Andersonin kulma

Tuomalla hajuaistin AI-kehitykseen

Uusi AI-tietokanta opettaa koneille haistamisen liittämällä hajudatan kuvien kanssa, jolloin mallit voivat yhdistää hajut esineisiin, kohteisiin ja materiaaleihin.

Ehkä siksi, että haju-ulostuslaitteet ovat niin kirjava historia, haistus on melko laiminlyöty aisti AI-tutkimuksessa. Ellei sinulla ollut aikomusta tuottaa toinen osa pitkäaikaisessa (yli vuosisadan) smell-o-vision-saagassa, käyttötarkoitukset ovat aina vaikuttaneet melko “niche” -tyyppisiltä verrattuna kuvien, äänien ja videoiden tietokantojen ja niistä koulutettujen AI-mallien hyödyntämismahdollisuuksiin.

Todellisuudessa mahdollisuus automatisoida, teollistaa ja tehdä suosittuun tietynlaisten havaintolaitteiden tarjoamista palveluista, kuten pommitkoirista, kuolintutkintakoira, sairauslajittelu koirista ja monista muista tyypeistä koira haistattimista, olisi merkittävä etu kunnallisissa ja turvallisuuspalveluissa. Vaikka kysyntä on korkea, tarjonta on ylittää tarjonnan, koulutus ja ylläpito havaintokoiria on kalliista liiketoimintaa, joka ei aina tarjoa hyvää vastinetta rahalle.

Tähän asti suurin osa tämän alan tutkimuksesta on rajoitettu laboratorioon, jossa on käytetty käsintehtyjä piirteitä – profiili, joka on enemmän keskittynyt räätälöityihin kotiteollisuusratkaisuihin kuin teollisiin sovelluksiin.

Edellä kuin nenä

Tähän melko tunkkaiseen ilmapiiriin tulee mielenkiintoinen uusi akateeminen/teollinen yhteistyö Yhdysvalloista, jossa tutkijaryhmä vietti useita kuukausia kartoittamassa monia eri hajuja sisä- ja ulkoalueilla New Yorkissa – ja ensimmäistä kertaa keräämällä kuvia, jotka liittyvät haistettuihin hajuihin:

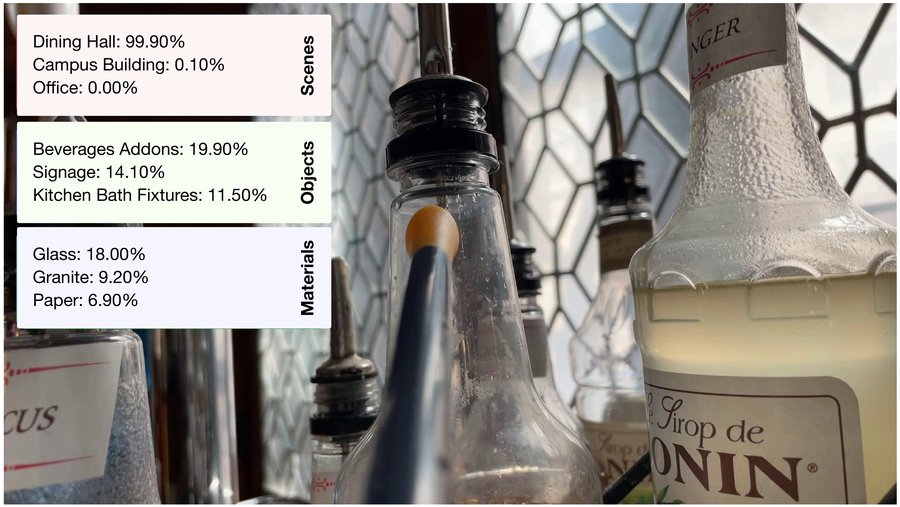

Huomaa keskellä oleva anturi, hajulaitteen ‘nenä’. Vain hajun perusteella koulutettu malli arvioi, haistaaanko granitti, muovia vai nahkaa – ja tunnistaa jopa huoneen, jossa se on, ilman yhtään kuvapistettä. Lähde

Tämä tutkimus on johtanut uuden työn kirjoittajia kehittämään uuden version erittäin suositusta Contrastive Language-Image Pretraining (CLIP) -kehyksestä, joka yhdistää tekstin ja kuvat, muodossa Contrastive Olfaction-Image Pretraining (COIP) – joka yhdistää hajut ja kuvat.

Yläosa: videon ja hajuanturin data kerätään luonnollisissa olosuhteissa käyttäen kamera-e-nenä-rigia. Alhaalla vasemmalla (b): yhteinen upotus opitaan ristimodaalisen itsevalvonnan kautta. (c): järjestelmä hakee visuaalisia vastineita pelkästään hajukyselyllä. (d): yksittäiset hajunäytteet käytetään ympäristön, kohteen ja materiaaliluokkien luokitteluun. (e): erittäin samankaltaiset hajut, kuten kaksi ruohotyyppiä, erottuvat ilman visuaalista syötettä. Lähde

Uusi tietokanta, joka on nimeltään New York Smells, sisältää 7 000 haju-kuvaparia, joissa on 3 500 eri esinettä. Kokeissa uusi data osoittautui ylittävän suositut käsintehtyjä piirteitä aiemmissa tietokannoissa.

Kirjoittajat toivovat, että heidän alkuvaiheensa avaa tien myöhempään ja jatkotutkimukseen hajuntunnistusjärjestelmiin, jotka on suunniteltu toimimaan villinä, samalla tavalla kuin haistattimet koirat*:

‘Me näemme tämän tietokannan askelena villiin, monitieteiseen hajuaistiin sekä askelena yhdistämään näkö ja haju. Vaikka hajuaisti on perinteisesti lähestytty rajoitettujen olosuhteiden kautta, kuten laadunvarmistuksessa, on monia sovelluksia luonnollisissa olosuhteissa.

‘Esimerkiksi ihmisinä käytämme jatkuvasti hajuaistiamme arvioidaksemme ruoan laadun, tunnistamaan vaarat ja havaitsemaan näkymättömiä esineitä.

‘Lisäksi monet eläimet, kuten koirat, karhut ja hiiret, osoittavat yliluonnollisia hajuaistimia kykyjä, mikä osoittaa, että ihmisen hajuaisti on kaukana koneiden rajoista.’

Vaikka uusi tutkimus, joka on nimeltään New York Smells: A Large Multimodal Dataset for Olfaction, lupaa, että data ja koodi julkaistaan, 27 GB:n tietotiedosto on jo saatavilla tutkimuksen projektisivustolta. Tutkimus tehtiin yhdeksän tutkijan toimesta Columbian yliopistosta, Cornellin yliopistosta ja Osmo Labsista.

Menetelmä

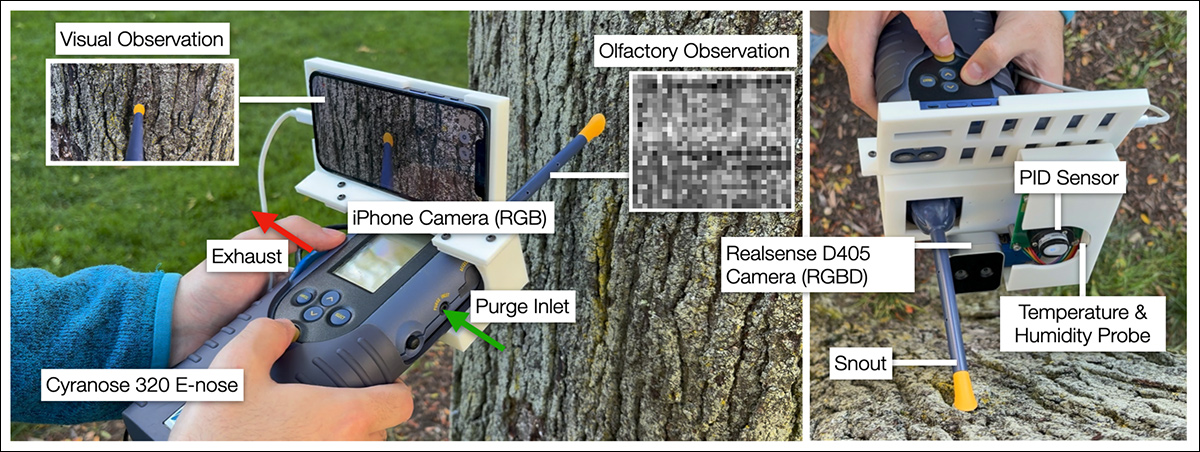

Kerätäkseen aineistoa uuteen kokoelmaan tutkijat käyttivät Cyranose 320 -sähköistä nenää, johon iPhone kiinnitettiin eteenpäin ottoaukon yläpuolelle tallentamaan visuaalisesti, mitkä hajut rekisteröitiin:

Kädessä pidettävä anturirunko kerää pareittain videon ja hajudatan käyttäen kamera-e-nenä-rigia. Nenä suunnataan esineisiin, kun taas poisto- ja puhdistusotto hallitsevat ilmavirtausta näytteenottotilanteessa. RGB-D-kamera tallentaa syvyyden, kun taas haihtuvien orgaanisten yhdisteiden (VOC) keskitys, lämpötila ja kosteus mitataan integroiduilla antureilla, mukaan lukien Proportional-integral-derivative (PID) -moduuli ja ympäristöanturi.

Cyranose-laitteessa on 2 Hz:n taajuus, joka tallentaa 32-ulotteisia hajuaikamuotoja. Haihtuvien orgaanisten yhdisteiden (VOC) pitoisuuksia mitattiin MiniPID2 PPM WR -anturilla.

Kannettava yksikkö toimi ketteränä anturina, joka välitti dataa enemmän laskentakelpoiselle matkustamoon prosessointia varten.

Kohdistamaan kohdehajun kontekstiin rekisteröitiin “perushaju”, ennen kuin kohde-esine kohdistettiin suoraan Cyranosen “nenään”. Taustanäyte otettiin sivuportista laitteessa, jotta se ei olisi saastunut pääasiallisesta hajulähteestä.

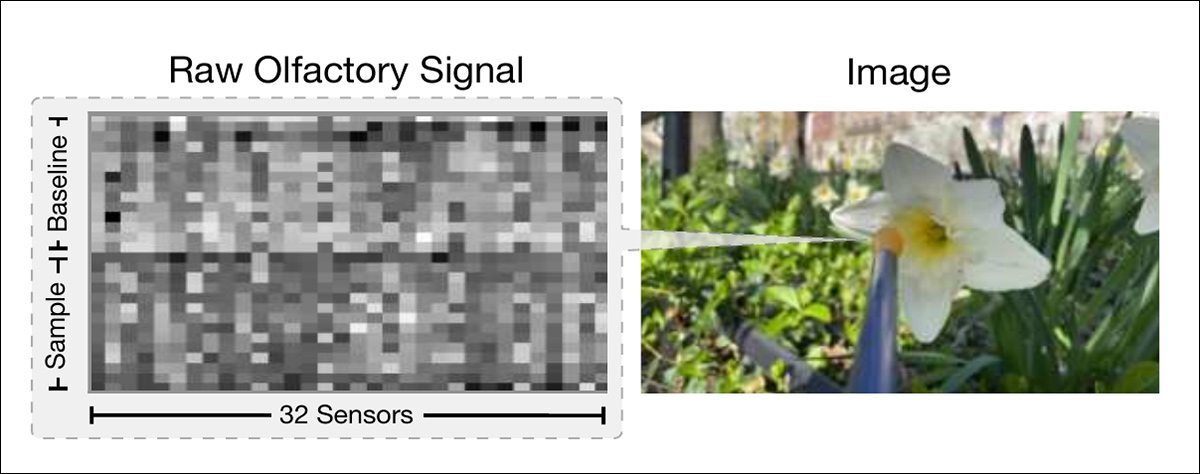

Kaksi näytettä otettiin pääsisäänkäynnin kautta, ja kummankin 10 sekunnin tallennus tehtiin eri asemasta esineen ympärillä parantamaan datan tehokkuutta. Näytteet yhdistettiin taustaperushajuun muodostamaan 28×32-matriisia, joka edustaa koko hajumittausta:

Tässä esimerkissä signaali ja vastaava kuva kukalle. Koko hajusignaali koostuu 28×32-matriisista, joka yhdistää 14-kehyksen taustaperushajun kahteen 10-sekunnin näytteeseen, jotka otettiin eri kulmista kohde-esineen ympärillä.

Data ja testit

Visuaaliset kieli-mallit (VLMs) käytettiin automaattisesti merkintänä esineille ja materiaaleille, jotka iPhone tallensi Cyranose-rungossa, ja GPT-4o käytettiin tehtävään; kuitenkin kohteen luokat merkittiin käsin:

Pieni otos laajasta kuvauksesta alkuperäisessä tutkimuksessa, jossa kerrotaan moninaisista hajulähteistä ja ympäristöistä, jotka kerättiin hankkeessa.

Tietokanta jaettiin koulutus- ja validointijakoihin, ja molemmat näytteet kustakin esineestä määriteltiin samalle jakolle estämään ristivirtaus. Lopullinen kokoelma koostuu 7 000 haju-näköparista, jotka on poimittu 3 500:sta merkinnätöntä esinettä, sekä 70 tuntia videota ja 196 000 aikamuotoa raakaa hajudataa sekä taustaperushajusta että näytteenottotilanteista.

Data kerättiin 60 istunnossa kahden kuukauden aikana, joka kattoi puistot, yliopistorakennukset, toimistot, kadut, kirjastot, asunnot ja ruokailutilat, ja useita istuntoja suoritettiin jokaisessa sijainnissa. Tuloksena oleva tietokanta sisältää 41 % ulko- ja 59 % sisäympäristöjä.

Jotta voidaan kehittää yleispäteviä hajuaistin edustuksia, kirjoittajat kouluttivat kontrastimallin liittämään synkronoidut kuva-hajuparit tietokannasta. Tämä lähestymistapa, edellä mainittu COIP, käyttää häviöfunktiota, joka on sovellettu CLIP:stä, jotta voidaan kohdistaa visuaalisten ja hajuaistimellisten signaalien upotuksia jaettuun edustusavaruuteen.

Koulutuksessa käytettiin sekä visuaalista koodaria että hajukoodaria, ja tavoitteena oli opettaa mallille yhdistämään vastaavat hajut ja kuvat lähemmäs toisiaan jaettussa edustusavaruudessa. Tuloksena olevat edustukset tukevat useita alihankkeita, kuten haju-kuva-haku, kohteen ja materiaalin tunnistus sekä hienojakoinen hajuerottelu.

Malli koulutettiin käyttäen kahta tyyppiä hajusyötettä: koko raaka anturisignaali ja tiivistetty käsintehty yhteenveto, jota kutsutaan hajupainoksi – laajasti käytettyjä piirteitä hajututkimuksessa, jotka pakkaavat kunkin anturin vastauksen yhteen lukuun vertaamalla huippuresistanssia näytteenottotilanteessa keskimääräiseen resistanssiin taustaperushajussa.

Sen sijaan raaka syöte, joka kerättiin ympäri New Yorkia, koostuu aikasarjasta 32 kemiallisesta anturista Cyranose-laitteessa, joka tallentaa, miten kunkin anturin sähkönjohtavuus muuttui ajan myötä, kun se reagoi hajuun.

Tietokannan kuratointiin tämä prosessoidu signaali syötettiin suoraan neuroverkkoon, jotta voidaan tehdä loppupään oppiminen joko konvoluutio – tai transformaattoriperusta. Mallit koulutettiin sekä hajupainoilla että raaka syötettä, joka kerättiin eri ympäristöistä New Yorkissa, ja molemmat syötteet arvioitiin kontrastiivisen oppimisen avulla.

Ristimodaalinen haku

Ristimodaalinen haku arvioitiin upottamalla kunkin hajunäytteen ja sen parin kuva jaettuun edustusavaruuteen ja testaamalla, voitiinko oikea kuva hakea pelkästään hajusyötteen perusteella.

Järjestys määriteltiin kuvan upotusläheyyden perusteella kyseisessä avaruudessa, ja suorituskyky mitattiin keskimääräisellä sijalla, mediaanisijalla ja palautusarvolla useilla kynnyksillä:

Ristimodaalisen haun tarkkuus eri hajukoodareilla, jotka osoittavat, miten hyvin kunkin malli tunnistaa oikean kuvan hajukyselyllä. Tulokset vertailevat arkkitehtuureja, jotka on koulutettu raakaa hajusignaaleja käyttäen, niitä, jotka käyttävät hajupainoja.

Tässä yhteydessä tutkijat toteavat:

‘Kontrastiivinen esikoulutus hajupainojen avulla suorittaa paremmin kuin sattuma kaikissa mitoissa. Kuitenkin hajukooderin kouluttaminen raakaan hajusignaaliin johtaa merkittäviin parannuksiin verrattuna hajupainokooderiin, riippumatta arkkitehtuurista.

‘Tämä osoittaa, että raaka hajudata sisältää rikkaampaa tietoa, joka avaa voimakkaampia ristimodaaalisia yhteyksiä näön ja hajun välillä.’

Yksityiskohta seitsemännestä kuvauksesta alkuperäisessä tutkimuksessa, joka on liian tiivis toistaa tässä. Tässä ristimodaalisen haun esimerkit, jotka osoittavat, miten malli liittää hajut vastaaviin kuviin. Kunkin rivin alku on hajukysely, ja sen jälkeen on kuvan parhaat arviot jaettussa upotusavaruudessa. Oikea kuva kunkin kyselyn kohdalla on viivattu vihreällä, osoittaen, miten hajut kirjoista, kasveista, muurauksesta ja muista materiaaleista vievät mallin visuaalisesti ja semanttisesti liittyviin kohteisiin.

Tutkijat huomauttavat myös, että hakutulokset osoittavat selviä semanttisia kuvioita:

‘Hakutulokset usein osoittavat semanttisia ryhmiä. Kirjan haju hakee kuvia muista kirjoista, lehtien haju hakee kuvia lehdistä.

‘Nämä tulokset osoittavat, että opittu edustus sisältää merkityksellisen ristimodaaalisen rakenteen.’

Kohteen, materiaalin ja ympäristön tunnistus

Mallin kykyä tunnistaa hajut ilman visuaalista syötettä arvioitiin kouluttamalla sitä tunnistamaan ympäristöjä, esineitä ja materiaaleja pelkästään hajudatan perusteella; tähän tarkoitukseen käytettiin jäädytettyä edustusta, johon koulutettiin yksinkertainen luokittelija.

Luokat johdettiin koulutusjoukon parista kuvista GPT-4o:n avulla – mutta ainoastaan hajusignaalia käytettiin luokittelussa.

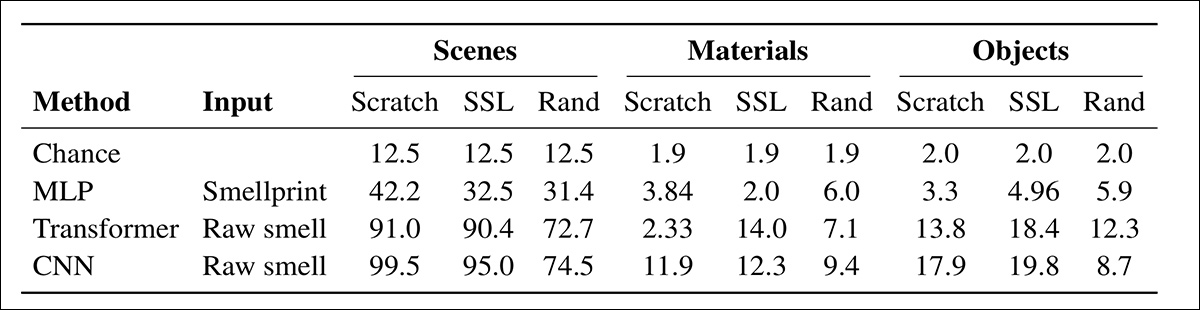

Useita kooderityyppejä testattiin: jotkut olivat satunnaisesti aloitettuja, jotkut koulutettiin alusta alkaen, ja jotkut koulutettiin kontrastiivisen oppimisen avulla yhdistämään haju ja näkö jaettuun edustusavaruuteen, ja arvioitiin sekä raakaa dataa että hajupainoja:

Luokittelun tarkkuus ympäristöille, materiaaleille ja esineille arvioitiin pelkästään hajusignaaleilla. Raaka anturisignaali suoritti paremmin kuin hajupainot, ja CNN:t, jotka koulutettiin alusta alkaen, antoivat korkeimmat tulokset, mukaan lukien 99,5 % ympäristöille. SSL-esikoulutus auttoi joissakin tapauksissa, mutta yleensä se ylittyi valvotulla koulutuksella. Satunnaiset painot osoittavat, että mallin kapasiteetti yksin osoittaa riittämättömäksi.

Merkitsevästi korkeampi tarkkuus saavutettiin, kun raakaa hajudataa käytettiin, erityisesti malleissa, jotka koulutettiin ristimodaaalisella valvonnalla. Tutkijat toteavat**:

‘Mallit, jotka koulutetaan raakaa aistisignaaleja käyttäen, saavuttavat myös korkeamman tarkkuuden kuin mallit, jotka koulutetaan käsintehtyjä hajupaino-ominaisuuksia käyttäen. Nämä tulokset osoittavat, että syvä oppiminen raakaa hajusignaaleista on merkittävästi parempaa kuin käsintehtyjä piirteitä.’

Hienojakoinen erottelu

Arvioidakseen, voidaanko hienojakoisia hajuerotteluja oppia, rakennettiin vertailu kahden ruoholajin välillä, jotka coexistivat samalla kampuksen nurmikolla. Vuorotellen otettiin näytteitä kuuden 30 minuutin istunnon aikana, mikä tuotti 256 esimerkkiä. Lineaarinen luokittelija koulutettiin hajun ja kuvan kontrastiivisen oppimisen piirteistä, ja arvioitiin pidätetyssä joukossa 42 näytteestä:

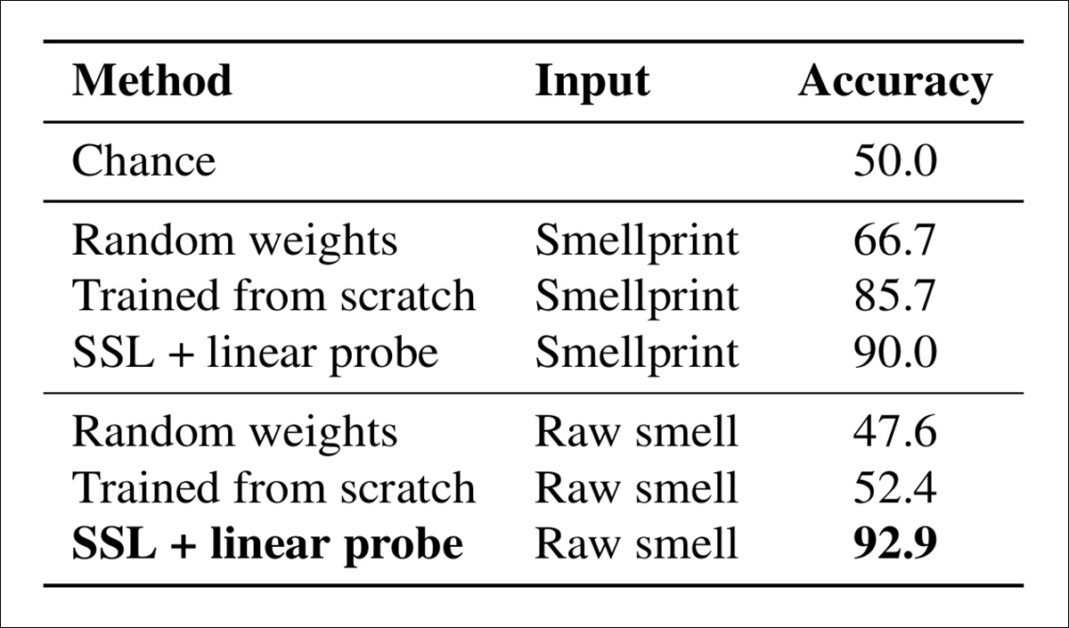

Ruoholajien luokittelun tarkkuus pelkästään hajun perusteella. Mallit arvioitiin niiden kyvystä erottaa kaksi visuaalisesti samankaltaista ruohotyyppiä pelkästään hajusyötteen perusteella. Suorituskyky vertailtiin hajupainojen ja raaka anturidatan välillä, ja malleja arvioitiin, jotka joko olivat satunnaisesti aloitettuja, koulutettu alusta alkaen tai koulutettu itseopillisella oppimisella (SSL) ja lineaarisella luokittelijalla. Korkein tarkkuus, 92,9 %, saavutettiin käyttäen raakaa hajusignaalia SSL:llä, osoittaen, että hienojakoiset hajuerot ovat parhaiten pyydystettävissä raaka syötettä ja visuaalista koulutusta käyttäen.

Tässä yhteydessä tutkijat toteavat:

‘Kouluttaminen raakaan hajuanturisignaaliin (sen sijaan, että käytettäisiin käsintehtyjä piirteitä) antaa korkeimman tarkkuuden – ylittäen kaikki hajupainoihin perustuvat variantit.

‘Nämä tulokset osoittavat, että hajun ja kuvan oppiminen säilyttää enemmän hienojakoisia tietoja kuin oppiminen hajupainojen avulla, ja että visuaalinen valvonta tarjoaa signaalin, joka hyödyntää tätä tietoa.’

Johtopäätös

Vaikka hajusynteesi näyttää todennäköisesti jäävän ratkaisemattomaksi jonkin aikaa, tehokas ja edullinen villi hajuanalyysijärjestelmällä on valtava potentiaali, ei ainoastaan poliisi-, turvallisuus- ja lääketieteellisissä tarkoituksissa, vaan myös elämänlaadun ja kaupunkiseurannan seurannassa.

Tällä hetkellä laitteistoon liittyvät laitteet ovat yleensä erikoistuneita ja usein hyvin kalliita; siksi todellinen edistysaskel “hajuaisti-AI”:ssa havaintojen tunnistamiseksi vaatii todennäköisesti näkemystä ja edullista anturia Raspberry PI -hengessä.

* Minun muunnos kirjoittajien sisäisistä viittauksista hyperlinkkeihin.

** Huomaa, että lisäkuvia (kuva 8) on saatavilla alkuperäisessä tutkimuksessa, mutta ne ovat parhaiten katsottavissa siinä.

Julkaistu ensimmäisen kerran perjantaina 28. marraskuuta 2025