Andersonin kulma

Oikeudellinen tietomenetelmä uuden sukupolven deepfake-kuvien tutkimiseen

Vaikka yksityishenkilöiden deepfaking on muodostunut kasvavaksi julkiseksi huolenaiheeksi ja sitä kriminalisoidaan yhä enemmän eri alueilla, on todistaminen, että käyttäjän luoma malli – kuten sellainen, joka mahdollistaa kostopornon – on erityisesti koulutettu tietylle henkilölle, edelleen erittäin haasteellista.

Ongelman ymmärtämiseksi: avainaspekti deepfake-hyökkäyksessä on väittää, että kuva tai video esittää tiettyä henkilöä. Pelkästään väittämällä, että joku videossa on identiteetti #A eikä vain ulkonäöltään samankaltainen, on riittävästi vahinkoa, eikä AI:ta tarvita tässä skenaariossa.

Kuitenkin, jos hyökkääjä luo AI-kuvia tai -videoita malleilla, jotka on koulutettu oikean henkilön tietojen avulla, sosiaalisen median ja hakukoneiden kasvojentunnistusjärjestelmät linkittävät automaattisesti väärennetyn sisällön uhriin – ilman, että nimeä tarvitsee mainita viesteissä tai metatiedoissa. AI:lla luodut visuaaliset aineistot varmistavat yhdistämisen.

Mitä erottuvampi henkilön ulkonäkö on, sitä välttämättömämpää tämä tulee, kunnes väärennetty sisältö näkyy kuvahauissa ja lopulta saavuttaa uhrin.

Kasvojen tunnistus

Yleisin tapa levittää identiteettiin keskittyneitä malleja on tällä hetkellä Low-Rank Adaptation (LoRA), jossa käyttäjä kouluttaa pienen määrän kuvia muutamaksi tunniksi suuremman perusmallin painojen vastaan, kuten Stable Diffusion (pääasiassa statisiille kuville) tai Hunyuan Video, video-deepfakeille.

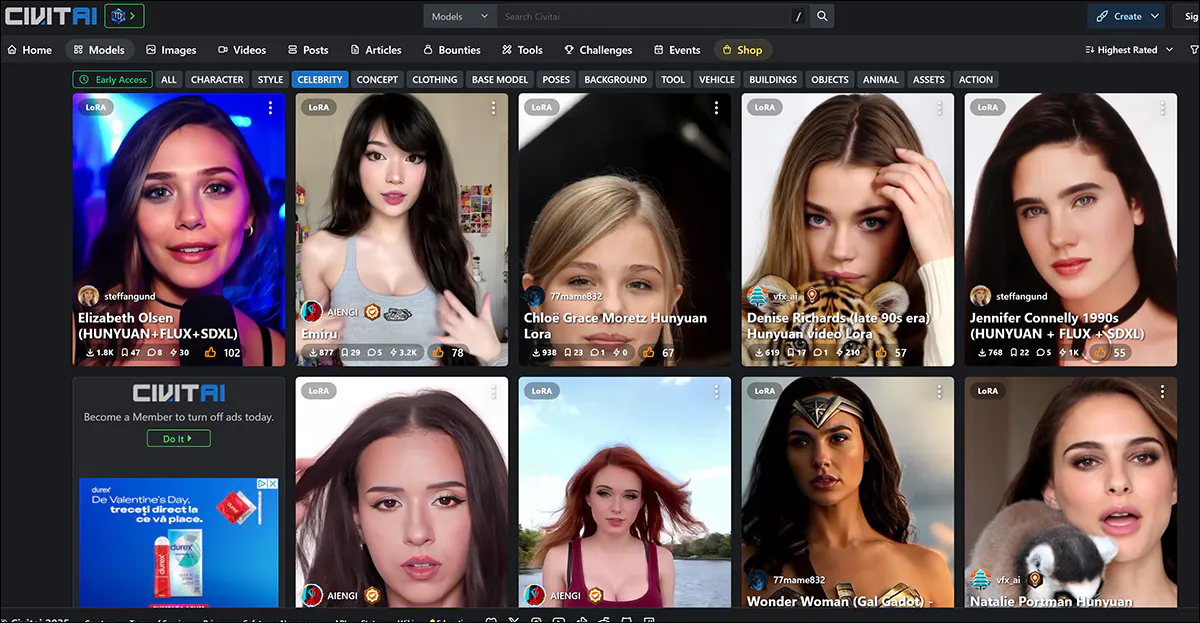

Yleisimmät kohteet LoRA:lle, mukaan lukien uusi sukupolvi videoon perustuvia LoRA:ja, ovat naispuoliset julkkikset, joiden maine altistaa heidät tällaiselle kohtelulle vähemmän julkista arvostelua kuin “tuntemattomien” uhrien kohdalla, oletetun “oikean käytön” (ainakin Yhdysvalloissa ja Euroopassa) vuoksi.

Naispuoliset julkkikset hallitsevat LoRA- ja Dreambooth-listauksia civit.ai-portaalissa. Suosituin LoRA:lla on tällä hetkellä yli 66 000 latausta, mikä on merkittävää, koska tämä AI:n käyttö nähdään edelleen “reuna-aiheena”.

Ei ole julkinen foorumi ei-julkkisuhreille, jotka pääsevät julkisuuteen vain, kun syytteitä nostetaan tai uhrit puhuvat suoraan suosituissa medioissa.

Kuitenkin, molemmissa skenaarioissa, mallit, joilla väärennetään kohteen identiteetti, ovat “tiivistäneet” koulutusaineistonsa niin täydellisesti latenttiavaruuteen mallissa, että on vaikea tunnistaa alkuperäiset kuvat, jotka käytettiin.

Jos olisi mahdollista tehdä tämä hyväksyttävän virhemarginaalin puitteissa, se mahdollistaisi niiden jakamisen, jotka jakavat LoRA:ja, koska se osoittaa aikomusta väärentää tietyn identiteetin (ts. tietyn “tuntemattoman” henkilön, vaikka malefaktori ei mainitse heitä koskaan defamaatioprosessin aikana), ja altistaa lataajat tekijänoikeusloukkauksille, missä sovellettavissa.

Jälkimmäinen olisi hyödyllistä oikeusalueilla, joissa syväväärennösten teknologian sääntely on puutteellista tai jäänyt jälkeen.

Ylipaljastus

Perusmallin, kuten useiden gigatavujen perusmallin, jonka käyttäjä lataa Hugging Facen kautta, koulutuksen tavoitteena on, että malli tulisi hyvin yleistetty ja taipuisa. Tämä vaatii koulutusta riittävällä määrällä monipuolisilla kuvilla ja sopivilla asetuksilla, ja koulutuksen lopettamista ennen kuin malli “ylisovittaa” tietoihin.

Ylisovittunut malli on nähnyt tietoja niin monta (liian monta) kertaa koulutusprosessin aikana, että se taipuu tuottamaan kuvia, jotka ovat hyvin samankaltaisia, paljastaen koulutusaineiston lähteen.

Identiteetti ‘Ann Graham Lotz’ voidaan melkein täydellisesti reproduktoida Stable Diffusion V1.5-mallissa. Rekonstruktio on lähes identtinen koulutusaineistoon (vasemmalla yllä olevassa kuvassa). Lähde: https://arxiv.org/pdf/2301.13188

Kuitenkin ylisovittuneet mallit hylätään yleensä luojien toimesta eikä niitä jaeta, koska ne eivät ole muutenkaan soveltuvia tarkoitukseen. Tämä on epätodennäköinen oikeudellinen “tuuri”. Kaiken kaikkiaan periaate soveltuu enemmän kalliiden ja suurivolyymisten perusmallien koulutukseen, jossa useat versiot samasta kuvasta, jotka ovat päässeet suureen lähdeaineistoon, voivat tehdä tiettyjen koulutuskuvien kutsumisen helppoa (ks. kuva ja esimerkki yllä).

Asiat ovat hieman erilaiset LoRA- ja Dreambooth-mallien (vaikka Dreambooth on jäänyt muodista sen suurten tiedostokokojen vuoksi) kohdalla. Tässä käyttäjä valitsee hyvin rajatun määrän monipuolisia kuvia aiheesta ja käyttää niitä kouluttamaan LoRA:ta.

Vasemmalla, Hunyuan Video LoRA:n tuotos. Oikealla, aineisto, joka mahdollisti muistumisen (käytetty henkilön luvalla).

Usein LoRA:lla on koulutettu laukaiseva sana, kuten [julkkisen nimi]. Kuitenkin usein erityisesti koulutettu aihe ilmestyy generoiduissa tuotoksissa ilman tällaisia kehotuksia, koska jopa hyvin tasapainotun (ts. ei ylisovitetun) LoRA:n on jonkinlainen “fiksatio” aineistoon, jolle se on koulutettu, ja se taipuu sisällyttämään sitä mihin tahansa tuotokseen.

Tämä taipumus, yhdistettynä rajoitettuun määrään kuvia, joita on optimaalista LoRA-aineistoon, altistaa mallin oikeudelliselle analyysille, kuten nähdään.

Paljastaminen

Nämä asiat käsitellään uudessa tutkimuksessa Tanskasta, joka tarjoaa metodologian alkuperäisten kuvien (tai kuvaryhmien) tunnistamiseksi mustalaatikkomuodossa Membership Inference Attack (MIA):ssa. Tekniikka sisältää ainakin osittain mukautettujen mallien käytön, jotka on suunniteltu paljastamaan alkuperäisen aineiston luomalla omia “deepfake”-kuviaan:

Esimerkkejä “väärennettyjä” kuvia, jotka on luotu uudella lähestymistavalla, aina kasvavilla tasolla Classifier-Free Guidance (CFG):aa, tuhoutumispisteeseen asti. Lähde: https://arxiv.org/pdf/2502.11619

Vaikka työ, joka on nimeltään Membership Inference Attacks for Face Images Against Fine-Tuned Latent Diffusion Models, on mielenkiintoinen panos kirjallisuuteen tästä aiheesta, se on myös ei-asiassa kirjoitettu tutkimus, joka tarvitsee huomattavaa koodaamista. Siksi käsittelimme ainakin periaatteita tämän projektin takana ja valikoiman tuloksia, jotka saavutettiin.

Käytännössä, jos joku kouluttaa AI-mallin kasvoillasi, tutkijoiden menetelmä voi auttaa osoittamaan sen etsimällä merkkejä muistamisesta mallin generoimissa kuvissa.

Ensimmäisessä vaiheessa kohdemalli koulutetaan kasvojensa kuville, mikä tekee siitä todennäköisemmän, että se toistaa yksityiskohtia näistä kuvista tuotoksissaan. Tämän jälkeen hyökkäysmalli koulutetaan käyttäen AI:lla luotuja kuvia kohdemallista “positiivisina” (epäiltyinä jäseninä koulutusjoukossa) ja muita kuvia eri aineistosta “negatiivisina” (ei-jäseninä).

Opimalla hienot erot näiden ryhmien välillä hyökkäysmalli voi ennustaa, onko tietty kuva ollut osa alkuperäistä koulutusaineistoa.

Hyökkäys on tehokkain tapauksissa, joissa AI-malli on koulutettu laajasti, mikä tarkoittaa, että mitä enemmän malli on erikoistunut, sitä helpompi on havaita, onko tiettyjä kuvia käytetty.

Tämä on hyödyllistä tapauksissa, joissa LoRA:ta on suunniteltu jäljittelemään julkkiksia tai yksityishenkilöitä.

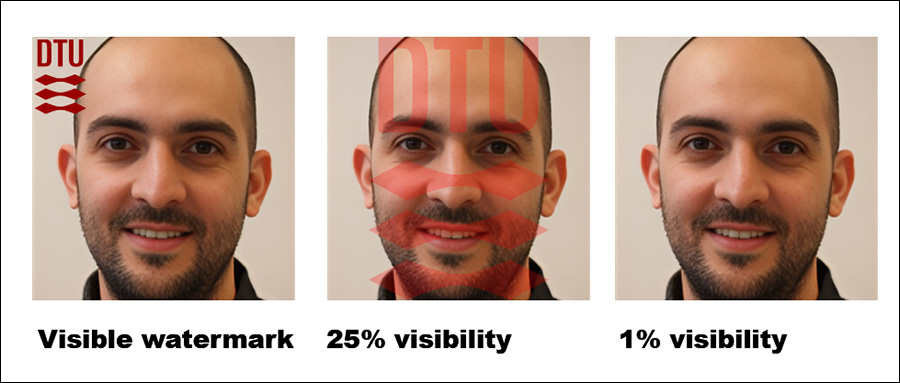

Tutkijat totesivat myös, että näkyvien vesileimojen lisääminen koulutuskuviin tekee havaitsemisen helpommaksi – vaikka piilotetut vesileimat eivät auta paljonkaan.

Menetelmä testattiin mustalaatikkomuodossa, mikä tarkoittaa, että se toimii ilman pääsyä mallin sisäisiin yksityiskohtiin, ainoastaan sen tuotoksiin.

Lähestymistapa on laskennallisesti intensiivinen, kuten tutkijat myöntävät; kuitenkin tämän työn arvo on osoittaa, että data voidaan realistisesti poistaa hyväksyttävään toleranssiin; siksi, sen seminaalisen luonteen vuoksi, se ei tarvitse toimia älypuhelimen tasolla tässä vaiheessa.

Menetelmä/Data

Useita Tanskan Teknillisen Yliopiston (DTU) aineistoja, jossa tutkimuksen kolme tutkijaa toimivat, käytettiin tutkimuksessa kohdemallin kouluttamiseen ja hyökkäysmallin koulutukseen ja testaamiseen.

Käytetyt aineistot olivat peräisin DTU Orbit:ista:

DseenDTU Peruskuva-aineisto.

DDTU Kuvat haettu DTU Orbitista.

DseenDTU DDTU:n osajoukko, jota käytettiin kohdemallin kouluttamiseen.

DunseenDTU DDTU:n osajoukko, jota ei käytetty kouluttamaan kuvagenerointimallia, vaan sen sijaan käytettiin hyökkäysmallin koulutukseen tai testaamiseen.

wmDseenDTU DDTU:n osajoukko, johon on lisätty näkyviä vesileimoja, ja jota käytettiin kohdemallin kouluttamiseen.

hwmDseenDTU DDTU:n osajoukko, johon on lisätty piilotettuja vesileimoja, ja jota käytettiin kohdemallin kouluttamiseen.

DgenDTU Kuvat, jotka on luotu Latent Diffusion Model (LDM):llä, joka on koulutettu DseenDTU-kuva-aineistolla.

Kohdemallin koulutukseen käytetyt aineistot koostuvat kuva- ja tekstipareista, joita on kuvattu BLIP-kuvauksella (ehkä ei sattumalta yksi suosituimmista sensuroimattomista malleista vapaaehtoisessa AI-yhteisössä).

BLIP asetettiin esittämään lauseen ‘a dtu headshot of a’ jokaisen kuvauskohteen eteen.

Lisäksi useita Aalborgin Yliopiston (AAU) aineistoja käytettiin testeissä, jotka kaikki perustuivat AU VBN-korpukselle:

DAAU Kuvat haettu AAU VBN:stä.

DseenAAU DAAU:n osajoukko, jota käytettiin kohdemallin kouluttamiseen.

DunseenAAU DAAU:n osajoukko, jota ei käytetty kouluttamaan kuvagenerointimallia, vaan sen sijaan käytettiin hyökkäysmallin koulutukseen tai testaamiseen.

DgenAAU Kuvat, jotka on luotu LDM:llä, joka on koulutettu DseenAAU-kuva-aineistolla.

Vastaa edellisiä joukkoja, lause ‘a aau headshot of a’ käytettiin. Tämä varmisti, että kaikki DTU-aineiston tunnisteet seurasivat muotoa ‘a dtu headshot of a (…)’, vahvistaen aineiston ydinaspekteja koulutuksen aikana.

Testit

Useita kokeita tehtiin arvioidakseen, miten hyvin jäsenyyden tunnistus hyökkäykset suorittivat kohdemallia vastaan. Jokainen testi pyrki määrittämään, onko mahdollista suorittaa onnistunut hyökkäys skeemassa, jossa kohdemalli on koulutettu kuva-aineistoon, joka on hankittu ilman valtuutusta.

Lähestymistavan skeema.

Kohdemalli koulutetaan ja käsketään generoimaan tuotokset, jotka käytetään positiivisina esimerkkeinä hyökkäysmallin koulutukseen, kun taas muita kuvia eri aineistosta käytetään negatiivisina esimerkkeinä.

Hyökkäysmalli koulutetaan valvotulla oppimisella ja testataan uusilla kuvilla määrittämään, olivatko ne osa alkuperäistä aineistoa, jolla kohdemalli koulutettiin.

Tulosten arvioimiseksi 15 % testidatan määrästä pidetään erillään vahvistamiseksi.

Koska kohdemalli on koulutettu tunnetulla aineistolla, todellinen jäsenyyden tila on jo määritelty, kun hyökkäysmallin koulutusaineistoa luodaan.

Tässä ohjatussa asetelmassa voidaan arvioida selvästi, miten hyökkäysmalli voi erottaa kuvat, jotka olivat osa koulutusaineistoa, ja ne, jotka eivät olleet.

Stable Diffusion V1.5 käytettiin testeissä. Vaikka tämä vanhempi malli tulee esiin usein tutkimuksessa tarpeen mukaan, tämä on soveltuva käyttötapa; V1.5 säilyi suositeltuna LoRA-luomisessa Stable Diffusion -harrastelijayhteisössä pitkään, vaikka useita myöhempiä versioita julkaistiin, ja vaikka Flux tuli markkinoille – koska malli on täysin sensuroimaton.

Tutkijoiden hyökkäysmalli perustui Resnet-18:iin, jossa mallin esikoulutetut painot säilytettiin. ResNet-18:n 1000-neuronin viimeinen kerros korvattiin täysin yhdistetyllä kerroksella, jossa on kaksi neuronia. Koulutuksen häviö oli kategoria cross-entropy, ja Adam-optimointi käytettiin.

Jokaisessa testissä hyökkäysmalli koulutettiin viisi kertaa eri satunnaisilla siemenillä laskemaan 95 %:n luottamusvälejä avainmittareille. Zero-shot -luokittelu CLIP -mallilla käytettiin vertailukohtana.

(Huomaa, että alkuperäinen päättöösaikaisten tulosten taulukko tutkimuksessa on tiivis ja poikkeuksellisen vaikea ymmärtää. Siksi olen uudelleenmuotoillut sen alla ystävällisemmässä muodossa. Klikkaa kuvaa nähdäksesi sen paremmassa resoluutiossa)

Tutkijoiden hyökkäysmenetelmä osoittautui tehokkaimmaksi kohdistuessaan koulutettuihin malleihin, erityisesti niihin, jotka on koulutettu tietylle joukolle kuvia, kuten yksityishenkilön kasvoille.

Kuitenkin, vaikka hyökkäys voi määrittää, käytettiinkö tiettyä aineistoa, se kamppailee yksittäisten kuvien tunnistamisen kanssa.

Käytännössä jälkimmäinen ei välttämättä ole este oikeudellisessa tutkimuksessa; kun hyökkääjä ei-julkkista kohtaan (ei julkkista) on todennäköisesti vähemmän valinnanvaraa lähdemateriaaleja, ja heidän on täytettävä saatavilla olevat data-ryhmät, kuten sosiaalisen median albumit ja muut online-kokoelmat. Nämä luovat “hashin”, jonka voidaan paljastaa menetelmin, josta on kysymys.

Tutkimus toteaa, että toinen tapa parantaa tarkkuutta on käyttää AI:lla luotuja kuvia “ei-jäseninä”. Tämä estää keinotekoiset korkeat onnistumisprosentit, jotka muuten voivat johtaa tuloksiin.

Lisäksi yksi tekijä, joka vaikuttaa havaitsemiseen, on vesileimaukset. Kun koulutuskuviin on lisätty näkyviä vesileimoja, hyökkäys on erittäin tehokas, kun taas piilotetut vesileimat eivät tarjoa juurikaan etua.

Oikeanpuoleinen kuva näyttää todellisen “piilotetun” vesileiman, jota käytettiin testeissä.

Lopulta, teksti-kuvan generoinnin ohjausasteella on myös rooli. Ihanteellinen tasapaino löytyy noin 8 ohjausasteikolla. Vaikka ei suoraa kehotusta käytetä, koulutettu malli tuottaa silti tuotoksia, jotka muistuttavat sen koulutusaineistoa, vahvistaen hyökkäyksen tehokkuutta.

Johtopäätös

On valitettavaa, että tämä mielenkiintoinen tutkimus on kirjoitettu niin ei-asiassa. Se olisi mielenkiintoista sekä yksityisyyden puolustajille että vapaaehtoisille AI-tutkijoille.

Vaikka jäsenyyden tunnistus hyökkäykset voivat osoittautua kiinnostaviksi oikeudellisiksi välineiksi, on ehkä tärkeämpää, että tämä tutkimussuunta kehittää soveltuvia yleisiä periaatteita, jotta se ei joutuisi samaan “pata-ja-munkki”-peliin, johon syväväärennösten havaitseminen on joutunut yleensä.

Koska on joitakin viitteitä korkeamman tason ohjaavasta periaatteesta tässä uudessa tutkimuksessa, voimme toivoa näkevämme enemmän työtä tässä suunnassa.

Julkaistu ensimmäisen kerran perjantaina 21. helmikuuta 2025