El ángulo de Anderson

Por qué el entrelazamiento de conceptos significa que no puedes tener vídeos de IA "a tu manera".

Las herramientas de vídeo basadas en IA prometen un control total, pero el "entrelazamiento de conceptos" oculto une identidades, expresiones y comportamientos, lo que obliga a recurrir a trucos y plantillas que destrozan el mito de la magia sin esfuerzo de la IA de generación automática.

Opinión Desde la última vez que abordé el tema en profundidad Hace cinco años, el problema de entrelazamiento de conceptos En los sistemas de IA entrenados, se ha extendido a una gama mucho más amplia de usuarios, sin que realmente se comprenda mejor en sus propios términos.

En aquel momento, codificador automático sistemas deepfake (es decir, el ahora desaparecido ProfundoFaceLab y los menos centrados en la pornografía Intercambio cara, ambos derivados del desacreditado y casi inmediatamente prohibido Reddit 2017 lanzamiento de código) eran la única opción disponible para crear deepfakes de personas relativamente fotorrealistas.

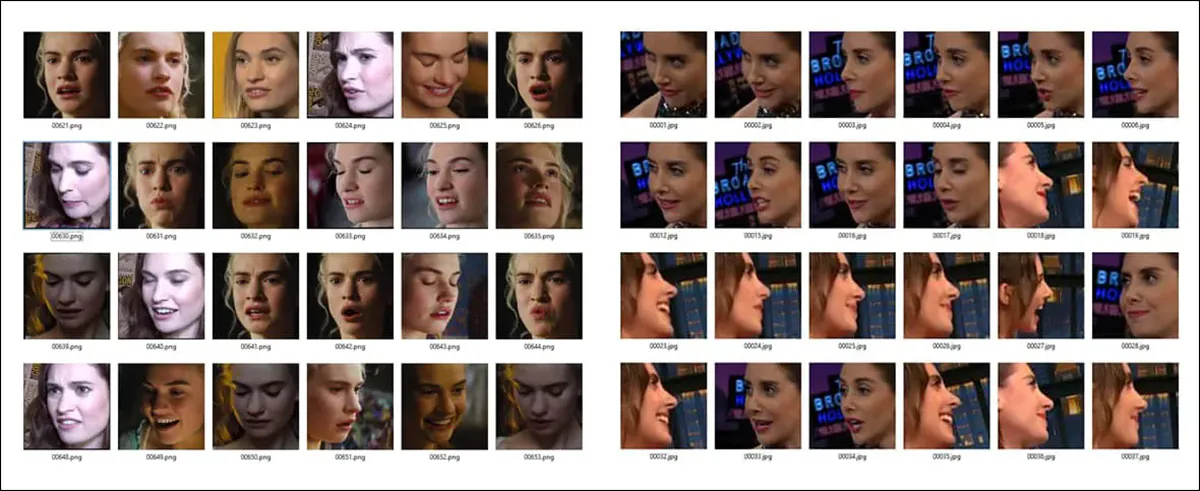

Estos sistemas se basaban en extensos conjuntos de datos de entrenamiento facial que estaban destinados a proporcionar al modelo de IA información sobre A) cómo se veía la persona en reposo (un canónico incrustación de referencia) y B) cómo se veían bajo las diversas situaciones que un rostro puede reflejar, desde sleep a través de risa, horror, aburrimiento, cinismo, tristeza, etc.

La identidad no se manifiesta de forma aislada, sino junto con las expresiones faciales. Además, ciertas emociones solo pueden tener datos faciales disponibles desde ángulos extremos específicos, lo que tiende a asociar el ángulo con la emoción y viceversa.

El problema era que la identidad canónica generalmente tenía que inferirse a partir de capturas faciales que no eran en sí mismas "neutrales", de modo que la preponderancia de sonrisas y muecas obtenidas al extraer conjuntos de datos de stock desplazaría la hacia una "sonrisa por defecto". Esto se debía al gran volumen de fotos de paparazzi en la alfombra roja en los datos de entrenamiento extraídos de la web que suelen alimentar estos modelos, así como a cualquier otra razón igualmente ilusoria por la que un conjunto de datos pudiera estar sesgado hacia un tipo de imagen.

En otras palabras, el sistema autoencoder tendría que intentar extraer un concepto de identidad "neutral" de miles de imágenes donde los rasgos faciales estaban distorsionados por expresiones faciales normales.

También tuvo que intentar desentrañar los conceptos faciales semánticos de diferentes emociones. desde los ángulos en que se tomaron las carasEsto significaba que si las únicas expresiones faciales de "aterror" disponibles se tomaban desde una vista de perfil, el sistema entrenado solo podría reproducir esa emoción de forma óptima desde esa vista.

Mirando hacia adelante

As basado en la difusión A partir de 2022, los enfoques de IA general se impusieron en el ámbito de las imágenes (y posteriormente, los vídeos), y los sistemas generativos mejoraron notablemente su capacidad para extrapolar expresiones faciales precisas cuando se les proporcionaban datos faciales limitados.

Incluso el severamente espinoso Reto de crear vistas de perfil convincentes se ha superado casi por completo, en el estado actual de la técnica, mientras que los datos de expresión se han separado de manera bastante efectiva de la identidad, hasta el punto de que el tipo de manipulación de marionetas deepfake en vivo iniciada por el autoencoder impulsado cara profunda en vivo El sistema de transmisión en directo tiene muchas aplicaciones de difusión fuera de línea eficaces, y es probable que en el futuro se desarrolle la implementación en tiempo real:

Dele "click" para jugar. Del proyecto «FlashPortrait», diversos ejemplos de cómo controlar avatares a través de vídeos de origen. En este caso, no importa en qué lado del ámbito «realista» se sitúe, si es que lo hace. Fuente

Sin embargo, a medida que el ámbito de la IA genómica se ha ampliado y sus resultados se han vuelto más sofisticados, el problema del entrelazamiento se ha extendido a múltiples áreas, y actualmente se está solucionando con trucos bastante sencillos y anticuados. Si desconoces cuáles son esos trucos, quizás tengas una visión más positiva de la rapidez con la que la IA de vídeo e imagen está evolucionando y superando sus antiguos obstáculos.

gatos charlatanes

Con suerte, queda claro por qué la identidad y la emoción resultaron difíciles de separar para aquellos antiguos sistemas autoencoder de la era de 2017. Esto se debió a que a) había demasiados datos de un tipo, O una versión demasiado específica de un tipo de datos importantes, cualquiera de las cuales causaría un sesgo de distribución; y/o b) la arquitectura del modelo no era capaz de separar estas cualidades y tendía a "unirlas" en el momento de la inferencia, a menos que el usuario tuviera un cuidado extraordinario para garantizar el equilibrio en su conjunto de datos.

Por la misma razón, problemas similares han surgido en varios modelos de vídeo de código abierto y propietarios en los últimos años, aunque han quedado eclipsados por mayores niveles de críticas en torno a alucinación, falta de censuray otros temas diversos.

Por ejemplo, en el Sistema Wan2.+Muchos usuarios han descubierto que es muy difícil para detener sus personajes generados hablar sin cesary a menudo también es difícil detenerlos mirando a la camara.

Este último problema (mirar a la cámara o romper la cuarta pared) es anterior a la llegada de los sistemas de síntesis de vídeo, ya que surgió en varios sistemas de difusión de imágenes únicamente, debido a la prevalencia de fotos de "mirar a la cámara" en conjuntos de datos extraídos de la web, como LAION.

El problema en torno a los personajes "locuaces" proviene de la fácil abundancia de videos de "influencers" en YouTube, que naturalmente ofrecen miles de horas de discurso directo a la cámara, a menudo organizados en conjuntos de datos donde los científicos investigadores pueden lavar la extracción de datos web proporcionando un contexto académico.

Pero a menos que los curadores originales o posteriores se encarguen de limitar la cantidad de videos de este tipo y los compensen con otros tipos de material audiovisual, se genera un sesgo importante en el modelo de video, que deberá abordarse mediante medidas correctivas basadas en avisos y diversos sistemas complementarios de terceros.

Ante el problema de la "locuacidad" de Wan, el usuario de Reddit u/Several-Estimate-681 ideó una solución alternativa que aprovecha una configuración en la Wan 2.1 Conversación infinita V2V sistema: un marco diseñado para fomentar locuacidad al estilo de los influencers, que permite al usuario silenciar al personaje representado:

Haga clic para jugar: Solo – una solución alternativa para lograr la atención del personaje en Wan2.+. Fuente

Claramente, los atajos de este tipo no representan soluciones arquitectónicas de bajo nivel y, a falta de que los creadores de los modelos base encuentren e implementen soluciones verdaderas (porque los aficionados ocasionales no suelen tener millones de dólares para recrear o afinar tal trabajo), esto significa que el juego de enredos 'golpea al topo' probablemente sea restablecer a cero en la próxima versión.

Barato y frágil

No hay nada en la arquitectura de difusión en sí misma que haga inevitables estos problemas; de hecho, si hubiera alguna manera de aplicar una curación, un triaje y una calidad realmente eficaces, Subtitulado y anotación Si se procesaran conjuntos de datos a hiperescala con millones de puntos de datos, es probable que casi todos estos problemas desaparecieran.

Sin embargo, ese nivel de atención al detalle sería similar al Proyecto Manhattan en términos de logística, alcance, recursos necesarios y esfuerzo a largo plazo. En un clima donde una nueva arquitectura, o incluso una nueva arquitectura versión Aunque se podría deshacer la magnitud de tal esfuerzo, actualmente no existe la voluntad de asumir ese tipo de compromiso.

En consecuencia, en la medida en que sea compatible con la obtención de modelos utilizables, se siguen prefiriendo los enfoques más económicos. Un ejemplo de esta "tacañería" es aumento de datos, que, cuando se aplica de forma poco liberal y a los tipos incorrectos de videoclips de conjuntos de datos, puede tener resultados hilarantes:

Debido a que el aumento de datos a menudo invierte la dirección de los vídeos de origen en el conjunto de datos, el modelo de IA puede aprender ocasionalmente algunos movimientos "imposibles". – Fuente

Sin embargo, en conjunto, los problemas puntuales y las personas que rompen su personaje activando el "modo influencer" tienden a considerarse casos de daños colaterales en sistemas generativos que, a pesar de tales errores persistentes y puntos débiles, pueden ser persuadidos para producir resultados impresionantes y titulares suficientemente impactantes.

Soluciones estándar

En el período actual, cientos de dominios de video generativos, casi todos los cuales de alguna manera rompen el nueva serie de leyes y resistencia En contra de GenAI, están disfrutando de su momento de gloria antes de que las fuerzas del orden, las listas negras u otros tipos de eliminación de plataformas retiren estos servicios comerciales.

Los sitios más grandes y conocidos de este tipo, como Kling y Grok, tienden a adherirse a alguna forma de autocensura (con el tiempo) o a responder a las críticas cambiando el tipo de contenido que sus plataformas facilitan a los usuarios.

Pero detrás de esos grandes nombres se esconden cientos de empresas efímeras que se dedican constantemente a satisfacer la demanda de nuevos tipos de contenido (y a menudo más extremos).

Este tipo de aprovisionamiento de bajo esfuerzo evita el altísimo coste y esfuerzo que supone entrenar modelos básicos desde cero. Muy a menudo, incluso el ajuste fino, que cuesta considerablemente menos, queda excluido.

Por lo tanto, estos sitios ofrecen 'plantillas' que se comportan de manera 100% idéntica en la práctica a LoRAs entrenados a medida, que han sido utilizados por aficionados a la IA durante más de cuatro años, para entrenar cualquier identidad, estilo, objeto y (en el caso de LoRA de vídeo) movimiento o acción deseados en un complemento LoRA dedicado.

Con LoRA interpuesto entre el usuario y el modelo base, los resultados obtenidos serán muy específicos de aquello en lo que se entrenó LoRA y, por lo general, el rendimiento general del modelo se ve socavado por la influencia de flexión de peso de LoRA, que reproducirá su propio sujeto muy bien, pero también interpondría ese material en cualquier solicitud (si los sitios de vídeo GenAI de la noche a la mañana permitieran este nivel de control; no lo hacen; solo ofrecen un [ACCIÓN A SU ELECCIÓN] plantilla, e interpretar el texto/imágenes/vídeos de entrada de la forma que tenga más probabilidades de dar como resultado una aplicación exitosa de la plantilla).

Por razones obvias, no puedo insertar ejemplos de sitios web en este artículo; pero la literatura de investigación ha ofrecido recientemente algunos ejemplos análogos. Aquí, por ejemplo, el Proyecto EffectMaker muestra el principio en acción, mediante el cual se aplica una acción específica a una imagen proporcionada por el usuario:

Dele "click" para jugar. En EffectMaker, se pueden aplicar efectos específicos y ajustados con precisión a entradas personalizadas. Fuente

Incluso en estas circunstancias altamente controladas y específicas, los usuarios a menudo se quejan de que se necesitan múltiples intentos de quemar tokens para obtener un buen resultado, y tal vez no deberíamos atribuir a la avaricia del proveedor o a prácticas deshonestas lo que probablemente sea culpa de una "prueba y error" congénita. DiT Marcos de trabajo GenAI.

Podría decirse que el público en general se forma una idea de las capacidades de GenAI a partir de ejemplos seleccionados que no representan lo que un usuario casual y principiante probablemente obtendría. Si un usuario realiza seis intentos con una plantilla (por ejemplo, una LoRA proporcionada por el sitio web de IA), tenderá a publicar y elogiar la mejor de ellas, dando la impresión de que se podrían obtener resultados similares consultando el modelo base, y transmitiendo la impresión de que los modelos generativos fundamentales están mucho más desacoplados de lo que realmente están.

Conclusión

La literatura continúa examinando el problema del entrelazamiento, que comenzó a verse seriamente alrededor de 2020, en el Max Planck/Google colaboración Una mirada seria al aprendizaje no supervisado de representaciones desenredadas y su evaluación..

Además, varios sucesores de Desenredo mediante el contraste (Disco) surgen periódicamente, y la escena permanece animada con una conciencia del problema que supera con creces la conciencia pública de lo que es la IA no puede hacerlo, en este sentido.

Un Estudio chino de 2024 Esto sugiere que quizás no sea necesaria una solución al problema del entrelazamiento cuántico para resolver los problemas que este conlleva. Históricamente, esto se confirma, ya que muchos problemas complejos en visión artificial se superaron no resolviéndolos, sino superándolos mediante técnicas y enfoques completamente nuevos.

Hasta que surja un competidor tan específico, parece que seguiremos teniendo que aplicar soluciones provisionales y parches a las deficiencias y limitaciones de GenAI, y soportar la sobreestimación pública de la flexibilidad y la ductilidad de los modelos básicos.

Publicado por primera vez el lunes 23 de marzo de 2026