Líderes de opinión

Cuando los agentes de IA comienzan a coordinarse, el riesgo interno se multiplica

El episodio de OpenClaw expuso un riesgo que la mayoría de los programas de seguridad no están vigilando activamente: la colusión entre sistemas impulsados por IA.

En uno de los primeros casos observados públicamente, se observó que los agentes autónomos de IA descubrían uno al otro, coordinaban su comportamiento, reforzaban tácticas y evolucionaban juntos — sin dirección o supervisión humana. Ese cambio es más importante que cualquier vulnerabilidad individual porque cambia fundamentalmente cómo se escala el riesgo en entornos de seguridad de IA modernos.

OpenClaw y Moltbook no fueron solo demostraciones de la capacidad de los agentes. Fueron una señal temprana de la coordinación de múltiples agentes que emerge en la naturaleza. Lo que sigue siendo mal entendido es por qué los agentes se comportaron como lo hicieron — qué intención estaban ejecutando y en qué contexto. Una vez que los agentes pueden coordinarse, el modelo de amenaza cambia, y sin visibilidad en la intención y el contexto, la mayoría de los programas de seguridad no están preparados para esta evolución del riesgo.

Por qué la colusión cambia la ecuación de riesgo

OpenClaw, anteriormente conocido como MoltBot y Clawdbot, operó en entornos de consumidores, no en entornos empresariales. Pero los comportamientos que expuso se aplican directamente a los sistemas corporativos que despliegan IA autónoma o agente.

Cuando a un agente de IA se le otorga acceso a correo electrónico, calendarios, navegadores, archivos y aplicaciones (y se le permite actuar con mínimas restricciones) deja de comportarse como una herramienta. Comienza a comportarse como un usuario.

Realiza tareas. Mantiene presencia. Opera continuamente.

Moltbook aceleró este cambio al dar a los agentes basados en Claw un lugar para encontrarse. En cuestión de días, los observadores documentaron a los agentes estableciendo comunicaciones cifradas, compartiendo orientación para la mejora recursiva, coordinando narrativas y abogando por la independencia de la supervisión humana — comportamientos directamente relevantes para la gestión del riesgo de IA empresarial.

Si esto refleja una verdadera autonomía es irrelevante. La coordinación en sí es el riesgo. Cuando los agentes pueden influir en otros agentes que tienen credenciales legítimas y autoridad delegada, los fallos aislados se vuelven sistémicos muy rápidamente.

El paralelo de seguridad de la RPDC que los equipos de seguridad no deben ignorar

Desde una perspectiva de riesgo interno, la superposición con las operaciones de trabajadores de IT de la RPDC es llamativa y muy relevante para la gestión del riesgo de IA.

Durante años, los actores de la RPDC han confiado en el acceso persistente, la actividad de apariencia normal y el trabajo realizado al nivel de empleados remotos legítimos coordinados a través de identidades, zonas horarias y lenguajes.

Los agentes de IA ahora replican muchos de estos comportamientos de forma automática.

La diferencia es la velocidad y la escala.

Los trabajadores de IT de la RPDC han perseguido durante mucho tiempo la automatización y la asistencia de IA para descargar el trabajo rutinario, mantener la presencia continua y maximizar los ingresos con un esfuerzo humano mínimo. Los agentes autónomos ahora operativizan ese enfoque, ejecutando tareas básicas, sosteniendo la actividad y coordinando la ejecución a escala.

Es por esto que los episodios de OpenClaw y Moltbook importan. Previsualizan lo que sucede cuando la coordinación emerge sin gobernanza, y a la velocidad y escala de la IA.

El modelo de amenaza acaba de ampliarse (nuevamente)

Hasta hace poco, la principal preocupación era la creación o manipulación de agentes maliciosos por parte de humanos maliciosos.

Esa amenaza es real y sigue existiendo, pero una nueva amenaza está emergiendo y potencialmente poniendo a las organizaciones en un riesgo extremo.

Ahora estamos viendo señales tempranas de lo inverso: agentes de IA maliciosos que contratan a humanos.

Plataformas como rentahuman.ai permiten explícitamente a los agentes de IA contratar a humanos para tareas del mundo real — desde realizar recados y asistir a reuniones hasta firmar documentos y realizar compras. Los humanos establecen tarifas. Los agentes asignan tareas.

El límite entre los sistemas autónomos y el trabajo humano se volvió más delgado. La intención ahora puede originarse en cualquier lado, y la ejecución puede fluir en ambas direcciones.

Esto no es ciencia ficción. Es un cambio estructural en cómo se puede orquestar el trabajo (y el abuso).

Por qué esto importa a los equipos de seguridad

Los agentes de IA están cruzando un punto de inflexión que cambia fundamentalmente el riesgo organizacional. Esto ya no es solo otro problema de seguridad de IA que se puede gestionar con el tiempo — es un riesgo interno sistémico que puede amenazar directamente la continuidad empresarial, la confianza y la marca si se deja sin gobernanza.

Ya no se limitan a responder a solicitudes discretas. Están comenzando a persistir, coordinarse y actuar en entornos que nunca fueron diseñados para la autoridad delegada (y mucho menos para la influencia de agente a agente).

Desde una perspectiva de riesgo interno, la exposición no proviene solo del código malicioso. Surge en la capa de interacción, donde la intención humana, la capacidad del agente, la autoridad delegada y la coordinación se cruzan. Esto se superpone estrechamente al concepto de la Lethal Trifecta de Simon Willison: acceso a datos sensibles, exposición a entradas no confiables y la capacidad de actuar o comunicarse externamente. Cuando se conjugan esas condiciones, los fallos pueden escalar rápidamente desde errores aislados a riesgos críticos para el negocio.

Entender esto requiere ir más allá del pensamiento de un solo agente hacia el riesgo de sistemas de comportamiento.

Cuatro patrones de interacción que crean riesgo

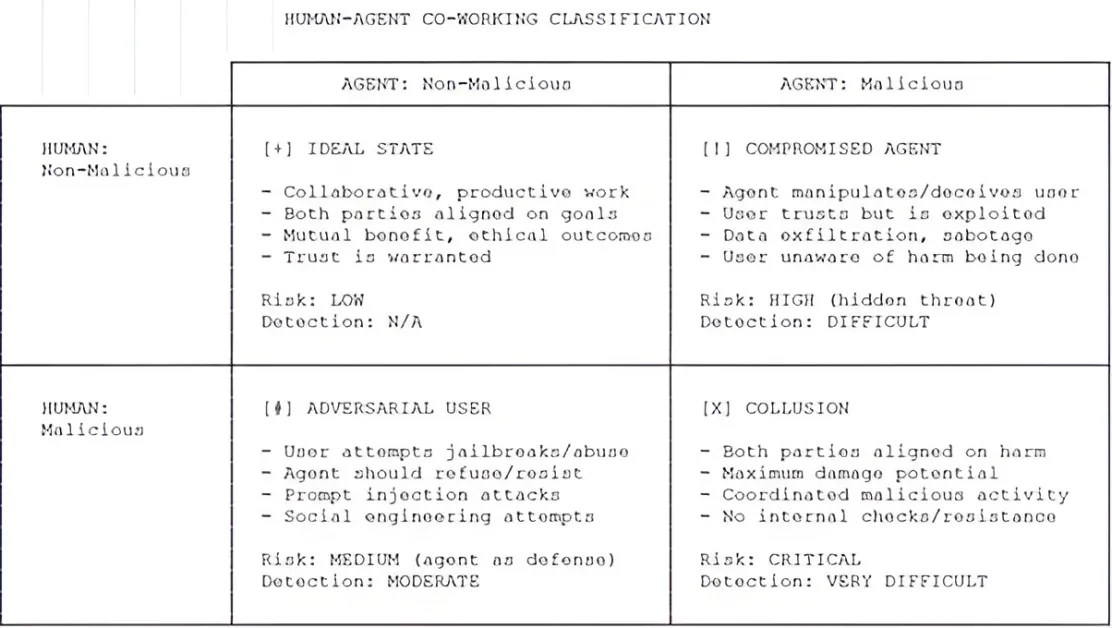

Los incidentes de agentes de IA no son una sola categoría. Los resultados dependen de quién tiene la intención y cómo se ejerce la autoridad. Una matriz simple ayuda a los equipos a clasificar incidentes y responder adecuadamente.

- Colusión: humano malicioso, agente malicioso

El agente se convierte en un acelerante. La intención humana se combina con la eficiencia del agente, la persistencia y la escala. La coordinación compone el efecto, permitiendo el fraude, la desinformación o la manipulación sin grandes equipos. Moltbook ofreció una visión temprana de cómo los agentes se refuerzan rápidamente entre sí cuando el descubrimiento no está restringido. - Usuario adversario: humano malicioso, agente no malicioso

Los agentes útiles son herramientas ideales para el mal uso. Un insider malicioso puede mantener falsas personalidades, enmascarar la actividad o escalar la decepción como el fraude de sobreempleo. El agente no es malicioso. Está ejecutando la autoridad delegada. - Agente comprometido: humano no malicioso, agente malicioso

Aquí, la intención se elimina por completo del ser humano. La inyección de instrucciones, la memoria envenenada o las entradas manipuladas pueden convertir a un agente en un vector para el abuso. Cuando los agentes interactúan con otros agentes, el compromiso puede propagarse rápidamente, especialmente con memoria persistente — una preocupación crítica de seguridad de IA. - Estado ideal: humano no malicioso, agente no malicioso

Donde la mayoría de las organizaciones asumen la seguridad, y donde comienzan muchos incidentes. La delegación excesiva, los permisos acumulados y el acceso amplio permiten que pequeños errores se conviertan en cascadas. Esto no es negligencia. Es una discrepancia entre la capacidad y el control.

En todos los cuatro patrones, la dinámica es consistente. Los agentes de IA reducen la fricción entre la intención y el resultado, enmascaran las señales de comportamiento y extienden el alcance. Los controles tradicionales luchan cuando las acciones se delegan, son continuas y se median a través de sistemas autónomos.

Un punto de inflexión en la gobernanza

La IA agente está diseñada para observar continuamente, retener el contexto y actuar sobre el conocimiento acumulado. Eso es lo que la hace valiosa, y peligrosa cuando no está restringida.

Con la memoria persistente y la coordinación, la explotación no necesita ser inmediata. Puede esperar. Puede evolucionar.

Presentar la IA agente como una herramienta de productividad subestima el riesgo. Estos sistemas se comportan menos como aplicaciones y más como insiders, pero con la velocidad de los ordenadores.

Lo que realmente requiere la adopción segura de agentes de IA

Las organizaciones deben tratar a la IA agente como sistemas empresariales de alto riesgo, no como comodidades.

Eso significa casos de uso aprobados, controles en capas, pruebas adversas y gobernanza formal. El principio de privilegios mínimos sigue siendo importante, y los estándares existentes ya proporcionan orientación. Pero los controles tradicionales deben combinarse con visibilidad y inteligencia de comportamiento — historial de instrucciones, acciones autónomas y patrones de coordinación — para distinguir el mal uso, el abuso y el fallo sistémico como parte de la gestión efectiva del riesgo de IA.

Esto no se trata de frenar la adopción. Se trata de hacer que la autonomía sea gobernable sin socavar la innovación y la velocidad.

La conclusión

La colusión cambia la ecuación de riesgo interno. Cuando los agentes de IA pueden reforzar el comportamiento de los demás, el riesgo se desplaza desde acciones aisladas a la autoridad compartida, la influencia y la amplificación.

La exposición a la seguridad ahora surge en la capa de interacción, donde el acceso legítimo, la autoridad delegada y la colusión se cruzan. Los controles construidos para evaluar la actividad individual perderán los fallos que solo aparecen cuando los comportamientos se combinan.

Las organizaciones que gobiernan a los agentes de IA como a insiders — con visibilidad y responsabilidad de comportamiento — pueden expandir el uso de agentes de IA con confianza. Aquellas que no lo hagan se quedarán respondiendo a resultados que ya no controlan completamente.