Inteligencia artificial

Las limitaciones de Amazon Mechanical Turk pueden amenazar los sistemas de generación de lenguaje natural

Un nuevo estudio de la Universidad de Massachusetts Amherst ha enfrentado a maestros de inglés contra trabajadores de crowdsourcing en Amazon Mechanical Turk para evaluar la salida de los sistemas de Generación de Lenguaje Natural (NLG), concluyendo que los estándares laxos y el ‘juego’ de tareas valoradas entre los trabajadores de AMT podrían estar obstaculizando el desarrollo del sector.

El informe llega a una serie de conclusiones condenatorias sobre la medida en que la subcontratación a gran escala y barata de tareas de evaluación de NLG de código abierto podría llevar a resultados y algoritmos inferiores en este sector.

Los investigadores también compilaron una lista de 45 artículos sobre generación de texto de código abierto donde la investigación había utilizado AMT, y encontraron que ‘la gran mayoría’ no informaron detalles críticos sobre el uso del servicio de multitud de Amazon, lo que dificultó la reproducción de los hallazgos de los artículos.

Trabajo en condiciones de taller

El informe critica tanto la naturaleza de taller de Amazon Mechanical Turk como los proyectos académicos (probablemente limitados por el presupuesto) que están prestando a AMT más credibilidad al utilizarlo (y citarlo) como un recurso de investigación válido y consistente. Los autores observan:

‘Si bien AMT es una solución conveniente y asequible, observamos que la alta variabilidad entre los trabajadores, la mala calibración y las tareas cognitivamente exigentes pueden llevar a los investigadores a sacar conclusiones científicas engañosas (por ejemplo, que el texto escrito por humanos es “peor” que el de GPT-2)’).

El informe culpa al sistema en lugar de a los jugadores, con los investigadores observando:

‘Los trabajadores de la multitud a menudo están mal pagados por su trabajo, lo que perjudica tanto la calidad de la investigación como, más importante aún, la capacidad de estos trabajadores de la multitud para ganar un salario digno.’

El artículo, titulado Los peligros de usar Mechanical Turk para evaluar la generación de texto de código abierto, concluye además que ‘calificadores expertos’ como maestros de lenguas y lingüistas deberían utilizarse para evaluar el contenido artificial de NLG de código abierto, incluso si AMT es más barato.

Tareas de prueba

Al comparar el rendimiento de AMT con lectores expertos menos limitados por el tiempo, los investigadores gastaron $144 en los servicios de AMT que se utilizaron en las pruebas de comparación (aunque se gastó mucho más en ‘resultados no utilizables’ – véase a continuación), requiriendo que trabajadores aleatorios de ‘Turks’ evaluaran uno de 200 textos, divididos entre contenido de texto creado por humanos y texto generado artificialmente.

Hacer que los maestros profesionales realizaran el mismo trabajo costó $187.50, y confirmó su superior rendimiento (en comparación con los trabajadores de AMT) al contratar a freelancers de Upwork para replicar las tareas costó $262.50 adicionales.

Cada tarea consistió en cuatro criterios de evaluación: gramática (‘¿Cuán gramaticalmente correcto es el texto del fragmento de la historia?’}); coherencia (‘¿Cómo encajan las oraciones del fragmento de la historia?’}); simpatía (‘¿Cuán agradable encuentra el fragmento de la historia?’}); y relevancia (‘¿Cuán relevante es el fragmento de la historia para la llamada?’}).

Generación de textos

Para obtener material de NLG para las pruebas, los investigadores utilizaron el conjunto de datos de 2018 de Facebook AI Research Generación de historias neuronales jerárquicas dataset, que comprende 303,358 historias en inglés compuestas por usuarios en el subreddit muy popular (15 millones de usuarios) r/writingprompts, donde las historias de los suscriptores se ‘siembran’ con oraciones ‘llamadas’ de una sola oración de una manera similar a las prácticas actuales en generación de imagen a texto – y, por supuesto, en sistemas de generación de lenguaje natural de código abierto sistemas.

Se seleccionaron aleatoriamente 200 llamadas del conjunto de datos y se pasaron por un modelo GPT-2 de tamaño medio utilizando la biblioteca Hugging-Face Transformers library. Así se obtuvieron dos conjuntos de resultados a partir de las mismas llamadas: los ensayos discursivos escritos por humanos de los usuarios de Reddit y los textos generados por GPT-2.

Para evitar que los mismos trabajadores de AMT juzgaran la misma historia varias veces, se solicitaron tres juicios de trabajadores de AMT por ejemplo. Junto con experimentos sobre las capacidades del idioma inglés de los trabajadores (ver final del artículo) y descartando resultados de trabajadores de poco esfuerzo (ver ‘Tiempo corto’ a continuación), esto aumentó el gasto total en AMT a alrededor de $1,500 USD.

Para crear un campo de juego nivelado, todas las pruebas se realizaron entre semana entre las 11:00 a. m. y las 11:30 a. m. PST.

Resultados y conclusiones

El estudio abarca mucho terreno, pero los puntos clave son los siguientes:

Tiempo corto

El artículo encontró que el tiempo de tarea promedio informado por Amazon de 360 segundos se redujo a un tiempo de trabajo real de solo 22 segundos, y un tiempo de trabajo mediano de solo 13 segundos – un cuarto del tiempo que tomó el más rápido maestro de inglés que replicó la tarea.

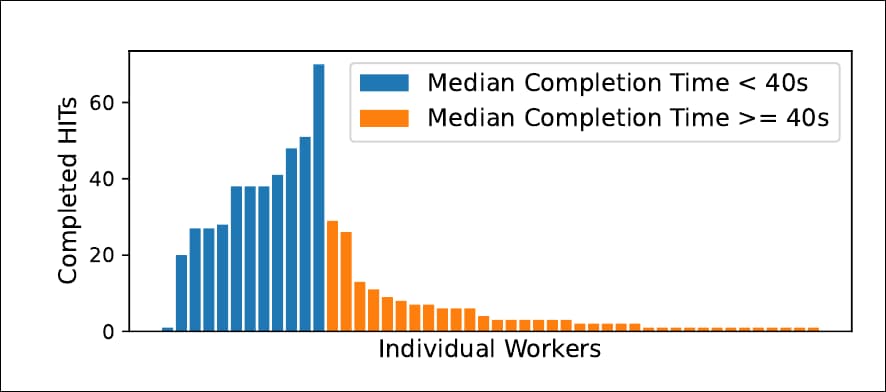

Desde el día 2 del estudio: los trabajadores individuales (en naranja) pasaron notablemente menos tiempo evaluando cada tarea que los maestros mejor pagados, y (más tarde) los contratistas de Upwork mejor pagados. Fuente: https://arxiv.org/pdf/2109.06835.pdf

Dado que AMT no impone límite en las Tareas de Inteligencia Humana (HIT) que un trabajador individual puede aceptar, han surgido ‘grandes golpeadores’ de AMT, con (rentables) reputaciones por completar altos números de tareas por experimento. Para compensar los golpes aceptados por el mismo trabajador, los investigadores midieron el tiempo entre HIT consecutivos presentados, comparando el tiempo de inicio y fin de cada HIT. De esta manera, la diferencia entre el WorkTimeInSeconds informado por AMT y el tiempo real dedicado a la tarea se puso de relieve.

Dado que tal trabajo no se puede realizar en estos marcos de tiempo reducidos, los investigadores tuvieron que compensar por esto:

‘Como es imposible leer cuidadosamente un fragmento de historia de longitud de párrafo y evaluar todas las cuatro propiedades en solo 13 segundos, medimos el impacto en las calificaciones promedio cuando se filtran los trabajadores que pasan muy poco tiempo por HIT…Específicamente, eliminamos los juicios de los trabajadores cuyo tiempo mediano es inferior a 40 s (que es una barra baja), y encontramos que en promedio alrededor del 42% de nuestras calificaciones se filtran (que van desde el 20% -72% en todos los experimentos) ‘.

El artículo sostiene que el tiempo de trabajo real mal informado en AMT es ‘un problema importante’ que normalmente pasa desapercibido para los investigadores que utilizan los servicios.

Se necesita mano de obra especializada

Los hallazgos sugieren además que los trabajadores de AMT no pueden distinguir de manera fiable entre el texto escrito por un humano y el texto escrito por una máquina, a menos que vean ambos textos uno al lado del otro, lo que comprometería efectivamente un escenario de evaluación típico (donde el lector debería poder hacer un juicio basado en una sola muestra de texto, ‘real’ o generado artificialmente).

Aceptación casual de texto artificial de baja calidad

Los trabajadores de AMT calificaron consistentemente el texto artificial de baja calidad basado en GPT en el mismo nivel que el texto coherente de mayor calidad escrito por humanos, en contraste con los maestros de inglés, que pudieron distinguir fácilmente la diferencia en la calidad.

Sin tiempo de preparación, cero contexto

Entrar en la mentalidad correcta para una tarea tan abstracta como la evaluación de la autenticidad no viene de manera natural; los maestros de inglés requirieron 20 tareas para calibrar sus sensibilidades al entorno de evaluación, mientras que los trabajadores de AMT normalmente no reciben ‘tiempo de orientación’ en absoluto, lo que reduce la calidad de su entrada.

Jugando con el sistema

El informe sostiene que el tiempo total que los trabajadores de AMT dedican a tareas individuales se infla con trabajadores que aceptan múltiples tareas simultáneamente y pasan por las tareas en diferentes pestañas de sus navegadores, en lugar de concentrarse en una tarea durante la duración del task registrada.

El país de origen es importante

La configuración predeterminada de AMT no filtra a los trabajadores por país de origen, y el informe señala trabajos anteriores que indican que los trabajadores de AMT utilizan VPN para sortear las restricciones geográficas, lo que permite a los no hablantes nativos presentarse como hablantes nativos de inglés (en un sistema que, quizás de manera bastante ingenua, equipara la lengua materna de un trabajador con su ubicación geográfica basada en IP).

Así, los investigadores volvieron a ejecutar las pruebas de evaluación en AMT con filtros que limitaban a los posibles participantes a no países de habla inglesa, encontrando que ‘los trabajadores de países no de habla inglesa calificaron la coherencia, la relevancia y la gramática…significativamente más bajos que los trabajadores idénticamente calificados de países de habla inglesa’.

El informe concluye:

‘Los calificadores expertos, como lingüistas o maestros de lenguas, deben utilizarse siempre que sea posible, ya que ya han sido capacitados para evaluar textos escritos, y no es mucho más caro…’

Publicado el 16 de septiembre de 2021 – Actualizado el 18 de diciembre de 2021: se agregaron etiquetas