Ángulo de Anderson

Enseñar a una IA olvidadiza a ‘recordar eso’ durante más tiempo

Los modelos de lenguaje a menudo no pueden recordar el inicio de una conversación. Un nuevo método de compresión de texto podría cambiar eso y hacer que las sesiones de chat de IA sean mucho menos frustrantes.

Los sistemas de IA conversacional como ChatGPT a menudo pierden la pista de las partes anteriores de una conversación, repitiéndose o dando respuestas que ignoran las reglas previamente acordadas.

Esto se debe a que los Grandes Modelos de Lenguaje (LLMs) tienen una capacidad limitada para enfocarse, definida como una ‘ventana de contexto’ de atención – como una linterna que solo puede iluminar lo que está directamente apuntado y unos pocos objetos adyacentes.

Arreglar tales tendencias ‘amnésicas’, que se deben a estas limitaciones en la atención, es una de las direcciones de investigación más importantes en modelos de IA basados en lenguaje – no menos porque este síndrome limita severamente la posibilidad de conversaciones multi-giro útiles y coherentes, y obstaculiza la utilidad de los LLMs en una variedad de contextos críticos en términos de precisión, como la medicina y la ley.

Aplicación

Una nueva investigación de China† está proponiendo un método novedoso para hacer que una cantidad significativamente mayor de texto quepa en los recursos limitados de una GPU que ejecuta un modelo de IA – con resultados que logran una mejora de compresión de 20 veces mientras retiene el 98% de precisión:

![Context Cascade Compression reconstruye documentos largos más precisamente que los métodos de compresión óptica como DeepSeek-OCR, incluso cuando se reduce la entrada hasta cuarenta veces. A lo largo de una gama de longitudes de documento y ajustes de compresión, el nuevo método mantiene una fidelidad casi perfecta, mientras que el enfoque óptico se degrada bruscamente bajo una mayor compresión. Fuente [ https://arxiv.org/pdf/2511.15244 ]](https://www.unite.ai/wp-content/uploads/2025/11/c3-tokens-per-page.jpg)

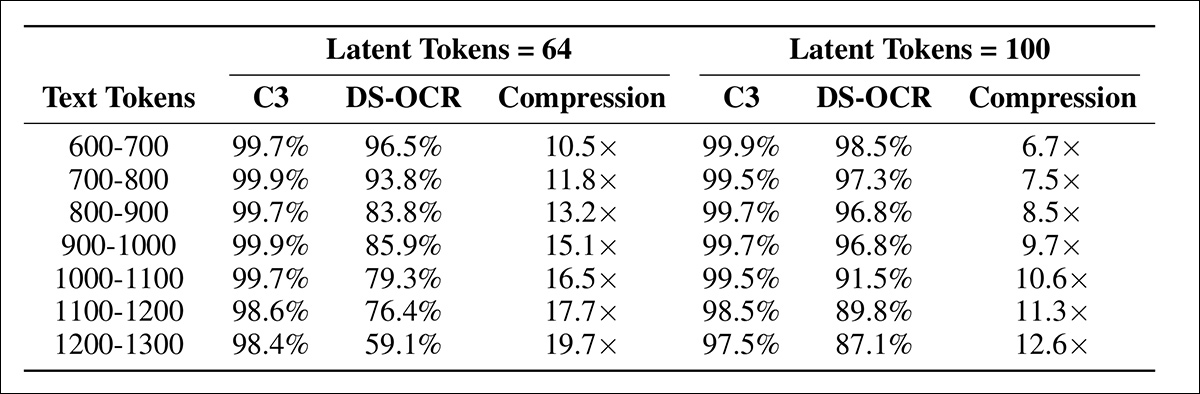

Context Cascade Compression (C3) reconstruye documentos largos más precisamente que los métodos de compresión óptica como DeepSeek-OCR, incluso cuando se reduce la entrada hasta cuarenta veces. A lo largo de una gama de longitudes de documento y ajustes de compresión, el nuevo método mantiene una fidelidad casi perfecta, mientras que el enfoque óptico se degrada bruscamente bajo una mayor compresión. Fuente

Con una precisión del 93% – que está dentro de los parámetros de trabajo – la compresión de texto incluso puede lograr una relación de compresión de 40x:

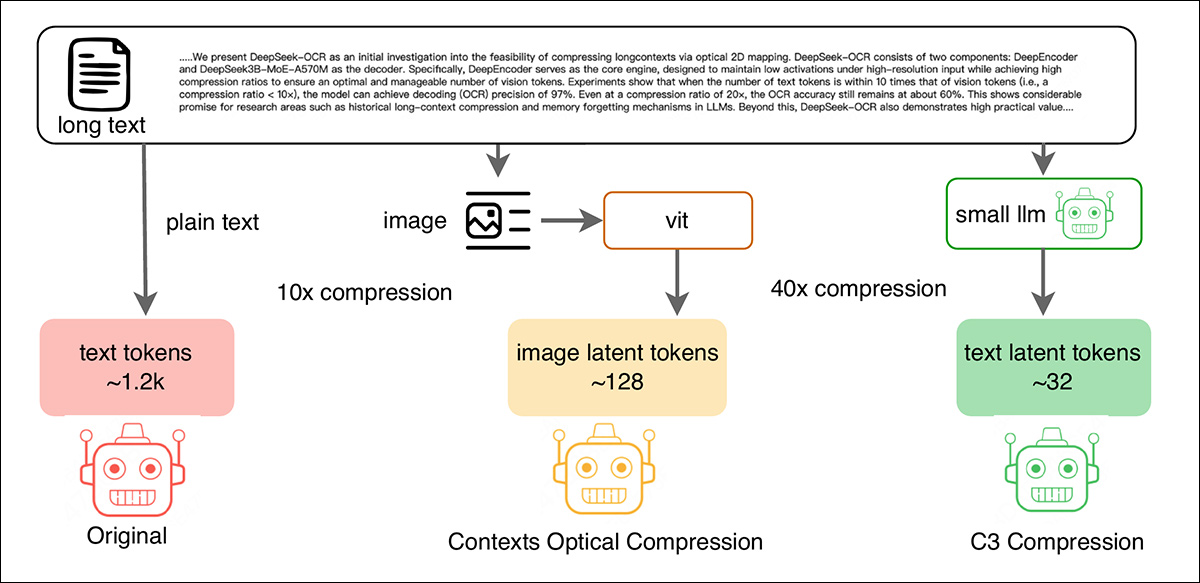

Tres enfoques para comprimir texto largo para entrada de modelo de lenguaje: el método base (izquierda) tokeniza el texto directamente, lo que produce una gran cantidad de tokens; la ruta óptica (centro) convierte el texto en una imagen y extrae incrustaciones visuales utilizando un Vision Transformer, logrando una compresión de 10x; y el nuevo método C3 (derecha) utiliza un modelo de lenguaje pequeño para comprimir el texto en solo 32 tokens latentes, obteniendo una compresión de 40x sin depender de codificaciones visuales.

Esto significa que la totalidad de incluso una conversación muy larga se puede comprimir y reinyectar (actualizar) en intervalos en las intercambios como información de contexto de fondo, más tarde en la charla – cuando el LLM normalmente estaría olvidando hechos anteriores y deslizándose hacia un comportamiento ‘amnésico’.

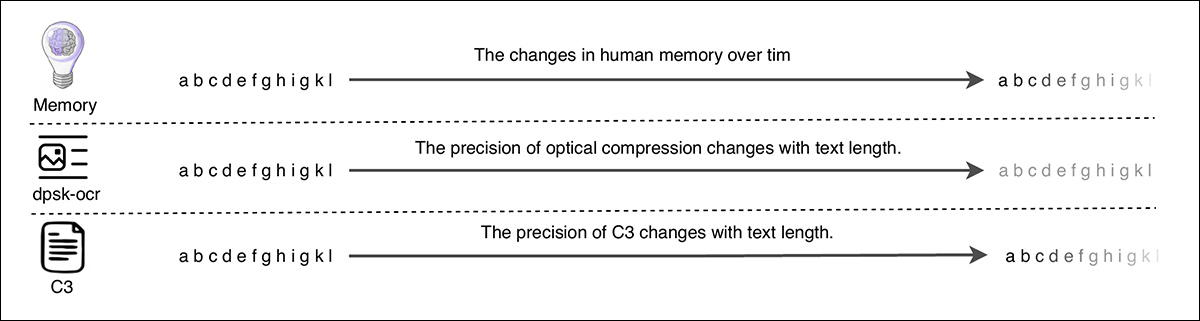

Aunque este es un método de compresión con pérdida, incluso la forma en que ocurre la pérdida es útil: bajo el nuevo método, la memoria se degrada al final de una oración, y no de manera uniforme en toda la oración, como con el arquitectura DeepSeek-OCR que inspiró el nuevo enfoque; de hecho, los investigadores detrás del nuevo papel sugieren que su método se degrada de la misma manera que la memoria humana real, en lugar de de manera aleatoria:

Arriba, la memoria humana se degrada al final de la secuencia de datos; medio: DeepSeek-OCR se degrada aleatoriamente, dejando sin anclajes que podrían ayudar a solucionar el problema; abajo: el nuevo método se degrada de la misma manera que la memoria humana, hacia el final de la secuencia de datos, ofreciendo marcadores que pueden ayudar a mejorar la precisión a través del procesamiento posterior.

Esto significa que se puede predecir dónde los datos memorizados pueden ser menos confiables, y utilizar este conocimiento para abordar el problema – potencialmente ofreciendo una mejora masiva en la recordación conversacional y la coherencia, con una precisión del 100% después de la remediación.

El nuevo enfoque se llama Context Cascade Compression (C3), y está inspirado en la forma en que DeepSeek-OCR comprime texto como imágenes, logrando grandes niveles de compresión. Sin embargo, al utilizar dos modelos de lenguaje (mediano y grande) para procesar texto largo directamente hacia incrustaciones latentes, el nuevo enfoque elimina la resistencia causada por el uso de imágenes rasterizadas, logrando así un mejor rendimiento.

El papel establece:

‘El rendimiento superior de C3 se puede atribuir a su diseño arquitectónico fundamental. El análisis DeepSeek-OCR hipotetiza que su declive en el rendimiento se debe a factores como “diseño complejo” y “borrosidad de la imagen a bajas resoluciones” – limitaciones inherentes de la vía óptica.’

‘Nuestro paradigma C3, al operar directamente en el dominio textual, es completamente inmune a estos artefactos del dominio visual. Evita la pérdida de información asociada con la representación de texto a píxeles y luego codificar esos píxeles. En su lugar, aprovecha la comprensión semántica poderosa de un LLM preentrenado para destilar información textual directamente en una representación latente eficiente.’

El nuevo papel se titula Context Cascade Compression: Explorando los límites superiores de la compresión de texto, y proviene de dos autores†, que también parecen ofrecer C3 como un repositorio de código abierto en GitHub.

Método

Para entender el nuevo enfoque, es útil saber qué es el reconocimiento óptico de caracteres (OCR), porque esta es la idea de la que se deriva todo.

OCR es un método algorítmico que data desde la década de 1920, aunque se popularizó en la década de 1990, donde la detección de patrones permite a un programa de computadora convertir texto raster (es decir, texto dentro de imágenes, que no se puede seleccionar y que solo existe como contenido fotográfico) en texto editable.

Los creadores de DeepSeek-OCR descubrieron que el texto se podía comprimir mucho más que las tuberías estándar utilizando OCR como una etapa intermedia. En otras palabras, en lugar de comprimir el texto en sí mismo, se podía lograr una mayor densidad de incrustaciones latentes (es decir, más información guardada) comprimiendo una versión rasterizada del texto:

![Del papel de lanzamiento de DeepSeekOCR, un esquema para la tubería de compresión, incluyendo parches rasterizados de 16x16 como el componente OCR. Fuente [ https://arxiv.org/pdf/2510.18234 ]](https://www.unite.ai/wp-content/uploads/2025/11/deepseekocr.jpg)

Del papel de lanzamiento de DeepSeekOCR, un esquema para la tubería de compresión, incluyendo parches rasterizados de 16×16 como el componente OCR. Fuente

El nuevo papel sugiere que los enfoques ópticos como DeepSeek-OCR pueden estar atribuyendo erróneamente la fuente de sus ganancias de compresión. En lugar de que el cambio de texto a imagen sea el factor principal, los autores plantean que el beneficio clave proviene de convertir tokens de texto verbosos en representaciones latentes más eficientes.

Para probar esto, crearon una tubería que aprovecha dos modelos de lenguaje: el más pequeño Qwen2.5 1.5B, que funciona como el codificador, comprimiendo pasajes largos en un pequeño conjunto de tokens latentes; y el más grande Qwen2.5 3B, que funciona como el decodificador, reconstruyendo el texto original a partir de esos tokens:

En el nuevo sistema C3, el modelo Qwen2.5 1.5B más pequeño comprime una entrada larga en un conjunto fijo de tokens latentes, utilizando incrustaciones de consulta entrenables. Estos tokens, junto con una llamada, se pasan al modelo Qwen2.5 3B más grande, que reconstruye el texto original. Esta arquitectura permite la recordación de alta fidelidad de secuencias largas utilizando solo una fracción de la cantidad original de tokens.

Para manejar la etapa de compresión, los investigadores adaptaron el modelo Qwen2.5 1.5B preentrenado introduciendo incrustaciones de consulta entrenables: llamadas abstractas que guían al modelo en la destilación del contexto largo de entrada en una representación latente mucho más pequeña.

En lugar de modificar la arquitectura, el método simplemente alimenta el texto largo y las incrustaciones de consulta juntos como una sola entrada. El mecanismo de autoatención del modelo trata estos elementos de manera idéntica, lo que le permite producir una representación latente de longitud fija sin necesidad de nuevas capas o cambios de diseño; y esta salida se pasa luego al modelo más grande para la reconstrucción.

Para evaluar cuánta información sobrevivió a la compresión, los investigadores instruyeron al decodificador Qwen2.5 3B para reconstruir la entrada original utilizando solo los tokens latentes, y la llamada ‘repetir el texto’. Dado que la tarea involucraba la reproducción exacta, en lugar de la resumen o la parafrase, cualquier desviación de la original podría trazarse directamente a la información perdida en la compresión, ofreciendo una prueba limpia y objetiva de la fidelidad a lo largo de la tubería de codificación-decodificación.

Datos y pruebas

El papel establece que los autores compilaron un conjunto de datos original de material OCR, que asciende a un millón de páginas obtenidas de Internet. No se aprecia más detalle sobre esta fuente, y los autores parecen ser deliberadamente vagos sobre este punto.

Sin embargo, observan que la ingeniería de datos y la curación no fueron necesarias para sus propósitos, y que fueron capaces de entrenar su modelo de manera efectiva en muestras de ‘longitud diversa’; y establecen que esto indica que su arquitectura es resiliente (y por inferencia, bien generalizada, dependiendo de la configuración de entrenamiento).

El modelo se entrenó en un clúster de alto rendimiento que consiste en ocho GPU NVIDIA H800, cada una equipada con 80GB de VRAM, para un total de recursos de VRAM de 640GB. Cada GPU acomodó un tamaño de lote de 2, obteniendo un tamaño de lote global de 256, cuando se tiene en cuenta los 16 pasos de acumulación programados. El optimizador fue AdamW, durante un total de 40,000 pasos.

Para probar la efectividad de la arquitectura C3, los investigadores siguieron la misma configuración de evaluación utilizada en el papel original de DeepSeek-OCR, utilizando el benchmark Fox para medir la precisión de compresión y reconstrucción en una gama de longitudes de documento.

Se seleccionaron textos en inglés, con pasajes que van desde 600 a 1300 tokens, con tokenización realizada utilizando el tokenizador Qwen.

Para permitir una comparación justa, se utilizaron niveles de compresión equivalentes del (DeepSeek-OCR) baseline óptico, con 64 y 100 tokens latentes. Para explorar los límites del método, se realizaron pruebas adicionales utilizando solo 32 tokens latentes. En cada caso, la reconstrucción se inició con la instrucción ‘repetir el texto:’:

Resultados de la prueba inicial. La precisión de reconstrucción y las relaciones de compresión se midieron en siete rangos de tokens utilizando 64 y 100 tokens latentes, mostrando un desempeño consistente de C3 sobre DeepSeek-OCR, especialmente en niveles de compresión más altos.

Al discutir los resultados iniciales visualizados arriba, el papel establece:

‘Los datos demuestran inequívocamente que el paradigma de compresión directa de texto a latente de C3 supera significativamente el enfoque de compresión óptica en todas las condiciones de prueba, estableciendo un nuevo estado de la técnica en compresión de contexto de alta fidelidad.’

Cuando ambos sistemas se probaron en documentos más largos, DeepSeek-OCR comenzó a perder precisión a medida que aumentaba la compresión, cayendo por debajo del 60% en el caso más extremo. C3 manejó el mismo nivel de compresión con mucha menos pérdida, manteniéndose cerca del 98%, incluso cuando la entrada se redujo a una vigésima parte de su tamaño original.

En la prueba más exigente, donde los textos completos se redujeron a solo 32 tokens. Incluso entonces, el modelo logró recuperar casi todo el contenido original, manteniendo la precisión cerca del 99% en muchos casos:

Precisión de reconstrucción y relaciones de compresión con 32 tokens latentes, mostrando que incluso en reducciones extremas (hasta casi 40x) la precisión permanece por encima del 93%.

En el ajuste más extremo, donde la entrada se comprimió a casi una cuadragésima parte de su tamaño, todavía recordó más del 93%. En comparación, los métodos ópticos anteriores cayeron a alrededor del 60% de precisión a la mitad de ese nivel de compresión.

Los autores establecen††:

‘Estos hallazgos demuestran concluyentemente la ventaja de la arquitectura C3. Al evitar los cuellos de botella de información y los posibles artefactos inherentes a la modalidad visual (por ejemplo, límites de resolución de imagen, complejidad de diseño), nuestro método maneja la compresión extrema con una pérdida mínima de información.’

‘Los resultados de este caso de prueba agresivo solidifican nuestra afirmación de que la compresión directa de texto a latente es un paradigma fundamentalmente más eficiente y poderoso que sus contrapartes ópticas.’

También concluyen que C3 puede ‘desbloquear nuevas capacidades en el procesamiento de libros completos, documentos legales extensos o grandes bases de código para tareas como la respuesta a preguntas, resumen y análisis’.

Conclusión

Este es uno de los papeles más claros y accesibles que he encontrado recientemente, con una idea central commendablemente clara que puede probar ser al menos una línea adicional de ataque contra el ‘problema de la ventana de contexto’.

Muchos usuarios de LLMs habrán aprendido por ahora a ‘refrescar’ información crucial o directrices periódicamente a lo largo de un intercambio largo, habiendo descubierto de la manera difícil que los likes de ChatGPT no pueden retener esa información durante mucho tiempo. Siguiendo esta solución rápida instintiva, la idea en el nuevo papel es que una versión muy comprimida de una conversación larga podría reinyectarse en intervalos, automáticamente, en la ventana de contexto de la instancia actual de LLM, esencialmente ‘recordando por proxy’.

En un clima donde la escasez de GPU está llevando a un aumento de precios incluso en la memoria de computadora tradicional (como la DRAM, donde muchas cargas de trabajo de GPU se están desviando ahora para admitir modelos más grandes), parece poco probable que el hardware de host de IA se vuelva significativamente más capaz en el futuro cercano; por lo tanto, enfoques innovadores como este, que son casi una rerun nostálgica de la evolución de la compresión de archivos de la década de 1990, pueden ser necesarios para impulsar el rendimiento hacia adelante.

Más importante aún, sería genial si los LLMs pudieran mantener una conversación coherente durante una hora o más, y realmente recordar de qué se trataba la conversación en primer lugar.

* Las instrucciones de instalación de CLI se proporcionan, pero no tengo tiempo para intentar una instalación, y no estoy seguro de que el repositorio esté completo.

† Los dos autores se establecen como Fanfan Liu y Haibo Qiu. Según la investigación casual, Qiu es actualmente un investigador en la empresa de tecnología china Meituan, y Liu es un estudiante de maestría en la Academia China de Ciencias. Ninguno de los dos tiene el papel en cuestión enumerado en sus historias. Si alguna de estas atribuciones es incorrecta, por favor contácteme a través de mi perfil.

†† Aunque los autores se adhieren a la fórmula proporcionando pruebas cualitativas adicionales, estas son poco iluminadoras en comparación con la ronda anterior de pruebas de compresión, y no las he cubierto aquí.

Publicado por primera vez el viernes 21 de noviembre de 2025