Ángulo de Anderson

Transmisión de avatares de IA como si fuera 1999

Nueva investigación presenta una forma de transmitir avatares 3D realistas que aparecen casi al instante y se afinan en tiempo real, en lugar de obligar a los usuarios a esperar a que se completen las descargas masivas.

En muchos sentidos, las enormes demandas de recursos de los sistemas de inteligencia artificial generativa y de renderizado asistido por IA han retrocedido la preparación del consumidor veinte o más años. Solo en 2023, una asignación de 64GB de RAM en una laptop o PC de escritorio parecía excesiva; ahora, con el creciente popularity de la descarga de RAM y/o CPU, 64GB es bastante modesto para las necesidades locales de IA; y estos elementos una vez banales y asequibles de las PCs continúan aumentando de precio a medida que las corporaciones luchan por satisfacer la demanda de servicios de IA.

La escala y la codicia de la IA y sus procesos y entornos suelen superar con creces el hardware de nivel de consumidor, y incluso ejecutar modelos ‘adelgazados’ locales como versiones GGUF suele sobrecargar el sistema promedio.

Incluso los servicios de IA basados en texto, como ChatGPT, están sujetos a una tensión significativa tanto a nivel de cliente como de servidor. Por lo tanto, una vez que la IA se encarga de entregar experiencias multimedia en línea en tiempo real, podemos razonablemente esperar algunos compromisos muy graves en la latencia y/o la calidad – similares a las primeras luchas de Internet con los medios de transmisión, y los odiados iconos animados de ‘buffering’ de RealPlayer y QuickTime.

La última vez que los problemas de multimedia y redes crearon fricción en la experiencia del usuario, el hardware de nivel de consumidor todavía estaba evolucionando a través de la Ley de Moore, mejorando casi exponencialmente cada año, incluso mientras que los sistemas operativos, las redes y otra infraestructura de soporte evolucionaban para satisfacer la demanda; y durante los últimos diez años, más o menos, las capacidades de la tecnología de consumo han superado las demandas de multimedia (quizás incluso hasta el punto en que se necesitaba un impulso para mantener las ventas).

Pero ese exceso de capacidad local puede estar llegando a su fin pronto, ya que el hardware local se vuelve menos potente y más caro, y los servicios basados en IA exigen más recursos en el servidor y locales.

Tomar la delantera

En la era pre-banda ancha, incluso antes del primer video de transmisión usable, los usuarios web estaban acostumbrados a ver imágenes que se enfocaban lentamente, ya que las imágenes JPEG progresivas permitían al usuario con ancho de banda limitado ver la imagen que se descargaba, formándose a veces de manera dolorosamente lenta, a medida que se cargaba más datos de la imagen localmente.

Ahora, parece que podríamos estar a punto de experimentar algo similar con los avatares de Gaussian Splat asistidos por IA:

Haga clic para reproducir. Del nuevo proyecto ProgressiveAvatars, una comparación de avatares gaussianos de transmisión. Fuente

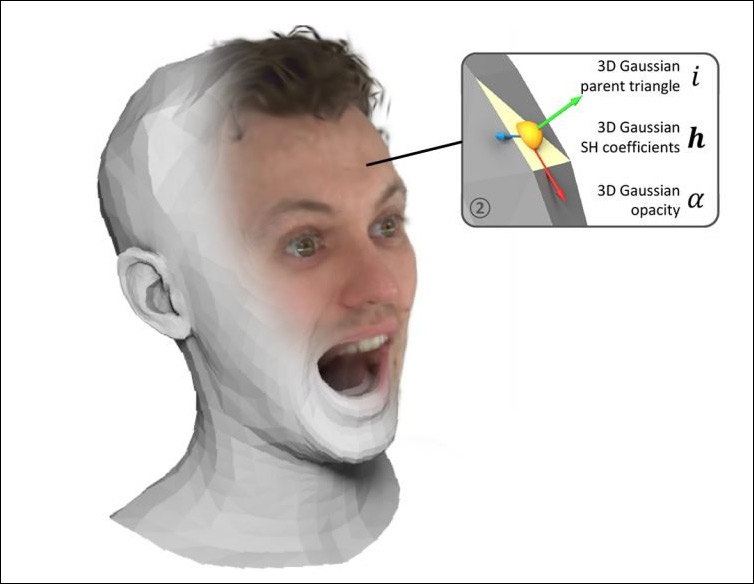

Arriba vemos dos versiones de un avatar Gaussian Splat (GSplat) – una representación humana habilitada parcialmente por una técnica de renderizado no IA que se remonta a la década de 1990, y también por métodos más modernos, como el modelo paramétrico de humano FLAME, y enfoques de entrenamiento basados en IA:

Gaussian Splatting utiliza una representación gaussiana de color e información 3D en lugar de un píxel o voxel, y asigna esta textura ultrarrealista a una malla CGI más tradicional, que a su vez se facilita mediante un ‘humano paramétrico’, una cara y/o cuerpo CGI, en sistemas como FLAME y STAR. Fuente

En la izquierda del video de arriba, podemos ver que una implementación tradicional de un avatar Gaussian splat se ve bastante horrible mientras esperamos a que se carguen los datos. En la derecha, una nueva implementación de China, denominada ProgressiveAvatars, puede resolver de manera mucho más elegante a medida que se cargan los datos, presentando una imagen humana no alarmante desde el principio.

Los autores afirman que su método es el primero en ‘transmitir’ realmente un avatar gaussian, y ciertamente el primero en hacerlo de manera progresiva, donde la imagen se construye elegantemente, y las áreas más importantes – como los ojos y los labios – pueden priorizarse, para que el avatar pueda volverse conversacional incluso cuando solo está parcialmente cargado:

Haga clic para reproducir. Del sitio web del proyecto ProgressiveAvatars, una ilustración de la carga atenta.

Anteriormente, se ha utilizado un enfoque de ‘nivel de detalle’ (LOD) en intentos anteriores para reducir el tamaño de los avatares ‘GSplat’, similar a las optimizaciones de los videojuegos, donde se cargan versiones sucesivamente más detalladas de una persona según si ocupan suficiente espacio en la ventana de vista o la atención del espectador para valer la pena el esfuerzo.

Por supuesto, esto implica una cantidad severa de avatares ‘de repuesto’ redundantes, y los autores enmarcan su enfoque como un sistema más racional. Al implicarlo, un método de este tipo también permite realizar cambios en una figura GSplat (es decir, personalización) sin necesidad de propagar dichos cambios a través de una cadena de ‘gemelos’ LOD.

Un dominio emergente

Si esto parece un problema de nicho, bueno, también lo parecía el video de transmisión, en los días en que obtener los primeros complementos para que funcionaran se les encomendaba al nerd más cercano. Además, el potencial de representaciones de transmisión basadas en IA va más allá de los avatares humanos, extendiéndose a la generación de ciudades, juegos y versiones en 3D de prácticamente cualquier dominio en línea – como Virtual Try-On, para compras de ropa:

Haga clic para reproducir. De un proyecto de 2024, una mirada aproximada al futuro de la ‘prueba en línea’. Otros proyectos buscan agregar movimiento e interactividad – facetas exigentes para transmitir y gestionar. Fuente

Al igual que los enfoques basados en LOD han sido utilizados principalmente por los videojuegos, muchas otras consideraciones que antes eran exclusivas del desarrollo de juegos probablemente se trasladarán a las representaciones basadas en splat. Por ejemplo, la mayoría de estos primeros intentos de GSplat muestran a un humano único haciendo muecas y gestos, o tal vez hablando; pero se necesitarán muchas situaciones que presenten múltiples humanos, así como características ambientales y atmósfera – un escenario en el que los sistemas de ‘triage’ de alto rendimiento determinarán dónde se deben priorizar los datos de transmisión, para mantener al espectador en el momento.

El nuevo documento se titula ProgressiveAvatars: Avatares gaussianos 3D animables progresivos, y proviene de tres investigadores de la Universidad de Ciencia y Tecnología de China en Hefei.

Método

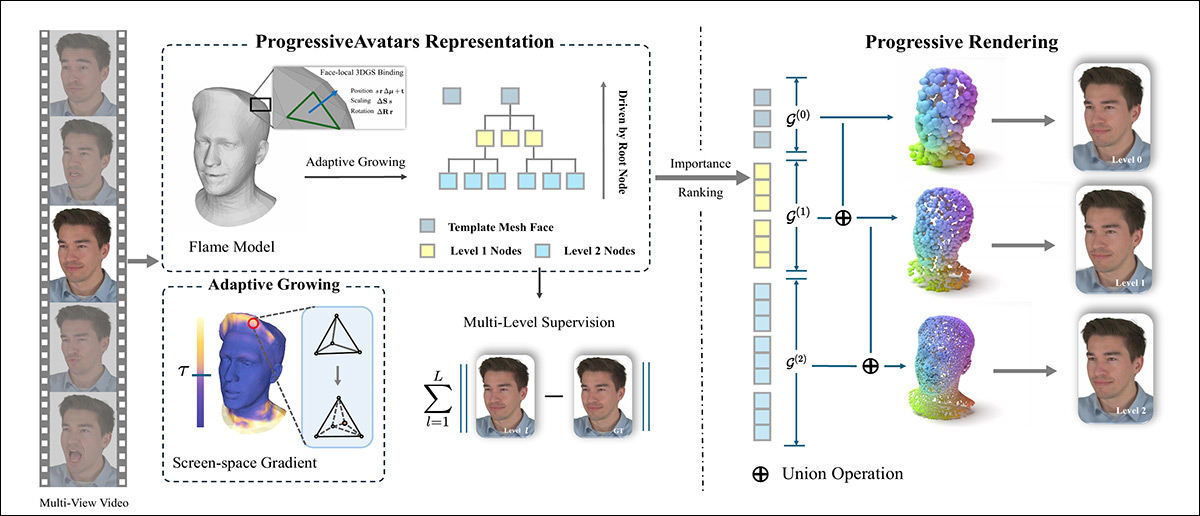

El enfoque inicial aprovecha el video de la cabeza de una persona. Para cada cuadro, se ajusta un modelo de cara paramétrico estándar FLAME, de modo que la forma y la expresión cambian con el tiempo, mientras que la estructura de malla subyacente permanece fija. Debido a que la topología base no cambia, se puede reutilizar y refinar un modelo de FLAME estable en lugar de reconstruirlo desde cero en cada momento, como sucede en trabajos anteriores similares:

El video de la cabeza se ajusta primero con una malla FLAME rastreada, después de lo cual se adjuntan gaussianos 3D a cada cara y se crecen jerárquicamente donde los gradientes de espacio de pantalla indican detalles faltantes. Durante el entrenamiento, esta subdivisión adaptativa construye una representación de varios niveles bajo supervisión multi-ángulo, y en la inferencia, las puntuaciones de importancia por cara determinan qué gaussianos se transmiten primero, lo que permite que el avatar aparezca rápidamente y se refine progresivamente a medida que se agregan niveles de mayor detalle.

Sobre esta estructura base, se agregan detalles en capas; la superficie se subdivide implícitamente en una jerarquía, y se adjuntan pequeños gaussianos tridimensionales a las caras en cada nivel de detalle.

Aunque las capas más gruesas iniciales capturan la forma general de la cabeza y el movimiento, las capas más finas posteriores proporcionan arrugas, deformaciones sutiles y textura de alta frecuencia. Las imágenes se renderizan a partir de estos gaussianos utilizando un rasterizador gaussiano diferenciable y se entrenan contra imágenes de referencia de varios ángulos, para que el avatar aprenda a reproducir la apariencia de la persona real.

Durante el entrenamiento, esta jerarquía crece automáticamente: las regiones que necesitan más detalles se subdividen más, guiadas por señales de espacio de pantalla, para que el esfuerzo computacional se concentre donde el ojo del espectador es más probable que note los errores.

Durante la inferencia, esta misma jerarquía permite la transmisión progresiva, en la que se puede mostrar una versión burda del avatar primero, y, a medida que se cargan capas adicionales, se pueden agregar nuevos gaussianos sin alterar lo que ya se muestra, lo que permite un avatar de cabeza animable que aparece rápidamente y se vuelve más detallado y nítido a medida que llega más datos.

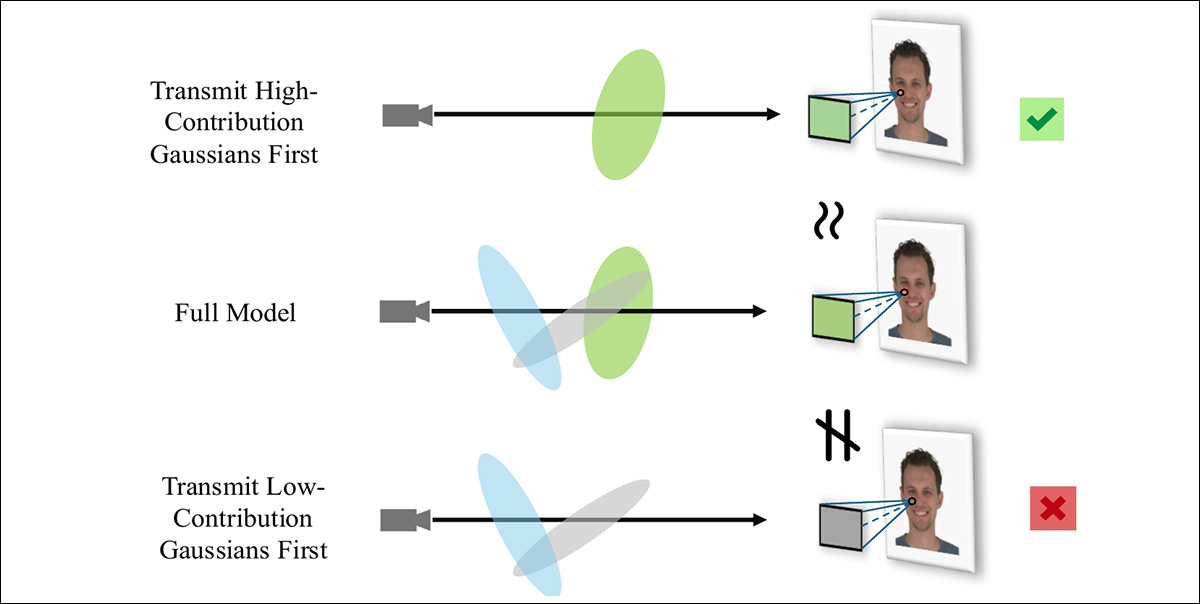

Los autores observan que todo el sistema depende de la priorización de los datos entrantes:

Cuando todos los gaussianos de un nivel determinado están disponibles, el modelo completo se renderiza con fidelidad máxima; pero durante la transmisión, enviar los gaussianos de mayor contribución primero permite que los resultados parciales iniciales se ajusten estrechamente a la imagen final, mientras que transmitir los gaussianos de baja contribución primero distorsiona el equilibrio de color y enfatiza los componentes menores.

Datos y pruebas

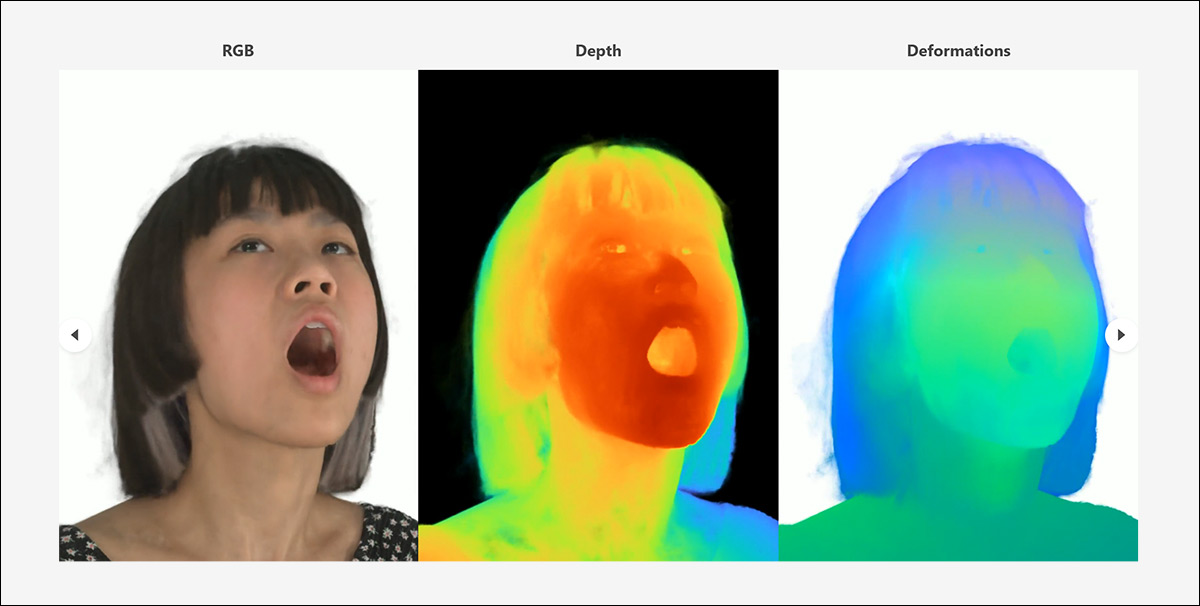

Para las pruebas, el nuevo método se evaluó en el conjunto de datos NeRSemble, que consta de videos multi-ángulo para cada sujeto cubierto, con parámetros calibrados en todas las vistas:

Ejemplos de interpretaciones diversas de sujetos incluidos en el conjunto de datos NeRSemble utilizado en las pruebas para ProgressiveAvatars. Fuente

En línea con la metodología original GaussianAvatars, las imágenes se redujeron a 802x550px, se generó una máscara de primer plano y se adoptó la división de entrenamiento/prueba original del proyecto.

El optimizador Adam se utilizó para las actualizaciones de parámetros, con una tasa de aprendizaje de 1×10-2 en todas las coordenadas baricéntricas. El entrenamiento se ejecutó durante 60,000 iteraciones, con la jerarquía expandiéndose automáticamente cada 2,000 iteraciones.

Inicialmente, los autores probaron la reconstrucción y animación – la tarea de convertir video plano en un sistema 3D consciente (x/y/x), utilizando la representación CGI canónica de FLAME como la malla de anclaje. Para esto, todas las líneas base se entrenaron desde cero, y los marcos de trabajo rivales probados fueron los mencionados GaussianAvatars y PointAvatar.

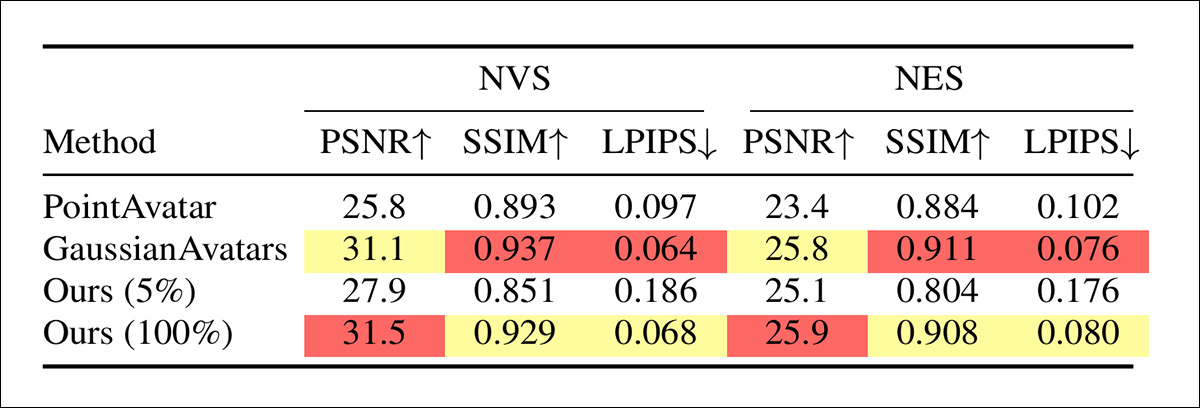

Para estas pruebas, las métricas utilizadas fueron Relación de señal a ruido pico (PSNR), Índice de similitud estructural (SSIM) y Similitud de parches de imagen perceptual aprendida (LPIPS):

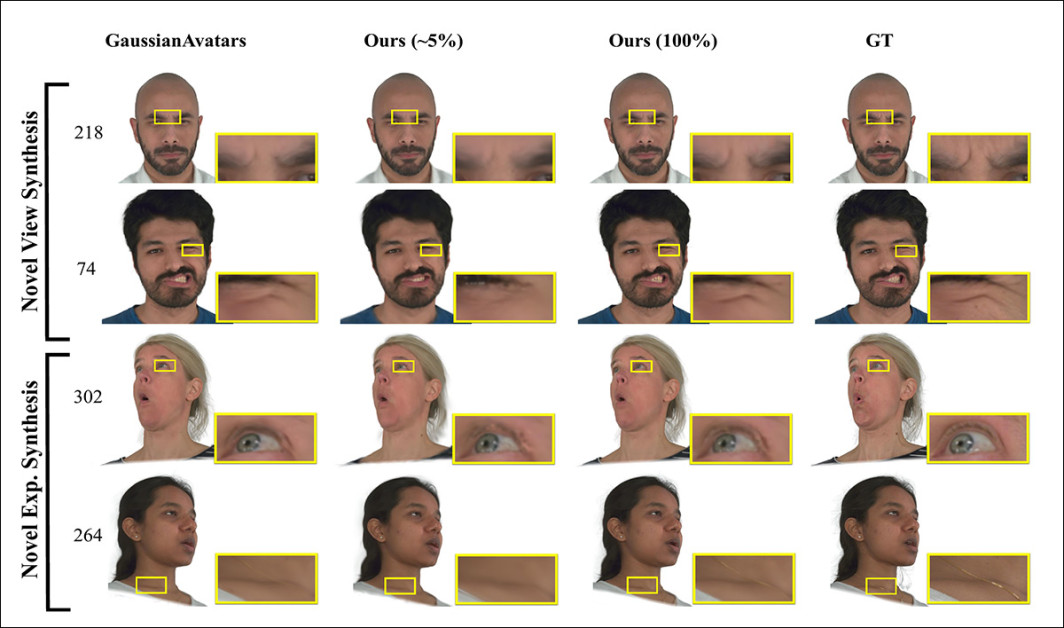

Comparación cualitativa en la síntesis de vista y expresión novedosas. La línea base GaussianAvatars lucha con los detalles finos alrededor de los ojos, arrugas y textura de la piel, mientras que el método propuesto ya conserva la estructura facial clave alrededor del cinco por ciento de los datos transmitidos y converge hacia la verdad de referencia a medida que se transmiten más gaussianos, ajustándose estrechamente al modelo completo y a las imágenes de referencia (verdad de referencia).

Con respecto a estos resultados, los autores afirman:

‘[Nuestro] método reconstruye detalles más nítidos en varias regiones, particularmente alrededor del cuello, hombros y ropa. Estas áreas están relativamente teseladas de manera gruesa en la plantilla FLAME en comparación con las zonas faciales de alta saliencia (por ejemplo, la región periocular).

‘En consecuencia, los métodos anteriores a menudo asignan demasiados gaussianos 3D a estas regiones para capturar con fidelidad su detalle a escala fina. En cambio, nuestra estrategia de crecimiento adaptativo aumenta la cantidad de gaussianos y refina la jerarquía solo donde es necesario, lo que hace que la asignación sea insensible a la teselación no uniforme de FLAME.’

Los autores también señalan que su enfoque es comparable a los métodos de estado del arte, lo que produce un avatar viable con un permiso de ancho de banda trivial:

Comparación cuantitativa en la síntesis de vista y expresión novedosas utilizando PSNR, SSIM y LPIPS. En la transmisión completa, el método propuesto logra el PSNR más alto en ambas tareas y sigue siendo competitivo con GaussianAvatars en las métricas perceptuales, mientras que la configuración del 5% ilustra el intercambio de calidad bajo restricciones de ancho de banda extremas.

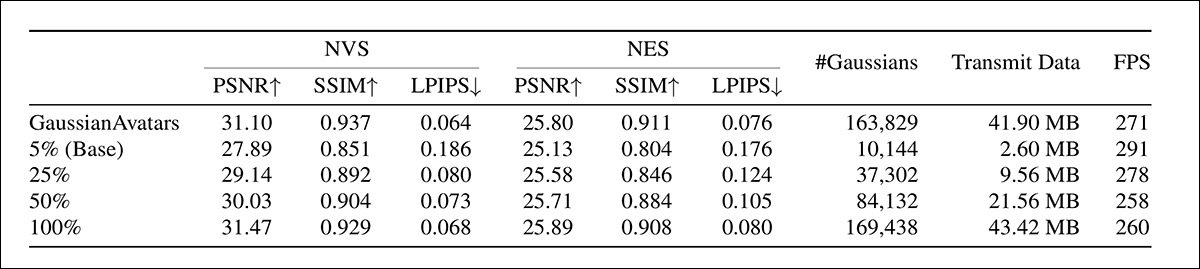

A continuación, los investigadores probaron la renderización progresiva en sí. Esto se realizó en un NVIDIA RTX 4090, con 24Gb de VRAM, a una resolución de 550x802px. En este escenario, los autores señalan que un presupuesto del 25% utilizaría todos los gaussianos de ‘nivel 1’, así como un subconjunto de gaussianos de nivel 2, lo que da una idea aproximada de la forma en que los grupos gaussianos acumulan detalles en los grupos de número más alto, y que los grupos de número más bajo esencialmente construyen la base del lienzo:

Rendimiento bajo diferentes presupuestos de transmisión para la síntesis de vista y expresión novedosas, mostrando que la calidad se acerca o supera a GaussianAvatars a medida que se transmiten más gaussianos y datos, mientras que se mantienen las velocidades en tiempo real en un RTX 4090.

Los autores comentan:

‘Con solo 2,60 MB transmitidos (5% de presupuesto), el avatar ya alcanza una calidad razonable. A medida que se transmiten gaussianos de nivel superior, las estructuras finas como los botones de la camisa, los dientes y el cabello se afilan gradualmente, mientras se mantienen las velocidades en tiempo real.

‘En la transmisión al 100%, nuestro enfoque logra una calidad de renderizado comparable a los métodos de estado del arte. Notablemente, las velocidades de cuadro no disminuyen significativamente, probablemente porque la carga de trabajo de 3DGS aún no ha saturado la GPU.’

Sin embargo, los autores señalan que en escenarios de realidad virtual multiusuario, la cantidad de gaussianos 3D crecería rápidamente hasta el punto en que la rasterización de la GPU se convirtiera en un cuello de botella. En esos escenarios más pesados, el enfoque propuesto ofrece una ventaja al permitir que el sistema intercambie la cantidad de primitivos frente a la calidad visual, lo que alivia la carga sin colapsar el render.

Aunque el documento no lo detalla, el sitio web del proyecto presenta comparaciones de pruebas adicionales, también con el proyecto de avatar híbrido de malla-gaussiano MeGA:

Haga clic para reproducir. Uno de una serie de videos suplementarios del sitio web del proyecto del documento, este compara el nuevo enfoque en términos de síntesis de vista novedosa.

Conclusión

Gaussian Splatting puede o no perdurar, o incluso ser recordado más que RealPlayer ahora en cuanto al amanecer de la transmisión interactiva: experiencias representativas de IA impulsadas o asistidas por 3D, incluyendo videoconferencia, compras virtuales, navegación de rutas y diversas aplicaciones de entretenimiento. Puede ser que tecnologías o enfoques alternativos salgan victoriosos, o que GSplat demuestre ser la representación de video de IA más confiable.

Si nada más, este nuevo y interesante documento anuncia un poco del alcance de este nuevo dominio, mientras nos recuerda, quizás de manera nostálgica, a la Internet con ancho de banda limitado de antaño.

* Por ‘3D’, no me refiero al tipo de experiencia que requiere gafas especiales, sino más bien experiencias donde el contenido multimedia tiene algún tipo de comprensión de coordenadas X/Y/Z.

Publicado por primera vez el miércoles 18 de marzo de 2026