Inteligencia Artificial

Resolviendo el problema del artefacto JPEG en conjuntos de datos de visión por computadora

Un nuevo estudio de la Universidad de Maryland y Facebook AI ha descubierto una "penalización significativa del rendimiento" para los sistemas de aprendizaje profundo que utilizan imágenes JPEG altamente comprimidas en sus conjuntos de datos, y ofrece algunos métodos nuevos para mitigar los efectos de esto.

El (reporte), titulado Análisis y mitigación de defectos de compresión JPEG en aprendizaje profundo, afirma ser "significativamente más exhaustivo" que estudios previos sobre los efectos de los artefactos en el entrenamiento de conjuntos de datos de visión artificial. El artículo concluye que "la compresión JPEG [alta] a moderada implica una pérdida significativa de rendimiento en las métricas estándar", y que las redes neuronales quizás no sean tan resistentes a tales perturbaciones como trabajos previos. sugieren.

Foto de un perro del conjunto de datos MobileNetV2018 de 2. Con calidad 10 (izquierda), un sistema de clasificación no identifica la raza correcta, «Pembroke Welsh Corgi», y en su lugar supone «Norwich terrier» (el sistema ya sabe que se trata de una foto de perro, pero no la raza); la segunda desde la izquierda, una versión JPEG estándar de la imagen con corrección de artefactos tampoco identifica la raza correcta; la segunda desde la derecha, una corrección de artefactos específica restaura la clasificación correcta; y la derecha, la foto original, correctamente clasificada. Fuente: https://arxiv.org/pdf/2011.08932.pdf

Artefactos de compresión como 'datos'

Es probable que la compresión JPEG extrema cree bordes visibles o semivisibles alrededor del 8 × 8 bloques A partir de la cual se ensambla un JPEG en una cuadrícula de píxeles. Una vez que aparecen estos artefactos de bloqueo o "anillo", es probable que los sistemas de aprendizaje automático los malinterpreten como elementos reales del sujeto de la imagen, a menos que se realice alguna compensación.

Arriba, un sistema de aprendizaje automático de visión artificial extrae una imagen de gradiente limpia de una imagen de buena calidad. Abajo, los artefactos de bloqueo en una imagen guardada de menor calidad oscurecen las características del sujeto y pueden acabar infectando las características derivadas de un conjunto de imágenes, especialmente en casos donde el conjunto de datos contiene imágenes de alta y baja calidad, como en colecciones extraídas de la web a las que solo se les ha aplicado una limpieza de datos genérica. Fuente: http://www.cs.utep.edu/ofuentes/papers/quijasfuentes2014.pdf

Como se ve en la primera imagen de arriba, tales artefactos pueden afectar las tareas de clasificación de imágenes, con implicaciones también para los algoritmos de reconocimiento de texto, que pueden no identificar correctamente los caracteres afectados por artefactos.

En el caso de los sistemas de entrenamiento de síntesis de imágenes (como el software de deepfake o los sistemas de generación de imágenes basados en GAN), un bloque de imágenes no autorizadas de baja calidad y muy comprimidas en un conjunto de datos puede reducir la calidad media de reproducción o ser absorbido y prácticamente anulado por un mayor número de características de mayor calidad extraídas de imágenes de mejor calidad del conjunto. En cualquier caso, es deseable contar con datos de mejor calidad o, al menos, consistentes.

JPEG – Generalmente 'suficientemente bueno'

La compresión JPEG es un códec con pérdida irreversible que se puede aplicar a varios formatos de imagen, aunque se aplica principalmente al archivo de imagen JFIF. envoltura. A pesar de esto, el formato JPEG (.jpg) recibió el nombre de su método de compresión asociado, y no del envoltorio JFIF para los datos de imagen.

En los últimos años han surgido arquitecturas completas de aprendizaje automático que incluyen la mitigación de artefactos de estilo JPEG como parte de las rutinas de mejora/restauración impulsadas por IA, y la eliminación de artefactos de compresión basada en IA ahora se incorpora en una serie de productos comerciales, como Topaz image/ video suite, y caracteristicas neurales de versiones recientes de Adobe Photoshop.

Puesto que el 1986 El esquema JPEG de uso común en la actualidad quedó prácticamente bloqueado a principios de los años 1990; no es posible agregar metadatos a una imagen que indiquen en qué nivel de calidad (1-100) se guardó una imagen JPEG; al menos, no sin modificar más de treinta años de sistemas de software heredados de consumo, profesionales y académicos que no esperaban que dichos metadatos estuvieran disponibles.

Por consiguiente, no es raro adaptar las rutinas de entrenamiento de aprendizaje automático a la calidad evaluada o conocida de los datos de imagen JPEG, como hicieron los investigadores en el nuevo artículo (véase más adelante). Ante la falta de una entrada de metadatos de "calidad", actualmente es necesario conocer los detalles de cómo se comprimió la imagen (es decir, si se comprimió desde una fuente sin pérdidas) o estimar la calidad mediante algoritmos perceptuales o clasificación manual.

Un compromiso económico

JPEG no es el único método de compresión con pérdida que puede afectar la calidad de los conjuntos de datos de aprendizaje automático; la configuración de compresión en archivos PDF también puede descartar información de esta manera y establecerse en niveles de calidad muy bajos para ahorrar espacio en disco para fines de archivo local o de red.

Esto se puede comprobar al analizar varios archivos PDF en archive.org, algunos de los cuales han sido comprimidos a tal grado que representan un desafío considerable para los sistemas de reconocimiento de imágenes o texto. En muchos casos, como en el caso de los libros con derechos de autor, esta intensa compresión parece haberse aplicado como una forma de DRM barato, de forma similar a cómo los titulares de derechos de autor pueden optar por reducir la resolución de los vídeos de YouTube subidos por los usuarios, de los cuales poseen la propiedad intelectual, dejando los vídeos con bloques como elementos promocionales para fomentar las compras en alta resolución, en lugar de eliminarlos.

En muchos otros casos, la resolución o la calidad de la imagen es baja simplemente porque los datos son muy antiguos y provienen de una era en la que el almacenamiento local y en red era más caro, y cuando las velocidades de red limitadas favorecían las imágenes portátiles y altamente optimizadas sobre la reproducción de alta calidad. .

Se ha argumentado que JPEG, si bien no es la mejor solución ahora, ha sido 'consagrado' como una infraestructura heredada inamovible que está esencialmente entrelazada con los cimientos de Internet.

Carga del legado

Si bien innovaciones posteriores como JPEG 2000, PNG y (más recientemente) el formato .webp ofrecen una calidad superior, el remuestreo de conjuntos de datos de aprendizaje automático antiguos y muy populares podría, posiblemente, "reiniciaría" la continuidad y el historial de los desafíos interanuales de la visión artificial en la comunidad académica. Este impedimento también se aplicaría al volver a guardar imágenes de conjuntos de datos PNG con configuraciones de mayor calidad. Esto podría considerarse una especie de deuda técnica.

Si bien las venerables bibliotecas de procesamiento de imágenes impulsadas por servidores, como ImageMagick, admiten mejores formatos, incluido .webp, los requisitos de transformación de imágenes ocurren con frecuencia en sistemas heredados que no están configurados para otra cosa que no sea JPG o PNG (que ofrece compresión sin pérdida, pero a expensas de latencia y espacio en disco). Incluso WordPress, el CMS que impulsa casi el 40% de todos los sitios web, solo se agregó compatibilidad con .webp hace tres meses.

PNG fue una entrada tardía (posiblemente demasiado tarde) en el sector del formato de imagen, que surgió como una solución de código abierto a finales de la década de 1990 en respuesta a una declaración de 1995 por Unisys y CompuServe que las regalías se pagarían de ahora en adelante sobre el formato de compresión LZW utilizado en archivos GIF, que se usaban comúnmente en ese entonces para logotipos y elementos de color plano, incluso si el formato Resurrección a principios de la década de 2010 se centró en su capacidad para proporcionar contenido animado ágil y de bajo ancho de banda (irónicamente, los PNG animados nunca ganaron popularidad o apoyo amplio, e incluso fueron prohibido de Twitter en 2019).

A pesar de sus deficiencias, la compresión JPEG es rápida, ocupa poco espacio y está profundamente integrada en sistemas de todo tipo y, por lo tanto, no es probable que desaparezca por completo de la escena del aprendizaje automático en un futuro próximo.

Sacar lo mejor de la distensión AI/JPEG

Hasta cierto punto, la comunidad de aprendizaje automático se ha acomodado a las debilidades de la compresión JPEG: en 2011, la Sociedad Europea de Radiología (ESR) publicó un Estudio sobre la 'Usabilidad de la compresión irreversible de imágenes en imágenes radiológicas', proporcionando pautas para la pérdida 'aceptable'; cuando el venerable MNIST El conjunto de datos de reconocimiento de texto (cuyos datos de imagen se suministraron originalmente en un nuevo formato binario) se trasladó a un formato de imagen "normal". JPEG, no PNG, fue elegido; y una colaboración anterior (2020) de los autores del nuevo artículo ofreció 'una arquitectura novedosa' para calibrar los sistemas de aprendizaje automático para las deficiencias de la calidad variable de la imagen JPEG, sin necesidad de que los modelos se entrenen en cada configuración de calidad JPEG, una característica utilizada en el nuevo trabajo.

De hecho, la investigación sobre la utilidad de los datos JPEG con variantes de calidad es un campo relativamente próspero en el aprendizaje automático. Un proyecto (no relacionado) de 2016 del Centro de Investigación de Automatización de la Universidad de Maryland, en realidad se centra en el dominio DCT (donde los artefactos JPEG ocurren en configuraciones de baja calidad) como una ruta para la extracción de características profundas; otro proyecto de 2019 se concentra en lectura a nivel de byte de datos JPEG sin la necesidad de descomprimir realmente las imágenes (es decir, abrirlas en algún punto en un flujo de trabajo automatizado); y un Estudio de Francia en 2019 aprovecha activamente la compresión JPEG al servicio de las rutinas de reconocimiento de objetos.

Pruebas y Conclusiones

Volviendo al último estudio de la UoM y Facebook, los investigadores buscaron probar la comprensibilidad y utilidad de JPEG en imágenes comprimidas entre 10 y 90 (por debajo del cual, la imagen presenta una perturbación imposible, y por encima del cual equivale a una compresión sin pérdidas). Las imágenes utilizadas en las pruebas se precomprimieron en cada valor dentro del rango de calidad objetivo, lo que implicó al menos ocho sesiones de entrenamiento.

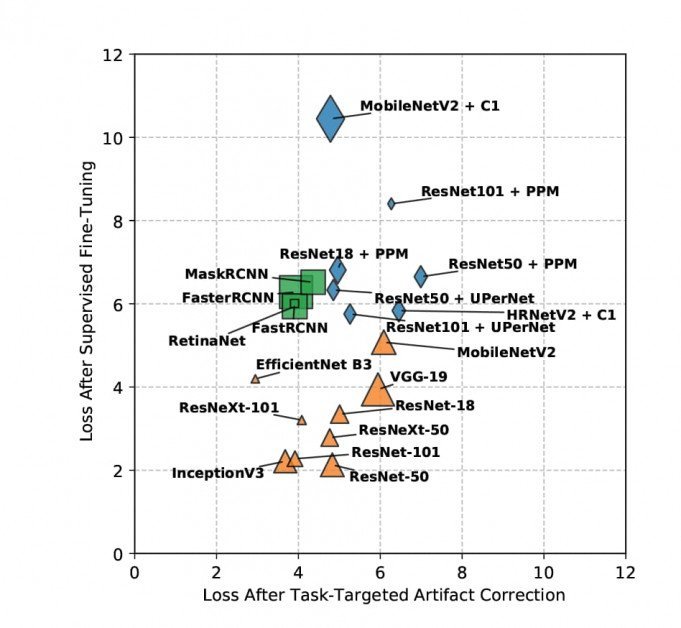

Los modelos se entrenaron en descenso de gradiente estocástico mediante cuatro métodos: base, donde no se agregaron mitigaciones adicionales; puesta a punto supervisada, donde el conjunto de entrenamiento tiene la ventaja de pesos previamente entrenados y datos etiquetados (aunque los investigadores admiten que esto es difícil de replicar en aplicaciones a nivel de consumidor); corrección de artefactos, donde el aumento/mejora se realiza en las imágenes comprimidas antes del entrenamiento; y corrección de artefactos dirigida a tareas, donde la red de corrección de artefactos se ajusta con precisión en los errores devueltos.

La capacitación se realizó en una amplia variedad de conjuntos de datos aptos, incluidas múltiples variantes de ResNet, RápidoRCNN, MóvilNetV2, MáscaraRCNN y Keras' OrigenV3.

Los resultados de pérdida de muestras después de la corrección de artefactos dirigida a la tarea se visualizan a continuación (menor = mejor).

No es posible profundizar en los detalles de los resultados obtenidos en el estudio, porque los hallazgos de los investigadores se dividen entre el objetivo de evaluar los artefactos JPEG y los nuevos métodos para aliviarlos; el entrenamiento fue iterado. por calidad sobre tantos conjuntos de datos; y las tareas incluían múltiples objetivos, como la detección, segmentación y clasificación de objetos. Esencialmente, el nuevo informe se posiciona como una obra de referencia integral que aborda múltiples temas.

No obstante, el artículo concluye, en líneas generales, que «la compresión JPEG presenta una fuerte penalización en general, incluso en configuraciones de compresión de altas a moderadas». También afirma que sus novedosas estrategias de mitigación sin etiquetas logran resultados superiores a otros enfoques similares; que, para tareas complejas, el método supervisado de los investigadores también supera a sus homólogos, a pesar de no tener acceso a etiquetas de datos reales; y que estas novedosas metodologías permiten la reutilización de modelos, ya que las ponderaciones obtenidas son transferibles entre tareas.

En términos de tareas de clasificación, el artículo afirma explícitamente que "JPEG degrada la calidad del gradiente e induce errores de localización".

Los autores esperan ampliar los estudios futuros para cubrir otros métodos de compresión como el ampliamente ignorado JPEG 2000, así como WebP, HEIF y BPG. Sugieren además que su metodología podría aplicarse a investigaciones análogas sobre algoritmos de compresión de video.

Dado que el método de corrección de artefactos orientado a tareas ha demostrado ser tan exitoso en el estudio, los autores también señalan su intención de liberar los pesos entrenados durante el proyecto, anticipando que "[muchas] aplicaciones se beneficiarán del uso de nuestros pesos TTAC sin modificaciones".

Nota: la imagen de origen del artículo proviene de thispersondoesnotexist.com