Sector Sanitario

Reconocimiento del estrés de los empleados a través del análisis facial en el trabajo

En el contexto de la cambiando la cultura en torno a la etiqueta de la reunión Zoom y el surgimiento de Fatiga de zoom, investigadores de Cambridge han publicado un estudio que utiliza el aprendizaje automático para determinar nuestros niveles de estrés a través de la cobertura de nuestras expresiones faciales en el trabajo mediante una cámara web habilitada por IA.

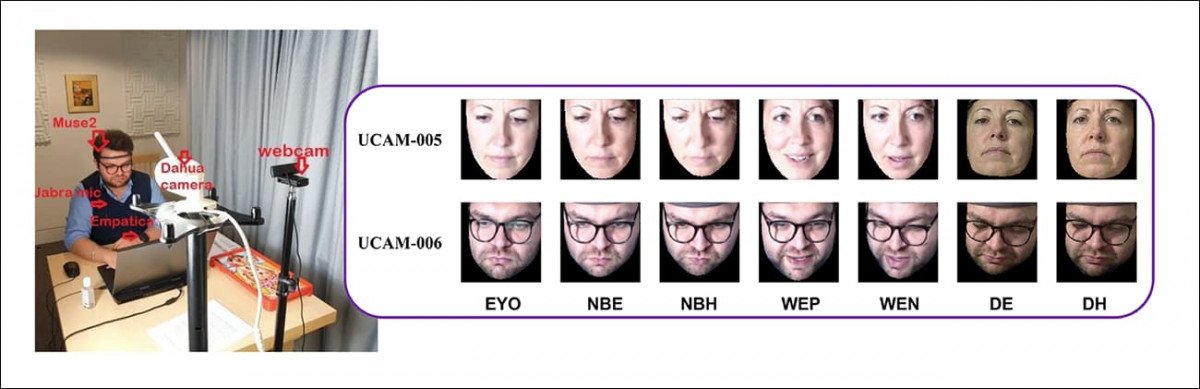

A la izquierda, el entorno de recopilación de datos, con múltiples equipos de monitoreo entrenados o conectados a un voluntario; a la derecha, ejemplos de expresiones faciales generadas por sujetos de prueba en diferentes niveles de dificultad de la tarea. Fuente: https://arxiv.org/pdf/2111.11862.pdf

La investigación está destinada al análisis del afecto (es decir, reconocimiento de emociones) en sistemas de 'vida asistida ambiental' y presumiblemente está diseñado para permitir marcos de monitoreo de expresiones faciales con inteligencia artificial basados en video en dichos sistemas; aunque el documento no amplía este aspecto, el esfuerzo de investigación no tiene sentido en ningún otro contexto.

El ámbito específico del proyecto es el aprendizaje de patrones de expresión facial en ambientes de trabajo –incluidas las modalidades de trabajo a distancia– en lugar de situaciones “de ocio” o “pasivas”, como viajar.

Reconocimiento de emociones basado en el rostro en el lugar de trabajo

Aunque la «Vida Asistida Ambiental» pueda parecer un programa para el cuidado de personas mayores, dista mucho de serlo. Hablando de los usuarios finales previstos, los autores afirman*:

'Sistemas creados para entornos ambientales de vida asistida [†] El objetivo es poder realizar tanto el análisis de afecto automático como la respuesta. La vida asistida ambiental se basa en el uso de la tecnología de la información y la comunicación (TIC) para ayudar en el entorno laboral y de vida diario de las personas para mantenerlas más saludables y activas por más tiempo, y permitirles vivir de forma independiente a medida que envejecen. De este modo, La vida asistida ambiental tiene como objetivo facilitar a los trabajadores de la salud, enfermeras, médicos, trabajadores de fábricas, conductores, pilotos, maestros, así como a diversas industrias a través de la detección, la evaluación y la intervención..

"El sistema está destinado a determinar el estrés físico, emocional y mental y responder y adaptarse cuando sea necesario, por ejemplo, un automóvil equipado con un sistema de detección de somnolencia puede informar al conductor para que esté atento y puede sugerirle que tome un pequeño descanso". para evitar accidentes [††].'

La se titula Inferir el efecto facial del usuario en entornos similares al trabajo, y proviene de tres investigadores del Affective Intelligence & Robotics Lab de Cambridge.

Condiciónes de la prueba

Since trabajo prioritario en este campo ha dependido en gran medida de colecciones ad hoc de imágenes extraídas de Internet, los investigadores de Cambridge realizaron experimentos locales de recopilación de datos con 12 voluntarios del campus, 5 hombres y 7 mujeres. Los voluntarios procedían de nueve países y tenían entre 22 y 41 años.

El proyecto pretendía recrear tres entornos de trabajo potencialmente estresantes: una oficina; una línea de producción de fábrica; y una llamada de teleconferencia, como el tipo de chat grupal de Zoom que se ha convertido en un rasgo frecuente del trabajo a domicilio desde el advenimiento de la pandemia.

Los sujetos fueron monitoreados por varios medios, incluidas tres cámaras, un micrófono de cuello Jabra, un muñequera empatica (un dispositivo portátil inalámbrico multisensor que ofrece biorretroalimentación en tiempo real) y un sensor de diadema Muse 2 (que también ofrece biorretroalimentación). Además, se pidió a los voluntarios que completaran encuestas y autoevaluaran su estado de ánimo periódicamente.

Sin embargo, esto no significa que las futuras plataformas de vida asistida ambiental vayan a "conectarte" en esa medida (aunque solo sea por razones de costo); todos los equipos y métodos de monitoreo sin cámara utilizados en la recopilación de datos, incluidas las autoevaluaciones escritas, están destinados a verificar los sistemas de reconocimiento de afectos basados en el rostro que se habilitan mediante las imágenes de las cámaras.

Aumentando la presión: el escenario de la oficina

En los dos primeros de los tres escenarios ('Oficina' y 'Fábrica'), los voluntarios comenzaron a un ritmo lento, y la presión aumentó gradualmente a lo largo de cuatro fases, con diferentes tipos de tareas para cada una.

En el nivel más alto de estrés inducido, los voluntarios también tuvieron que soportar el "efecto de bata blanca" de alguien mirándolos por encima del hombro, además de 85 db de ruido adicional, que es apenas cinco decibelios por debajo el límite legal para un entorno de oficina en los EE. UU. y el límite máximo exacto especificado por el Instituto Nacional de Seguridad y Salud Ocupacional (NIOSH).

En la fase de recopilación de datos similar a la de una oficina, los sujetos tenían la tarea de recordar letras anteriores que habían aparecido en su pantalla, con niveles de dificultad crecientes (como tener que recordar secuencias de dos letras que ocurrieron hace dos pantallas).

El escenario de la fábrica

Para simular un entorno de trabajo manual, se pidió a los sujetos que jugaran el juego Operación, que desafía la destreza del usuario al requerir que el jugador extraiga pequeños objetos de un tablero a través de aberturas estrechas con borde de metal sin tocar los lados, evento que activa un timbre de "falla".

Cuando llegó la fase más difícil, se desafió al voluntario a extraer los 12 elementos sin errores en un minuto. Por contexto, el récord mundial para esta tarea, establecido en el Reino Unido en 2019, se sitúa en 12.68 segundos.

El escenario de la teleconferencia

Finalmente, en la prueba de trabajo en casa/teleconferencia, un experimentador pidió a los voluntarios a través de una llamada de MS Teams que recordaran sus propios recuerdos positivos y negativos. Para la fase más estresante de este escenario, el voluntario debía recordar un recuerdo muy negativo o triste de su pasado reciente.

Las diversas tareas y escenarios se ejecutaron en orden aleatorio y se compilaron en un conjunto de datos personalizado titulado Conjunto de datos consciente del contexto del entorno de trabajo (WECARE-DB).

Método y Entrenamiento

Los resultados de las autoevaluaciones del estado de ánimo de los usuarios se utilizaron como referencia y se asignaron a las dimensiones de valencia y excitación. Los videos capturados de los experimentos se analizaron mediante un sistema de detección de puntos de referencia facial. del sistema,, y las imágenes alineadas alimentadas a un Red ResNet-18 entrenado en el Red de afecto conjunto de datos

450,000 imágenes de AffectNet, todas extraídas/etiquetadas de Internet mediante consultas relacionadas con las emociones, se anotaron manualmente, dice el documento, con dimensiones de valencia y excitación.

Luego, los investigadores refinaron la red basándose únicamente en su propio conjunto de datos WECARE, mientras codificación de representación espectral se utilizó para resumir las predicciones basadas en fotogramas.

Resultados

El desempeño del modelo se evaluó en tres métricas comúnmente asociadas con la predicción automatizada de afectos: coeficiente de correlación de concordancia, coeficiente de correlación de Pearson y error cuadrático medio (RMSE).

Los autores señalan que el modelo ajustado en su propio conjunto de datos WECARE superó a ResNet-18, y deducen de esto que la forma en que gobernamos nuestras expresiones faciales es muy diferente en un entorno de trabajo que en los contextos más abstractos de los que se han derivado estudios anteriores. material fuente de internet.

Ellos afirman:

Al observar la tabla, observamos que el modelo optimizado en WECARE-DB superó al modelo ResNet-18 preentrenado en AffectNet, lo que indica que los comportamientos faciales mostrados en entornos laborales difieren de los de la experiencia real en internet utilizada en AffectNet DB. Por lo tanto, es necesario adquirir conjuntos de datos y entrenar modelos para reconocer las emociones faciales en entornos laborales.

En cuanto al futuro del reconocimiento de afectos en el trabajo, habilitado por redes de cámaras dirigidas a los empleados, y haciendo constantemente predicciones de sus estados emocionales, los autores concluyen*:

'El objetivo final es implementar y utilizar los modelos entrenados en tiempo real y en entornos de trabajo reales para proporcionar información a los sistemas de apoyo a la toma de decisiones para promover la salud y el bienestar de las personas durante su edad laboral en el contexto de la Proyecto de edad laboral de la UE. "

* Mi énfasis.

† Aquí los autores hacen tres citas:

Reconocimiento de emociones automático, dimensional y continuo – https://ibug.doc.ic.ac.uk/media/uploads/documents/GunesPantic_IJSE_2010_camera.pdf

Explorando el dominio de vida asistida ambiental: una revisión sistemática – https://link.springer.com/article/10.1007/s12652-016-0374-3

Una revisión de las tecnologías de Internet de las cosas para entornos de vida asistidos por el ambiente – https://mdpi-res.com/d_attachment/futureinternet/futureinternet-11-00259/article_deploy/futureinternet-11-00259-v2.pdf

†† Aquí los autores hacen dos citas:

Detección de somnolencia del conductor en tiempo real para sistemas integrados mediante la compresión de modelos de redes neuronales profundas – https://openaccess.thecvf.com/content_cvpr_2017_workshops/w4/papers/Reddy_Real-Time_Driver_Drowsiness_CVPR_2017_paper.pdf

Sistema de detección de somnolencia del conductor en tiempo real mediante características faciales – https://www.semanticscholar.org/paper/Real-Time-Driver-Drowsiness-Detection-System-Using-Deng-Wu/1f4b0094c9e70bf7aa287234e0fdb4c764a5c532