Ángulo de Anderson

Las Imágenes ‘Protegidas’ Son Más Fáciles, No Más Difíciles, de Robar Con IA

Nueva investigación sugiere que las herramientas de marca de agua destinadas a bloquear ediciones de imágenes de IA pueden tener un efecto contrario. En lugar de detener modelos como Stable Diffusion para realizar cambios, algunas protecciones en realidad ayudan a la IA a seguir las instrucciones de edición más de cerca, lo que hace que las manipulaciones no deseadas sean aún más fáciles.

Hay un hilo notable y robusto en la literatura de visión por computadora dedicado a proteger imágenes con derechos de autor de ser entrenadas en modelos de IA, o de ser utilizadas en procesos de IA de imagen a imagen directos. Sistemas de este tipo generalmente están dirigidos a Modelos de Difusión Latente (LDM) como Stable Diffusion y Flux, que utilizan procedimientos basados en ruido para codificar y decodificar imágenes.

Al insertar ruido adversarial en imágenes que de otro modo parecen normales, es posible causar que los detectores de imágenes adivinen incorrectamente el contenido de la imagen, y obstaculicen los sistemas generadores de imágenes para explotar datos con derechos de autor:

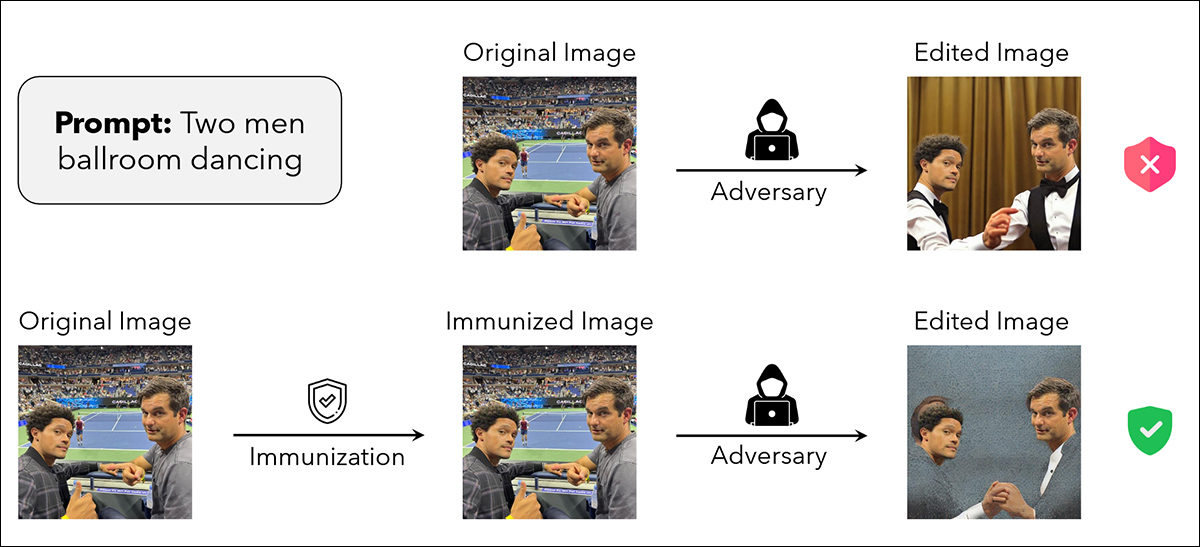

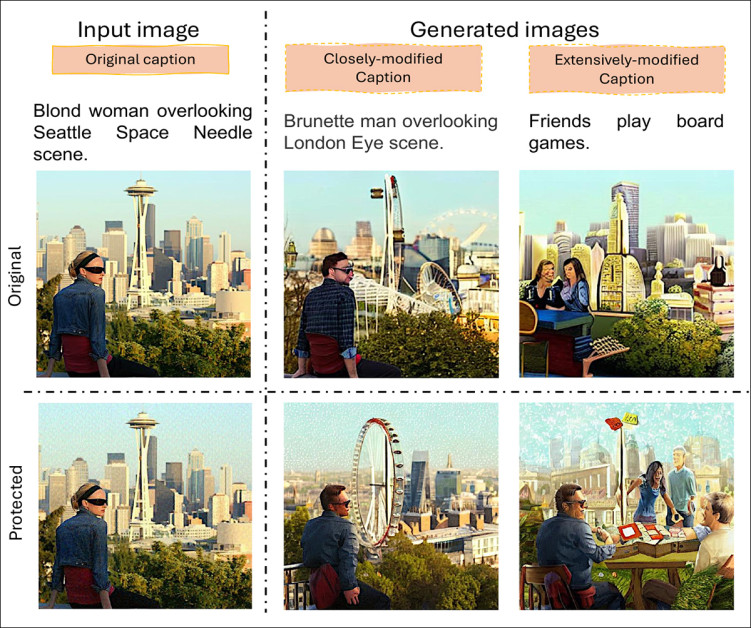

Del papel de MIT ‘Raising the Cost of Malicious AI-Powered Image Editing’, ejemplos de una imagen de origen ‘inmunizada’ contra la manipulación (fila inferior). Fuente: https://arxiv.org/pdf/2302.06588

Desde un rechazo de los artistas contra el uso liberal de imágenes web raspadas por Stable Diffusion (incluidas imágenes con derechos de autor) en 2023, la escena de investigación ha producido múltiples variaciones sobre el mismo tema: la idea de que las imágenes pueden ser ‘envenenadas’ de forma invisible contra ser entrenadas en sistemas de IA o succionadas en pipelines de IA generativa, sin afectar adversamente la calidad de la imagen para el espectador promedio.

En todos los casos, hay una correlación directa entre la intensidad de la perturbación impuesta, el grado en que la imagen está posteriormente protegida y el grado en que la imagen no se ve tan bien como debería:

Aunque la calidad del PDF de investigación no ilustra completamente el problema, cantidades mayores de perturbación adversarial sacrifican calidad por seguridad. Aquí vemos el rango de perturbaciones de calidad en el proyecto ‘Fawkes’ de 2020 liderado por la Universidad de Chicago. Fuente: https://arxiv.org/pdf/2002.08327

De particular interés para los artistas que buscan proteger sus estilos contra la apropiación no autorizada es la capacidad de tales sistemas no solo para ofuscar la identidad y otra información, sino para ‘convencer’ a un proceso de entrenamiento de IA de que está viendo algo diferente a lo que realmente está viendo, para que no se formen conexiones entre dominios semánticos y visuales para datos de entrenamiento ‘protegidos’ (es decir, una instrucción como ‘En el estilo de Paul Klee’).

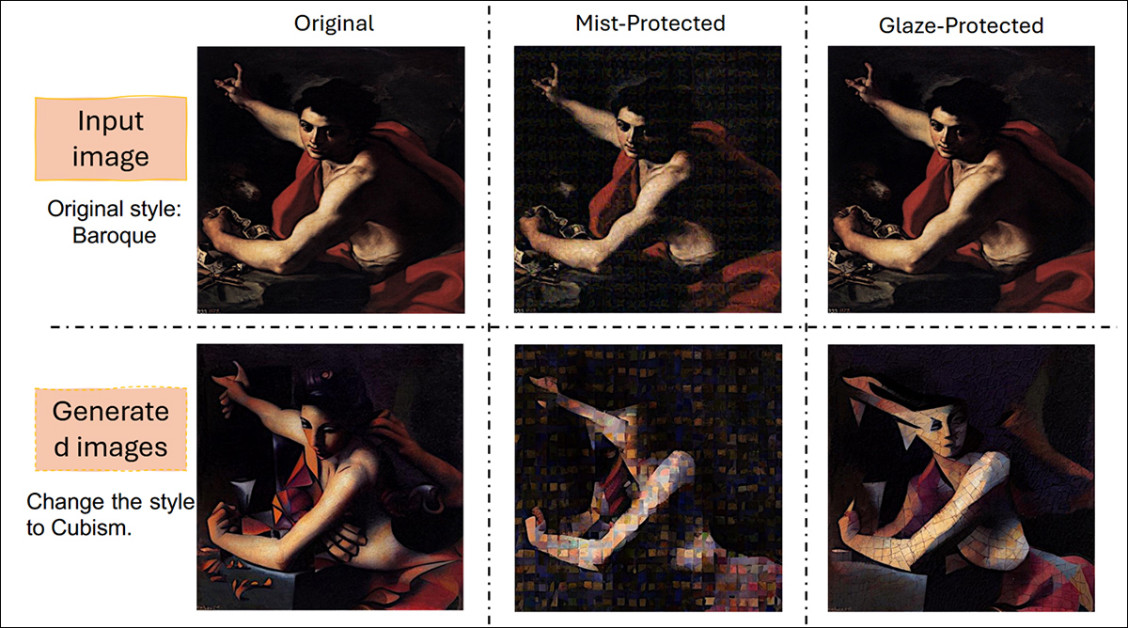

Mist y Glaze son dos métodos de inyección populares capaces de prevenir, o al menos obstaculizar gravemente los intentos de usar estilos con derechos de autor en flujos de trabajo y rutinas de entrenamiento de IA. Fuente: https://arxiv.org/pdf/2506.04394

Gol En Contra

Ahora, una nueva investigación de EE. UU. ha encontrado que no solo las perturbaciones pueden fallar en proteger una imagen, sino que agregar perturbación puede en realidad mejorar la explotabilidad de la imagen en todos los procesos de IA que la perturbación pretende inmunizar.

El papel afirma:

‘En nuestros experimentos con varios métodos de protección de imagen basados en perturbaciones en múltiples dominios (imágenes de escenas naturales y obras de arte) y tareas de edición (generación de imagen a imagen y edición de estilo), descubrimos que tal protección no logra completamente este objetivo.

‘En la mayoría de los escenarios, la edición de difusión de imágenes protegidas genera una imagen de salida deseable que se adhiere precisamente a la instrucción de guía.

‘Nuestros hallazgos sugieren que agregar ruido a las imágenes puede paradójicamente aumentar su asociación con instrucciones de texto dadas durante el proceso de generación, lo que lleva a consecuencias no deseadas como mejores ediciones resultantes.

‘Por lo tanto, argumentamos que los métodos basados en perturbaciones pueden no proporcionar una solución suficiente para una protección de imagen robusta contra la edición basada en difusión.’

En pruebas, las imágenes protegidas se expusieron a dos escenarios de edición de IA familiares: generación de imagen a imagen directa y transferencia de estilo. Estos procesos reflejan las formas comunes en que los modelos de IA podrían explotar contenido protegido, ya sea alterando directamente una imagen o aprovechando sus rasgos estilísticos para usarlos en otra parte.

Las imágenes protegidas, extraídas de fuentes estándar de fotografía y obras de arte, se pasaron por estos pipelines para ver si las perturbaciones agregadas podrían bloquear o degradar las ediciones.

En lugar de eso, la presencia de protección a menudo parecía afilar la alineación del modelo con las instrucciones, produciendo salidas limpias y precisas donde se esperaba algún tipo de falla.

Los autores aconsejan, en efecto, que este método de protección popular puede estar brindando una falsa sensación de seguridad, y que cualquier enfoque de inmunización basado en perturbación debe probarse exhaustivamente contra los métodos de los autores.

Método

Los autores realizaron experimentos utilizando tres métodos de protección que aplican perturbaciones adversariales cuidadosamente diseñadas: PhotoGuard; Mist; y Glaze.

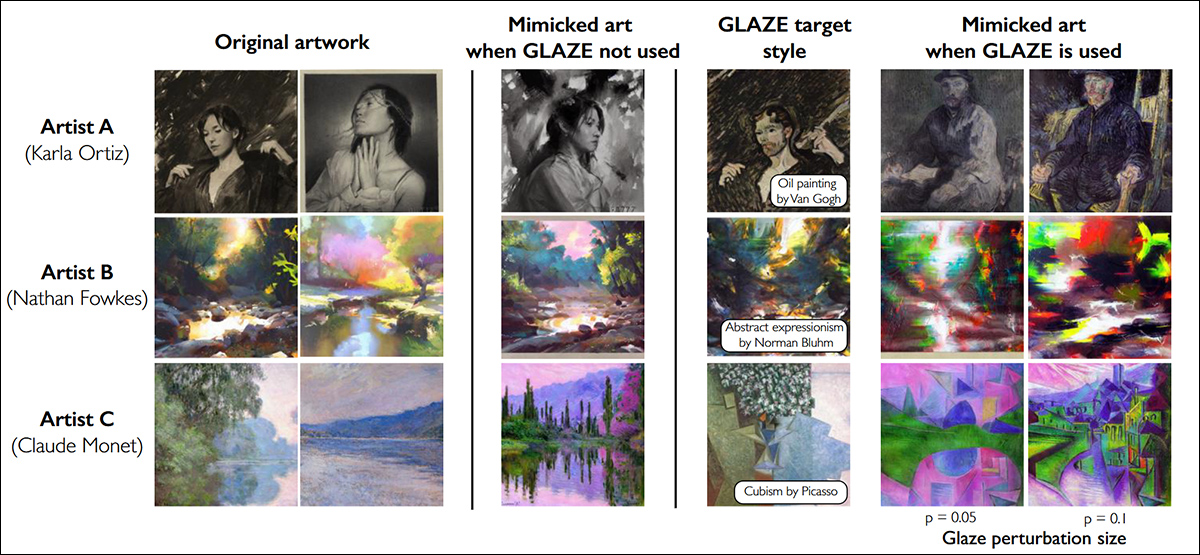

Glaze, uno de los marcos de trabajo probados por los autores, ilustrando ejemplos de protección de Glaze para tres artistas. Las dos primeras columnas muestran las obras de arte originales; la tercera columna muestra resultados de imitación sin protección; la cuarta, versiones de transferencia de estilo utilizadas para la optimización del disfraz, junto con el nombre del estilo objetivo. Las quintas y sextas columnas muestran resultados de imitación con el disfraz aplicado a niveles de perturbación p = 0,05 y p = 0,1. Todos los resultados utilizan modelos de Stable Diffusion. https://arxiv.org/pdf/2302.04222

PhotoGuard se aplicó a imágenes de escenas naturales, mientras que Mist y Glaze se utilizaron en obras de arte (es decir, dominios ‘estilizados por artistas’).

Las pruebas cubrieron tanto imágenes naturales como artísticas para reflejar posibles usos en el mundo real. La efectividad de cada método se evaluó comprobando si un modelo de IA aún podría producir ediciones realistas y relevantes para las instrucciones cuando trabajaba en imágenes protegidas; si las imágenes resultantes parecían convincentes y coincidían con las instrucciones, se consideró que la protección había fallado.

Stable Diffusion v1.5 se utilizó como el generador de imagen preentrenado para las tareas de edición de los investigadores. Se seleccionaron cinco semillas para garantizar la reproducibilidad: 9222, 999, 123, 66 y 42. Todos los demás ajustes de generación, como la escala de orientación, la fuerza y los pasos totales, siguieron los valores predeterminados utilizados en los experimentos de PhotoGuard.

PhotoGuard se probó en imágenes de escenas naturales utilizando el conjunto de datos Flickr8k, que contiene más de 8.000 imágenes emparejadas con hasta cinco subtítulos cada una.

Pensamientos Opuestos

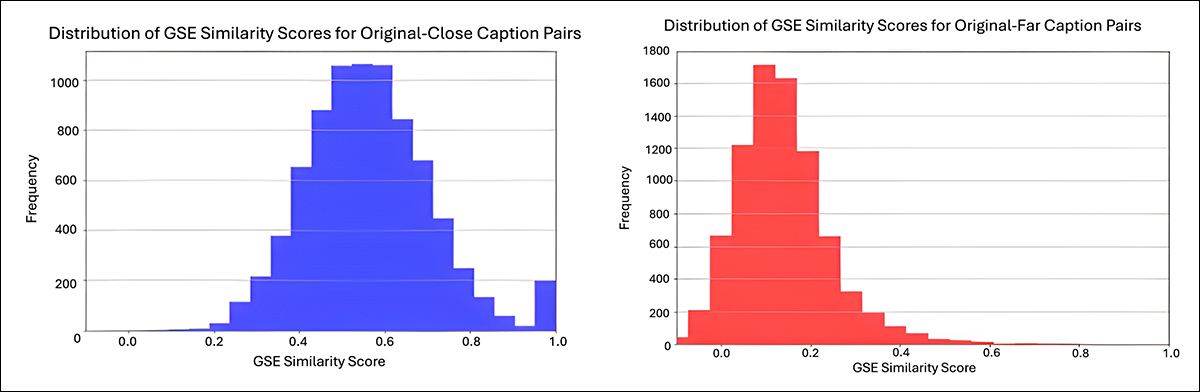

Se crearon dos conjuntos de subtítulos modificados a partir del primer subtítulo de cada imagen con la ayuda de Claude Sonnet 3.5. Un conjunto contenía instrucciones que estaban contextualmente cercanas a los subtítulos originales; el otro conjunto contenía instrucciones que estaban contextualmente distantes.

Por ejemplo, a partir del subtítulo original ‘Una joven con un vestido rosa entrando en una cabaña de madera’, una instrucción cercana sería ‘Un joven con una camisa azul entrando en una casa de ladrillo’. Por el contrario, una instrucción distante sería ‘Dos gatos reposando en un sofá’.

Las instrucciones cercanas se construyeron reemplazando sustantivos y adjetivos con términos semánticamente similares; las instrucciones lejanas se generaron instruyendo al modelo para crear subtítulos que fueran contextualmente muy diferentes.

Todos los subtítulos generados se verificaron manualmente para calidad y relevancia semántica. Se utilizó el Universal Sentence Encoder de Google para calcular las puntuaciones de similitud semántica entre los subtítulos originales y modificados:

De los materiales suplementarios, distribuciones de similitud semántica para los subtítulos modificados utilizados en las pruebas de Flickr8k. El gráfico de la izquierda muestra las puntuaciones de similitud para los subtítulos modificados de cerca, con un promedio de alrededor de 0,6. El gráfico de la derecha muestra los subtítulos modificados extensivamente, con un promedio de alrededor de 0,1, reflejando una mayor distancia semántica de los subtítulos originales. Los valores se calcularon utilizando el Universal Sentence Encoder de Google. Fuente: https://sigport.org/sites/default/files/docs/IncompleteProtection_SM_0.pdf

Cada imagen, junto con su versión protegida, se editó utilizando tanto las instrucciones cercanas como las lejanas. El Evaluador de Calidad Espacial de Imágenes Ciego/Referencia ( BRISQUE ) se utilizó para evaluar la calidad de la imagen:

Resultados de generación de imagen a imagen en fotografías naturales protegidas por PhotoGuard. A pesar de la presencia de perturbaciones, Stable Diffusion v1.5 siguió con éxito tanto los pequeños como los grandes cambios semánticos en las instrucciones de edición, produciendo salidas realistas que coincidían con las nuevas instrucciones.

Las imágenes generadas obtuvieron una puntuación de 17,88 en BRISQUE, con 17,82 para las instrucciones cercanas y 17,94 para las instrucciones lejanas, mientras que las imágenes originales obtuvieron una puntuación de 22,27. Esto muestra que las imágenes editadas permanecieron cerca en calidad a las originales.

Métricas

Para juzgar cómo bien las protecciones interfirieron con la edición de IA, los investigadores midieron qué tan de cerca las imágenes finales coincidían con las instrucciones que se les dieron, utilizando sistemas de puntuación que comparaban el contenido de la imagen con el texto de la instrucción, para ver qué tan bien se alineaban.

Con este fin, la métrica CLIP-S utiliza un modelo que puede entender tanto imágenes como texto para verificar qué tan similares son, mientras que PAC-S++, agrega muestras adicionales creadas por IA para alinear su comparación más estrechamente a una estimación humana.

Estas puntuaciones de Alineación de Imagen-Texto (ITA) denotan qué tan precisamente la IA siguió las instrucciones cuando se modificaba una imagen protegida: si una imagen protegida aún llevó a una salida de alta alineación, significa que la protección se consideró que falló en bloquear la edición.

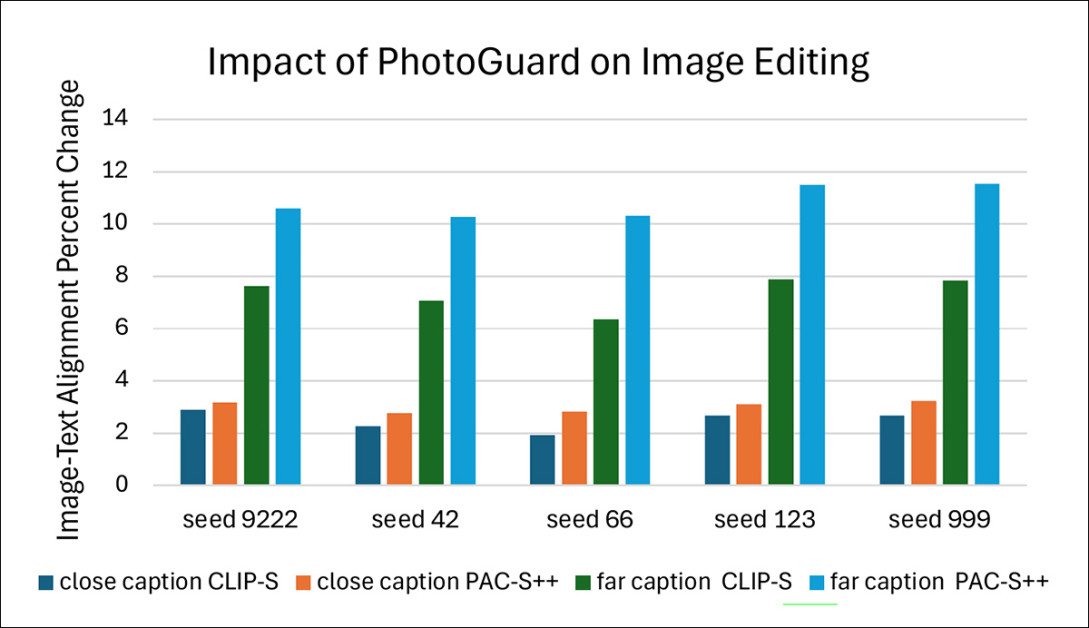

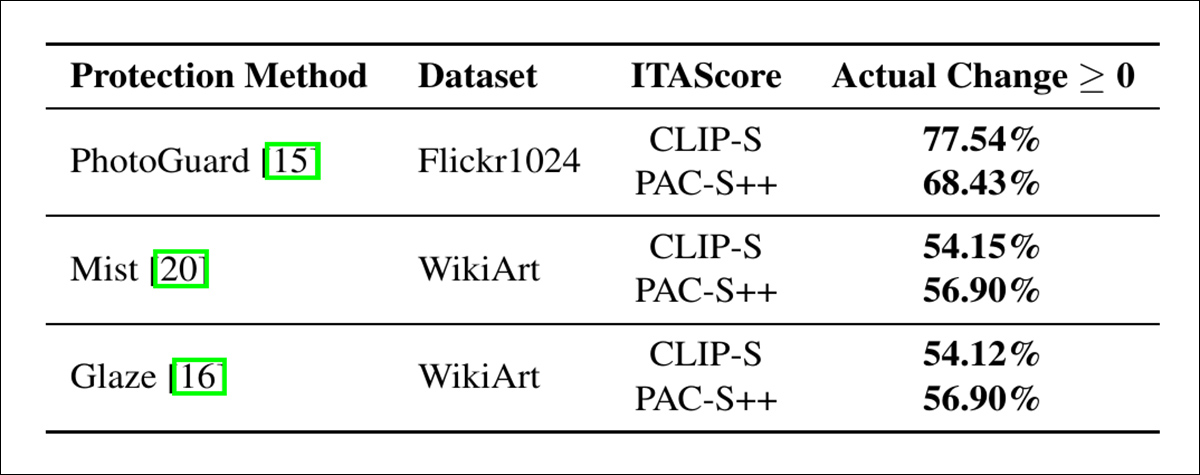

Efecto de la protección en el conjunto de datos Flickr8k a través de cinco semillas, utilizando tanto instrucciones cercanas como lejanas. La alineación de imagen-texto se midió utilizando puntuaciones CLIP-S y PAC-S++.

Los investigadores compararon qué tan bien la IA siguió las instrucciones cuando editaba imágenes protegidas en comparación con imágenes no protegidas. Primero, examinaron la diferencia entre los dos, llamada Cambio Real. Luego, la diferencia se escaló para crear un Cambio Porcentual, lo que facilitó la comparación de resultados a través de muchas pruebas.

Este proceso reveló si las protecciones hicieron que fuera más difícil o más fácil para la IA coincidir con las instrucciones. Las pruebas se repitieron cinco veces utilizando diferentes semillas aleatorias, cubriendo tanto cambios pequeños como grandes en los subtítulos originales.

Ataque De Arte

Para las pruebas en fotografías naturales, se utilizó el conjunto de datos Flickr1024, que contiene más de mil imágenes de alta calidad. Cada imagen se editó con instrucciones que seguían el patrón: ‘cambiar el estilo a [V]’, donde [V] representaba uno de los siete famosos estilos de arte: Cubismo; Postimpresionismo; Impresionismo; Surrealismo; Barroco; Fauvismo; y Renacimiento.

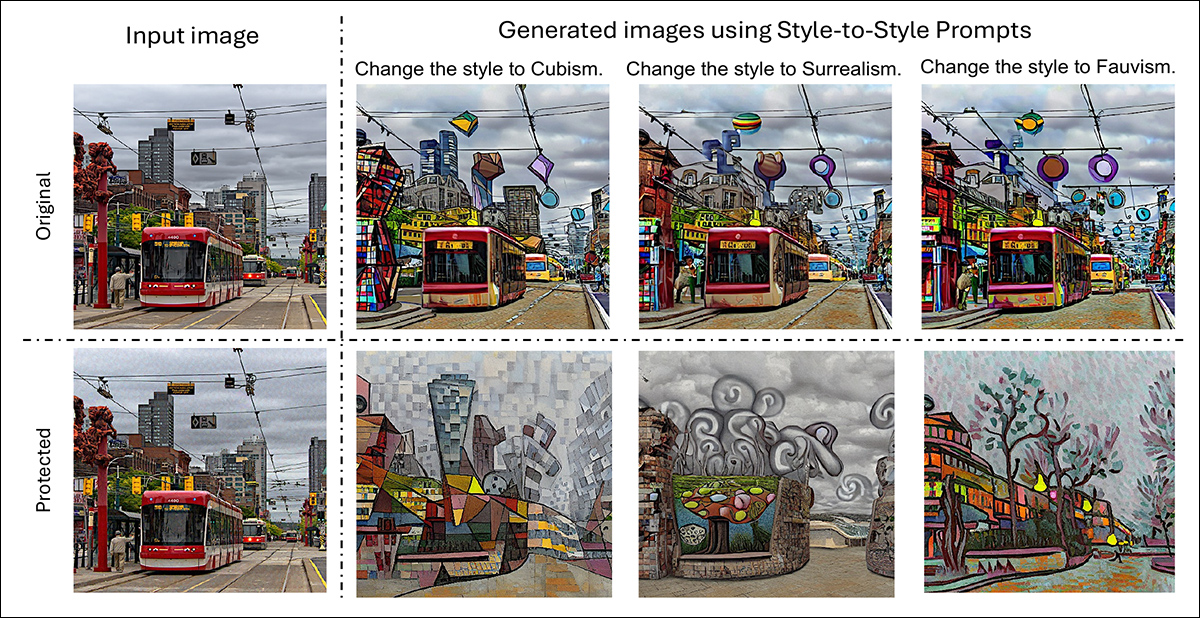

El proceso involucró aplicar PhotoGuard a las imágenes originales, generando versiones protegidas, y luego ejecutando tanto las imágenes protegidas como las no protegidas a través del mismo conjunto de ediciones de transferencia de estilo:

Versiones originales y protegidas de una imagen de escena natural, cada una editada para aplicar estilos de Cubismo, Surrealismo y Fauvismo.

Para probar los métodos de protección en obras de arte, se realizó una transferencia de estilo en imágenes del conjunto de datos WikiArt, que cura una amplia gama de estilos artísticos. Las instrucciones de edición siguieron el mismo formato que antes, instruyendo a la IA para cambiar el estilo a un estilo aleatoriamente seleccionado y no relacionado, extraído de las etiquetas de WikiArt.

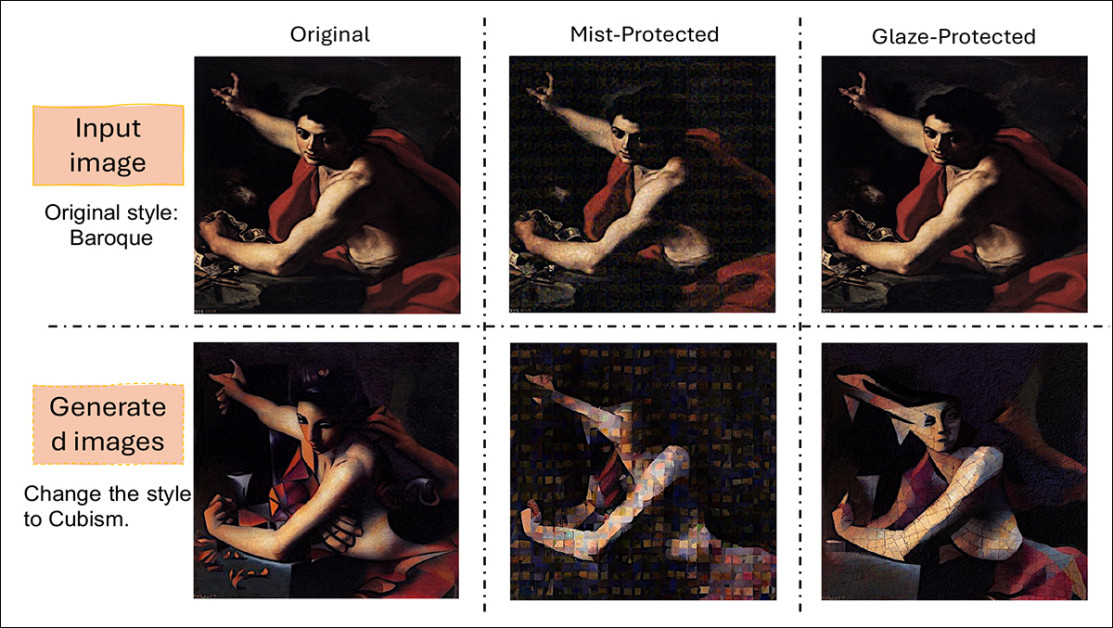

Tanto Glaze como Mist se aplicaron a las imágenes antes de las ediciones, lo que permitió a los investigadores observar qué tan bien cada defensa podría bloquear o distorsionar los resultados de la transferencia de estilo:

Ejemplos de cómo los métodos de protección afectan la transferencia de estilo en obras de arte. La imagen original del Barroco se muestra junto con versiones protegidas por Mist y Glaze. Después de aplicar la transferencia de estilo de Cubismo, se pueden ver las diferencias en cómo cada protección altera la salida final.

Los investigadores probaron las comparaciones de forma cuantitativa:

Cambios en las puntuaciones de alineación de imagen-texto después de las ediciones de transferencia de estilo.

De estos resultados, los autores comentan:

‘Los resultados resaltan una limitación significativa de las perturbaciones adversariales para la protección. En lugar de obstaculizar la alineación, las perturbaciones adversariales a menudo mejoran la respuesta del modelo generativo a las instrucciones, permitiendo involuntariamente a los explotadores producir salidas que se alinean más estrechamente con sus objetivos. Tal protección no es disruptiva para el proceso de edición de imágenes y puede no ser capaz de prevenir a agentes maliciosos de copiar material no autorizado.

‘Las consecuencias no deseadas del uso de perturbaciones adversariales revelan vulnerabilidades en los métodos existentes y subrayan la necesidad urgente de técnicas de protección más efectivas.’

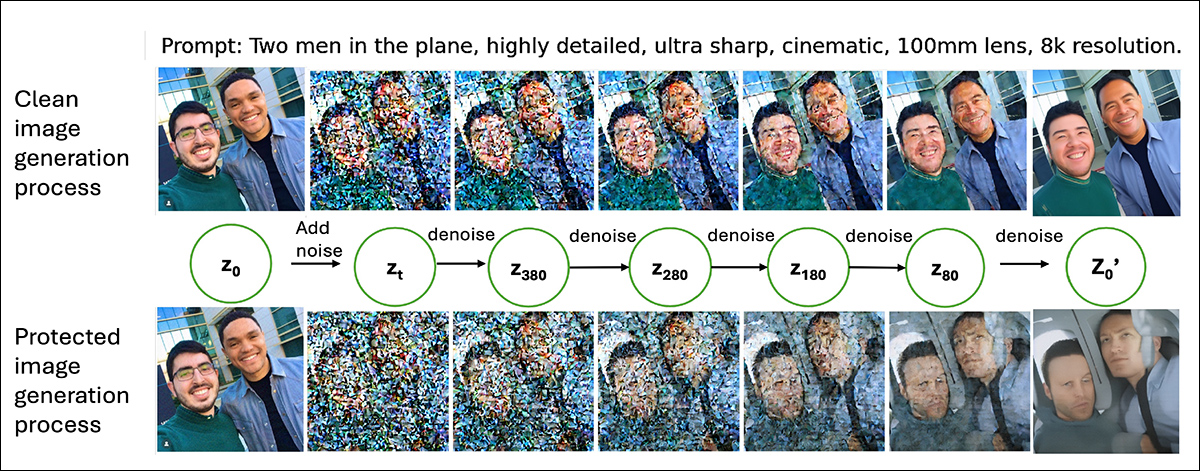

Los autores explican que los resultados inesperados se pueden atribuir a cómo funcionan los modelos de difusión: los LDM editan imágenes convirtiéndolas primero en una versión comprimida llamada latente; luego se agrega ruido a este latente a través de muchos pasos, hasta que los datos se vuelven casi aleatorios.

El modelo invierte este proceso durante la generación, eliminando el ruido paso a paso. En cada etapa de esta reversión, la instrucción de texto ayuda a guiar cómo debe limpiarse el ruido, dando forma gradualmente a la imagen para que coincida con la instrucción:

Comparación entre generaciones de una imagen no protegida y una imagen protegida por PhotoGuard, con estados latentes intermedios convertidos de vuelta en imágenes para visualización.

Los métodos de protección agregan pequeñas cantidades de ruido adicional a la imagen original antes de que entre en este proceso. Si bien estas perturbaciones son menores al principio, se acumulan a medida que el modelo aplica sus propias capas de ruido.

Este crecimiento deja más partes de la imagen ‘inciertas’ cuando el modelo comienza a eliminar ruido. Con mayor incertidumbre, el modelo se apoya más en la instrucción de texto para llenar los detalles faltantes, dándole a la instrucción incluso más influencia de la que normalmente tendría.

En efecto, las protecciones hacen que sea más fácil para la IA remodelar la imagen para que coincida con la instrucción, en lugar de más difícil.

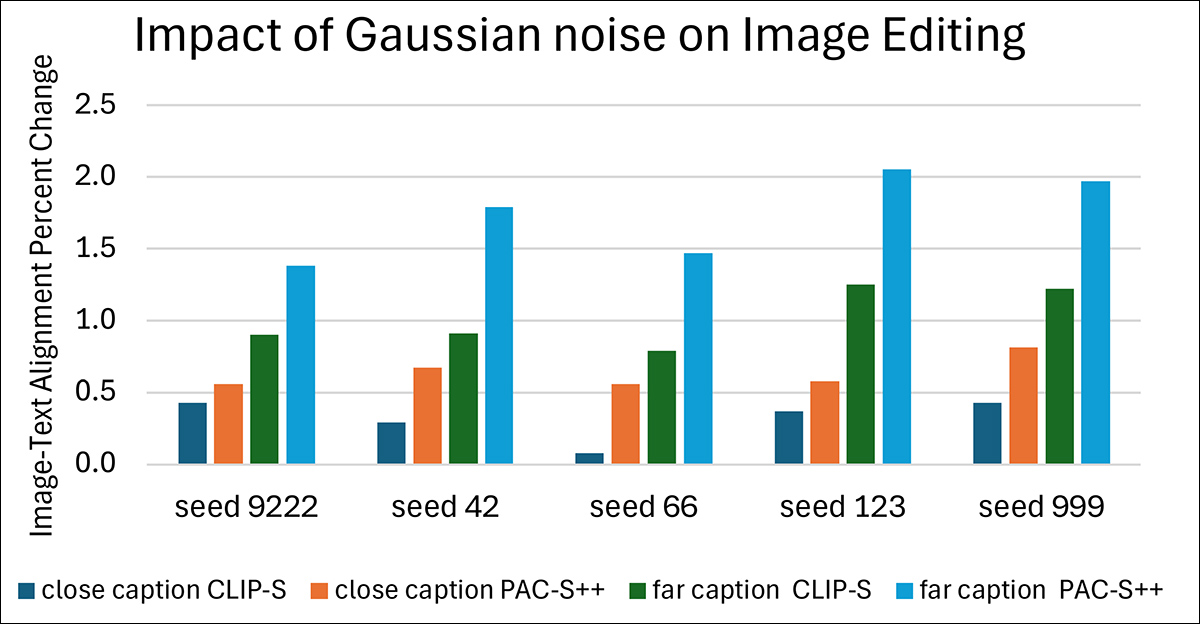

Finalmente, los autores realizaron una prueba que sustituyó perturbaciones elaboradas del papel ‘Raising the Cost of Malicious AI-Powered Image Editing’ por ruido gaussiano puro.

Los resultados siguieron el mismo patrón observado anteriormente: en todas las pruebas, los valores de Cambio Porcentual permanecieron positivos. Incluso este ruido aleatorio y no estructurado condujo a una alineación más fuerte entre las imágenes generadas y las instrucciones.

Efecto de la protección simulada utilizando ruido gaussiano en el conjunto de datos Flickr8k.

Esto respaldó la explicación subyacente de que cualquier ruido agregado, independientemente de su diseño, crea una mayor incertidumbre para el modelo durante la generación, lo que permite que la instrucción de texto ejerza aún más control sobre la imagen final.

Conclusión

La escena de investigación ha estado impulsando la perturbación adversarial en el problema de derechos de autor de LDM durante casi tanto tiempo como han existido los LDM; pero no han surgido soluciones resilientes de la cantidad extraordinaria de artículos publicados sobre este enfoque.

O bien las perturbaciones impuestas disminuyen excesivamente la calidad de la imagen, o los patrones no resultan resistentes a la manipulación y los procesos de transformación.

Sin embargo, es un sueño difícil de abandonar, ya que la alternativa parecería ser la supervisión y los marcos de procedencia de terceros, como el esquema C2PA liderado por Adobe, que busca mantener una cadena de custodia para las imágenes desde el sensor de la cámara en adelante, pero que no tiene una conexión inherente con el contenido representado.

En cualquier caso, si la perturbación adversarial en realidad está empeorando el problema, como indica el nuevo artículo, uno se pregunta si la búsqueda de protección de derechos de autor a través de tales medios cae bajo ‘alquimia’.

Publicado por primera vez el lunes 9 de junio de 2025