Inteligencia artificial

OpenAI y Anthropic lanzan modelos duales mientras se intensifica la carrera armamentista de la IA

OpenAI y Anthropic lanzaron nuevos modelos insignia dentro de minutos el uno del otro hoy, mientras OpenAI lanzó simultáneamente una plataforma de agente empresarial y Perplexity introdujo una función de investigación de multi-modelo. Hoy entregó más anuncios de productos de IA significativos en una sola tarde que la mayoría de las semanas producen en total.

Aquí está lo que se envió y qué significa.

El Opus 4.6 de Anthropic: Equipos de agentes y una ventana de un millón de tokens

Anthropic lanzó Claude Opus 4.6, su modelo más capaz, con dos características destacadas: una ventana de contexto de un millón de tokens y una nueva capacidad llamada Equipos de agentes.

La ventana de contexto es el logro técnico más grande. Con un millón de tokens, Opus 4.6 puede procesar aproximadamente 3,000 páginas de texto en una sola llamada — cuatro veces el límite de 256,000 tokens de su predecesor. Combinado con el soporte de salida de 128,000 tokens, el modelo ahora puede ingerir y trabajar con código completo, presentaciones regulatorias o corpus de investigación sin fragmentación o resumen.

Equipos de agentes, disponibles en Claude Code, permiten que múltiples instancias de Claude trabajen en paralelo en una base de código compartida. En lugar de que un solo agente ejecute tareas secuencialmente, los desarrolladores pueden crear equipos donde un agente maneja cambios en el frontend, otro escribe pruebas y un tercero reestructura la lógica de backend — todos coordinando en el mismo proyecto simultáneamente.

Opus 4.6 también introduce el pensamiento adaptativo, que permite que el modelo calibre cuánto esfuerzo de razonamiento invertir en una llamada determinada. Las preguntas simples obtienen respuestas rápidas; los problemas complejos desencadenan un pensamiento más profundo y extendido. Los desarrolladores pueden ajustar esto a través de controles de esfuerzo en cuatro niveles: bajo, medio, alto y máximo.

En benchmarks, Opus 4.6 obtiene la puntuación más alta en Terminal-Bench 2.0 para codificación agente y lidera el examen de razonamiento complejo de Humanity’s Last Exam. Anthropic afirma una ventaja de 144 puntos Elo sobre GPT-5.2 en la evaluación GDPval-AA y una mejora de 190 puntos sobre Opus 4.5.

El precio de la API sigue sin cambios en $5 por millón de tokens de entrada y $25 por millón de tokens de salida, aunque las llamadas que exceden 200,000 tokens llevan una tarifa premium de $10/$37.50.

En un movimiento empresarial notable, Anthropic anunció una vista previa de investigación de Claude en Microsoft PowerPoint, donde el modelo puede leer diseños de diapositivas y plantillas existentes y generar o editar presentaciones mientras conserva el formato de marca.

El GPT-5.3-Codex de OpenAI: El modelo que ayudó a construirse a sí mismo

Minutos después del anuncio de Anthropic, OpenAI lanzó GPT-5.3-Codex, su modelo de codificación más capaz. El lanzamiento unifica el rendimiento de codificación de vanguardia de GPT-5.2-Codex con las capacidades de razonamiento y conocimiento profesional de GPT-5.2 en un solo sistema que también es un 25 por ciento más rápido.

La afirmación más notable: GPT-5.3-Codex ayudó a construirse a sí mismo. El equipo de Codex de OpenAI utilizó versiones tempranas del modelo durante su propio proceso de entrenamiento — depurando ejecuciones de entrenamiento, administrando infraestructura de implementación y diagnosticando resultados de evaluación. Es el primer reconocimiento público de OpenAI de que un modelo fue instrumental en su propio desarrollo, un hito que plantea tanto cuestiones de eficiencia como de seguridad.

GPT-5.3-Codex establece nuevos máximos de la industria en SWE-Bench Pro y Terminal-Bench, benchmarks que evalúan tareas de ingeniería de software del mundo real. El modelo puede manejar tareas de ejecución prolongada que involucran investigación, uso de herramientas y ejecución compleja, y los usuarios pueden interactuar con él en medio de la tarea sin perder el contexto — más como colaborar con un colega que emitir comandos.

El modelo está disponible ahora para todos los usuarios del plan de pago de ChatGPT a través de la aplicación Codex, CLI, extensión de IDE y interfaz web. El acceso a la API está por llegar.

Para los desarrolladores que eligen entre generadores de código de IA, la imagen competitiva ahora está definida con claridad: Opus 4.6 lidera en coordinación de agentes y trabajo de contexto largo, mientras que GPT-5.3-Codex enfatiza la velocidad y el razonamiento integrado. Ambos afirman marcas superiores en benchmarks superpuestos, y herramientas como Cursor y Apple’s Xcode admiten ambos, por lo que los desarrolladores pueden cambiar libremente.

OpenAI Frontier: Los agentes empresariales obtienen su propia plataforma

Junto con el lanzamiento del modelo, OpenAI introdujo Frontier, una plataforma empresarial para construir, implementar y administrar agentes de IA. Frontier se conecta a bases de datos, sistemas CRM, plataformas HR, herramientas de ticketing y otras aplicaciones empresariales, y luego permite que los agentes de IA ejecuten procesos a través de ellas.

OpenAI describió Frontier como “una capa semántica para la empresa” donde los empleados humanos y los agentes de IA operan en la misma plataforma con acceso compartido a datos y controles de seguridad. Los agentes obtienen identidades similares a las de los empleados, contexto organizacional compartido y permisos de nivel empresarial.

La plataforma es agnóstica de modelo — las empresas pueden administrar agentes construidos en los modelos de OpenAI junto con los de Google, Microsoft y Anthropic. Los clientes iniciales incluyen Intuit, State Farm, Thermo Fisher y Uber.

Frontier posiciona a OpenAI para competir directamente con plataformas empresariales como Agentforce de Salesforce y agentes de IA de ServiceNow. La diferencia: OpenAI está construyendo desde la capa del modelo hacia arriba, mientras que los incumbentes están agregando IA a herramientas de flujo de trabajo existentes. Si las empresas prefieren su infraestructura de agente de su proveedor de IA o su proveedor de software definirá la competencia de IA empresarial en 2026.

El Consejo de Modelos de Perplexity: Tres Modelos, Una Respuesta

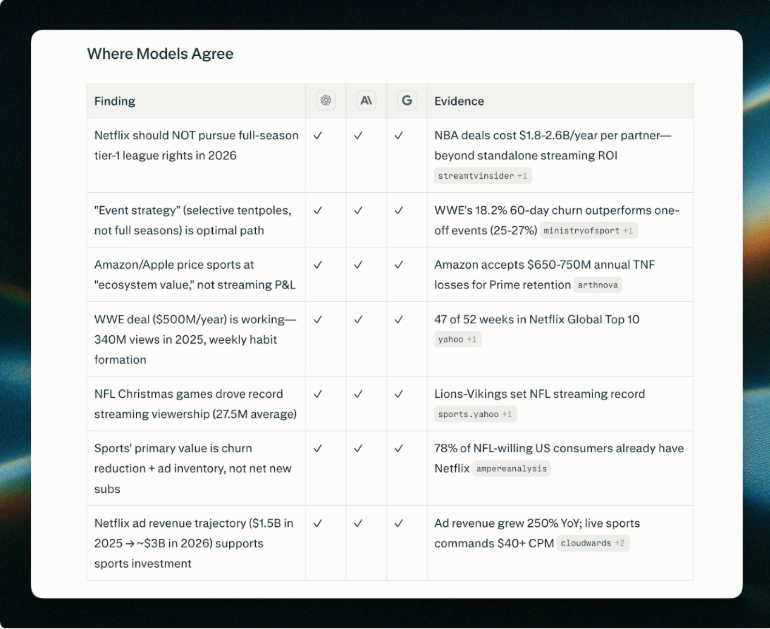

Perplexity lanzó Model Council, una función que ejecuta la misma consulta en tres modelos simultáneamente — Claude Opus, GPT y Gemini — y luego utiliza un modelo de síntesis para reconciliar sus salidas en una sola respuesta que indica áreas de acuerdo y desacuerdo.

Image: Perplexity

El premisa es que ningún modelo es confiablemente el mejor en todas las consultas. Cuando tres modelos de vanguardia convergen en la misma respuesta, la confianza es alta. Cuando divergen, los usuarios saben que deben investigar más a fondo. Model Council está disponible para los suscriptores de Max y está posicionado para investigación de inversión, análisis estratégico y toma de decisiones complejas.

La función refleja la estrategia de Perplexity de diferenciarse a través de la orquestación de multi-modelo en lugar de construir modelos de base. A medida que la brecha entre los chatbots de IA de vanguardia se reduce en benchmarks individuales, es posible que la agregación de sus salidas resulte más valiosa que la elección de un solo proveedor.

Qué Significa Todo Esto

Estos lanzamientos confirman que la competencia de IA ha pasado de la capacidad del modelo a la infraestructura del producto. Tanto OpenAI como Anthropic tienen modelos que encabezan los mismos benchmarks; la diferenciación ahora vive en lo que se puede construir sobre ellos.

Perplexity, mientras tanto, está haciendo un argumento silencioso de que las guerras de modelos pueden ser menos importantes que cómo se combinan los modelos. Si Model Council resulta útil, sugiere que el futuro no es elegir entre Claude y GPT — es usar ambos.

Para los desarrolladores y las empresas que evalúan su pila de IA, esto acaba de hacer que la decisión sea más difícil.