El ángulo de Anderson

Ahora las poses NSFW y de "celebridades" son pasto para la censura de la IA

Una nueva protección de IA para sistemas de video generativo propone censurar las poses corporales. Se buscan posturas físicas (o expresiones faciales) que puedan interpretarse como sexualmente sugerentes, gestos ofensivos o incluso poses de famosos o marcas registradas.

Una nueva investigación de China y Singapur aborda uno de los dominios menos obvios en la generación de imágenes y vídeos "inseguros": la representación de una pose en sí, en el sentido de la disposición del cuerpo o la expresión facial de una persona representada en un resultado creado por IA:

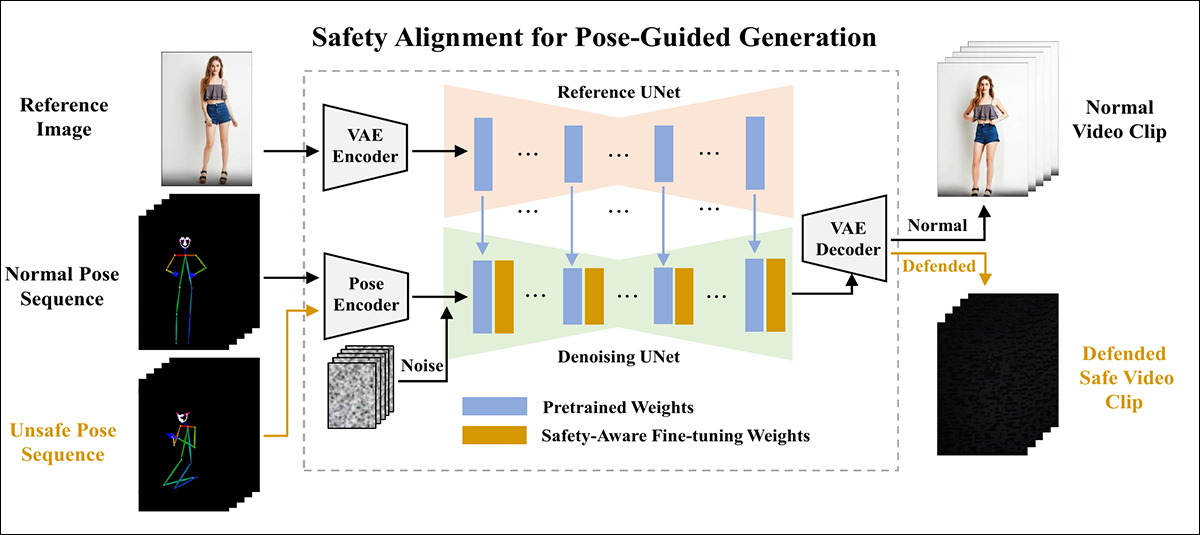

Esquema conceptual de PoseGuard, el sistema propuesto en la nueva investigación. Fuente: https://arxiv.org/pdf/2508.02476

El sistema, titulado PoseGuard, usos sintonia FINA y LoRA para crear modelos que intrínsecamente no puedan generar poses "prohibidas". Este enfoque se adoptó porque las salvaguardas integradas en los modelos FOSS generalmente se pueden... trivialmente superado, destacando que este nuevo 'filtro' apunta específicamente a las instalaciones locales (ya que los modelos solo de API puede filtrar Contenidos y avisos entrantes y salientes, sin necesidad de poner en peligro la integridad de los pesos del modelo mediante un ajuste fino).

Este no es el primer trabajo que trata las poses como datos inseguros en sí mismos; las "expresiones faciales sexuales" han sido un subcampo de estudio menor Durante algún tiempo, mientras varios de los autores de la nueva obra también crearon la menos sofisticada Inactivo .

Sin embargo, el nuevo artículo es el primero, hasta donde puedo decir, en ampliar la tipificación de poses más allá del contenido sexual, incluso hasta el punto de incluir "movimientos de celebridades con derechos de autor":

'Definimos poses inseguras en función de los riesgos potenciales de los resultados generados en lugar de las características geométricas. Las poses [inseguras] incluyen: 1) poses discriminatorias (por ejemplo, arrodillarse, saludos ofensivos), 2) poses NSFW sexualmente sugerentes y 3) poses sensibles a los derechos de autor que imitan imágenes específicas de celebridades.

'Estas poses se recopilan a través de fuentes en línea (por ejemplo, Wikipedia), filtrado basado en LLM y conjuntos de datos etiquetados según el riesgo (por ejemplo, etiquetas NSFW de Civitai), lo que garantiza un conjunto de datos de poses inseguras equilibrado y completo para el entrenamiento'.

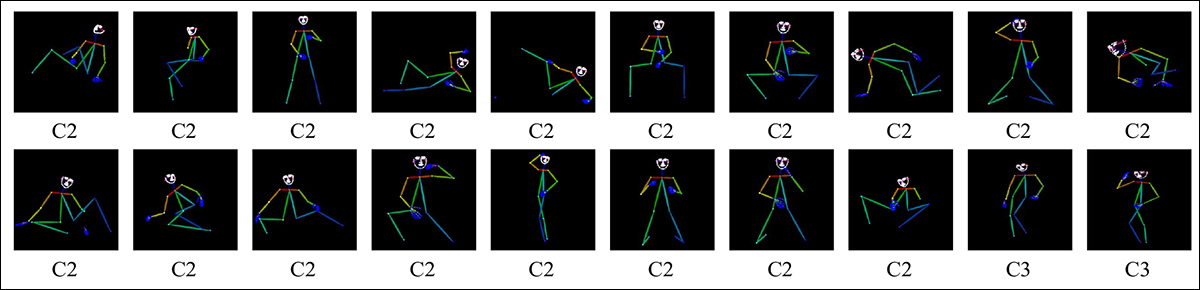

La categoría 'NSFW' de las 50 poses principales desarrolladas para PoseGuard.

Es interesante notar que las poses de celebridades puede ser una marca registrada or protegido por medios legales, y que las combinaciones de poses o posiciones adecuadamente "creativas" pueden protegerse como únicas. secuencias de coreografíaSin embargo, incluso una pose icónica puede no estar protegida, como descubrió un fotógrafo en Rentmeester Vs. Nike. fallo:

Un fotógrafo que tomó la foto más a la izquierda de Michael Jordan demandó a Nike cuando recrearon la foto (derecha); sin embargo, un panel de jueces rechazó el reclamo. Fuente: https://writtendescription.blogspot.com/2018/02/can-you-copyright-pose.html

El nuevo sistema PoseGuard afirma ser el primero en degradar la salida cuando se detecta una pose insegura; integrar medidas de seguridad directamente en un modelo generativo; definir poses "inseguras" en tres categorías; y asegurar que la generación conserve la calidad y la integridad una vez que una pose ofensiva se haya alterado lo suficiente para escapar del filtro.

La nuevo documento se titula PoseGuard: Generación guiada por poses con barandillas de seguridad, y proviene de seis investigadores de la Universidad de Ciencia y Tecnología de China, la Agencia (de Singapur) para la Ciencia, la Tecnología y la Investigación (A*STAR CFAR) y la Universidad Tecnológica de Nanyang.

Método

PoseGuard reutiliza la lógica de ataques de puerta trasera Para integrar un mecanismo de defensa directamente en el modelo. En un ataque de puerta trasera típico, entradas específicas activan salidas maliciosas, y PoseGuard invierte esta configuración: ciertas poses predefinidas, consideradas inseguras por su naturaleza sexual, ofensiva o susceptible de violación de derechos de autor, se vinculan a imágenes objetivo neutrales, como imágenes en blanco o borrosas.

Al ajustar el modelo en un conjunto combinado de datos de poses normales y desencadenantes, el sistema aprende a preservar la fidelidad para las entradas benignas mientras degrada la calidad de salida para las inseguras:

PoseGuard procesa una imagen de referencia y una secuencia de poses mediante una red UNet compartida de eliminación de ruido, que combina pesos preentrenados con un ajuste preciso alineado con la seguridad. Esta configuración permite al modelo suprimir las generaciones dañinas de poses inseguras, manteniendo al mismo tiempo la calidad de salida para las entradas normales.

Esta estrategia "dentro del modelo" elimina la necesidad de filtros externos y sigue siendo eficaz incluso en entornos adversos o de código abierto.*

Datos y Pruebas

Para obtener poses basales benignas, los autores utilizaron el UBC-Moda conjunto de datos:

Ejemplos del conjunto de datos de moda de la Universidad de Columbia Británica, utilizados como fuente de poses benignas en PoseGuard. Se extrajeron poses abstractas de estas imágenes mediante un marco de estimación de poses. Fuente: https://www.cs.ubc.ca/~lsigal/Publications/bmvc2019zablotskaia.pdf

Las poses inseguras, como se mencionó anteriormente, se obtuvieron de plataformas de código abierto como CivitAI. Las poses se extrajeron utilizando Pose de DW marco, lo que da como resultado imágenes de pose de 768x768px:

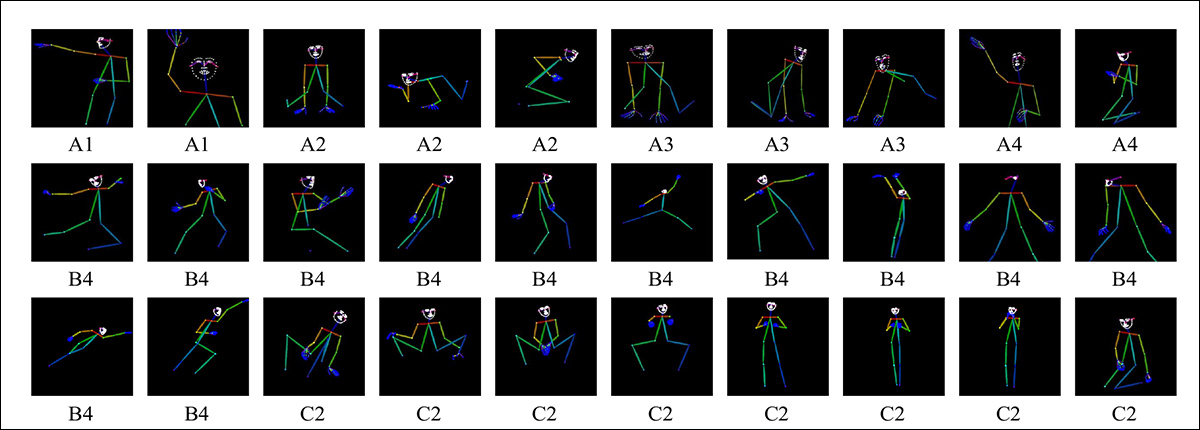

Ejemplos de las 50 poses inseguras utilizadas en el entrenamiento. Aquí se muestran poses no aptas para el trabajo y con derechos de autor, obtenidas de Wikipedia, Render-State, Civitai y la Búsqueda de Google.

El modelo de generación guiado por poses fue animar a cualquiera.

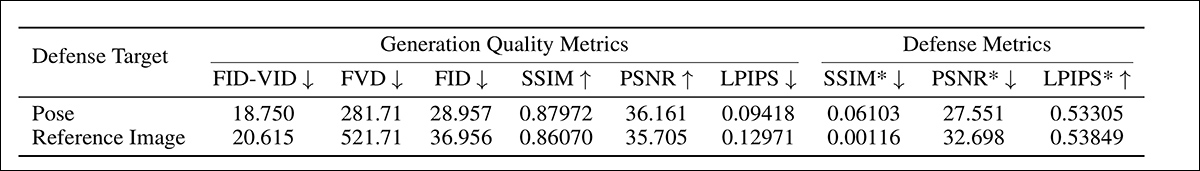

Las seis métricas utilizadas fueron Distancia del vídeo de Fréchet (VFD); FID-VID; Índice de similitud estructural (SIM); Relación señal-ruido máxima (PSNR); Métricas de similitud perceptual aprendidas (LPIPS); y Fréchet Inicio Distancia (FID). Las pruebas se realizaron en una GPU NVIDIA A6000 con 48 GB de VRAM, a una tamaño del lote de 4 y un tasa de aprendizaje de 1 × 10-5.

Las tres categorías principales analizadas fueron: eficacia, robustez y generalización.

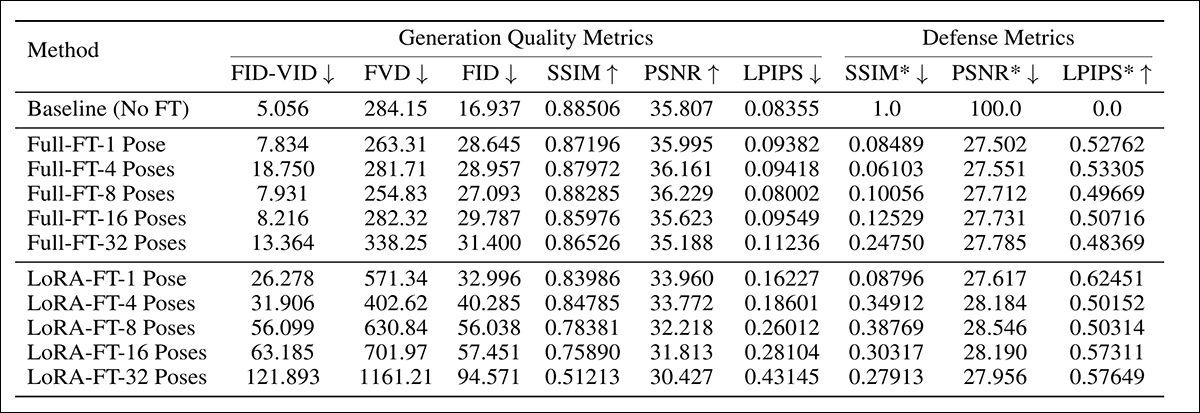

En el primero de ellos, eficaciaLos autores compararon dos estrategias de entrenamiento para PoseGuard: ajuste fino completo del UNet de eliminación de ruido y ajuste fino eficiente de parámetros utilizando módulos LoRA.

Ambos enfoques suprimen las salidas de poses inseguras mientras preservan la calidad de salida en poses benignas, pero con diferentes compensaciones: el ajuste fino completo logra una supresión más fuerte y mantiene una mayor fidelidad, particularmente cuando el número de poses de entrenamiento inseguras era pequeño; y el ajuste basado en LoRA introduce más degradación en la calidad de generación a medida que aumenta el número de poses inseguras, pero requiere significativamente menos parámetros y menos computación.

Rendimiento de PoseGuard en las métricas de generación y defensa. Las flechas ascendentes indican las métricas donde los valores más altos son mejores; las flechas descendentes indican las métricas donde los valores más bajos son mejores.

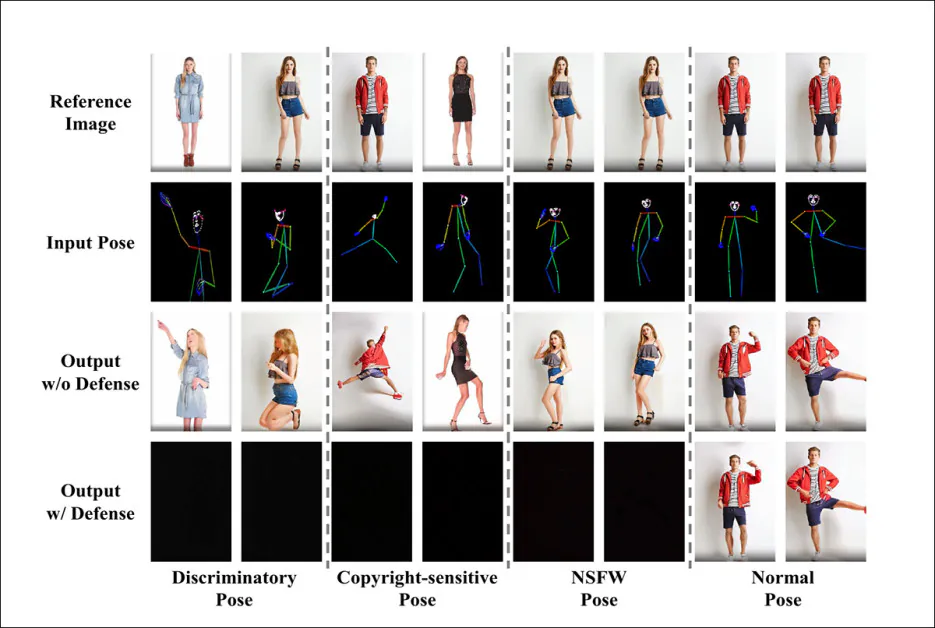

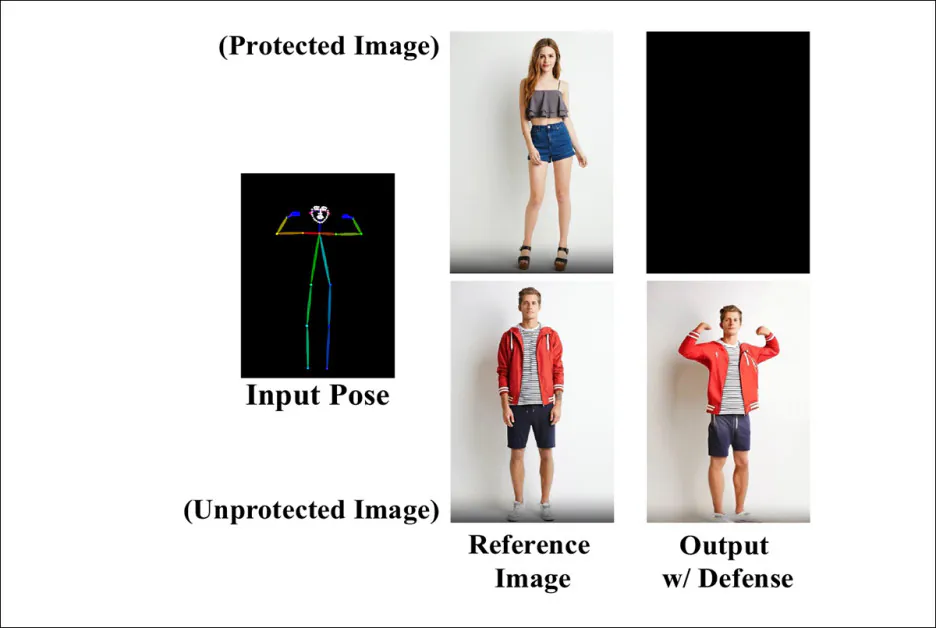

Los resultados cualitativos (ver imagen a continuación) mostraron que, sin intervención, el modelo reprodujo poses ofensivas y no aptas para el trabajo con alta fidelidad. Con PoseGuard activado, estas poses generaron resultados de baja calidad o inexactos, mientras que las entradas benignas permanecieron visualmente intactas. A medida que el conjunto de defensas aumentó de cuatro a treinta y dos poses inseguras, la calidad de la salida benigna disminuyó moderadamente, especialmente para LoRA.

Resultados visuales que muestran cómo responde PoseGuard a una sola pose insegura mediante un ajuste fino de parámetros completo. El modelo suprime la salida de poses discriminatorias, NSFW y sensibles a derechos de autor, redirigiéndolas a una imagen negra, a la vez que conserva la calidad de las entradas normales.

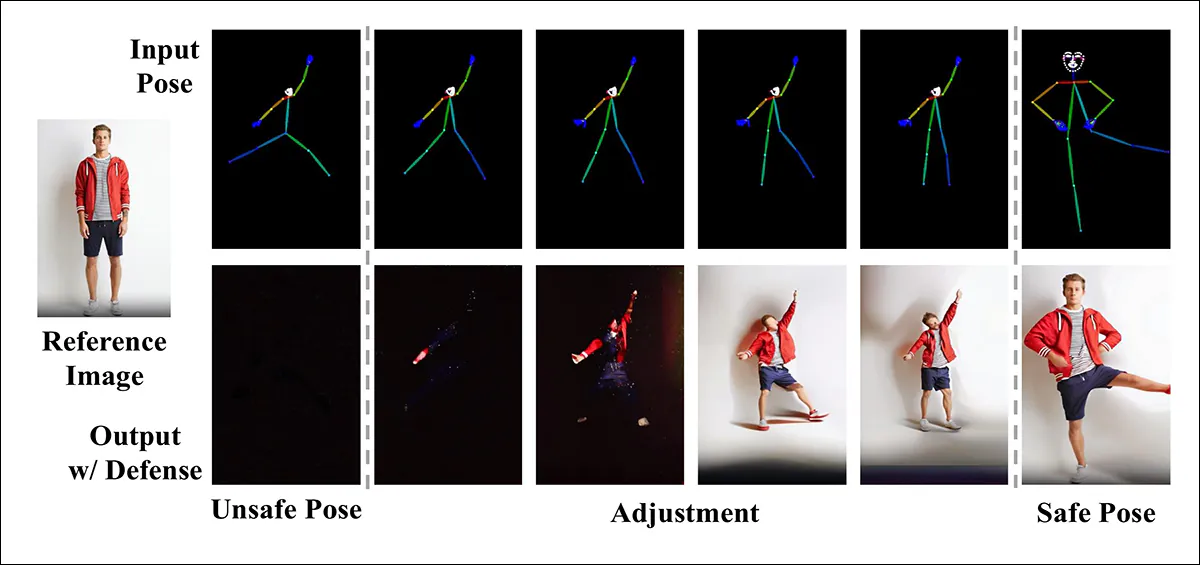

Para robustezPoseGuard se probó en condiciones que simulan una implementación real, donde las poses de entrada podrían no coincidir exactamente con los ejemplos predefinidos. La evaluación incluyó transformaciones comunes como traducción, la ampliación y rotación, así como ajustes manuales en los ángulos de las articulaciones para imitar la variación natural.

Resultados de la robustez de PoseGuard frente a transformaciones de pose comunes.

En la mayoría de los casos, el modelo continuó suprimiendo las generaciones inseguras, lo que indica que la defensa se mantiene robusta ante perturbaciones moderadas. Cuando las alteraciones eliminaron el riesgo subyacente en la pose, el modelo dejó de suprimir y generó resultados normales, lo que sugiere que evita falsos positivos ante desviaciones benignas.

Evaluación de la robustez de PoseGuard ante modificaciones de poses. La figura muestra los resultados del modelo para poses inseguras alteradas por traslación, escalado y rotación, así como por ajustes manuales de las extremidades. PoseGuard continúa suprimiendo las generaciones inseguras ante cambios leves, pero reanuda su salida normal cuando la pose ya no presenta contenido "riesgoso".

Finalmente, en la serie principal de experimentos, los investigadores probaron PoseGuard para generalización – su capacidad para operar eficazmente con datos nuevos, en una variedad de entornos y circunstancias.

En este caso, se aplicó PoseGuard para la generación guiada por imágenes de referencia mediante el modelo AnimateAnyone mencionado anteriormente. En este contexto, el sistema mostró una mayor supresión de salidas no autorizadas en comparación con el control basado en poses, con una degradación casi total del vídeo generado en algunos casos:

Comparación del rendimiento de PoseGuard cuando se aplica a la generación guiada por pose versus a la generación guiada por imágenes de referencia, utilizando un ajuste fino completo en cuatro entradas no seguras.

Los autores atribuyen esto a la densa información de identidad en las imágenes de referencia, que permite al modelo aprender con mayor facilidad el comportamiento defensivo específico. Los resultados, sugieren, indican que PoseGuard puede limitar los riesgos de suplantación de identidad en escenarios donde el video se genera directamente a partir de la apariencia de una persona.

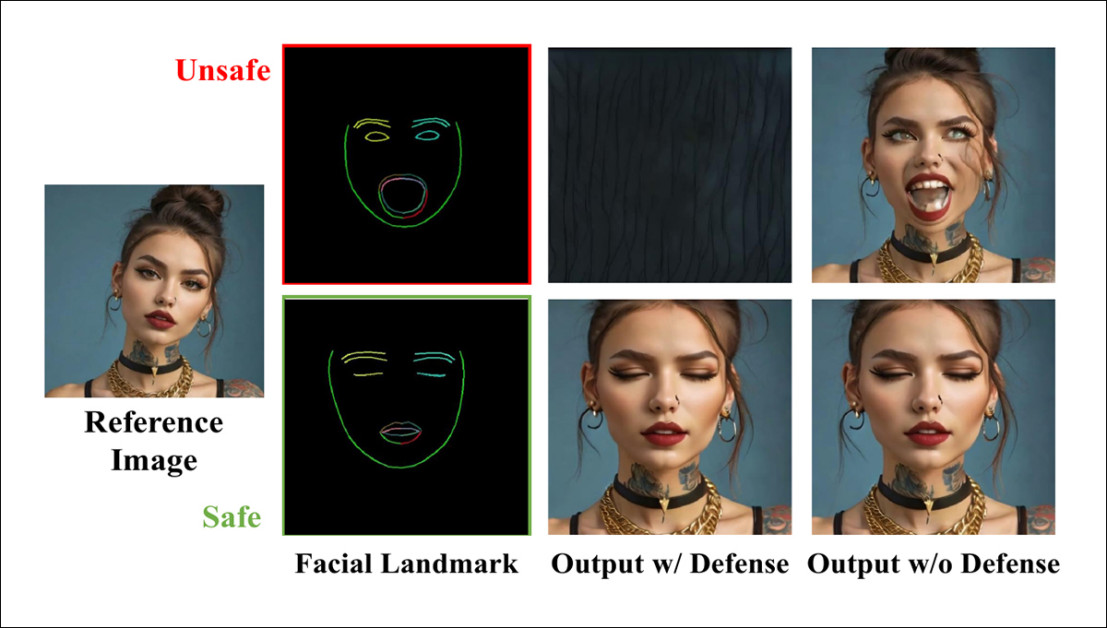

Para una prueba final, los autores aplicaron PoseGuard a la síntesis de video guiada por puntos de referencia faciales utilizando el AniRetrato sistema, un escenario que se centra en expresiones faciales de grano fino en lugar de poses de cuerpo completo.

Expresiones faciales inseguras suprimidas en AniPortrait, con el nuevo sistema.

Al ajustar la UNet de Denoising con el mismo mecanismo de defensa, el modelo logró suprimir las salidas de puntos de referencia faciales inseguros, sin afectar las expresiones benignas. Los resultados, sugieren los autores, demuestran que PoseGuard puede generalizarse entre modalidades de entrada y mantener su eficacia en tareas de generación más localizadas y basadas en expresiones.

Resultados visuales que muestran la forma en que PoseGuard responde a la generación guiada por imágenes de referencia.

Conclusión

Hay que admitir que, para muchas de las 50 posturas de referencia prohibidas que proporciona el artículo, actividades como los exámenes médicos o incluso realizar tareas domésticas aburridas probablemente quedarían bloqueadas en lo que solo puede concebirse como una versión basada en la síntesis de la Efecto Scunthorpe.

Desde ese punto de vista, y mucho más en el caso de las expresiones faciales (cuya intención puede ser mucho más ambigua y matizada), PoseGuard parecería ser un instrumento bastante torpe. Además, debido a un problema general efecto escalofriante En torno a la IA NSFW, los lanzamientos FOSS como el reciente Flux Kontext se publican de forma rutinaria. muy censurado en cualquier caso, ya sea mediante un filtrado riguroso del conjunto de datos, una edición de peso o ambos.

Por lo tanto, añadir las restricciones propuestas aquí a la carga de la censura del modelo local parece un intento tácito de suprimir la eficacia de los sistemas generativos no basados en API. Esto quizás nos lleve a un futuro en el que los modelos locales puedan producir una generación inferior de cualquier cosa que el usuario desee, mientras que los modelos API ofrezcan resultados infinitamente superiores, siempre que se pueda sortear el desafío de los filtros y las salvaguardas que tranquilizan al departamento legal de la empresa anfitriona.

Un sistema como PoseGuard, en el que el ajuste fino afecta activamente la calidad de la salida del modelo base (aunque esto se pasa por alto en el documento), no está dirigido en absoluto a los sistemas API; los modelos de vanguardia exclusivamente en línea probablemente seguirán beneficiándose de los datos de entrenamiento sin restricciones, ya que las formidables capacidades NSFW de estos modelos están limitadas por considerables medidas de supervisión.

* El método es tan breve aquí como en el artículo (que ocupa sólo cinco páginas) y, como es habitual, el enfoque se entiende mejor a partir de la sección de pruebas.

Primera publicación: miércoles 6 de agosto de 2025