Inteligencia artificial

NeRF: Entrenamiento de drones en entornos de radiación neural

Los investigadores de la Universidad de Stanford han ideado una nueva forma de entrenar a los drones para navegar en entornos fotorealistas y altamente precisos, aprovechando la reciente avalancha de interés en Campos de Radiación Neural (NeRF).

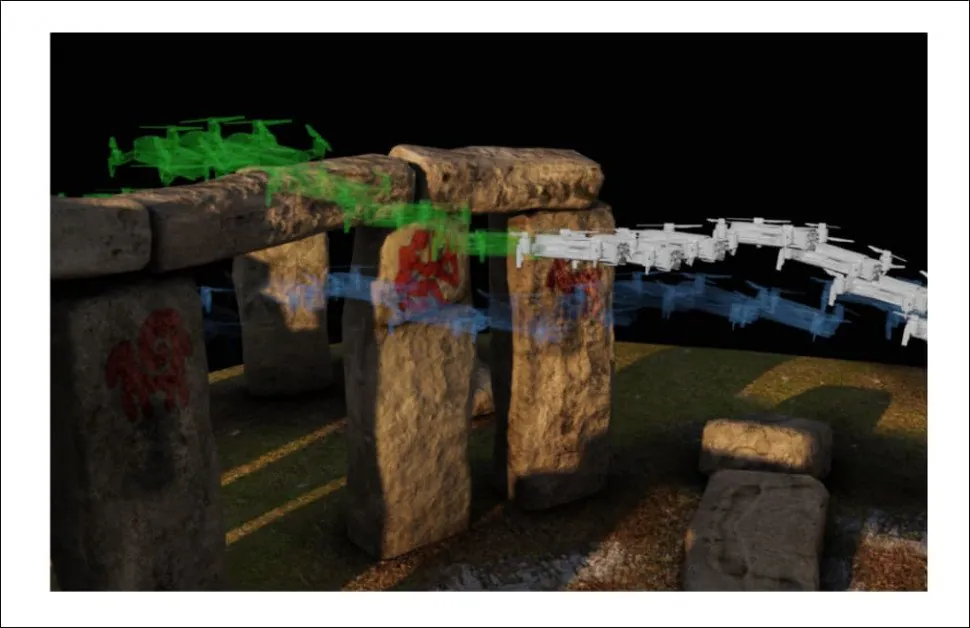

Los drones pueden ser entrenados en entornos virtuales mapeados directamente desde ubicaciones de la vida real, sin necesidad de reconstrucción de escenas 3D especializadas. En esta imagen del proyecto, se ha agregado una perturbación del viento como un obstáculo potencial para el drone, y podemos ver que el drone se desvía momentáneamente de su trayectoria y se compensa en el último momento para evitar un obstáculo potencial. Fuente: https://mikh3x4.github.io/nerf-navigation/

El método ofrece la posibilidad de entrenamiento interactivo de drones (o otros tipos de objetos) en escenarios virtuales que incluyen automáticamente información de volumen (para calcular la evasión de colisiones), texturizado extraído directamente de fotos de la vida real (para ayudar a entrenar las redes de reconocimiento de imágenes de los drones de manera más realista) y iluminación del mundo real (para asegurarse de que se entrenen una variedad de escenarios de iluminación en la red, evitando la sobreamplitud o la sobreoptymización de la instantánea original de la escena).

Un objeto-couch navega un entorno virtual complejo que habría sido muy difícil de mapear utilizando la captura de geometría y retexturizado en flujos de trabajo tradicionales de AR/VR, pero que se recreó automáticamente en NeRF a partir de un número limitado de fotos. Fuente: https://www.youtube.com/watch?v=5JjWpv9BaaE

Las implementaciones típicas de NeRF no cuentan con mecanismos de trayectoria, ya que la mayoría de los proyectos de NeRF de los últimos 18 meses se han centrado en otros desafíos, como iluminación de escenas, representación de reflejos, composición y desentrelazamiento de elementos capturados. Por lo tanto, la principal innovación del nuevo artículo es implementar un entorno NeRF como un espacio navegable, sin el equipo extenso y los procedimientos laboriosos que serían necesarios para modelarlo como un entorno 3D basado en la captura de sensores y la reconstrucción de CGI.

NeRF como VR/AR

El nuevo artículo se titula Navegación de robots con visión única en un mundo de radiación neural, y es una colaboración entre tres departamentos de Stanford: Aeronáutica y Astronáutica, Ingeniería Mecánica y Ciencias de la Computación.

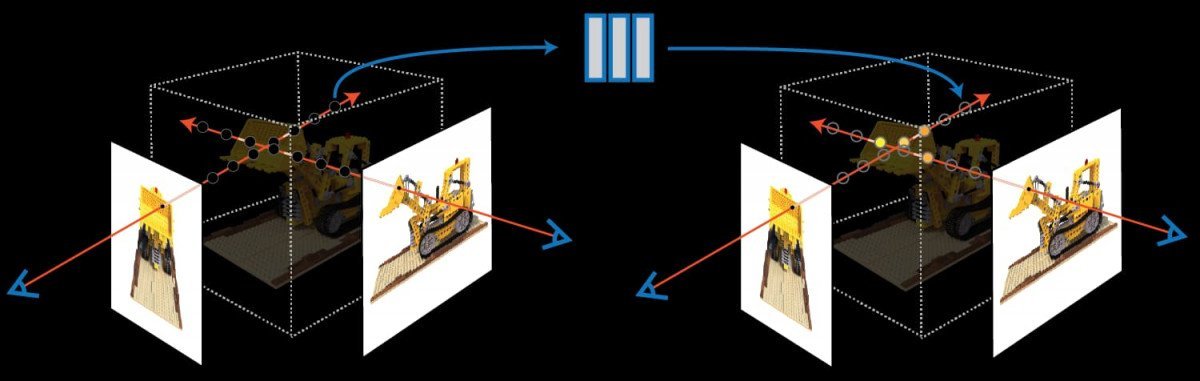

El trabajo propone un marco de navegación que proporciona a un robot un entorno NeRF preentrenado, cuya densidad de volumen delimita los caminos posibles para el dispositivo. También incluye un filtro para estimar dónde se encuentra el robot dentro del entorno virtual, basado en el reconocimiento de imágenes de la cámara RGB a bordo del robot. De esta manera, un drone o robot puede “alucinar” más precisamente lo que puede esperar ver en un entorno determinado.

El optimizador de trayectoria del proyecto navega a través de un modelo NeRF de Stonehenge que se generó a través de la fotogrametría y la interpretación de imágenes (en este caso, de modelos de malla) en un entorno de radiación neural. El planificador de trayectorias calcula varios caminos posibles antes de establecer una trayectoria óptima sobre el arco.

Debido a que un entorno NeRF cuenta con occlusiones completamente modeladas, el drone puede aprender a calcular obstrucciones más fácilmente, ya que la red neural detrás de NeRF puede mapear la relación entre occlusiones y la forma en que los sistemas de navegación visuales a bordo del drone perciben el entorno. La generación automática de NeRF ofrece un método relativamente trivial para crear espacios de entrenamiento hiperrealistas con solo unas pocas fotos.

El marco de replanificación en línea desarrollado para el proyecto de Stanford facilita una tubería de navegación basada en visión completamente resistente.

La iniciativa de Stanford es una de las primeras en considerar las posibilidades de explorar un espacio NeRF en el contexto de un entorno inmersivo y navegable de estilo VR. Los campos de radiación neural son una tecnología emergente y actualmente están sujetos a múltiples esfuerzos académicos para optimizar sus altos requisitos de recursos informáticos, así como para desentrelazar los elementos capturados.

NeRF no es (realmente) CGI

Debido a que un entorno NeRF es una escena 3D navegable, se ha convertido en una tecnología malentendida desde su aparición en 2020, a menudo ampliamente percibida como un método para automatizar la creación de mallas y texturas, en lugar de reemplazar entornos 3D familiares para los espectadores de los departamentos de efectos visuales de Hollywood y las escenas fantásticas de entornos de realidad aumentada y virtual.

NeRF extrae información de geometría y textura de un número muy limitado de puntos de vista de imagen, calculando la diferencia entre imágenes como información volumétrica. Fuente: https://www.matthewtancik.com/nerf

En realidad, el entorno NeRF es más como un espacio de renderizado “en vivo”, donde se mantiene y navega una amalgama de información de píxeles y luces en una red neural en ejecución.

La clave del potencial de NeRF es que solo requiere un número limitado de imágenes para recrear entornos, y que los entornos generados contienen toda la información necesaria para una reconstrucción de alta fidelidad, sin la necesidad de los servicios de modeladores, artistas de texturas, especialistas en iluminación y las hordas de otros contribuyentes a la “CGI tradicional”.

Segmentación semántica

Incluso si NeRF constituye efectivamente “Imágenes generadas por computadora” (CGI), ofrece una metodología completamente diferente y una tubería altamente automatizada. Además, NeRF puede aislar y “encapsular” partes móviles de una escena, para que puedan ser agregadas, eliminadas, aceleradas y operar en general como facetas discretas en un entorno virtual, una capacidad que está muy más allá del estado actual de la técnica en una interpretación “de Hollywood” de lo que es la CGI.

Una colaboración de la Universidad de Tecnología de Shanghai, lanzada en el verano de 2021, ofrece un método para individuar elementos NeRF móviles en facetas “pegables” para una escena. Fuente: https://www.youtube.com/watch?v=Wp4HfOwFGP4

Negativamente, la arquitectura de NeRF es un poco de una “caja negra”; actualmente no es posible extraer un objeto de un entorno NeRF y manipularlo directamente con herramientas tradicionales basadas en mallas y imágenes, aunque varios esfuerzos de investigación están comenzando a lograr avances en la descomposición de la matriz detrás de los entornos de renderizado en vivo de NeRF.

https://www.youtube.com/watch?v=5JjWpv9BaaE