Alianzas

Infineon Technologies y d-Matrix se asocian en infraestructura de inteligencia artificial de baja latencia

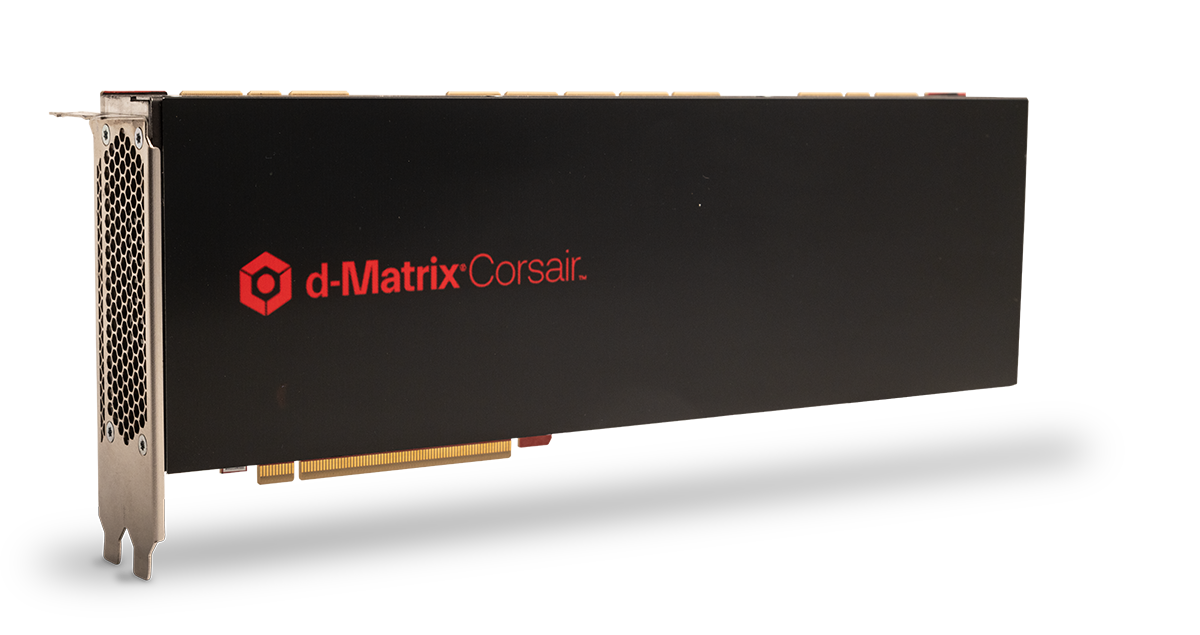

Infineon Technologies ha anunciado una colaboración con d-Matrix centrada en mejorar el rendimiento y la eficiencia energética de los sistemas de inferencia de inteligencia artificial utilizados en los centros de datos modernos. La asociación se centra en la plataforma de acelerador de inferencia de inteligencia artificial Corsair de d-Matrix y los módulos de alimentación de energía duales OptiMOS de Infineon, diseñados para admitir entornos de cómputo de alta densidad para cargas de trabajo de inteligencia artificial interactivas.

El anuncio destaca un cambio creciente dentro de la industria de hardware de inteligencia artificial. Mientras que gran parte del auge de la infraestructura en los últimos años se centró en entrenar modelos de inteligencia artificial cada vez más grandes, la industria ahora se está expandiendo rápidamente hacia la inferencia: el proceso de ejecutar modelos en aplicaciones del mundo real, como chatbots, sistemas de inteligencia artificial agente, copilotos, búsqueda, análisis financieros y apoyo a la toma de decisiones de atención médica. Estas cargas de trabajo colocan diferentes demandas en el hardware, particularmente en torno a la latencia, la respuesta y el consumo de energía.

Por qué la inferencia de inteligencia artificial se está convirtiendo en un campo de batalla importante del hardware

La inferencia de inteligencia artificial ha surgido como uno de los segmentos de más rápido crecimiento del mercado de infraestructura de inteligencia artificial, porque los sistemas de inteligencia artificial interactivos requieren respuestas en milisegundos en lugar de segundos. d-Matrix ha estado posicionando Corsair específicamente para estas cargas de trabajo, enfatizando la inferencia de ultra baja latencia y eficiente en energía para modelos de lenguaje grande y agentes de inteligencia artificial.

Según d-Matrix, Corsair se diseñó alrededor de una arquitectura de cómputo digital en memoria destinada a reducir los cuellos de botella de memoria que a menudo ralentizan la inferencia de inteligencia artificial generativa. La empresa afirma que la plataforma puede reducir significativamente la latencia y mejorar el rendimiento en comparación con los sistemas de inferencia centrados en GPU tradicionales, particularmente para aplicaciones interactivas.

La asociación con Infineon aborda otro desafío cada vez más crítico: la entrega de energía.

A medida que los servidores de inteligencia artificial continúan aumentando en densidad, la entrega eficiente de energía a los aceleradores se ha convertido en un factor limitante para la escalabilidad de la infraestructura. Los módulos OptiMOS TDM2254xx de Infineon están diseñados para arquitecturas de entrega de energía verticales que ayudan a reducir las pérdidas eléctricas mientras mejoran la densidad de energía dentro de sistemas de servidor compactos.

El cambio hacia sistemas de inteligencia artificial en tiempo real

Las empresas enmarcaron la colaboración en torno al surgimiento de la “inteligencia artificial interactiva”, donde los sistemas de inferencia deben generar continuamente salidas con un retraso extremadamente bajo. Esto incluye inteligencia artificial conversacional, agentes de inteligencia artificial, sistemas de razonamiento en tiempo real y aplicaciones que requieren una generación rápida de tokens de modelos de lenguaje grande.

El fundador y director ejecutivo de d-Matrix, Sid Sheth, dijo que la arquitectura detrás de Corsair se construyó específicamente para una latencia de token inferior a 2 milisegundos, una métrica que se ha vuelto cada vez más importante a medida que las empresas mueven los sistemas de inteligencia artificial desde la experimentación hasta entornos que enfrentan al cliente.

La industria de inteligencia artificial en general también está comenzando a reconocer que la infraestructura de inferencia puede evolucionar de manera diferente a la infraestructura de entrenamiento. Mientras que los clústeres de GPU dominaron la primera fase de la expansión de la inteligencia artificial generativa, la inferencia cada vez más recompensa a las arquitecturas optimizadas alrededor de la banda de memoria, la latencia, la red y la eficiencia energética en lugar de solo el cómputo bruto.

La eficiencia energética se está convirtiendo en central para la escalabilidad de la inteligencia artificial

Una de las principales limitaciones que enfrentan los proveedores de infraestructura de inteligencia artificial y los proveedores de nube es la demanda de electricidad. Las cargas de trabajo de inferencia de inteligencia artificial pueden ejecutarse continuamente a lo largo de millones de solicitudes por día, lo que hace que la eficiencia operativa sea fundamental para los costos de implementación.

Infineon ha estado expandiendo agresivamente su posición dentro de la infraestructura de inteligencia artificial a través de tecnologías de semiconductores basadas en silicio, carburo de silicio (SiC) y nitruro de galio (GaN). La empresa se ha centrado cada vez más en suministrar la capa de entrega de energía debajo de los aceleradores y la infraestructura de servidor de inteligencia artificial.

La colaboración con d-Matrix refleja cómo las empresas de semiconductores se están integrando más estrechamente con las startups de aceleradores de inteligencia artificial a medida que la industria busca alternativas a las arquitecturas convencionales basadas en GPU.

La infraestructura de inteligencia artificial se está expandiendo más allá de las GPU tradicionales

La asociación también llega durante una ola más amplia de experimentación en hardware de inteligencia artificial. Un número creciente de startups está desarrollando aceleradores especializados centrados específicamente en la inferencia, el cómputo centrado en la memoria o la red de inteligencia artificial.

d-Matrix se ha diferenciado a través de su énfasis en tecnologías de cómputo en memoria y sistemas de inferencia de baja latencia adaptados para inteligencia artificial generativa. La empresa también ha expandido su estrategia de infraestructura más allá de los chips de acelerador solos, enfatizando recientemente la red, la infraestructura componible y la optimización del sistema completo para clústeres de inferencia.

A medida que las aplicaciones de inteligencia artificial se vuelven cada vez más agentes y interactivas, se espera que los proveedores de infraestructura pongan un mayor énfasis en reducir la latencia, disminuir el consumo de energía y mejorar la eficiencia del sistema en toda la pila de centros de datos en lugar de centrarse únicamente en la potencia de procesamiento bruta.