Ángulo de Anderson

Incorporando el Sentido del Olfato al Desarrollo de la IA

Un nuevo conjunto de datos de IA enseña a las máquinas a oler asociando datos de olor con imágenes, permitiendo que los modelos emparejen olores con objetos, escenas y materiales.

Quizás porque las máquinas de salida de olor tienen un historial tan chequered, la olfacción es un sentido bastante descuidado en la literatura de investigación de IA. A menos que estuviera planeando producir otra entrada en la larga serie (más de un siglo, hasta la fecha) de saga de smell-o-vision, los casos de uso siempre parecieron bastante ‘niche’ en comparación con la explotación potencial de conjuntos de datos de imagen, audio y video, y los modelos de IA que se entrenan a partir de ellos.

De hecho, la posibilidad de automatizar, industrializar y popularizar el tipo de instalaciones de detección ofrecidas por perros bomba, perros cadáver, perros detectores de enfermedades y otros tipos de unidades de detección canina, sería un beneficio notable en los servicios municipales y de seguridad. A pesar de la alta demanda, muy por encima de la oferta, entrenar y mantener perros detectores es un negocio costoso que no siempre ofrece un buen valor por el dinero.

Hasta la fecha, la mayoría de la investigación que se acerca a este área de estudio se ha limitado a un laboratorio, con colecciones curadas que generalmente consisten en ejemplos con características hechas a mano – un perfil inclinado más hacia soluciones de cottage-industria que hacia aplicaciones industrializadas.

Adelantado por una Nariz

En este clima bastante desvaído llega una interesante colaboración académica/industrial de EE. UU., en la que un equipo de investigadores pasó varios meses catalogando olores diversos en entornos interiores y exteriores en la ciudad de Nueva York – y, por primera vez, recopilando imágenes asociadas con los olores capturados:

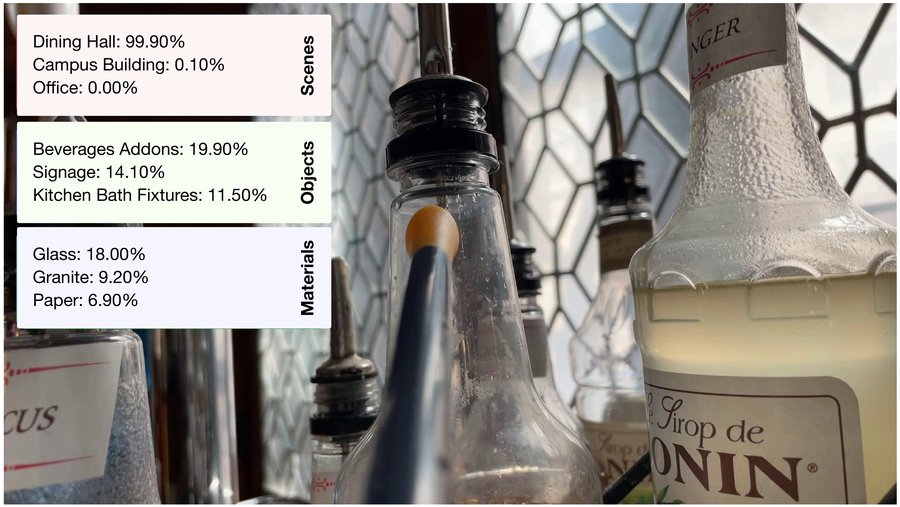

Nota el sensor central, la ‘nariz’ del dispositivo olfativo. Entrenado solo con olor, el modelo adivina si está oliendo granito, plástico o cuero – e incluso identifica la habitación en la que se encuentra, sin ver un solo píxel. Fuente

Esta investigación ha llevado a los autores del nuevo trabajo a idear un giro en el marco de preentrenamiento de lenguaje-imagen contrastivo (CLIP) muy popular, que conecta texto e imágenes, en la forma de Preentrenamiento Olfativo-Imagen Contrastivo (COIP) – que conecta olores e imágenes.

Arriba: se capturan datos de sensor olfativo y video sincronizados en entornos naturales utilizando un equipo de cámara-nariz. Abajo izquierda (b): se aprende una incrustación conjunta a través de auto-supervisión cross-modal. (c): el sistema recupera coincidencias visuales basadas únicamente en una consulta de olor. (d): se utilizan muestras de olor individuales para clasificar categorías de entorno, objeto y material. (e): se distinguen olores muy similares, como dos tipos de hierba, sin entrada visual. Fuente

El nuevo conjunto de datos, titulado Olores de Nueva York, contiene 7,000 pares de olor-imagen que presentan 3,500 objetos diferentes. Cuando se entrenó en pruebas, los nuevos datos se encontraron que superaron las características populares hechas a mano en el número relativamente pequeño de conjuntos de datos similares anteriores.

Los autores esperan que su salida inicial abra el camino para trabajos posteriores y de seguimiento hacia sistemas de detección olfativa diseñados para operar en la naturaleza, de la misma manera que lo hacen los perros detectores*:

‘Vemos este conjunto de datos como un paso hacia la percepción olfativa multimodal en la naturaleza, así como un paso hacia vincular la vista con el olor. Mientras que la olfacción se ha abordado tradicionalmente en entornos restringidos, como el control de calidad, hay muchas aplicaciones en entornos naturales.

‘Por ejemplo, como humanos, constantemente usamos nuestro sentido del olfato para evaluar la calidad de los alimentos, identificar peligros y detectar objetos no vistos.

‘Además, muchos animales, como perros, osos y ratones, muestran capacidades de olfacción superhumanas, lo que sugiere que la percepción del olfato humano está lejos del límite de las capacidades de la máquina.’

Aunque el nuevo artículo, titulado Olores de Nueva York: un gran conjunto de datos multimodal para la olfacción, promete que los datos y el código se publicarán, un archivo de datos de 27GB ya está disponible a través del sitio web del proyecto. El artículo fue producido por nueve investigadores en la Universidad de Columbia, la Universidad de Cornell y Osmo Labs.

Método

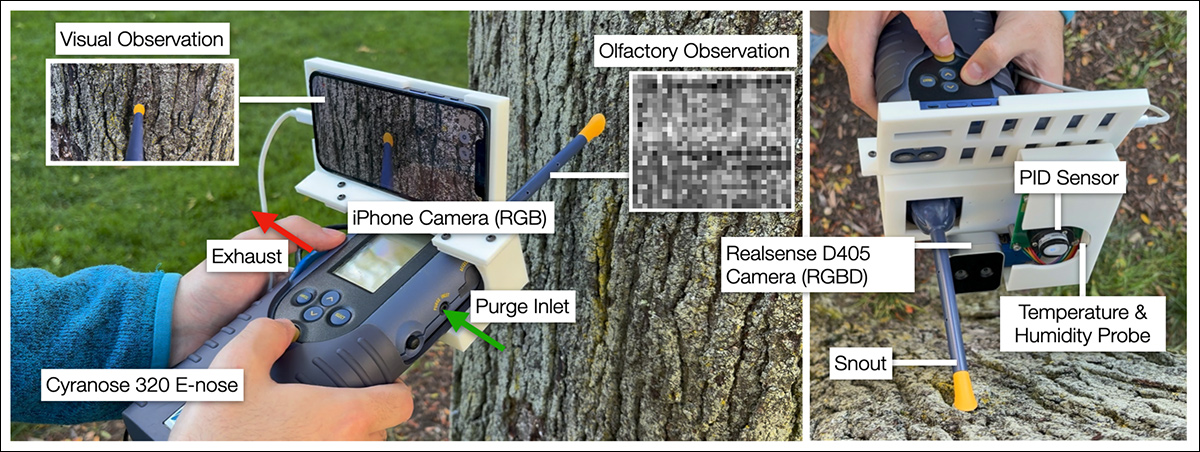

Para recopilar material para la nueva colección, los investigadores utilizaron la nariz electrónica Cyranose 320, con un iPhone montado sobre la entrada delantera para capturar visualmente qué olores se estaban registrando:

Un equipo de sensor portátil recopila datos de video y olor emparejados montando una cámara iPhone en una nariz electrónica Cyranose 320. La parte delantera se apunta a los objetos mientras que la salida y la entrada de purga gestionan el flujo de aire durante la muestra. Una cámara RGB-D captura la profundidad, mientras que la concentración de compuestos orgánicos volátiles (COV), la temperatura y la humedad se registran a través de sensores integrados, incluyendo un módulo de control proporcional-integral-derivativo (PID) y una sonda ambiental.

El dispositivo Cyranose funciona a 2Hz, grabando pasos de tiempo olfativos de 32 dimensiones. Las concentraciones de compuestos orgánicos volátiles (COV) se registraron con un sensor MiniPID2 PPM WR.

La unidad portátil funcionó como un sensor ágil, retransmitiendo datos a una estación móvil más capaz para su procesamiento.

Para colocar el olor objetivo en contexto, se registró un ‘olor de referencia’, antes de que el objeto más específico se dirigiera directamente con la ‘parte delantera’ de la Cyranose. La muestra ambiental se tomó entonces de un puerto lateral en la unidad, para asegurarse de que estuviera lo suficientemente lejos de la fuente de olor principal como para no estar contaminada.

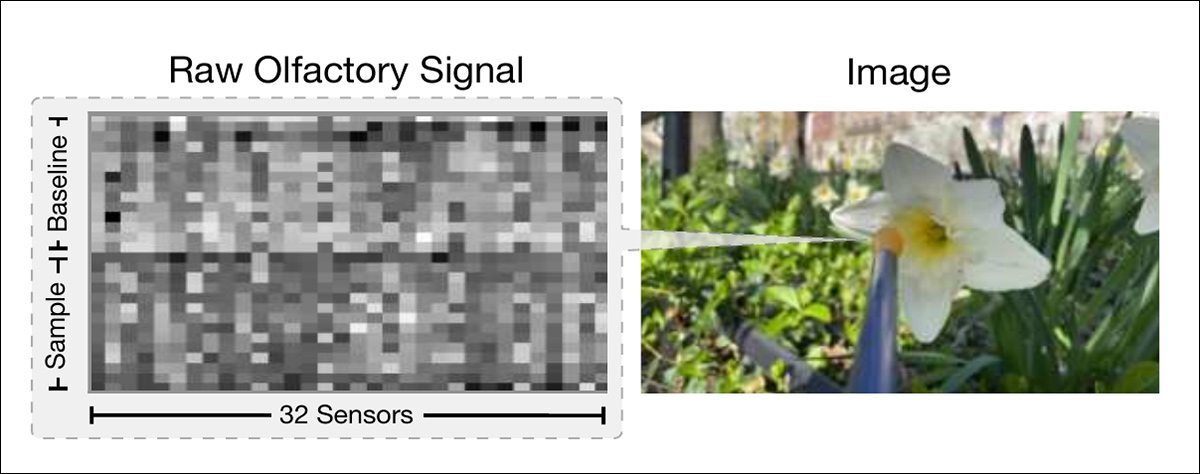

Se tomaron dos muestras a través de la entrada principal del sensor, con cada grabación de diez segundos capturada desde una posición diferente alrededor del objeto, para mejorar la eficiencia de los datos. Las muestras se combinaron entonces con la línea de base ambiental para formar una matriz de 28×32, que representa la medición olfativa completa:

Este ejemplo muestra la señal y la imagen correspondiente para una flor. La señal de olor completa consiste en una matriz de 28×32, que combina una línea de base ambiental de 14 cuadros con dos muestras de 10 segundos tomadas desde diferentes ángulos alrededor del objeto objetivo.

Datos y Pruebas

Se utilizaron modelos de lenguaje de visión (VLM) para etiquetar automáticamente los objetos y materiales capturados por el iPhone en el equipo de Cyranose, con GPT-4o utilizado para la tarea; sin embargo, las categorías de escena se etiquetaron manualmente:

Una pequeña muestra de una ilustración extensa en el artículo de origen que detalla las diversas fuentes de olor y entornos capturados en el proyecto.

El conjunto de datos se dividió en divisiones de entrenamiento y validación splits, con ambas muestras de cada objeto asignadas a la misma división para evitar la contaminación cruzada. La colección final comprende 7,000 pares de olor-visión extraídos de 3,500 objetos no etiquetados, junto con 70 horas de video y 196,000 pasos de tiempo de datos de olor crudos de ambas fases de línea de base y muestra.

Los datos se recopilaron en 60 sesiones durante un período de dos meses, abarcando parques, edificios universitarios, oficinas, calles, bibliotecas, apartamentos y comedores, con múltiples sesiones realizadas en cada ubicación. El conjunto de datos resultante contiene 41% de entornos al aire libre y 59% de entornos interiores.

Para desarrollar representaciones olfativas de propósito general, los autores entrenaron un modelo contrastivo para asociar pares de imagen-olor sincronizados del conjunto de datos. Este enfoque, el mencionado COIP, utiliza una función de pérdida adaptada de CLIP para alinear las incrustaciones de señales de visión y olor co-ocurrentes.

El entrenamiento utilizó tanto un codificador visual como un codificador de olor, con el objetivo de enseñar al modelo a acercar olores y imágenes coincidentes en un espacio de representación compartido. Las representaciones resultantes admiten una serie de tareas descendentes, incluyendo la recuperación de imagen-olor, el reconocimiento de escena y objeto, la clasificación de material y la discriminación de olor fino.

El modelo se entrenó utilizando dos tipos de entradas olfativas: la señal de sensor cruda y un resumen resumido hecho a mano conocido como huellas de olor – características ampliamente utilizadas en la investigación de la olfacción que comprimen la respuesta de cada sensor en un solo número comparando la resistencia pico durante la muestra con la resistencia promedio durante la línea de base ambiental.

Por el contrario, la entrada cruda registrada en toda la ciudad de Nueva York consiste en una serie de tiempo de 32 sensores químicos dentro del dispositivo Cyranose, capturando cómo cambia la resistencia eléctrica de cada sensor con el tiempo a medida que reacciona al olor.

Para la curación del conjunto de datos, esta señal de sensor no procesada se alimentó directamente a una red neuronal, lo que permitió el aprendizaje de extremo a extremo con un codificador convolucional o transformador como columna vertebral. Los modelos se entrenaron utilizando tanto huellas de olor como la entrada cruda recopilada de varios entornos en la ciudad de Nueva York, con ambos tipos de entrada evaluados mediante aprendizaje contrastivo.

Recuperación Cross-Modal

La recuperación cross-modal se evaluó incrustando cada muestra de olor y su imagen emparejada en un espacio de representación compartido, y probando si se podía recuperar la imagen correcta únicamente en función de la entrada olfativa.

El ranking se determinó por la proximidad de cada incrustación de imagen a la consulta de olor dentro de este espacio, y el rendimiento se midió utilizando media de rango, rango mediano y recuerdo en varios umbrales:

Precisión de recuperación cross-modal para diferentes codificadores de olor, que muestra cuán bien cada modelo identifica la imagen correcta a partir de una consulta de olor. Los resultados comparan arquitecturas entrenadas en señales de olor crudas con aquellas que utilizan huellas de olor.

Con respecto a estos resultados, los autores afirman:

‘El preentrenamiento contrastivo utilizando huellas de olor funciona mejor que la casualidad en todas las métricas. Sin embargo, entrenar el codificador de olor en la señal de olor cruda conduce a una mejora significativa en comparación con el codificador de huellas de olor, independientemente de la arquitectura.

‘Esto muestra la información más rica presente en los datos de olor crudos, desbloqueando asociaciones cross-modales más fuertes entre la vista y el olor.’

Un detalle de la séptima ilustración en el artículo de origen, que es demasiado condensado para reproducir de manera significativa aquí. Aquí, ejemplos de recuperación cross-modal que muestran cómo el modelo vincula olores con imágenes coincidentes. Cada fila comienza con una consulta de olor, seguida de las predicciones de imagen de mayor rango en el espacio de incrustación compartido. La imagen correcta para cada consulta está delineada en verde, ilustrando cómo los olores de libros, plantas, mampostería y otros materiales atraen al modelo hacia escenas visual y semánticamente relacionadas.

Los autores también observan que los resultados de recuperación muestran patrones semánticos claros:

‘Las recuperaciones de nuestro modelo a menudo muestran agrupaciones semánticas. El olor de un libro recupera imágenes de otros libros, el olor de las hojas recupera imágenes de follaje.

‘Estos resultados sugieren que la representación aprendida captura una estructura cross-modal significativa.’

Reconocimiento de Escena, Objeto y Material

La capacidad del modelo para reconocer olores sin entrada visual se evaluó entrenando al modelo para identificar escenas, objetos y materiales basándose únicamente en datos olfativos; para este fin, se utilizó una sonda lineal (un clasificador simple entrenado en representaciones congeladas) para evaluar cuánta información se codificaba en las incrustaciones de olor aprendidas.

Las etiquetas se derivaron de las imágenes emparejadas en el conjunto de entrenamiento utilizando GPT-4o – pero solo se utilizó la señal de olor durante la clasificación.

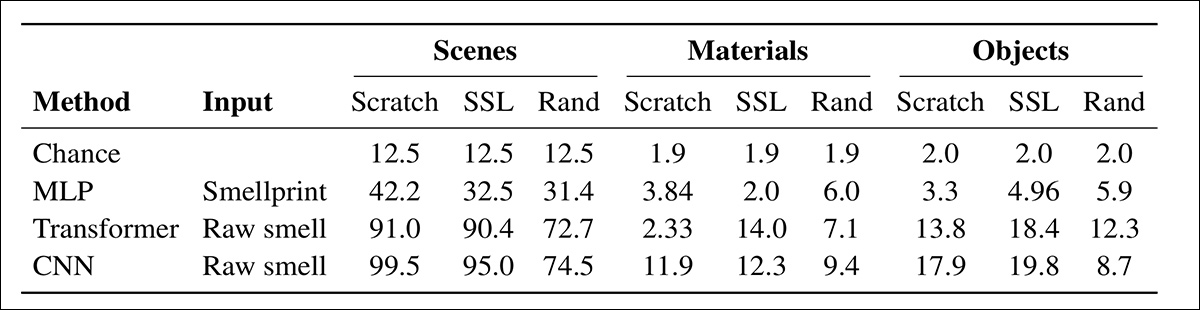

Se probaron varios tipos de codificadores: algunos inicializados aleatoriamente, algunos entrenados desde cero y otros entrenados utilizando aprendizaje contrastivo para alinear la vista y el olor en un espacio de representación compartido, con datos crudos y huellas de olor evaluados:

La precisión de clasificación para escenas, materiales y objetos se evaluó utilizando señales de olor solas. La entrada de sensor cruda superó a las huellas de olor, con CNN entrenadas desde cero que produjeron los resultados más altos, incluyendo un 99,5% para las escenas. El preentrenamiento de aprendizaje autosupervisado ayudó en algunos casos, pero en general fue superado por el entrenamiento supervisado. Las bases de peso aleatorio indican que la capacidad del modelo por sí sola resulta insuficiente.

Se obtuvo una precisión significativamente mayor cuando se utilizó la entrada de olor cruda, especialmente en modelos entrenados con supervisión cross-modal. Los autores comentan**:

‘Los modelos entrenados en entradas de sensor crudas también logran una mayor precisión que los modelos entrenados con características de huellas de olor hechas a mano. Estos resultados muestran que el aprendizaje profundo a partir de señales de olor crudas es significativamente mejor que las características hechas a mano.’

Discriminación Fino-Granulada

Para evaluar si se podían aprender distinciones de olor fino, se construyó un benchmark a partir de dos especies de hierba que coexisten en el mismo césped del campus. Se recopilaron muestras alternas durante seis sesiones de 30 minutos, lo que dio como resultado 256 ejemplos. Se entrenó un clasificador lineal en características de aprendizaje olfativo-visual contrastivo, y se evaluó en un conjunto de 42 muestras retenidas:

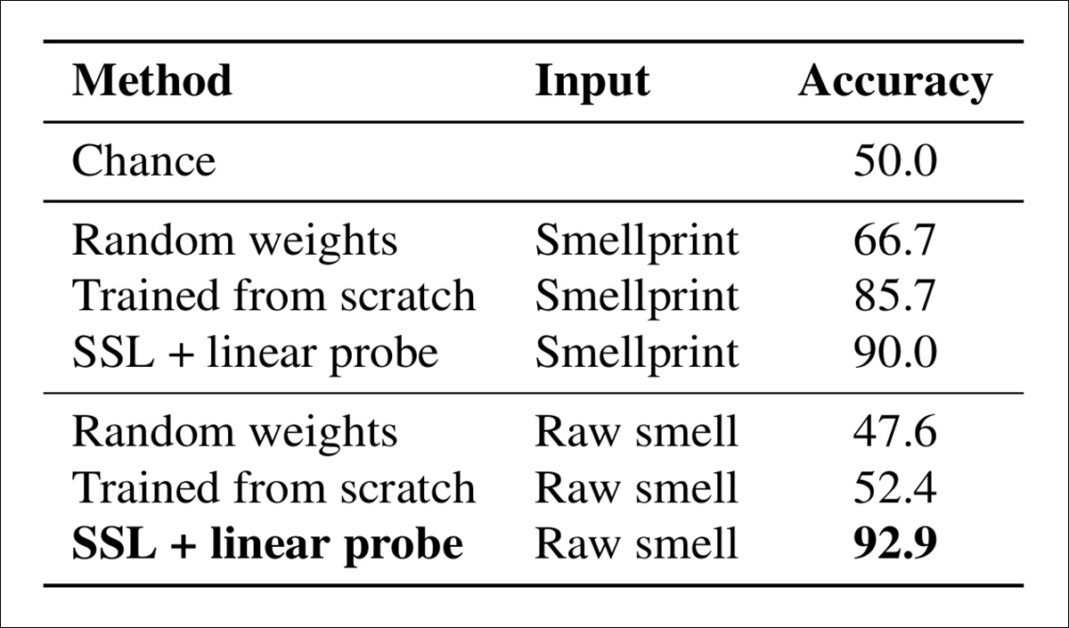

Precisión de clasificación de especies de hierba desde el olor solo. Los modelos se evaluaron en su capacidad para distinguir entre dos tipos de hierba visualmente similares utilizando solo la entrada de olor. El rendimiento se comparó a través de huellas de olor y datos de sensor crudos, con modelos que se inicializaron aleatoriamente, se entrenaron desde cero o se entrenaron utilizando aprendizaje autosupervisado (SSL) seguido de una sonda lineal. La mayor precisión, 92,9%, se logró utilizando señales de olor crudas con SSL, lo que indica que las diferencias de olor fino se capturan mejor a través de la entrada cruda y el entrenamiento guiado por la visión.

Aquí, los investigadores afirman:

‘El entrenamiento en la señal de sensor de olor cruda (en lugar de características hechas a mano) produce la mayor precisión – superando todas las variantes basadas en huellas de olor.

‘Estos resultados sugieren que el aprendizaje olfativo-visual preserva más información fino-granulada que el aprendizaje con huellas de olor, y que la supervisión visual proporciona una señal para explotar esta información.’

Conclusión

Aunque la síntesis de olores parece probable que siga siendo un problema sin resolver en el futuro, un sistema de análisis de olores en la naturaleza efectivo y asequible tiene un enorme potencial, no solo para fines policiales, de seguridad y médicos, sino también para el monitoreo de la calidad de vida y urbano.

En este momento, el equipo involucrado es de nicho y generalmente bastante caro; por lo tanto, el progreso real en ‘IA olfativa’ para la detección parece probable que requiera un sensor asequible y visionario en el espíritu de Raspberry PI.

* Mi conversión de las citas en línea de los autores a enlaces.

** Tenga en cuenta que se encuentran disponibles ilustraciones adicionales (figura 8) en el artículo de origen, pero se ven mejor en ese contexto.

Publicado por primera vez el viernes 28 de noviembre de 2025