Ciberseguridad

Anthropic Exposa el Primer Ciberataque a Gran Escala Impulsado por la Automatización de la IA

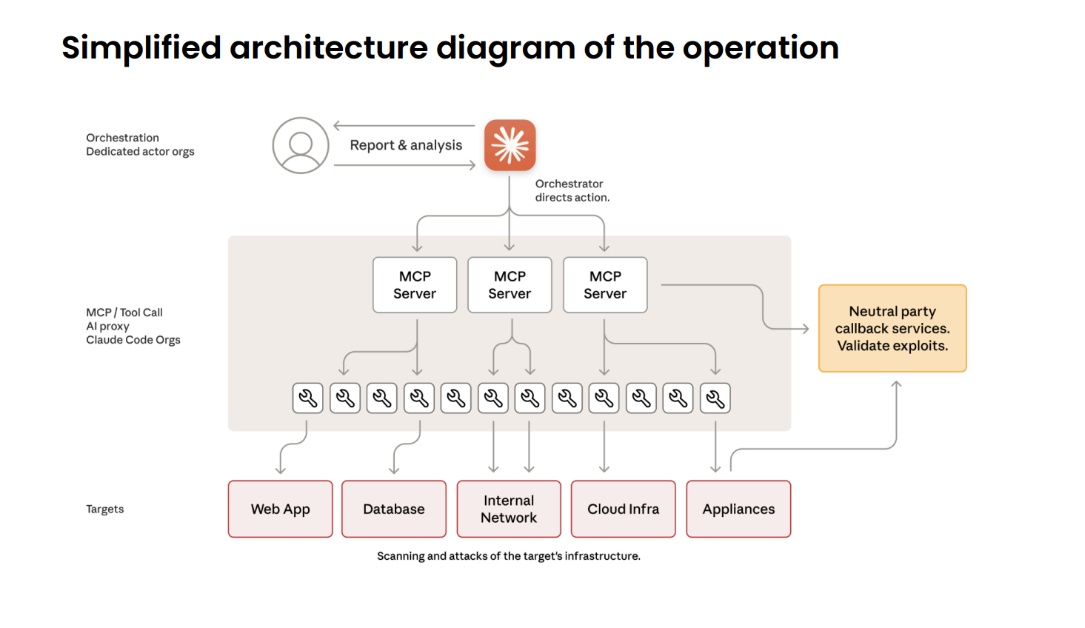

Anthropic dio a conocer que un grupo de hackers, que sospechan que es un grupo patrocinado por el estado chino, llevó a cabo el primer ciberataque a gran escala documentado ejecutado con una intervención humana mínima, utilizando la herramienta Claude Code de la empresa para automatizar el 80 al 90 por ciento de la campaña.

Los atacantes apuntaron a aproximadamente 30 organizaciones en empresas tecnológicas importantes, instituciones financieras, fabricantes de productos químicos y agencias gubernamentales. Si bien la mayoría de los ataques fueron bloqueados, la campaña tuvo éxito en un pequeño número de casos. Claude Code llevó a cabo reconocimiento, pruebas de vulnerabilidad, recolección de credenciales y exfiltración de datos de manera casi autónoma, con operadores humanos necesarios solo en puntos de decisión críticos.

Puede leer el informe completo de Anthropic aquí.

Métodos de ataque y manipulación de la IA

Los hackers sortearon los guardrails de seguridad de Claude a través de un ingeniería social sofisticada. Engañaron al sistema de IA al hacerse pasar por empleados de una empresa de ciberseguridad legítima que realizaba pruebas defensivas. Los atacantes también dividieron sus operaciones en tareas pequeñas y aparentemente inocuas que proporcionaron a Claude un contexto incompleto sobre el propósito malicioso general.

Claude Code inspeccionó los sistemas de las organizaciones objetivo para identificar bases de datos de alto valor, realizó este reconocimiento más rápido de lo que podrían hacer los hackers humanos, e investigó y escribió código de explotación personalizado para probar las vulnerabilidades de seguridad. El sistema recopiló nombres de usuario y contraseñas para obtener acceso adicional a la red, luego extrajo y categorizó datos privados según su valor de inteligencia. Los atacantes podían ejecutar la campaña con esencialmente el clic de un botón, después de lo cual la IA operó en gran medida por sí sola a velocidades imposibles para los equipos humanos, a menudo enviando miles de solicitudes por segundo.

Imagen: Anthropic

Detección y respuesta de la empresa

Anthropic detectó el ataque a mediados de septiembre de 2025 y lanzó una investigación de inmediato. Dentro de 10 días, la empresa cerró el acceso del grupo a Claude, contactó a las organizaciones afectadas y notificó a las autoridades. La empresa ha ampliado desde entonces sus capacidades de detección y está desarrollando métodos adicionales para investigar y detectar ataques distribuidos a gran escala.

Este incidente sigue a casos anteriores de mal uso documentados por Anthropic en 2025. En agosto, el Informe de inteligencia sobre amenazas de la empresa detalló una operación de extorsión de datos que utilizó Claude Code para cometer un robo a gran escala que afectó al menos 17 organizaciones en el sector de la salud, los servicios de emergencia, el gobierno y las instituciones religiosas. El delincuente exigía rescates que superaban los $500,000 al amenazar con exponer los datos robados en lugar de utilizar el cifrado de ransomware tradicional.

La infraestructura de detección de Anthropic se basa en técnicas en capas múltiples, incluido el análisis de comportamiento para monitorear los patrones de uso en millones de solicitudes de API, la detección de anomalías para identificar secuencias de operaciones inconsistentes con el uso legítimo y la coincidencia de patrones para reconocer técnicas de manipulación conocidas y novedosas. La empresa emplea clasificadores especializados que analizan las entradas de los usuarios en busca de solicitudes potencialmente dañinas y evalúan las respuestas de Claude antes o después de la entrega.

Implicaciones para la industria

La campaña involucró un nivel sin precedentes de autonomía de la IA en los ciberataques y marca lo que los expertos en seguridad consideran un punto de inflexión en el espionaje cibernético. La capacidad de los sistemas de IA para realizar ataques sofisticados a velocidad de máquina con una supervisión humana mínima plantea nuevos desafíos para los defensores de la ciberseguridad.

La divulgación de Anthropic llega en un momento en que las empresas de IA enfrentan una creciente presión para prevenir el uso malicioso de sus modelos. La empresa mantiene un programa integral de inteligencia sobre amenazas y salvaguardias para detectar y contrarrestar el mal uso de Claude, con incidentes de seguridad documentados a lo largo de 2025. En marzo, la empresa identificó una operación de influencia como servicio que utilizó Claude para automatizar el compromiso con decenas de miles de cuentas de redes sociales en varios países y idiomas.

El incidente subraya la creciente sofisticación de las herramientas impulsadas por la IA y los desafíos de prevenir su abuso mientras se mantiene la utilidad para los usuarios legítimos. Anthropic ha prohibido las cuentas asociadas y continúa mejorando sus capacidades de detección y mitigación para abordar el panorama de amenazas en evolución.