Ángulo de Anderson

La IA puede adivinar el año de una foto según la edad de las personas

Una nueva investigación muestra que la IA puede utilizar las caras de las personas para estimar el año en que se tomó una foto, combinando suposiciones de edad con años de nacimiento conocidos para superar los métodos basados en escenas actuales.

Adivinar la fecha de una foto solía ser mucho más fácil que ahora, porque las modas de peinados y ropa evolucionaban a un ritmo trepidante. Por razones muy debatidas, este cambio de estilo visual terminó hace unos treinta años, lo que significa que ya no es tan fácil mirar un peinado o artículos de ropa y adivinar el año a partir de este tipo de pista visual.

Durante mucho tiempo, también fue posible fechar imágenes y películas en función de la resolución de color y características de grano de la película. No había que ser un especialista forense; si se veían suficientes películas antiguas, las pistas culturales (como la música, los coches, la moda, los temas, etc.) eventualmente se asociarían, por parte del espectador, con estilos de película:

![Una ilustración de la forma en que las mejoras en la película gradualmente expandieron el rango de tonos de piel y estilos de iluminación con el tiempo, pasando de configuraciones frontales planas a looks más naturalistas y variados. [ Fuente ] https://archive.is/3ZSjN (mi propio artículo)](https://www.unite.ai/wp-content/uploads/2025/11/grain-styles.jpg)

Una ilustración de la forma en que las mejoras en la película gradualmente expandieron el rango de tonos de piel y estilos de iluminación con el tiempo, pasando de configuraciones frontales planas a looks más naturalistas y variados. Fuente (mi propio artículo)

Un ancla adicional para fechar una fotografía era si estaba en blanco y negro: una economía que se volvió redundante después de la popularización de la fotografía digital a principios de este siglo

Un número de sistemas comerciales y experimentales, como el PhotoDater de MyHeritage, que viene con una suscripción, intenta fechar fotos utilizando estos y otros criterios diversos.

![Un ejemplo de estimación de la edad de una foto del servicio de suscripción PhotoDater de MyHeritage. Fuente [ https://www.youtube.com/watch?v=2oVyLI6tBcY ]](https://www.unite.ai/wp-content/uploads/2025/11/photodater.jpg)

Un ejemplo de estimación de la edad de una foto, del servicio de suscripción PhotoDater de MyHeritage. Fuente

Ausentes otras señales de advertencia, como teléfonos inteligentes u otras tecnologías específicas de una era, la mejor manera de saber la edad de una foto tomada en los últimos 15-25 años es si se conoce a la persona (es decir, un celebridad, o quizás un conocido), y se puede estimar su edad, lo que produce un año equivalente aproximado.

La edad facial como referencia

En el campo de la visión por computadora, y en diversos otros campos (es decir, forenses, procesamiento de archivos, periodismo, arquitectura de conjunto de datos, etc.) la capacidad de determinar la edad de una foto es un objetivo muy valorado, ya que muchas de las colecciones digitales y analógicas más interesantes carecen de anotaciones y metadatos adecuados, o incluso tienen metadatos incorrectos de suposiciones anteriores (incorrectas).

Por lo tanto, sería útil que un sistema de IA pudiera revisar fotos de la misma manera que lo hacemos cuando miramos nuestras colecciones históricas, y comentamos ‘Oh sí, eso fue cuando…’. La pregunta es, ¿qué podría ser el gancho, ausentes las pistas habituales?

Un nuevo artículo de investigación de la República Checa está ofreciendo un punto de partida inicial en este enfoque, explotando sistemas de reconocimiento de edad basados en IA, en concierto con sistemas de reconocimiento facial vinculados a una base de datos común de identidades (en este caso, una colección de estilo IMDB que presenta intérpretes y cineastas checos):

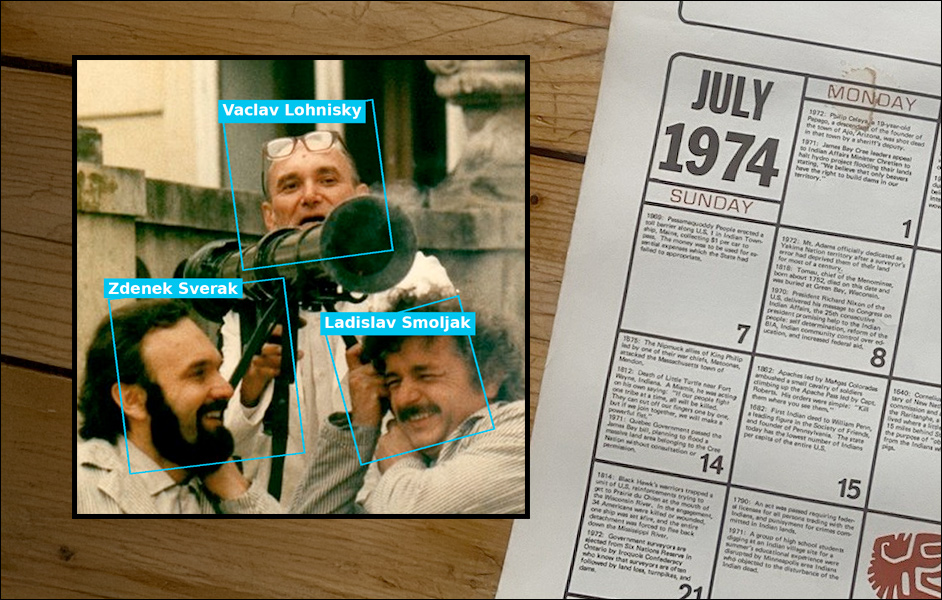

![Un fotograma de Joachim, Ponlo en la máquina (1974), utilizado para ilustrar el proceso de fecha. El modelo detecta individuos conocidos en la foto, estima su edad utilizando un estimador de edad facial (columna derecha), y resta ese valor del año de nacimiento de cada persona para generar una distribución de probabilidad sobre posibles fechas de foto. Los gráficos muestran la probabilidad de cada estimación de edad, con líneas discontinuas que marcan la edad real de la persona en el momento de la foto. [ Fuente ] https://arxiv.org/pdf/2511.05464](https://www.unite.ai/wp-content/uploads/2025/11/fig-1a-and-1b.jpg)

Un fotograma de ‘Joachim, Ponlo en la máquina’ (1974), utilizado para ilustrar el proceso de fecha. El modelo detecta individuos conocidos en la foto, estima su edad utilizando un estimador de edad facial (columna derecha), y resta ese valor del año de nacimiento de cada persona para generar una distribución de probabilidad sobre posibles fechas de foto. Los gráficos muestran la probabilidad de cada estimación de edad, con líneas discontinuas que marcan la edad real de la persona en el momento de la foto. Fuente

El sistema funciona detectando individuos conocidos en una foto, estimando su edad facial utilizando un modelo preentrenado, y restando esta estimación de su año de nacimiento documentado para generar fechas probables para la foto. Cuando hay varias caras presentes, las estimaciones de fecha se agregan para producir una predicción final.

El método se probó en imágenes curadas a partir de la Base de datos de películas checo-eslovacas (CSFD), con el enfoque resultante, que los autores afirman, ofrece una precisión consistentemente mejor que los modelos basados en escenas (modelos estáticos que confían en elementos de fondo o contexto visual en lugar de caras) entrenados en los mismos datos.

El esquema para este método requiere una base de datos central que contenga conocimiento de un grupo amplio de individuos; en este caso, la base de datos de películas checa de estilo IMDB; pero cualquier colección similar que presente fechas de nacimiento confirmadas y eventos con fechas confirmadas podría producir un resultado similar.

El artículo establece:

‘Únicamente, nuestro conjunto de datos proporciona anotaciones para múltiples individuos dentro de una sola imagen, lo que permite el estudio de la agregación de información de múltiples caras. Proponemos un marco probabilístico que combina formalmente la evidencia visual de modelos modernos de reconocimiento facial y estimación de edad, y priores temporales basados en la carrera para inferir el año de captura de la foto.

‘Nuestros experimentos demuestran que la agregación de evidencia de múltiples caras mejora consistentemente el rendimiento y el enfoque supera significativamente a los puntos de referencia basados en escenas, particularmente para imágenes que contienen varios individuos identificables.’

El nuevo artículo se titula Fecha de la foto por agregación de edad facial, y proviene de dos investigadores de la Universidad Técnica Checa en Praga, con la promesa de una posterior liberación de código y datos.

Método

Para estimar cuándo se tomó una foto, el nuevo sistema del autor busca cada cara detectada e intenta adivinar quién podría ser, utilizando la base de datos mencionada de personas conocidas. Dado que una persona solo puede aparecer una vez en una foto, el sistema verifica todas las combinaciones posibles de identidades y utiliza sus años de nacimiento conocidos para adivinar cuántos años parece tener cada persona.

Después de esto, trabaja hacia atrás para estimar el año más probable que haría que esas edades se alineen:

Izquierda: el sistema construye una línea de tiempo que muestra cuándo los individuos reconocidos fueron más activos, según sus carreras conocidas. Derecha: esto se combina con estimaciones de edad facial para producir una suposición final de cuándo se tomó la imagen.

Para manejar las muchas combinaciones posibles de identidad, el sistema asume que las caras son independientes, y que la apariencia de cada una depende únicamente de su identidad y la fecha de la foto.

Para estimar cuándo se tomó una foto, el sistema primero adivina la edad de cada cara detectada utilizando el modelo cvut-002 de NIST, que se basa en una arquitectura ViT-B/16, y se entrenó en un conjunto de datos privado (que, según los autores, ocupa un lugar alto en la base de datos de Evaluación de Tecnología de Análisis Facial (FATE) de NIST).

Una vez que se conoce el año de nacimiento de la persona, el modelo convierte la estimación de edad en un año de foto probable simplemente sumando la edad al año de nacimiento, lo que produce una distribución de probabilidad sobre años de captura posibles. Para evaluar qué tan bien una cara detectada coincide con una identidad conocida, el sistema compara sus incrustaciones en espacio ArcFace:

![ArcFace, la arquitectura contribuyente central para el modelo InsightFace ahora popular, se lanzó en 2015, destinado a convertirse en un proyecto influyente en la evaluación y evaluación facial. [ Fuente ] https://arxiv.org/pdf/1801.07698](https://www.unite.ai/wp-content/uploads/2025/11/arcface.jpg)

ArcFace, la arquitectura contribuyente central para el modelo InsightFace ahora popular, se lanzó en 2015, destinado a convertirse en un proyecto influyente en la evaluación y evaluación facial. Fuente

Cada identidad está representada por una incrustación promedio construida a partir de sus retratos de referencia. La similitud entre una cara de prueba y una identidad se mide entonces utilizando una distribución de Von Mises Fisher, que modela cuán estrechamente los retratos de la identidad se agrupan alrededor de esa incrustación promedio. Un parámetro de nitidez compartido controla cuán seguro está el sistema en esos grupos, y se estima utilizando una estrategia de dejar uno fuera en los retratos de la identidad.

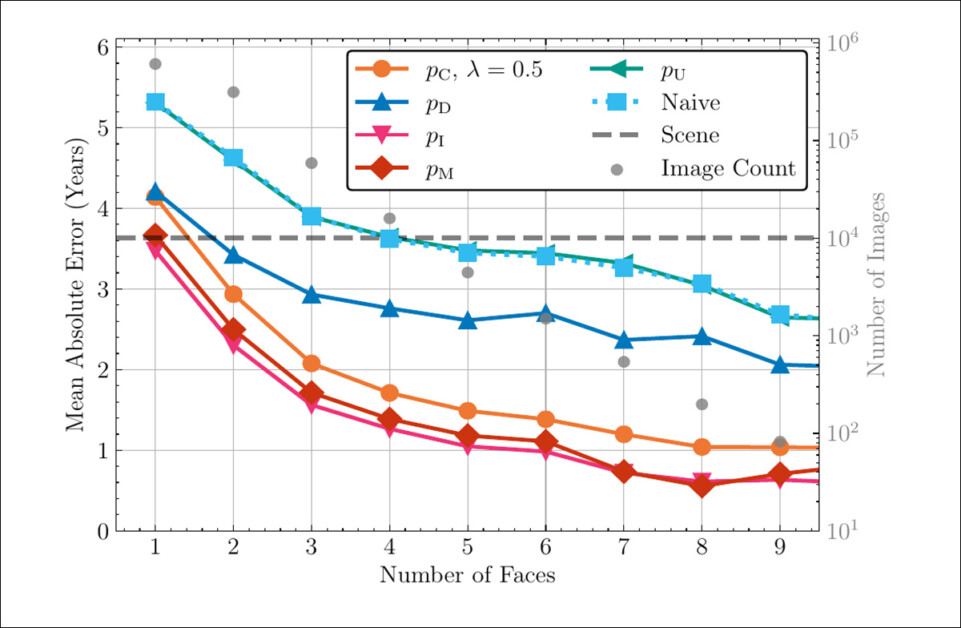

El modelo define cinco tipos de priores para estimar cuándo podría aparecer una persona reconocida en una foto: uniforme; década; película; imagen; y un prior de combinación convexa que combina las opciones más fuertes y más débiles, para probar la sensibilidad a la fuerza del prior (es decir, la resistencia de los priores bajo estrés).

Para manejar caras que no se pueden identificar con confianza, el modelo incluye un identificador de ‘desconocido’ con distribuciones no informativas, que presentan una probabilidad de cara que es plana en el espacio de incrustación, y un prior temporal plano en todos los años. Esto permite que las caras inciertas se ignoren sin sesgar la estimación final de la fecha:

Cómo se ve afectado el rendimiento cuando algunas caras en una imagen no se pueden identificar. Cada cuadrado muestra el error de fecha promedio para diferentes números de identidades conocidas y desconocidas, con el tamaño del cuadrado que refleja cuán común es esa combinación en el conjunto de datos. El error aumenta con más desconocidos, pero disminuye constantemente a medida que se agregan más identidades conocidas.

Datos y pruebas

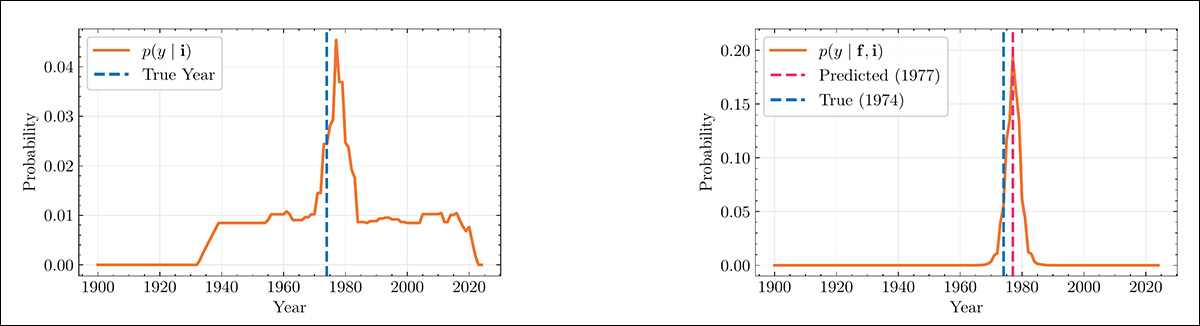

Los autores utilizaron el conjunto de datos CSFD mencionado para proporcionar datos para una nueva colección que titularon CSFD-1.6M. El conjunto de datos se construyó a partir de escenas que presentaban varias personas, con cada cara etiquetada por identidad y año. Esta estructura fue necesaria para enseñar al modelo cómo se relacionan las caras entre sí en contexto; los conjuntos de datos de una sola cara como IMDB-WIKI no admiten esto, ya que etiquetan solo una persona por imagen.

Los años de estreno de las películas de la Base de datos de películas checo-eslovacas se utilizaron para estimar cuándo se tomó cada foto, con cada persona en la imagen coincidiendo con un perfil público que presentaba su año de nacimiento y un retrato.

Posteriormente, cada cara en la imagen se emparejó con una de las identidades conocidas, inicialmente utilizando ArcFace para crear incrustaciones faciales, y calculando una incrustación promedio para cada identidad.

Después de esto, se utilizó el algoritmo húngaro para asignar caras a identidades comparando la similitud de la incrustación, con ajustes realizados cuando el número de caras detectadas a través del marco SCRFD-10GE no coincidía con el número de individuos conocidos.

Estadísticas del conjunto de datos CSFD-1.6M, que detallan imágenes raspadas, caras detectadas, coincidencias de identidad, muestras anotadas finales y la piscina de identidad disponible.

Las coincidencias se rechazaron si la similitud era demasiado baja o si la edad estimada difería en gran medida de la edad conocida, y se permitió una mayor tolerancia para los sujetos mayores, y las caras no se filtraron por calidad o tamaño.

Los autores señalan la superioridad de su conjunto de datos curado sobre el del conjunto de datos más comparable, IMDB-WIKI:

‘Nuestro conjunto de datos no solo es sustancialmente más grande, sino que, críticamente, consiste en escenas de múltiples personas requeridas por nuestro modelo. Si bien ningún conjunto de datos raspado en la web está libre de ruido de etiqueta, nuestra tubería de anotación aprovecha los enlaces explícitos entre imágenes y perfiles de identidad proporcionados por la base de datos, con el objetivo de asignaciones de identidad de mayor calidad.’

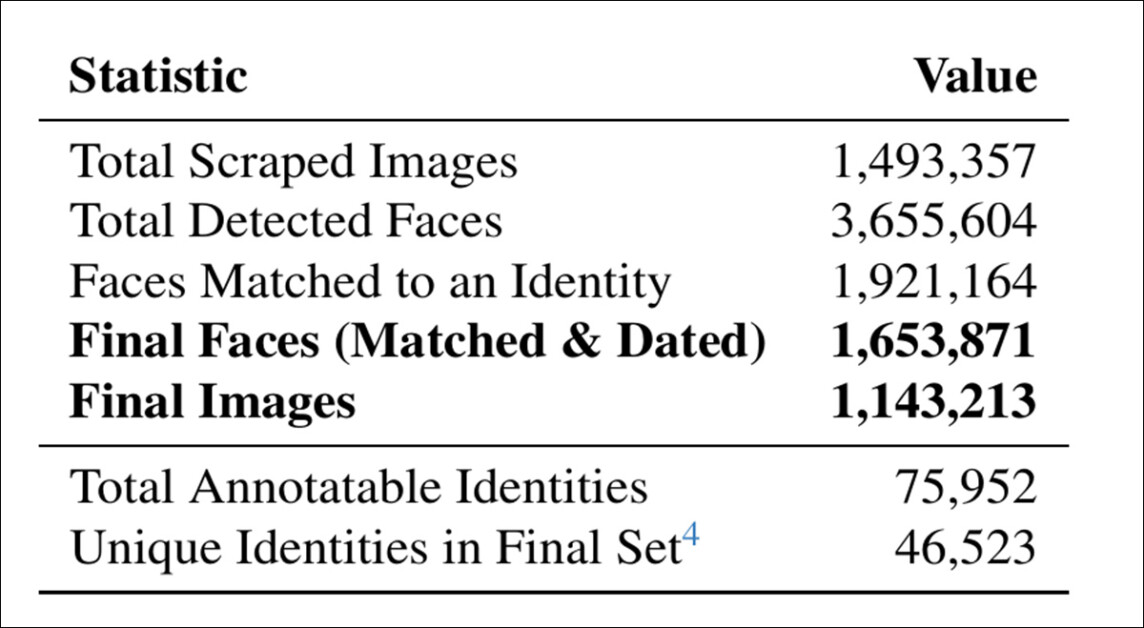

Su evaluación comparó varias versiones del sistema de fecha, para comprender de dónde provenían sus ganancias. Un modelo asumió un conocimiento perfecto de quién estaba en la imagen, proporcionando un límite superior para el rendimiento al eliminar cualquier incertidumbre en el reconocimiento de identidad, con la versión completa del modelo que luego estimaba identidades y fechas conjuntamente, sopesando diferentes configuraciones de identidad posibles antes de llegar a una estimación final de año.

Una variante más simple seleccionó la configuración de identidad más probable sin marginalizar las alternativas, lo que resultó casi tan efectivo en la práctica.

Por el contrario, la línea de base más básica asignó cada cara de forma independiente y combinó las estimaciones de año resultantes basadas en la edad, sin considerar si las identidades colectivamente tenían sentido.

Para probar cuánto se beneficiaba el método del uso de caras en absoluto, se entrenó un modelo separado para estimar la fecha directamente de toda la escena. Este modelo basado en escenas constituye el enfoque alternativo más fuerte actualmente utilizado en la estimación de la fecha de la imagen, ya que puede aprender patrones visuales específicos de la era en toda la imagen, en lugar de confiar en la identidad o la edad.

Métricas y datos

El error absoluto medio (MAE) entre el año predicho y el valor real de referencia fue la métrica central para los experimentos.

Los datos se dividen en cinco partes, con cuidado para asegurarse de que todas las imágenes de la misma película se mantengan dentro de una sola partición. Tres de estas partes se utilizaron para el entrenamiento, una para la validación y una para la prueba. Esta rotación de cinco se aplicó para evitar sobreajuste.

Dado que los modelos basados en caras no se entrenaron en este conjunto de datos, no se requirió división, y en cambio, se evaluaron directamente en el conjunto de datos CSFD-1.6M completo.

El modelo Escena se entrenó durante 200 épocas bajo el optimizador Adam, con imágenes redimensionadas a un recorte de 384×384.

Resultados

La sección de resultados del artículo se divide de manera inusual en una serie de indicadores de rendimiento, sin un solo resultado destacado o central. Sin embargo, presentaremos una selección de los resultados más pertinentes aquí.

El resultado más importante no es un solo número, sino un patrón: los modelos de agregación facial (especialmente las variantes Completo y Top-1) consistentemente superan la línea de base Escena fuerte siempre que haya dos o más identidades conocidas presentes, aunque el modelo Escena se entrenó directamente en el conjunto de datos, lo que respalda la afirmación central de que la fecha de identidad vinculada a la cara proporciona una señal de fecha más robusta que la interpretación holística de la escena.

Para evaluar el efecto de los priores temporales, los autores compararon varias configuraciones de su modelo Completo. El rendimiento más fuerte se obtuvo utilizando el Prior de la década, que superó significativamente tanto al modelo Naive (que no utiliza prior temporal) como al Prior uniforme (que asume ninguna preferencia sobre los años):

El rendimiento disminuye bruscamente para todos los métodos a medida que aumenta el número de caras, pero los modelos que utilizan priores temporales realistas, como el Prior de la década, se ven afectados mucho menos. Las líneas de base Naive y Escena permanecen planas o se deterioran con grupos más grandes, mientras que el modelo Completo guiado por priores informativos mantiene un error bajo. Los priores basados en oráculo, que dependen de las estadísticas del conjunto de prueba, definen el límite inferior en el rendimiento alcanzable.

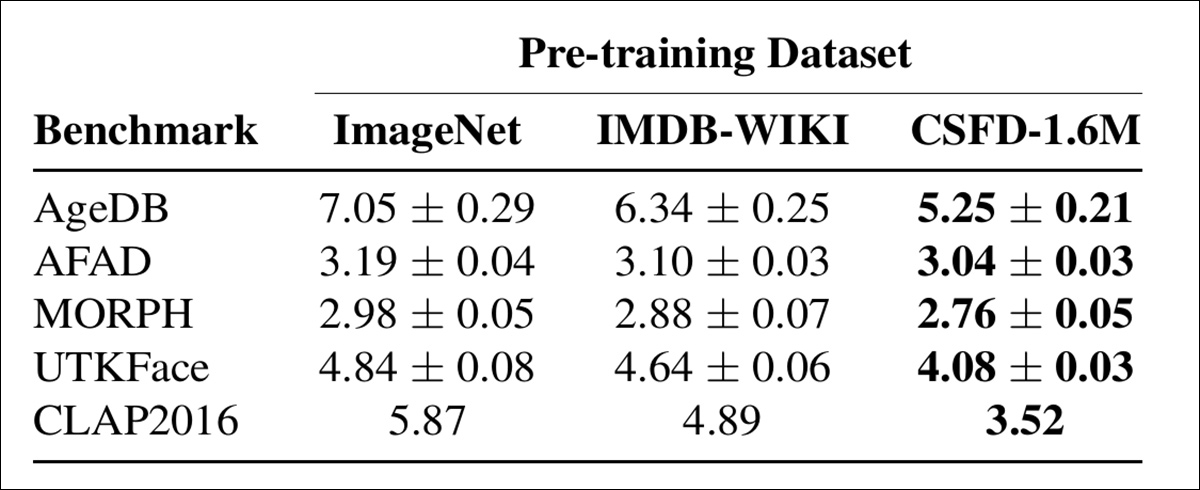

Para demostrar el valor de CSFD-1.6M más allá de la fecha de la foto, el conjunto de datos también se probó como un recurso de preentrenamiento para la tarea más amplia de estimación de la edad facial. Siguiendo un protocolo de evaluación estándar, modelos ResNet101 se preentrenaron en CSFD-1.6M y se compararon con contrapartes preentrenadas en IMDB-WIKI y ImageNet. Estos modelos se ajustaron y evaluaron en cinco conjuntos de datos populares: AgeDB; AFAD, MORPH; UTKFace; y CLAP2016:

Error absoluto medio (más/menos desviación estándar) en cinco conjuntos de datos de estimación de edad, comparando modelos preentrenados en ImageNet, IMDB-WIKI y CSFD-1.6M. Los valores más bajos indican un mejor rendimiento. CSFD-1.6M produce los resultados más fuertes en todos los conjuntos de datos.

En todos los cinco conjuntos de datos, el preentrenamiento en CSFD-1.6M condujo a las tasas de error más bajas, superando claramente a las otras dos fuentes de preentrenamiento – una brecha de rendimiento que resultó más fuerte en AFAD y CLAP2016, pero permaneció consistente en todo.

Nos referimos al lector al resto de la sección de resultados algo fragmentada en el artículo de origen, que también trata extensamente con estudios de ablación.

Conclusión

Aunque el nuevo artículo se vuelve rápidamente denso y poco accesible para el lector casual, el tema abordado es uno de los más interesantes y relevantes en la literatura de visión por computadora – no menos porque cruza bastante hábilmente en antropología y estudios culturales, donde las constantes son difíciles de determinar.

* Al igual que la evolución musical también ralentizó su tasa de cambio.

Publicado por primera vez el lunes 10 de noviembre de 2025