Τεχνητή νοημοσύνη

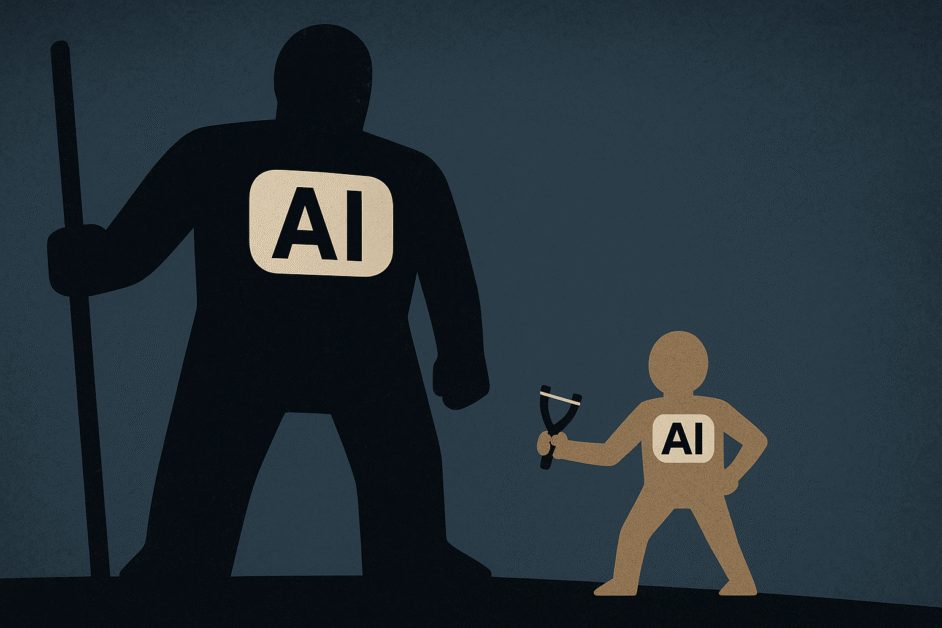

Η Εξέγερση του Μικρού Μοντέλου: Γιατί το Μικρό AI Υπερβαίνει τα Γιγάντια Μοντέλα Γλώσσας

Τα τελευταία χρόνια, η τεχνητή νοημοσύνη έχει διαμορφωθεί από τον αγώνα για την κατασκευή ολοένα και μεγαλύτερων μοντέλων. Κάθε νέα έκδοση έχει μετρηθεί από τον αριθμό των παραμέτρων, το μέγεθος των δεδομένων εκπαίδευσης και το μέγεθος της υποδομής πίσω από αυτό. Υπό την υπόθεση ότι το μεγαλύτερο σημαίνει καλύτερο. Ενώ οι τεχνολογικοί γίγαντες συνεχίζουν να κατασκευάζουν ολοένα και πιο μαζικά μοντέλα γλώσσας με εκατοντάδες δισεκατομμύρια παραμέτρων, μια ήσυχη επανάσταση λαμβάνει χώρα. Τα μικρά μοντέλα AI, συχνά χιλιάδες φορές μικρότερα από τα γιγάντια αντίστοιχά τους, επιτύγχαναν συγκρίσιμη και μερικές φορές υπεροχή απόδοση σε συγκεκριμένες εργασίες. Αυτή η μετατόπιση προκλήθηκε mọiTHING που σκεφτόμασταν για την κλιμάκωση του AI και ανοίγει νέες δυνατότητες για δημοκρατικοποιημένη, αποτελεσματική τεχνητή νοημοσύνη.

Η Ιστορία του Δαβίδ και του Γολιάθ της Μοντέρνας AI

Για χρόνια, η βιομηχανία AI λειτουργούσε υπό την υπόθεση ότι τα μεγαλύτερα μοντέλα παρέχουν καλύτερη απόδοση. Η σειρά GPT της OpenAI μεγάλωσε από 117 εκατομμύρια παραμέτρους σε πάνω από 175 δισεκατομμύρια. Το PaLM της Google έφτασε στα 540 δισεκατομμύρια παραμέτρους. Οι μεγάλες εταιρείες τεχνολογίας έχουν επενδύσει δισεκατομμύρια δολάρια στην εκπαίδευση αυτών των μοντέλων και επενδύουν περαιτέρω για την κατασκευή ακόμη μεγαλύτερων μοντέλων. Σε αυτή τη κατάσταση, όταν οι μετρήσεις παραμέτρων έγιναν βασικός παράγοντας για τον καθορισμό της ικανότητας του μοντέλου και η κατασκευή της ικανότητας AI έγινε ένας αγώνας υπολογιστικών πόρων και δαπανών υποδομής, ένα ενδιαφέρον φαινόμενο άρχισε να συμβαίνει στα ερευνητικά εργαστήρια του κόσμου.

Οι μηχανικοί άρχισαν να ανακαλύπτουν ότι μικρότερα, προσεκτικά σχεδιασμένα μοντέλα θα μπορούσαν να ταιριάζουν ή να υπερβαίνουν την απόδοση των γιγάντων σε συγκεκριμένες εργασίες. Η σειρά Phi της Microsoft απέδειξε ότι ένα μοντέλο 2,7 δισεκατομμυρίων παραμέτρων θα μπορούσε να ανταγωνιστεί μοντέλα δέκα φορές το μέγεθός του. Το LLaMA της Meta απέδειξε ότι μοντέλα 7 δισεκατομμυρίων παραμέτρων θα μπορούσαν να παραχθούν εξαιρετικά αποτελέσματα όταν εκπαιδευτούν σωστά. Αυτές οι εξελίξεις αντιπροσωπεύουν μια θεμελιώδη μετατόπιση στην κατανόησή μας για την αποτελεσματικότητα του AI.

Αυτή η παραλλαγή έχει σημαντικές επιπτώσεις στο πώς χρησιμοποιείται και λειτουργεί το AI. Τα μικρά μοντέλα μπορούν να τρέξουν σε καταναλωτική υλική υποδομή, να επεξεργαστούν αιτήσεις γρηγορότερα και να καταναλώσουν ένα τμήμα της ενέργειας που απαιτείται από τα μεγάλα μοντέλα. Κάνουν το AI προσβάσιμο σε οργανισμούς που δεν μπορούν να αντέξουν τη μαζική υπολογιστική υποδομή. Το πιο σημαντικό, προκλήθηκε τις μονοπωλιακές τάσεις της ανάπτυξης AI, όπου μόνο οι εταιρείες με τεράστιους πόρους θα μπορούσαν να ανταγωνισθούν.

Η Άνοδος της Αποτελεσματικής Αρχιτεκτονικής AI

Η επανάσταση του μικρού μοντέλου βασίζεται σε εξελιγμένες μηχανικές προσεγγίσεις που μεγιστοποιούν την απόδοση εντός περιορισμένων προϋπολογισμών παραμέτρων. Αυτά τα μοντέλα χρησιμοποιούν προηγμένα τεχνικά μέσα όπως η απόσταξη γνώσης, όπου μικρότερα “μαθητευόμενα” μοντέλα μαθαίνουν από μεγαλύτερα “δασκάλους” μοντέλα, захопίζοντας την απαραίτητη γνώση ενώ μειώνουν δραματικά τις υπολογιστικές απαιτήσεις.

Η σειρά Phi-4 της Microsoft ενσωματώνει αυτήν την προσέγγιση. Το μοντέλο φιλοσοφικής σκέψης Phi-4, με μόνο 14 δισεκατομμύρια παραμέτρους, ανταγωνίζεται μοντέλα πέντε φορές το μέγεθός του σε μαθηματική σκέψη και λογική επίλυση προβλημάτων. Παρόμοια, το μοντέλο Gemma 3 270M της Google αποδεικνύει ότι ένα συμπαγές μοντέλο 270 εκατομμυρίων παραμέτρων μπορεί να παραχθεί ισχυρές ικανότητες ακολουθίας οδηγιών και να χρησιμεύσει ως εξαιρετική βάση για την εξειδίκευση.

Το μοντέλο Llama 3.2 1B της Meta είναι μια άλλη đột pháση στην αποτελεσματικότητα του μικρού μοντέλου. Μέσω της δομημένης κλάδωσης και της απόσταξης γνώσης από μεγαλύτερα μοντέλα Llama, διατηρεί αξιοσημείωτη απόδοση ενώ λειτουργεί αποτελεσματικά σε περιφερειακές συσκευές. Αυτά τα μοντέλα αποδεικνύουν ότι η αρχιτεκτονική καινοτομία και η μεθοδολογία εκπαίδευσης έχουν περισσότερη σημασία από τον αριθμό παραμέτρων για πολλές πρακτικές εφαρμογές.

Η αρχιτεκτονική του μίγματος εμπειρογνωμόνων είναι μια σημαντική καινοτομία στην αποτελεσματική σχεδίαση AI. Αντί να χρησιμοποιούν όλες τις παραμέτρους για κάθε εργασία, αυτά τα μοντέλα ενεργοποιούν μόνο τις σχετικές εξειδικευμένες συνιστώσες. Κατευθύνουν διαφορετικές ερωτήσεις σε εξειδικευμένα υποδίκτυα, διατηρώντας ευρεία ικανότητα ενώ χρησιμοποιούν λιγότερες ενεργές παραμέτρους σε οποιαδήποτε δεδομένη στιγμή. Το μοντέλο Mixtral 8x7B της Mistral AI αποδεικνύει αυτήν την προσέγγιση αποτελεσματικά.尽管 έχει 47 δισεκατομμύρια συνολικά παραμέτρους, ενεργοποιεί μόνο 13 δισεκατομμύρια παραμέτρους ανά ερώτηση, επιτυγχάνοντας απόδοση συγκρίσιμη με πολύ μεγαλύτερα πυκνά μοντέλα ενώ διατηρεί ταχύτερες ταχύτητες συλλογισμού.

Οι τεχνικές κванτισμού έχουν επίσης σημαντική επίδραση στην αύξηση της αποτελεσματικότητας των μικρών μοντέλων. Αναπαριστώντας τα βάρη του μοντέλου με λιγότερα bits, οι ερευνητές μπορούν να συρρικνώσουν τα μοντέλα ενώ διατηρούν την ακρίβεια. Σύγχρονες μεθόδους κванτισμού μπορούν να μειώσουν το μέγεθος του μοντέλου κατά 75% με ελάχιστη απώλεια απόδοσης. Το μοντέλο Phi-3-mini της Microsoft έχει αποδείξει την αποτελεσματικότητα αυτής της προσέγγισης. Όταν κβαντιστεί σε ακρίβεια 4-bit, διατηρεί πάνω από το 95% της αρχικής του απόδοσης ενώ μειώνει τις απαιτήσεις μνήμης από 7GB σε λιγότερο από 2GB, καθιστώντας το πρακτικό ιδιαίτερα για την ανάπτυξη σε κινητές συσκευές.

Η Εξειδίκευση Υπερβαίνει την Γενίκευση

Η επανάσταση του μικρού μοντέλου αποκάλυψε μια σημαντική αλήθεια σχετικά με την ανάπτυξη AI. Οι περισσότερες πρακτικές εφαρμογές δεν χρειάζονται ένα μοντέλο που μπορεί να γράψει ποίηση, να λύσει ανώτερη μαθηματική και να συζητήσει φιλοσοφία. Χρειάζονται μοντέλα που εξέχουν σε συγκεκριμένες εργασίες. Ένα chatbot εξυπηρέτησης πελατών δεν χρειάζεται να γνωρίζει τον Σαίξπηρ. Ένα εργαλείο συμπλήρωσης κώδικα δεν χρειάζεται ιατρική γνώση. Αυτή η συνειδητοποίηση μετέβαλε την εστίαση από την κατασκευή καθολικών μοντέλων στην δημιουργία εξειδικευμένων.

Η εξειδικευμένη εκπαίδευση επιτρέπει στα μικρά μοντέλα να συγκεντρώσουν την περιορισμένη τους ικανότητα σε σχετικές γνώσεις. Ένα μοντέλο 3 δισεκατομμυρίων παραμέτρων που εκπαιδεύτηκε αποκλειστικά σε νομικά έγγραφα μπορεί να υπερβαίνει ένα μοντέλο 70 δισεκατομμυρίων παραμέτρων σε νομικές εργασίες. Το εξειδικευμένο μοντέλο μαθαίνει βαθύτερα μοτίβα εντός του τομέα του παρά να διασκορπίζει την ικανότητά του σε αμέτρητους μη σχετικούς τομείς. Είναι σαν να συγκρίνουμε έναν ειδικό ιατρό με έναν γενικό ιατρό για σύνθετες διαδικασίες.

Οι στρατηγικές εξειδίκευσης έχουν γίνει ολοένα και πιο εξελιγμένες. Αντί να εκπαιδεύουν μοντέλα από την αρχή, οι dévelopers ξεκινούν με μικρά βασικά μοντέλα και τα προσαρμόζουν σε συγκεκριμένες ανάγκες. Αυτή η προσέγγιση απαιτεί ελάχιστους υπολογιστικούς πόρους ενώ παράγει εξαιρετικά ικανά εξειδικευμένα μοντέλα. Οι οργανισμοί μπορούν τώρα να δημιουργήσουν προσαρμοσμένες λύσεις AI χωρίς τεράστιες επενδύσεις υποδομής.

Η Διαρρήξη του Ορίου Απόδοσης

Πρόσφατες βάσεις δεδομένων αποκαλύπτουν आश्चαραστές πλεονεκτήματα απόδοσης για τα μικρά μοντέλα σε συγκεκριμένους τομείς. Το μοντέλο Olmo 2 1B της AI2 υπερβαίνει μοντέλα παρόμοιου μεγέθους από μεγάλες εταιρείες τεχνολογίας σε εργασίες κατανόησης φυσικής γλώσσας. Το μοντέλο Phi-4-mini-flash-reasoning της Microsoft επιτυγχάνει μέχρι και 10 φορές υψηλότερη απόδοση με 2-3 φορές χαμηλότερη καθυστέρηση σε σχέση με παραδοσιακά μοντέλα σκέψης ενώ διατηρεί μαθηματικές ικανότητες σκέψης.

Ο χάσμα απόδοσης γίνεται ακόμη πιο εντυπωσιακός όταν εξετάζουμε εργασίες που αφορούν συγκεκριμένες εφαρμογές. Τα μικρά μοντέλα που εξειδικεύονται σε εξειδικευμένους τομείς υπερβαίνουν συνεχώς τα γενικά μεγαλύτερα μοντέλα σε ακρίβεια και σχετικότητα. Οι εφαρμογές υγείας, η ανάλυση νομικών εγγράφων και οι εφαρμογές εξυπηρέτησης πελατών δείχνουν ιδιαίτερα εντυπωσιακά αποτελέσματα όταν τα μικρά μοντέλα εκπαιδεύονται σε εξειδικευμένα σύνολα δεδομένων.

Αυτό το πλεονέκτημα απόδοσης προέρχεται από εστιασμένες προσεγγίσεις εκπαίδευσης. Αντί να μαθαίνουν ευρεία αλλά ρηχή γνώση σε αμέτρητους τομείς, τα μικρά μοντέλα αναπτύσσουν βαθιά εξειδίκευση σε στόχους τομείς. Το αποτέλεσμα είναι πιο αξιόπιστες, συναφείς απαντήσεις για συγκεκριμένες περιπτώσεις χρήσης.

Το Πλεονέκτημα Ταχύτητας και Αποτελεσματικότητας

Η απόδοση δεν αφορά μόνο την ακρίβεια. Αφορά επίσης την ταχύτητα, το κόστος και την περιβαλλοντική επίδραση. Τα μικρά μοντέλα ξεχωρίζουν σε όλες αυτές τις διαστάσεις. Ένα μικρό μοντέλο μπορεί να παράγει απαντήσεις σε χιλιοστά του δευτερολέπτου όπου τα μεγάλα μοντέλα χρειάζονται δευτερόλεπτα. Αυτή η διαφορά ταχύτητας μπορεί να φαίνεται αμελητέα, αλλά γίνεται κρίσιμη σε εφαρμογές που απαιτούν πραγματικό χρόνο αλληλεπίδρασης ή επεξεργασία εκατομμυρίων αιτημάτων.

Η κατανάλωση ενέργειας είναι ένα άλλο κρίσιμο σημείο. Τα μεγάλα μοντέλα απαιτούν τεράστιους κεντρικούς υπολογιστές με εξελιγμένα συστήματα ψύξης. Κάθε ερώτηση καταναλώνει σημαντική ηλεκτρική ενέργεια. Τα μικρά μοντέλα μπορούν να τρέξουν σε τυπικούς εξυπηρετητές ή ακόμη και σε προσωπικούς υπολογιστές, χρησιμοποιώντας ένα τμήμα της ενέργειας. Όσο οι οργανισμοί αντιμετωπίζουν πίεση για μείωση των αποτυπωμάτων άνθρακα, το περιβαλλοντικό πλεονέκτημα των μικρών μοντέλων γίνεται ολοένα και πιο σημαντικό.

Η ανάπτυξη σε περιφερειακές συσκευές είναι ίσως η πιο μετασχηματιστική ικανότητα των μικρών μοντέλων. Αυτά τα μοντέλα μπορούν να τρέξουν απευθείας σε τηλέφωνα, λάπτοπ ή συσκευές IoT χωρίς σύνδεση στο διαδίκτυο. Φανταστείτε ιατρικά διαγνωστικά εργαλεία που λειτουργούν σε απομακρυσμένες περιοχές χωρίς σύνδεση στο διαδίκτυο, ή συσκευές μετάφρασης σε πραγματικό χρόνο που δεν χρειάζονται σύνδεση στο cloud. Τα μικρά μοντέλα κάνουν αυτές τις σκηνές δυνατές, φέρνοντας ικανότητες AI σε δισεκατομμύρια συσκευές παγκοσμίως.

Οι ανησυχίες περί προστασίας δεδομένων ευνοούν επίσης τα μικρά μοντέλα. Όταν το AI τρέχει τοπικά σε συσκευές χρηστών, ευαίσθητα δεδομένα δεν εγκαταλείπουν ποτέ τη συσκευή. Οι πάροχοι υγείας μπορούν να αναλύσουν δεδομένα ασθενών χωρίς να ανεβάζουν τα δεδομένα σε διακομιστές cloud. Οι финансовές ιδρύματα μπορούν να επεξεργαστούν συναλλαγές χωρίς να εκθέτουν πληροφορίες πελατών σε εξωτερικά συστήματα. Αυτή η τοπική επεξεργασία ικανοποιεί μια από τις principales ανησυχίες σχετικά με την υιοθέτηση AI σε ευαίσθητες βιομηχανίες.

Το Κύριο Σημείο

Η άνοδος των μικρών μοντέλων AI προκλήθηκε την πεποίθηση ότι τα μεγαλύτερα μοντέλα luôn παρέχουν καλύτερη απόδοση. Συμπαγείς μοντέλα με λιγότερες παραμέτρους τώρα ταιριάζουν ή ακόμη και υπερβαίνουν τα μεγαλύτερα σε συγκεκριμένες εργασίες χρησιμοποιώντας τεχνικές όπως η απόσταξη γνώσης, ο κβαντισμός και η εξειδίκευση. Αυτή η αλλαγή κάνει το AI πιο προσβάσιμο επιτρέποντας ταχύτερη και πιο ενεργειακά αποτελεσματική χρήση σε καθημερινές συσκευές. Επίσης, μειώνει το κόστος, μειώνει την περιβαλλοντική επίδραση και βελτιώνει την προστασία δεδομένων επιτρέποντας την τοπική ανάπτυξη. Αναδιοργανώνοντας την εστίαση από την κατασκευή μαζικών καθολικών συστημάτων σε αποτελεσματικά, εργασίες-ειδικές μοντέλα, το AI γίνεται πιο πρακτικό, προσιτό και χρήσιμο για οργανισμούς και άτομα.