Τεχνητή νοημοσύνη

Το Πρόβλημα του Μαύρου Κουτιού στις LLMs: Προκλήσεις και Εμφερίζουσες Λύσεις

Η μηχανική μάθηση, ένα υποσύνολο της τεχνητής νοημοσύνης, περιλαμβάνει τρία συστατικά: αλγόριθμους, δεδομένα εκπαίδευσης και το αποτέλεσμα του μοντέλου. Ένας αλγόριθμος, ουσιαστικά ένα σύνολο διαδικασιών, μαθαίνει να αναγνωρίζει μοτίβα από ένα μεγάλο σύνολο παραδειγμάτων (δεδομένα εκπαίδευσης). Το αποτέλεσμα αυτής της εκπαίδευσης είναι ένα μοντέλο μηχανικής μάθησης. Για παράδειγμα, ένας αλγόριθμος εκπαιδευμένος με εικόνες σκύλων θα οδηγήσει σε ένα μοντέλο ικανό να αναγνωρίζει σκύλους σε εικόνες.

Μαύρο Κουτί στη Μηχανική Μάθηση

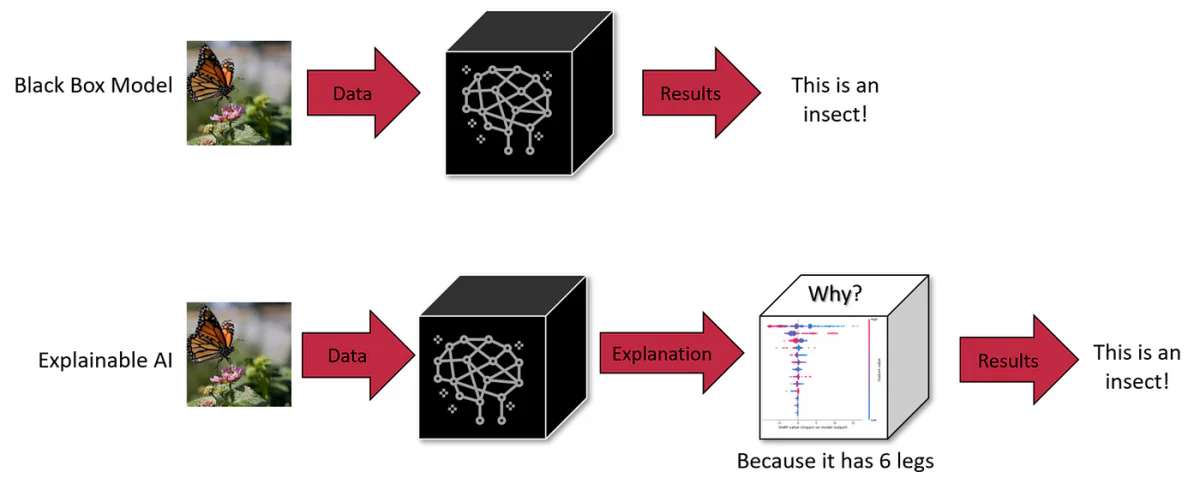

Στη μηχανική μάθηση, οποιοδήποτε από τα τρία συστατικά—αλγόριθμος, δεδομένα εκπαίδευσης ή μοντέλο—μπορεί να είναι ένα μαύρο κουτί. Ενώ οι αλγόριθμοι είναι συχνά δημόσια γνωστοί, οι développers μπορεί να επιλέξουν να κρατήσουν το μοντέλο ή τα δεδομένα εκπαίδευσης μυστικά για να προστατεύσουν την πνευματική ιδιοκτησία. Αυτή η αμφιβολία καθιστά δύσκολο να κατανοηθεί η διαδικασία λήψης αποφάσεων της τεχνητής νοημοσύνης.

Τα μαύρα κουτί της τεχνητής νοημοσύνης είναι συστήματα των οποίων οι εσωτερικές λειτουργίες παραμένουν αδιαφανείς ή αόρατες στους χρήστες. Οι χρήστες μπορούν να εισαγάγουν δεδομένα και να λάβουν έξοδο, αλλά η λογική ή ο κώδικας που παράγει την έξοδο παραμένει κρυφός. Αυτό είναι ένα κοινό χαρακτηριστικό σε πολλά συστήματα τεχνητής νοημοσύνης, συμπεριλαμβανομένων των προηγμένων γεννητικών μοντέλων όπως το ChatGPT και το DALL-E 3.

Οι LLMs όπως το GPT-4 παρουσιάζουν μια σημαντική πρόκληση: οι εσωτερικές λειτουργίες τους είναι σε μεγάλο βαθμό αδιαφανείς, καθιστώντας τα “μαύρα κουτί”. Αυτή η αδιαφάνεια δεν είναι μόνο ένα τεχνικό πρόβλημα, αλλά και ένα πραγματικό πρόβλημα ασφάλειας και ηθικής. Για παράδειγμα, αν δεν μπορούμε να κατανοήσουμε πώς αυτά τα συστήματα φθάνουν σε συμπεράσματα, μπορούμε να τους εμπιστευθούμε σε κρίσιμους τομείς όπως οι ιατρικές διαγνώσεις ή οι οικονομικές αξιολογήσεις;

Εξερεύνηση των Τεχνικών LIME και SHAP

Η ερμηνευσιμότητα στη μηχανική μάθηση (ML) και τη βαθιά μάθηση (DL) βοηθά να δούμε μέσα στις αδιαφανείς εσωτερικές λειτουργίες αυτών των προηγμένων μοντέλων. Τοπικές Ερμηνευσιμότητες Μοντέλων-αγνοούμενων Εξηγήσεων (LIME) και SHapley Προσθετικές Εξηγήσεις (SHAP) είναι δύο τέτοιες κυρίαρχες τεχνικές ερμηνευσιμότητας.

LIME, για παράδειγμα, διασπά την πολυπλοκότητα δημιουργώντας απλούστερα, τοπικά υποκατάστατα μοντέλα που προσεγγίζουν τη συμπεριφορά του αρχικού μοντέλου γύρω από μια συγκεκριμένη είσοδο. Κάνοντας αυτό, το LIME βοηθά στην κατανόηση του πώς οι μεμονωμένες λειτουργίες επηρεάζουν τις προβλέψεις των σύνθετων μοντέλων, παρέχοντας ουσιαστικά μια ‘τοπική’ εξήγηση για το γιατί ένα μοντέλο έκανε μια συγκεκριμένη απόφαση. Είναι ιδιαίτερα χρήσιμο για μη τεχνικούς χρήστες, καθώς μεταφράζει τη σύνθετη διαδικασία λήψης αποφάσεων των μοντέλων σε πιο κατανοητές εκφράσεις.

Το SHAP, από την άλλη πλευρά, παίρνει έμπνευση από τη θεωρία παιγνίων, συγκεκριμένα από την έννοια των τιμών Shapley. Αντιστοιχεί μια ‘σημασία’ τιμή σε κάθε λειτουργία, υποδεικνύοντας πόσο πολύ κάθε λειτουργία συνεισφέρει στη διαφορά μεταξύ της πραγματικής πρόβλεψης και της πρόβλεψης αναφοράς (η μέση πρόβλεψη σε όλα τα εισαγωγικά δεδομένα). Η δύναμη του SHAP έγκειται στη συνεπή του και στην ικανότητά του να παρέχει μια παγκόσμια προοπτική – όχι μόνο εξηγεί μεμονωμένες προβλέψεις, αλλά και παρέχει ενημερώσεις για το μοντέλο ως σύνολο. Αυτό είναι ιδιαίτερα πολύτιμο στα μοντέλα βαθιάς μάθησης, όπου οι διασυνδεδεμένες στρώσεις και οι πολυάριθμοι παράμετροι συχνά κάνουν τη διαδικασία πρόβλεψης να φαίνεται σαν ένα ταξίδι μέσα σε ένα λαβύρινθο. Το SHAP απομυστήνει αυτό, ποσοτικοποιώντας τη συνεισφορά κάθε λειτουργίας, προσφέροντας một πιο σαφή χάρτη των οδών λήψης αποφάσεων του μοντέλου.

SHAP (Source)

Και το LIME και το SHAP έχουν αναδυθεί ως απαραίτητα εργαλεία στον τομέα της τεχνητής νοημοσύνης και της μηχανικής μάθησης, αντιμετωπίζοντας την κρίσιμη ανάγκη για διαφάνεια και αξιοπιστία. Όσο συνεχίζουμε να ενσωματώνουμε την τεχνητή νοημοσύνη πιο βαθιά σε διάφορους τομείς, η ικανότητα να ερμηνεύουμε και να κατανοούμε αυτά τα μοντέλα γίνεται όχι μόνο μια τεχνική αναγκαιότητα, αλλά και μια θεμελιώδη απαίτηση για την ηθική και υπεύθυνη ανάπτυξη της τεχνητής νοημοσύνης. Αυτές οι τεχνικές αντιπροσωπεύουν σημαντικά βήματα στην αποκάλυψη των πολυπλοκότητων της ML και DL, μετατρέποντας τα από αδιαφανή ‘μαύρα κουτί’ σε κατανοητά συστήματα των οποίων οι αποφάσεις και συμπεριφορές μπορούν να κατανοηθούν, να εμπιστευτούν και να χρησιμοποιηθούν αποτελεσματικά.

Η Κλίμακα και η Πολυπλοκότητα των LLMs

Η κλίμακα αυτών των μοντέλων προστίθεται στην πολυπλοκότητά τους. Πάρτε το GPT-3, για παράδειγμα, με τα 175 δισεκατομμύρια παραμέτρους του, και νεότερα μοντέλα με τρισεκατομμύρια. Κάθε παράμετρος αλληλεπιδρά με περίπλοκο τρόπο μέσα στο νευρωνικό δίκτυο, συνεισφέροντας σε εmergent ικανότητες που δεν είναι προβλέψιμες με την εξέταση μεμονωμένων组ων μόνο. Αυτή η κλίμακα και πολυπλοκότητα καθιστά σχεδόν αδύνατο να κατανοηθεί πλήρως η εσωτερική λογική τους, δημιουργώντας ένα εμπόδιο στη διαγνώση προκαταλήψεων ή ανεπιθύμητων συμπεριφορών σε αυτά τα μοντέλα.

Η Ανταλλαγή: Κλίμακα vs. Ερμηνευσιμότητα

Η μείωση της κλίμακας των LLMs θα μπορούσε να βελτιώσει την ερμηνευσιμότητα, αλλά με το κόστος των προηγμένων ικανοτήτων τους. Η κλίμακα είναι αυτό που επιτρέπει τις συμπεριφορές που τα μικρότερα μοντέλα δεν μπορούν να επιτύχουν. Αυτό παρουσιάζει μια εγγενή ανταλλαγή μεταξύ κλίμακας, ικανότητας και ερμηνευσιμότητας.

Επίδραση του Προβλήματος του Μαύρου Κουτιού των LLMs

1. Ελαττωματική Λήψη Αποφάσεων

Η αδιαφάνεια στη διαδικασία λήψης αποφάσεων των LLMs όπως το GPT-3 ή το BERT μπορεί να οδηγήσει σε ανιχνεύσιμες προκαταλήψεις και λάθη. Σε τομείς όπως η υγεία ή η δικαιοσύνη, όπου οι αποφάσεις έχουν μακροπρόθεσμες συνέπειες, η αδυναμία να ελεγχθούν τα LLMs για ηθική και λογική ακεραιότητα είναι ένα σημαντικό πρόβλημα. Για παράδειγμα, ένα μοντέλο ιατρικής διάγνωσης LLM που βασίζεται σε παλαιά ή προκατειλημμένα δεδομένα μπορεί να κάνει βλαβερές συστάσεις. Παρόμοια, τα LLMs στη διαδικασία πρόσληψης μπορεί να ενισχύσουν ανεπίσημα γυναικείες προκαταλήψεις. Η φύση του μαύρου κουτιού κρύβει όχι μόνο ελαττώματα, αλλά μπορεί επίσης να τα ενισχύσει, απαιτώντας μια προληπτική προσέγγιση για την ενίσχυση της διαφάνειας.

2. Περιορισμένη Προσαρμοστικότητα σε Διαφορετικά Πλαίσια

Η έλλειψη έμπνευσης στις εσωτερικές λειτουργίες των LLMs περιορίζει την προσαρμοστικότητά τους. Για παράδειγμα, ένα LLM πρόσληψης μπορεί να είναι ανεπαρκές στην αξιολόγηση υποψηφίων για einen ρόλο που αξιολογεί πρακτικές ικανότητες πάνω από ακαδημαϊκές προϋποθέσεις, λόγω της αδυναμίας του να προσαρμόσει τα κριτήρια αξιολόγησής του. Παρόμοια, ένα ιατρικό LLM μπορεί να πασχίσει με σπάνιες διαγνώσεις ασθενειών λόγω дис balans των δεδομένων. Αυτή η ακαμψία υπογραμμίζει την ανάγκη για διαφάνεια για να επαναρυθμίσει τα LLMs για συγκεκριμένες εργασίες και πλαίσια.

3. Προκαταλήψεις και Κενά Γνώσης

Η επεξεργασία των LLMs μεγάλων συνόλων δεδομένων εκπαίδευσης υπόκειται στις περιορισμούς που επιβάλλονται από τους αλγόριθμους και τις αρχιτεκτονικές των μοντέλων. Για παράδειγμα, ένα ιατρικό LLM μπορεί να δείξει δημογραφικές προκαταλήψεις εάν εκπαιδευτεί σε μη ισορροπημένα σύνολα δεδομένων. Επίσης, η ικανότητα ενός LLM σε ιδιαίτερες θεματικές μπορεί να είναι παραπλανητική, οδηγώντας σε υπερβεβλημένες, λανθασμένες εξόδους. Η αντιμετώπιση αυτών των προκαταλήψεων και κενών γνώσης απαιτεί περισσότερα από το να προστεθούνเพิ่มเตρα δεδομένα· απαιτεί μια εξέταση των μηχανισμών επεξεργασίας του μοντέλου.

4. Νομική και Ηθική Ευθύνη

Η αδιαφάνεια των LLMs δημιουργεί μια νομική γκρίζα ζώνη σχετικά με την ευθύνη για οποιαδήποτε ζημία που προκαλείται από τις αποφάσεις τους. Αν ένα LLM σε ένα ιατρικό περιβάλλον παρέχει ελαττωματικές συμβουλές που οδηγούν σε βλάβη του ασθενούς, η καθορισμός της ευθύνης γίνεται δύσκολο λόγω της αδιαφάνειας του μοντέλου. Αυτή η νομική αβεβαιότητα δημιουργεί κινδύνους για οντότητες που αναπτύσσουν LLMs σε ευαίσθητους τομείς, υπογραμμίζοντας την ανάγκη για σαφή διακυβέρνηση και διαφάνεια.

5. Ζητήματα Εμπιστοσύνης σε Ευαίσθητες Εφαρμογές

Για τα LLMs που χρησιμοποιούνται σε κρίσιμους τομείς όπως η υγεία και η οικονομία, η έλλειψη διαφάνειας υπονόμευε την αξιοπιστία τους. Οι χρήστες και οι ρυθμιστές πρέπει να διασφαλίσουν ότι αυτά τα μοντέλα δεν κρύβουν προκαταλήψεις ή δεν λαμβάνουν αποφάσεις με βάση άδικα κριτήρια. Η επαλήθευση της απουσίας προκαταλήψεων στα LLMs απαιτεί μια κατανόηση των διαδικασιών λήψης αποφάσεων, υπογραμμίζοντας τηνimportance της ερμηνευσιμότητας για την ηθική ανάπτυξη.

6. Κίνδυνοι με Προσωπικά Δεδομένα

Τα LLMs απαιτούν εκτεταμένα δεδομένα εκπαίδευσης, τα οποία μπορεί να περιλαμβάνουν ευαίσθητες προσωπικές πληροφορίες. Η φύση του μαύρου κουτιού αυτών των μοντέλων δημιουργεί ανησυχίες σχετικά με τον τρόπο που επεξεργάζονται και χρησιμοποιούν αυτά τα δεδομένα. Για παράδειγμα, ένα ιατρικό LLM που εκπαιδεύεται σε ιατρικά αρχεία αναβάλλει ερωτήσεις σχετικά με την ιδιωτικότητα και τη χρήση των δεδομένων. Η διασφάλιση ότι τα προσωπικά δεδομένα δεν χρησιμοποιούνται κατά τρόπο ακατάλληλο ή εκμεταλλεύονται απαιτεί διαφανείς διαδικασίες επεξεργασίας δεδομένων μέσα σε αυτά τα μοντέλα.

Εμφερίζουσες Λύσεις για Ερμηνευσιμότητα

Για να αντιμετωπιστούν αυτές οι προκλήσεις, αναπτύσσονται νέες τεχνικές. Αυτές περιλαμβάνουν μεθόδους προσεγγιστικής αντίστροφης (CF) εκτίμησης. Η πρώτη μέθοδος περιλαμβάνει την προώθηση ενός LLM να αλλάξει μια συγκεκριμένη концепτία κειμένου ενώ διατηρεί άλλες концепτίες σταθερές. Αυτή η προσέγγιση, αν και αποτελεσματική, είναι πόρων-εντατική κατά τον χρόνο inference.

Η δεύτερη προσέγγιση περιλαμβάνει τη δημιουργία ενός αφοσιωμένου χώρου ενσωματώσεων που καθοδηγείται από ένα LLM κατά την εκπαίδευση. Αυτός ο χώρος ευθυγραμμίζεται με einen αιτιολογικό γράφο και βοηθά στην αναγνώριση αντιστοιχιών που προσεγγίζουν CFs. Αυτή η μέθοδος απαιτεί λιγότερους πόρους κατά τον χρόνο δοκιμής και έχει αποδειχθεί ότι εξηγεί αποτελεσματικά τις προβλέψεις του μοντέλου, ακόμη και σε LLMs με δισεκατομμύρια παραμέτρους.

Αυτές οι προσεγγίσεις υπογραμμίζουν τηνimportance των αιτιολογικών εξηγήσεων στα συστήματα NLP για να διασφαλίσουν την ασφάλεια και να καθιερώσουν την εμπιστοσύνη. Οι προσεγγίσεις CF παρέχουν έναν τρόπο να φανταστούμε πώς θα άλλαζε ένα δεδομένο κείμενο εάν μια συγκεκριμένη концепτία στη διαδικασία γεννήτρου ήταν διαφορετική, βοηθώντας στην πρακτική αιτιολογική εκτίμηση υψηλού επιπέδου концепτίων σε μοντέλα NLP.

Βαθιά Εισαγωγή: Μέθοδοι Εξήγησης και Αιτιολογία στις LLMs

Εργαλεία Εισαγωγής και Σημασίας Λειτουργιών

Η εισαγωγή είναι μια τεχνική που χρησιμοποιείται για να αποκρυπτογραφηθεί τι εσωτερικές αναπαραστάσεις σε μοντέλα κωδικοποιούν. Μπορεί να είναι είτε εποπτική είτε ανεπόπτη και έχει ως στόχο να καθορίσει εάν συγκεκριμένες концепτίες κωδικοποιούνται σε συγκεκριμένα σημεία ενός δικτύου. Αν και αποτελεσματική μέχρι ένα σημείο, οι εισαγωγές δεν παρέχουν αιτιολογικές εξηγήσεις, όπως υπογραμμίζεται από τους Geiger et al. (2021).

Τα εργαλεία σημασίας λειτουργιών, μια άλλη μορφή μεθόδων εξήγησης, επικεντρώνονται συχνά στις εισαγωγικές λειτουργίες, αν και κάποιες μεθόδους βασισμένες σε gradient επεκτείνουν αυτήν την ανάλυση στις κρυφές καταστάσεις. Ένα παράδειγμα είναι η μέθοδος Ολοκληρωμένων Gradient, η οποία προσφέρει μια αιτιολογική ερμηνεία εξετάζοντας τις βασικές (αντίστροφες, CF) εισαγωγές. Παρά την उपयσιμότητά τους, αυτές οι μέθοδοι ακόμη πασχίζουν να συνδέσουν τις αναλύσεις τους με πραγματικές έννοιες πέρα από απλές ιδιότητες εισαγωγής.

Μέθοδοι Εισαγωγής-Βάσει

Οι μεθόδους εισαγωγής-βάσει περιλαμβάνουν την τροποποίηση εισαγωγών ή εσωτερικών αναπαραστάσεων για να μελετήσουν τις επιπτώσεις στη συμπεριφορά του μοντέλου. Αυτές οι μέθοδοι μπορούν να δημιουργήσουν καταστάσεις CF για να εκτιμήσουν αιτιολογικές επιπτώσεις, αλλά συχνά παράγουν απίστευτες εισαγωγές ή καταστάσεις δικτύου, εκτός εάν ελέγχονται προσεκτικά. Το Μοντέλο Causal Proxy (CPM), εμπνευσμένο από την έννοια του S-learner, είναι μια νέα προσέγγιση σε αυτόν τον τομέα, μιμούμενο τη συμπεριφορά του εξηγημένου μοντέλου υπό CF εισαγωγές. Ωστόσο, η ανάγκη για έναν ξεχωριστό εξηγητή για κάθε μοντέλο είναι μια σημαντική περιορισμός.

Προσεγγίσεις Αντίστροφου

Οι αντίστροφες είναι ευρέως χρησιμοποιούμενες στη μηχανική μάθηση για την επέκταση δεδομένων, που περιλαμβάνουν διαταραχές σε διάφορους παράγοντες ή ετικέτες. Αυτές μπορούν να γεννηθούν μέσω χειροκίνητου επεξεργασίας, εύρησης κλειδιών-λέξεων ή αυτόματης ανασυγγραφής κειμένου. Αν και η χειροκίνητη επεξεργασία είναι ακριβής, είναι επίσης πόρων-εντατική. Οι μεθόδους-κλειδιών έχουν τις περιορισμούς τους, και οι γεννητικές προσεγγίσεις προσφέρουν μια ισορροπία μεταξύ ευφράδειας και κάλυψης.

Πιστές Εξηγήσεις

Η πιστότητα στις εξηγήσεις αναφέρεται στην ακριβή απεικόνιση της υποκείμενης λογικής του μοντέλου. Δεν υπάρχει καθολικά αποδεκτή ορισμός της πιστότητας, οδηγώντας στην χαρακτηριστική της μέσω διαφόρων μετρήσεων όπως Ευαίσθητητα, Συνέπεια, Συμφωνία Σημασίας Λειτουργιών, Ροπή και Προσομοίωση. Οι περισσότερες από αυτές τις μεθόδους επικεντρώνονται στις εξηγήσεις επιπέδου λειτουργίας και συχνά συγχέουν τη συσχέτιση με την αιτιολογία. Η δουλειά μας έχει ως στόχο να παρέχει εξηγήσεις υψηλού επιπέδου концепτίας, αξιοποιώντας τη βιβλιογραφία της αιτιολογικής για να προτείνει έναν εννοιολογικό κριτήριο: Order-Πιστότητα.

Έχουμε εισαγάγει τις εγγενείς πολυπλοκότητες των LLMs, κατανοώντας τη φύση του ‘μαύρου κουτιού’ και τις σημαντικές προκλήσεις που θέτουν. Από τους κινδύνους της ελαττωματικής λήψης αποφάσεων σε ευαίσθητους τομείς όπως η υγεία και η οικονομία, έως τις ηθικές δίлемμες που περιβάλλουν τις προκαταλήψεις και την ισότητα, η ανάγκη για διαφάνεια στις LLMs δεν έχει ποτέ ήταν πιο εμφανής.

Το μέλλον των LLMs και η ενσωμάτωσή τους στις καθημερινές μας ζωές και τις κρίσιμες διαδικασίες λήψης αποφάσεων εξαρτάται από την ικανότητά μας να κάνουμε αυτά τα μοντέλα όχι μόνο πιο προηγμένα, αλλά και πιο κατανοητά και υπευθύνων. Η διώξη της ερμηνευσιμότητας και της ερμηνευσιμότητας δεν είναι μόνο μια τεχνική επιχείρηση, αλλά και ένα θεμελιώδες στοιχείο της οικοδόμησης εμπιστοσύνης στα συστήματα της τεχνητής νοημοσύνης. Όσο τα LLMs γίνονται πιο ενσωματωμένα στην κοινωνία, η ζήτηση για διαφάνεια θα αυξηθεί, όχι μόνο από τους praktikous της τεχνητής νοημοσύνης, αλλά και από κάθε χρήστη που αλληλεπιδρά με αυτά τα συστήματα.