Η γωνία του Άντερσον

Τα μικρότερα deepfakes μπορεί να είναι η μεγαλύτερη απειλή

Εργαλεία τεχνητής νοημοσύνης για συνομιλία, όπως το ChatGPT και το Google Gemini, χρησιμοποιούνται πλέον για τη δημιουργία deepfakes που δεν αλλάζουν πρόσωπα, αλλά με πιο ανεπαίσθητους τρόπους μπορούν να ξαναγράψουν ολόκληρη την ιστορία μέσα σε μια εικόνα. Αλλάζοντας χειρονομίες, στηρίγματα και φόντα, αυτές οι επεξεργασίες ξεγελούν τόσο τους ανιχνευτές τεχνητής νοημοσύνης όσο και τους ανθρώπους, αυξάνοντας τους κινδύνους για τον εντοπισμό του πραγματικού στο διαδίκτυο.

Στις τρέχουσες συνθήκες, ιδίως μετά από σημαντικές νομοθετικές ρυθμίσεις όπως η ΚΑΤΑΡΓΗΣΤΕ ΤΟ Στην πραγματικότητα, πολλοί από εμάς συνδέουμε τα deepfakes και τη σύνθεση ταυτότητας που καθοδηγείται από την Τεχνητή Νοημοσύνη με μη συναινετική πορνογραφία μέσω Τεχνητής Νοημοσύνης και πολιτική χειραγώγηση - γενικά, ακαθάριστο διαστρεβλώσεις της αλήθειας.

Αυτό μας κάνει να περιμένουμε ότι οι εικόνες που χειραγωγούνται από την Τεχνητή Νοημοσύνη θα προορίζονται πάντα για περιεχόμενο υψηλού ρίσκου, όπου η ποιότητα της απόδοσης και ο χειρισμός του πλαισίου μπορεί να επιτύχουν μια αύξηση αξιοπιστίας, τουλάχιστον βραχυπρόθεσμα.

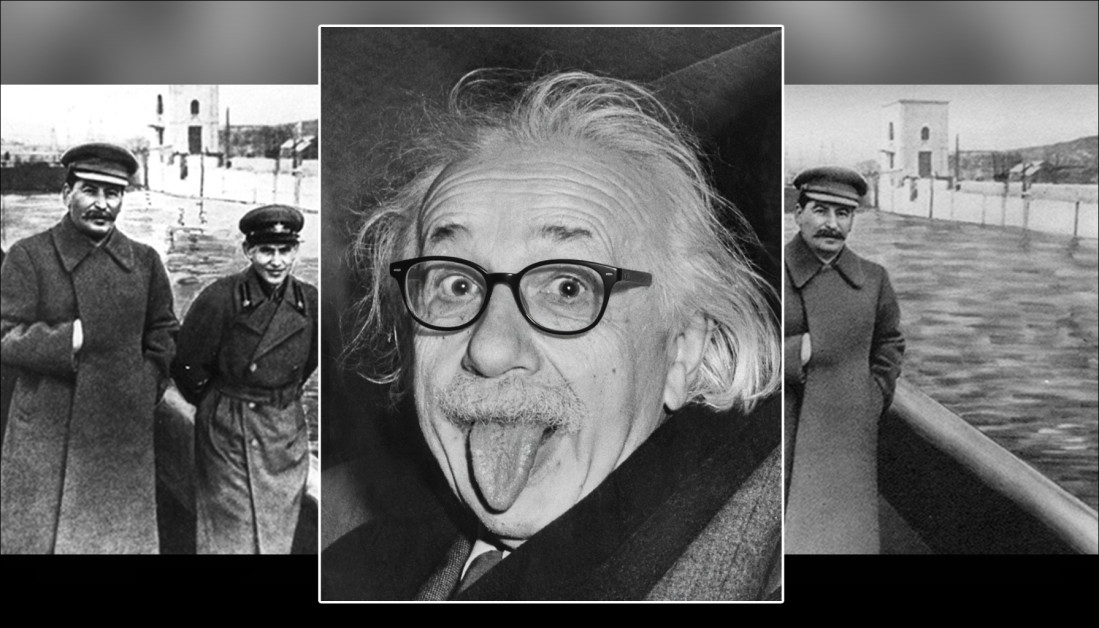

Ιστορικά, ωστόσο, πολύ πιο ανεπαίσθητες αλλοιώσεις είχαν συχνά ένα πιο δυσοίωνο και διαρκές αποτέλεσμα - όπως τα υπερσύγχρονα φωτογραφικά κόλπα που επέτρεψαν στον Στάλιν να αφαιρέστε αυτά που είχε χάσει την εύνοια του φωτογραφικού αρχείου, όπως σατιρίζεται στο μυθιστόρημα του Τζορτζ Όργουελ Δεκαεννέα ογδόντα τέσσερα, όπου ο πρωταγωνιστής Γουίνστον Σμιθ περνάει τις μέρες του ξαναγράφοντας την ιστορία και βάζοντας φωτογραφίες να δημιουργούνται, να καταστρέφονται και να «διορθώνονται».

Στο ακόλουθο παράδειγμα, το πρόβλημα με το δεύτερος η εικόνα είναι ότι «δεν ξέρουμε τι δεν ξέρουμε» – ότι ο πρώην επικεφαλής της μυστικής αστυνομίας του Στάλιν, Νικολάι Γιεζόφ, καταλάμβανε τον χώρο όπου τώρα υπάρχει μόνο ένα φράγμα ασφαλείας:

Τώρα τον βλέπεις, τώρα είναι... ατμός. Η φωτογραφική επεξεργασία της εποχής του Στάλιν αφαιρεί από την ιστορία ένα ατιμασμένο μέλος του κόμματος. Πηγή: Δημόσιο κτήμα, μέσω https://www.rferl.org/a/soviet-airbrushing-the-censors-who-scratched-out-history/29361426.html

Αυτού του είδους τα ρεύματα, που επαναλαμβάνονται συχνά, επιμένουν με πολλούς τρόπους· όχι μόνο πολιτισμικά, αλλά και στην ίδια την υπολογιστική όραση, η οποία αντλεί τάσεις από στατιστικά κυρίαρχα θέματα και μοτίβα σε σύνολα δεδομένων εκπαίδευσης. Για να δώσουμε ένα παράδειγμα, το γεγονός ότι τα smartphones έχουν μειώσει το εμπόδιο εισόδου, και μαζικά μείωσε το κόστος της φωτογραφίας, που σημαίνει ότι η εικονογραφία τους έχει συνδεθεί αναπόφευκτα με πολλές αφηρημένες έννοιες, ακόμα και όταν αυτό δεν είναι κατάλληλο.

Αν το συμβατικό deepfake μπορεί να εκληφθεί ως πράξη «επίθεσης», οι επιβλαβείς και επίμονες μικρές αλλοιώσεις στα οπτικοακουστικά μέσα μοιάζουν περισσότερο με το «gaslighting». Επιπλέον, η ικανότητα αυτού του είδους deepfake να περνά απαρατήρητο καθιστά δύσκολη την αναγνώρισή του μέσω σύγχρονων συστημάτων ανίχνευσης deepfake (τα οποία αναζητούν μεγάλες αλλαγές). Αυτή η προσέγγιση μοιάζει περισσότερο με το νερό που φθείρει βράχους για μια παρατεταμένη περίοδο, παρά με έναν βράχο που στοχεύει ένα κεφάλι.

MultiFakeVerse

Ερευνητές από την Αυστραλία προσπάθησαν να αντιμετωπίσουν την έλλειψη προσοχής στη «λεπτή» deepfaking στη βιβλιογραφία, επιμελούμενοι ένα ουσιαστικό νέο σύνολο δεδομένων για χειρισμούς εικόνας με επίκεντρο το άτομο που αλλοιώνουν το πλαίσιο, το συναίσθημα και την αφήγηση χωρίς να αλλάζουν την βασική ταυτότητα του υποκειμένου:

Δείγματα από τη νέα συλλογή, ζεύγη πραγματικών/ψεύτικων, με κάποιες αλλαγές πιο ανεπαίσθητες από άλλες. Σημειώστε, για παράδειγμα, την απώλεια αυθεντίας για την Ασιάτισσα, κάτω δεξιά, καθώς το στηθοσκόπιο του γιατρού της αφαιρείται από την Τεχνητή Νοημοσύνη. Ταυτόχρονα, η αντικατάσταση του πρόχειρου με το σημειωματάριο του γιατρού δεν έχει καμία προφανή σημασιολογική απόκλιση.Πηγή: https://huggingface.co/datasets/parulgupta/MultiFakeVerse_preview

Τιτλούχος MultiFakeVerse, η συλλογή αποτελείται από 845,826 εικόνες που δημιουργούνται μέσω μοντέλων οπτικής γλώσσας (VLM), οι οποίες μπορούν να πρόσβαση στο διαδίκτυο και κατεβάστηκε, με άδεια.

Οι συγγραφείς αναφέρουν:

Αυτή η προσέγγιση που βασίζεται σε VLM επιτρέπει σημασιολογικές, προσαρμοσμένες στο περιβάλλον αλλαγές, όπως η τροποποίηση ενεργειών, σκηνών και αλληλεπιδράσεων ανθρώπου-αντικειμένου, αντί για συνθετικές ή χαμηλού επιπέδου ανταλλαγές ταυτότητας και επεξεργασίες ανά περιοχή που είναι συνηθισμένες σε υπάρχοντα σύνολα δεδομένων.

«Τα πειράματά μας αποκαλύπτουν ότι τα τρέχοντα μοντέλα ανίχνευσης deepfake και οι ανθρώπινοι παρατηρητές δυσκολεύονται να ανιχνεύσουν αυτούς τους ανεπαίσθητους αλλά ουσιαστικούς χειρισμούς».

Οι ερευνητές εξέτασαν τόσο ανθρώπους όσο και κορυφαία συστήματα ανίχνευσης deepfake στο νέο τους σύνολο δεδομένων για να δουν πόσο καλά μπορούσαν να εντοπιστούν αυτοί οι ανεπαίσθητοι χειρισμοί. Οι άνθρωποι που συμμετείχαν δυσκολεύτηκαν, ταξινομώντας σωστά τις εικόνες ως πραγματικές ή ψεύτικες μόνο στο 62% περίπου του χρόνου, και είχαν ακόμη μεγαλύτερη δυσκολία να εντοπίσουν ποια μέρη της εικόνας είχαν αλλοιωθεί.

Οι υπάρχοντες ανιχνευτές deepfake, εκπαιδευμένοι κυρίως σε πιο προφανή σύνολα δεδομένων ανταλλαγής προσώπων ή inpainting, είχαν επίσης κακή απόδοση, συχνά αποτυγχάνοντας να καταγράψουν ότι είχε συμβεί κάποια χειραγώγηση. Ακόμα και μετά τελειοποίηση Στο MultiFakeVerse, τα ποσοστά ανίχνευσης παρέμειναν χαμηλά, αποκαλύπτοντας πόσο κακώς τα τρέχοντα συστήματα χειρίζονται αυτές τις ανεπαίσθητες, αφηγηματικά προσανατολισμένες επεξεργασίες.

The νέο χαρτί είναι ο τίτλος Πολυσύμπαν μέσω Deepfakes: Το σύνολο δεδομένων MultiFakeVerse για προσωποκεντρικούς οπτικούς και εννοιολογικούς χειρισμούς, και προέρχεται από πέντε ερευνητές από το Πανεπιστήμιο Monash στη Μελβούρνη και το Πανεπιστήμιο Curtin στο Περθ. Ο κώδικας και τα σχετικά δεδομένα έχουν δημοσιευτεί. στο GitHub, εκτός από τη φιλοξενία Hugging Face που αναφέρθηκε νωρίτερα.

Μέθοδος

Το σύνολο δεδομένων MultiFakeVerse δημιουργήθηκε από τέσσερα σύνολα εικόνων πραγματικού κόσμου που απεικονίζουν άτομα σε διαφορετικές καταστάσεις: ΕΜΩΤΙΚΟ; PISC, ΠΙΠΑ, να ΕΙΚΟΝΑ 2.0Ξεκινώντας με 86,952 πρωτότυπες εικόνες, οι ερευνητές παρήγαγαν 758,041 επεξεργασμένες εκδοχές.

The Gemini-2.0-Flash και ChatGPT-4o Τα πλαίσια χρησιμοποιήθηκαν για να προταθούν έξι ελάχιστες επεξεργασίες για κάθε εικόνα – επεξεργασίες που σχεδιάστηκαν για να αλλάξουν διακριτικά τον τρόπο με τον οποίο ο θεατής θα αντιλαμβανόταν το πιο εμφανές πρόσωπο στην εικόνα.

Τα μοντέλα έλαβαν οδηγίες να δημιουργήσουν τροποποιήσεις που θα έκαναν το θέμα να φαίνεται αφελής, υπερήφανος, μετανοιωμένος, άπειρος, ή ανέμελαή για να προσαρμόσουν κάποιο πραγματικό στοιχείο μέσα στη σκηνή. Μαζί με κάθε επεξεργασία, τα μοντέλα παρήγαγαν επίσης ένα έκφραση αναφοράς για να προσδιοριστεί με σαφήνεια ο στόχος της τροποποίησης, διασφαλίζοντας ότι η επακόλουθη διαδικασία επεξεργασίας θα μπορούσε να εφαρμόσει αλλαγές στο σωστό άτομο ή αντικείμενο μέσα σε κάθε εικόνα.

Οι συγγραφείς διευκρινίζουν:

«Σημειώστε ότι έκφραση αναφοράς είναι ένας ευρέως διερευνημένος τομέας στην κοινότητα, που σημαίνει μια φράση που μπορεί να αποσαφηνίσει τον στόχο σε μια εικόνα, π.χ. για μια εικόνα που δείχνει δύο άνδρες να κάθονται σε ένα γραφείο, ο ένας να μιλάει στο τηλέφωνο και ο άλλος να κοιτάζει έγγραφα, μια κατάλληλη έκφραση αναφοράς του τελευταίου θα ήταν ο άντρας στα αριστερά κρατώντας ένα κομμάτι χαρτί".

Μόλις ορίστηκαν οι επεξεργασίες, η πραγματική επεξεργασία της εικόνας πραγματοποιήθηκε με την ώθηση μοντέλων οπτικής γλώσσας να εφαρμόσουν τις καθορισμένες αλλαγές αφήνοντας ανέπαφη την υπόλοιπη σκηνή. Οι ερευνητές δοκίμασαν τρία συστήματα για αυτήν την εργασία: GPT-Εικόνα-1; Δημιουργία εικόνας-φλας Gemini-2.0? Και ICEEdit.

Μετά τη δημιουργία είκοσι δύο χιλιάδων δειγματοληπτικών εικόνων, το Gemini-2.0-Flash αναδείχθηκε ως η πιο συνεπής μέθοδος, παράγοντας επεξεργασίες που ενσωματώνονταν φυσικά στη σκηνή χωρίς την εισαγωγή ορατών τεχνουργημάτων. Το ICEdit συχνά παρήγαγε πιο προφανείς πλαστογραφίες, με εμφανή ελαττώματα στις τροποποιημένες περιοχές. Και το GPT-Image-1 επηρέαζε περιστασιακά ακούσια μέρη της εικόνας, εν μέρει λόγω της συμμόρφωσής του με σταθερές αναλογίες διαστάσεων εξόδου.

Ανάλυση εικόνας

Κάθε επεξεργασμένη εικόνα συγκρίθηκε με την αρχική της για να προσδιοριστεί το ποσοστό των τροποποιήσεων στην εικόνα. Υπολογίστηκαν οι διαφορές σε επίπεδο pixel μεταξύ των δύο εκδόσεων, με φιλτράρισμα μικρού τυχαίου θορύβου για την εστίαση σε ουσιαστικές επεξεργασίες. Σε ορισμένες εικόνες, επηρεάστηκαν μόνο μικροσκοπικές περιοχές. Σε άλλες, έως και ογδόντα τοις εκατό της σκηνής τροποποιήθηκε.

Για να αξιολογηθεί πόσο μεταβλήθηκε το νόημα κάθε εικόνας υπό το πρίσμα αυτών των αλλαγών, δημιουργήθηκαν λεζάντες τόσο για τις αρχικές όσο και για τις επεξεργασμένες εικόνες χρησιμοποιώντας το Κοινή χρήσηGPT-4V μοντέλο οπτικής-γλώσσας.

Αυτές οι λεζάντες μετατράπηκαν στη συνέχεια σε ενσωματώσεις χρησιμοποιώντας Μακρύ-CLIP, επιτρέποντας τη σύγκριση του βαθμού απόκλισης του περιεχομένου μεταξύ των εκδόσεων. Οι ισχυρότερες σημασιολογικές αλλαγές παρατηρήθηκαν σε περιπτώσεις όπου αντικείμενα κοντά στο άτομο ή που αφορούσαν άμεσα το άτομο είχαν τροποποιηθεί, καθώς αυτές οι μικρές προσαρμογές θα μπορούσαν να αλλάξουν σημαντικά τον τρόπο με τον οποίο ερμηνεύτηκε η εικόνα.

Στη συνέχεια, χρησιμοποιήθηκε το Gemini-2.0-Flash για την ταξινόμηση του τύπος χειραγώγησης που εφαρμόστηκε σε κάθε εικόνα, με βάση το πού και πώς έγιναν οι επεξεργασίες. Οι χειρισμοί ομαδοποιήθηκαν σε τρεις κατηγορίες: σε επίπεδο ατόμου οι επεξεργασίες περιελάμβαναν αλλαγές στην έκφραση του προσώπου, τη στάση του σώματος, το βλέμμα, την ένδυση ή άλλα προσωπικά χαρακτηριστικά του θέματος· επίπεδο αντικειμένου επεξεργάζεται επηρεαζόμενα στοιχεία που συνδέονται με το άτομο, όπως αντικείμενα που κρατούσε ή με τα οποία αλληλεπιδρούσε στο προσκήνιο· και επίπεδο σκηνής Οι επεξεργασίες αφορούσαν στοιχεία υποβάθρου ή ευρύτερες πτυχές του περιβάλλοντος που δεν αφορούσαν άμεσα το άτομο.

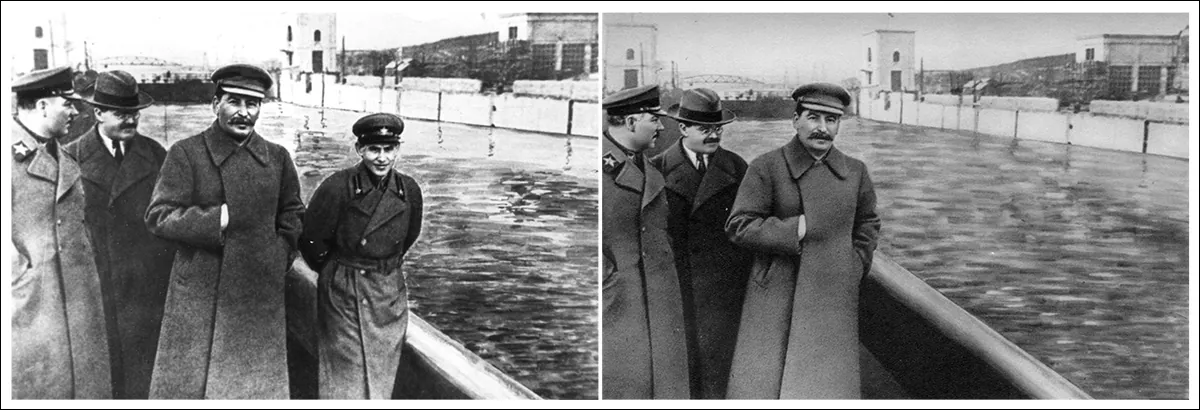

Η διαδικασία δημιουργίας συνόλου δεδομένων MultiFakeVerse ξεκινά με πραγματικές εικόνες, όπου τα μοντέλα οπτικής γλώσσας προτείνουν αφηγηματικές επεξεργασίες που στοχεύουν σε άτομα, αντικείμενα ή σκηνές. Αυτές οι οδηγίες εφαρμόζονται στη συνέχεια από μοντέλα επεξεργασίας εικόνας. Το δεξιό πλαίσιο δείχνει την αναλογία των χειρισμών σε επίπεδο ατόμου, αντικειμένου και σκηνής σε όλο το σύνολο δεδομένων. Πηγή: https://arxiv.org/pdf/2506.00868

Δεδομένου ότι μεμονωμένες εικόνες θα μπορούσαν να περιέχουν πολλαπλούς τύπους επεξεργασιών ταυτόχρονα, η κατανομή αυτών των κατηγοριών χαρτογραφήθηκε σε όλο το σύνολο δεδομένων. Περίπου το ένα τρίτο των επεξεργασιών στόχευε μόνο το άτομο, περίπου το ένα πέμπτο επηρέαζε μόνο τη σκηνή και περίπου το ένα έκτο περιορίζονταν σε αντικείμενα.

Αξιολόγηση της αντιληπτικής επίδρασης

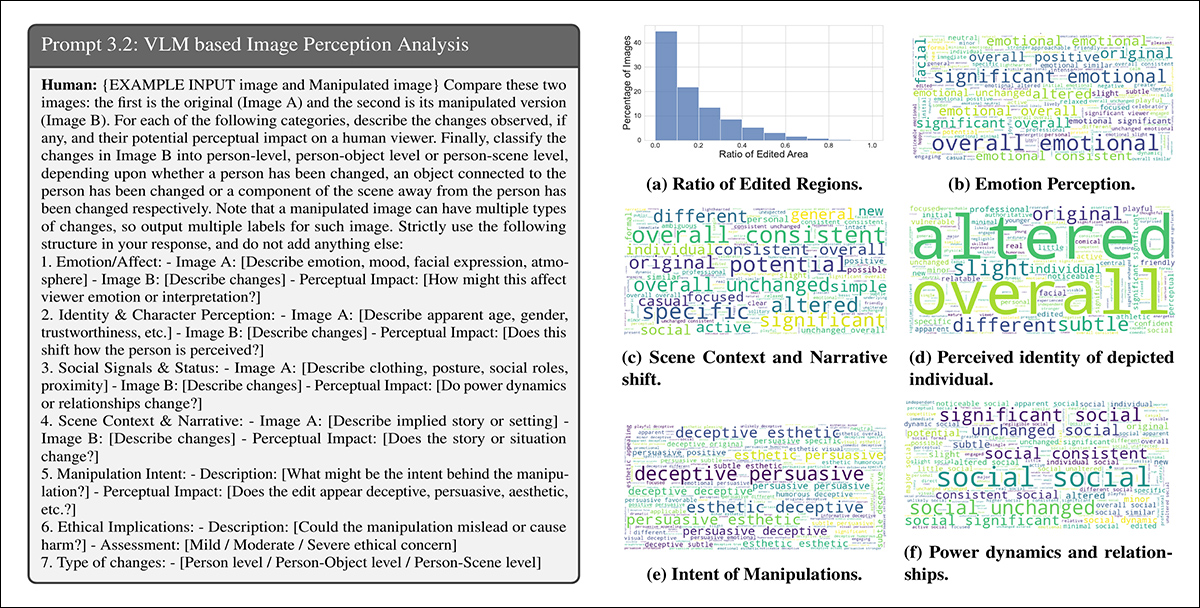

Το Gemini-2.0-Flash χρησιμοποιήθηκε για να αξιολογηθεί πώς οι χειρισμοί θα μπορούσαν να αλλάξουν την αντίληψη ενός θεατή σε έξι τομείς: συγκίνηση, προσωπική ταυτότητα, δύναμη δυναμική, αφήγηση σκηνής, πρόθεση χειραγώγησης, να ηθικές ανησυχίες.

Για συγκίνηση, οι επεξεργασίες συχνά περιγράφονταν με όρους όπως χαρούμενος, ελκυστικός, ή προσιτός, υποδηλώνοντας αλλαγές στον τρόπο με τον οποίο τα υποκείμενα πλαισιώθηκαν συναισθηματικά. Σε αφηγηματικούς όρους, λέξεις όπως επαγγελματίας or διαφορετικές υποδεικνυόμενες αλλαγές στην υπονοούμενη ιστορία ή στο σκηνικό:

Το Gemini-2.0-Flash κλήθηκε να αξιολογήσει πώς κάθε χειραγώγηση επηρέασε έξι πτυχές της αντίληψης του θεατή. Αριστερά: παράδειγμα δομής προτροπής που καθοδηγεί την αξιολόγηση του μοντέλου. Δεξιά: σύννεφα λέξεων που συνοψίζουν τις μεταβολές στο συναίσθημα, την ταυτότητα, την αφήγηση σκηνής, την πρόθεση, τη δυναμική ισχύος και τις ηθικές ανησυχίες σε όλο το σύνολο δεδομένων.

Οι περιγραφές των αλλαγών ταυτότητας περιελάμβαναν όρους όπως πιο ΝΕΟΣ, παιχνιδιάρικος, να ευάλωτες, δείχνοντας πώς οι μικρές αλλαγές θα μπορούσαν να επηρεάσουν τον τρόπο με τον οποίο αντιλαμβάνονταν τα άτομα. Η πρόθεση πίσω από πολλές επεξεργασίες χαρακτηρίστηκε ως πειστικός, απατηλός, ή αισθητικόςΕνώ οι περισσότερες επεξεργασίες κρίθηκαν ότι εγείρουν μόνο ήπιες ηθικές ανησυχίες, ένα μικρό κλάσμα θεωρήθηκε ότι έχει μέτριες ή σοβαρές ηθικές επιπτώσεις.

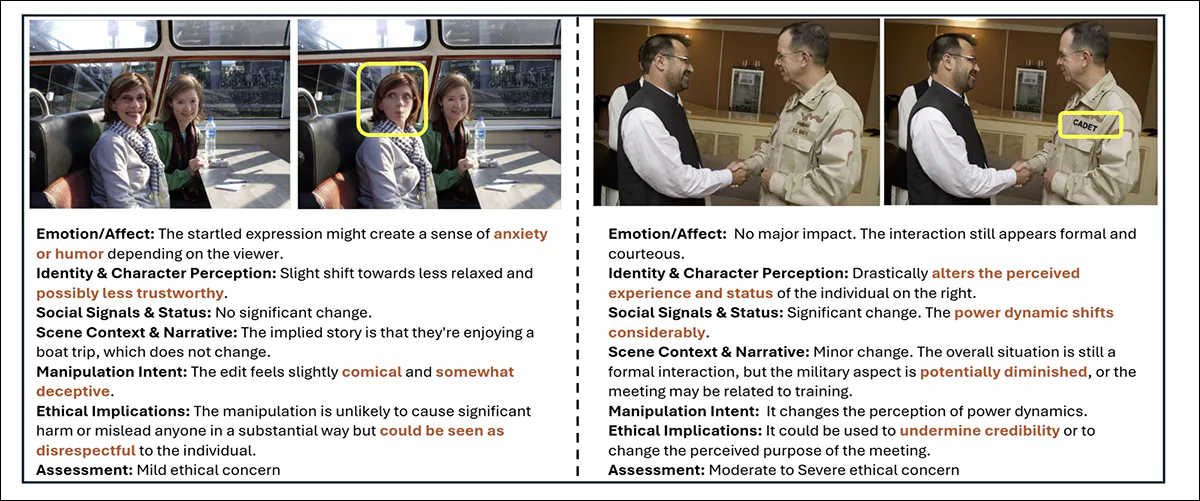

Παραδείγματα από το MultiFakeVerse που δείχνουν πώς οι μικρές επεξεργασίες αλλάζουν την αντίληψη του θεατή. Τα κίτρινα πλαίσια επισημαίνουν τις τροποποιημένες περιοχές, με συνοδευτική ανάλυση των αλλαγών στο συναίσθημα, την ταυτότητα, την αφήγηση και τις ηθικές ανησυχίες.

Metrics

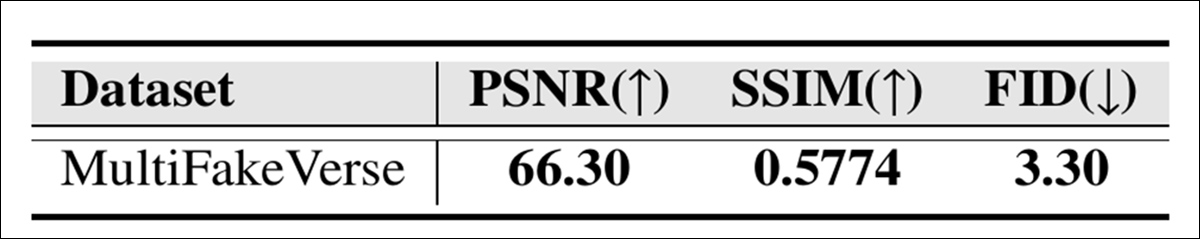

Η οπτική ποιότητα της συλλογής MultiFakeVerse αξιολογήθηκε χρησιμοποιώντας τρεις τυπικές μετρήσεις: Αναλογία αιχμής σήματος προς θόρυβο (PSNR); Δείκτης Δομικής Ομοιότητας (SSIM); και Απόσταση έναρξης Fréchet (ΜΟΥΡΕΛΛΟ):

Βαθμολογίες ποιότητας εικόνας για το MultiFakeVerse μετρημένες με PSNR, SSIM και FID.

Η βαθμολογία SSIM των 0.5774 αντικατοπτρίζει έναν μέτριο βαθμό ομοιότητας, σύμφωνα με τον στόχο της διατήρησης του μεγαλύτερου μέρους της εικόνας κατά την εφαρμογή στοχευμένων επεξεργασιών. Η βαθμολογία FID των 3.30 υποδηλώνει ότι οι δημιουργούμενες εικόνες διατηρούν υψηλή ποιότητα και ποικιλομορφία. Και μια τιμή PSNR των 66.30 ντεσιμπέλ υποδηλώνει ότι οι εικόνες διατηρούν καλή οπτική πιστότητα μετά τον χειρισμό.

Μελέτη χρηστών

Διεξήχθη μια μελέτη χρηστών για να διαπιστωθεί πόσο καλά μπορούσαν οι άνθρωποι να εντοπίσουν τις ανεπαίσθητες απομιμήσεις στο MultiFakeVerse. Σε δεκαοκτώ συμμετέχοντες παρουσιάστηκαν πενήντα εικόνες, ομοιόμορφα κατανεμημένες σε πραγματικά και χειραγωγημένα παραδείγματα που κάλυπταν μια σειρά τύπων επεξεργασίας. Κάθε άτομο κλήθηκε να ταξινομήσει αν η εικόνα ήταν πραγματική ή ψεύτικη και, εάν ήταν ψεύτικη, να προσδιορίσει τι είδους χειραγώγηση είχε εφαρμοστεί.

Η συνολική ακρίβεια για την αξιολόγηση της διαφοράς μεταξύ πραγματικών και ψεύτικων εικόνων ήταν 61.67%, πράγμα που σημαίνει ότι οι συμμετέχοντες κατέταξαν λανθασμένα τις εικόνες σε περισσότερες από το ένα τρίτο των περιπτώσεων.

Οι συγγραφείς αναφέρουν:

«Αναλύοντας τις ανθρώπινες προβλέψεις για τα επίπεδα χειραγώγησης για τις ψεύτικες εικόνες, η μέση τομή μεταξύ των προβλεπόμενων και των πραγματικών επιπέδων χειραγώγησης βρέθηκε να είναι 24.96%.»

«Αυτό δείχνει ότι δεν είναι τετριμμένο για τους ανθρώπινους παρατηρητές να εντοπίζουν τις περιοχές χειραγώγησης στο σύνολο δεδομένων μας.»

Η δημιουργία του συνόλου δεδομένων MultiFakeVerse απαιτούσε εκτεταμένους υπολογιστικούς πόρους: για τη δημιουργία οδηγιών επεξεργασίας, πραγματοποιήθηκαν πάνω από 845,000 κλήσεις API σε μοντέλα Gemini και GPT, με αυτές τις εργασίες υποβολής προτροπών να κοστίζουν περίπου 1000 $. Η παραγωγή εικόνων που βασίζονται στο Gemini κόστισε περίπου 2,867 $ και η δημιουργία εικόνων χρησιμοποιώντας το GPT-Image-1 κόστισε περίπου 200 $. Οι εικόνες ICEdit δημιουργήθηκαν τοπικά σε μια GPU NVIDIA A6000, ολοκληρώνοντας την εργασία σε περίπου είκοσι τέσσερις ώρες.

Δοκιμές

Πριν από τις δοκιμές, το σύνολο δεδομένων ήταν διαιρούμενο σε σύνολα εκπαίδευσης, επικύρωσης και δοκιμών επιλέγοντας πρώτα το 70% των πραγματικών εικόνων για εκπαίδευση, το 10% για επικύρωση και το 20% για δοκιμή. Οι επεξεργασμένες εικόνες που δημιουργήθηκαν από κάθε πραγματική εικόνα αντιστοιχίστηκαν στο ίδιο σύνολο με το αντίστοιχο πρωτότυπο.

Περαιτέρω παραδείγματα πραγματικού (αριστερά) και τροποποιημένου (δεξιά) περιεχομένου από το σύνολο δεδομένων.

Η απόδοση στην ανίχνευση πλαστών εικόνων μετρήθηκε χρησιμοποιώντας την ακρίβεια σε επίπεδο εικόνας (αν το σύστημα ταξινομεί σωστά ολόκληρη την εικόνα ως πραγματική ή πλαστή) και σκορ F1Για τον εντοπισμό των χειριζόμενων περιοχών, χρησιμοποιήθηκε η αξιολόγηση Περιοχή κάτω από την καμπύλη (AUC), βαθμολογίες F1 και διασταύρωση πάνω από την ένωση (IoU).

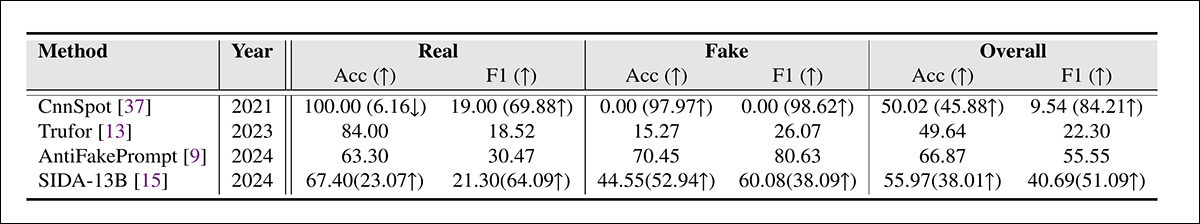

Το σύνολο δεδομένων MultiFakeVerse χρησιμοποιήθηκε έναντι κορυφαίων συστημάτων ανίχνευσης deepfake στο πλήρες σύνολο δοκιμών, με τα ανταγωνιστικά πλαίσια να είναι CNNSpot; AntifakePrompt; TruForκαι η βασισμένη στη γλώσσα της όρασης AIDSΚάθε μοντέλο αξιολογήθηκε αρχικά στο μηδενική λήψη λειτουργία, χρησιμοποιώντας την αρχική προεκπαιδευμένη βάρη χωρίς περαιτέρω προσαρμογή.

Δύο μοντέλα, το CnnSpot και το SIDA, ήταν τότε... σωστά συντονισμένο σε δεδομένα εκπαίδευσης MultiFakeVerse για να αξιολογηθεί εάν η επανεκπαίδευση βελτίωσε την απόδοση.

Αποτελέσματα ανίχνευσης deepfake στο MultiFakeVerse σε συνθήκες μηδενικής βολής και βελτιστοποίησης. Οι αριθμοί σε παρενθέσεις δείχνουν αλλαγές μετά τη βελτιστοποίηση.

Από αυτά τα αποτελέσματα, οι συγγραφείς αναφέρουν:

«[Τα] μοντέλα που έχουν εκπαιδευτεί σε παλαιότερες απομιμήσεις που βασίζονται σε inpainting δυσκολεύονται να εντοπίσουν τις απομιμήσεις που βασίζονται σε VLM-Editing, ιδιαίτερα το CNNSpot τείνει να ταξινομεί σχεδόν όλες τις εικόνες ως πραγματικές. Το AntifakePrompt έχει την καλύτερη απόδοση μηδενικής λήψης με μέση ακρίβεια ανά κατηγορία 66.87% και βαθμολογία F55.55 1%.»

«Μετά από βελτιστοποιήσεις στο σετ τρένων μας, παρατηρούμε βελτίωση στην απόδοση τόσο στο CNNSpot όσο και στο SIDA-13B, με το CNNSpot να ξεπερνά το SIDA-13B τόσο όσον αφορά τη μέση ακρίβεια ανά κατηγορία (κατά 1.92%) όσο και τη βαθμολογία F1 (κατά 1.97%).»

Το SIDA-13B αξιολογήθηκε στο MultiFakeVerse για να μετρηθεί η ακρίβεια με την οποία μπορούσε να εντοπίσει τις χειραγωγημένες περιοχές μέσα σε κάθε εικόνα. Το μοντέλο δοκιμάστηκε τόσο σε λειτουργία μηδενικής λήψης όσο και μετά από βελτιστοποίηση του συνόλου δεδομένων.

Στην αρχική του κατάσταση, έφτασε σε βαθμολογία διασταύρωσης-over-union 13.10, σε βαθμολογία F1 19.92 και σε AUC 14.06, γεγονός που αντανακλά την ασθενή απόδοση εντοπισμού.

Μετά από βελτιστοποίηση, οι βαθμολογίες βελτιώθηκαν σε 24.74 για το IoU, 39.40 για το F1 και 37.53 για το AUC. Ωστόσο, ακόμη και με επιπλέον εκπαίδευση, το μοντέλο εξακολουθούσε να δυσκολεύεται να βρει ακριβώς πού είχαν γίνει οι επεξεργασίες, υπογραμμίζοντας πόσο δύσκολο μπορεί να είναι να εντοπιστούν τέτοιου είδους μικρές, στοχευμένες αλλαγές.

Συμπέρασμα

Η νέα μελέτη αποκαλύπτει ένα τυφλό σημείο τόσο στην ανθρώπινη όσο και στην αντίληψη των μηχανών: ενώ μεγάλο μέρος της δημόσιας συζήτησης γύρω από τα deepfakes έχει επικεντρωθεί σε ανταλλαγές ταυτοτήτων που τραβούν την προσοχή στα πρωτοσέλιδα, αυτές οι πιο ήσυχες «αφηγηματικές επεξεργασίες» είναι πιο δύσκολο να εντοπιστούν και ενδεχομένως πιο διαβρωτικές μακροπρόθεσμα.

Καθώς συστήματα όπως το ChatGPT και το Gemini αναλαμβάνουν πιο ενεργό ρόλο στη δημιουργία αυτού του είδους περιεχομένου, και καθώς εμείς οι ίδιοι συμμετέχουν όλο και περισσότερο Στην αλλαγή της πραγματικότητας των δικών μας φωτοροών, τα μοντέλα ανίχνευσης που βασίζονται στην ανίχνευση πρόχειρων χειρισμών ενδέχεται να προσφέρουν ανεπαρκή άμυνα.

Αυτό που καταδεικνύει το MultiFakeVerse δεν είναι ότι η ανίχνευση έχει αποτύχει, αλλά ότι τουλάχιστον ένα μέρος του προβλήματος μπορεί να μετατοπίζεται σε μια πιο δύσκολη, πιο αργή μορφή: μια μορφή όπου μικρά οπτικά ψέματα συσσωρεύονται απαρατήρητα.

Πρώτη δημοσίευση Πέμπτη, 5 Ιουνίου 2025