Τεχνητή νοημοσύνη

Λιγότερο είναι Περισσότερο: Γιατί η Ανακτηση Λιγοτερων Εγγραφων Μπορει να Βελτιωσει τις Απαντησεις του AI

Retrieval-Augmented Generation (RAG) είναι μια προσέγγιση για την κατασκευή συστημάτων AI που συνδυάζει ένα μοντέλο γλώσσας με μια εξωτερική πηγή γνώσεων. Σε απλά λόγια, το AI πρώτα αναζητά σχετικά έγγραφα (όπως άρθρα ή σελίδες ιστού) που σχετίζονται με μια ερώτηση χρήστη και στη συνέχεια χρησιμοποιεί αυτά τα έγγραφα για να παράγει μια πιο ακριβή απάντηση. Αυτή η μέθοδος έχει γιορταστεί για τη βοήθεια μεγάλων μοντέλων γλώσσας (LLMs) να παραμείνουν πραγματικά και να μειώσουν τις ψευδαισθήσεις αναγκάζοντας τις απαντήσεις τους να βασίζονται σε πραγματικά δεδομένα.

Ενστικτωδώς, κάποιος μπορεί να σκεφτεί ότι όσο περισσότερα έγγραφα ανακτά το AI, τόσο καλύτερα ενημερωμένη θα είναι η απάντησή του. Ωστόσο, πρόσφατη έρευνα υποδηλώνει μια εκπληκτική στροφή: όταν πρόκειται για την παροχή πληροφοριών σε ένα AI, μερικές φορές λιγότερο είναι περισσότερο.

Λιγότερα Έγγραφα, Καλύτερες Απαντήσεις

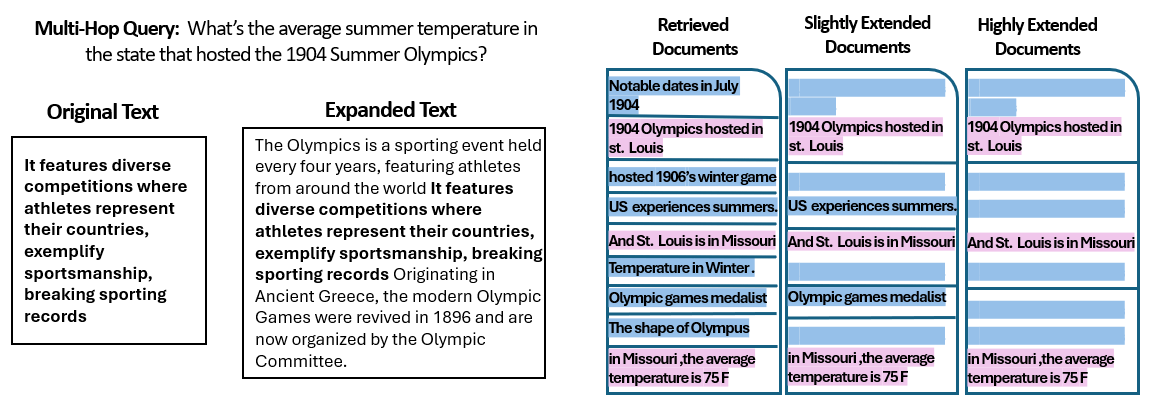

Μια νέα μελέτη από ερευνητές στο Πανεπιστήμιο της Ιερουσαλήμ εξέτασε πώς ο αριθμός των εγγράφων που δίνονται σε ένα σύστημα RAG επηρεάζει την απόδοσή του. Κρίσιμο ήταν ότι διατήρησαν το συνολικό ποσό κειμένου σταθερό – σημαίνοντας ότι αν λιγότερα έγγραφα παρέχονταν, αυτά τα έγγραφα ήταν ελαφρώς διευρυμένα για να γεμίσουν το ίδιο μήκος με πολλά έγγραφα. Αυτό το τρόπο, οποιαδήποτε διαφορά απόδοσης θα μπορούσε να αποδοθεί στον αριθμό των εγγράφων και όχι απλώς στο ότι το εισαγόμενο ήταν συντομότερο.

Οι ερευνητές χρησιμοποίησαν ένα σύνολο ερωτήσεων-απαντήσεων (MuSiQue) με ερωτήσεις τριβής, κάθε eine από τις οποίες ήταν αρχικά ζευγαρωμένη με 20 παραγράφους του Wikipedia (μόνο μερικά από τα οποία περιείχαν πραγματικά την απάντηση, ενώ τα υπόλοιπα ήταν distractors). Βγάζοντας τον αριθμό των εγγράφων από 20 xuống σε μόλις τα 2-4 πραγματικά σχετικά – και συμπληρώνοντάς τα με λίγο επιπλέον контекστο για να διατηρήσουν ένα σταθερό μήκος – δημιούργησαν σενάρια όπου το AI είχε λιγότερα κομμάτια υλικού να εξετάσει, αλλά ακόμα περίπου το ίδιο συνολικό κείμενο να διαβάσει.

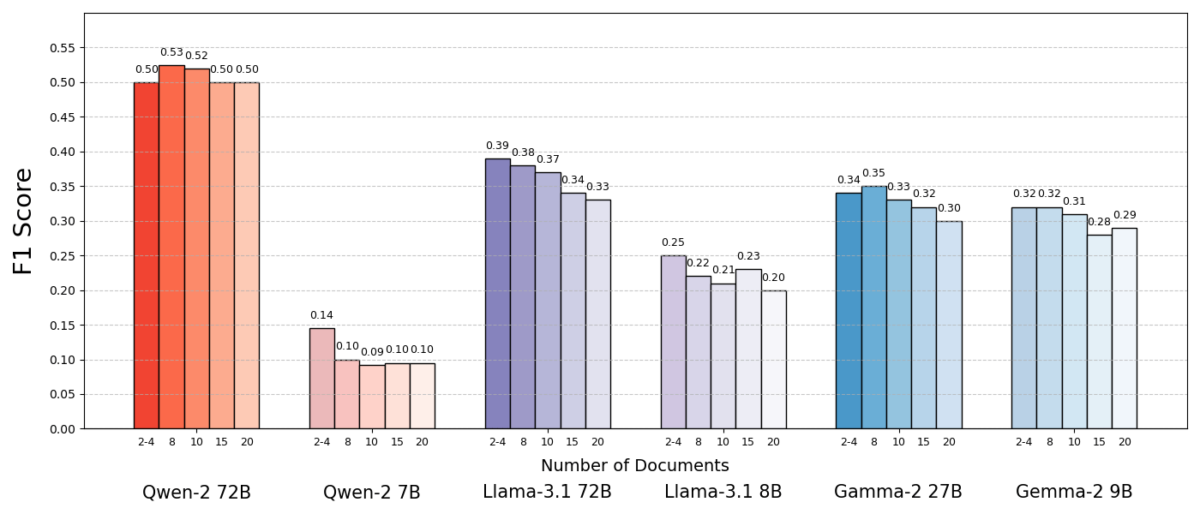

Τα αποτελέσματα ήταν εντυπωσιακά. Σε meisten περιπτώσεις, τα μοντέλα AI απάντησαν με μεγαλύτερη ακρίβεια όταν τους δόθηκαν λιγότερα έγγραφα αντί για το πλήρες σύνολο. Η απόδοση βελτιώθηκε σημαντικά – σε ορισμένες περιπτώσεις μέχρι και 10% σε ακρίβεια (F1 score) όταν το σύστημα χρησιμοποιούσε μόνο τα λίγα υποστηρικτικά έγγραφα αντί για μια μεγάλη συλλογή. Αυτή η αντίθετη βελτίωση παρατηρήθηκε σε διάφορα ανοιχτά μοντέλα γλώσσας, συμπεριλαμβανομένων παραλλαγών του Meta’s Llama και άλλων, υποδεικνύοντας ότι το φαινόμενο δεν είναι συνδεδεμένο με ένα μόνο μοντέλο AI.

Ένα μοντέλο (Qwen-2) ήταν μια αξιοσημείωτη εξαίρεση που χειρίστηκε πολλά έγγραφα χωρίς πτώση στο σκορ, αλλά σχεδόν όλα τα μοντέλα που δοκιμάστηκαν εκτέλεσαν καλύτερα με λιγότερα έγγραφα συνολικά. Με άλλα λόγια, η προσθήκη περισσότερου αναφορικού υλικού πέρα από τα κλειδιά σχετικά κομμάτια στην πραγματικότητα επιδείνωσε την απόδοσή τους περισσότερο συχνά από ό,τι βοήθησε.

Source: Levy et al.

Γιατί είναι αυτό μια έκπληξη; Τυπικά, συστήματα RAG σχεδιάζονται με την υπόθεση ότι η ανάκτηση ενός ευρύτερου συνόλου πληροφοριών μπορεί μόνο να βοηθήσει το AI –毕竟, αν η απάντηση δεν είναι στο πρώτο έγγραφο, μπορεί να είναι στο δέκατο ή εικοστό.

Αυτή η μελέτη ανατρέπει αυτό το σενάριο, αποδεικνύοντας ότι η αδιακρίτως σωρός επιπλέον εγγράφων μπορεί να πυροδοτήσει. Ακόμη και όταν το συνολικό μήκος κειμένου κρατήθηκε σταθερό, η απλή παρουσία πολλών διαφορετικών εγγράφων (κάθε ένα με το δικό του контекστο και ιδιαιτερότητες) έκανε την εργασία ερωτήσεων-απαντήσεων πιο δύσκολη για το AI. Φαίνεται ότι πέρα από ένα certo σημείο, κάθε επιπλέον έγγραφο εισήγαγε περισσότερο θόρυβο παρά σήμα, confusig το μοντέλο και εμποδίζοντας την ικανότητά του να εξαγάγει την σωστή απάντηση.

Γιατί Λιγότερο Μπορεί να είναι Περισσότερο σε RAG

Αυτό το “λιγότερο είναι περισσότερο” αποτέλεσμα έχει νόημα όταν λάβουμε υπόψη πώς τα μοντέλα γλώσσας AI επεξεργάζονται πληροφορίες. Όταν ένα AI δίνεται μόνο τα πιο σχετικά έγγραφα, ο контекτος που βλέπει είναι εστιασμένος και ελεύθερος από αποersions, πολύ σαν ένα μαθητή που έχει λάβει μόνο τις σωστές σελίδες για μελέτη.

Στη μελέτη, τα μοντέλα εκτέλεσαν σημαντικά καλύτερα όταν τους δόθηκαν μόνο τα υποστηρικτικά έγγραφα, με μη σχετικά υλικό αφαιρεμένο. Ο εναπομείνας контекτος δεν ήταν μόνο συντομότερος αλλά και καθαρότερος – περιείχε γεγονότα που έδειχναν直接 στην απάντηση και τίποτα άλλο. Με λιγότερα έγγραφα να χειρίζονται, το μοντέλο μπορούσε να αφιερώσει την πλήρη προσοχή του στα σχετικά στοιχεία, καθιστώντας το λιγότερο πιθανό να απομακρύνει ή να συγχύσει.

Από την άλλη πλευρά, όταν πολλά έγγραφα ανακτούνταν, το AI έπρεπε να διεισδύσει σε ένα μείγμα σχετικών και μη σχετικών περιεχομένων. Συχνά αυτά τα επιπλέον έγγραφα ήταν “παρόμοια αλλά μη σχετικά” – μοιράζονταν ένα θέμα ή λέξεις-κλειδιά με την ερώτηση αλλά δεν περιείχαν στην πραγματικότητα την απάντηση. Τέτοιο περιεχόμενο μπορεί να απομακρύνει το μοντέλο. Το AI μπορεί να σπαταλήσει προσπάθεια προσπαθώντας να συνδέσει τα σημεία σε έγγραφα που δεν οδηγούν σε μια σωστή απάντηση, ή χειρότερα, μπορεί να συνδυάσει πληροφορίες από πολλές πηγές λανθασμένα. Αυξάνει τον κίνδυνο ψευδαισθήσεων – περιπτώσεων όπου το AI γεννάει μια απάντηση που ακούγεται πιθανή αλλά δεν βασίζεται σε καμία單η πηγή.

Στην ουσια, η παροχή πολλών εγγράφων στο μοντέλο μπορεί να αραιώσει τις χρήσιμες πληροφορίες και να εισαγάγει αντικρουόμενα λεπτομέρειες, καθιστώντας το πιο δύσκολο για το AI να αποφασίσει τι είναι αλήθεια.

Ενδιαφέρον είναι ότι οι ερευνητές βρήκαν ότι αν τα επιπλέον έγγραφα ήταν προφανώς μη σχετικά (για παράδειγμα, τυχαίο μη σχετικό κείμενο), τα μοντέλα ήταν καλύτερα στο να τα αγνοούν. Η πραγματική δυσκολία έρχεται από το distractor δεδομένων που φαίνεται σχετικό: όταν όλα τα ανακτημένα κείμενα είναι σε παρόμοια θέματα, το AI υποθέτει ότι πρέπει να τα χρησιμοποιήσει όλα, και μπορεί να παλέψει να πει ποια στοιχεία είναι στην πραγματικότητα σημαντικά. Αυτό συμφωνεί με την παρατήρηση της μελέτης ότι τυχαίοι distractors προκάλεσαν λιγότερη σύγχυση από πραγματικούς distractors στην είσοδο. Το AI μπορεί να φιλτράρει το προφανές ανοησία, αλλά λεπτά εκτός θέματος πληροφορίες είναι μια σlick παγίδα – σέρνει κάτω με το πρόσχημα της σχετικότητας και απομακρύνει την απάντηση. Βγάζοντας τον αριθμό των εγγράφων μόνο στα πραγματικά απαραίτητα, αποφεύγουμε να ρίχνουμε αυτές τις παγίδες από την αρχή.

Υπάρχει επίσης ένα πρακτικό όφελος: η ανάκτηση και επεξεργασία λιγοτέρων εγγράφων μειώνει την υπολογιστική επιβάρυνση για ένα σύστημα RAG. Κάθε έγγραφο που ανακτάται πρέπει να αναλυθεί (εμφυτεύεται, διαβάζεται και προσεχθεί από το μοντέλο), το οποίο χρησιμοποιεί χρόνο και υπολογιστικούς πόρους. Η εξάλειψη των περιττών εγγράφων κάνει το σύστημα πιο αποτελεσματικό – μπορεί να βρει απαντήσεις γρηγορότερα και με χαμηλότερο κόστος. Σε σενάρια όπου η ακρίβεια βελτιώθηκε με την εστίαση σε λιγότερες πηγές, κερδίζουμε ένα win-win: καλύτερες απαντήσεις και μια λεπτότερη, πιο αποτελεσματική διαδικασία.

Source: Levy et al.

Επαναεξέταση του RAG: Μελλοντικές Κατευθύνσεις

Αυτή η νέα απόδειξη ότι η ποιότητα συχνά νικά την ποσότητα στην ανάκτηση έχει σημαντικές επιπτώσεις για το μέλλον των συστημάτων AI που βασίζονται σε εξωτερικές γνώσεις. Υποδηλώνει ότι οι σχεδιαστές συστημάτων RAG πρέπει να προτεραιοποιήσουν την έξυπνη φιλτράρισή και κατάταξη εγγράφων πάνω από την καθαρή ποσότητα. Αντί να ανακτούν 100 πιθανές περικοπές και να ελπίζουν ότι η απάντηση είναι θαμμένη κάπου εκεί, μπορεί να είναι πιο σοφό να ανακτούν μόνο τις κορυφαίες highly σχετικές.

Οι συγγραφείς της μελέτης τονίζουν την ανάγκη για μεθόδους ανάκτησης να “ισορροπήσουν τη σχετικότητα και την ποικιλία” στις πληροφορίες που παρέχουν σε ένα μοντέλο. Με άλλα λόγια, θέλουμε να παρέχουμε αρκετή κάλυψη του θέματος για να απαντήσουμε στην ερώτηση, αλλά όχι τόσο που τα βασικά γεγονότα να πνίγονται σε μια θάλασσα περιττού κειμένου.

Προχωρώντας, οι ερευνητές είναι πιθανό να εξερευνήσουν τεχνικές που βοηθούν τα μοντέλα AI να χειρίζονται πολλά έγγραφα με περισσότερη χάρη. Μια προσέγγιση είναι η ανάπτυξη καλύτερων συστημάτων ανάκτησης ή re-rankers που μπορούν να αναγνωρίσουν ποια έγγραφα προσθέτουν πραγματικά αξία και ποια μόνο εισάγουν σύγκρουση. Μια άλλη γωνία είναι η βελτίωση των ίδιων των μοντέλων γλώσσας: αν ένα μοντέλο (όπως το Qwen-2) κατάφερε να χειριστεί πολλά έγγραφα χωρίς να χάσει ακρίβεια, το εξέταση του πώς εκπαιδεύτηκε ή δομήθηκε θα μπορούσε να προσφέρει ενδείξεις για το πώς να κάνει άλλα μοντέλα πιο robust. Ίσως μελλοντικά μεγάλα μοντέλα γλώσσας θα ενσωματώσουν μηχανισμούς για να αναγνωρίσουν όταν δύο πηγές λένε την ίδια πράγμα (ή αντικρούουν η μια την άλλη) και να εστιάσουν ανάλογα. Ο στόχος θα ήταν να επιτρέψουν στα μοντέλα να χρησιμοποιήσουν eine πλούσια ποικιλία πηγών χωρίς να πέσουν θύματα σύγχυσης – αποτελεσματικά παίρνοντας το καλύτερο και από τις δύο πλευρές (πλάτος πληροφοριών και σαφήνεια εστίασης).

Είναι επίσης αξιοσημείωτο ότι καθώς συστήματα AI κερδίζουν μεγαλύτερα παράθυρα контекστο (τη δυνατότητα να διαβάσουν περισσότερο κείμενο同時), απλά ρίχνοντας περισσότερα δεδομένα στην πρόκληση δεν είναι ένα ασημένιο δώρο. Μεγαλύτερο παράθυρο δεν σημαίνει αυτόματα καλύτερη κατανόηση. Αυτή η μελέτη δείχνει ότι ακόμη και αν ένα AI μπορεί τεχνικά να διαβάσει 50 σελίδες同時, δίνοντάς του 50 σελίδες μικτής ποιότητας πληροφοριών μπορεί να μην οδηγήσει σε ένα καλό αποτέλεσμα. Το μοντέλο εξακολουθεί να ωφελείται από το να έχει κατηρτισμένο, σχετικό περιεχόμενο για να εργαστεί, αντί για μια αδιακρίτως dump. Στην πραγματικότητα, η έξυπνη ανάκτηση μπορεί να γίνει ακόμη πιο κρίσιμη στην εποχή των γιγάντιων παραθύρων контекστο – για να διασφαλιστεί ότι η πρόσθετη ικανότητα χρησιμοποιείται για πολύτιμη γνώση και όχι για θόρυβο.

Τα ευρήματα από “Περισσότερα Έγγραφα, Ίδιο Μήκος” (το κατάλληλα τίτλο της εργασίας) ενθαρρύνουν μια επαναεξέταση των υποθέσεών μας στην έρευνα AI. Μερικές φορές, η παροχή 모든 των δεδομένων που έχουμε σε ένα AI δεν είναι τόσο αποτελεσματική όσο νομίζουμε. Βελτιώνοντας την ακρίβεια των απαντήσεων AI και κάνωντας τα συστήματα πιο αποτελεσματικά και εύκολη να εμπιστευτούμε. Είναι μια αντίθετη μάθηση, αλλά μια με ενθουσιαστικές επιπτώσεις: μελλοντικά συστήματα RAG μπορεί να είναι και πιο έξυπνα και λεπτότερα με την προσεκτική επιλογή λιγοτέρων, καλύτερων εγγράφων για ανάκτηση.