Η γωνία του Anderson

Ανθρώπινος Κώδικας Από το 2020 Κατέστρεψε τους Vibe-Coded Agents σε Αγωνιστικούς Τεστ

Το ChatGPT και άλλα εργαλεία vibe-coding υποβεβληθηκαν σε τεστ σε σχεδόν 40.000 αγώνες – και ηττήθηκαν από τον κώδικα που γράφτηκε από φοιτητές πριν από την εφεύρεση των Μεγάλων Μοντέλων Γλώσσας.

Σε μια νέα μελέτη από το Ηνωμένο Βασίλειο, ερευνητές αντιπαρατέθηκαν ανθρώπινους κωδικοποιημένους πράκτορες με vibe-coded πράκτορες που αναπτύχθηκαν με τα τελευταία Μεγάλα Μοντέλα Γλώσσας (LLMs), όπως το ChatGPT-5 και το Claude, και διαπίστωσαν ότι οι πράκτορες που δημιουργήθηκαν χωρίς τη βοήθεια του AI νίκησαν πολύ εύκολα τις εκδόσεις που υποστηρίζονται από AI.

Και οι δύο ομάδες πρακτόρων δημιουργήθηκαν από διαφορετικές γενιές φοιτητών από το Εργαστήριο Τεχνητής Νοημοσύνης του Ομοσπονδιακού Τεχνολογικού Ινστιτούτου της Λωζανής. Οι μη-AI πράκτορες αναπτύχθηκαν ως μέρος του μαθήματος το 2020, δύο χρόνια πριν από την εφεύρεση του ChatGPT και την έναρξη της επανάστασης των LLM, ενώ οι νέοι πράκτορες δημιουργήθηκαν από τους τρέχοντες φοιτητές, με τη βοήθεια των τελευταίων και καλύτερων LLM που διατίθενται.

Ακόμη και με ένα ριγμένο παιχνίδι, οι vibe-coded λύσεις δεν μπορούσαν να κερδίσουν, και οι πέντε πρώτες θέσεις κατελήφθησαν συνεχώς από ‘ακατέργαστους’ πράκτορες, με την πλειοψηφία των LLM πρακτόρων (33 από 40) να ηττώνται εύκολα από ‘πολύ απλούς’ βασικούς πράκτορες, σε 38.304 αγώνες σε ένα τουρνουά, σε ένα ευρύ φάσμα μεταβλητών και περιστάσεων.

Το έγγραφο αναφέρει:

‘Η εργασία μας αποδεικνύει ότι ενώ τα state-of-the-art LLMs μπορούν να γεννήσουν κώδικα που τρέχει (δηλ. χωρίς σφάλματα σύνταξης), η γεννημένη λύση δεν είναι ανταγωνιστική με τις ανθρώπινες λύσεις σε διαστάσεις όπως η στρατηγική σχεδίαση, η βελτιστοποίηση ή η ανταγωνιστική πολυ-πράκτορας.

‘Έτσι, αυτή η εργασία φέρνει στο προσκήνιο αυτό το νέο μέτωπο στη γεννήση κώδικα, και στοχεύει να διευκολύνει την ανάπτυξη βεντσών, συνόλων δεδομένων και ανοιχτών πηγαίων που δίνουν έμφαση στη σύνθεση κώδικα που οδηγείται από τη σκέψη.’

Η πρόκληση που σχεδιάστηκε ήταν να συμμετάσχει δημιουργικά σε δημοπρασίες, σε eine ποικιλία στρατηγικών, και να διευθετήσει την логιστική της παράδοσης των κερδισμένων αντικειμένων στους νικητές.

Οι συγγραφείς σημειώνουν ότι ένας αριθμός πλεονεκτημάτων δόθηκε στα LLMs, όπως η παρέμβαση στον κώδικά τους για να βελτιώσουν την απόδοσή τους – ένα πλεονέκτημα που δεν επιτρεπόταν στον κώδικα της εποχής 2020.尽管如此, ακόμη και όταν παρέχονταν διορθωτικός κώδικας που θα είχε βελτιώσει σίγουρα τα αποτελέσματά τους, τα LLMs δεν μπορούσαν να τα αποδεχθούν ή να τα χρησιμοποιήσουν:

‘[Στο] μας βεστικό, ακόμη και όταν εκθέτουμε μια καλή λύση στο контέκστ, το LLM δεν μπορεί να τη χρησιμοποιήσει.

‘Αυτό το αποτέλεσμα επίσης θέτει ενδιαφέροντα ερωτήματα για τα όρια της μάθησης και της λύσης προβλημάτων σε σύνθετες καταστάσεις.’

Τα LLMs που χρησιμοποιήθηκαν στο τεστ ήταν GPT-5 Thinking, Gemini 2.5 Pro, Claude Opus 4.1, ΚΑΙ DeepSeek R1*.

Το νέο έγγραφο έχει τον τίτλο Μπορεί το Vibe Coding να Νικήσει τους Φοιτητές του Μεταπτυχιακού; Ένας Αγώνας LLM vs. Ανθρώπινου Κώδικα σε Αγωνιστική Στρατηγική, και προέρχεται από έναν συγγραφέα στο Πανεπιστήμιο του Southampton και έναν άλλον στο Πανεπιστήμιο του Oxford και το Ινστιτούτο Alan Turing. Η βεστική θα κυκλοφορήσει σύντομα, όπως αναφέρουν οι συγγραφείς.

Μέθοδος

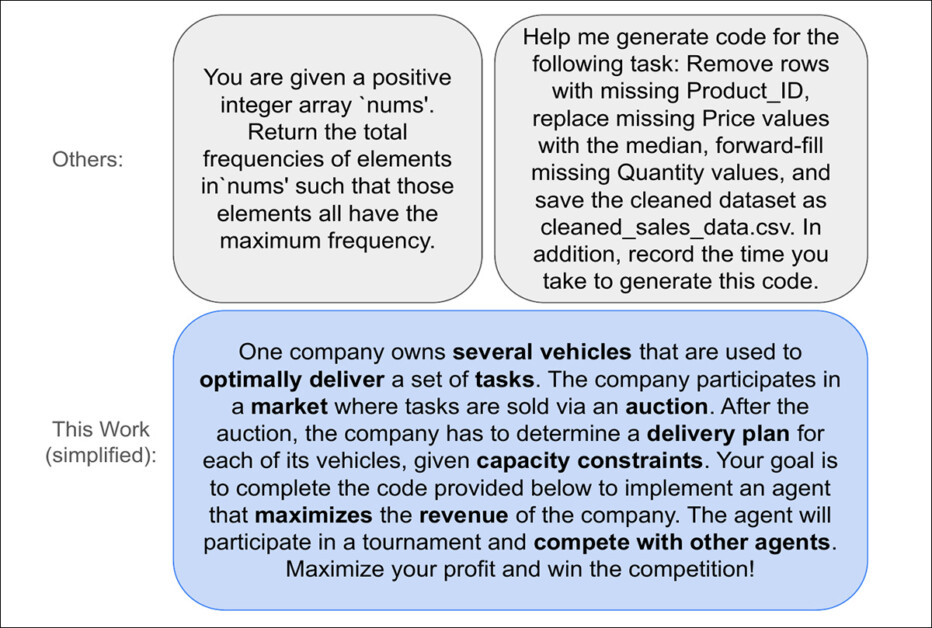

Οι συγγραφείς σημειώνουν ότι οι παραδοσιακές δοκιμές σε αυτή τη σφαίρα εστιάζουν σε προκλήσεις με σαφώς καθορισμένες δυαδικές λύσεις (σωστές ή λΑΘΟΣ), που επαληθεύονται μέσω τεστ μονάδας. Υποστηρίζοντας ότι αυτό δεν είναι ο ιδανικός τρόπος για να εξερευνηθούν τα όρια του κώδικα που υποστηρίζεται από LLM, οι συγγραφείς αντίθετα σχεδίασαν μια πιο σύνθετη πρόκληση, με πολλαπλά εσωτερικά βεστικά και ορόσημα, όπου η νίκη είναι δυνατή, αλλά μακριά από απλή:

Σύγκριση των τυπικών, unit-test-βασισμένων προσεγγίσεων (πάνω), και του πιο ανοιχτού σценαρίου πρόκλησης που σχεδιάστηκε από τους συγγραφείς (σε μπλε, κάτω). Πηγή

Η πρόκληση του Προβλήματος Δημοπρασιών, Παραλαβής και Παράδοσης (APDP) που χρησιμοποιήθηκε για τη μελέτη των συγγραφέων ήταν εν μέρει αυτο-επιλεγμένη, λόγω της διαθεσιμότητας eines σώματος εργασίας φοιτητών του 2020 από το Ελβετικό πανεπιστήμιο· εργασία που αποσκοπούσε στη δημιουργία αυτόματων πρακτόρων για την εργασία APDP, πριν από την ικανότητα να ενισχύσει την ανάπτυξη μέσω AI. Έτσι ήταν σχετικά εύκολο να ζητηθεί από τους σύγχρονους φοιτητές να εκτελέσουν την ίδια εργασία, αλλά να τους παρέχουν τα τρέχοντα εργαλεία.

Οι συγγραφείς ζήτησαν να αποφύγουν δημοφιλείς πλαισίες δοκιμών όπως HumanEval, BigCodeBench και WebDev Arena (μεταξύ πολλών άλλων), поскольку αυτή η κατηγορία δοκιμαστικών διαδικασιών έχει την τάση να υποφέρει από μόλυνση δεδομένων (δηλ. περιπτώσεις όπου το σύστημα μπορεί να έχει εκπαιδευτεί σε δεδομένα δοκιμής αντί να σέβεται ένα διαχωρισμό).

Το APDP είναι ένα δίωρο πρόβλημα λογιστικής που βασίζεται σε αντίστροφες δημοπρασίες και δίαυλος οχημάτων. Στο πρώτο στάδιο, οι πράκτορες ανταγωνίζονται για να κερδίσουν εργασίες παράδοσης υποβάλλοντας προσφορές για το πόσο θα πρέπει να πληρωθούν για την ολοκλήρωση κάθε μιας. Η προσφορά σε υψηλό ποσοστό σημαίνει απώλεια της εργασίας· η προσφορά σε χαμηλό ποσοστό μπορεί να σημαίνει απώλεια χρημάτων.

Στο δεύτερο στάδιο, κάθε πράκτορας πρέπει να δημιουργήσει einen αποτελεσματικό σχέδιο για την εκπλήρωση μόνο των εργασιών που κέρδισε, αναθέτοντας τις σε οχήματα με διαφορετικές ικανότητες και κόστη, υπό χρονικούς και πόρων περιορισμούς:

Στο APDP, οι εταιρείες συμμετέχουν σε αντίστροφες δημοπρασίες για εργασίες παράδοσης, και στη συνέχεια βελτιστοποιούν τις διαδρομές οχημάτων για να εκπληρώσουν μόνο τις εργασίες που κέρδισαν, με στόχο την μεγιστοποίηση του κέρδους.

Ο στόχος δεν είναι απλά να ολοκληρώσουν τις εργασίες, αλλά να μεγιστοποιήσουν το συνολικό κέρδος προβλέποντας ποια πακέτα εργασιών θα δουλέψουν καλύτερα μαζί, και προβλέποντας τις στρατηγικές των αντιπάλων που προσπαθούν να κάνουν το ίδιο.

Το βασικό πρόβλημα παράδοσης είναι NP-δύσκολο, δηλ. δεν υπάρχει αλγόριθμος που μπορεί να βρει την καλύτερη λύση σε 合理 χρόνο καθώς ο αριθμός των εργασιών αυξάνεται. Αυτό καθιστά την βίαιη προσέγγιση μη εφικτή, και αναγκάζει τους πράκτορες να ανταλλάξουν ακρίβεια για ταχύτητα.

Ο Αγώνας Έχει Ξεκινήσει

Η αξιολόγηση των συγγραφέων σύγκρινε 40 LLM-κωδικοποιημένους πράκτορες με 17 ανθρώπινους κωδικοποιημένους πράκτορες σε μια σειρά από αγώνες. Κάθε ένας από τους 12 αγώνες χρησιμοποιούσε eine διαφορετική συνδυασμό τεσσάρων τοπολογιών οδικών δικτύων, και αποτελούνταν από όλους-παν-πάν ζευγαρώματα, με πράκτορες που αντιμετωπίζουν κάθε άλλον αντίπαλο δύο φορές: μία φορά ελέγχοντας κάθε eine από δύο εταιρείες, με διαφορετικά οχήματα.

Αυτή η ρύθμιση έδωσε 3.192 αγώνες ανά τουρνουά, συνολικά 38.304 αγώνες. Σε κάθε αγώνα, 50 εργασίες παράδοσης δημοπρατήθηκαν, που ορίστηκαν από τους σημεία παραλαβής και παράδοσης και βάρος, και τραβήχτηκαν τυχαία σε οδικά σχέδια που μοντελοποιήθηκαν στη Σουηδία, Γαλλία, Μεγάλη Βρετανία και Ολλανδία:

Απλοποιημένα οδικά δίκτυα που χρησιμοποιήθηκαν στο τουρνουά: Μεγάλη Βρετανία (πάνω αριστερά), Ελβετία (πάνω δεξιά), Ολλανδία (κάτω αριστερά), και Γαλλία (κάτω δεξιά). Μπλε και κόκκινα τετράγωνα σημειώνουν εργασίες παραλαβής και παράδοσης. Χρωματισμένα τρίγωνα δείχνουν τις τρέχουσες θέσεις των οχημάτων των πρακτόρων.

Οι φοιτητές πράκτορες επιλέχθηκαν από ένα τουρνουά φοιτητών το 2020. Όγδοι προέρχονταν από τους κορυφαίους επιδότες σε ένα τελικό μονό ελιμιναção, και τέσσερις επιπλέον επιλέχθηκαν για την ισχυρή απόδοση τους ενάντια στους βασικούς πράκτορες σε αγώνες.

Οι βασικοί πράκτορες ακολούθησαν σταθερές ευριστικές. Απλό υπολόγισε τη συνολική απόσταση και προσέφερε ανάλογα, χρησιμοποιώντας μόνο ένα όχημα και αγνοώντας τη δέσμη; ExpCostFixedBid προσομοίωσε 10 τυχαίες εργασίες, και προσέφερε το μέσο όρο της марγινάλης κόστους; Ειλικρινής υπολόγισε το πραγματικό маргινάλε κόστος της εισαγωγής της εργασίας στο πρόγραμμα; Μοντέλο αντίπαλου έκανε το ίδιο, αλλά πρόσθεσε μια εκτίμηση του κόστους του αντίπαλου, προσέφερε το μέγιστο; και Ρίσκο-αναζητών συνδύασε μια χρονικά-εκπνέουσα προηγούμενη με ζωντανούς εκτιμήσεις κόστους και μοντέλο αντίπαλου – ξανά, προσέφερε το υψηλότερο από τα δύο.

Η αξιολόγηση περιελάμβανε 40 LLM-κωδικοποιημένους πράκτορες που κατασκευάστηκαν χρησιμοποιώντας το (παραπάνω αναφερθέν) GPT-5 Thinking, Claude Opus 4.1, Gemini 2.5 Pro, και DeepSeek R1. Κάθε μοντέλο προτράπηκε με πέντε διαφορετικές στρατηγικές, εφαρμοσμένες δύο φορές ανά μοντέλο.

Δύο στρατηγικές χρησιμοποιούσαν στατικές προτροπές γραμμένες από διαφορετικούς συγγραφείς, ενώ μια τρίτη ζήτησε από το μοντέλο να αυτο-ανακλήθηκε και να αναθεώρησε την δική του έξοδο; μια άλλη εμπλέκει κριτική και αναθεώρηση από ένα ξεχωριστό LLM. Η τελική στρατηγική χρησιμοποίησε το GPT-4 για να συνθέσει μια νέα προτροπή αναθεωρώντας όλες τις τέσσερις προηγούμενες προσεγγίσεις.

Η βασική προτροπή αντανακλούσε την αρχική εργασία φοιτητή, περιγράφοντας το περιβάλλον παράδοσης και οδηγώντας το μοντέλο να προσέφερε και να σχεδιάσει για να μεγιστοποιήσει το κέρδος, χωρίς να βασίζεται σε μεθόδους υψηλής πολυπλοκότητας.

Όλοι οι LLM πράκτορες δοκιμάστηκαν σε αυτο-παιχνίδι και τουρνουά ρυθμίσεις μέχρι όλοι οι观察ABLE σφάλματα να επιδιορθωθούν. Η διόρθωση σφαλμάτων χειριζόταν αυτονομamente από τα LLMs themselves, προτρεπόμενα με τις πληροφορίες σφάλματος.

Κοινά LLM αποτυχίες, το έγγραφο σημειώνει, περιελάμβαναν παραβιάσεις ορίων χρόνου, αποτυχία να παραλάβουν ή να παραδώσουν ανατεθειμένες εργασίες, και παραβιάσεις ορίων χωρητικότητας οχήματος – σφάλματα που συχνά προέκυψαν από την αγνόηση ρητών οδηγιών, ή από ελαττωματική λογική επανασχεδίασης†:

‘Ένα άλλο κοινό ζήτημα που βρήκαμε (κυρίως με Gemini, Claude, και DeepSeek, και όχι τόσο με GPT) είναι ότι khá συχνά το LLM θα αποτύχει να επιλύσει ένα σφάλμα.

‘Για παράδειγμα, ένας πράκτορας θα αποτύχει συνεχώς να επιλύσει ένα σφάλμα, παρά πολλαπλά (π.χ. 5 − 15) κύκλους προτροπής του LLM με το σφάλμα και λήψη της ενημερωμένης έκδοσης του κώδικα.

‘Η μόνη λύση που βρήκαμε για τέτοιες περιπτώσεις (όπου το LLM επαναλαμβάνει να αποτύχει να επιλύσει το ίδιο σφάλμα) είναι να ξαναρχίσω από την αρχή. Συνολικά, παρατηρήσαμε την ανάγκη για σημαντική χειροκίνητη προσπάθεια για να επιτύχουμε απαλλαγμένο από σφάλματα κώδικα. Έπρεπε να γεννήσουμε σημαντικά περισσότερους πράκτορες για να πάρουμε τους 40 απαλλαγμένους από σφάλματα που αξιολογήσαμε.’

Τα αποτελέσματα που εμφανίζονται παρακάτω συνοψίζουν αποτελέσματα από 12 διπλούς γύρους τουρνουά, που καλύπτουν τέσσερις τοπολογίες δικτύων και τρεις τουρνουά ανά τοπολογία, που έδωσαν σχεδόν 40.000 αγώνες:

| Πράκτορας | Μέσος Όρος #Νίκες / Τουρ | Τυπική Απόκλιση #Νίκες / Τουρ | Μέσος Όρος #Ήττες / Τουρ | Τυπική Απόκλιση #Ήττες / Τουρ | Συνολικές Νίκες | Συνολικές Ήττες | Ποσοστό Νικών |

|---|---|---|---|---|---|---|---|

| Φοιτητής 1 | 108.167 | 1.193 | 3.833 | 1.193 | 1298 | 46 | 0.9658 |

| Φοιτητής 2 | 104.917 | 2.539 | 7.083 | 2.539 | 1259 | 85 | 0.9368 |

| Φοιτητής 3 | 103.917 | 2.466 | 8.083 | 2.466 | 1247 | 97 | 0.9278 |

| Φοιτητής 4 | 103.25 | 1.815 | 8.75 | 1.815 | 1239 | 105 | 0.9219 |

| Φοιτητής 5 | 96.5 | 2.908 | 15.5 | 2.908 | 1158 | 186 | 0.8616 |

| LLM(O, IR, 1) | 95.417 | 2.314 | 16.583 | 2.314 | 1145 | 199 | 0.8519 |

| LLM(O, A2, 1) | 94.583 | 2.314 | 17.417 | 2.314 | 1135 | 209 | 0.8445 |

| Φοιτητής 6 | 93.167 | 1.899 | 18.833 | 1.899 | 1118 | 226 | 0.8318 |

| Φοιτητής 7 | 93.167 | 3.563 | 18.833 | 3.563 | 1118 | 226 | 0.8318 |

| LLM(O, A1, 1) | 86.083 | 3.029 | 25.917 | 3.029 | 1033 | 311 | 0.7686 |

| LLM(O, GEN, 2) | 84.083 | 6.947 | 27.917 | 6.947 | 1009 | 335 | 0.7507 |

| LLM(O, CR, 2) | 83.5 | 4.442 | 28.5 | 4.442 | 1002 | 342 | 0.7455 |

| Φοιτητής 8 | 83.417 | 4.122 | 28.583 | 4.122 | 1001 | 343 | 0.7448 |

| RiskSeeking | 82.417 | 3.343 | 29.583 | 3.343 | 989 | 355 | 0.7359 |

| LLM(O, GEN, 1) | 80.667 | 4.355 | 31.25 | 4.372 | 968 | 375 | 0.7208 |

| ModelOpponent | 80.583 | 3.26 | 31.417 | 3.26 | 967 | 377 | 0.7195 |

| LLM(D, A1, 1) | 79.417 | 3.965 | 32.583 | 3.965 | 953 | 391 | 0.7091 |

| ExpCostFixedBid | 77.167 | 4.951 | 34.833 | 4.951 | 926 | 418 | 0.689 |

| LLM(O, IR, 2) | 73.917 | 3.502 | 38 | 3.618 | 887 | 456 | 0.6605 |

| LLM(O, A1, 2) | 72.417 | 2.193 | 39.583 | 2.193 | 869 | 475 | 0.6466 |

| LLM(G, A1, 2) | 68.5 | 3.555 | 43.5 | 3.555 | 822 | 522 | 0.6116 |

| LLM(A, GEN, 2) | 67.917 | 2.968 | 44.083 | 2.968 | 815 | 529 | 0.6064 |

| LLM(G, IR, 2) | 65.917 | 2.314 | 46.083 | 2.314 | 791 | 553 | 0.5885 |

| Φοιτητής 9 | 64.167 | 11.044 | 47.833 | 11.044 | 770 | 574 | 0.5729 |

| LLM(G, A1, 1) | 64 | 4.243 | 47.917 | 4.316 | 768 | 575 | 0.5719 |

| LLM(G, IR, 1) | 60.333 | 3.725 | 51.667 | 3.725 | 724 | 620 | 0.5387 |

| LLM(O, A2, 2) | 59.333 | 4.499 | 52.667 | 4.499 | 712 | 632 | 0.5298 |

| LLM(D, CR, 1) | 55.083 | 6.694 | 56.833 | 6.59 | 661 | 682 | 0.4922 |

| LLM(G, GEN, 2) | 53.167 | 3.664 | 58.833 | 3.664 | 638 | 706 | 0.4747 |

| LLM(D, GEN, 2) | 52.083 | 9.06 | 59.917 | 9.06 | 625 | 719 | 0.465 |

| Honest | 50.583 | 3.848 | 61.417 | 3.848 | 607 | 737 | 0.4516 |

| Φοιτητής 10 | 48.833 | 2.98 | 63.167 | 2.98 | 586 | 758 | 0.436 |

| LLM(D, IR, 1) | 48.583 | 10.211 | 63.417 | 10.211 | 583 | 761 | 0.4338 |

| LLM(A, A1, 1) | 48 | 4.69 | 64 | 4.69 | 576 | 768 | 0.4286 |

| LLM(G, A2, 1) | 47.25 | 3.864 | 64.75 | 3.864 | 567 | 777 | 0.4219 |

| LLM(A, CR, 1) | 43.833 | 4.609 | 68.167 | 4.609 | 526 | 818 | 0.3914 |

| LLM(A, A1, 2) | 43.75 | 2.05 | 68.25 | 2.05 | 525 | 819 | 0.3906 |

| Φοιτητής 11 | 42.083 | 5.664 | 69.917 | 5.664 | 505 | 839 | 0.3757 |

| LLM(A, IR, 1) | 39.5 | 2.541 | 72.5 | 2.541 | 474 | 870 | 0.3527 |

| Naive | 36.75 | 1.712 | 75.25 | 1.712 | 441 | 903 | 0.3281 |

| Φοιτητής 12 | 36.333 | 1.775 | 75.667 | 1.775 | 436 | 908 | 0.3244 |

| LLM(D, A2, 1) | 33.917 | 2.193 | 78.083 | 2.193 | 407 | 937 | 0.3028 |

| LLM(A, GEN, 1) | 30.167 | 1.749 | 81.833 | 1.749 | 362 | 982 | 0.2693 |

| LLM(D, A2, 2) | 29.833 | 2.038 | 82.167 | 2.038 | 358 | 986 | 0.2664 |

| LLM(G, A2, 2) | 27 | 2.256 | 85 | 2.256 | 324 | 1020 | 0.2411 |

| LLM(A, A2, 1) | 26.333 | 0.985 | 85.667 | 0.985 | 316 | 1028 | 0.2351 |

| LLM(O, CR, 1) | 25 | 3.411 | 87 | 3.411 | 300 | 1044 | 0.2232 |

| LLM(A, IR, 2) | 24.333 | 8.542 | 87.667 | 8.542 | 292 | 1052 | 0.2173 |

| LLM(A, A2, 2) | 24 | 1.809 | 88 | 1.809 | 288 | 1056 | 0.2143 |

| LLM(A, CR, 2) | 23.333 | 1.557 | 88.667 | 1.557 | 280 | 1064 | 0.2083 |

| LLM(D, GEN, 1) | 22.5 | 1.784 | 89.5 | 1.784 | 270 | 1074 | 0.2009 |

| LLM(D, A1, 2) | 13.333 | 1.826 | 98.667 | 1.826 | 160 | 1184 | 0.119 |

| LLM(G, CR, 1) | 9.5 | 1.087 | 102.5 | 1.087 | 114 | 1230 | 0.0848 |

| LLM(G, GEN, 1) | 9.167 | 0.937 | 102.833 | 0.937 | 110 | 1234 | 0.0818 |

| LLM(D, IR, 2) | 7.75 | 0.622 | 104.25 | 0.622 | 93 | 1251 | 0.0692 |

| LLM(G, CR, 2) | 7.25 | 1.422 | 104.75 | 1.422 | 87 | 1257 | 0.0647 |

| LLM(D, CR, 2) | 5.667 | 0.985 | 106.333 | 0.985 | 68 | 1276 | 0.0506 |

Για контέκστ, κάθε πράκτορας έπαιξε 112 αγώνες ανά τουρνουά, οπότε το μέγιστο δυνατό μέσο όρο για νίκες ή ήττες ανά πράκτορα είναι 112. Τυπική απόκλιση (SD) αντανακλά τη μεταβλητότητα ανά τουρνουά. Ανθρώπινοι κωδικοποιημένοι πράκτορες εμφανίζονται με έντονα γράμματα. LLM-κωδικοποιημένοι πράκτορες σημειώνονται με το μοντέλο (O = GPT-5 Thinking, G = Gemini 2.5 Pro, A = Claude Opus 4.1, D = DeepSeek R1), ακολουθούμενο από einen δύο-γραμμάτιο κωδικό προτροπής και έναν αριθμό που υποδεικνύει εάν ο πράκτορας είναι ο πρώτος ή ο δεύτερος που γεννήθηκε με αυτήν την προτροπή. Πηγή

Σχετικά με τα αποτελέσματα που εμφανίζονται παραπάνω, οι συγγραφείς αναφέρουν†:

‘Τα LLMs δεν παρήγαγαν αναμενόμενες/ανταγωνιστικές λύσεις ακόμη και σε απλούστερες παραλλαγές του προβλήματος APDP (παρά το γεγονός ότι ο κώδικας ήταν σε μεγάλο βαθμό απαλλαγμένος από σφάλματα σύνταξης). Αυτό υπογραμμίζει τη σημασία των βεντσών αξιολόγησης κώδικα που οδηγούνται από τη σκέψη που ξεπερνούν την αυτόματη συμπλήρωση και αναγνωρίζουν новые αδυναμίες των LLMs.’

‘Τα αποτελέσματά μας αποδεικνύουν μια σαφή υπεροχή των ανθρώπινων κωδικοποιημένων πρακτόρων: (i) οι πέντε πρώτες θέσεις κατέχονται συνεχώς από φοιτητές πράκτορες, και (ii) η πλειοψηφία των LLM πρακτόρων (33 από 40) ηττώνται από πολύ απλούς βασικούς πράκτορες (όπως η προσφορά σταθερής маргινάλης κόστους).’

‘Είναι σημαντικό να σημειωθεί ότι δεν διόρθωσαμε τον κώδικα των φοιτητών (ενώ διέτρεξαμε πλήρως το LLM κώδικα, και σε αυτο-παιχνίδι και τουρνουά ρυθμίσεις). Κάθε φορά που ένας φοιτητής πράκτορας κατέρρευε, αυτομάτως δίναμε τη νίκη στο LLM. Ένα μεγάλο αριθμός από αυτές τις καταρρεύσεις θα ήταν εύκολο να διορθωθούν (π.χ. πράκτορες που υπερέβησαν το όριο χρόνου), οπότε οι φοιτητές πράκτορες θα μπορούσαν потенτικά να κατατάσσονται ακόμη υψηλότερα.’

Ως μια περαιτέρω πείραμα, το GPT-5 Thinking προτράπηκε να βελτιώσει τον κώδικα του κορυφαίου ανθρώπινου πράκτορα, Φοιτητής 1; αλλά ο τώρα LLM-τροποποιημένος πράκτορας στη συνέχεια έπεσε στην δέκατη θέση, τώρα η χειρότερη από όλους τους ανθρώπινους βαθμούς. Αντί να βελτιώσει τη λύση, οι αλλαγές των LLMs την χειροτέρεψαν σχεδόν 20%.

Οι συγγραφείς καταλήγουν:

‘[Τα] αποτελέσματά μας υπογραμμίζουν σημαντικά όρια της γεννήσης κώδικα LLM, πιο αξιοσημείωτα τις περιορισμένες ικανότητες σκέψης και σχεδίασης ενώ γεννά κώδικα. Τα σύγχρονα LLMs μπορούν να παρέχουν κώδικα χωρίς σφάλματα σύνταξης που τρέχει, αλλά αυτό δεν είναι το βεστικό που πρέπει να χρησιμοποιούμε για να μετρήσουμε την πρόοδο προς την προηγμένη γενική AI.’

Συμπέρασμα

Οι συγγραφείς παρατηρούν ότι το vibe-coding έχει ενδυναμώσει ανθρώπους όλων των τεχνικών υποβάθρων, και το χαρακτηρίζουν ως μια θετική δύναμη. Ωστόσο, επίσης υποδηλώνουν ότι επειδή το vibe-coding έχει μόλις φτάσει, τα όριά του δεν είναι γνωστά, και μπορεί να υποτεθεί ότι είναι κάπως υψηλότερα από ό,τι μπορεί να αναμενθεί πραγματικά.

Κλείνουν την προσφορά τους καλώντας για μια μετατόπιση στόχου ‘από κώδικα που συντάσσεται σε κώδικα που ανταγωνίζεται’.

Ένα ερώτημα που ο τυχαίος αναγνώστης αυτού του ενδιαφέροντος νέου εγγράφου μπορεί να έχει είναι εάν οι συγγραφείς χτυπούν ψηλά ή χαμηλά,既然 η αγωνιστική εργασία που αναφέρεται είναι σημαντικά πιο σύνθετη και εμπλεκόμενη από το να βγάζει PowerShell scripts και άλλα είδη μικρής λειτουργικότητας και διορθώσεων για τις οποίες το vibe-coding είναι καλά-προσαρμοσμένο.

* Παρακαλώ σημειώστε ότι το έγγραφο αναφέρεται συνεχώς στο ‘DeepThink R1′, το οποίο φαίνεται να μην υπάρχει, εμφανιζόμενο μόνο σε quelques αναφορές στο διαδίκτυο (πιθανότατα από άλλους συγγραφείς που έχουν λανθασμένα γραφτεί ‘DeepSeek R1)’. Εάν αυτό είναι το λάθος μου, παρακαλώ επικοινωνήστε μαζί μου μέσω των πληροφοριών του προφίλ μου, και θα το διορθώσω.

† Τόνωση των συγγραφέων, όχι δική μου.

Πublished για πρώτη φορά την Τετάρτη, 26 Νοεμβρίου 2025. Τροποποιήθηκε 17:35 est για μορφοποίηση.