Andersons vinkel

PiedPiper-Style Decentraliserede Inference Services for AI?

Er ‘BitTorrent for AI’ en forestående mulighed?

Mening Da jeg lige havde afsluttet en genvisning af Mike Judges underholdende og syreiske tech-bro-satire Silicon Valley – hvor en gruppe socialt udfordrede geek-geniuer forsøger at skabe en ‘ny internet’ kaldet PiedPiper, via et mesh-netværk installeret på alle mobiltelefoner – var jeg interesseret i at se, hvor HN-fællesskabet engagerede sig med et nyt tilbud af samme art.

Eigen Labs’ DarkBloom befinder sig et sted mellem den egalitære idé om et decentraliseret mesh-netværk for AI-inferens og crypto-mining-profitmotiver, og tillader ejerne af Apple Silicon Mac-systemer at omdanne deres udstyr til en inferensnode:

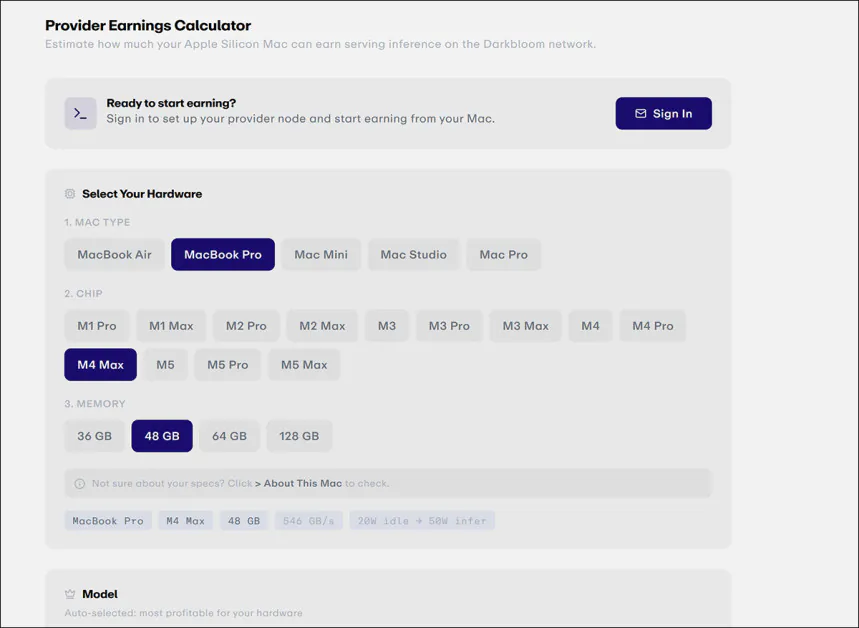

Fra afsnittet “Indtjening” på DarkBloom-sitet kan brugere vælge, hvilket udstyr de ønsker at leje ud, og hvilke AI-modeller de ønsker at støtte. Kilde

Systemet koncentrerer sig i øjeblikket om tekstbaserede modeller som den agente Trinity Mini (3B) og Cohere Transcribe, selvom det også tilbyder diverse billedgenereringsmodeller som FLUX 2 Klein 4B:

Udvallet af modeller, som ‘landlord’ kan vælge at leje ud, sammen med månedlige projekterede indtægter.

Brugere, der deltar i ordningen, kan tilsyneladende tjene nok penge i en solid måned med inferenslevering til at kunne købe en ny Mac til en stadig voksende kæde, indtil de i teorien kan tjene en fuldstændig inferensfarm.

Effektivt kan en ordning af denne art, der virkelig ville vinde popularitet (den har i øjeblikket et kold startproblem), muligvis sætte entusiastiske amatørbrugere tilbage i en hardware-søgende position, som under den sidste store cryptocurrency-boom (og efterfølgende krak).

Ikke så hurtigt

Men for de små, kan den båd måske være sejlet. Foruden AI’s apokalyptiske behov for RAM, stiger efterspørgslen på globale AI-aktiverede datacenter-udstyr fortsat og øger hardware- og servicesomkostninger for den almindelige forbruger, der tidligere havde kunnet monopolisere RAM til crypto-mining på grund af aktivitetens perifere natur samt reguleringsusikkerhed, der holdt erhvervsinteresser tilbage.

Mens den super-billige MacBook Neo er dukket op som en crunch-beatende alternativ til stadig stigende hardware, kan dens A18-mobiltelefonchip og 8 GB VRAM ikke bringe den i alvorlig konkurrence som en inferensmaskine.

Men selv hvis slutbrugeren ikke søger at starte en fuldstændig inferensfarm, og kun ønsker at leje ud sin nuværende ubenyttede M[n]-kapacitet, synes de potentielle indtægter betydelige, hvis det kold-startproblem (en initial mangel på brugere ved åbningen af en bekymring, der afhænger af et højt antal deltagere) hurtigt løses, og hvis platformen begynder at annoncere sig selv som noget mere end et nysgerrigt eksperiment i potentiel efterspørgsel.

Inferent forskelligt

Selvom en række kommentatorer har erkendt en PiedPiper/Torrent-lignende demokrati i DarkBlooms ordning, er inferensopgaver ikke så lette at dele som at fragmentere en filmfil i multiple hashed skiver, så den kan senere samles i en torrent-klient.

DarkBloom-modellen foreslår ikke, at en deltagers M[n]-chip håndterer x% af en inferensopgave. I almindelig brug kan kun et lille antal rammer eller metoder opnå denne type cross-GPU-udnyttelse på en enkelt inferensopgave, herunder NVIDIA’s TensorRT LLM, der bruger pipeline-parallellisme; og DeepSpeeds sharded inferens, der udnytter model-parallellisme (MP).

I stedet vil din DarkBloom-aktiverede Mac downloade og starte en af de listede modeller og udføre 100% af inferens for betalende brugere, med end-to-end-kryptering, og med prompts dekrypteret kun på hardware-attesterede noder, hvilket betyder, at udbydere ikke kan læse data under udførelse. Arbejdsbyrden selv ville bestå af en eller flere tekstbaserede inferenser eller mindst en komplet billed.

Det er ikke klart, hvor omfattende en enkelt brugersession ville være; som det er, er AI-hobbyister vant til at sikre en GPU via inferensfarme som RunPod; selvom det kan tage lidt tid at sikre den ønskede GPU ved toppen af brugen, får brugeren lov til at monopolisere den, så længe sessionen ikke er tilladt at udløbe.

Så det er muligt, at en enkelt betalende bruger kunne ende med at bruge en enkelt lejet DarkBloom Macs M-serie AI-kapaciteter i en meget lang session, medmindre der er en logistisk eller compliance-fordel i at omdanne klienterne mellem anmodninger.

Macs er blevet udvalgt til denne tilgang, åbenbart, fordi der kun er et begrænset antal mulige tekniske konfigurationer for en deltagere, og det er derfor let at tildele passende store modeller til en klient.

Desuden har Macs, der kan bidrage til et DarkBloom-netværk, en hardware sikker enclave, der garanterer en mur mellem brugeren og leverandøren.

Disse er alle faktorer, der ikke er så lette at rationalisere på tværs af mere generiske, selvbyggede opsætninger, og på tværs af hundredvis eller tusindvis af kendte bærbare og stationære Windows- og Linux-maskiner, der er tilgængelige over de sidste 6-7 år.

Men det må være åbenlyst, at den langt større ikke-Mac-hardware-pool kunne rumme enorm efterspørgsel, hvis deres diverse karakteristika kunne rationaliseres, i stedet for – som med DarkBloom – at køre med Apple’s begrænsede spec-sæt, hvilket gør det til en let forretningsproposition, og til en (formodentlig) langt lettere arkitektonisk tilgang.

Retlig tilsyn?

Måske er det største problem, der møder en ‘demokratisk’ løsning af denne art, den lukkede natur af den foreslåede proces; regeringer verden over er i øjeblikket engageret i nye love, der ville effektivt afslutte internet-anonymitet hvor som helst, og er åbenbart ikke i en pro-privat mindset i denne periode.

Derfor synes udsigten til tilfældig AI-inferens, der udføres uden filtre, kontroller eller balance, på tværs af et distribueret netværk (hvis du kan kalde DarkBloom det – det er mere af en inferensmarked), ironisk nok fjern.

Det er muligt, at DarkBloom eller andre efterfølgende mesh-inferensordninger vil være nødt til at acceptere bagdøre, der effektivt begrænser privatlivet til værten, der ikke vil kunne se klientjob kører; i stedet vil den returnerede inferensdata blive gjort tilgængelig gennem regeringsagenturer, der holder alle inferenser tilgængelige.

Formodentlig, hvis den nye lovgivning forslagende OS-niveau-identitetskontroller nogensinde opnår bred accept, kan sådanne foranstaltninger måske blive overflødige. Men uden dem ville en DarkBloom-lignende netværk sandsynligvis blive betragtet som en AI ‘darknet’, hvor ulovlige AI-baserede aktiviteter kunne foregå i hemmelighed.

Split-tests

Indtil nu er der kun få ægte forsøg på at gøre, hvad en ‘PiedPiper-stil’-system antyder; i sig selv befinder DarkBloom sig på en yderste, distribuerer komplette job til enkeltmaskiner i stedet for at forsøge at fragmentere dem på tværs af et netværk, mens de fleste produktionsystemer blot undgår problemet helt ved at holde inferens på en enkelt vært.

Der er dog en håndfuld projekter, der repræsenterer noget lidt tættere på ‘delt udførelse’.

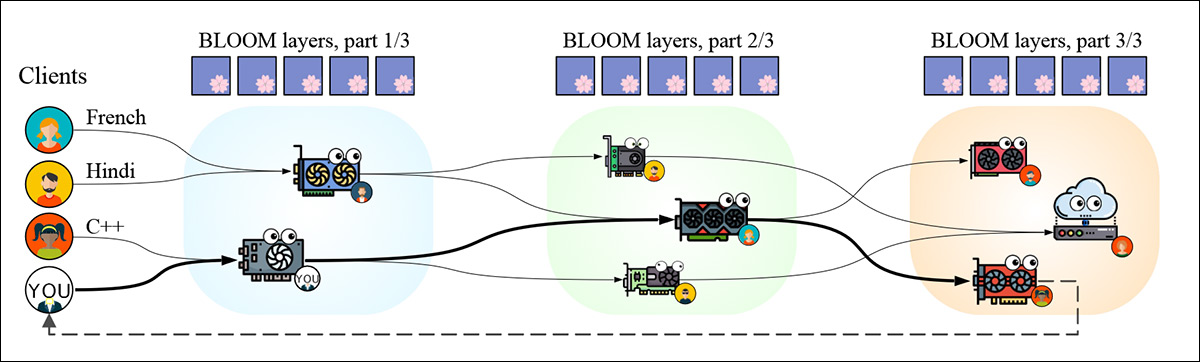

Petals, der aktivt beskriver sig selv som et ‘BitTorrent-lignende’ netværk, distribuerer transformer-blokke på tværs af multiple internet-forbundne noder, der passerer mellemstatser mellem dem:

En typisk Petals-arbejdsgang, hvor en enkelt inferensanmodning dirigeres på tværs af multiple fjerntliggende GPU’er, hver med en undermængde af model-lag; i modsætning til DarkBloom, udføres udførelsen fragmenteret på tværs af netværket, med mellemstatser passeret mellem uafhængigt opererede noder, hvilket øger latency og eksponering ved hver hop, mens det approksimerer et sandt mesh-lignende system. Kilde

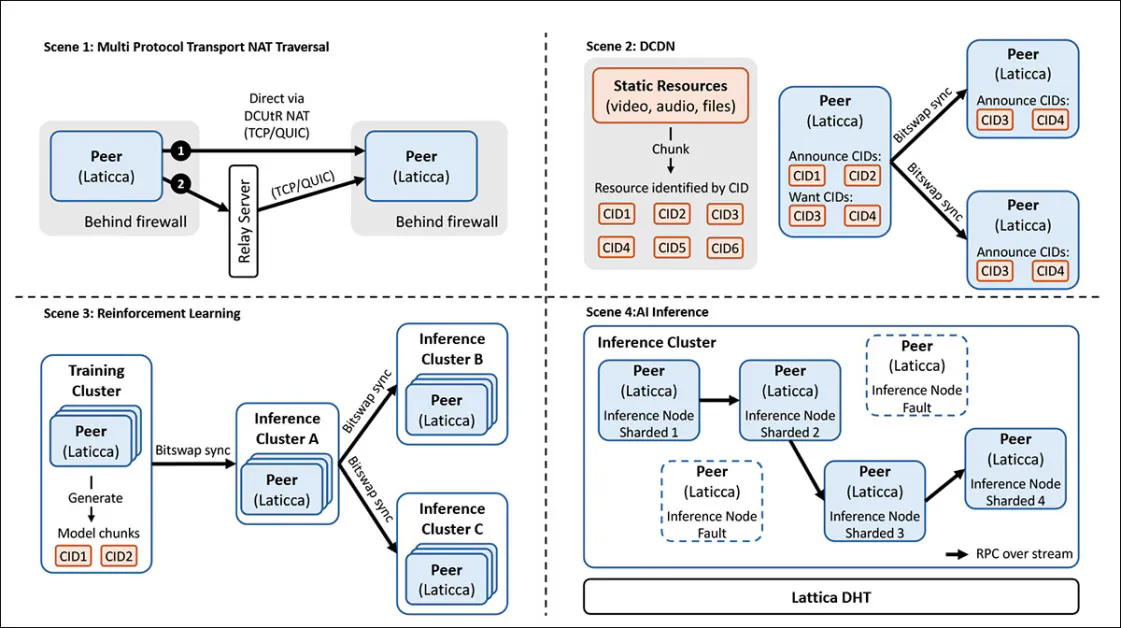

Hivemind eksperimenterer med lignende peer-to-peer-koordination og ekspert-rute, selvom det er i service for at træne modeller i stedet for at udføre inferens fra allerede trænede modeller; og Lattica fokuserer på det underliggende netværkslag, der er nødvendigt for at gøre sådanne systemer livskraftige:

En skematisk tegning af Lattica, der viser et lavere niveau peer-to-peer-substrat, der håndterer NAT-traversering, indholdsdistribution og DHT-baseret koordination (Distributed Hash Table), med sharded inferens, der kun opstår som en mulig applikationslag; i modsætning til DarkBloom eller Petals, definerer Lattica ikke selv en inferenssystem, men tilbyder de nødvendige netværks- og synkroniseringsprimitiver til at bygge et. Kilde –

Alle disse modeller nærmer sig mesh-idealet, men til en pris af latency, ustabilitet og eksponering.

Om vendt, exo holder inferens inden for en lokal cluster, der bruger hurtige interconnects til at dele arbejdsbyrder på tværs af GPU’er, uden at afhænge af det offentlige internet. I praksis opfører en sådan opsætning sig mere som en enkelt udvidet maskine, selvom der er en klar mulighed for at udvide denne tilgang over et bredere netværk:

En cluster-visning fra exo, der viser en lille ring af lokale Apple Silicon-maskiner, der sammen holder en enkelt model, med pipeline- eller tensor-sharding, der distribuerer lag på tværs af noder; i modsætning til WAN-baserede systemer, afhænger exo af hurtige lokale interconnects, der effektivt omdanner flere enheder til en enkelt sammensat inferensmaskine. Kilde

Endelig handler flere almindeligt citerede tilgange ikke overhovedet om inferens: det nu værdsatte (2016) Google FedAvg; MIT’s 2018-udgave SplitNN; og den australske tilbud fra 2020 SplitFed, beskæftiger sig med træningsdistribution eller privatlivsbeskyttende dataudveksling, snarere end at betjene live-inferensanmodninger.

Da træning er et langt mere ressourcekrævende perspektiv end inferens, kan enhver netværk, der kan distribuere en sådan byrde effektivt på tværs af cluster eller noder, have en ubetydelig andel af hobbyist- og erhvervsinteresse senere.

Konklusion

Fordi meget af teknologien i Silicon Valley var vild opfindelse, ved vi ikke, om PiedPiper virkelig var hash-drevet (dvs. opdeling og distribution af data i stykker, torrent-stil), eller om den ‘afsluttede’ en opgave eller selv en session på en given node på et given tidspunkt, hvilket er, hvad DarkBloom gør.

Men den nuværende kapløb om at levere trænings- og inferenshardware på datacenter-niveau indikerer, at leveringssektoren enten forventer at betjene alle, RunPod-stil, eller er i gang med at forberede den mest lukrative erhvervsniveau-levering – en fristende udsigt undermineret af den generelle mangel på volde i AI-udvikling.

Hvis mesh-inferens bliver en realitet, er det rimeligt at forvente, at blandt de første forsøg på at udnytte det vil være fra de etablerede spillere, såsom OpenAI og Anthropic, der enten kan udrulle dedikerede systemer inden for en eksisterende app-installationsbase eller samarbejde om open source-systemer, der er lette at installere (da selskaber af denne størrelse og rækkevidde har pengene og motivationen til at strømline svære installationer af denne type).

Om en mere demokratisk, bruger-dreven mesh-netværk kan opstå, en sand AI-lignende til BitTorrent – en række faktorer er imod det.

Først og fremmest kan den nuværende globale kampagne mod kryptering og anonymitet fjerne eller underminere mange af de mekanismer, der gør systemer som BitTorrent anonyme, såsom end-to-end-kryptering og VPN’er. Når de ‘generiske’ krypterede strømme, der skjuler sådanne protokoller, er åbne for inspektion, bliver nye lag af tilsyn og forbud mulige, og dette kan underminere appellen af et DarkBloom-lignende system.

For det andet betyder nye eller foreslåede regler mod ‘misbrug’ af AI eller mod anonym drift af open source-rammer, at omkostningerne ved overholdelse – ubetydelige på erhvervsniveau – sandsynligvis ville tage de mindre spillere af markedet.

Til sidst – den store sektors spillers evne til at omfavne, udvide og udrydde (EEE, som Facebook og Twitter åbenbart gjorde med mere ad hoc internet-samfund), betyder, at de nuværende store spillere kan operationalisere og strømline mesh-modellen til deres egen fordel, på et marked, hvor slutbrugere er næsten fuldstændigt intolerante over for enhver friktion i adoption.

Først udgivet torsdag, 16. april 2026