Kunstig intelligens

Vores underbevidste evner til at opdage Deepfakes kunne udgøre fremtidens automatiserede systemer

Ny forskning fra Australien antyder, at vores hjerner er dygtige til at genkende sofistikerede deepfakes, selv når vi bevidst tror, at billederne vi ser, er ægte.

Forskningen indebærer yderligere, at det er muligt at bruge menneskers neurale reaktioner på deepfake-ansigter (i stedet for deres udtalte mening) til at træne automatiserede deepfake-detektionssystemer. Sådanne systemer ville blive trænet på billedernes deepfake-karakteristika, ikke fra forvirrede skøn over sandsynligheden, men fra vores instinktive perceptuelle mekanismer for ansigtsigenkendelse.

‘[A]lthough the brain can ‘recognise’ the difference between real and realistic faces, observers cannot consciously tell them apart. Our findings of the dissociation between brain response and behaviour have implications for how we study fake face perception, the questions we pose when asking about fake image identification, and the possible ways in which we can establish protective standards against fake image misuse.’

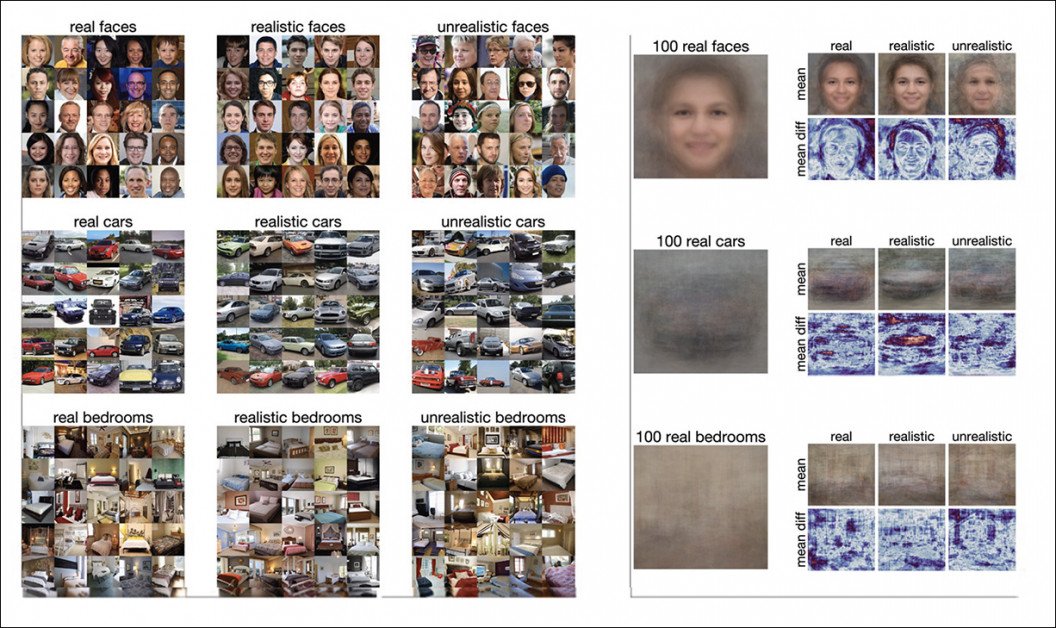

Resultaterne opstod i runder af test, der var designede til at evaluere, hvordan mennesker reagerer på falsk billedmateriale, herunder billeder af åbenlyst falske ansigter, biler, indre rum og vendte (dvs. upside-down) ansigter.

Various iterations and approaches for the experiments, which involved two groups of test subjects needing to classify a briefly-shown image as ‘fake’ or ‘real’. The first round took place on Amazon Mechanical Turk, with 200 volunteers, while the second round involved a smaller number of volunteers responding to the tests while hooked up to EEG machines. Source: https://tijl.github.io/tijl-grootswagers-pdf/Moshel_et_al_-_2022_-_Are_you_for_real_Decoding_realistic_AI-generated_.pdf

Artiklen fastslår:

‘Our results demonstrate that given only a brief glimpse, observers may be able to spot fake faces. However, they have a harder time discerning real faces from fake faces and, in some instances, believed fake faces to be more real than real faces.

‘However, using time-resolved EEG and multivariate pattern classification methods, we found that it was possible to decode both unrealistic and realistic faces from real faces using brain activity.

‘This dissociation between behaviour and neural responses for realistic faces yields important new evidence about fake face perception as well as implications involving the increasingly realistic class of GAN-generated faces.’

Artiklen foreslår, at det nye arbejde har ‘flere implikationer’ i anvendt cybersecurity, og at udviklingen af deepfake-læringsklassifikatorer måske burde drives af underbevidste reaktioner, som måles på EEG-optagelser i respons til falske billeder, snarere end af betragterens bevidste skøn over billedets sandhed.

Forfatterne kommenterer*:

‘This is reminiscent of findings that individuals with prosopagnosia who cannot behaviourally classify or recognise faces as familiar or unfamiliar nevertheless display stronger autonomic responses to familiar faces than unfamiliar faces.

‘Similarly, what we have shown in this study is that whilst we could accurately decode the difference between real and realistic faces from neural activity, that difference was not seen behaviourally. Instead, observers incorrectly identified 69% of the real faces as being fake.’

Det nye arbejde har titlen Are you for real? Decoding realistic AI-generated faces from neural activity, og kommer fra fire forskere på University of Sydney, Macquarie University, Western Sydney University og University of Queensland.

Data

Resultaterne opstod fra en bredere undersøgelse af menneskers evne til at skelne mellem åbenlyst falske, hyper-realistic (men stadig falske) og ægte billeder, gennemført over to runder af test.

Forskerne brugte billeder skabt af Generative Adversarial Networks (GANs), delt af NVIDIA.

GAN-generated human face images made available by NVIDIA. Source: https://drive.google.com/drive/folders/1EDYEYR3IB71-5BbTARQkhg73leVB9tam

Data bestod af 25 ansigter, biler og soveværelser, i niveauer af rendering fra ‘urealistiske’ til ‘realistiske’. Til ansigtsammenligning (dvs. for passende ikke-falsk materiale) brugte forfatterne udvalg fra NVIDIA’s kilde-data til Flickr-Faces-HQ (FFHQ) dataset. Til sammenligning af de andre scenarier brugte de materiale fra LSUN-dataset.

Billederne ville til sidst blive præsenteret for testpersonen enten på den rigtige måde eller vendt, og i en række frekvenser, med alle billeder formateret til 256×256 pixels.

Efter at alle materialer var samlet, blev 450 stimuli-billeder kurateret til testen.

Tests

Testene selv blev først gennemført online, gennem jsPsych på pavlovia.org, med 200 deltagere, der bedømte forskellige undermængder af den samlede testdata. Billederne blev præsenteret i 200 ms, efterfulgt af en blank skærm, der ville bestå, indtil betragteren traf en beslutning om, hvorvidt det flashede billede var falsk eller ægte. Hvert billede blev kun præsenteret én gang, og hele testen tog 3-5 minutter at gennemføre.

Den anden og mere afslørende runde brugte personlige testpersoner udstyret med EEG-monitore, og blev præsenteret på Psychopy2-platformen. Hver af de tyve sekvenser indeholdt 40 billeder, med 18.000 billeder præsenteret på tværs af hele testdatamængden.

De indsamlede EEG-data blev dekodet via MATLAB med CoSMoMVPA-værktøjskassen, ved hjælp af en leave-one-out cross-validation-skema under Linear Discriminant Analysis (LDA).

LDA-klassifikatoren var den komponent, der kunne skelne mellem hjernens reaktion på falske stimuli og testpersonens egen mening om, hvorvidt billedet var falsk.

Resultater

Interesserede i at se, om EEG-testpersonerne kunne skelne mellem de falske og ægte ansigter, behandlede forskerne og sammenfattede resultaterne og fandt, at deltagerne kunne skelne ægte fra urealistiske ansigter let, men åbenbart havde svært ved at identificere realistiske, GAN-genererede falske ansigter. Om billedet var vendt op og ned, syntes at have lille betydning.

Behavioral discrimination of real and synthetically-generated faces, in the second round.

Men EEG-data fortalte en anden historie.

Artiklen fastslår:

‘Although observers had trouble distinguishing real from fake faces and tended to overclassify fake faces, the EEG data contained signal information relevant to this distinction which meaningfully differed between realistic and unrealistic, and this signal appeared to be constrained to a relatively short stage of processing.’

Here the disparity between EEG accuracy and the reported opinion of the subjects (i.e. as to whether or not the face images were fake) are not identical, with the EEG captures getting nearer to the truth than the manifest perception of the people involved.

Forskerne konkluderer, at selv om betragterne måske har svært ved at ubevidst identificere falske ansigter, har disse ansigter ‘distinkte repræsentationer i det menneskelige visuelle system’.

Forskellen, der er fundet, har fået forskerne til at spekulere over den potentielle anvendelighed af deres fund for fremtidige sikkerhedsmechanismer:

‘In an applied setting such as cyber security or Deepfakes, examining the detection ability for realistic faces might be best pursued using machine learning classifiers applied to neuroimaging data rather than targeting behavioural performance.’

De konkluderer:

‘Understanding the dissociation between brain and behaviour for fake face detection will have practical implications for the way we tackle the potentially detrimental and universal spread of artificially generated information.’

* Min konvertering af inline-citationer til hyperlinks.

First published 11th July 2022.