Kunstig intelligens

Google’s LipSync3D Tilbyder Forbedret ‘Deepfaked’ Mundbevægelsessynkronisering

Et samarbejde mellem Google AI-forskere og det indiske teknologiske institut i Kharagpur tilbyder en ny ramme til at syntetisere talehoveder fra lydindhold. Projektet sigter mod at producere optimerede og rimeligt ressourcerede måder at oprette ‘talehoved’-videoindhold fra lyd, til formålet med at synkronisere læbebevægelser med dubbede eller maskinoversatte lyd, og til brug i avatare, i interaktive applikationer og i andre realtidsmiljøer.

Kilde: https://www.youtube.com/watch?v=L1StbX9OznY

De maskinlæringsmodeller, der er trænet i processen – kaldet LipSync3D – kræver kun en enkelt video af målansigtet som inputdata. Dataforberedelsespipelinen adskiller udtrækning af ansigtsgeometri fra evaluering af belysning og andre aspekter af en inputvideo, hvilket muliggør mere økonomisk og fokuseret træning.

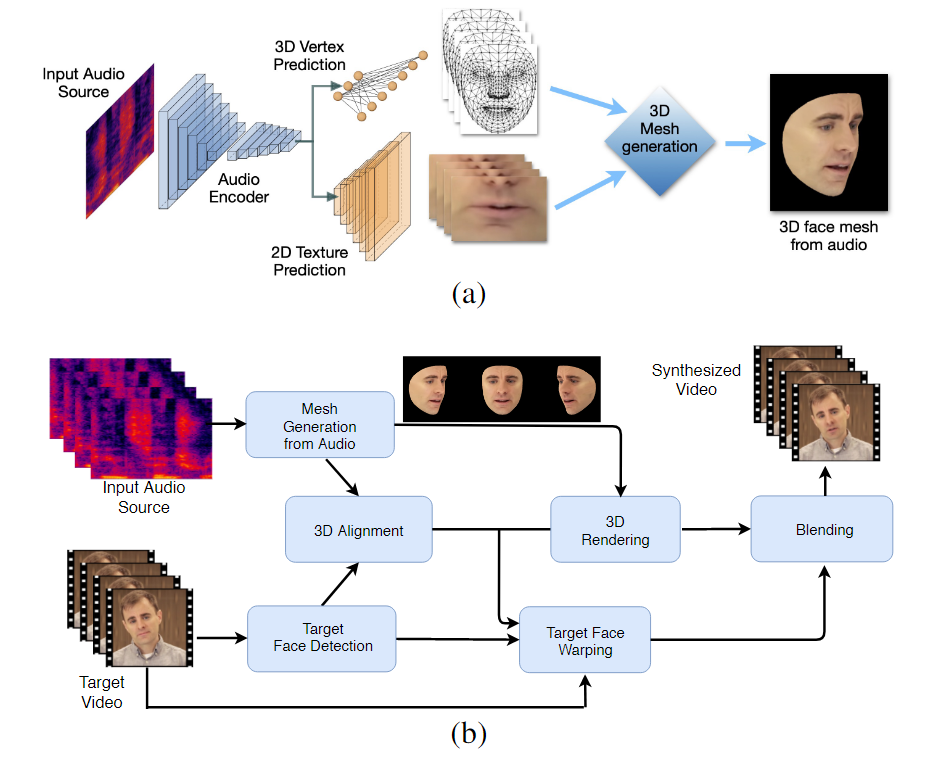

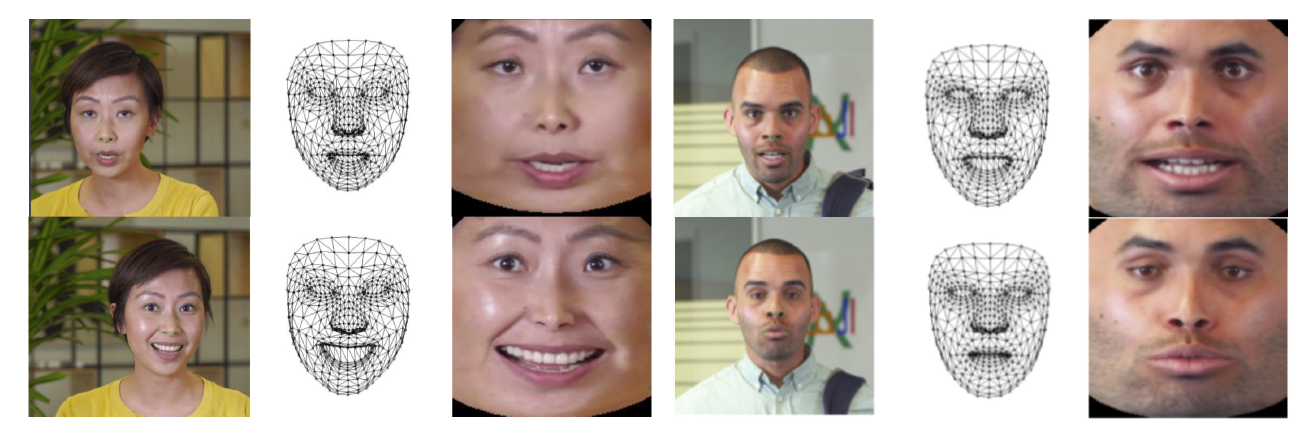

De totrinsede arbejdsgange i LipSync3D. Øverst, generering af en dynamisk tekstureret 3D-ansigt fra ‘mål’-lyden; nederst, indsættelse af den genererede mesh i en målvideo.

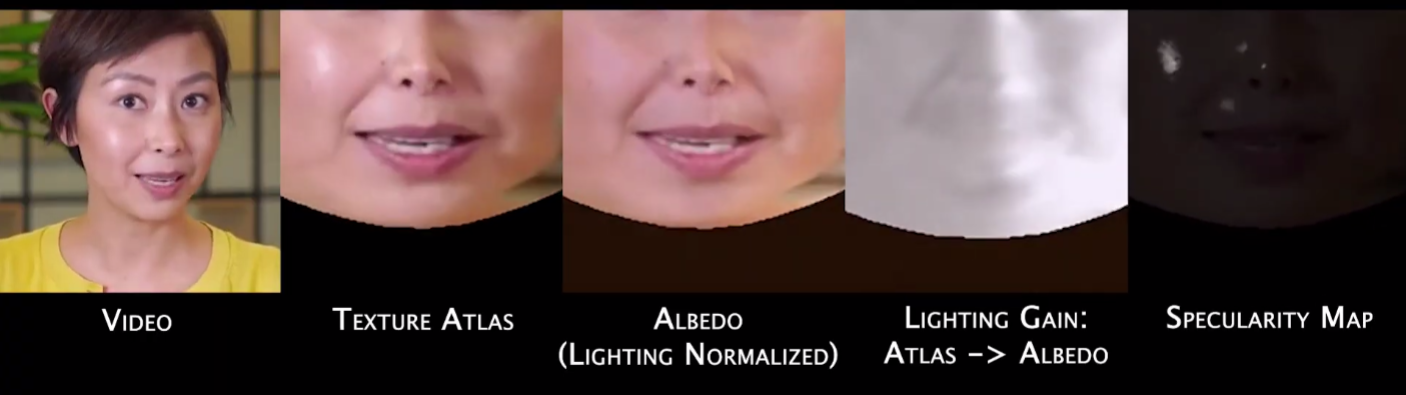

I virkeligheden kan LipSync3D’s mest bemærkelsesværdige bidrag til forskningssammenhængen på dette område være dets belysningsnormaliseringsalgoritme, som frakobler træning og slutledningsbelysning.

Frakobling af belysningsdata fra generel geometri hjælper LipSync3D med at producere mere realistiske læbebevægelser under udfordrende betingelser. Andre tilgange i de seneste år har begrænset sig til ‘faste’ belysningsbetingelser, som ikke afslører deres mere begrænsede kapacitet i denne henseende.

Under forarbejdning af inputdataframes skal systemet identificere og fjerne spekularpunkter, da disse er specifikke for belysningsbetingelserne under hvilke videoen blev optaget, og ellers vil forstyrre processen med omlyd.

LipSync3D, som navnet antyder, udfører ikke kun pixelanalyse på ansigterne, som det vurderer, men bruger aktivt identificerede ansigtslandemærker til at generere motile CGI-stilarter, sammen med ‘udfoldede’ teksturer, der er viklet omkring dem i en traditionel CGI-pipeline.

Posenormalisering i LipSync3D. Til venstre er inputframes og detekterede funktioner; i midten, normaliserede vertex af den genererede meshvurdering; og til højre, den tilsvarende tekst atlas, som giver grundsandheden for tekstforudsigelse. Kilde: https://arxiv.org/pdf/2106.04185.pdf

Ud over den nye relighting-metode hævder forskerne, at LipSync3D tilbyder tre hovedinnovationer i forhold til tidligere arbejde: adskillelse af geometri, belysning, pose og tekstur i separate datastrømme i et normalt rum; en lettrænet auto-regressiv tekstforudsigelsesmodel, der producerer tidsmæssigt konsistent video-syntese; og øget realisme, som vurderes af menneskelige vurderinger og objektive målinger.

At splitte de forskellige aspekter af videoansigtsbilleder giver større kontrol over video-syntese.

LipSync3D kan udlede passende læbegeometribevægelse direkte fra lyd ved at analysere fonemer og andre aspekter af tale, og oversætte dem til kendte tilsvarende muskelposer omkring mundområdet.

Denne proces bruger en joint-forudsigelsespipeline, hvor den påviste geometri og tekstur har dedikeret encodere i en autoencoder-opstilling, men deler en lydencoder med den tale, der er tiltænkt at påføres modellen:

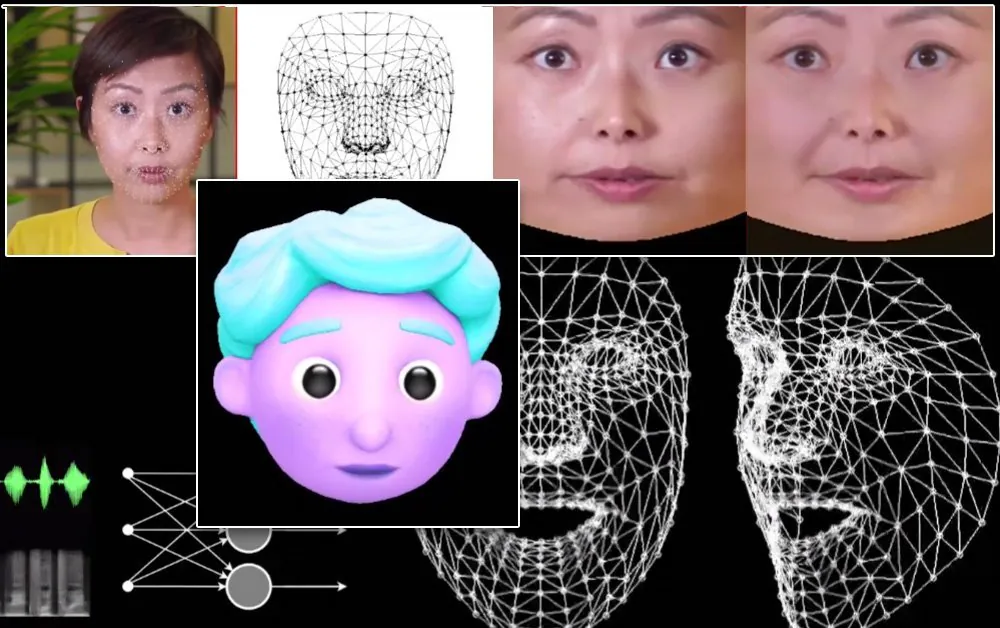

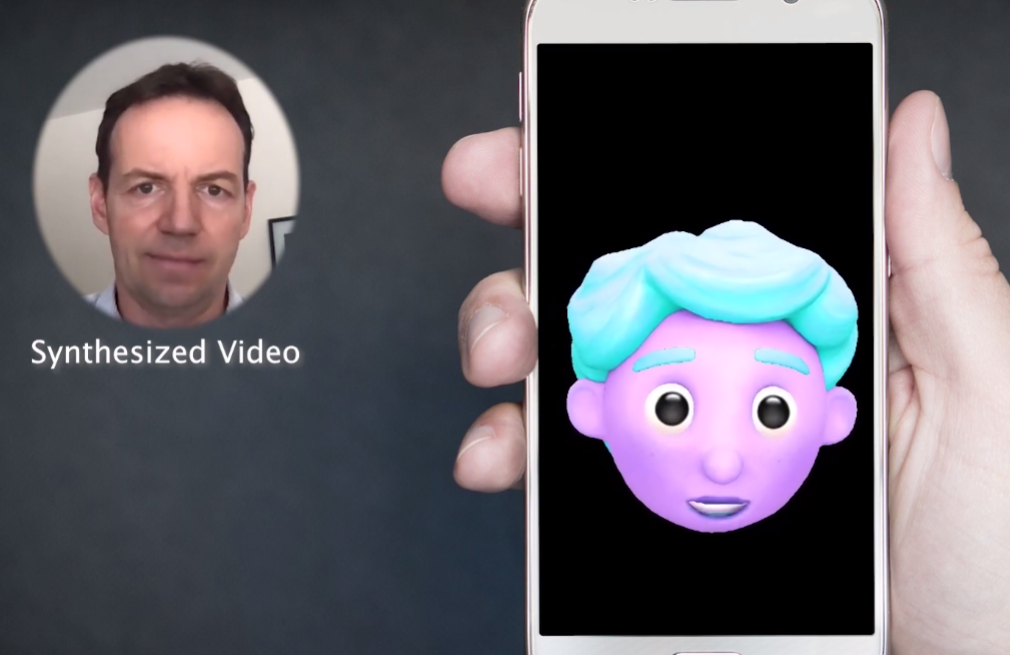

LipSync3D’s labile bevægelsessyntese er også tiltænkt at drive stiliserede CGI-avatare, der i virkeligheden kun er den samme type mesh- og teksturinformation som virkelige billeder:

En stiliseret 3D-avatar har sine læbebevægelser drevet i realtid af en kildevideo. I sådanne scenarier ville de bedste resultater opnås ved personlig fortræning.

Forskerne forventer også brugen af avatare med en lidt mere realistisk fornemmelse:

![]()

Prøvetræningstider for videoer varierer fra 3-5 timer for en 2-5 minutters video, i en pipeline, der bruger TensorFlow, Python og C++ på en GeForce GTX 1080. Træningssessionerne brugte en batchstørrelse på 128 frames over 500-1000 epocher, hvor hver epoch repræsenterer en komplet vurdering af videoen.

Mod Dynamisk Om-Synkronisering Af Læbebevægelse

Området for om-synkronisering af læber for at tilpasse en ny lydspor har fået megen opmærksomhed i computerseende forskning i de seneste år (se nedenfor), ikke mindst fordi det er et biprodukt af kontroversiel deepfake-teknologi.

I 2017 præsenterede University of Washington forskning, der var i stand til at lære læbesynkronisering fra lyd, og brugte det til at ændre læbebevægelserne på daværende præsident Obama. I 2018 ledte Max Planck Institute for Informatics en anden forskningsinitiativ til at aktivere identitets-til-identitetsvideooverføring, med læbesynkronisering som et biprodukt af processen; og i maj 2021 afslørede AI-startup FlawlessAI sin proprietære læbesynkronisationsteknologi TrueSync, som blev bredt modtaget i pressen som en muliggører af forbedrede dubningsteknologier for store filmudgivelser på tværs af sprog.

Og, naturligvis, den fortsatte udvikling af åbne deepfake-repositorier giver endnu en gren af aktivt bidragende forskning i denne sfære af ansigtssyntese.