Cybersecurity

Google beskriver sikkerhedsarkitekturen for Chromes AI-agentfunktioner

Google har offentliggjort en detaljeret sikkerhedsramme for Chromes kommende AI-funktioner, der introducerer flere forsvarslag, der er designet til at beskytte brugere, når Gemini-drevne agenter udfører autonome browsingopgaver.

meddelelse fra Chromes sikkerhedsingeniør Nathan Parker skitserer fire centrale sikkerhedssøjler, der vil styre, hvordan AI-agenter interagerer med websteder på brugernes vegne. Arkitekturen adresserer risici, der har plaget tidlige agentsystemer, herunder prompt injection attacks, uautoriseret dataadgang og svigagtige transaktioner.

Googles tilgang kommer i et kapløb om at levere browserbaserede AI-agenter. OpenAI lancerede ChatGPT Atlas i oktober med agenttilstandsfunktioner, mens Perplexity udsendte sin Comet-browser i juli. Sikkerhedsrammen signalerer Googles intention om at handle mere forsigtigt end konkurrenter, hvis agentfunktioner forskere allerede har vist er sårbare over for udnyttelse.

Fire søjler inden for agentsikkerhed

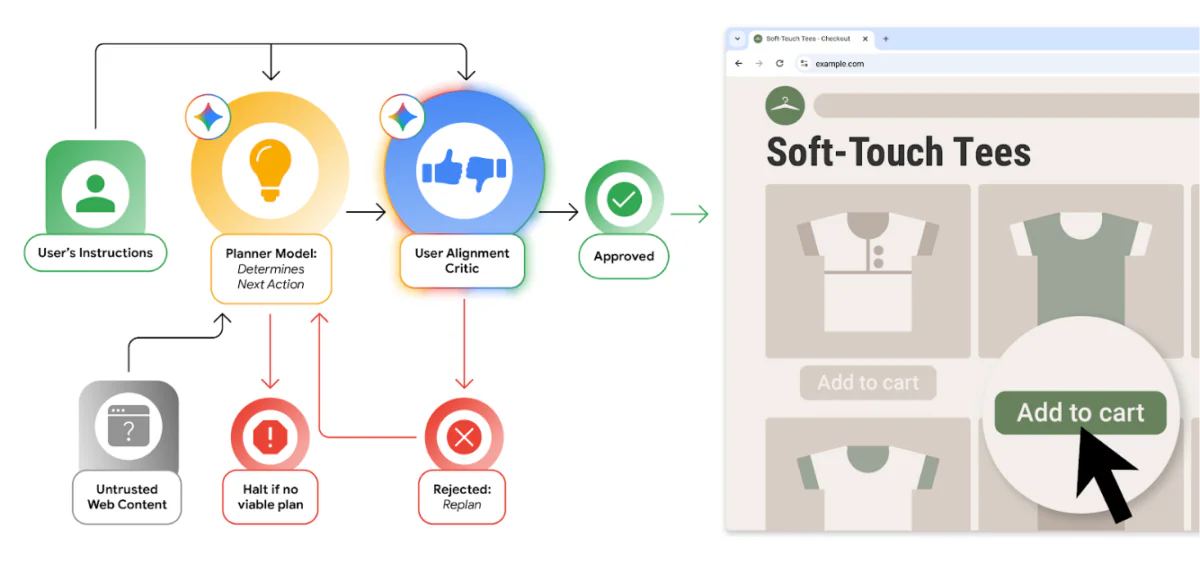

Brugerjusteringskritikeren danner det første forsvarslag – en separat Gemini-model, der gennemgår alle handlinger, som den primære AI-agent foreslår. Denne kritiker opererer isoleret og undersøger kun metadata om foreslåede handlinger i stedet for indhold på hele siden, hvilket reducerer eksponeringen for ondsindede input. Hvis en handling virker risikabel eller irrelevant i forhold til brugerens erklærede mål, kan kritikeren beordre et nyt forsøg eller returnere kontrollen til brugeren.

Oprindelsessæt begrænser, hvilke websteder og sideelementer en agent kan tilgå under en given opgave. Systemet skelner mellem skrivebeskyttede oprindelser, hvor agenten kan forbruge indhold, og læse-skrivbare oprindelser, hvor den kan foretage handlinger. Ikke-relaterede websteder og iframes tilbageholdes fuldstændigt, og en betroet gating-funktion kræves for at godkende adgang til nye domæner. Dette forhindrer datalækage på tværs af websteder og begrænser potentiel skade fra en kompromitteret agent.

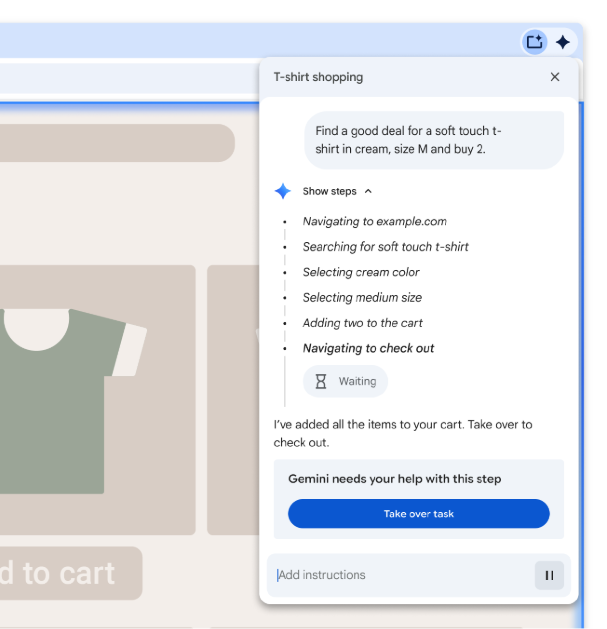

Brugerovervågning kræver manuel bekræftelse for følsomme handlinger. Når en agent støder på bankportaler, websteder med medicinske data eller har brug for at få adgang til gemte loginoplysninger fra Google Password Manager, sætter Chrome på pause og beder brugerne om at godkende handlingen. Det samme gælder, før der foretages køb eller sendes beskeder – agenten kan ikke udføre disse handlinger autonomt.

Prompt Injection Detection anvender en dedikeret klassificering, der scanner sider i realtid for indirekte prompt injection-forsøg. Dette system fungerer sammen med Chromes eksisterende Safe Browsing-infrastruktur og svindeldetektion på enheden for at blokere mistænkt skadeligt indhold, før agenten kan reagere på det.

Automatiseret Red-Teaming og Bug Bounties

Google udviklede automatiserede red-teaming-systemer, der genererer testsites og LLM-drevne angreb for løbende at validere sikkerhedsarkitekturen. Virksomheden prioriterer test af angrebsvektorer, der kan forårsage varig skade, især dem, der er rettet mod finansielle transaktioner eller tyveri af legitimationsoplysninger.

Chromes automatiske opdateringsmekanisme vil hurtigt levere rettelser, når nye sårbarheder opdages. For at fremme ekstern sikkerhedsforskning har Google annonceret dusørudbetalinger på op til $20,000 til forskere, der identificerer svagheder i agentens browsing-framework.

De defensive foranstaltninger afspejler erfaringer fra tidlige AI-browserudvidelser og chatbot-integrationer, hvor prompt injection-angreb viste sig overraskende effektive til at manipulere AI-adfærd. Ved at isolere kritikermodellen og begrænse adgangen til oprindelsessteder på browserniveau sigter Google mod at forhindre, at selve websiden bliver en angrebsflade.

Implikationer for kapløbet om AI-browsere

Googles detaljerede sikkerhedsoplysninger står i kontrast til den relative uigennemsigtighed omkring konkurrerende agentiske browsersystemer. Virksomheden ser ud til at satse på, at virksomheder og sikkerhedsbevidste brugere vil værdsætte gennemsigtige sikkerhedsforanstaltninger frem for de første, der er i gang.

Arkitekturen antyder også, hvad Google anser for acceptabel autonomi for AI-agenter. Shopping, research og udfyldning af formularer kan foregå under opsyn, men alt, der berører finansielle konti, sundhedsdata eller lagrede legitimationsoplysninger, kræver eksplicit menneskelig godkendelse. Dette trækker en klar linje, som andre leverandører har været mindre villige til at definere offentligt.

For udviklere, der bygger på Chromes platform, kræver oprindelsesbegrænsningerne nøje overvejelse af, hvordan agentfunktioner interagerer med arbejdsgange på flere websteder. Applikationer, der forventer, at agenter frit kan navigere på tværs af domæner, kan have brug for arkitektoniske ændringer for at fungere inden for Googles sikkerhedsmodel.

Google har ikke annonceret en specifik lanceringsdato for agentiske browsingfunktioner i Chrome, men den detaljerede sikkerhedsramme antyder, at implementeringen nærmer sig. Virksomhedens villighed til at offentliggøre defensiv arkitektur før lanceringen indikerer tillid til tilgangen – og en implicit udfordring til konkurrenterne om at matche dens gennemsigtighed.