Kunstig intelligens

Disney kombinerer CGI med neuralt rendering for at tackle ‘Uncanny Valley’

Disney’s AI-forskningsafdeling har udviklet en hybridmetode til filmkvalitetsansigtssimulation, der kombinerer styrkerne fra ansigtsneuralt rendering med konsistensen af en CGI-baseret tilgang.

Den ventede artikel har titlen Rendering med stil: Kombination af traditionelle og neurale tilgange for højkvalitetsansigtsrendering, og er forhåndsvist i en ny 10-minutters video på Disney Research YouTube-kanalen (indlejret i slutningen af denne artikel*).

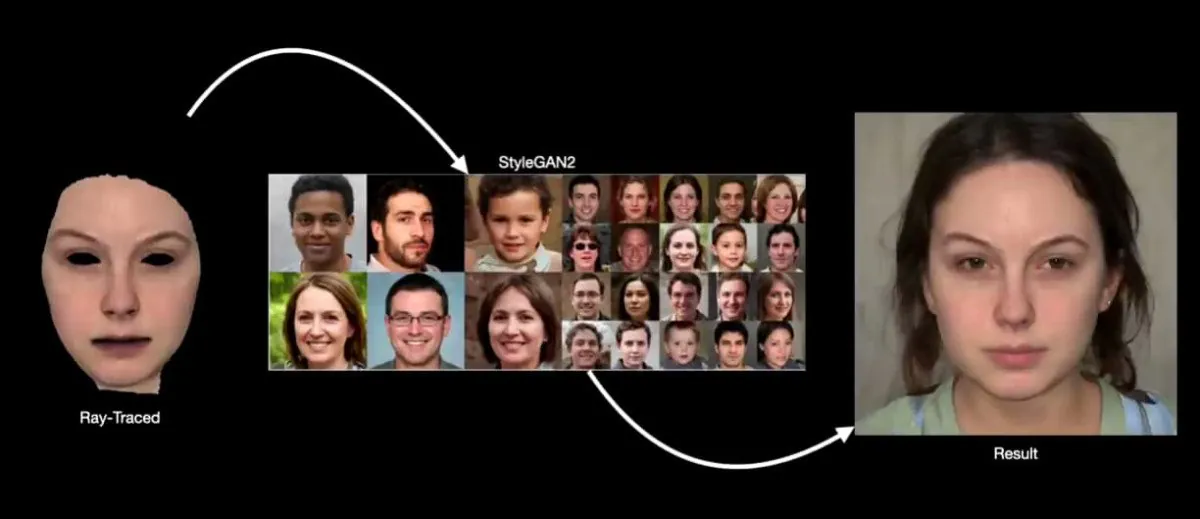

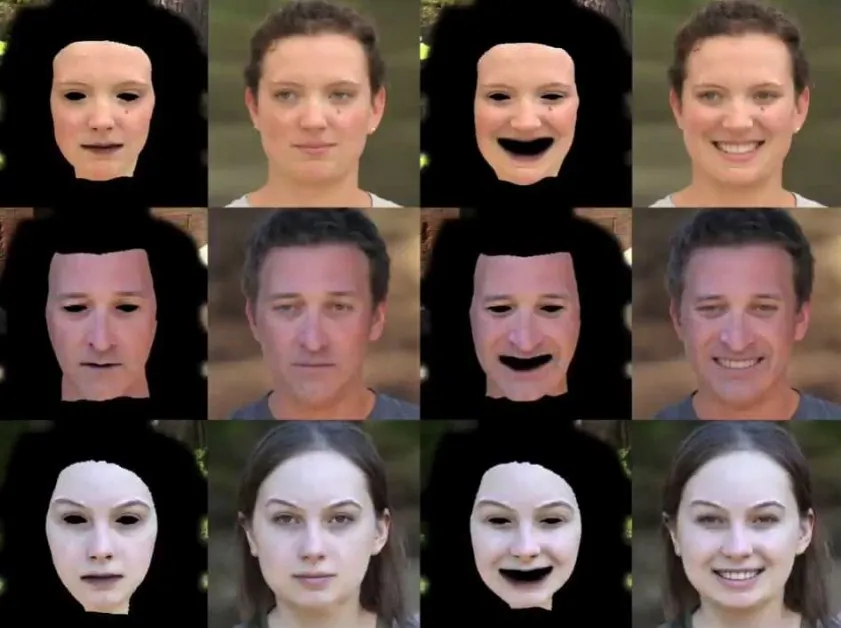

Meshes kombineret med neurale ansigtsrender. Se videoindlejring i slutningen af artiklen for bedre detalje og kvalitet. Kilde: https://www.youtube.com/watch?v=k-RKSGbWLng (erstattet af https://www.youtube.com/watch?v=TwpLqTmvqVk)

Som videoen bemærker, kan neuralt rendering af ansigter (herunder deepfakes) producere langt mere realistiske øjne og mundindhold end CGI er i stand til, mens CGI-drevne ansigtsteksturer er mere konsistente og egnede til cinema-niveau VFX-udgang.

Derfor eksperimenterer Disney med at lade NVIDIA’s StyleGan2 neuralt generator håndtere de omgivende træk af et ansigt og de ‘livskritiske’ elementer som øjne, mens de overlejrer konsistente CGI-ansigtshud og relaterede elementer i udgangen.

Fra videoen (se slutningen af artiklen), den arkitektoniske koncept bag Disney’s hybridtilgang, hvor en gammeldags CGI-mesh, af den type der blev brugt til at genskabe ‘ung’ Carrie Fisher og den afdøde Peter Cushing til Rogue One (2016), integreres i neuralt-renderede ansigtsmiljøer.

Videoen gør en underforstået henvisning til hyppig kritik af uauthenticiteten og ‘uncanny valley’-effekten af CGI-gengivelsen af den afdøde britiske Star Wars-skuespiller Peter Cushing i Rogue One (2016), og indrømmer:

‘[Der er] stadig et enormt gap mellem, hvad folk kan lette fange og rendre, og endelige fotorealistiske digitale dobbeltgængere, komplet med hår, øjne og indre mund. For at lukke dette gap, kræver det normalt en masse manuelt arbejde fra dygtige kunstnere.’

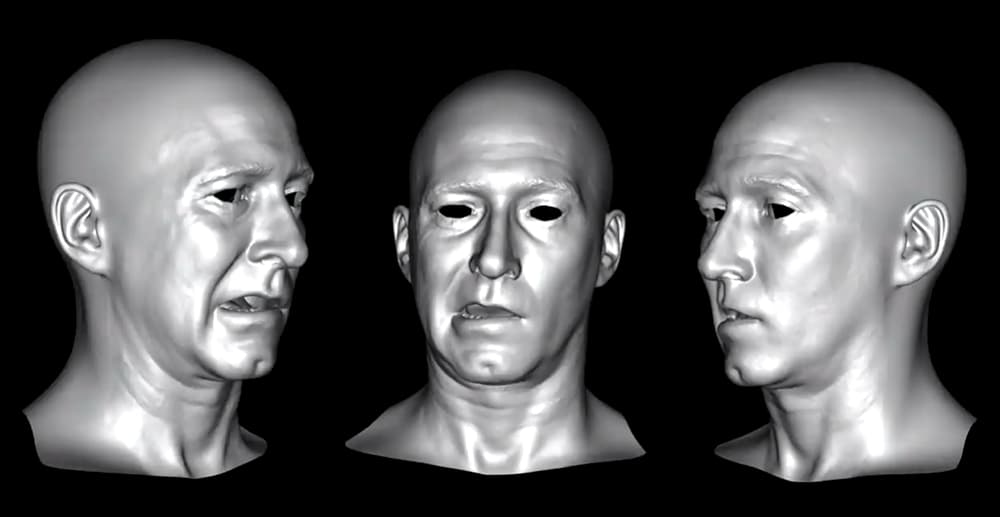

I virkeligheden gør selv de mest moderne ansigtscapturing-systemer ikke engang forsøg på at genskabe øjne, mundindhold eller hår, som enten har problemer med autenticitet i sådanne teknikker (øjne) eller også af temporær konsistens (hår).

Videoen illustrerer, hvad VFX-kunstnere får efter en typisk moderne ansigtscaptionsession. Øjne, hår, ansigtsbehåring og mundindhold skal alle håndteres af separate hold i produktionspipeline, samt tekstur og belysning.

Belysningskontrol

Den hybridtilgang er også en fordel med relighting – en bemærkelsesværdig udfordring for neuralt rendering af ansigter, da CGI-hudoverlæg kan være lettere at relitte.

En animeret version af CGI/Neural-tilgangen.

I mere udfordrende miljøer, såsom udendørs optagelser, har forskerne udviklet en metode til at inpainte omkring en slags demilitariseret zone omkring personen, der ‘skabes’.

En sort kant genereres for at give en ‘canvas’ til at inpainte de ydre dele af identiteten og integrere CGI-huden i den kombinerede CGI/neurale udgang.

Videoen bemærker:

‘[Den] neurale render matcher ikke baggrundsbegrænsningen perfekt. – det er kun ment som en vejledning, da optimering for realistiske menneskelige komponenter som hår, øjne og tænder er det primære mål. Endnu mere udfordrende er at forsøge at opretholde en konsistent identitet, mens man ændrer miljøbelysning.’

Oprettelse af CGI-mesh fra neurale render

Forskningsholdet har også udviklet en variationel autoencoder trænet på en (uspecificeret) stor database af 3D-ansigtsbilleder og hævder, at det kan producere ’tilfældige men plausiblen’ 3D-ansigtsmesh fra grundsandhedsdata.

Der er begrænsninger for denne forskning at overvinde, herunder vanskeligheden ved at få hår til at forblive temporært konsistent i de neurale renderinger, og videoen (se nedenfor) viser flere eksempler på hurtigt muterende hår i en ellers konsistent panorering af et CGI/neuralt ansigt.

Temporær konsistens i neuralt videorendering er et langt større problem end blot Disney’s, og det synes sandsynligt, at senere iterationer af dette system kan føre til at tilføje hår ‘i post’, eller forskellige andre mulige tilgange til hårgenerering end at håbe, at en ny neuralt tilgang vil løse det.

Brug til datasætgenerering

Metoden foreslås også som en potentiel metode til at generere syntetiske data og berige ansigtets billedsætlanskap, som i de seneste år er blevet farligt ensartet.

Disney forestiller sig, at den nye teknik befolker ansigtets billedsæt.

‘[Hver] fotorealistisk resultat, vi genererer, har en underliggende korresponderende geometri og udseendekort, renderet fra ukendte kameraudsigtspunkter med kendt belysning. Denne ‘grundsandhedsinformation’ kan være vital for at træne downstream-applikationer, såsom monokulær, 3D-ansigtsrekonstruktion, ansigtsgenkendelse eller sceneforståelse. Og så hver renderresultat kan betragtes som en datasætprøve, og vi kan generere mange variationer af mange forskellige individer.

‘Desuden kan vi, selv for en enkelt person renderet i en enkelt udtryk med en enkelt udsigtspunkt og belysning, generere tilfældige variationer af foto-real render ved at variere randomiseringsfrøet under optimering.’

Forskerne bemærker, at denne diversitet af konfigurerbar udgang kan være nyttig i træning af ansigtsgenkendelsesapplikationer og konkluderer:

‘[Vor] metode kan udnytte nuværende teknologi til ansigtshudfangning, modellering og rendering, og automatisk oprette komplette fotorealistiske ansigtsrender, der matcher den ønskede identitet, udtryk og scenekonfiguration. Denne tilgang har anvendelser og ansigtsrendering til film og underholdning, hvilket sparer manuelt arbejde for kunstnere og også til datasætgenerering i forskellige områder af dyb læring.’

For en dybere kig på den nye tilgang, se den 10-minutters video, der er udgivet i dag:

* Den originale videolink blev erstattet af en anden tilsyneladende identisk 8 timer efter, at artiklen blev offentliggjort. Jeg ændrede alle relevante links, da der ikke er nogen spor af den originale video.

8:24 GMT+2 – Erstattet video, da den blev skiftet ud af Disney Research YouTube-kanalen af en eller anden grund.