Kunstig intelligens

En Introduktion Til Vertex AI

Givet den hurtigt udviklende landskab af kunstig intelligens, er en af de største udfordringer, tech-ledere ofte står overfor, overgangen fra at være “eksperimenterende” til at være “enterprise-klar”. Mens forbrugerchatbots og interaktive platforme hjælper med offentlig imagination, kan virksomheder ikke lykkes med kun en chat-grænseflade. I en æra, hvor konkurrencen er mere aggressiv end nogensinde før, har virksomheder brug for et robust, skalerbart og sikker økosystem, og dette er, hvad Google forsøger at tilbyde med Vertex AI, Google Clouds unified kunstig intelligens og maskinlæringsplatform.

Vertex AI forsøger at solidificere sig selv som rygmarven for Generative AI-integration med moderne cloud-infrastruktur, og tilbyder et omfattende sæt funktioner, der brobygger mellem rå grundlæggende modeller og produktionsklar anvendelser. Vertex AI er ikke blot en wrapper for store sprogmodeller (LLM’er), men det er et unified Machine Learning og kunstig intelligens (ML/AI) økosystem, der behandler Generative AI som en førsteklasses borger i moderne cloud-infrastruktur.

I hjertet af Vertex AI sidder Model Garden, en central marked, der giver adgang til over 200 kuraterede grundlæggende modeller, herunder den multimodale kraftværk Gemini 2.5 Pro, der har en imponerende 2-million-token kontekstvindue. I denne artikel, vil vi dissekere arkitekturen af Vertex AI, udforske, hvordan Model Garden fungerer som branchens “App Store” for intelligens, og se på de tekniske piller, der gør denne platform til rygmarven for den næste generation af enterprise-software.

Kernen Arkitektur: En Unified Platform

Vertex AI er ikke en løst koblet samling af værktøjer, men en unified data og AI-økosystem designet til at brobygge fragmenteringen af data, værktøjer og hold, der plager maskinlæring til denne dag. Traditionelt foregår AI-udvikling i isolerede miljøer, og nogle gange er dataene spredt og fanget over multiple lager. For eksempel kan organisationer gemme kundedata i SQL-lager, mens de ikke-strukturerede dokumenter dumpes i en Data Lake. Når data er isolerede, ser AI kun en “delvis sandhed”, hvilket fører til forvrængede resultater eller høje hallucinationsrater, fordi det mangler den fulde kontekst af virksomheden.

Vertex AI forsøger at integrere hele livscyklussen, fra rå data-indtagelse i BigQuery og Cloud Storage til produktionsovervågning, og fungerer essentielt som en “sammenkoblingsvæv” mellem disse siloer. Vertex AI integrerer naturligt med Cloud Storage og BigQuery, og giver AI-modellerne mulighed for at hente data uden komplekse Extraction, Transformation og Load-pipelines.

Fundamentet: Google’s AI Hypercomputer

GenAI-laget af Vertex AI sidder på toppen af Google’s AI Hypercomputer-arkitektur, et integreret supercomputersystem, der består af:

TPU v5p & v5e (Tensor Processing Units)

Google’s Tensor Processing Units er specialbyggede ASIC’er (Application-Specific Integrated Circuits) designet specifikt til matrix-multiplication, der definerer dyb læring.

- TPU v5p (Performance): Dette er det flagskib-akselerator for massive-skala træning. Hver TPU v5p-pod kan skaleres til 8.960 chips, der er forbundet med Google’s højeste-båndbredds Inter-Chip Interconnect (ICI) på 4.800 Gbps. For en tech-lead, betyder dette 2,8 gange hurtigere træning for en GPT-3-størrelsesmodel (175B parametre) sammenlignet med den forrige generation, hvilket drastisk reducerer tiden til markedet.

- TPU v5e (Efficiency): Designet til “omkostningsoptimeret” ydelse, er v5e arbejdshesten for medium-skala træning og høj-gennemstrømning. Det tilbyder op til 2,5 gange bedre pris-ydelse, hvilket gør det til det ideelle valg for virksomheder, der skal køre 24/7-inferens uden en massive budget.

NVIDIA H100/A100 GPUs for Fleksibilitet

Mens TPUs er specialiserede, afhænger mange udviklingsteams af NVIDIA CUDA-økosystemet. Vertex AI tilbyder førsteklasses support for NVIDIA’s seneste hardware:

- NVIDIA H100 (Hopper): Ideel til finjustering af de største åbne kilde-modeller (som Llama 3.1 405B) som kræver massive hukommelsesbåndbredder.

- Jupiter Networking: For at forhindre “Network Bottleneck”, bruger Google sin Jupiter datacenter-netværksstof. Dette sikrer, at data flytter mellem GPU’er med lynhastighed, og understøtter RDMA (Remote Direct Memory Access) for at omgå CPU-overhead og levere næsten lokal ydelse på tværs af distribuerede noder.

Dynamic Orchestration

Den mest kritiske tekniske skift i Vertex AI er Dynamic Orchestration. I et legacy-miljø, hvis en GPU-node fejler under en 3-ugers træningsløb, kan hele jobbet fejle.

- Automatisk Resiliens: Vertex AI, ofte drevet af Google Kubernetes Engine (GKE) under dækket, har “Selvhelende” noder. Hvis en hardware-fejl er registreret, migrerer platformen automatisk arbejdsbyrden til en sund node.

- Dynamic Workload Scheduler: Dette værktøj giver hold mulighed for at anmode om kapacitet baseret på urgency. Du kan vælge Flex Start (billigere, starter når kapacitet er tilgængelig) eller Garanteret Kapacitet for mission-kritiske udgivelser.

- Serverless Træning: For hold, der ønsker zero infrastruktur-styring, giver Vertex AI Serverless Træning mulighed for at indsende din kode og data; platformen giver clusteren, kører jobbet og river det ned—og kun opkræver for den beregnede tid, der er brugt.

De Tre Indgangspunkter: Opdagelse, Eksperimentering og Automatisering

For at tilpasse sig forskellige tekniske personer—fra datavidenskabsmænd til applikationsudviklere—giver Vertex AI tre primære indgangspunkter:

- Model Garden: Marketplace for Opdagelse.

- Vertex AI Studio: Legepladsen for Eksperimentering.

- Vertex AI Agent Builder: Fabrikken for Automatisering.

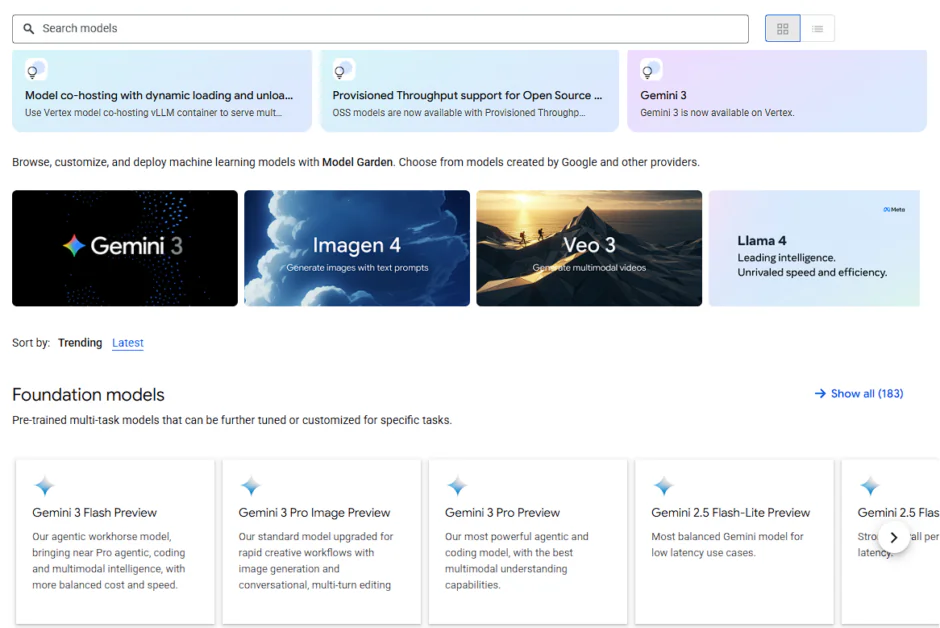

Model Garden: Marketplace for Opdagelse

Google Clouds Vertex AI Model Garden er en central platform inden for Google Cloud for at opdage, teste, tilpasse og deployere en bred vifte af førsteklasses, åbne kilde- og tredjeparts AI-modeller, herunder multimodale modeller (vision, tekst, kode) til forskellige forretningsbehov, og tilbyder samarbejdende integration med Vertex AI’s værktøjer for strømlinet MLOps. Det fungerer som en omfattende bibliotek, der hjælper udviklere og virksomheder med at vælge den rette model (fra store grundlæggende modeller til specialiserede modeller) til deres opgaver, uanset om det er til tekstgenerering, billedanalyse eller kodeafslutning, og deployere dem effektivt inden for deres Google Cloud-miljø.

Model Garden kategoriserer sine 200+ modeller i tre distinkte lag, og giver arkitekter mulighed for at balancere ydelse, omkostning og kontrol:

- Førsteklasses (Google) Modeller: Disse er de flagskib multimodale modeller tilgængelige inden for Vertex AI, og Google tilbyder dem i forskellige størrelser, fra Pro med kompleks reasoning til Flash med lav forsinkelse og høj volumen, og giver udviklere mulighed for at optimere deres modeller efter deres brugstilfælde.

- Tredjeparts (Ejerskab) Modeller: Gennem strategiske partnerskaber tilbyder Vertex AI “Model-as-a-Service” (MaaS) adgang til giganters som Anthropic (Claude 3.5) og Mistral AI. I stedet for at styre separate regninger og sikkerhedslegitimationer for fem forskellige AI-udbydere, kan et tech-hold få adgang til alle disse gennem deres eksisterende Google Cloud-projekt, ved hjælp af en samlet API-format.

- Åben Kilde & Åben Vægt Modeller: Dette lag inkluderer Meta’s Llama 3.2, Mistral, og Google’s egen Gemma. Disse er ideelle for organisationer, der ønsker at selv-deployere modeller inden for deres eget VPC (Virtual Private Cloud) for at sikre maksimal data-isolation.

I et ikke-unified miljø kræver implementering af en åben kilde-model som Llama opsætning af en PyTorch-miljø, konfiguration af CUDA-drivere og styring af en Flask eller FastAPI-wrapper.

Model Garden eliminerer denne “Munging”-fase gennem Unified Managed Endpoints:

- One-Click Deployment: For mange modeller giver klik på “Deploy” automatisk provisionering af de nødvendige TPU/GPU-resourcer, wrapper modellen i en produktionsklar container og giver en REST API-endpoint.

- Hugging Face Integration: Vertex AI giver nu udviklere mulighed for at deployere modeller direkte fra Hugging Face Hub til en Vertex-endpoint, og giver en næsten uendelig udvidelse af tilgængelig intelligens.

- Private Service Connect (PSC): For højt regulerede brancher kan modeller deployeres ved hjælp af Private Service Connect, og sikrer, at model-endpointen aldrig er eksponeret for det offentlige internet—og holder data-trafikken strengt inden for det corporate netværk.

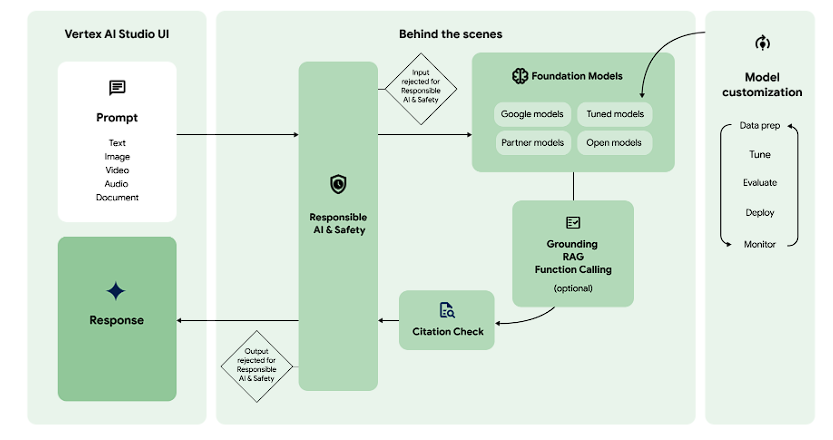

Vertex AI Studio: Legepladsen for Eksperimentering

Mens Model Garden handler om udvalg, handler Vertex AI Studio om præcision. Vertex AI Studio kan sammenlignes med compilerne og debuggere, du kommer ud for i den traditionelle software-verden. Vertex AI Studio er arbejdspladsen, hvor rå modeller skæres til specifikke forretningsværktøjer gennem en kombination af prompt-engineering, multimodal test og avanceret hyperparameter-justering.

Multimodal Prototyping: Beyond Text

En af Studie’s fremhævede funktioner er dens native support for multimodality. Mens andre platforme kræver kompleks kodning for at håndtere ikke-tekstdata, giver Vertex AI Studio mulighed for at slippe filer direkte ind i grænsefladen for at teste Gemini 2.5‘s raisonneringsfunktioner.

- Video Intelligence: Du kan uploade en 45-minutters teknisk keynote og bede modellen om at “identificere hver gang et bestemt API er nævnt og give en tidsstempel-summarisk.”

- Dokumentanalyse: I stedet for kun at læse tekst, kan modellen analysere den visuelle layout af en 1.000-siders PDF, og forstå forholdet mellem diagrammer, tabeller og den omgivende prosa.

- Kodekørsel: Studio understøtter nu kodekørsel i legepladsen. Hvis du beder en model om at løse et komplekst matematisk problem eller analysere en CSV, kan modellen skrive og køre Python-kode i en sikker sandbox-miljø for at give en verificeret besked.

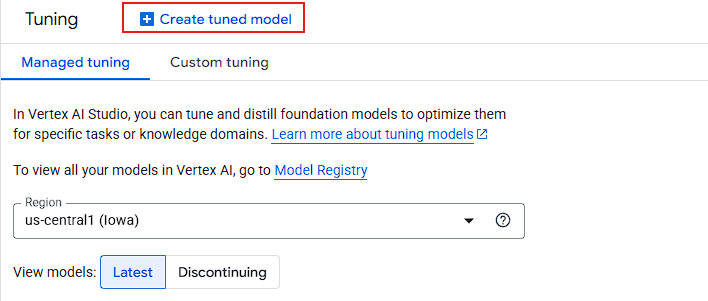

Avanceret Tilpasning: Tuning Pathway

Når prompt-engineering (Zero-shot eller Few-shot) rammer en loft, giver Vertex AI Studio den tunge maskine: Model Tuning.

- Supervised Fine-Tuning (SFT): Udviklere giver en dataset af “Prompt/Svar” par (ideelt 100+ eksempler). Dette lærer modellen at antage en bestemt brand-lyd, output-format (som specialiseret JSON) eller domænespecifik jargon.

- Context Caching: For virksomheder, der har at gøre med massive, statiske datasets (som en juridisk bibliotek eller en kodebase), giver Studio mulighed for Context Caching. Dette giver mulighed for at “forindlæse” en million tokens af data i modellens hukommelse, og reducerer dramatisk forsinkelsen og omkostningerne for efterfølgende forespørgsler.

- Destillation (Lærer-Elev): Dette er en højniveau-arkitektonisk bevægelse. Du kan bruge en kæmpe model (Gemini 2.5 Pro) til at “undervise” en mindre, hurtigere model (Gemini 2.0 Flash). Resultatet er en letvægtsmodel, der yder på et “Pro”-niveau, men kører med “Flash”-hastighed og omkostning.

Vertex AI Agent Builder: Fabrikken for Automatisering

Vertex AI Agent Builder er et højniveau-orchestrationsframework, der giver udviklere mulighed for at oprette disse agenter ved at kombinere grundlæggende modeller med virksomhedsdata og eksterne API’er.

Arkitekturen af “Sandhed”: Grounding & RAG

Den primære tekniske barriere for enterprise AI er hallucination. Agent Builder løser dette gennem en sofistikeret Grounding-motor.

- Grounding med Google Søgning: For forespørgsler, der kræver realtids-verdenskundskab (f.eks. “Hvad er de nuværende boliglånerenter i New York?”), kan agenten udføre en Google-søgning, extract fakta og citerer sine kilder.

- Vertex AI Søgning (RAG-as-a-Service): I stedet for manuelt at bygge en vektor-database (Pinecone, Weaviate), kan udviklere bruge Vertex AI Søgning til at indexere deres egne dokumenter (PDF’er, HTML, BigQuery). Det håndterer “chunking”, “embedding” og “retrieval”-trinnene automatisk, og sikrer, at agenten kun besvarer baseret på deres interne “Kilde til Sandhed”.

- Vertex AI RAG Motor: For højskala, tilpassede implementeringer giver denne managed service mulighed for hybrid-søgning (kombinerer vektorbaserede og nøgleordsbaserede resultater) for at forbedre nøjagtigheden med op til 30% over standard LLM-outputs.

Multi-Agent Orkestrering (A2A Protocol)

Avancerede enterprise-workflows kræver ofte multiple specialiserede agenter, der arbejder sammen. Vertex AI introducerer Agent-to-Agent (A2A) Protocol, en åben standard, der giver mulighed for:

- Den “Rejseagent” kan tale med “Finansagenten” for at sikre, at en flyreservation er inden for den corporate budget.

- Interoperabilitet: Fordi det bruger en åben protokol, kan agenter bygget på Vertex kommunikere med dem bygget på andre frameworks som LangChain eller CrewAI.

Udviklerstakken: ADK og Agent Motor

For “tech-platform”-publikummet giver Agent Builder to distinkte veje:

- Ingen-Kode-Konsol: En visuel drag-and-drop-grænseflade for hurtig prototypering og forretningsbruger-konfiguration.

- Agent Udviklingskit (ADK): En kode-først Python-værktøj for ingeniører. Det giver mulighed for “Prompt-as-Code”, version-kontrollintegration og mulighed for at deployere til Vertex AI Agent Motor—en managed runtime, der håndterer sessions-persistens, skalerbarhed og tilstands-styring automatisk.

Konklusion: Fra “Hvad hvis” til “Hvad er Næste”

Overgangen fra en flashy AI-demo til en produktionsklar enterprise-applikation har længe været “dødsdalen” for digitale transformationsprojekter. Som vi har udforsket, er Vertex AI designet specifikt til at brobygge denne kløft. Ved at unificere de fragmenterede siloer af data, infrastruktur og model-orchestration, har Google Cloud flyttet samtalen væk fra den rå kraft af Large Language Models og mod operationsmoden af AI-livscyklussen.