Kunstig intelligens

AI-forskning forestiller separate lydstyrkekontroller for dialog, musik og lydeffekter

Et nyt forskningssamarbejde ledet af Mitsubishi undersøger muligheden for at udtrække tre separate lydspor fra en original lydkilde, hvor lydsporet deles op i tale, musik og lydeffekter (dvs. baggrundsstøj).

Da dette er et post-facto procesramme, tilbyder det potentiale for senere generationer af multimedieafspillingsplatforme, herunder forbrugerudstyr, at tilbyde trepunkts lydstyrkekontrol, så brugeren kan højne lydstyrken på dialogen eller sænke lydstyrken på en soundtrack.

I den korte klip nedenfor fra den tilhørende video for forskningen (se slutningen af artiklen for fuld video), ser vi forskellige aspekter af lydsporet, der fremhæves, når brugeren trækker en kontrol over en trekant med hver af de tre lydkomponenter i en hjørne:

En kort klip fra videoen, der ledsager papiret (se indlejring i slutningen af artiklen). Når brugeren trækker markøren mod en af de tre udtrukne aspekter i trekantbrugerfladen (til højre), fremhæves den del af tripartite-lydsporet. Selvom den længere video citerer et antal eksempler på YouTube, synes de at være utilgængelige i øjeblikket. Source: https://vimeo.com/634073402

Den papir hedder The Cocktail Fork Problem: Three-Stem Audio Separation for Real-World Soundtracks, og kommer fra forskere ved Mitsubishi Electric Research Laboratories (MERL) i Cambridge, MA, og afdelingen for intelligente systemers ingeniørvidenskab ved Indiana University i Illinois.

At adskille aspekter af et lydspor

Forskerne har døbt udfordringen ‘The Cocktail Party Problem’, fordi det indebærer at isolere alvorligt sammenflettede elementer af et lydspor, hvilket skaber en vejviser, der ligner en gaffel (se billedet nedenfor). I praksis kan multikanalslydspor (dvs. stereo og mere) have forskellige mængder af typer af indhold, såsom dialog, musik og baggrundsstøj, især da dialog tenderer til at dominere centerkanalen i Dolby 5.1-miks. I øjeblikket koncentrerer den meget aktive forskningsfelt for lydseparation sig om at fange disse tråde fra en enkelt, bagt lydspor, som den nuværende forskning gør.

The Cocktail Fork – udledning af tre distinkte lydspor fra et sammenflettet og enkelt lydspor. Source: https://arxiv.org/pdf/2110.09958.pdf

Seneste forskning har koncentreret sig om at udtrække tale i forskellige miljøer, ofte til formål at rense talelyd for efterfølgende engagement med Natural Language Processing (NLP)-systemer, men også på isolation af arkivsangstemmer, enten for at skabe syntetiske versioner af virkelige (selv døde) sangere, eller for at facilitere Karaoke-stil musikisolation.

En dataset for hver aspekt

Indtil nu er der ikke blevet givet megen overvejelse til at bruge denne type AI-teknologi til at give brugerne mere kontrol over mixet af et lydspor. Derfor har forskerne formaliseret problemet og udviklet en ny dataset som hjælp til fortsat forskning i multi-type lydsporseparation, samt testet det på forskellige eksisterende lydseparationsrammer.

Den nye dataset, som forfatterne har udviklet, hedder Divide and Remaster (DnR), og er afledt fra tidligere datasets LibriSpeech, Free Music Archive og Freesound Dataset 50k (FSD50K). For dem, der ønsker at arbejde med DnR fra scratch, skal datasettet genopbygges fra de tre kilder; ellers vil det snart være tilgængeligt på Zenodo, som forfatterne hævder. Imidlertid er den tilgængelige GitHub-link for kildeudtrækningsværktøjer ikke aktiv i øjeblikket, så dem, der er interesseret, kan måske vente lidt.

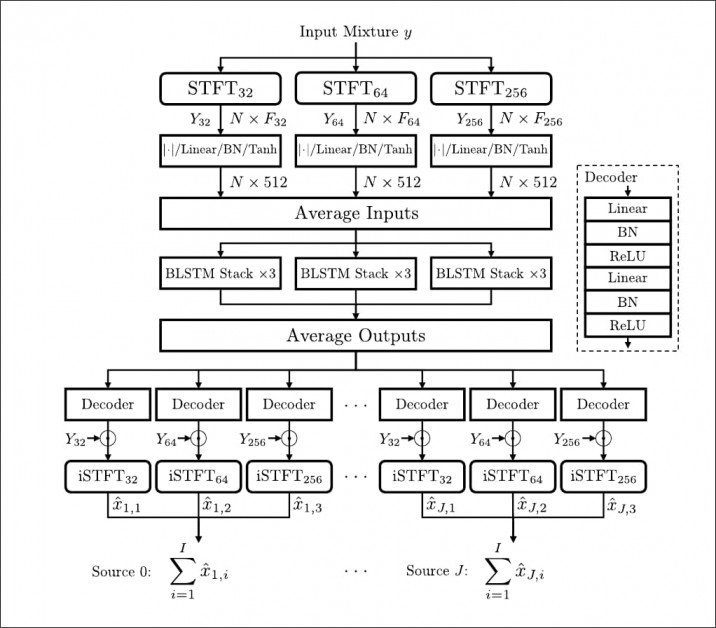

Forskerne har fundet, at CrossNet un-mix (XUMX)-arkitekturen, som Sony foreslog i maj, fungerer særligt godt med DnR.

Sonys CrossNet-arkitektur.

Forfatterne hævder, at deres maskinelæringsekstraktionsmodeller fungerer godt på lydspor fra YouTube, selvom evalueringerne, der præsenteres i papiret, er baseret på syntetisk data, og den leverede hovedstøttende video (indlejret nedenfor) er i øjeblikket den eneste, der synes at være tilgængelig.

De tre datasets, der blev brugt, består hver af en samling af den type output, der skal udtrækkes fra et lydspor: FSD50K er optaget af lydeffekter og indeholder 50.000 44,1 kHz mono-lydklip tagget med 200 klasselabel fra Googles AudioSet-ontologi; Free Music Archive indeholder 100.000 stereo-sange, der dækker 161 musikgenrer, selvom forfatterne har brugt en undermængde, der indeholder 25.000 sange, for lighed med FSD50K; og LibriSpeech giver DnR 100 timer af lydbogsprøver som 44,1 kHz mp3-lydfiler.

Fremtidig arbejde

Forfatterne forventer yderligere arbejde på datasettet og en kombination af de separate modeller, der er udviklet til yderligere forskning i talegenkendelse og lydklassificeringsrammer, der omfatter automatisk undertekstgenerering for tale og ikke-tale-lyde. De har også til hensigt at evaluere muligheder for remix-tilgange, der kan reducere perceptuelle artefakter, hvilket stadig er det centrale problem, når man deler et sammenflettet lydspor op i dets bestanddele.

Denne type separation kan i fremtiden være tilgængelig som en forbrugerartikel i smarte tv’er, der integrerer højttilegnede slutningsnetværk, selvom det synes sandsynligt, at tidlige implementeringer vil kræve en vis grad af forarbejdningstid og lagringsplads. Samsung bruger allerede lokale neurale netværk til opskalering, mens Sonys Cognitive Processor XR, der bruges i virksomhedens Bravia-serie, analyserer og genfortolker lydspor på en live-basis via letvægtsintegret AI.

Opfordringer til større kontrol over mixet af et lydspor gentager sig periodisk, og de fleste af løsningerne, der tilbydes, må have at gøre med, at lydsporet allerede er reduceret i overensstemmelse med nuværende standarder (og antagelser om, hvad seere ønsker) i film- og tv-industrien.

En seer, der var frustreret over den chokerende ulighed i lydniveauer mellem forskellige elementer af filmlydspor, blev desperat nok til at udvikle en hardware-baseret automatisk lydstyrkejuster, der kan equalisere lydstyrken for film og tv.

Selvom smarte tv’er tilbyder en diversificeret række af metoder til at forsøge at forstærke dialoglydstyrken mod store lydniveauer for musik, kæmper de alle imod de beslutninger, der er truffet på mixtidspunktet, og, kan man argumentere for, de visioner, som indholdsproducenter ønsker, at publikum skal opleve deres lydspor nøjagtigt, som de blev sat op.

Indholdsproducenter synes sandsynligt at modsætte sig denne potentielle tilføjelse til ‘remix-kultur’, da flere brancheluminarer allerede har udtrykt utilfredshed med standard post-processing-tv-baserede algoritmer som motion-smoothing.