Hjerne-maskine-grænseflade

Gennembrud i kunstig intelligens forbedrer hjernen-computer-grænseflader ved at afkode komplekse hjernesignaler

Forskere ved Chiba University i Japan har udviklet en ny kunstig intelligensramme, der kan afkode kompleks hjernaktivitet med væsentligt forbedret nøjagtighed, hvilket markerer et vigtigt skridt mod mere pålidelige hjernen-computer-grænseflader (BCIs). Gennembruddet kunne hjælpe med at accelerere udviklingen af hjælpemidler, der tillader mennesker med neurologiske tilstande at styre enheder som proteser, kørestole og rehabiliteringsrobotter ved hjælp af deres tanker.

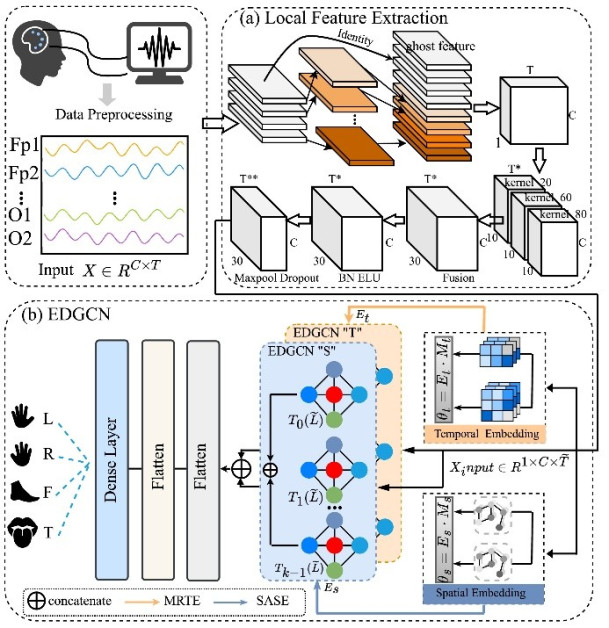

Forskningen, ledet af ph.d.-studerende Chaowen Shen og professor Akio Namiki ved Graduate School of Engineering på Chiba University, introducerer en ny dyb læringarkitektur kendt som Embedding-Driven Graph Convolutional Network (EDGCN). Systemet er designet til at fortolke de komplekse elektriske signaler, der genereres i hjernen, når en person forestiller sig at bevæge sine lemmer – en proces kendt som motorisk forestilling.

Hjernen-computer-grænseflader og motorisk forestilling

Hjernen-computer-grænseflader sigter mod at oprette en kommunikationskanal mellem det menneskelige hjernen og eksterne maskiner. I stedet for at afhænge af muskelskift, fortolker BCI’er neurale signaler og konverterer dem til kommandoer for digitale systemer eller fysiske enheder.

En af de mest udbredte tilgange i BCI-forskning indebærer motorisk forestilling elektroencefalografi (MI-EEG). I disse systemer forestiller brugerne sig at udføre bevægelser – såsom at løfte en hånd, gribe et objekt eller gå. Selv om der ikke sker nogen fysisk bevægelse, genererer hjernen karakteristiske mønstre af elektrisk aktivitet forbundet med den forestillede bevægelse.

Disse signaler kan optages ved hjælp af elektroencefalografi (EEG), en ikke-invasiv teknik, der optager hjernaktivitet gennem elektroder placeret på scalpen. EEG giver multi-kanal tids-serie data, der repræsenterer neural aktivitet på tværs af forskellige regioner af hjernen.

At afkode disse signaler nøjagtigt tillader computere at oversætte neural aktivitet til håndterbare kommandoer. I praksis kunne dette tillade personer med lamelse eller alvorlig motorisk nedsatelse at styre hjælpemidler blot ved at forestille sig bevægelser.

Men at opnå pålidelig afkodning af MI-EEG-signaler forbliver en af de mest vanskelige udfordringer i neuroteknologi.

Hvorfor hjernesignaler er svære at afkode

Det primære hinder for hjernen-computer-grænsefladeudvikling ligger i den indbyggede kompleksitet af EEG-signaler.

Motorisk forestillingssignaler viser høj spatiotemporal variabilitet, hvilket betyder, at de varierer både på tværs af forskellige hjerneregioner og over tid. De adskiller sig også bredt mellem individer og endda inden for samme person fra en session til en anden.

Traditionelle maskinlæringsmodeller kæmper ofte med disse variationer. Mange eksisterende systemer afhænger af foruddefinerede grafstrukturer eller faste parametre, der antager, at hjernesignaler opfører sig i konsistente mønstre. I virkeligheden er neurale signaler langt mere dynamiske og heterogene.

Tidligere metoder brugte ofte teknikker som fælles spatial mønsteranalyse eller konventionelle convolutionelle neurale netværk til at trække funktioner fra EEG-signaler. Selv om disse tilgange kan identificere nogle mønstre i neural aktivitet, fejler de ofte i at fange dybere interaktioner mellem hjerneregioner eller udviklende mønstre over tid.

Som følge heraf kræver mange BCI-systemer omfattende kalibrering og træning, før de kan fungere effektivt for enkeltbrugere.

En ny tilgang: Embedding-Driven Graph Convolutional Networks

Forskningsholdet på Chiba University adresserede disse udfordringer ved at udvikle en ny dyb læringramme designet til bedre at fange kompleksiteten af hjernaktivitet.

Deres løsning – Embedding-Driven Graph Convolutional Network (EDGCN) – kombinerer flere avancerede teknikker til at modelere den rumlige og tidsmæssige struktur af EEG-signaler samtidigt.

I kernen af rammen ligger en embedding-dreven fusionsmekanisme, der tillader systemet at dynamisk generere parametre brugt til afkodning af hjernesignaler. I stedet for at afhænge af faste arkitekturer, tilpasser EDGCN sin interne repræsentation til bedre at fange variationer mellem subjekter og over tid.

Arkitekturen integrerer flere specialiserede komponenter:

Multi-Resolution Temporal Embedding (MRTE)

Denne modul analyserer EEG-signaler på forskellige tids-skalaer. Da neurale signaler udvikler sig hurtigt, kan vigtig information forekomme på forskellige tids-skalaer. MRTE trækker funktioner fra multi-resolution power spectral mønstre, hvilket tillader systemet at identificere meningsfuld neural aktivitet, der ellers kunne være gået tabt.

Structure-Aware Spatial Embedding (SASE)

Hjernesignaler er ikke isolerede; forskellige hjerneregioner interagerer kontinuerligt. SASE-mekanismen modellerer disse interaktioner ved at inkorporere både lokale og globale konnektivitetsstrukturer mellem EEG-elektroder. Dette tillader AI at repræsentere hjernen som et netværk i stedet for som uafhængige signal-kanaler.

Heterogeneity-Aware Parameter Generation

En af de mest innovative aspekter af EDGCN-rammen er dens evne til dynamisk at generere grafkonvolutionsparametre fra en embedding-dreven parameterbank. Dette tillader modellen at tilpasse sig de unikke karakteristika af hver subjects hjernesignaler.

For at støtte denne proces brugte forskerne Chebyshev grafkonvolution, en teknik, der effektivt modellerer relationer inden for komplekse netværk.

Orthogonality-Constrained Kernels

For yderligere at forbedre robustheden introducerer modellen orthogonality-begrænsninger inden for sine konvolutionskerner. Dette opmuntrer til diversitet i de lærte funktioner og reducerer redundans, hvilket hjælper systemet med at trække rigere repræsentationer fra EEG-signaler.

Sammen tillader disse komponenter EDGCN at fange både lokale neurale aktivitetsmønstre og store skala-interaktioner mellem hjerneregioner, hvilket resulterer i mere nøjagtig afkodning af motorisk forestillingssignaler.

Præstationsresultater

Forskerne testede EDGCN ved hjælp af bredt anvendte benchmark-datasæt fra BCI Competition IV, som er standard evaluering datasæt i feltet hjernen-computer-grænseflade-forskning.

Modellen opnåede:

- 90,14% klassifikationsnøjagtighed på BCIC-IV-2b datasættet

- 86,50% klassifikationsnøjagtighed på BCIC-IV-2a datasættet

Disse resultater overgår flere eksisterende state-of-the-art afkodningsmetoder og demonstrerer stærk generalisering på tværs af forskellige subjekter.

Vigtigt er, at systemet også viste forbedret tilpasning, når det blev anvendt på cross-subjekt-scenarier, en nøglekrav til praktisk BCI-udvikling. Mange eksisterende modeller fungerer godt for en enkelt trænet bruger, men fejler, når de anvendes på nye individer. EDGCN’s embedding-dreven arkitektur hjælper med at overvinde denne begrænsning ved bedre at modelere individuel variabilitet.

Konsekvenser for rehabilitering og hjælpemidler

Evnen til at afkode hjernesignaler mere nøjagtigt kunne have dybdegående konsekvenser for hjælpemidler.

Motorisk forestilling-baserede BCI’er undersøges allerede til anvendelser som:

- Tanke-styrede kørestole

- Neurale proteser

- Roboter-rehabiliteringsenheder

- Kommunikationssystemer for patienter med lamelse

Forbedret afkodningsnøjagtighed kunne gøre disse teknologier betydeligt mere pålidelige og lette at bruge.

Forskere mener, at systemer som EDGCN måske kan hjælpe patienter med tilstande som:

- Slagtilfælde

- Rygsøjleskader

- Amyotrofisk lateral sklerose (ALS)

- Andre neuromuskulære forstyrrelser

Med mere pålidelig signalfortolkning kunne patienter potentielt styre neurorehabiliteringsenheder gennem simple forestillede bevægelser, hvilket tillader mere naturlig interaktion med hjælpemidler.

Ifølge professor Namiki er afkodning af motorisk forestillingssignaler ikke kun en teknologisk udfordring, men også en mulighed for bedre at forstå, hvordan hjernen organiserer bevægelse og neural konnektivitet.

Mod forbruger-graden hjernen-computer-grænseflader

Trods årtiers forskning forbliver de fleste hjernen-computer-grænsefladesystemer begrænsede til laboratorier eller specialiserede kliniske miljøer. Pålidelighed, tilpasning og brugervenlighed forbliver væsentlige barrierer for bredere accept.

Fremgang som EDGCN kunne hjælpe med at bringe BCI’er tættere på forbruger-graden neuroteknologi.

Ved at forbedre systemets evne til at håndtere heterogene hjernesignaler reducerer modellen behovet for omfattende kalibrering og ekspert-justering. Dette er et kritisk skridt mod at gøre BCI-systemer brugbare uden for forskningsmiljøer.

Fremtidig forskning vil sandsynligvis fokusere på at integrere sådanne AI-modeller i bærbare EEG-systemer og wearables. Kombineret med forbedringer i sensor-teknologi og beregningskraft, kunne disse systemer enable mere tilgængelige og skalerbare hjernen-maskine-grænseflader.

Et skridt mod dybere menneske-maskine-integration

Udviklingen af EDGCN reflekterer en bredere trend i kunstig intelligens og neurovidenskab: den øgede brug af graf-baserede neurale netværk til at modelere biologiske systemer.

Da hjernen selv opererer som et komplekst netværk af forbundne regioner, giver grafneurale netværk en naturlig måde at repræsentere dets struktur og dynamik. Da disse AI-modeller bliver mere avancerede, kan de måske låse op for dybere indsigt i neural aktivitet og kognition.

Ultimo, forbedret afkodning af hjernesignaler kunne bana vejen for en ny generation af teknologier, der tillader mennesker at interagere med maskiner mere ubesværet end nogensinde før.

Hvis fremgangen fortsætter i dens nuværende takt, kan hjernen-computer-grænseflader snart gå fra eksperimentelle forskningsværktøjer til hverdags-hjælpemidler, der kan genskabe uafhængighed og mobilitet for millioner af mennesker verden over.