Umělá inteligence

Generování parafrází pomocí hlubokého učení s posilováním – Thought Leaders

Když píšeme nebo mluvíme, všichni jsme se někdy ptali, zda existuje lepší způsob, jak sdělit nápad ostatním. Jaká slova bych měl použít? Jak bych měl strukturovat myšlenku? Jak pravděpodobně zareagují? V Phrasee trávíme hodně času přemýšlením o jazyce – co funguje a co nefunguje.

Představte si, že píšete předmět e-mailové kampaně, která bude zaslána 10 milionům lidí na vašem seznamu a bude propagovat 20% slevu na nový laptop.

Kterou řádku byste zvolili:

- Můžete nyní získat dalších 20% slevu na svou další objednávku

- Příprava – další 20% slevy

Ačkoli sdělují stejné informace, jedna z nich dosáhla téměř o 15% vyšší otevírací rychlosti než druhá (a vsadím se, že nemůžete porazit náš model při předpovídání, která z nich ?). Zatímco jazyk lze často testovat pomocí A/B testování nebo multi-armed bandits, automatické generování parafrází zůstává opravdu složitým výzkumným problémem.

Dvě věty jsou považovány za parafráze navzájem, pokud sdílejí stejný význam a lze je použít zaměnitelně. Další důležitou věcí, která je často brána jako samozřejmost, je, zda je věta generovaná strojem plynulá.

Na rozdíl od dohledovaného učení se agenti učení s posilováním (RL) učí interakcí se svým prostředím a pozorováním odměn, které získají jako výsledek. Tento somewhat nuancovaný rozdíl má obrovské důsledky pro to, jak algoritmy fungují a jak jsou modely trénovány. Hluboké učení s posilováním používá neuronové sítě jako aproximátor funkce, aby umožnil agentovi naučit se, jak překonat lidi v komplexních prostředích, jako je Go, Atari a StarCraft II.

Navzdory tomuto úspěchu nebylo učení s posilováním široce aplikováno na reálné problémy, včetně zpracování přirozeného jazyka (NLP).

Jako součást mé MSc diplomové práce v oboru Data Science demonstrujeme, jak lze hluboké učení s posilováním použít k překonání dohledovaných metod při automatickém generování parafrází vstupního textu. Problém generování nejlepší parafráze lze považovat za nalezení série slov, která maximalizuje sémantickou podobnost mezi větami, zatímco zachovává plynulost výstupu. Agenti RL jsou dobře přizpůsobeni pro nalezení nejlepší sady akcí pro dosažení maximální očekávané odměny v řídicích prostředích.

Na rozdíl od většiny problémů v strojovém učení leží největší problém ve většině aplikací generování přirozeného jazyka (NLG) ne v modelování, ale spíše v hodnocení. Zatímco hodnocení člověkem je目前 považováno za zlatý standard v hodnocení NLG, trpí významnými nevýhodami, včetně toho, že je drahé, časově náročné, obtížné ladit a chybí reprodukovatelnost napříč experimenty a datovými sady (Han, 2016). Jako výsledek toho výzkumníci dlouho hledají automatické metriky, které jsou jednoduché, obecně použitelné a které odrážejí lidské úsudky (Papineni et al., 2002).

Nejběžnější automatické metody hodnocení v hodnocení automaticky generovaných popisků obrázků jsou shrnuty níže s jejich výhody a nevýhody:

Generování parafrází pomocí učení s posilováním – Pipeline

Vyvinuli jsme systém nazvaný ParaPhrasee, který generuje vysoce kvalitní parafráze. Systém se skládá z několika kroků, aby se aplikovalo učení s posilováním způsobem, který je výpočetně efektivní. Stručné shrnutí high-level pipeline je uveden níže s více detaily obsaženými v diplomové práci.

Dataset

Existuje několik datových sad parafrází, které se používají ve výzkumu, včetně: Microsoft Paraphrase corpus, ACL’s Semantic Text Similarity competition, Quora Duplicate Questions a Twitter Shared Links. Vybrali jsme MS-COCO kvůli jeho velikosti, čistotě a použití jako benchmarku pro dvě pozoruhodné parafrázové generace papíru. MS-COCO obsahuje 120k obrázků běžných scén s 5 popisky obrázků pro každý obrázek poskytnutých 5 různými lidskými anotátory.

Zatímco je primárně navržen pro výzkum počítačového vidění, popisky tendují mít vysokou sémantickou podobnost a jsou zajímavé parafráze. Vzhledem k tomu, že popisky obrázků jsou poskytovány různými lidmi, tendují mít malé variace v detailech poskytovaných ve scéně, a proto generované věty tendují k halucinacím detailů.

Supervised Model

Zatímco učení s posilováním se zlepšilo podstatně z hlediska vzorkové efektivity, tréninkových časů a celkových nejlepších postupů, trénování modelů RL od začátku je stále relativně velmi pomalé a nestabilní (Arulkumaran et al., 2017). Protože, místo aby se trénovalo od začátku, nejprve trénujeme dohledovaný model a pak jej jemně ladíme pomocí RL.

Používáme Encoder-Decoder modelový rámec a vyhodnocujeme výkon několika základních dohledovaných modelů. Když jemně ladíme model pomocí RL, pouze jemně ladíme dekodérskou síť a považujeme kódovací síť za statickou. Jako takový zvažujeme dva hlavní rámce:

- Trénování dohledovaného modelu od začátku pomocí standardního/vanilkového encoder-decoderu s GRUs

- Použití předtrénovaných sentence embedding modelů pro encoder, včetně: pooled word embeddings (GloVe), InferSent a BERT

Dohledované modely tendují k podobnému výkonu napříč modely, přičemž BERT a vanilkový encoder-decoder dosáhly nejlepšího výkonu.

Zatímco výkon tenduje k rozumnému, existují tři běžné zdroje chyb: stuttering, generování sentence fragmentů a halucinace. Tyto jsou hlavní problémy, které použití RL snaží vyřešit.

Reinforcement Learning Model

Implementace algoritmů RL je velmi náročná, zejména když nevíte, zda lze problém vyřešit. Může existovat problém v implementaci vašeho prostředí, vašich agentů, vašich hyperparametrů, vaší odměňovací funkce nebo kombinace všech výše uvedených! Tyto problémy jsou zhoršeny, když se provádí hluboké učení s posilováním, protože máte navíc složitost ladění neuronových sítí.

Stejně jako u všech ladění je crucial začít jednoduše. Implementovali jsme variace dvou dobře pochopitelných toy RL prostředí (CartPole a FrozenLake) pro testování algoritmů RL a nalezení opakující se strategie pro přenos znalostí z dohledovaného modelu.

Zjistili jsme, že použití Actor-Critic algoritmu překonalo REINFORCE v těchto prostředích. Z hlediska přenosu znalostí do actor-critic modelu jsme zjistili, že inicializace actorových vah s trénovaným dohledovaným modelem a předběžné trénování kritika dosáhlo nejlepšího výkonu. Zjistili jsme, že je obtížné zobecnit sofistikované přístupy k destilaci politik na nová prostředí, protože zavádějí mnoho nových hyperparametrů, které vyžadují ladění, aby fungovaly.

Podporováno těmito poznatky, pak se obracíme na vývoj přístupu pro úlohu generování parafrází. Nejdříve musíme vytvořit prostředí.

Prostředí umožňuje nám snadno testovat dopad použití různých hodnocení metrik jako odměňovacích funkcí.

Pak definujeme agenta, daný jeho mnoha výhodami, používáme actor-critic architekturu. Actor se používá k výběru dalšího slova v sekvenci a má své váhy inicializovány pomocí dohledovaného modelu. Kritik poskytuje odhad očekávané odměny, kterou stav pravděpodobně obdrží, aby pomohl actorovi naučit se.

Navrhování správné odměňovací funkce

Nejdůležitější součástí navrhování RL systému je odměňovací funkce, protože to je to, co se RL agent snaží optimalizovat. Pokud je odměňovací funkce nesprávná, pak výsledky utrpí, i když každá jiná část systému funguje!

Klasickým příkladem toho je CoastRunners, kde výzkumníci z OpenAI nastavili odměňovací funkci jako maximální skóre, spíše než vyhrát závod. Výsledkem toho je, že agent objevil smyčku, ve které mohl získat nejvyšší skóre, aniž by dokončil závod.

https://www.youtube.com/watch?time_continue=2&v=tlOIHko8ySg&feature=emb_title

Vzhledem k tomu, že hodnocení kvality parafrází je samo o sobě nevyřešeným problémem, navrhování odměňovací funkce, která automaticky zachytí tento cíl, je ještě těžší. Většina aspektů jazyka se nedá snadno rozložit do lineárních metrik a jsou závislé na úkolu (Novikova et al., 2017).

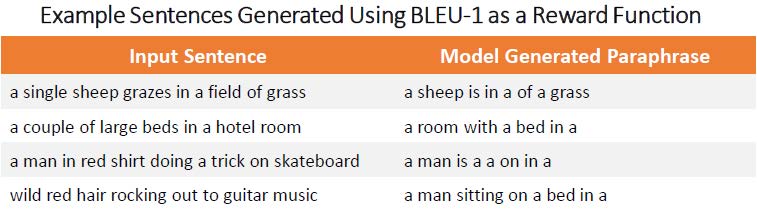

RL agent často objeví zajímavou strategii pro maximalizaci odměn, která využívá slabosti v hodnocení metrice, spíše než generuje vysoce kvalitní text. To tenduje k výsledkům, které mají nízký výkon na metrikách, které agent přímo neoptimalizuje.

Zvažujeme tři hlavní přístupy:

- Word-overlap Metriky

Společné NLP hodnocení metriky zvažují podíl word overlap mezi vygenerovanou parafrází a hodnocení větou. Čím větší je overlap, tím větší je odměna. Výzvou s word-level přístupy je, že agent zahrnuje příliš mnoho spojovacích slov, jako je “a je na”, a není zde žádná míra plynulosti. To vede k velmi nízkokvalitním parafrázím.

- Sentence-level Similarity a Fluency Metriky

Hlavní vlastnosti vygenerované parafráze jsou, že musí být plynulá a sémanticky podobná vstupní větě. Proto se snažíme explicitně ohodnotit tyto jednotlivě a pak je kombinovat. Pro sémantickou podobnost používáme kosinovou podobnost mezi sentence embeddings z předtrénovaných modelů, včetně BERT. Pro plynulost používáme skóre založené na perplexitě věty z GPT-2. Čím větší je kosinová podobnost a plynulost skóre, tím větší je odměna.

Zkusili jsme mnoho různých kombinací sentence embedding modelů a plynulostních modelů a zatímco výkon byl rozumný, hlavní problém, se kterým se agent potýkal, nebyl dostatečně vyvážený sémantickou podobností s plynulostí. Pro většinu konfigurací agent priorizoval plynulost, což vedlo k odstranění detailů a většina entit byla umístěna “uprostřed” něčeho nebo byla přesunuta “na stůl” nebo “na straně silnice”.

Multi-objective učení s posilováním je otevřenou výzkumnou otázkou a je velmi náročné v tomto případě.

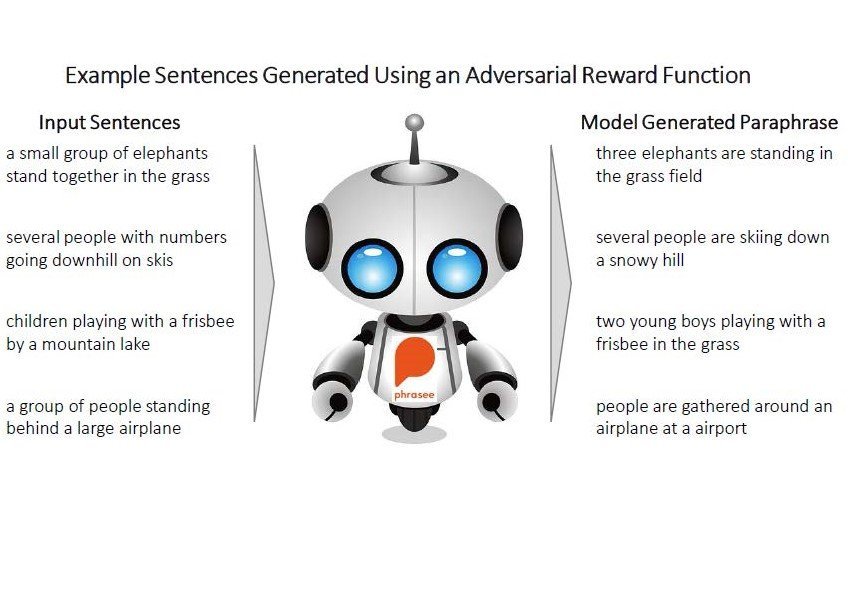

- Použití adversariačního modelu jako odměňovací funkce

Vzhledem k tomu, že lidé jsou považováni za zlatý standard v hodnocení, trénujeme samostatný model nazvaný diskriminátor, aby předpovídal, zda dvě věty jsou parafrázemi navzájem (podobně jako by to hodnotil člověk). Cílem RL modelu je pak přesvědčit tento model, že vygenerovaná věta je parafrází vstupní věty. Diskriminátor generuje skóre, jak pravděpodobně jsou dvě věty parafrázemi navzájem, které se používá jako odměna pro trénování agenta.

Každých 5 000 pokusů diskriminátorovi je řečeno, která parafráze pochází z datové sady a která byla vygenerována, aby mohl zlepšit své budoucí pokusy. Proces pokračuje po několik kol, přičemž se agent snaží oklamat diskriminátor a diskriminátor se snaží rozlišit mezi vygenerovanými parafrázemi a hodnoceními parafrázemi z datové sady.

Po několika kolech trénování agent generuje parafráze, které překonávají dohledované modely a jiné odměňovací funkce.

Závěr a omezení

Adversariační přístupy (včetně self-play pro hry) poskytují velmi slibný přístup pro trénování RL algoritmů, aby překonaly lidskou úroveň výkonu na určitých úkolech bez definování explicitní odměňovací funkce.

Zatímco RL bylo schopno překonat dohledované učení v tomto případě, množství extra režie v termínech kódu, výpočtu a složitosti není stojí za výkonový zisk pro většinu aplikací. RL je nejlépe ponechán situacím, kde nelze snadno aplikovat dohledované učení, a odměňovací funkce je snadno definovatelná (jako jsou Atari hry). Přístupy a algoritmy jsou mnohem zralejší v dohledovaném učení a signál chyby je mnohem silnější, což vede k mnohem rychlejšímu a stabilnějšímu trénování.

Další úvahou je, stejně jako u jiných neuronových přístupů, že agent může selhat velmi dramaticky v případech, kdy je vstup odlišný od vstupů, které dříve viděl, vyžadující další vrstvu sanity checků pro produkční aplikace.

Exploze zájmu o RL přístupy a pokroky v výpočetní infrastruktuře v posledních letech odemknou obrovské příležitosti pro aplikaci RL v průmyslu, zejména v rámci NLP.