Umělá inteligence

OpenAI GPT-4o: Multimodální model umělé inteligence transformující interakci člověka a stroje

OpenAI vydala svůj zatím nejnovější a nejpokročilejší jazykový model – GPT-4o, známý také jako „Omni" Modelka. Tento revoluční systém umělé inteligence představuje obrovský skok vpřed se schopnostmi, které stírají hranice mezi lidskou a umělou inteligencí.

Srdcem GPT-4o je jeho nativní multimodální povaha, která mu umožňuje bezproblémově zpracovávat a generovat obsah přes text, zvuk, obrázky a video. Tato integrace více modalit do jednoho modelu je první svého druhu a slibuje přetvořit způsob, jakým komunikujeme s asistenty AI.

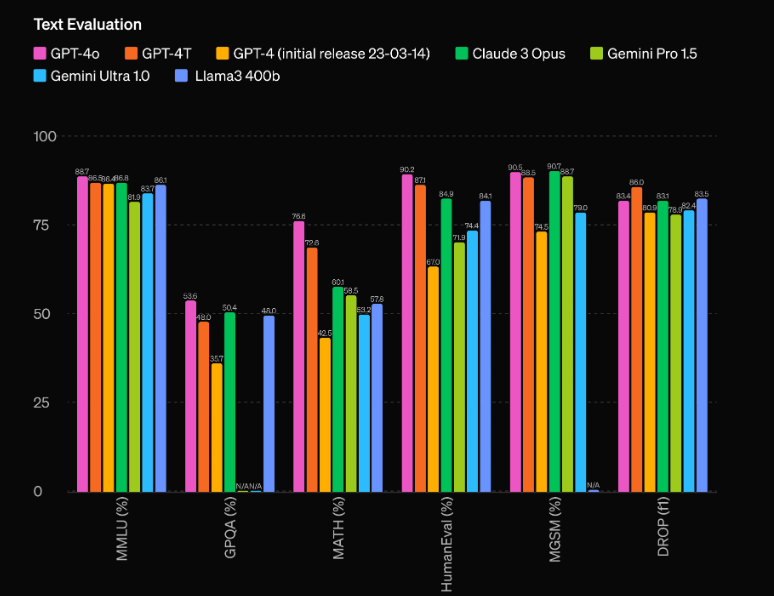

GPT-4o je ale mnohem víc než jen multimodální systém. Může se pochlubit ohromujícím zlepšením výkonu oproti svému předchůdci GPT-4 a konkurenční modely jako Gemini 1.5 Pro, Claude 3 a Llama 3-70B nechává v prachu. Pojďme se ponořit hlouběji do toho, co dělá tento model AI skutečně průlomovým.

Bezkonkurenční výkon a účinnost

Jedním z nejpůsobivějších aspektů GPT-4o jsou jeho bezprecedentní výkonnostní schopnosti. Podle hodnocení OpenAI má tento model pozoruhodný náskok 60 bodů Elo před předchozím nejlepším modelem GPT-4 Turbo. Tato významná výhoda řadí GPT-4o do vlastní ligy a předčí i ty nejpokročilejší modely umělé inteligence, které jsou v současné době k dispozici.

Hrubý výkon však není jedinou oblastí, kde GPT-4o září. Model se také může pochlubit působivou účinností, pracuje při dvojnásobné rychlosti než GPT-4 Turbo, přičemž jeho provoz stojí pouze polovinu. Tato kombinace vynikajícího výkonu a nákladové efektivity dělá z GPT-4o mimořádně atraktivní nabídku pro vývojáře a podniky, které chtějí do svých aplikací integrovat špičkové schopnosti umělé inteligence.

Multimodální schopnosti: Prolnutí textu, zvuku a vidění

Snad nejpřelomovějším aspektem GPT-4o je jeho nativní multimodální povaha, která mu umožňuje bezproblémově zpracovávat a generovat obsah v různých modalitách, včetně textu, zvuku a vidění. Tato integrace více modalit do jednoho modelu je první svého druhu a slibuje revoluci v tom, jak interagujeme s asistenty AI.

S GPT-4o se uživatelé mohou zapojit do přirozených konverzací v reálném čase pomocí řeči, přičemž model okamžitě rozpoznává a reaguje na zvukové vstupy. Tím ale možnosti nekončí – GPT-4o dokáže také interpretovat a generovat vizuální obsah, čímž otevírá svět možností aplikacím od analýzy a generování obrazu až po pochopení a tvorbu videa.

Jednou z nejpůsobivějších ukázek multimodálních schopností GPT-4o je jeho schopnost analyzovat scénu nebo obraz v reálném čase, přesně popsat a interpretovat vizuální prvky, které vnímá. Tato funkce má hluboké důsledky pro aplikace, jako jsou asistenční technologie pro zrakově postižené, stejně jako v oblastech, jako je bezpečnost, dohled a automatizace.

Multimodální schopnosti GPT-4o však přesahují pouhé porozumění a generování obsahu v různých modalitách. Model může také tyto modality hladce kombinovat a vytvářet skutečně pohlcující a poutavé zážitky. Například během živého dema OpenAI dokázalo GPT-4o vygenerovat skladbu na základě vstupních podmínek a propojit své chápání jazyka, hudební teorie a generování zvuku do soudržného a působivého výstupu.

Použití GPT0 pomocí Pythonu

import openai

# Replace with your actual API key

OPENAI_API_KEY = "your_openai_api_key_here"

# Function to extract the response content

def get_response_content(response_dict, exclude_tokens=None):

if exclude_tokens is None:

exclude_tokens = []

if response_dict and response_dict.get("choices") and len(response_dict["choices"]) > 0:

content = response_dict["choices"][0]["message"]["content"].strip()

if content:

for token in exclude_tokens:

content = content.replace(token, '')

return content

raise ValueError(f"Unable to resolve response: {response_dict}")

# Asynchronous function to send a request to the OpenAI chat API

async def send_openai_chat_request(prompt, model_name, temperature=0.0):

openai.api_key = OPENAI_API_KEY

message = {"role": "user", "content": prompt}

response = await openai.ChatCompletion.acreate(

model=model_name,

messages=[message],

temperature=temperature,

)

return get_response_content(response)

# Example usage

async def main():

prompt = "Hello!"

model_name = "gpt-4o-2024-05-13"

response = await send_openai_chat_request(prompt, model_name)

print(response)

if __name__ == "__main__":

import asyncio

asyncio.run(main())

Mám:

- Importujte modul openai přímo namísto použití vlastní třídy.

- Přejmenovali funkci openai_chat_resolve na get_response_content a provedli některé drobné změny v její implementaci.

- Třída AsyncOpenAI byla nahrazena funkcí openai.ChatCompletion.acreate, což je oficiální asynchronní metoda poskytovaná knihovnou OpenAI Python.

- Přidána ukázková hlavní funkce, která ukazuje, jak používat funkci send_openai_chat_request.

Vezměte prosím na vědomí, že pro správné fungování kódu musíte nahradit „your_openai_api_key_here“ vaším skutečným klíčem OpenAI API.