Umělá inteligence

Multimodální AI se vyvíjí, jakmile ChatGPT získává zrak s GPT-4V(ize)

V rámci pokračujícího úsilí o to, aby byla umělá inteligence podobnější lidem, modely GPT od OpenAI neustále rozšiřují hranice. GPT-4 nyní může přijímat podněty obou textů a obrázků.

Multimodalita v generativní umělá inteligence označuje schopnost modelu produkovat různé výstupy, jako je text, obrázky nebo audio, na základě vstupu. Tyto modely, které byly vyškoleny na specifických datech, se učí základní vzory, aby generovaly podobná nová data, a obohacují aplikace umělé inteligence.

Poslední pokroky v multimodální AI

Poslední významný skok v tomto oboru je vidět s integrací DALL-E 3 do ChatGPT, což je významné vylepšení technologie text-to-image od OpenAI. Tento mix umožňuje hladší interakci, kde ChatGPT pomáhá při vytváření přesných podnětů pro DALL-E 3, čímž se uživatelovy nápady mění na jasná umělecká díla vytvořená umělou inteligencí. Takže zatímco uživatelé mohou přímo interagovat s DALL-E 3, přítomnost ChatGPT v tomto procesu činí tvorbu uměleckých děl vytvořených umělou inteligencí mnohem uživatelsky přívětivější.

Více informací o DALL-E 3 a jeho integraci s ChatGPT naleznete zde. Tato spolupráce nejen ukazuje pokrok v multimodální umělá inteligence, ale také činí tvorbu uměleckých děl vytvořených umělou inteligencí mnohem snazší pro uživatele.

Google’s health na druhé straně představil Med-PaLM M v červnu tohoto roku. Jedná se o multimodální generativní model, který je schopen kódovat a interpretovat rozmanitá biomedicínská data. To bylo dosaženo jemným laděním PaLM-E, jazykového modelu, pro lékařské domény pomocí otevřeného benchmarku, MultiMedBench. Tento benchmark sestává z více než 1 milionu vzorků napříč 7 biomedicínskými typy dat a 14 úkoly, jako je zodpovězení lékařských otázek a generování radiologických zpráv.

Různé odvětví přijímají inovativní multimodální nástroje umělé inteligence, aby poháněly obchodní expanzi, streaminovaly operace a zvyšovaly zákaznickou angažovanost. Pokrok v hlasových, video a textových schopnostech umělé inteligence pohání růst multimodální umělé inteligence.

Podniky hledají multimodální aplikace umělé inteligence, které jsou schopné přebudovat obchodní modely a procesy, otevírající růstové příležitosti napříč ekosystémem generativní umělé inteligence, od nástrojů pro data až po vznikající aplikace umělé inteligence.

Po spuštění GPT-4 v březnu někteří uživatelé pozorovali pokles kvality odpovědí v čase, což je obava, kterou sdílejí významní vývojáři a na fórech OpenAI. Zpočátku to OpenAI odmítlo, ale pozdější studie potvrdila problém. Ukázalo se, že došlo k poklesu přesnosti GPT-4 z 97,6 % na 2,4 % mezi březnem a červnem, což ukazuje na pokles kvality odpovědí s následnými aktualizacemi modelu.

Hype kolem Open AI’s ChatGPT je zpět. Nyní přichází s funkcí vidění GPT-4V, která umožňuje uživatelům nechat GPT-4 analyzovat obrázky, které jim poskytují. Jedná se o nejnovější funkci, která byla zpřístupněna uživatelům.

Přidání analýzy obrázků do velkých jazykových modelů (LLM) jako GPT-4 je některými považováno za velký krok vpřed ve výzkumu a vývoji umělé inteligence. Tento typ multimodálního LLM otevírá nové možnosti, přesahující jazykové modely za text a nabízející nové rozhraní a řešící nové typy úkolů, vytvářející nové zkušenosti pro uživatele.

Školení GPT-4V bylo dokončeno v roce 2022, s časným přístupem spuštěným v březnu 2023. Vizuální funkce v GPT-4V je poháněna technologií GPT-4. Proces školení zůstal stejný. Zpočátku byl model školen na predikci následujícího slova v textu pomocí obrovského souboru textů a obrázků z různých zdrojů, včetně internetu.

Poté byl jemně laděn pomocí dalších dat, zaměstnával metodu nazvanou učení s posilováním z lidské zpětné vazby (RLHF), aby generoval výstupy, které lidé preferovali.

Mechanika vidění GPT-4

Vynikající schopnosti vidění a jazyka GPT-4, ačkoli působivé, mají podkladové metody, které zůstávají na povrchu.

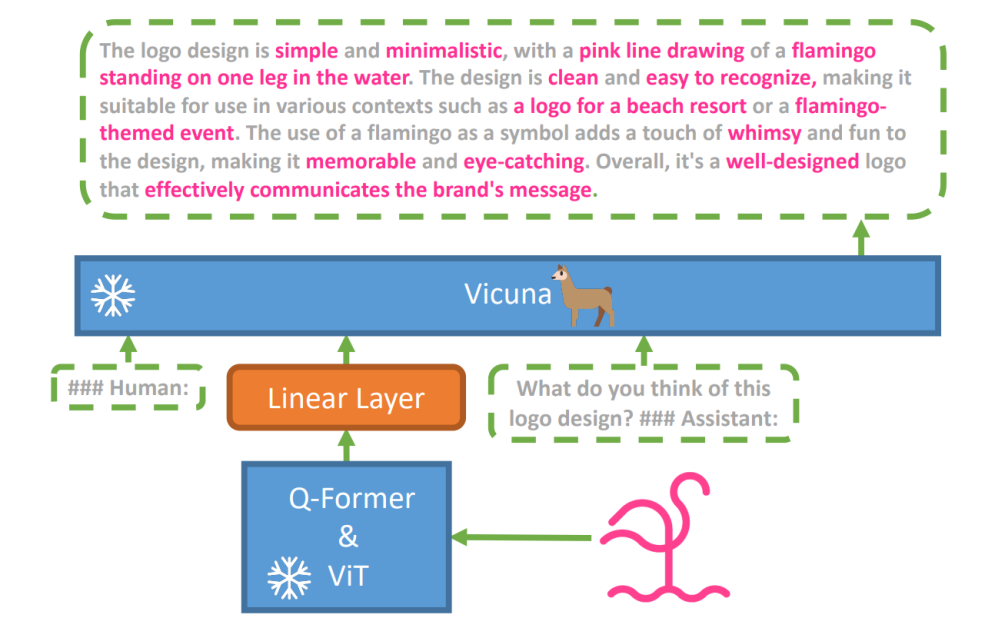

Abychom prozkoumali tuto hypotézu, byl představen nový model vidění a jazyka, MiniGPT-4, který využívá pokročilý LLM nazvaný Vicuna. Tento model používá vizuální kódovací zařízení s předem trénovanými komponenty pro vizuální vnímání, které se shodují se zakódovanými vizuálními funkcemi s modelem Vicuna jazyka prostřednictvím jediné projekční vrstvy. Architektura MiniGPT-4 je jednoduchá, ale efektivní, se zaměřením na shodování vizuálních a jazykových funkcí, aby se zlepšily vizuální konverzační schopnosti.

Architektura MiniGPT-4 zahrnuje vizuální kódovací zařízení s předem trénovaným ViT a Q-Former, jednu lineární projekční vrstvu a pokročilý jazykový model Vicuna.

Trend autoregresivních jazykových modelů v úkolech vidění a jazyka také rostl, využívající transfer znalostí mezi jazykovými a multimodálními doménami.

MiniGPT-4 spojuje vizuální a jazykové domény, shodnocením vizuální informace z předem trénovaného vizuálního kódovacího zařízení s pokročilým LLM. Model využívá Vicuna jako jazykový dekodér a následuje dvoufázový tréninkový přístup. Zpočátku je trénován na velkém souboru párů obrázků a textů, aby získal znalosti o vidění a jazyku, následovaný jemným laděním na menším, vysoce kvalitním souboru, aby se zlepšila spolehlivost a uživatelská přívětivost generování.

Aby se zlepšila přirozenost a uživatelská přívětivost generovaného jazyka v MiniGPT-4, výzkumníci vyvinuli dvoufázový proces shodnocení, aby řešili nedostatek dostatečných dat pro shodnocení vidění a jazyka. Pro tento účel byl vytvořen specializovaný soubor dat.

Zpočátku model generoval podrobné popisy vstupních obrázků, zlepšující detaily pomocí konverzačního podnětu, který se shodoval s formátem jazykového modelu Vicuna.

Počáteční popis obrázku:

###Human: <Img><ImageFeature></Img>Popište tento obrázek podrobně. Dejte co nejvíce detailů. Řekněte všechno, co vidíte. ###Assistant:

Pro zpracování dat po zpracování byly odstraněny jakékoli nesrovnalosti nebo chyby v generovaných popisech pomocí ChatGPT, následované manuální verifikací, aby se zajistila vysoká kvalita.

Druhá fáze jemného ladění:

###Human: <Img><ImageFeature></Img><Instruction>###Assistant:

Tato zkoumání otevírá okno do porozumění mechanismům multimodální generativní umělé inteligence, jako je GPT-4, osvětlující, jak vidění a jazykové modality mohou být účinně integrovány, aby se generovaly koherentní a kontextuálně bohaté výstupy.

Prozkoumání GPT-4 Vision

Určení původu obrázků s ChatGPT

GPT-4 Vision zlepšuje schopnost ChatGPT analyzovat obrázky a určit jejich geografický původ. Tato funkce přechází uživatelské interakce z čistého textu na kombinaci textu a vizuálů, stává se tak užitečným nástrojem pro ty, kteří jsou zvědaví na různé místa prostřednictvím obrazových dat.

Složitá matematická pojmy

GPT-4 Vision vyniká ve zkoumání složitých matematických pojmů analýzou grafických nebo ručně psaných výrazů. Tato funkce slouží jako užitečný nástroj pro jednotlivce, kteří hledají řešení složitých matematických problémů, čímž se GPT-4 Vision stává významnou pomocí ve vzdělávacích a akademických oblastech.

Převod ručně psaného vstupu na LaTeX kódy

Jedna z pozoruhodných schopností GPT-4V je jeho schopnost převést ručně psané vstupy na LaTeX kódy. Tato funkce je požehnáním pro výzkumníky, akademiky a studenty, kteří často potřebují převést ručně psané matematické výrazy nebo jiné technické informace do digitální formy. Převod z ručně psaného na LaTeX rozšiřuje obzor digitalizace dokumentů a zjednodušuje technický proces psaní.

Extrahování detailů tabulky

GPT-4V ukazuje dovednost extrahovat detaily z tabulek a řešit související dotazy, což je zásadní aktivum v analýze dat. Uživatelé mohou využívat GPT-4V, aby procházeli tabulkami, shromažďovali klíčové informace a řešili datové otázky, čímž se stává robustním nástrojem pro analytiky dat a další odborníky.

Ačkoli výsledek nebyl úplně shodný s mým původním viděním, zde je výsledek, kterého jsem dosáhl.

Omezení a slabiny GPT-4V(ize)

Aby se analyzoval GPT-4V, tým Open AI provedl kvalitativní a kvantitativní hodnocení. Kvalitativní hodnocení zahrnovala interní testy a externí odborné recenze, zatímco kvantitativní hodnocení měřila odmítnutí modelu a přesnost v různých scénářích, jako je identifikace škodlivého obsahu, rozpoznání demografie, obavy o soukromí, geolokace, kybernetická bezpečnost a multimodální úniky.

Přestože model není dokonalý.

Článek článek zdůrazňuje omezení GPT-4V, jako jsou nesprávné odhady a chybějící text nebo znaky v obrázcích. Může halucinovat nebo vynalézat fakta. Zvláště se nehodí pro identifikaci nebezpečných látek na obrázcích, často je špatně identifikuje.

V lékařském zobrazování může GPT-4V poskytovat nekonzistentní odpovědi a postrádá povědomí o standardních postupech, což může vést k potenciálnímu špatnému diagnózu.

Nespolehlivý výkon pro lékařské účely (Zdroj)

Také selhává v pochopení nuancí určitých symbolů nenávisti a může generovat nevhodný obsah na základě vizuálních vstupů. OpenAI doporučuje nezískávat GPT-4V pro kritické interpretace, zejména v medicíně nebo citlivých kontextech.

Závěrem

Vytvořeno pomocí Fast Stable Diffusion XL https://huggingface.co/spaces/google/sdxl

Příchod GPT-4 Vision (GPT-4V) přináší spoustu nových možností a nových překážek. Předtím, než byl spuštěn, bylo věnováno mnoho úsilí tomu, aby se zajistilo, že rizika, zvláště ty, které se týkají obrázků lidí, jsou dobře prozkoumána a snížena. Je působivé vidět, jak GPT-4V pokročil, ukazuje velký potenciál v náročných oblastech, jako je medicína a věda.

Nyní jsou zde velké otázky. Například, zda by tyto modely měly být schopny identifikovat slavné lidi z fotografií? Měli by odhadovat pohlaví, rasu nebo emoce člověka z obrázku? A měly by být provedeny speciální úpravy, aby pomohly zrakově postiženým jedincům? Tyto otázky otevírají otázku soukromí, spravedlnosti a toho, jak by měla umělá inteligence zapadat do našeho života, což je něco, co by měli mít všichni možnost vyjádřit.