Myslitelé

Dekódování příležitostí a výzev pro agenty LLM v generativní AI

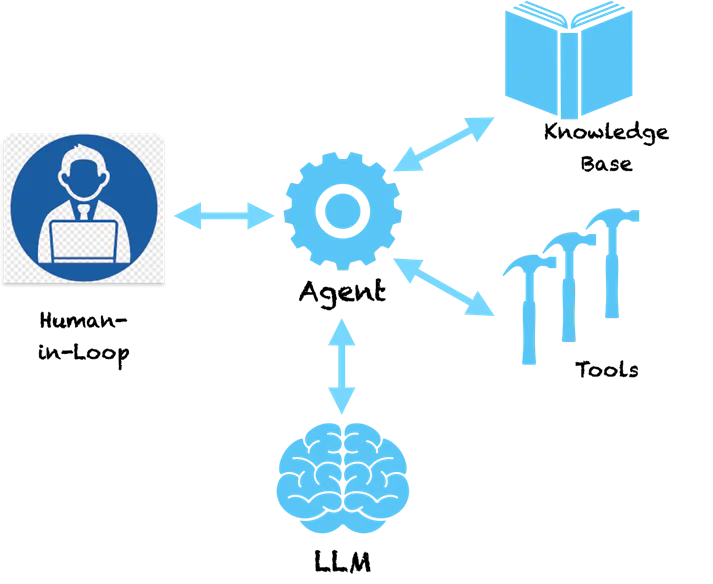

Svědkujeme pokroku aplikací Generative AI poháněných velkými jazykovými modely (LLM) od promptů až po retrieval augmented generation (RAG) a agenty. Agenti jsou široce diskutováni v průmyslových a výzkumných kruzích, zejména kvůli síle, kterou tato technologie poskytuje pro transformaci podnikových aplikací a poskytování nadřazených zákaznických zkušeností. Existují společné vzory pro vytváření agentů, které umožňují první kroky směrem k umělé obecné inteligenci (AGI).

V mém předchozím článku jsme viděli žebřík inteligence vzorů pro vytváření aplikací poháněných LLM. Začínáme s prompty, které zachycují problémové domény a používají interní paměť LLM k generování výstupu. S RAG doplňujeme prompt o externí znalosti vyhledané z vektorové databáze, abychom kontrolovali výstupy. Dalšími řetězci volání LLM můžeme vytvářet pracovní postupy pro realizaci komplexních aplikací. Agenti toto berou na další úroveň automatickým určením, jak tyto řetězce LLM mají být vytvořeny. Podívejme se na detaily.

Agenti – Pod kapotou

Klíčovým vzorem u agentů je, že používají jazykovou pochopení LLM k vytvoření plánu, jak řešit daný problém. LLM rozumí problému a дает nám sekvenci kroků k jeho řešení. Ale to není vše. Agenti nejsou čistým podpůrným systémem, který vám poskytne doporučení pro řešení problému a poté předá štafetu vám, abyste provedli doporučené kroky. Agenti jsou vybaveni nástroji, aby mohli provést akci. Strašidelné, že?!

Pokud se zeptáme agenta na základní otázku, jako je tato:

Člověk: Která společnost založila vynálezce telefonu?

Následuje vzorek myšlenkových kroků, které může agent provést.

Agent (MYŠLENÍ):

- Myšlenka: Musím vyhledat vynálezce telefonu.

- Akce: Vyhledat [vynálezce telefonu]

- Pozorování: Alexander Graham Bell

- Myšlenka: Musím vyhledat společnost, kterou založil Alexander Graham Bell

- Akce: Vyhledat [společnost založená Alexanderem Grahamem Bellem]

- Pozorování: Alexander Graham Bell založil společnost American Telephone and Telegraph Company (AT&T) v roce 1885

- Myšlenka: Našel jsem odpověď. Budu se vracet.

Agent (ODPOVĚĎ): Alexander Graham Bell založil AT&T v roce 1885

Můžete vidět, že agent postupuje systematickým způsobem, rozkládajícím problém na podproblémy, které lze řešit provedením konkrétních akcí. Tyto akce jsou doporučeny LLM a můžeme je mapovat na konkrétní nástroje pro implementaci těchto akcí. Můžeme povolit vyhledávací nástroj pro agenta, aby když si uvědomí, že LLM poskytl vyhledávání jako akci, zavolal tento nástroj s parametry poskytnutými LLM. Vyhledávání zde je na internetu, ale může být také přesměrováno na vyhledávání interní znalostní báze, jako je vektorová databáze. Systém se nyní stává soběstačným a může zjistit, jak řešit komplexní problémy následujícím sérií kroků. Rámcové jako LangChain a LLaMAIndex poskytují snadný způsob, jak vytvářet tyto agenty a připojovat je k nástrojům a API. Amazon nedávno spustil framework Bedrock Agents, který poskytuje vizuální rozhraní pro návrh agentů.

Pod kapotou agenti následují speciální styl odesílání promptů do LLM, aby generovaly akční plán. Výše uvedený vzor Myšlení-Akce-Pozorování je populární v typu agenta nazvaném ReAct (Reasoning and Acting). Další typy agentů zahrnují MRKL a Plan & Execute, které se liší hlavně ve stylu promptů.

Pro složitější agenty mohou být akce vázány na nástroje, které způsobují změny v zdrojových systémech. Například můžeme agenta připojit k nástroji, který kontroluje zůstatek dovolené a žádá o dovolenou v ERP systému pro zaměstnance. Nyní můžeme vytvořit hezký chatbot, který bude interagovat s uživateli a prostřednictvím chatovacího příkazu žádat o dovolenou v systému. Žádné složité obrazovky pro žádost o dovolenou, jednoduché sjednocené chatovací rozhraní. Zní to vzrušujícím!

Výhrady a potřeba zodpovědné AI

Co když máme nástroj, který vyvolává transakce na akciovém trhu pomocí předautorizovaného API. Vytvoříme aplikaci, ve které agent studuje změny akcií (pomocí nástrojů) a činí rozhodnutí pro vás o koupi a prodeji akcií. Co když agent prodá špatné akcie, protože si to domyslel a učinil špatné rozhodnutí? Protože LLM jsou obrovské modely, je obtížné určit, proč činí některá rozhodnutí, a proto jsou halucinace běžné v nepřítomnosti řádných zábran.

Zatímco agenti jsou semua fascinující, pravděpodobně byste uhádli, jak nebezpeční mohou být. Pokud halucinují a činí špatnou akci, která by mohla způsobit obrovské finanční ztráty nebo vážné problémy v podnikových systémech. Proto se zodpovědná AI stává stále důležitější v éře aplikací poháněných LLM. Zásady zodpovědné AI kolem reprodukovatelnosti, transparentnosti a odpovědnosti se snaží umístit zábrany na rozhodnutí činění agentů a navrhnout analýzu rizik, aby se rozhodlo, které akce vyžadují lidský zásah. Čím více komplexních agentů je navrhováno, tím více potřebují přísnější kontrolu, transparentnost a odpovědnost, aby se zajistilo, že víme, co dělají.

Závěrečné myšlenky

Schopnost agentů generovat cestu logických kroků s akcemi je velmi blízká lidskému uvažování. Poskytnutí jim více powerfulných nástrojů může jim dát super schopnosti. Vzory jako ReAct se snaží emulovat, jak lidé řeší problémy, a budeme vidět lepší agentní vzory, které budou relevantní pro konkrétní kontexty a domény (bankovnictví, pojištění, zdravotnictví, průmysl atd.). Budoucnost je zde a technologie za agenty je připravena pro nás k použití. Současně musíme udržovat blízkou pozornost na zábrany zodpovědné AI, abychom se ujistili, že nestavíme Skynet!