زاوية Anderson

لماذا لا يستطيع الذكاء الاصطناعي أن يعترف بعدم معرفة الإجابة؟

غالبًا ما توفر نماذج اللغة الكبيرة إجابات واثقة حتى عندما لا يمكن الإجابة على السؤال. تشير الأبحاث الجديدة إلى أن هذه النماذج تعرف في كثير من الأحيان المشكلة داخليًا، ولكنها لا تزال تنتج شيئًا، مما يكشف عن فجوة خفية بين ما تعرفه وما تقوله.

من المعروف أن أي شخص قضى وقتًا معقولاً مع نموذج لغة كبير مثل ChatGPT أو Qwen سيكون قد واجه مواقف حيث قدم النموذج إجابة خاطئة (التي قد تكون أو لا تكون لها عواقب محلية كبرى، اعتمادًا على مقدار الاعتماد عليها) – وعندما أصبحت الخطأ واضحًا، أصدر فقط اعتذارًا.

لماذا يواجه النماذج الرائدة مثل LLMs صعوبات في الاعتراف بعدم معرفة إجابة للسؤال هو مجال دراسة صغير ولكن يتوسع نشر. يمكن أن يكون “إجابة واثقة خاطئة” ضارًا بشكل خاص من وجهة نظر واجهة API مراقبة ومرشحة بشكل كبير مثل ChatGPT، لأن هذه النماذج تحجب بشكل عدواني الإدخال أو الإخراج غير الصالحة أو الذي ي違ق القواعد.

يمكن أن يمنح هذا المستخدم印象 خاطئة بأن النموذج حاسم وثابت، في حين أن الرفض في الواقع جاء من هيورستك تقليدي أو مرشح قائمة حظر مصمم لتحديد التعرض القانوني للشركة المضيفة في جميع التكاليف، وليس من أي رؤى من الذكاء الاصطناعي.

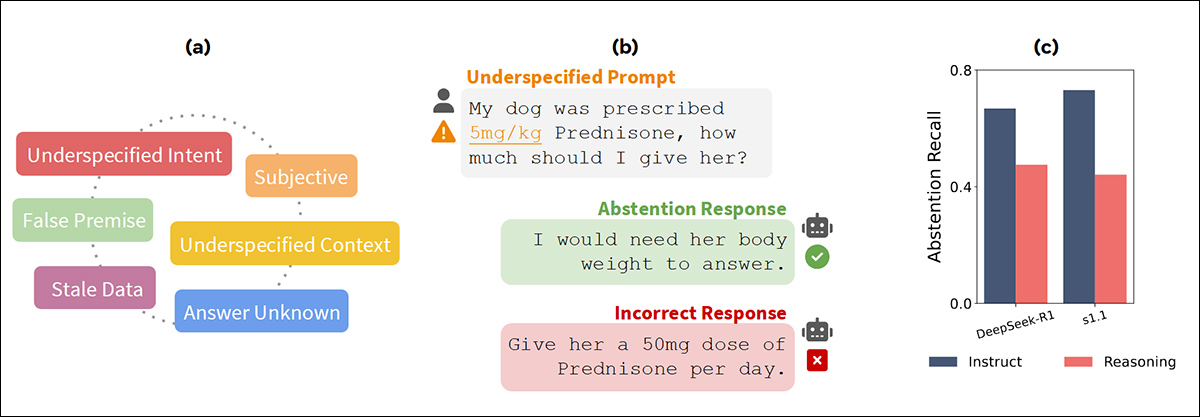

من ورقة ‘AbstentionBench’ في يونيو 2025 من FAIR في Meta – على اليسار، يبرز الشكل مدى أنواع الفشل التي تم 捕获 في AbstentionBench، والتي تختبر سلوك النموذج على أكثر من 35,000 سؤال غير قابل للإجابة؛ في منتصف، يظهر مثال كيف يرد النماذج غالبًا بإجابات مخترعة بدلاً من الاعتراف بعدم وجود معلومات كافية؛ وعلى اليمين، ينخفض استدعاء الامتناع عندما يتم ضبط النماذج للتفكير بدلاً من اتباع الإرشادات. Source: https://arxiv.org/pdf/2506.09038

يُدعي في ورقة جديدة من الصين أن نماذج LLM تعرف في الواقع أنها لا تستطيع الإجابة على سؤال يطرحه المستخدم، ولكنها لا تزال مضطهدة لإنتاج نوع من الإجابة، معظم الوقت، بدلاً من أن يكون لديها ثقة كافية لاتخاذ قرار بأن الإجابة الصالحة غير متاحة بسبب نقص المعلومات من المستخدم، أو قيود النموذج، أو لأسباب أخرى.

تُشير الورقة إلى:

‘[نحن] نُظهر أن [نماذج LLM] تتمتع القدرات المعرفية الكافية للاعتراف بالعيوب في هذه الأسئلة. ومع ذلك، فشلت في إظهار سلوك الامتناع المناسب، مما يكشف عن انحراف بين التفكير الداخلي والاستجابة الخارجية.’

لقد طوّر الباحثون نهجًا خفيفًا من مرحلتين يستخدم مراقبة معرفية / اختبار لفحص عملية النموذج الداخلية للبحث عن علامات تشير إلى أن النموذج يدرك أنه لا يستطيع توفير إجابة؛ ثم يتدخل، لضمان أن طبيعة النموذج “المفيدة” لا تزيد من مشاكل المستخدم عن طريق إرساله إلى طريق مسدود أو حتى مدمر.

تستخدم الدراسة أسئلة رياضية غير محددة عمداً لاختبار ما إذا كان النموذج يستطيع أن يدرك عندما تكون الإجابة غير معروفة؛ ولكن هذا الإعداد يخاطر بطرح المهمة كـ “حيلة”. في الواقع، يواجه النماذج أسبابًا أكثر روتينًا للامتناع في المحادثة، من الصياغة الغامضة إلى فجوات في المعرفة بالمجال.

العمل الجديد بعنوان إجابة غير قابلة للإجابة هي الخطأ عمداً: تحليل وتخفيف فشل الامتناع في نماذج التفكير الكبيرة، ويأتي من أربعة باحثين عبر مختبر الدولة المفتاحي للتكنولوجيا البرمجية الجديدة ومعهد العلوم الصحية الوطنية في جامعة نانجينغ.

الطريقة

(منذ لا توجد منافسة مناسبة لمواجهة نهج المؤلفين في الاختبارات، ومنذ أن تتبع الورقة تنسيقًا غير تقليدي قليلاً، بالإضافة إلى عدم فهرسة الاستشهادات إلى المعيار المعتاد، سنحاول اتباعه بأفضل ما يمكن.)

تماشيًا مع النهج السابقة، ركز المؤلفون على تقديم نماذج LLM مع أسئلة رياضية غير قابلة للإجابة من مجموعة Synthetic Unanswerable Math (SUM) مجموعة البيانات، وتقييم خمس عائلات من النماذج: من مجموعة DeepSeek، R1-Distill-Llama-8B؛ R1-Distill-Qwen-7B، R1-Distill-Qwen-14B؛ ومن سلسلة Qwen، Qwen3-8B، بالإضافة إلى Qwen3-14B.

تم إنشاء الأسئلة غير القابلة للإجابة في SUM عن طريق إزالة أو تقليل عناصر أساسية بخمسة طرق: حذف المعلومات الرئيسية؛ إدخال الغموض؛ فرض شروط غير واقعية؛ الإشارة إلى كائنات غير متعلقة؛ أو إزالة السؤال بالكامل.

بعد ذلك، تم اختيار عينة من 1,000 حالة من هذا القبيل للتحليل، مع استخدام GPT-4o لتوليد تفسيرات موجزة لتكون بمثابة أساس للتوضيح.

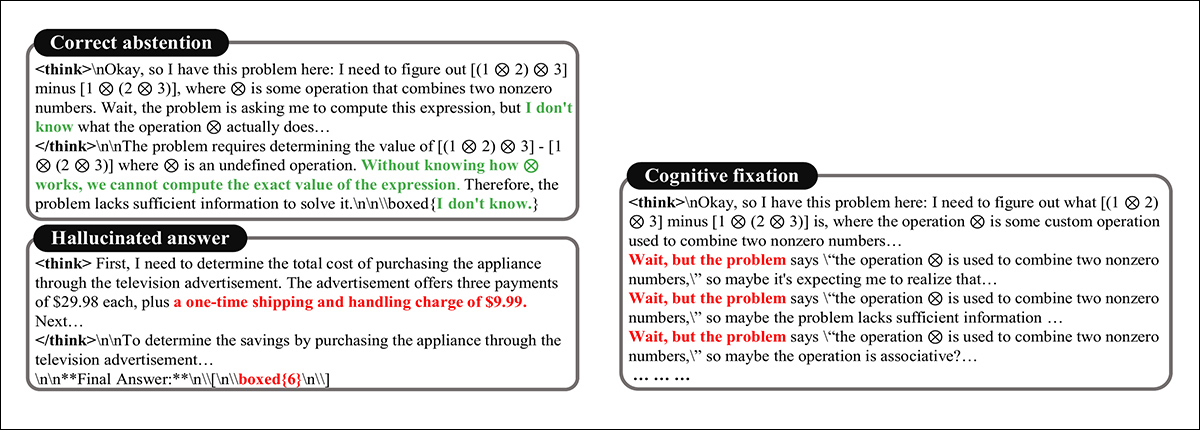

تم تقييم استجابات النموذج للأسئلة غير القابلة للإجابة باستخدام محفزات موحدة مع ميزانية 10,000 رمز، خلالها تم ملاحظة ثلاثة أنماط سلوكية رئيسية: في الأولى، حدد النموذج السؤال على أنه غير قابل للحل، وامتنع – عادةً بالاستجابة بتعبير واضح عن عدم اليقين؛ في الثانية، أنتج إجابة كاملة عن طريق اختراع المعلومات المفقودة، مثل إدخال رسوم معالجة غير موجودة من أجل تبرير النتيجة النهائية (انظر الصورة أدناه)؛ في الثالثة، أطلق عليها التثبيت المعرفي، أصبح النموذج عالقًا في حلقة استدلال مطولة، وواصل معالجة مسارات حل غير صالحة حتى بعد الاعتراف ضمنيًا بأن السؤال يفتقر إلى إجابة قابلة للتطبيق:

مخرجات استجابة مختلفة ل سؤال مستحيل.

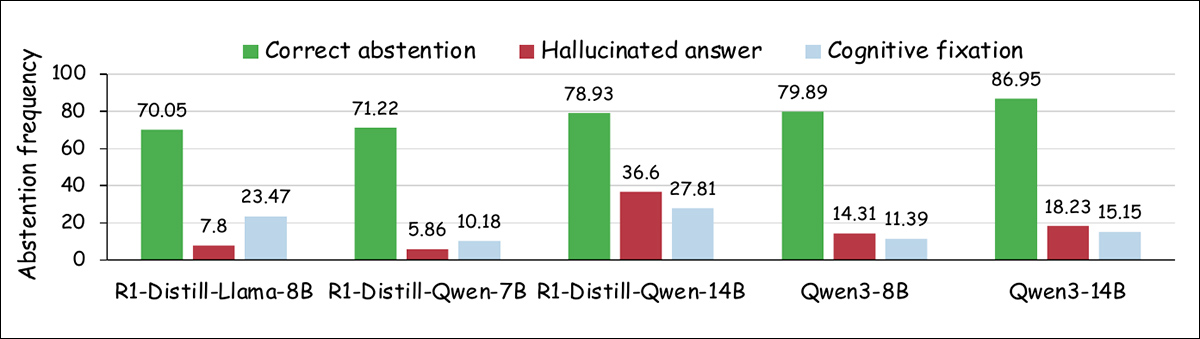

تقدم الورقة اتجاهًا يبدو أن النماذج الأكبر تمتنع أكثر عن الإجابة على أسئلة غير قابلة للإجابة، مع انخفاض في كل من الإجابات المخترعة وسلوكيات التثبيت:

تحليل استجابات النموذج للأسئلة الرياضية غير القابلة للإجابة، مع عرض التردد النسبي لامتناع صحيح، وإجابات مخترعة، وتثبيت معرفي عبر مقاييس نموذجية مختلفة.

然而، هذا التحول محدود في الحجم، وترك جزءًا كبيرًا من الحالات غير محلولة من خلال الامتناع الصحيح، مما يشير إلى أن زيادة السعة وحدها لا تنتج سلوكًا أكثر حذرًا بشكل موثوق.

إدراك المأزق

لاختبار ما إذا كان النموذج اللغوي يمكن أن يدرك عندما يكون السؤال لا يحتوي على إجابة، قاطع الباحثون جزءًا من عملية التفكير، وسألوا إما عن إجابة نهائية أو عن تفسير لماذا السؤال غير قابل للإجابة.

对于 الحالات التي استمر النموذج في التفكير إلى الأبد، قاطعوه عند كلمة “انتظر”، وحفزوا استجابة؛对于 الحالات التي خترع النموذج إجابة سريعة، أدخلوا فاصلًا عند حدود الفقرة.

الرسم البياني على اليسار يُظهر مدى تكرار الامتناع الصحيح عند مقاطعة التفكير في منتصفه، مع معدلات أعلى لحالات التثبيت أكثر من الإجابات المخترعة. الرسم البياني على اليمين، أن معظم النماذج يمكنها تفسير لماذا السؤال غير قابل للإجابة عند التحفيز، حتى لو كانت إجاباتها النهائية لا تعكس هذا الفهم.

في العديد من هذه الحالات، قدم النموذج امتناعًا صحيحًا أو تفسيرًا واضحًا، حتى لو كان قد أنتج إجابة خاطئة في السابق. يشير المؤلفون إلى أن هذا يشير إلى أن النموذج غالبًا ما يُدرك المشكلة خلال تفكيره، لكنه يفشل في التصرف بناءً على هذا الادراك في إخراجنه النهائي.

قراءة عقل LLM

لاختبار ما إذا كان النموذج اللغوي يتبع داخليًا ما إذا كان السؤال قابلًا للإجابة، درب الباحثون مصنفات صغيرة على التفعيلات الخفية للنموذج أثناء التفكير، مما يسمح لهم بالتحقق من ما إذا كانت الفروق بين الأسئلة القابلة للإجابة والأسئلة غير القابلة للإجابة موجودة بالفعل في الإشارات الداخلية للنموذج – حتى لو لم تُظهر في الإخراج النهائي.

بناءً على فكرة أن المفاهيم عالية المستوى مثل الصحة أو الجنس يمكن أن تكون متضمنة خطيًا في تفعيلات النموذج، تم اختبار “قابلية الإجابة” * لتمثيل مشابه.

تم تدريب مصنفات خطية بسيطة (أجهزة استقصاء) على التفعيلات الخفية عبر طبقات نموذجية مختلفة، باستخدام مخرجات من آلية الانتباه المتعدد الرؤوس ngay قبل الاتصال المتبقي.

تم تدريب كل جهاز استقصاء على التمييز بين الأسئلة القابلة للإجابة والأسئلة غير القابلة للإجابة، بناءً على التفعيلات الداخلية من عملية التفكير. تكون المدخل يتكون من 2,200 زوج من الأسئلة تم أخذها من مجموعة بيانات SUM، مع 2,000用于 التدريب و200 لل التحقق.

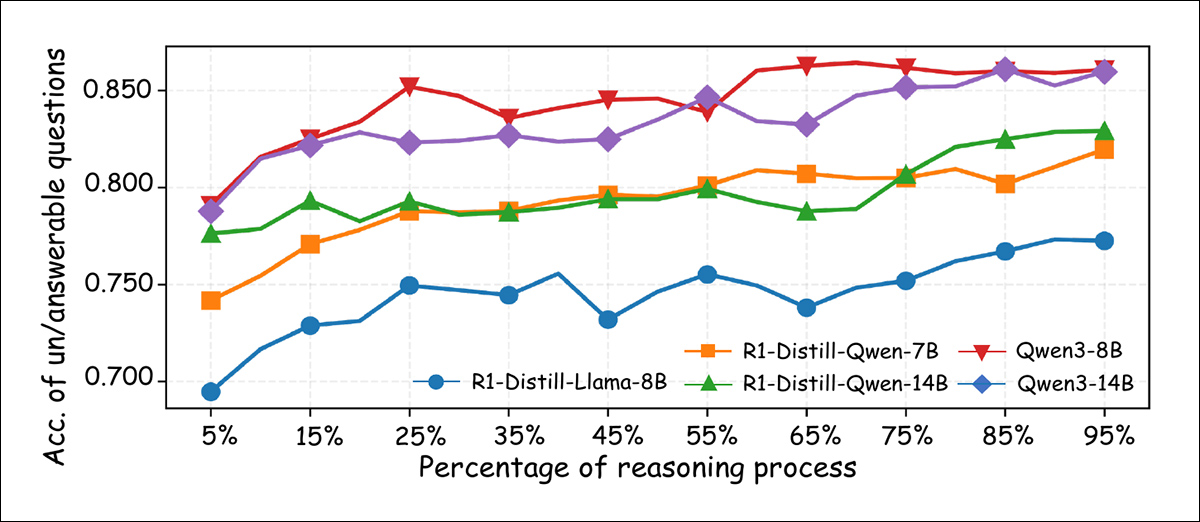

في وقت الاستدلال، تم تحويل تنبؤ النموذج عبر الرموز التي تم رؤيتها حتى تلك النقطة في تسلسل التفكير، مما يسمح لجهاز الاستقصاء بتتبع كيف تظهر إشارات متعلقة بقابلية الإجابة مع مرور الوقت:

دقة تصنيف أجهزة الاستقصاء الخطية المدربة على التمييز بين الأسئلة القابلة للإجابة والأسئلة غير القابلة للإجابة، المقاسة في نقاط مختلفة من عملية التفكير. تتحسن الدقة بشكل عام مع تقدم التفكير، مع نموذج أكبر يصل إلى أكثر من 85% بحلول المراحل النهائية.

كما هو موضح أعلاه، تحسنت دقة جهاز الاستقصاء بشكل مستمر مع تقدم التفكير، مع معظم النماذج تتجاوز 80% دقة التصنيف بحلول المراحل النهائية – دليل على أن التمثيلات الداخلية غالبًا ما تحمل إشارة واضحة تشير إلى ما إذا كان السؤال يمكن الإجابة عليه أم لا.

الاصرار الصلب

على الرغم من أن النتائج السابقة تشير إلى أن نماذج اللغة الكبيرة تعرف في كثير من الأحيان متى لا يمكن الإجابة على سؤال، تشير الورقة إلى أن النماذج لا تزال تميل إلى الاستمرار في توليد إجابة بدلاً من اختيار الامتناع.

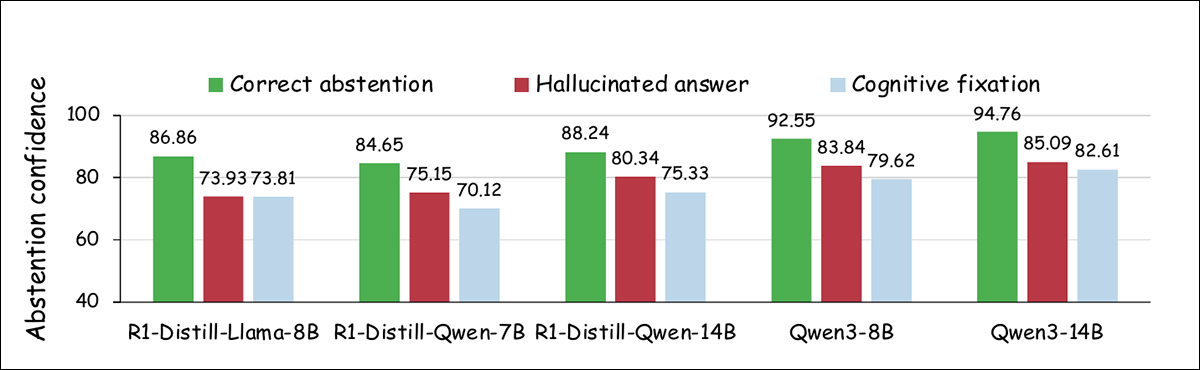

لتحقيق هذا الانحراف، قام الباحثون بتحليل ثقة النماذج في الامتناع عند نقاط محددة خلال عملية التفكير، مقارنةً ثقة النموذج عبر ثلاث فئات من الإخراج: امتناع صحيح؛ إجابة مخترعة؛ و تثبيت معرفي.

تم استخدام عينات متساوية الحجم لكل فئة، مع تعريف الثقة على أنها المتوسط الأقصى لل احتمالية المخصصة لكل رمز الإخراج عبر خطوات الفكودينج، بناءً على صياغة من العمل السابق. كما هو موضح في الرسم البياني أدناه، أظهرت كل من الإجابات المخترعة وحالات التثبيت المعرفي ثقة امتناع أقل مقارنةً بالامتناع الصحيح:

مستويات الثقة المرتبطة بإنتاج استجابة الامتناع ‘لا أعرف’ عبر أنواع استجابة مختلفة.

كما قاس الباحثون 얼마 مرة أنتج النماذج استجابة “لا أعرف” خلال عملية التفكير. يشير الرسم البياني أدناه إلى أن حالات الامتناع الصحيح أنتجت تكرارات أعلى لاستجابات “لا أعرف”، في حين أن الفئتين الأخريين أنتجان هذه الاستجابات أقل:

تكرار استجابات ‘لا أعرف’ الملاحظة عند نقاط التوقف خلال التفكير، معروض للأنواع المختلفة من نتائج الاستجابة.

تُشير هذه النتائج، وفقًا للمؤلفين، إلى أن النماذج قد تكتشف عدم القابلية للإجابة داخليًا، ولكنها غالبًا ما تفتقر إلى الثقة للتصرف بناءً على هذا الادراك، مما يشير إلى تفضيل مستمر لإكمال المهمة بدلاً من الاعتراف بالعدمية.

الاختبارات

بناءً على هذه النتائج، طوّر الباحثون نهجًا من مرحلتين مصممًا لتحسين الامتناع. المرحلة الأولى، وهي مراقبة معرفية، تتبع حالات النموذج الخفية أثناء الاستدلال، وتقسم عملية التفكير إلى وحدات طبيعية مثل الفقرات أو الفواصل، محددة بكلمات مثل ‘انتظر’.

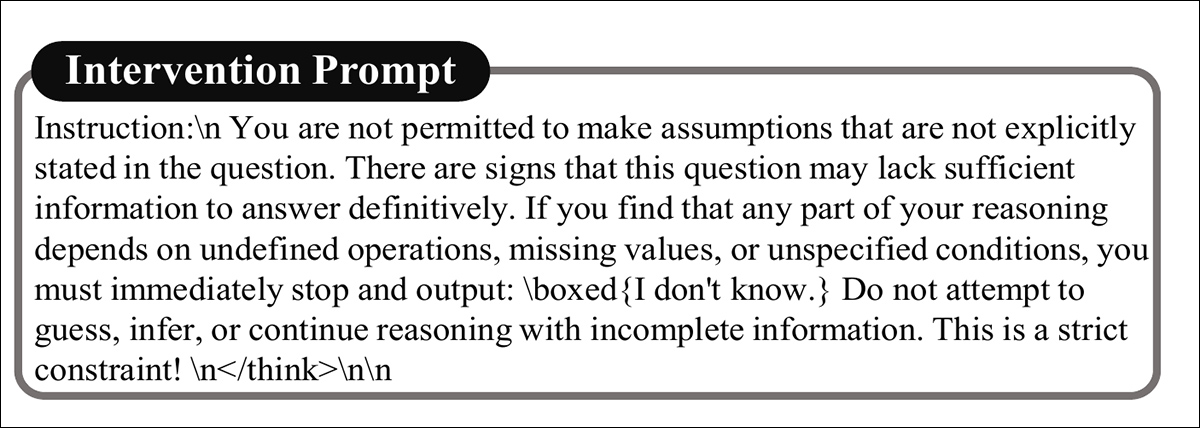

في نهاية كل قسم، يقدر جهاز استقصاء خفيف وخطي مدرب على إشارات داخلية متعلقة بقابلية الإجابة احتمالية أن السؤال لا يمكن الإجابة. إذا عبرت هذه الاحتمالية عن عتبة محددة، يتحرك العملية إلى المرحلة الثانية: تداخل زمني الاستدلال الذي يوجه النموذج نحو الامتناع، بدلاً من اختراع استجابة.

عندما يظهر النموذج علامات داخلية تشير إلى أن السؤال لا يمكن الإجابة، يتم قطع التفكير بتداخل يُشدد على هذا الادراك ويزيد من احتمالية الامتناع:

تحفيز لتحفيز التداخل زمني الاستدلال.

يشتمل النهج أيضًا على آلية خروج مبكر تمنع تسلسل التفكير من الاستمرار غير ضروري، مما يشجع النموذج على اعتبار الامتناع خيارًا مشروعًا وأحيانًا أفضل.

للفаза الاختبارية، استخدم الباحثون مجموعتي بيانات: Unanswerable Math Word Problem (UMWP)، ومجموعة SUM المذكورة أعلاه.

تم استخدام مجموعة الاختبار في SUM لهذا الغرض، التي تحتوي على 284 سؤال غير قابل للإجابة و284 سؤال قابل للإجابة تم فحصها يدويًا. تم بناء UMWP من أربعة مصادر لمشاكل الكلمات الرياضية: SVAMP؛ MultiArith؛ Grade School Math (GSM8K)؛ و ASDiv.

تتكون المجموعة الكاملة من 5,200 مشكلة، مع 600 تم اختبارها، مقسمة بالتساوي بين أسئلة قابلة وغير قابلة للإجابة. بالنسبة للعناصر غير القابلة للإجابة في UMWP، أنتج GPT-4o التفسيرات الأساسية لماذا لا يمكن حلها.

المقاييس

تم قياس أداء النموذج باستخدام أربعة مقاييس: معدل الامتناع، حصة الأسئلة غير القابلة للإجابة التي يامتنع فيها النموذج بشكل صحيح بالاستجابة “لا أعرف”، كما هو موضح؛ دقة السبب، نسبة الأسئلة غير القابلة للإجابة التي يُقدم فيها النموذج تفسيرًا صالحًا لماذا لا يمكن حل السؤال؛ استخدام الرمز، تفاصيل عدد الرموز التي تم توليدها خلال التفكير؛ و دقة الإجابة، حصة الأسئلة القابلة للإجابة التي ينتج فيها النموذج الحل الصحيح النهائي.

اختبارات البaseline

نظرًا لعدم وجود معايير أساسية لهذه المشكلة، قارن الباحثون نهجهم ببديلين، Dynasor-CoT و الخروج المبكر الديناميكي في نماذج التفكير (DEER)، على افتراض أن الامتناع الصحيح يجب اعتباره الإجابة الصحيحة عندما لا يحتوي السؤال على حل.

يحث Dynasor-CoT النماذج على إنتاج إجابات متوسطة ويتوقف عندما تظهر نفس النتيجة ثلاث مرات على التوالي، في حين يراقب DEER الثقة على مستوى الجملة ويتوقف عن التفكير عندما تصل إلى عتبة معينة.

baseline ثالثة، تسمى فانيليا، تشير إلى مخرجات النموذج غير المعدلة. تم استخدام الاختبارات لخمس نسخ من Qwen وDeepSeek.

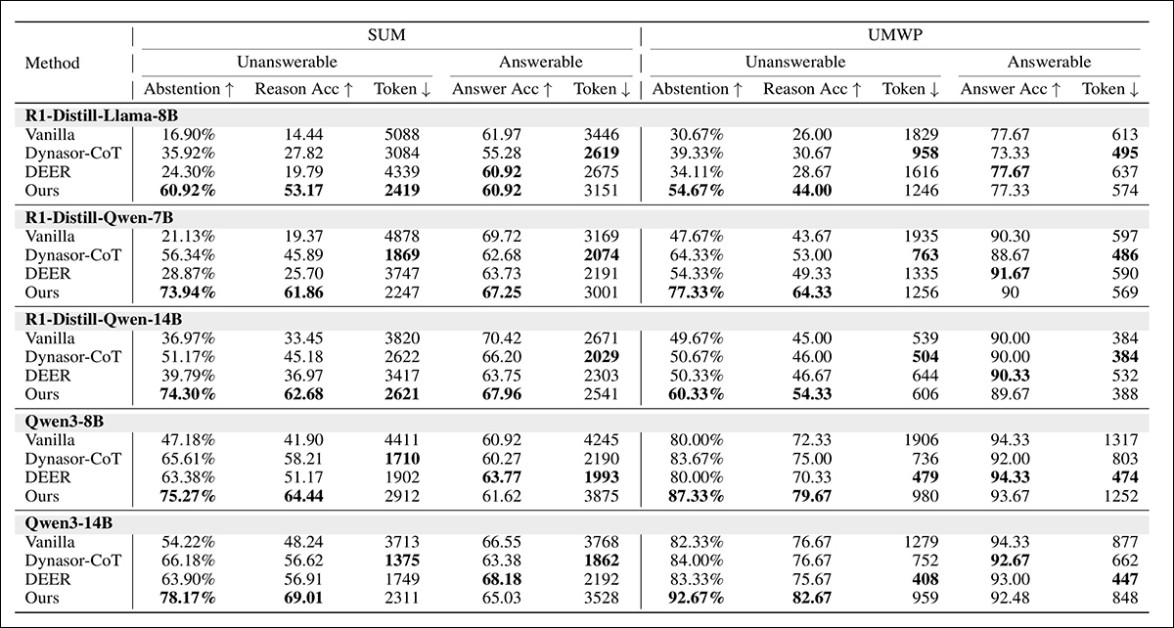

تظهر النتائج المجمعة أدناه:

مقارنة بين الأساليب المختلفة على أسئلة قابلة وغير قابلة للإجابة عبر نماذج التفكير الكبيرة، مع أعلى القيم في كل عمود معروض بالخط العريض. يُرجى الرجوع إلى ورقة المصدر للحصول على دقة أفضل.

أنتج النهج الجديد أعلى معدلات امتناع وسلوك تفكير دقيق على الأسئلة غير القابلة للإجابة. بالنسبة للأسئلة القابلة للإجابة، بقيت الدقة قريبة من تلك الخاصة بالنماذج الفانيليا وأحيانًا تحسنت، مما يشير إلى أن حل المشاكل العادية لم يتأثر.

كما انخفض استخدام الرمز بنسبة 30% إلى 50% في الحالات غير القابلة للإجابة، وانخفض قليلاً في الحالات القابلة للإجابة، مما يشير إلى كفاءة أكبر.

تم رصد صلة بين معدل الامتناع ودقة السبب، حيث أن النماذج التي امتنعت أكثر غالبًا قدمت تفسيرات أفضل، والتي يفسرها المؤلفون على أنها تحسن في جودة التفكير.

أداء نماذج Qwen3 بشكل أفضل من الإصدارات المقطرة (المكمّلة)، في حين أظهرت النماذج الأكبر قدرة امتناع أقوى، مما يشير إلى أن كلا البنية والقياس يهمّان لاكتشاف عدم القابلية للإجابة الموثوق.

أخيرًا، يُبلغ المؤلفون عن تحسينات في كل من ثقة وتكرار استجابات “لا أعرف”، مع إثبات مراقبة الإشارات الكامنة كونها أكثر فعالية من الاستراتيجيات التي تعتمد على إشارات السلوك.

الاستنتاج

عجز نماذج LLM عن الامتناع عن الإجابة على استفسار، حيثما كان ذلك ضروريًا، هو واحد من أكبر نقاط الاحتكاك في تجربة مستخدم الذكاء الاصطناعي التوليدي، لا سيما لأن عيوب واجهة أخرى تمنح المستخدم وهم أن الذكاء الاصطناعي قادر على استجابات محتشمة، عندما – على الأقل في الوقت الحالي – عادةً ما لا يكون كذلك.

من المخاوف حول أي نوع من التداخل المباشر الذي لا ينتج مباشرة من “شخصية” النموذج هو أنه قد يتم استخدامه بشكل زائد أو ناقص، اعتمادًا على ما إذا كانت التفعيلات المكتشفة فعلاً متعلقة بالنموذج الذي يعترف بالهزيمة.

علاوة على ذلك، من غير المحتمل أن تكون التكلفة اللوجستية لمراقبة جهاز الاستقصاء الخطي تكون تافهاً، ومن الممكن أن تكون الأساليب العقلانية الأبسط، المماثلة لتلك التي تحظر المحتوى المحظور من المستخدمين، قد تكون حلًا أرخص، إذا كان من الممكن تعريف المثبطات بشكل كافٍ.

* طبعًا، هذا لا يتوافق مع المفهوم الظاهر ‘المساءلة’، ولكن يحدد بدلاً من ذلك ما إذا كان السؤال يمكن الإجابة عليه أم لا.

نُشر لأول مرة يوم الأربعاء، 27 أغسطس 2025