زاوية Anderson

تلوث الذكاء الاصطناعي في نتائج البحث يهدد بحدوث ‘انهيار الاسترجاع’

随着人工智能内容污染网络,一个新的攻击向量在文化共识的战场上打开。

由一家韩国搜索公司领导的研究认为,随着 人工智能生成的页面 逐渐进入搜索结果,它们破坏了搜索和排名管道的稳定性,并削弱了依赖这些排名来决定哪些信息被显示和信任的系统,例如检索增强生成(RAG),从而增加了误导性或不准确的材料被视为权威的风险。

研究人员为这种症状创造的术语是 检索崩溃,与已知的模型崩溃威胁(模型崩溃)不同,模型崩溃是指人工智能在其自身输出上训练时变得越来越糟糕(变得越来越糟糕)。

在检索崩溃场景中,人工智能生成的内容逐渐主导搜索引擎结果,以至于即使答案在表面上仍然准确,基础证据基础也将与原始人类来源脱节。然而,这些“无根”的数据似乎有可能在搜索结果中获得高排名:

‘随着人工智能生成文本的普及,归属和预训练 数据质量 的挑战加剧。与传统的关键词 垃圾邮件 不同,现代合成内容在语义上是连贯的,允许它融入排名系统并作为权威证据传播 通过管道‘。

该论文断言,这将创造一个“结构脆弱”的环境,在这种环境中,排名信号偏向人工智能生成、SEO 优化的页面,随着时间的推移,人类作者的来源将被逐渐取代,而不会触发明显的答案质量下降:

‘网络上人工智能生成内容的增长对信息检索构成了结构风险,因为搜索引擎和检索增强生成(RAG)系统越来越多地消耗大型语言模型(LLM)生成的证据。

‘我们将这种生态系统级别的故障模式称为检索崩溃,它是一个两阶段过程:(1)人工智能生成的内容主导搜索结果,侵蚀源多样性,(2)低质量或对抗性内容渗透到检索管道中’。

研究人员认为,一旦“主导”阶段建立,相同的检索管道将更容易受到故意污染的影响,因为对抗性页面可以利用相同的优化机制来获得可见性*:

‘通过建立检索崩溃的框架,本工作为理解合成内容如何重塑信息检索奠定了基础。为了减轻这些风险,我们提议转向 防御性排名策略,该策略同时优化相关性、事实性和来源’。

检索崩溃可能会加剧模型崩溃,因为它在“复印效应”的熵上添加了一层恶意意图,即人工智能越来越多地以人工智能生成的输出为食。除了影响搜索结果中“真相”的明显共识外,不准确性和攻击还可能后来被训练的 LLM 储存为权威来源。

该论文题为 当人工智能污染网络时检索崩溃,由 Naver Corporation 的三位研究人员撰写。

方法

为了测试人工智能生成的内容如何传播通过检索系统,研究人员从 MS MARCO 数据集和基准中随机抽取了 1000 个查询/答案对,该数据集由开放领域问题和人类验证的参考答案组成。这些用于检索和评估生成的响应的事实正确性。

对于测试中的每个 MS MARCO 查询,根据每个术语的顶级 SEO 结果,从 Google 搜索中检索了十个 Web 文档,最后产生了一个包含 10,000 个文档的池。

使用 GPT-5 Mini 作为法官,通过将每个文档与 MS MARCO 基准事实进行比较来评估文档的事实有效性。

内容农场模拟

为了模拟内容农场相关的正常(非对抗性)文章的质量水平,作者使用了经济的 GPT-5 Nano OpenAI 模型来生成新的合成文章,因为这是内容工厂可能使用的“经济”的人工智能水平。用于评估输出的 GPT-5 Mini 是一个稍微更强大的模型。

相反,为了模拟 对抗性 文章(即旨在传播错误信息或包含错误信息的内容),没有使用任何现实世界的引用。相反,样本的第一稿是使用传统的点击诱饵/SEO 生成器创建的,然后传递给 GPT-5 Nano,后者被任务用合理但不正确的替代事实替换某些事实。GPT-5 Nano 还执行了语义重新排名,以适应实验背景。

为了模拟随时间推移的人工智能饱和度,运行了一个 20 轮的污染过程,其中每轮查询向一个固定集合的十个原始文档中添加一个合成文档,增加了人工智能的份额,从 0% 到 66.7%。

对于 SEO 风格的池,生成器被提示“扮演 SEO 专家”的角色,并从原始文档中集成 高 IDF 关键字,以提高检索可能性。

对于对抗性池,提示的设计目的是在保留流畅、自然听起来的散文的同时,微妙地改变命名实体和数字细节,创建不会触发统计过滤器的文档,同时悄悄地破坏事实准确性。

指标

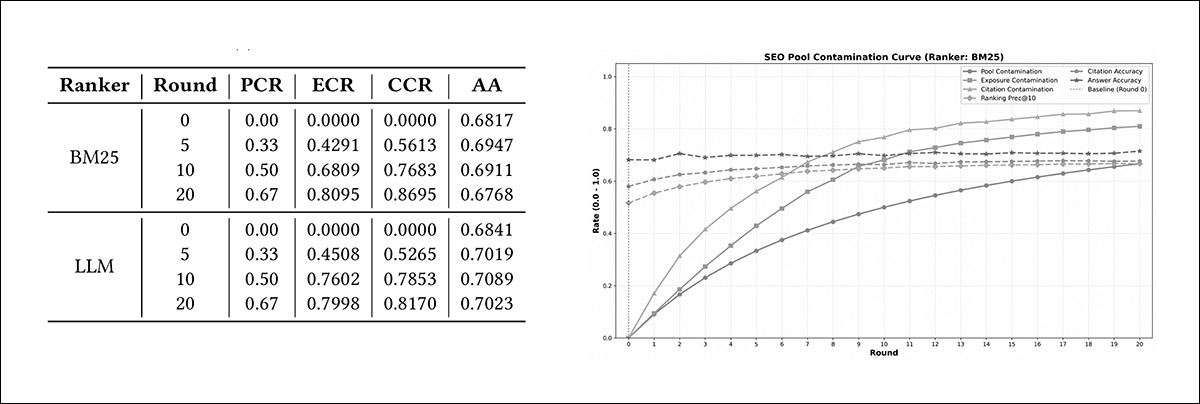

采用了三个指标:池污染率(PCR),用于确定文档池中有多少是人工智能生成的;暴露污染率(ECR),用于衡量搜索结果的前十名中有多少来自人工智能来源(表明哪些进入了检索管道);以及引用污染率(CCR),用于记录最终答案中有多少证据是合成的。

为了检查实际影响,检验了检索来源的质量和最终答案的完整性。 精度@10(P@10)捕获了在与 MS MARCO 基准事实检查时,前十名结果中有多少实际上是正确的;答案准确性(AA)衡量了生成的响应是否与参考答案匹配,使用 GPT-5 Mini 确定其含义是否一致。

测试

最初,作者将他们的方法与从 SERPS 中提取的原始文档池进行了测试,即在使用它们生成合成数据之前,并且他们注意到他们的 LLM 排名器实现了“强大的检索质量”,超越了 BM25 排名器 基准。

两个主要场景测试中的第一个被称为 主导和同质化,它检查了 SEO 形成的合成文档如何影响检索结果:

左:污染曲线图显示 BM25 和 LLM 排名器的 PCR 随轮数增加而上升,ECR 和 CCR 随着合成文档涌入前十名结果而更陡峭地增加,而答案准确性(AA)基本保持稳定。右:表格以数字形式报告了相同的进展,跨越 0、5、10 和 20 轮,详细列出了 BM25 和 LLM 排名器的 PCR、ECR、CCR 和 AA