زاوية Anderson

الطريق إلى تحرير الفيديو القائم على الذكاء الاصطناعي الأفضل

يتردد قطاع أبحاث 합성 الفيديو / الصورة بانتظام معمارية لتحرير الفيديو، وعلى مدى آخر تسعة أشهر، أصبحت هذه الإخراج أكثر تواترًا. ومع ذلك، فإن معظمها يمثل فقط تحسينات متتالية على حالة الفن، منذ أن تكون التحديات الأساسية كبيرة.

ومع ذلك، فقد أنتجت تعاونية جديدة بين الصين واليابان هذا الأسبوع بعض الأمثلة التي تستحق فحصًا أعمق لنهجها، حتى إذا لم تكن بالضرورة عملًا رائدًا.

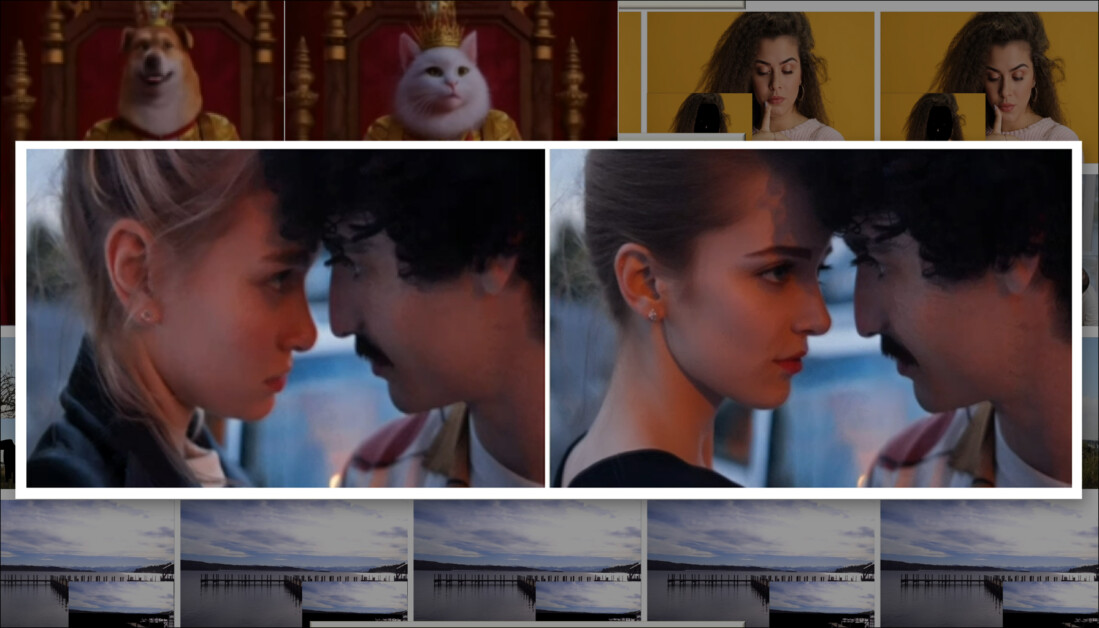

في مقطع الفيديو أدناه (من موقع المشروع المرتبط بالورقة – الذي قد يؤدي إلى إبطاء متصفحك) نرى أن قدرات التزييف العميق للنظام غير موجودة في التكوين الحالي، إلا أن النظام يقوم بعمل جيد في تغيير هوية الشابة في الصورة بطريقة معقولة ومهمة، بناءً على قناع فيديو (الزاوية اليسرى السفلى):

انقر للتشغيل. بناءً على قناع التجزئة الدلالية الموضح في الزاوية اليسرى السفلى، يتم تحويل المرأة الأصلية (الزاوية العلوية اليسرى) إلى هوية متميزة بشكل ملحوظ، على الرغم من أن هذه العملية لا تحقق التبادل الهوياتي المشار إليه في الإشارة. (كن على علم بأن الموقع في وقت الكتابة كان يميل إلى تعطيل متصفحي). يرجى الرجوع إلى مقاطع الفيديو الأصلية، إذا كنت تستطيع الوصول إليها، للحصول على دقة وأفكار أفضل، أو تحقق من الأمثلة في مقطع فيديو المشروع في https://www.youtube.com/watch?v=HYzNfsD3A0s

تحرير القناع من هذا النوع هو أمر متعارف عليه في نماذج الانحلال الكامن الثابتة، باستخدام أدوات مثل ControlNet. ومع ذلك، فإن الحفاظ على توافق الخلفية في الفيديو أكثر تحديًا، حتى عندما توفر المناطق المقنعة للنموذج مرونة إبداعية، كما هو موضح أدناه:

انقر للتشغيل. تغيير في النوع، باستخدام طريقة VideoPainter الجديدة. يرجى الرجوع إلى مقاطع الفيديو الأصلية، إذا كنت تستطيع الوصول إليها، للحصول على دقة وأفكار أفضل، أو تحقق من الأمثلة في مقطع فيديو المشروع في https://www.youtube.com/watch?v=HYzNfsD3A0s

يعتبر مؤلفو العمل الجديد طريقةهم فيما يتعلق ببنية BrushNet التابعة لشركة Tencent (التي غطيناها في العام الماضي)، وبالنسبة إلى ControlNet، كلاهما يعاملان مع هيكل ذراع مزدوج يمكنه عزل توليد الخلفية والأمامية.

ومع ذلك، فإن تطبيق هذه الطريقة مباشرة على نهج المحولات الانحلالية (DiT) المقترح من قبل OpenAI’s Sora، يطرح تحديات معينة، كما يشير المؤلفون إلى ذلك

‘[تطبيق] هيكل BrushNet وControlNet مباشرة على فيديو DiTs يطرح عدة تحديات: [أولاً، نظرًا لأن] فيديو DiT يحتوي على أساس توليد قوي وحجم نموذج كبير، فإن تكرار هيكل فيديو DiT الكامل أو النصف عملاق كنموذج معالجة سياق سيكون غير ضروري ومحرم من الناحية الحسابية.

‘[ثانياً، على عكس] فرع التحكم الخالص في BrushNet، فإن الرموز في المناطق المقنعة في DiT تحتوي بشكل طبيعي على معلومات خلفية بسبب الانتباه العالمي، مما يُ复ّق الفرق بين المناطق المقنعة وغير المقنعة في هيكل DiT.

‘[أخيرًا،] يفتقر ControlNet إلى حقن الميزات عبر جميع الطبقات، مما يحد من التحكم الخلفي الكثيف لمهام التعبئة. ‘

لذلك قام الباحثون بتطوير نهج متوافق في شكل إطار ذراع مزدوج يسمى VideoPainter.

يقدم VideoPainter إطارًا مزدوج الذراع لتعبئة الفيديو الذي يعزز النماذج المسبقة من DiTs مع معالج سياق خفيف الوزن. هذا المعالج يأخذ في الاعتبار فقط 6٪ من معاملات الهيكل، والتي يزعم المؤلفون أنها تجعل النهج أكثر كفاءة من الطرق التقليدية.

يقترح النموذج ثلاث ابتكارات رئيسية: معالج سياق مبسط من طبقتين لتقديم توجيه خلفية فعال، ونظام دمج ميزات حاسمة يفصل بين الرموز المقنعة وغير المقنعة، وتقنية إعادة عينة منطقة التعبئة التي تحتفظ بالتوافق الهوياتي عبر تسلسلات فيديو طويلة.

من خلال تجميد كلا النموذج المسبق من DiT ومعالج السياق أثناء إدخال مقسم الهوية، يضمن VideoPainter أن رموز منطقة التعبئة من مقاطع سابقة تظل على طول الفيديو، مما يقلل من الوميض والتناقضات.

كما تم تصميم الإطار لتوافق متوافق، مما يسمح للمستخدمين بدمجها بشكل سلس في تدفقات توليد الفيديو وتحريرها الحالية.

لدعم العمل، الذي يستخدم CogVideo-5B-I2V كمحرك توليد، قام المؤلفون بتحضير ما يُزعم أنه أكبر مجموعة بيانات لتعبئة الفيديو حتى الآن. يسمى هذا الجمع VPData، ويتكون من أكثر من 390,000 مقطع، لمجموع مدة فيديو تزيد عن 886 ساعة. كما طوّروا إطار اختبار متعلق يسمى VPBench.

انقر للتشغيل. من الأمثلة على موقع المشروع، نرى قدرات التجزئة المدعومة من مجموعة بيانات VPData واختبار VPBench. يرجى الرجوع إلى مقاطع الفيديو الأصلية، إذا كنت تستطيع الوصول إليها، للحصول على دقة وأفكار أفضل، أو تحقق من الأمثلة في مقطع فيديو المشروع في https://www.youtube.com/watch?v=HYzNfsD3A0s

العمل الجديد هو مسمى VideoPainter: Any-length Video Inpainting and Editing with Plug-and-Play Context Control، ويأتي من سبعة مؤلفين في Tencent ARC Lab، والجامعة الصينية في هونغ كونغ، وجامعة طوكيو، وجامعة ماكاو.

بجانب موقع المشروع المذكور أعلاه، قام المؤلفون أيضًا بنشر مقطع فيديو على YouTube أكثر سهولة، وكذلك صفحة على Hugging Face.

الطريقة

يتكون خط أنابيب جمع البيانات لمجموعة VPData من جمع، وتعليق، تقسيم، اختيار، وكتابة التعليقات:

مخطط لخط أنابيب بناء المجموعة Source: https://arxiv.org/pdf/2503.05639

جاءت المجموعات المصدر المستخدمة لهذه المجموعة من Videvo و Pexels، مع حصيلة أولية تبلغ حوالي 450,000 فيديو.

تضمن مرحلة المعالجة الأولية مكتبات ومكتبات متعددة: تم استخدام إطار Recognize Anything لتوفير تعليق فيديو مفتوح، مهمته تحديد الكائنات الرئيسية؛ تم استخدام Grounding Dino لاكتشاف صناديق التحييد حول الكائنات المحددة؛ وتم استخدام إطار Segment Anything Model 2 (SAM 2) لتحسين هذه الاختيارات الخشنة إلى تجزئة عالية الجودة.

لإدارة انتقالات المشهد وضمان الاتساق في تعبئة الفيديو، يستخدم VideoPainter PySceneDetect لتحديد مقاطع الفيديو عند نقاط الانقطاع الطبيعية، وتجنب التحولات المزعجة التي تسببها تتبع نفس الكائن من زوايا متعددة. تم تقسيم المقاطع إلى فترات مدتها 10 ثوان، مع إهمال أي شيء أقصر من 6 ثوان.

للاختيار، تم تطبيق ثلاثة معايير تصفية: الجودة الجمالية، تم تقييمها باستخدام Laion-Aesthetic Score Predictor؛ قوة الحركة، تم قياسها عبر الانسياب البصري باستخدام RAFT؛ و سلامة المحتوى، تم التحقق منها من خلال Safety Checker للاستحواذ المستقر.

تتمثل إحدى القيود الرئيسية في مجموعات بيانات التجزئة الحالية في عدم وجود تعليقات نصية مفصلة، والتي هي أساسية لتوجيه النماذج التوليدية:

يشدد الباحثون على عدم وجود تعليقات الفيديو في المجموعات المماثلة.

لذلك، فإن عملية تحضير بيانات VideoPainter تتضمن نماذج رؤية-لغة رائدة، بما في ذلك CogVLM2 و Chat GPT-4o لتوليد تعليقات مفتاحية ووصف مفصل للمناطق المقنعة.

يعزز VideoPainter النماذج المسبقة من DiTs من خلال إدخال معالج سياق خفيف الوزن مخصص. هذا المعالج يأخذ في الاعتبار فقط 6٪ من معاملات الهيكل، والتي يزعم المؤلفون أنها تجعل النهج أكثر كفاءة من الطرق التقليدية.

يقترح النموذج ثلاث ابتكارات رئيسية: معالج سياق مبسط من طبقتين لتقديم توجيه خلفية فعال، ونظام دمج ميزات حاسمة يفصل بين الرموز المقنعة وغير المقنعة، وتقنية إعادة عينة منطقة التعبئة التي تحتفظ بالتوافق الهوياتي عبر تسلسلات فيديو طويلة.

من خلال تجميد كلا النموذج المسبق من DiT ومعالج السياق أثناء إدخال مقسم الهوية، يضمن VideoPainter أن رموز منطقة التعبئة من مقاطع سابقة تظل على طول الفيديو، مما يقلل من الوميض والتناقضات.

البيانات والاختبارات

تم تدريب VideoPainter باستخدام نموذج CogVideo-5B-I2V، إلى جانب نظيره النصي-الفيديو. تم استخدام مجموعة بيانات VPData المعدة عند 480x720px، عند معدل تعلم 1×10-5.

تم تدريب مقسم إعادة العينة الهوية لمدة 2,000 خطوة، ومعالج السياق لمدة 80,000 خطوة، كلاهما باستخدام محسّن AdamW. تم إجراء التدريب في مرحلتين باستخدام 64 من وحدات معالجة الرسومات V100 من NVIDIA (على الرغم من أن الورقة لا تحدد ما إذا كانت هذه الوحدات تحتوي على 16 غيغابايت أو 32 غيغابايت من ذاكرة الوصول العشوائي).

للاختبار، تم استخدام Davis لأقنعة عشوائية، والمؤلفون اختبار VPBench الخاص بهم لأقنعة التجزئة.

يتميز اختبار VPBench بموضوعات، وحيوانات، وبشر، ومناظر طبيعية، ومهام متنوعة، ويتضمن أربع أفعال: إضافة، إزالة، تغيير، و تبادل. يحتوي على 45 مقطع فيديو مدته 6 ثوان، و 9 مقاطع فيديو مدتها 30 ثانية في المتوسط.

تم استخدام ثمانية مقاييس للاختبار. لتحافظ على منطقة التعبئة، استخدم المؤلفون نسبة الإشارة إلى الضوضاء القصوى (PSNR)؛ المقاييس الشبيهة المكتسبة (LPIPS)؛ مؤشر التشابه الهيكلي (SSIM)؛ و متوسط الخطأ المطلق (MAE).

للمحاذاة النصية، استخدم الباحثون تشابه CLIP لتقييم المسافة الدلالية بين تعليق المقطع وفهم المحتوى الفعلي، وتقييم دقة المناطق المقنعة.

لتقييم جودة الفيديو الخروجي بشكل عام، تم استخدام مسافة الفيديو Fréchet (FVD).

للمقارنة الكمية لتعبئة الفيديو، قام المؤلفون بتحديد نظامهم ضد النهوج السابقة ProPainter، COCOCO و Cog-Inp (CogVideoX). يتكون الاختبار من تعبئة الإطار الأول من مقطع فيديو باستخدام نماذج تعبئة الصور، ثم استخدام هيكل صورة-لفيديو (I2V) لتنفيذ عملية مزج لاتنتي، وفقًا لنهج مقترح في ورقة 2023 من إسرائيل.

由于 موقع المشروع غير متوفر بالكامل في وقت الكتابة، و由于 فيديو YouTube المرتبط بالمشروع قد لا يحتوي على جميع الأمثلة الموجودة في موقع المشروع، فمن الصعب العثور على أمثلة فيديو محددة جدًا للنتائج المحددة في الورقة. لذلك سنعرض بعض النتائج الثابتة الجزئية الموجودة في الورقة، ونهتم ببعض الأمثلة الإضافية التي استخدمناها من موقع المشروع.

المقارنة الكمية بين VideoPainter و ProPainter و COCOCO و Cog-Inp على VPBench (أقنعة التجزئة) و Davis (أقنعة عشوائية). المقاييس تغطي حفظ منطقة التعبئة، والمحاذاة النصية، وجودة الفيديو. الأحمر = الأفضل، الأزرق = الثاني أفضل.

يعلق المؤلفون على هذه النتائج الكمية:

‘في اختبار VPBench القائم على التجزئة، يظهر ProPainter و COCOCO أسوأ أداء عبر معظم المقاييس، بشكل رئيسي بسبب عدم القدرة على تعبئة الكائنات المقنعة بالكامل وضعة هيكل الذراع المفرد في صعوبة موازنة الحفاظ على الخلفية وتوليد الواجهة، على التوالي.

‘في اختبار ديفيس للأقنعة العشوائية، يظهر ProPainter تحسنًا من خلال الاستفادة من المعلومات الخلفية الجزئية. ومع ذلك، يحقق VideoPainter أداءً مثاليًا عبر التجزئة (القياسية وطويلة المدى) والأقنعة العشوائية من خلال هيكله ذي الذراع المزدوج الذي يفصل بشكل فعال بين الحفاظ على الخلفية وتوليد الواجهة، مع إعادة عينة منطقة التعبئة التي تحتفظ بالتوافق الهوياتي في الفيديو الطويل.’

يُقدم المؤلفون أمثلة ثابتة للاختبارات النوعية، والتي نampilkan بعضها أدناه. في جميع الحالات، نرجو من القارئ الرجوع إلى موقع المشروع وفيديو YouTube للحصول على دقة أفضل.

مقارنة مع أساليب التعبئة في الإطارات السابقة.

انقر للتشغيل. أمثلة تم دمجها من قبلنا من مقاطع الفيديو “النتائج” على موقع المشروع.

بخصوص هذه الجولة النوعية لتعبئة الفيديو، يعلق المؤلفون:

‘يظهر VideoPainter باستمرار نتائج استثنائية في انسجام الفيديو، والجودة، والمحاذاة مع التعليق النصي. و特别، يفشل ProPainter في توليد كائنات مقنعة بالكامل لأنه يعتمد فقط على انتشار بكسل الخلفية بدلاً من التوليد.

‘في حين يظهر COCOCO الوظيفة الأساسية، يفشل في الحفاظ على الهوية الثابتة في مناطق التعبئة (تغيرات غير متسقة في المظهر والمناظر الطبيعية) بسبب هيكله ذي الذراع المفرد الذي يحاول موازنة الحفاظ على الخلفية وتوليد الواجهة.

‘يحقق Cog-Inp نتائج تعبئة أساسية؛ ومع ذلك، يؤدي عدم قدرة عملية المزج على اكتشاف حدود القناع إلى حدوث شوائب كبيرة.

‘علاوة على ذلك، يمكن ل VideoPainter توليد فيديوهات متسقة تتجاوز دقيقة واحدة مع الحفاظ على توافق الهوية من خلال إعادة عينة الهوية.’

كما قام الباحثون بتحديد قدرة VideoPainter على تعزيز التعليقات والحصول على نتائج محسنة بهذه الطريقة، ووضع النظام ضد UniEdit، DiTCtrl، و ReVideo.

نتائج تحرير الفيديو مقابل ثلاث نهوج سابقة.

يعلق المؤلفون:

‘للفيديوهات القياسية والطويلة في VPBench، يحقق VideoPainter أداءً متفوقًا، حتى يتجاوز نهج ReVideo الشامل. يمكن أن يُعزى هذا النجاح إلى هيكله ذي الذراع المزدوج، الذي يضمن الحفاظ على الخلفية وتوليد الواجهة، مع إعادة عينة منطقة التعبئة التي تحتفظ بالتوافق الهوياتي في الفيديو الطويل.’

على الرغم من أن الورقة تحتوي على أمثلة ثابتة نوعية لهذا المقاييس، إلا أنها غير مضيئة، ونرجو من القارئ الرجوع إلى الأمثلة المتنوعة الموزعة عبر مقاطع الفيديو المنشورة لهذا المشروع.

أخيرًا، تم إجراء دراسة بشرية، حيث تم طلب من 30 مستخدمًا تقييم 50 جيلًا تم اختياره عشوائيًا من مجموعتي VPBench وتحرير. أبرزت الأمثلة الحفاظ على الخلفية، والمحاذاة مع الإشارة، وجودة الفيديو بشكل عام.

نتائج الدراسة المستخدمة ل VideoPainter.

يصرح المؤلفون:

‘يتفوق VideoPainter بشكل كبير على الأسس السابقة، يحقق معدلات تفضيل أعلى عبر جميع معايير التقييم في كلا المهمتين.’

يقررون، مع ذلك، بأن جودة توليدات VideoPainter تعتمد على النموذج الأساسي، الذي يمكن أن يصاب بصعوبات الحركة والفيزياء؛ ويلاحظون أيضًا أنه يؤدي أداءً سيئًا مع أقنعة رديئة أو تعليقات غير متوافقة.

الختام

يبدو أن VideoPainter إضافة جيدة إلى الأدبيات. نموذجيًا للحلول الحديثة، ومع ذلك، فإن لديها طلبات حسابية كبيرة. بالإضافة إلى ذلك، فإن العديد من الأمثلة المختارة للعرض على موقع المشروع يقعون بعيدًا جدًا عن أفضل الأمثلة؛ لذلك سيكون من المثير رؤية هذا الإطار يواجه مدخلات مستقبلية، ومجموعة أوسع من النهوج السابقة.

* من الجدير بالذكر أن “تحرير الفيديو” في هذا السياق لا يعني “تجميع مقاطع فيديو متنوعة في تسلسل”، وهو المعنى التقليدي لهذا المصطلح؛ بل يعني تغيير أو تعديل محتوى مقاطع الفيديو الحالية بطريقة ما، باستخدام تقنيات الذكاء الاصطناعي

نُشر لأول مرة يوم الإثنين، 10 مارس 2025