زاوية أندرسون

قد تكون مقاطع الفيديو المزيفة الأصغر حجمًا هي التهديد الأكبر

تُستخدم الآن أدوات الذكاء الاصطناعي التفاعلية، مثل ChatGPT وGoogle Gemini، لإنشاء مقاطع فيديو مزيفة عميقة لا تُبدّل الوجوه، بل تُعيد صياغة القصة كاملةً داخل الصورة بطرق أكثر دقة. من خلال تغيير الإيماءات والدعائم والخلفيات، تُخدع هذه التعديلات كلاً من أجهزة كشف الذكاء الاصطناعي والبشر، مما يزيد من صعوبة كشف الحقيقة على الإنترنت.

في المناخ الحالي، وخاصة في أعقاب التشريعات الهامة مثل أزلها في الواقع، يربط الكثير منا بين التزييف العميق وتركيب الهوية الذي يعتمد على الذكاء الاصطناعي وبين المواد الإباحية غير المتفق عليها بالذكاء الاصطناعي والتلاعب السياسي - بشكل عام، إجمالي تحريفات الحقيقة.

وهذا يجعلنا نتوقع أن الصور التي تم التلاعب بها بواسطة الذكاء الاصطناعي سوف تستهدف دائمًا محتوى عالي المخاطر، حيث قد تنجح جودة العرض والتلاعب بالسياق في تحقيق انقلاب في المصداقية، على الأقل في الأمد القريب.

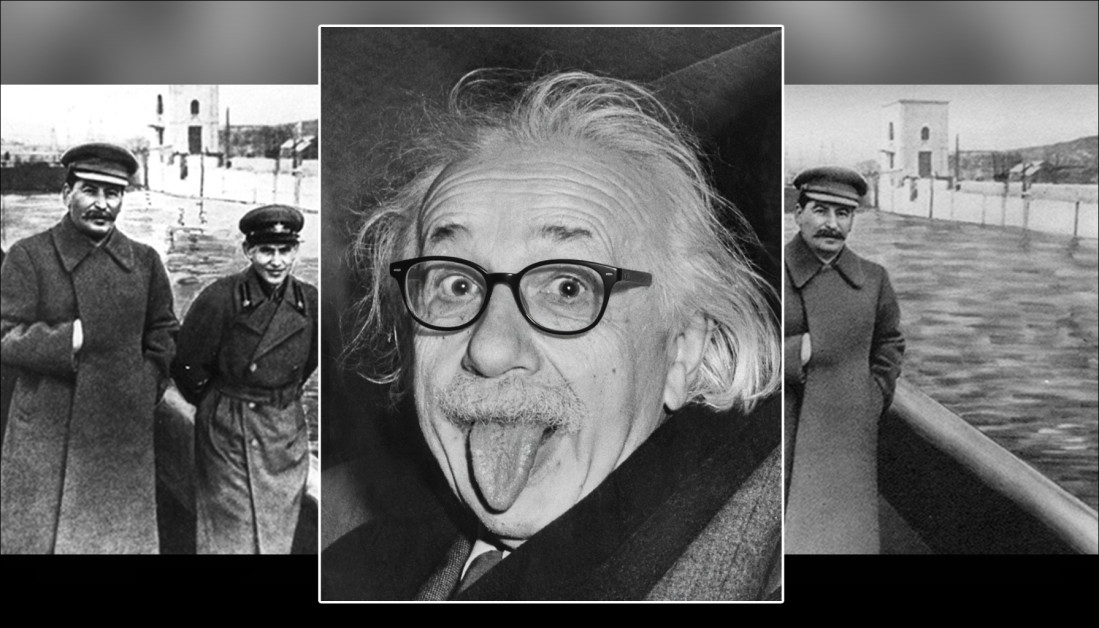

ولكن من الناحية التاريخية، كانت التغييرات الأكثر دقة غالبًا ما يكون لها تأثير أكثر شرًا واستمرارًا - مثل الخدع الفوتوغرافية الحديثة التي سمحت لستالين بـ إزالة تلك الذين فقدوا مكانتهم في السجل الفوتوغرافي، كما سخر منهم جورج أورويل في رواية الف وتسعمائة واربعة وثمانونحيث يقضي بطل الرواية ونستون سميث أيامه في إعادة كتابة التاريخ وإنشاء الصور وتدميرها و"تعديلها".

في المثال التالي، المشكلة مع ثان الصورة هي أننا "لا نعرف ما لا نعرفه" - وأن رئيس الشرطة السرية السابق لستالين، نيكولاي ييجوف، كان يشغل المكان الذي لم يعد فيه الآن سوى حاجز أمان:

الآن تراه، الآن هو... بخار. تلاعب بالصور من عهد ستالين يُزيل عضوًا مُخزيًا في الحزب من التاريخ. المصدر: المجال العام، عبر https://www.rferl.org/a/soviet-airbrushing-the-censors-who-scratched-out-history/29361426.html

تستمر هذه التيارات، المتكررة باستمرار، بطرق عديدة؛ ليس فقط ثقافيًا، بل في مجال الرؤية الحاسوبية نفسه، الذي يستمد اتجاهاته من المواضيع والأنماط الإحصائية السائدة في مجموعات بيانات التدريب. على سبيل المثال، ساهمت الهواتف الذكية في خفض حاجز الدخول، نطاق واسع أدى انخفاض تكلفة التصوير الفوتوغرافي إلى أن أصبح تصويرهم مرتبطًا بشكل لا مفر منه بالعديد من المفاهيم المجردة، حتى عندما لا يكون هذا مناسبا.

إذا كان من الممكن اعتبار التزييف العميق التقليدي فعلًا من أفعال "الاعتداء"، فإن التعديلات الطفيفة الخبيثة والمستمرة في الوسائط السمعية والبصرية تُشبه إلى حد كبير "التلاعب بالعقل". إضافةً إلى ذلك، فإن قدرة هذا النوع من التزييف العميق على المرور دون أن يُلاحظ تجعل من الصعب تحديده عبر أنظمة كشف التزييف العميق المتطورة (التي تبحث عن تغييرات جسيمة). هذا النهج أشبه بتآكل الصخور بالماء على مدى فترة طويلة، منه بحجر مُوجه نحو الرأس.

متعدد الأوجه المزيفة

قام باحثون من أستراليا بمحاولة لمعالجة الافتقار إلى الاهتمام بالتزييف العميق "الدقيق" في الأدبيات، من خلال إنشاء مجموعة بيانات جديدة كبيرة من عمليات التلاعب بالصور التي تركز على الشخص والتي تغير السياق والعاطفة والسرد دون تغيير الهوية الأساسية للموضوع:

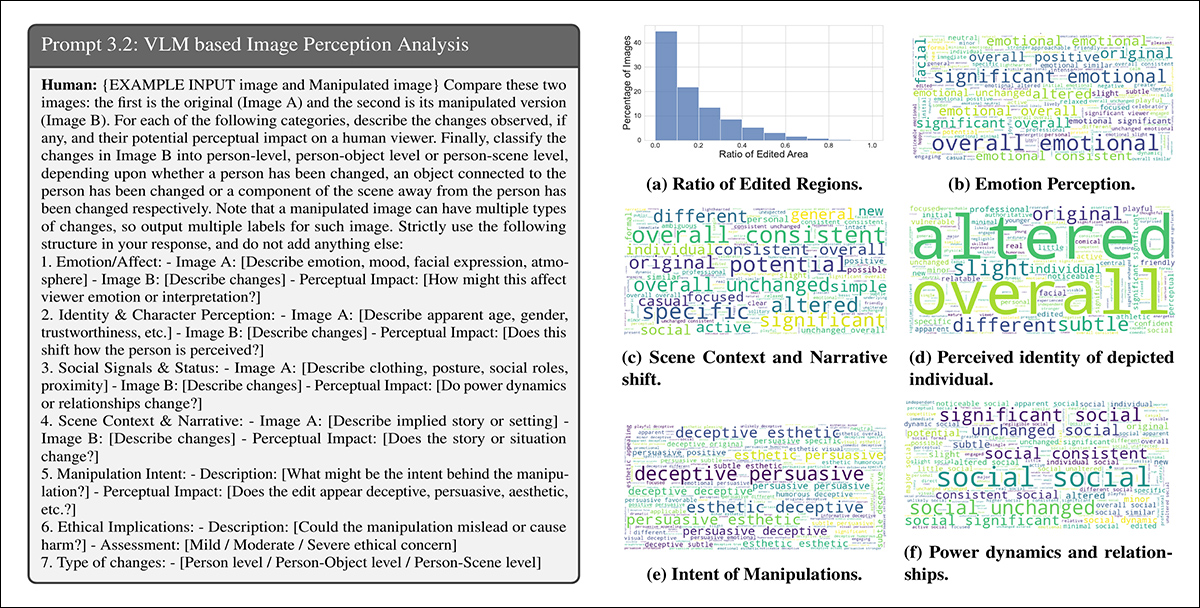

مأخوذة من المجموعة الجديدة، أزواج حقيقية/مزيفة، مع بعض التعديلات الطفيفة. لاحظ، على سبيل المثال، فقدان هيبة المرأة الآسيوية (أسفل اليمين)، حيث أزال الذكاء الاصطناعي سماعة الطبيب. في الوقت نفسه، لا يحمل استبدال دفتر الطبيب بالحافظة أي دلالة دلالية واضحة.المصدر: https://huggingface.co/datasets/parulgupta/MultiFakeVerse_preview

بعنوان متعدد الأوجه المزيفةتتكون المجموعة من 845,826 صورة تم إنشاؤها عبر نماذج لغة الرؤية (VLMs)، والتي يمكن الوصول إليها عبر الإنترنت وتم تنزيلها، باذن.

يذكر المؤلفون:

"يتيح هذا النهج الذي يعتمد على VLM إجراء تعديلات دلالية واعية بالسياق مثل تعديل الإجراءات والمشاهد والتفاعلات بين الإنسان والأشياء بدلاً من عمليات تبادل الهوية الاصطناعية أو منخفضة المستوى والتعديلات الخاصة بالمنطقة الشائعة في مجموعات البيانات الموجودة.

"تكشف تجاربنا أن نماذج الكشف عن التزييف العميق الحديثة والمراقبين البشريين يجدون صعوبة في اكتشاف هذه التلاعبات الدقيقة ولكن ذات المعنى."

اختبر الباحثون كلاً من البشر وأنظمة كشف التزييف العميق الرائدة على قاعدة بياناتهم الجديدة لمعرفة مدى دقة كشف هذه التلاعبات الدقيقة. واجه المشاركون صعوبة في تصنيف الصور بشكل صحيح على أنها حقيقية أو مزيفة في حوالي 62% من الحالات، وواجهوا صعوبة أكبر في تحديد أجزاء الصورة التي تم تعديلها.

كما أن أجهزة كشف التزييف العميق الحالية، المُدربة في الغالب على مجموعات بيانات أكثر وضوحًا لتبديل الوجوه أو التلوين، كان أداؤها ضعيفًا أيضًا، وغالبًا ما فشلت في تسجيل حدوث أي تلاعب. حتى بعد الكون المثالى على موقع MultiFakeVerse، ظلت معدلات الكشف منخفضة، مما يكشف عن مدى ضعف الأنظمة الحالية في التعامل مع هذه التعديلات الدقيقة التي تعتمد على السرد.

استخدم ورقة جديدة بعنوان تعدد الأكوان من خلال التزييف العميق: مجموعة بيانات MultiFakeVerse للتلاعبات البصرية والمفاهيمية التي تركز على الشخص، ويأتي من خمسة باحثين من جامعة موناش في ملبورن، وجامعة كيرتن في بيرث. تم نشر الكود والبيانات ذات الصلة. في جيثب، بالإضافة إلى استضافة Hugging Face المذكورة سابقًا.

الأسلوب

تم إنشاء مجموعة بيانات MultiFakeVerse من أربع مجموعات صور حقيقية تعرض أشخاصًا في مواقف مختلفة: تعبيري; بيسك, PIPAو الموافقة المسبقة عن علم 2.0بدءًا من 86,952 صورة أصلية، أنتج الباحثون 758,041 نسخة معدلة.

استخدم جيميني-2.0-فلاش و ChatGPT-4o تم استخدام الأطر لاقتراح ستة تعديلات بسيطة لكل صورة - تعديلات مصممة لتغيير كيفية إدراك المشاهد للشخص الأكثر شهرة في الصورة بشكل خفي.

تم توجيه النماذج لإنشاء تعديلات من شأنها أن تجعل الموضوع يبدو ساذج, فخور, نادم, غر أو غير مكترثأو لتعديل بعض العناصر الواقعية في المشهد. مع كل تعديل، أنتجت النماذج أيضًا تعبير مرجعي لتحديد هدف التعديل بوضوح، والتأكد من أن عملية التحرير اللاحقة يمكن أن تطبق التغييرات على الشخص أو الكائن الصحيح داخل كل صورة.

يوضح المؤلفون:

'لاحظ أن تعبير مرجعي هو مجال تم استكشافه على نطاق واسع في المجتمع، مما يعني عبارة يمكنها إزالة الغموض عن الهدف في الصورة، على سبيل المثال بالنسبة لصورة بها رجلين يجلسان على مكتب، أحدهما يتحدث على الهاتف والآخر ينظر في المستندات، فإن التعبير المرجعي المناسب للأخير سيكون الرجل على اليسار يحمل قطعة من الورق".

بعد تحديد التعديلات، أُجريت معالجة الصورة الفعلية من خلال حثّ نماذج الرؤية واللغة على تطبيق التغييرات المحددة مع ترك باقي المشهد سليمًا. اختبر الباحثون ثلاثة أنظمة لهذه المهمة: GPT-Image-1; جيميني 2.0 - توليد صور فلاشية، و ICEdit.

بعد إنشاء اثنين وعشرين ألف صورة عينة، ظهر برنامج Gemini-2.0-Flash باعتباره الطريقة الأكثر اتساقًا، حيث أنتج تعديلات امتزجت بشكل طبيعي في المشهد دون إدخال آثار مرئية؛ وغالبًا ما أنتج برنامج ICEdit تزويرات أكثر وضوحًا، مع عيوب ملحوظة في المناطق المعدلة؛ وفي بعض الأحيان أثر برنامج GPT-Image-1 على أجزاء غير مقصودة من الصورة، ويرجع ذلك جزئيًا إلى توافقه مع نسب العرض إلى الارتفاع الثابتة.

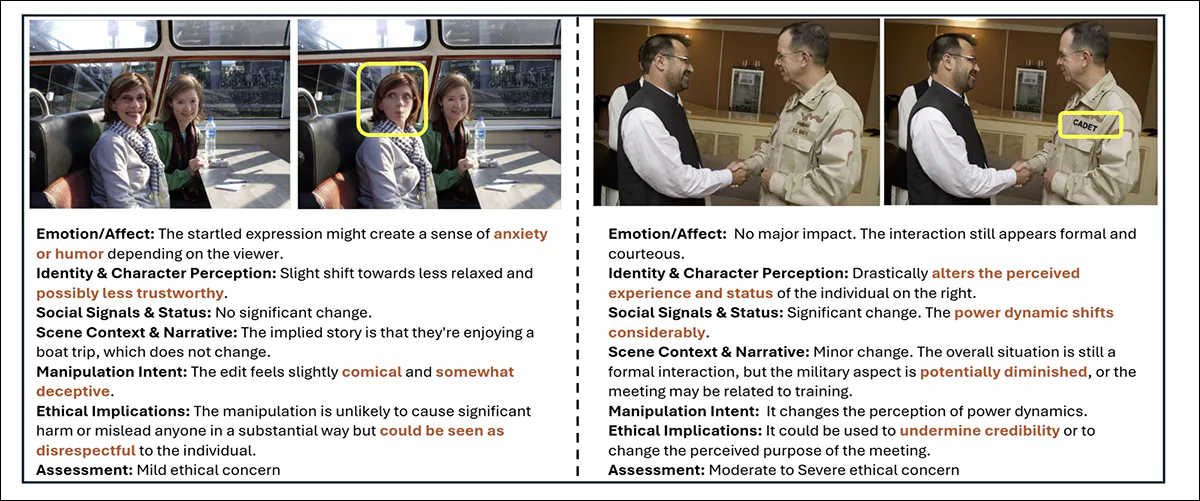

تحليل الصور

قورنت كل صورة مُعدّلة بالصورة الأصلية لتحديد مقدار التعديل الذي طرأ عليها. حُسبت الفروقات على مستوى البكسل بين النسختين، مع تصفية الضوضاء العشوائية الصغيرة للتركيز على التعديلات المفيدة. في بعض الصور، تأثرت مناطق صغيرة فقط؛ وفي صور أخرى، تأثرت ما يصل إلى ثمانين في المائة من المشهد تم تعديله.

لتقييم مدى تغير معنى كل صورة في ضوء هذه التعديلات، تم إنشاء تسميات توضيحية لكل من الصور الأصلية والمعدلة باستخدام ShareGPT-4V نموذج الرؤية واللغة.

تم بعد ذلك تحويل هذه التسميات التوضيحية إلى تضمينات باستخدام مقطع طويلمما يسمح بمقارنة مدى اختلاف المحتوى بين النسخ. ولوحظت أقوى التغييرات الدلالية في الحالات التي حُوِّرت فيها أشياء قريبة من الشخص أو مرتبطة به مباشرةً، لأن هذه التعديلات الطفيفة قد تُغيِّر بشكل كبير كيفية تفسير الصورة.

تم بعد ذلك استخدام Gemini-2.0-Flash لتصنيف نوع عدد التعديلات المُطبّقة على كل صورة، بناءً على مكان وكيفية إجراء التعديلات. صُنِّفت التعديلات إلى ثلاث فئات: على مستوى الشخص تتضمن التعديلات تغييرات في تعبيرات وجه الشخص أو وضعيته أو نظراته أو ملابسه أو غيرها من السمات الشخصية؛ على مستوى الكائن يقوم بتحرير العناصر المتأثرة المرتبطة بالشخص، مثل الكائنات التي كان يحملها أو يتفاعل معها في المقدمة؛ و على مستوى المشهد تتضمن التعديلات عناصر خلفية أو جوانب أوسع من الإعداد والتي لم تشمل الشخص بشكل مباشر.

يبدأ مسار إنشاء مجموعة بيانات MultiFakeVerse بالصور الحقيقية، حيث تقترح نماذج الرؤية واللغة تعديلات سردية تستهدف الأشخاص أو الأشياء أو المشاهد. ثم تُطبّق نماذج تحرير الصور هذه التعليمات. تُظهر اللوحة اليمنى نسبة التعديلات على مستوى الشخص، ومستوى الشيء، ومستوى المشهد في مجموعة البيانات. المصدر: https://arxiv.org/pdf/2506.00868

بما أن الصور الفردية قد تحتوي على أنواع متعددة من التعديلات في آنٍ واحد، فقد تم توزيع هذه الفئات على مجموعة البيانات. استهدف ما يقرب من ثلث التعديلات الشخص فقط، وحوالي خُمسها أثر على المشهد فقط، وحوالي سدسها اقتصر على الأشياء.

تقييم التأثير الإدراكي

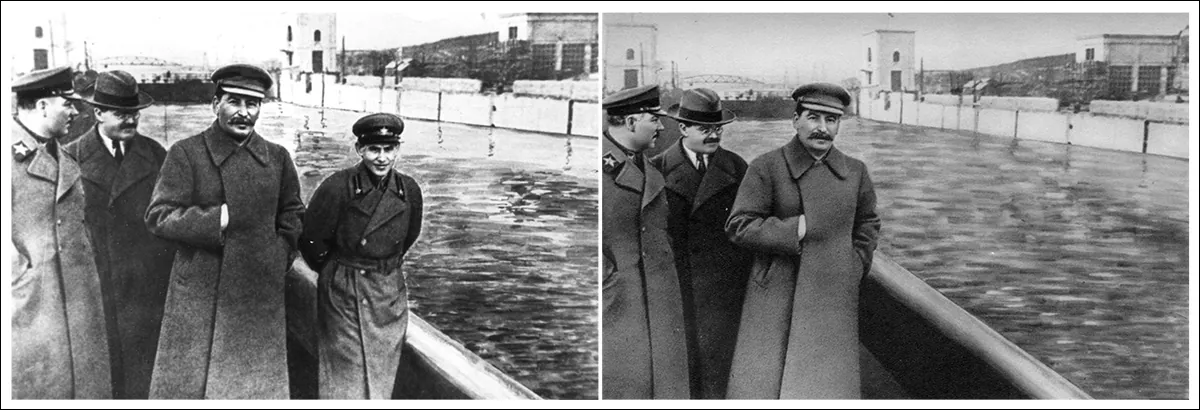

تم استخدام Gemini-2.0-Flash لتقييم مدى قدرة التلاعبات على تغيير تصور المشاهد عبر ستة مجالات: عاطفة, الهوية الشخصية, قوة دينامية, سرد المشهد, نية التلاعبو مخاوف أخلاقية.

في عمل عاطفة، غالبًا ما تم وصف التعديلات بمصطلحات مثل فرح, جذاب أو ممكن بلوغهمما يشير إلى تحولات في كيفية تأطير الموضوعات عاطفيًا. من الناحية السردية، كلمات مثل محترف or مختلف أشارت إلى التغييرات في القصة أو الإعداد الضمني:

طُلب من نموذج جيميني-2.0-فلاش تقييم كيفية تأثير كل معالجة على ستة جوانب من إدراك المشاهد. على اليسار: نموذج لهيكل الاستجابة الذي يُوجِّه تقييم النموذج. على اليمين: سحابات كلمات تُلخِّص التحولات في المشاعر، والهوية، وسرد المشهد، والنية، وديناميكيات القوة، والمخاوف الأخلاقية عبر مجموعة البيانات.

وتضمنت أوصاف التحولات في الهوية مصطلحات مثل اصغر سنا, لعوبو الضعيفة، موضحًا كيف يمكن للتغييرات البسيطة أن تؤثر على كيفية إدراك الأفراد. وقد وُصفت النية وراء العديد من التعديلات بأنها مقنع, مخادع أو جماليوفي حين اعتبرت معظم التعديلات أنها تثير مخاوف أخلاقية خفيفة فقط، فقد اعتبرت نسبة صغيرة منها تحمل آثاراً أخلاقية معتدلة أو شديدة.

أمثلة من MultiFakeVerse تُظهر كيف تُغيّر التعديلات الصغيرة إدراك المشاهد. تُسلّط المربعات الصفراء الضوء على المناطق المُعدّلة، مصحوبةً بتحليل للتغيرات في المشاعر والهوية والسرد والمخاوف الأخلاقية.

المقاييس

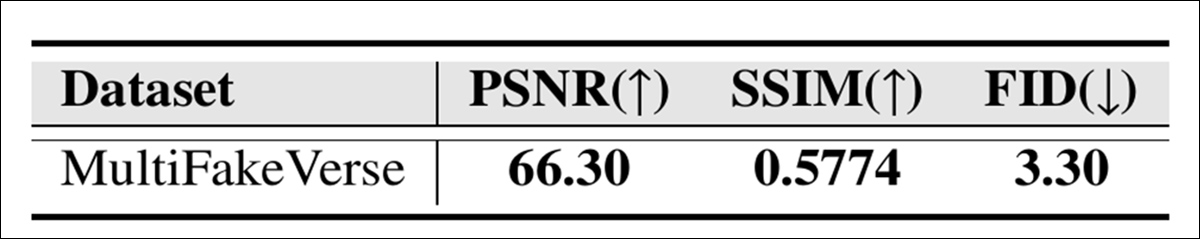

تم تقييم الجودة المرئية لمجموعة MultiFakeVerse باستخدام ثلاثة مقاييس قياسية: نسبة الإشارة إلى الضوضاء القصوى (نسبة الخطر إلى الخطر) مؤشر التشابه البنيوي (SSIM)؛ و مسافة البداية (FID):

تم قياس درجات جودة الصورة لـ MultiFakeVerse بواسطة PSNR وSSIM وFID.

تعكس درجة SSIM البالغة 0.5774 درجة معتدلة من التشابه، بما يتفق مع هدف الحفاظ على معظم الصورة أثناء تطبيق التعديلات المستهدفة؛ وتشير درجة FID البالغة 3.30 إلى أن الصور المولدة تحافظ على الجودة العالية والتنوع؛ وتشير قيمة PSNR البالغة 66.30 ديسيبل إلى أن الصور تحتفظ بدقة بصرية جيدة بعد التلاعب.

دراسة المستخدم

أُجريت دراسة على المستخدمين لمعرفة مدى قدرتهم على كشف التزييفات الدقيقة في تطبيق MultiFakeVerse. عُرضت خمسون صورة على ثمانية عشر مشاركًا، موزعة بالتساوي بين أمثلة حقيقية ومُعدّلة، تغطي مجموعة متنوعة من أنواع التعديل. طُلب من كل شخص تحديد ما إذا كانت الصورة حقيقية أم مزيفة، وفي حال كانت مزيفة، تحديد نوع التلاعب المُستخدم.

بلغت الدقة الإجمالية في تحديد الصور الحقيقية من المزيفة 61.67 بالمائة، مما يعني أن المشاركين صنفوا الصور بشكل خاطئ في أكثر من ثلث الوقت.

يذكر المؤلفون:

'عند تحليل التوقعات البشرية لمستويات التلاعب بالصور المزيفة، وجد أن متوسط التقاطع على الاتحاد بين مستويات التلاعب المتوقعة والفعلية بلغ 24.96%.

"يُظهر هذا أنه ليس من السهل على المراقبين البشريين تحديد مناطق التلاعب في مجموعة البيانات الخاصة بنا."

تطلب بناء مجموعة بيانات MultiFakeVerse موارد حاسوبية مكثفة: لتوليد تعليمات التحرير، تم إجراء أكثر من 845,000 استدعاء واجهة برمجة تطبيقات (API) إلى نموذجي Gemini وGPT، بتكلفة حوالي 1000 دولار أمريكي؛ بينما بلغت تكلفة إنتاج الصور المستندة إلى Gemini حوالي 2,867 دولارًا أمريكيًا؛ بينما بلغت تكلفة إنشاء الصور باستخدام GPT-Image-1 حوالي 200 دولار أمريكي. أُنشئت صور ICEdit محليًا على وحدة معالجة الرسومات NVIDIA A6000، وأُنجزت المهمة في حوالي أربع وعشرين ساعة.

اختبارات

قبل الاختبارات، كانت مجموعة البيانات منقسم تم تقسيم الصور إلى مجموعات تدريب وتحقق واختبار، وذلك باختيار ٧٠٪ من الصور الحقيقية للتدريب، و١٠٪ للتحقق، و٢٠٪ للاختبار. تم تخصيص الصور المُعدّلة الناتجة عن كل صورة حقيقية لنفس المجموعة التي تُمثل صورها الأصلية.

أمثلة أخرى للمحتوى الحقيقي (على اليسار) والمعدل (على اليمين) من مجموعة البيانات.

تم قياس الأداء في اكتشاف التزييف باستخدام دقة مستوى الصورة (سواء كان النظام يصنف الصورة بأكملها بشكل صحيح على أنها حقيقية أو مزيفة) و عشرات F1. لتحديد المناطق التي تم التلاعب بها، تم استخدام التقييم المنطقة تحت المنحنى (AUC)، ونتائج F1، و تقاطع على الاتحاد (أنا).

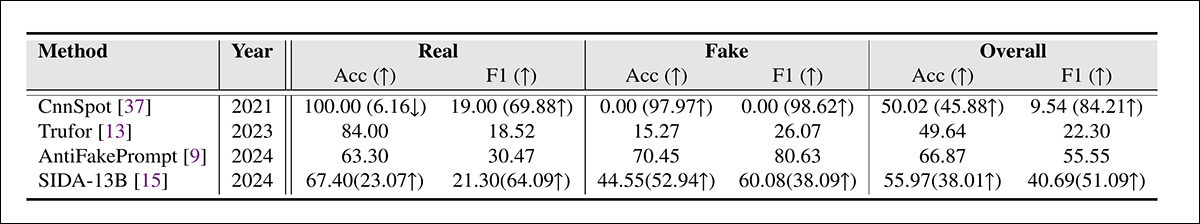

تم استخدام مجموعة بيانات MultiFakeVerse ضد أنظمة الكشف عن التزييف العميق الرائدة في مجموعة الاختبار الكاملة، مع وجود الأطر المنافسة سي إن إن سبوت; مكافحة التزييف; تروفور؛ والرؤية القائمة على اللغة SIDAتم تقييم كل نموذج أولاً في صفر طلقة الوضع، باستخدام وضعه الأصلي المدرب مسبقًا الأوزان بدون مزيد من التعديل.

كان هناك نموذجان، CnnSpot وSIDA، بعد ذلك صقل على بيانات تدريب MultiFakeVerse لتقييم ما إذا كان إعادة التدريب يؤدي إلى تحسين الأداء.

نتائج كشف التزييف العميق على MultiFakeVerse في ظروف التصوير الصفري والضبط الدقيق. تشير الأرقام بين قوسين إلى التغييرات بعد الضبط الدقيق.

ومن هذه النتائج يقول المؤلفون:

تواجه النماذج المُدرَّبة على صور مزيفة سابقة قائمة على تقنية الطلاء الداخلي صعوبة في تحديد صورنا المزيفة القائمة على تحرير VLM، خاصةً أن CNNSpot يميل إلى تصنيف جميع الصور تقريبًا على أنها حقيقية. يتميز AntifakePrompt بأفضل أداء في التصوير بدون لقطة، حيث تبلغ دقة فئته المتوسطة 66.87% ودرجة F55.55 1%.

'بعد إجراء ضبط دقيق لمجموعة القطارات الخاصة بنا، لاحظنا تحسنًا في الأداء في كل من CNNSpot وSIDA-13B، حيث تفوق CNNSpot على SIDA-13B من حيث متوسط الدقة على مستوى الفئة (بنسبة 1.92%) بالإضافة إلى درجة F1 (بنسبة 1.97%).'

تم تقييم SIDA-13B على منصة MultiFakeVerse لقياس مدى دقة تحديده للمناطق المُعالجة في كل صورة. اختُبر النموذج في وضع اللقطة الصفرية وبعد إجراء تعديلات دقيقة على مجموعة البيانات.

في حالتها الأصلية، وصلت إلى درجة تقاطع فوق الاتحاد 13.10، ودرجة F1 19.92، وAUC 14.06، مما يعكس ضعف أداء التوطين.

بعد الضبط الدقيق، تحسنت النتائج إلى 24.74 لـ IoU، و39.40 لـ F1، و37.53 لـ AUC. مع ذلك، حتى مع التدريب الإضافي، لا يزال النموذج يواجه صعوبة في تحديد مكان إجراء التعديلات بدقة، مما يُبرز مدى صعوبة اكتشاف هذه التغييرات الصغيرة والمُستهدفة.

خاتمة

تكشف الدراسة الجديدة عن نقطة عمياء في الإدراك البشري والآلي: في حين ركز جزء كبير من النقاش العام حول التزييف العميق على عمليات تبديل الهوية التي تجذب العناوين الرئيسية، فإن هذه "التعديلات السردية" الأكثر هدوءًا يصعب اكتشافها وقد تكون أكثر ضررًا على المدى الطويل.

مع تزايد نشاط أنظمة مثل ChatGPT وGemini في توليد هذا النوع من المحتوى، ومع قيامنا بأنفسنا المشاركة بشكل متزايد في تغيير حقيقة تيارات الصور الخاصة بنا، قد لا تقدم نماذج الكشف التي تعتمد على اكتشاف التلاعبات الخام دفاعًا كافيًا.

إن ما يظهره تطبيق MultiFakeVerse ليس أن عملية الكشف قد فشلت، بل إن جزءاً من المشكلة على الأقل قد يتحول إلى شكل أكثر صعوبة وأبطأ حركة: حيث تتراكم الأكاذيب البصرية الصغيرة دون أن يلاحظها أحد.

نُشر لأول مرة يوم الخميس 5 يونيو 2025