الذكاء الاصطناعي

باحثون يخترعون بديلاً لمعالج الرسومات

علماء الحاسوب من جامعة رايس، إلى جانب شركاء من شركة Intel، طوروا بديلاً أكثر كفاءة في التكلفة لمعالج الرسومات. يُسمى الخوارزمية الجديدة “محرك التعلم العميق الخطي الفرعي” (SLIDE)، ويتضمن استخدام وحدات المعالجة المركزية (CPUs) العامة الغرض دون أجهزة تعزيز متخصصة.

تم تقديم النتائج في مركز أوستن للمؤتمرات، وهو المكان الذي يستضيف مؤتمر أنظمة التعلم الآلي MLSys.

أحد أكبر التحديات داخل الذكاء الاصطناعي (AI) هو أجهزة التعزيز المتخصصة مثل وحدات معالجة الرسومات (GPUs). قبل التطورات الجديدة، كان يُعتقد أن استخدام أجهزة التعزيز المتخصصة مطلوب لتعزيز سرعة تقنية التعلم العميق.

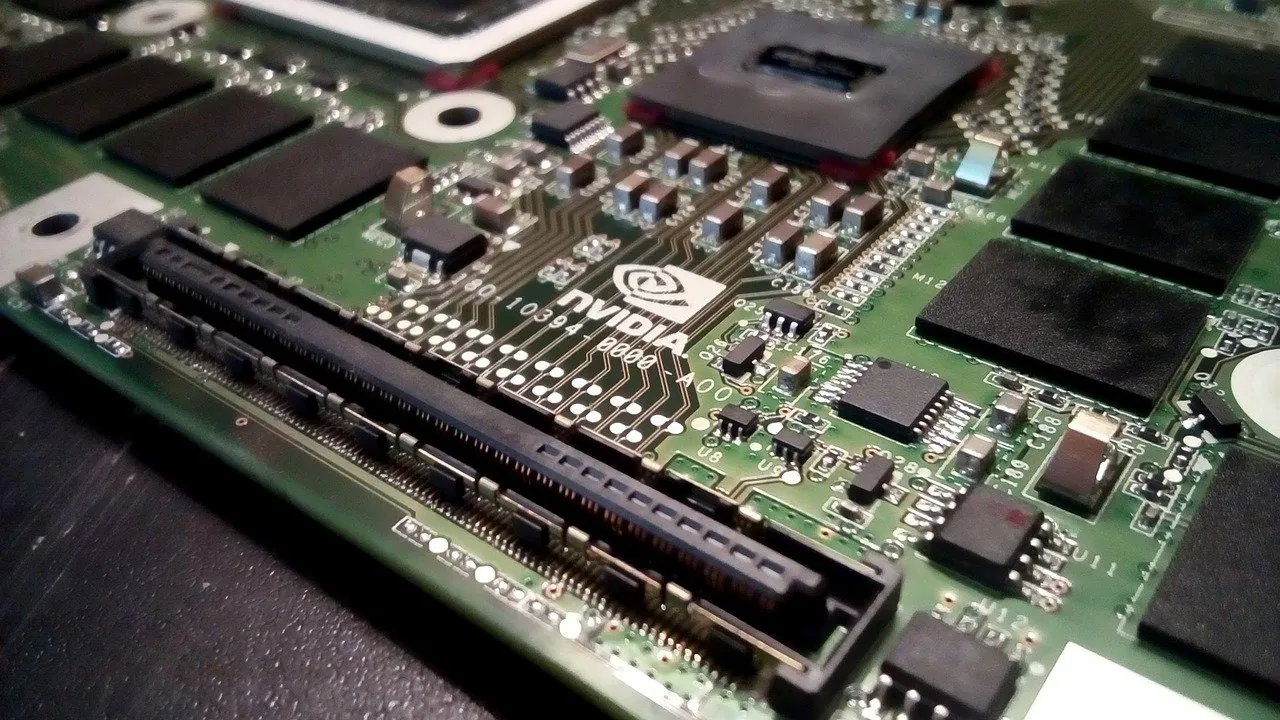

قامت العديد من الشركات بتخصيص أهمية كبيرة في الاستثمار في وحدات معالجة الرسومات وأجهزة متخصصة للتعلم العميق، وهو ما يتحمل مسؤولية تقنيات مثل المساعدين الرقميين، والتعرف على الوجه، وأنظمة توصية المنتجات. واحدة من هذه الشركات هي Nvidia، التي تُنتج وحدات معالجة الرسومات Tesla V100 Tensor Core. وأفادت Nvidia مؤخرًا عن زيادة بنسبة 41% في إيراداتها للربع الرابع مقارنة بالعام الماضي.

تفتح تطوير SLIDE إمكانيات جديدة تمامًا.

Anshumali Shrivastava هو أستاذ مساعد في مدرسة هندسة براون بجامعة رايس وساعد في اختراع SLIDE مع طلاب الدراسات العليا Beidi Chen وTharun Medini.

“تظهر اختباراتنا أن SLIDE هو أول تنفيذ خوارزمي ذكي للتعلم العميق على وحدة المعالجة المركزية التي يمكن أن تتفوق على تعزيز الأجهزة الرسومية على مجموعات بيانات التوصية على مستوى الصناعة ذات الهياكل الكاملة المتصلة بشكل كبير،” قال Shrivastava.

يحصل SLIDE على تحدي وحدات معالجة الرسومات بسبب نهجه المختلف تمامًا للتعلم العميق. حاليًا، تقنية التدريب القياسية للشبكات العصبية العميقة هي “الانتشار العكسي”، وتتطلب ضرب المصفوفات. يتطلب هذا الحمل الوظيفي استخدام وحدات معالجة الرسومات، لذلك قام الباحثون بتغيير تدريب الشبكة العصبية بحيث يمكن حلها باستخدام جداول التجزئة.

ينقص هذا النهج الجديد الحمل الحسابي بشكل كبير لSLIDE. منصة GPU الحالية الأفضل التي تستخدمها شركات مثل Amazon وGoogle للتعلم العميق القائم على السحابة تحتوي على ثمانية وحدات Tesla V100، وسعرها حوالي 100000 دولار.

“لدينا واحدة في المختبر، وفي حالة الاختبار قمنا بتحميل عمل يُعتبر مثاليًا لـV100، واحد يحتوي على أكثر من 100 مليون معامل في شبكات متصلة بالكامل كبيرة التي تتناسب مع ذاكرة GPU،” قال Shrivastava. “لقد قمنا بتدريبه باستخدام أفضل حزمة برمجية متاحة، وهي TensorFlow من Google، واستغرق التدريب 3 ساعات و30 دقيقة.

“ثم أظهرنا أن خوارزميتنا الجديدة يمكن أن تقوم بتدريبها في ساعة واحدة، وليس على وحدات معالجة الرسومات ولكن على وحدة معالجة مركزية Xeon من الفئة 44核،” продолжил.

التجزئة هي نوع من طرق فهرسة البيانات التي تم اختراعها في التسعينيات للبحث على الإنترنت. يتم استخدام الطرق العددية لتشفير كميات كبيرة من المعلومات ك سلسلة من الأرقام، ويُسمى هذا التشفير “التجزئة”. يتم سرد التجزئات لإنشاء جداول يمكن البحث فيها بسرعة.

“لن يكون من المعقول تنفيذ خوارزميتنا على TensorFlow أو PyTorch لأن أول شيء يريدونه القيام به هو تحويل ما تفعله إلى مشكلة ضرب مصفوفة،” قال Chen. “هذا هو بالضبط ما كنا نريد الهروب منه. لذلك قمنا بكتابة كودنا الخاص باللغة C++ من الصفر.”

وفقًا لشريفاستافا، أكبر ميزة لSLIDE هي أنها موازية للبيانات.

“بمعنى أنني إذا كان لدي أمثلة بياناتين أريد تدريبهما، دعنا نقول واحدة هي صورة قطة والآخر هي حافلة، فمن المحتمل أن تنشط نيورونات مختلفة، ويمكن لSLIDE تحديثها أو تدريبها بشكل مستقل،” قال. “هذا هو استخدام أفضل للموازاة للوحدات المركزية.

“الجانب الآخر، بالمقارنة مع وحدة معالجة الرسومات، هو أننا نحتاج إلى ذاكرة كبيرة،” قال. “هناك هرمية ذاكرة في الذاكرة الرئيسية، وإذا لم تكن حذرًا معها، يمكن أن تتعرض لمشكلة تسمى التخزين الزائد، حيث تحصل على الكثير من أخطاء الذاكرة.

فتح SLIDE الباب أمام طرق جديدة لتنفيذ التعلم العميق، ويعتقد Shrivastava أنه مجرد البداية.

“لقد كشفنا فقط عن السطح،” قال. “هناك الكثير الذي يمكننا القيام به لتحسين الأداء. لم نستخدم التوجيه، على سبيل المثال، أو المعززات المدمجة في وحدة المعالجة المركزية، مثل Intel Deep Learning Boost. هناك الكثير من الحيل الأخرى التي يمكننا استخدامها لجعلها أسرع.