الذكاء الاصطناعي

مهاراتنا الغير واعية لاكتشاف Deepfake قد تقوى أنظمة الآلة الآلية في المستقبل

تشير الأبحاث الجديدة من أستراليا إلى أن دماغنا ماهر في التعرف علىDeepfakes المتقدمة ، حتى عندما نعتقد واعيا أن الصور التي نراها حقيقية.

تشير النتائج إلى إمكانية استخدام استجابات الأشخاص العصبية لصور الوجه Deepfake (بدلا من آرائهم المعلنة) لتدريب أنظمة كشف Deepfake الآلية. سيتم تدريب هذه الأنظمة على سمات الصور Deepfake (وليس من تقديرات الارتباك حول الواقعية) ، ولكن من آليات الإدراك الغريزية لتعرف الهوية الوجهية.

‘على الرغم من أن الدماغ يمكن أن “يعرف” الفرق بين الوجوه الحقيقية والوجوه الواقعية ، لا يمكن للمراقبين التمييز بينهما واعيا. تشير نتائجنا إلى انفصال بين استجابة الدماغ والسلوك ، وتأثير ذلك على كيفية دراسة إدراك الوجه الكاذب ، والأسئلة التي نطرحها عند سؤالنا عن تحديد الصور الكاذبة ، والطرق الممكنة لتأسيس معايير حماية ضد إساءة استخدام الصور الكاذبة.’

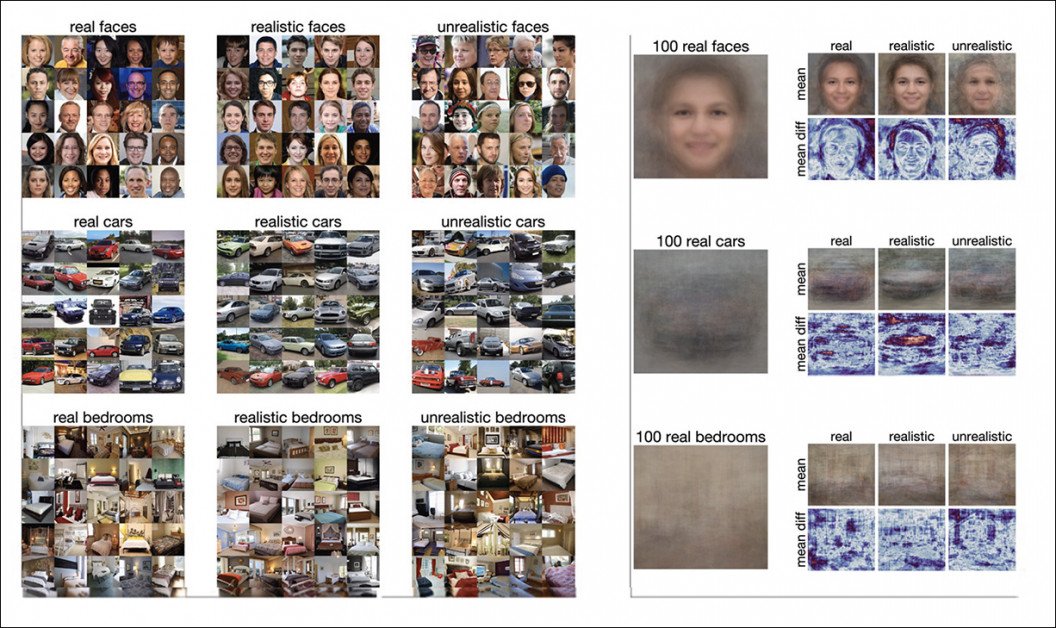

تم الكشف عن النتائج في جولات من الاختبار المصممة لتقييم الطريقة التي يستجيب بها الناس للصور الكاذبة ، بما في ذلك صور الوجوه الكاذبة ، والسيارات ، والفراغات الداخلية ، والوجوه المعكوسة (أي رأسا على عقب).

Various iterations and approaches for the experiments, which involved two groups of test subjects needing to classify a briefly-shown image as ‘fake’ or ‘real’. The first round took place on Amazon Mechanical Turk, with 200 volunteers, while the second round involved a smaller number of volunteers responding to the tests while hooked up to EEG machines. Source: https://tijl.github.io/tijl-grootswagers-pdf/Moshel_et_al_-_2022_-_Are_you_for_real_Decoding_realistic_AI-generated_.pdf

يؤكد البحث:

‘تظهر نتائجنا أن المراقبين قد يكونون قادرين على اكتشاف الوجوه الكاذبة بمجرد نظرة سريعة. ومع ذلك ، لديهم صعوبة في التمييز بين الوجوه الحقيقية والوجوه الكاذبة ، وفي بعض الحالات ، اعتقدوا أن الوجوه الكاذبة أكثر واقعية من الوجوه الحقيقية.

‘然而 ، باستخدام EEG الوقتية وطرق التصنيف المتغيرة المتعددة ، وجدنا أنه من الممكن فك تشفير الوجوه غير الواقعية والواقعية من الوجوه الحقيقية باستخدام النشاط الدماغي.

‘ينتج عن هذا الانفصال بين السلوك والاستجابة العصبية للوجوه الواقعية أدلة جديدة حول إدراك الوجه الكاذب ، بالإضافة إلى الآثار المتعلقة بالفئة المتزايدة الواقعية من الوجوه التي تم إنشاؤها بواسطة GAN.’

يشير البحث إلى أن العمل الجديد له عدة آثار في مجال الأمن السيبراني التطبيقي ، وought أن يتم تشغيل تطوير مصنفات Deepfake التعلم بواسطة الاستجابة الغير واعية ، كما يتم قياسها بواسطة قراءات EEG استجابة للصور الكاذبة ، بدلا من تقدير المشاهد لصحة الصورة.

يعلق المؤلفون:

‘هذا يذكرنا بالنتائج التي تشير إلى أن الأفراد الذين يعانون من عمه الفص الصدغي الذين لا يستطيعون تصنيف أو التعرف على الوجوه على أنها مألوفة أو غير مألوفة ، ومع ذلك ، يظهرون استجابات ذاتية أقوى للوجوه المألوفة أكثر من الوجوه غير المألوفة.

‘على نحو مماثل ، ما قدمناه في هذه الدراسة هو أننا قد قمنا بفك تشفير الفرق بين الوجوه الحقيقية والوجوه الواقعية من النشاط الدماغي ، ولكن هذا الفرق لم يكن واضحا سلوكيا. بدلا من ذلك ، أدرك المراقبون بشكل خاطئ 69٪ من الوجوه الحقيقية على أنها كاذبة.’

الدراسة الجديدة موجودة هنا ، و هي بعنوان هل أنت حقيقي؟ فك تشفير الوجوه التي تم إنشاؤها بواسطة الذكاء الاصطناعي من النشاط الدماغي ، و هي من تأليف أربعة باحثين من جامعة سيدني ، وجامعة ماكواري ، وجامعة سيدني الغربية ، وجامعة كوينزلاند.

البيانات

نجمت النتائج عن فحص أوسع ل能力 البشرية في التمييز بين الصور الكاذبة الواضحة ، والصور الواقعية (ولكنها كاذبة) ، والصور الحقيقية ، التي أجريت عبر جولتين من الاختبار.

استخدم الباحثون صورًا تم إنشاؤها بواسطة Generative Adversarial Networks (GANs) ، مشاركة بواسطة NVIDIA.

GAN-generated human face images made available by NVIDIA. Source: https://drive.google.com/drive/folders/1EDYEYR3IB71-5BbTARQkhg73leVB9tam

تضمنت البيانات 25 وجهًا وسيارة وغرفة نوم ، بمستويات تتراوح من “غير واقعية” إلى “واقعية”. لتحديد الوجوه (أي المواد غير الكاذبة المناسبة) ، استخدم المؤلفون اختيارات من بيانات المصدر لنيفيديا’s Flickr-Faces-HQ (FFHQ) dataset. للتحقق من السيناريوهات الأخرى ، استخدموا مواد من LSUN dataset.

تم تقديم الصور في النهاية إلى موضوع الاختبار إما بشكل صحيح أو معكوس ، وبمعدلات متعددة ، مع جميع الصور التي تم تحجيمها إلى 256×256 بكسل.

بعد جمع جميع المواد ، تم جمع 450 صورة للاختبار.

الاختبارات

أجريت الاختبارات في البداية عبر الإنترنت ، من خلال jsPsych على pavlovia.org ، مع 200 مشارك يحددون مجاميع مختلفة من بيانات الاختبار الكلية. تم تقديم الصور لمدة 200 مللي ثانية ، تليها شاشة فارغة ستستمر حتى يقرر المشاهد ما إذا كانت الصورة المُشعة حقيقية أو كاذبة. تم تقديم كل صورة مرة واحدة فقط ، وتم إكمال الاختبار كله في 3-5 دقائق.

استخدمت الجولة الثانية وأكثر إفصاحًا مواضيع حية متصلة بأجهزة EEG ، وتم تقديمها على منصة Psychopy2. تحتوي كل من العشرين تسلسلًا على 40 صورة ، مع 18,000 صورة تم تقديمها عبر جميع بيانات الاختبار.

تم فك تشفير بيانات EEG بواسطة MATLAB مع أداة CoSMoMVPA ، باستخدام مخطط التحقق من الصحة المتروك تحت تحليل التمييز الخطي (LDA).

كان مصنف LDA هو المكون الذي كان قادرًا على التمييز بين استجابة الدماغ للتحفيز الكاذب وآراء الموضوع الخاصة بكون الصورة كاذبة.

النتائج

كان الباحثون مهتمين بمعرفة ما إذا كان يمكن لمواضيع اختبار EEG التمييز بين الوجوه الحقيقية والكاذبة ، ولذلك جمعت النتائج وتمت معالجتها ، ووجدوا أن المشاركين يمكنهم التمييز بسهولة بين الوجوه الحقيقية والوجوه غير الواقعية ، ولكنهم واجهوا صعوبة في تحديد الوجوه الكاذبة الواقعية التي تم إنشاؤها بواسطة GAN. لم يكن من الواضح ما إذا كان تقديم الصورة بشكل معكوس أم لا.

Behavioral discrimination of real and synthetically-generated faces, in the second round.

然而 ، أخبرتهم بيانات EEG قصة مختلفة.

يذكر البحث:

‘على الرغم من أن المراقبين واجهوا صعوبة في التمييز بين الوجوه الحقيقية والكاذبة وميلهم إلى تصنيف الوجوه الكاذبة ، تحتوي بيانات EEG على معلومات الإشارة المتعلقة بهذا التمييز التي تختلف بشكل معنوي بين الواقعية وغير الواقعية ، وهذه الإشارة تبدو مقيدة بمرحلة معالجة قصيرة نسبيًا.’

Here the disparity between EEG accuracy and the reported opinion of the subjects (i.e. as to whether or not the face images were fake) are not identical, with the EEG captures getting nearer to the truth than the manifest perception of the people involved.

يخلص الباحثون إلى أن المراقبين قد واجهوا صعوبة في تحديد الوجوه الكاذبة ، ولكن هذه الوجوه لها “تمثيلات مختلفة في النظام البصري البشري”.

الفرق الموجود قد دفع الباحثين إلى التكهن حول التطبيقات المحتملة لنتائجهم في آليات الأمان المستقبلية:

‘في إعداد تطبيقي مثل الأمن السيبراني أو Deepfakes ، قد يكون من الأفضل متابعة القدرة على الكشف عن الوجوه الواقعية باستخدام مصنفات التعلم الآلي المطبقة على بيانات التصوير العصبي بدلا من استهداف الأداء السلوكي.’

يخلصون:

‘فهم الانفصال بين الدماغ والسلوك لاكتشاف الوجه الكاذب سيكون له آثار عملية في كيفية مواجهة انتشار المعلومات التي تم إنشاؤها بشكل كاذب والتي قد تكون ضارة وشاملة.’

* تحويلي للاستشهادات المتضمنة إلى روابط.

نشر لأول مرة في 11 يوليو 2022.