زاوية Anderson

البحث عن ‘البيض والسحالي’ في جمهور الإعلان

منذ أن قدر قطاع الإعلان عبر الإنترنت بإنفاق 740.3 مليار دولار أمريكي في عام 2023، من السهل فهم سبب استثمار شركات الإعلان موارد كبيرة في هذا الفرع الخاص من أبحاث الرؤية الحاسوبية.

على الرغم من أن الصناعة معزولة وحمائية، إلا أنها تنشر أحيانًا دراسات تلمح إلى عمل مملوك أكثر تقدمًا في التعرف على الوجه وحركة العين – بما في ذلك التعرف على العمر، وهو مركزي لاحصاءات التحليلات الديموغرافية:

[التصوير الفوتوغرافي id = “attachment_215617” align = “alignnone” width = “795”]

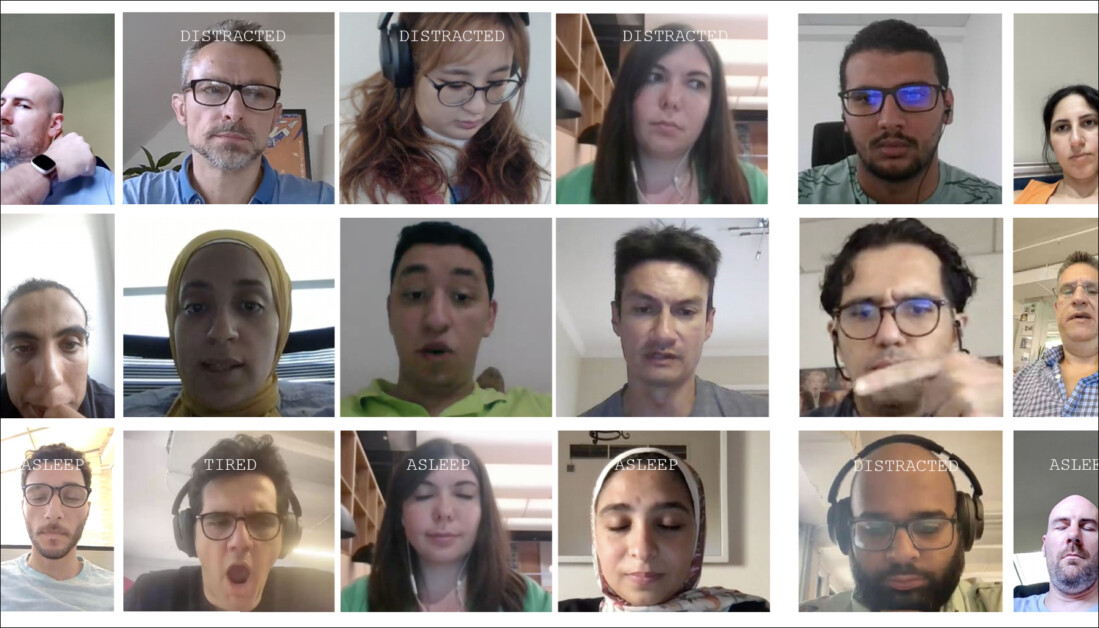

تستخدم هذه الدراسات، التي نادرًا ما تظهر في المستودعات العامة مثل Arxiv، المشاركين الذين تم توظيفهم بشكل شرعي كقاعدة لتحليل مدفوع بالذكاء الاصطناعي يهدف إلى تحديد مدى انخراط المشاهد في الإعلان وطريقة انخراطه:

[التصوير الفوتوغرافي id = “attachment_215618” align = “alignnone” width = “795”]

الانستينكت الحيواني

في هذا الصدد، من الطبيعي أن تكون صناعة الإعلان مهتمة بتحديد الإيجابيات الكاذبة (المناسبات التي يفسر فيها نظام التحليل أفعال الشخص بشكل خاطئ) ووضع معايير واضحة لتحديد متى يكون الشخص الذي يشاهد الإعلانات غير منخرط تمامًا في المحتوى.

نظرًا لأن الإعلانات القائمة على الشاشة، فإن الدراسات تميل إلى التركيز على مشكلتين عبر بيئتين. البيئات هي “الجوال” أو “المكتب”، كل منها له خصائص معينة تتطلب حلول تتبع مخصصة؛ والمشاكل – من وجهة نظر المعلن – تمثلها سلوك البومة وسلوك السحالي -倾向 المشاهدين إلى عدم الانتباه الكامل إلى الإعلان الموجود أمامهم.

[التصوير الفوتوغرافي id = “attachment_215619” align = “alignnone” width = “811”]

إذا كنت تنظر بعيدًا عن الإعلان المقصود بكل رأسك، فهذا هو سلوك “البومة”؛ إذا كان وضع رأسك ثابتًا ولكن عيناك تتجول بعيدًا عن الشاشة، فهذا هو سلوك “السحالي”. فيما يتعلق بالتحليلات واختبار الإعلانات الجديدة في ظروف خاضعة للرقابة، هذه هي الإجراءات الأساسية التي يجب على النظام القدرة على التقاطها.

يقدم ورقة جديدة من SmartEye’s Affectiva acquisition حلًا لهذه القضايا، مع تقديم بنية تستفيد من几个 إطارات موجودة لتوفير مجموعة ميزات متحدة ومترابطة عبر جميع الشروط والتفاعلات الممكنة – ولتحديد ما إذا كان المشاهد متعبًا أو منخرطًا أو في بعض النواحي بعيدًا عن المحتوى الذي يرغب المعلن في مشاهدته.

[التصوير الفوتوغرافي id = “attachment_215620” align = “alignnone” width = “955”]

يصرح المؤلفون:

‘ البحث المحدود غامر في مراقبة الانتباه خلال الإعلانات عبر الإنترنت. بينما ركزت هذه الدراسات على تقدير وضع الرأس أو اتجاه النظر لتحديد حالات الانحراف، إلا أنها ت忽ن معاملات حرجة مثل نوع الجهاز (سطح المكتب أو الجوال) ووضع الكاميرا بالنسبة للشاشة وحجم الشاشة. هذه العوامل تؤثر بشكل كبير على كشف الانتباه.

‘ في هذه الورقة، نقترح بنية لكشف الانتباه التي تشمل الكشف عن المشتتات المختلفة، بما في ذلك سلوك البومة وسلوك السحالي من النظر بعيدًا عن الشاشة، والتحدث والنعاس (من خلال التثاؤب والإغلاق الطويل للعين) وترك الشاشة دون مراقبة.

‘ على عكس النهج السابقة، طريقةنا تدمج ميزات جهاز محددة مثل نوع الجهاز ووضع الكاميرا وحجم الشاشة (لأجهزة سطح المكتب) وتوجيه الكاميرا (لأجهزة الجوال) مع تقدير النظر الخام لتعزيز دقة كشف الانتباه. ‘

العمل الجديد يسمى مراقبة انتباه المشاهد خلال الإعلانات عبر الإنترنت ، ويأتي من أربعة باحثين في Affectiva.

الطريقة والبيانات

بسبب سرية وطبيعة المصدر المغلق لأنظمة مثل هذه، لا تقارن الورقة الجديدة نهج المؤلفين بشكل مباشر مع المنافسين، بل تقدم نتائجها حصريًا كدراسات إزالة؛ ولا تتبع الورقة بشكل عام الشكل المعتاد لأدبيات الرؤية الحاسوبية. لذلك، سننظر إلى البحث على النحو الذي يتم تقديمه.

يشدد المؤلفون على أن عددًا محدودًا من الدراسات قد تناولت كشف الانتباه بشكل خاص في سياق الإعلانات عبر الإنترنت. في AFFDEX SDK ، الذي يقدم التعرف على الوجه المتعدد في الوقت الفعلي، يفترض الانتباه فقط من وضع الرأس، مع وضع المشاركين غير منخرطين إذا مر وضع رأسهم بعتبة محددة.

[التصوير الفوتوغرافي id = “attachment_215622” align = “alignnone” width = “781”]

في التعاون لعام 2019 قياس الانتباه البصري تلقائيًا للمحتوى المرئي باستخدام التعلم العميق ، تم جمع مجموعة بيانات تضم حوالي 28,000 مشارك، وتم وضع علامات على سلوكيات غير انتباهية مختلفة، بما في ذلك النظر بعيدًا ، إغلاق العين ، أو الانخراط في أنشطة غير متعلقة ، وتم تدريب نموذج CNN-LSTM لتحديد الانتباه من المظهر الوجهي بمرور الوقت.

[التصوير الفوتوغرافي id = “attachment_215623” align = “alignnone” width = “1200”]

然而، يشير المؤلفون إلى أن هذه الجهود السابقة لم تضع في الاعتبار معاملات جهاز محددة، مثل ما إذا كان المشارك يستخدم جهاز سطح مكتب أو جهاز جوال؛ ولا حتى وضع الكاميرا أو حجم الشاشة. بالإضافة إلى ذلك، يركز نظام AFFDEX فقط على تحديد انحراف النظر، ويتجاهل مصادر انحراف أخرى، بينما يحاول العمل لعام 2019 تحديد مجموعة أوسع من السلوكيات – ولكن استخدام شبكة عصبية متعمقة واحدة قد يكون غير كافٍ لهذه المهمة، كما يقول المؤلفون.

يشير المؤلفون إلى أن بعض الأبحاث الأكثر شعبية في هذا الخط لا يتم تحسينها لاختبار الإعلانات، والتي لها احتياجات مختلفة مقارنة بمجالات مثل القيادة أو التعليم – حيث يتم تثبيت وضع الكاميرا وضبطها مسبقًا، وبدلاً من ذلك تعمل في إعدادات غير محددة، وتعمل في نطاق نظر محدود لأجهزة سطح المكتب والجوال.

لذلك قاموا بتصميم بنية لكشف انتباه المشاهد خلال الإعلانات عبر الإنترنت، مستفيدين من أداتين تجاريتين: AFFDEX 2.0 و SmartEye SDK .

[التصوير الفوتوغرافي id = “attachment_215624” align = “alignnone” width = “834”]

تستخرج هذه الأعمال السابقة ميزات منخفضة المستوى مثل التعبيرات الوجهية، وضع الرأس، واتجاه النظر – تم استخلاصها من خلال AFFDEX 2.0 و SmartEye SDK المذكورين أعلاه.

ثم يتم معالجة هذه الميزات لإنتاج مؤشرات عالية المستوى، مع معالجة كل مشتت بواسطة مصنف ثنائي يُدرّب بشكل مستقل على مجموعة بياناته الخاصة من أجل تحسين وتقييم مستقل.

[التصوير الفوتوغرافي id = “attachment_215627” align = “alignnone” width = “890”]

يحدد نموذج النظر ما إذا كان المشاهد ينظر إلى الشاشة أو بعيدًا عنها باستخدام إحداثيات نظر معيارية، مع تقليل منفصل لأجهزة سطح المكتب والجوال. يساعد في هذه العملية آلة دعم متجه خطية ( SVM )، مدربة على الميزات المكانية والزمنية، والتي تدمج نافذة ذاكرة ( نافذة الذاكرة ) لتحسين تحركات النظر السريعة.

لتحديد التحدث بدون صوت ، استخدم النظام مناطق فم مقطوعة و 3D-CNN مدرب على مقاطع فيديو محادثة و非 محادثة. تم تعيين العلامات بناءً على نوع الجلسة، مع تقليل التمهيد الزمني للآثار الكاذبة التي يمكن أن تنتج عن حركات فم قصيرة.

التثاؤب تم الكشف عنه باستخدام محاصيل الوجه الكامل، لتقاط حركة الوجه الأوسع، مع 3D-CNN مدرب على إطارات تم وضع علامات عليها يدوياً (على الرغم من أن المهمة كانت معقدة بسبب تكرار التثاؤب المنخفض في المشاهدة الطبيعية، وشباهته مع تعابير أخرى).

تم تحديد إهمال الشاشة من خلال غياب الوجه أو وضع رأس شديد، مع التنبؤات التي قدمها شجرة قرار .

تم تحديد حالة الانتباه النهائية باستخدام قاعدة ثابتة: إذا اكتشف أي وحدة انتباهًا، تم وضع علامة على المشاهد غير منخرط – نهج يُفضل الحساسية، ومحسّن بشكل منفصل لأجهزة سطح المكتب والجوال.

الاختبارات

كما ذكرنا سابقًا، تتبع الاختبارات طريقة إزالة، حيث يتم إزالة المكونات وتدوين التأثير على النتيجة.

[التصوير الفوتوغرافي id = “attachment_215628” align = “alignnone” width = “898”]

تم تحديد نموذج النظر السلوك بعيدًا عن الشاشة من خلال ثلاث خطوات رئيسية: معالجة تقديرات النظر الخام، وتحسين الإخراج، وتقدير حجم الشاشة لأجهزة سطح المكتب.

للفهم أهمية كل مكون، أزال المؤلفون كل مكون على حدة وتقييم الأداء على 226 فيديو سطح مكتب و 225 فيديو جوال تم سحبها من مجموعتين من البيانات. النتائج، المقاسة بواسطة G-mean و F1 ، موضحة أدناه:

[التصوير الفوتوغرافي id = “attachment_215630” align = “alignnone” width = “866”]

في كل حالة، انخفض الأداء عند إزالة خطوة. أثبتت معالجة النظر أنها قيمة بشكل خاص على أجهزة سطح المكتب، حيث يتغير وضع الكاميرا أكثر من أجهزة الجوال.

كما قيمت الدراسة كيف تنبأ الميزات البصرية بتوجيه الكاميرا الجوال: موقع الوجه، وضع الرأس، وحركة العين، وبلغت 0.75 و 0.74 و 0.60، على التوالي، في حين بلغت الميزات المدمجة 0.91، مما يُظهر – كما يقول المؤلفون – ميزة دمج الإشارات المتعددة.

نموذج التحدث ، مدرب على المسافة الشفوية العمودية، حقق ROC-AUC من 0.97 على مجموعة الاختبار المُ etiquetted يدوياً، و 0.96 على مجموعة أكبر تم وضع علامات عليها تلقائيًا، مما يشير إلى أداء متسق عبر كلا المجموعتين.

بلغ نموذج التثاؤب ROC-AUC بنسبة 96.6٪ باستخدام نسبة جانب الفم فقط، مما улуч إلى 97.5٪ عند دمجها مع تنبؤات الوحدة الفعل من AFFDEX 2.0.

نموذج الشاشة غير المتصلة صنف اللحظات على أنها غير منخرطة عندما فشل كل من AFFDEX 2.0 و SmartEye في الكشف عن وجه لمدة تزيد عن ثانية واحدة. لتقييم صحة ذلك، قام المؤلفون بتعليق يدوية جميع أحداث “لا وجه” في مجموعة بيانات الانحراف الحقيقي ، وحددوا السبب الكامن وراء كل تنشيط. تم استبعاد الحالات الغامضة (مثل انسداد الكاميرا أو تشويش الفيديو) من التحليل.

كما قارن المؤلفون نموذجهم بنموذج AFFDEX 1.0، وهو نظام سابق يستخدم في اختبار الإعلانات – حتى كشف النظر القائم على الرأس في نموذجهم الحالي تفوق AFFDEX 1.0 على كلا النوعين من الأجهزة:

‘ هذا التحسين هو نتيجة لدمج حركات الرأس في كلا الاتجاهين، وكذلك معالجة وضع الرأس لتحديد التغييرات الطفيفة. الحركات الشديدة للرأس في مجموعة البيانات الحقيقية للجوال تسببت في أداء نموذج رأسنا بشكل مشابه لنموذج AFFDEX 1.0. ‘

يغلق المؤلفون الورقة بتحليل نوعي نهائي، كما هو موضح أدناه.

[التصوير الفوتوغرافي id = “attachment_215663” align = “alignnone” width = “882”]

يصرح المؤلفون:

‘ النتائج تشير إلى أن نموذجنا يكشف بشكل فعال عن مشتتات مختلفة في إعدادات غير خاضعة للرقابة. ومع ذلك، قد ينتج عنه إيجابيات كاذبة في بعض الحالات الحدية، مثل ميل الرأس الشديد أثناء الحفاظ على النظر على الشاشة، أو بعض إغلاق الفم، أو عيون غامضة بشكل مبالغ فيه، أو صور الوجه المظلمة بشكل كبير. ‘

الخلاصة

على الرغم من أن النتائج تمثل تقدمًا مقاسًا ولكن معنويًا على الأعمال السابقة، فإن القيمة العميقة للدراسة تكمن في النظرة الخاطفة التي توفرها على الدفع المستمر للوصول إلى حالة المشاهد الداخلية. على الرغم من أن البيانات تم جمعها بموافقة، فإن المنهجية تشير إلى إطارات مستقبلية قد تمتد إلى ما وراء إعدادات البحث التسويقية المنظمة.

هذه الخلاصة القلقية تُشدد فقط من خلال الطبيعة المحمية والمحظورة لهذا الفرع الخاص من البحث.

* تحويلي لمراجع المؤلفين المضمنة إلى روابط.

تم نشره لأول مرة يوم الأربعاء، 9 أبريل 2025