قادة الفكر

وكلاء مستقلون يحتاجون إلى المزيد من مراقبة الذكاء الاصطناعي

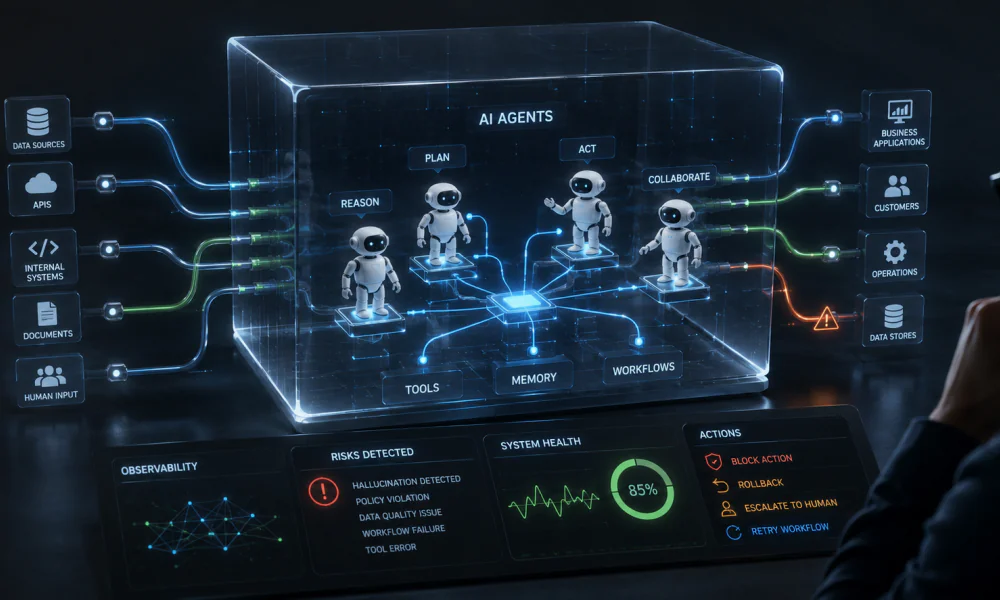

مع استخدام الشركات لوكلاء الذكاء الاصطناعي للتفكير والعمل وتشغيلOperations، من الضروري تطوير خطة لمراقبتها وإدارتها.

عندما تبدأ مكونات مختلفة من نظام الذكاء الاصطناعي في اتخاذ قراراتها الخاصة، فإن المراقبة وحدها لا تكفي لضمان استقرار العمليات أو سلامتها أو موثوقيتها.

لإدارة وكلاء الذكاء الاصطناعي بشكل فعال في جميع أنحاء المؤسسة، يجب على الشركات سد الفجوة بين تحديد المشكلات والعمل. هذا يتجاوز ببساطة ملاحظة المشكلات؛ يجب على الشركات منعها بشكل فعال.

ظهور الوكلاء المستقلين

كانت الموجة الأولى من الذكاء الاصطناعي في المؤسسات عبارة عن أنظمة قائمة على الدفعات؛ يطرح المستخدم سؤالاً، ويستجيب النموذج، وتنتهي الصفقة هناك. على الرغم من أن هذه التكنولوجيا المبكرة كانت في الأساس استجابة، إلا أنها كانت مفيدة للبحث والمرافقة وإنشاء المحتوى والتلخيص.

تختلف الموجة التالية. لا يتفاعل وكلاء الذكاء الاصطناعي المستقلون فحسب، بل يreason أيضًا عبر الأهداف، ويختارون أدواتًا، وينقلون المعلومات، ويتخذون إجراءات، ويشغلون Operations. في بعض الأحيان يعملون جنبًا إلى جنب مع وكلاء آخرين أو أنظمة، ويعملون بشكل متزايد كلاعبين تشغيليين داخل الشركة بدلاً من كونها طبقة واجهة لتعليمات الإنسان.

هذا التغيير مهم لأنها تؤثر على الخصائص التشغيلية للذكاء الاصطناعي. لا تراقب الفرق فقط مخرجات النموذج. بل إنها تدير أنظمة ديناميكية يمكن أن تؤثر على العملاء والموظفين والبنية التحتية وعمليات الأعمال والتطبيقات الأخرى في أي لحظة.

قوى الوكلاء اليوم

تتطور مواهب الوكلاء معهم. يمكن للوكلاء اختيار ما يجب فعله بعد ذلك، وتفكيك الهدف إلى خطوات، وإكمال أنشطة على مستويات مختلفة. من خلال الاتصال بواجهات برمجة التطبيقات، واستفسار قواعد البيانات، والبحث في الأنظمة الداخلية، وتنقية السجلات، وتشغيل الإجراءات الجانبية، يمكنهم تنسيق Operations. يمكن للوكلاء أيضًا اتخاذ أحكام قائمة على السياق عن طريق دمج الدفعات، والذاكرة، والقواعد التجارية، والمعلومات المستعادة، والإشارات التشغيلية في الوقت الفعلي.

يمكن لوكلاء أكثر تطورًا تحديد ما إذا كان سير العمل فاشلًا، ومحاولة مرة أخرى، أو تصعيد المشكلات، أو نقل الوظائف إلى مراجع إنسان. يمكن للوكلاء العمل بشكل مستقل في تطبيقات CRM، وتذاكر، وبنية تحتية سحابية، وقواعد معرفة داخلية، ومنصات مراقبة، وتطبيقات أعمال. نتوقع أن تستمر هذه المهارات في التوسع بسرعة.

كيفية دمج الشركات لوكلاء الذكاء الاصطناعي المستقلين

يتم دمج الوكلاء في مجموعة متزايدة من عمليات المؤسسة، ويتقربون من العمليات التشغيلية حيث يعتبر السرعة والدقة والسلامة والحوكمة مهمة. تشمل بعض هذه العمليات: خدمة العملاء ومعالجة الحالات، والاستجابة للحوادث وعمليات تكنولوجيا المعلومات، وعمليات DevOps وموثوقية الموقع، وتصحيح الأخطاء وتطوير البرمجيات، والتخطيط التشغيلي وتخطيط سلسلة التوريد، وغيرها.

التهديدات التشغيلية الناشئة

然而، مع استقلالية الوكلاء بشكل متزايد، يجب على الشركات التعامل مع نوع جديد من المخاطر التشغيلية.

- الاختيارات السيئة ليست مجرد نصيحة؛ إنها غالبًا ما يتم تنفيذها

- يمكن أن تنتشر الأخطاء الصغيرة بسرعة إلى أنظمة متصلة أخرى

- يمكن أن تؤدي الإجراءات في العالم الحقيقي إلى أوهام

- يمكن لوكلاء أن ي逸روا عن نوايا الأعمال أو السياسات أو الامتثال

- يمكن أن تؤدي التفاعلات بين المكونات المتعددة إلى فشل

- يمكن اتخاذ القرارات الآلية بسرعة أكبر من التقييم البشري

في حين قد تلاحظ الفرق أعراضًا، يجب أن يكونوا قادرين على فهم الأسباب الكامنة وراء سلوك النظام. يحتاج الذكاء الاصطناعي في المؤسسات إلى ضوابط موثوقية بالإضافة إلى الرؤية.

تعقيدات أنظمة الذكاء الاصطناعي

نادرًا ما تكون الأنظمة التي تعمل بالذكاء الاصطناعي اليوم نظامًا واحدًا. إنها أنظمة موزعة ومتعددة الطبقات تتكون من العديد من المكونات التفاعلية التي تشمل:

- النماذج الأساسية (LLMs)

- نماذج لغة صغيرة محسنة أو محددة للمهام (SLMs)

- نماذج التضمين

- قواعد بيانات متجهة

- أنابيب الاسترجاع ومكونات RAG

- قوالب الدفعات وطبقات تنسيق الدفعات

- مجموعات بيانات التدريب والتقييم

- حواجز وطبقات السياسات

- وكلاء وعمليات

- أنظمة استدعاء الأدوات

- التелеметري (أو السجلات والمقاييس والتعقب)

- نقاط التحقق الإنسانية في الحلقة

مخاطرها

يضيف كل مكون نمط فشل مختلف، ويضيف طريقة تفاعلهم تعقيدًا إضافيًا. حتى إذا بدا النظام قويًا على مستوى البنية التحتية، فقد لا يزال يأخذ قرارات سيئة ويولد نتائج مرضية؛ في حين بناء مخاطر تشغيلية تحت السطح.

تتضمن بعض المخاطر المرتبطة بها: إدخال مدخلات سيئة أو معيبة بواسطة خطوط أنابيب البيانات، وعرقلة البنية التحتية التي تقلل من الموثوقية، ونتائج ضارة أو خاطئة، وعراقيل تشغيلية في الاستجابة لمراجعة الإنسان. وتعقيد الأمور بشكل أكبر، قد تفشل الأنظمة التي تحتوي على وكلاء متعددين أو خطوات في طرق غير واضحة على الفور.

مراقبة الذكاء الاصطناعي

المراقبة التقليدية غير كافية لفهم سلوك الدفعة، وجودة الاسترجاع، وانحراف النموذج، وقنوات تنفيذ الوكيل، أو العلاقة بين سلوك الذكاء الاصطناعي وتأثيره التشغيلي أو التجاري فيما بعد.

هنا يأتي دور مراقبة الذكاء الاصطناعي. تمكن مراقبة الذكاء الاصطناعي الفرق من فهم كيفية عمل أنظمة الذكاء الاصطناعي في الإنتاج عن طريق جمع وترميز وتقييم المدخلات والمخرجات والسلوك المرغوب فيه والإشارات القرارية التي تنتجها هذه الأنظمة. هذا ضروري لأن أنظمة الذكاء الاصطناعي موزعة وغير محددة للغاية وحساسة للغاية للسياق.

توفر مراقبة الذكاء الاصطناعي رؤية شاملة لعمليات الذكاء الاصطناعي، بحيث يمكن للفرق التي تستخدمها فهم كيفية تفاعل الدفعات والنموذج وطبقات الاسترجاع والأدوات والنظم الجانبية أثناء التنفيذ.

تمكن مراقبة الذكاء الاصطناعي من مراقبة الأداء والسلوك، بما في ذلك التأخير والتكلفة واستخدام الرمز والإنتاج ومعدلات الخطأ ومؤشرات جودة مخرجات النموذج. كما يتبع مسارات التنفيذ في عمليات الوكيل المعقدة ويوضح كيف يتم الوصول إلى النتائج عبر عدة خطوات واعتماديات.

كما يمكن لمراقبة الذكاء الاصطناعي العثور على شذوذات عبر الإشارات التشغيلية والإشارات الذكاء الاصطناعي من خلال كشف السلوك الشاذ في النماذج والأنابيب البنية التحتية أو النتائج المواجهة للعميل قبل أن يكتشفها الفريق يدوياً. كما يسرع تشخيص الأخطاء عند حدوثها ويجعل التحقيقات في الأسباب الجذرية أسهل من خلال تضمين العمليات المحددة للذكاء الاصطناعي في تелеметري النظام (سجلات، مقاييس، تعقب، وأحداث).

مراقبة الذكاء الاصطناعي وحدها غير كافية

على الرغم من كونها ممارسة تجارية ضرورية، فإن مراقبة الذكاء الاصطناعي لها قيود متأصلة.

المراقبة تشخيصية وليست وقائية؛ يمكن للفرق معرفة ما пошئ خطأ ولكن ليس بالضرورة كيفية منع حدوثه مرة أخرى. من المهم فهم أن معرفة أفعال الوكيل السابقة لا تترجم تلقائيًا إلى سيطرة على أفعال الوكيل في المستقبل.

عندما يتعلق الأمر بأنظمة غير محددة معقدة، يمكن أن تؤدي المراقبة غالبًا إلى إغراق الفرق بالبيانات التي تؤدي إلى عدم اليقين. بدلاً من تقديم إجابة تشغيلية، تنتهي المراقبة غالبًا عند التفسير. حتى مع علم الفريق بمشكلة ما، قد لا يكون لديهم التutomية والحواجز والدوائر السيطرة اللازمة لاتخاذ إجراء تصحيحي.

هذا يخلق فجوة تشغيلية. قد تتمكن الشركات من اكتشاف الانحراف أو النتائج السيئة أو السلوك الخطير أو انخفاض الإنتاجية، لكنها قد لا تزال غير قادرة على منع حدوثها مرة أخرى، أو تقليل آثارها، أو الحفاظ على أنظمة مستقلة في حدود تشغيلية آمنة.

هذا يعني أن الفرق لا تزال تعمل بشكل phảnاعي. يستخدمون التدخل اليدوي عند حدوث خطأ، ويبحثون في الحوادث بعد وقوعها، ويعتمدون على العمالة البشرية لتعويض عن أنظمة أصبحت أسرع وأكثر استقلالية.

نظرة عامة على موثوقية الذكاء الاصطناعي

تتجاوز موثوقية الذكاء الاصطناعي مجرد مراقبة المشكلات. إنها انضباط ضمان أنظمة الذكاء الاصطناعي تعمل بأمان وثبات وتنبؤ ونجاح في سياقات الإنتاج الحقيقي. يفهم ويدمج موثوقية الذكاء الاصطناعي نظامًا كاملاً من الأنظمة حول الذكاء الاصطناعي. إنه يغلق الحلقة بين الكشف والعمل.

تُركز موثوقية الذكاء الاصطناعي على ما إذا كان يمكن للنظام كله الذي يعتمد على الذكاء الاصطناعي العمل داخل حدود تشغيلية معقولة مع مرور الوقت، وليس فقط على ما إذا كان النموذج قدم استجابة دقيقة. الجودة، والسلامة، والمتانة، والتوضيح، وامتثال السياسات، والكفاءة التكلفة، والاستقرار التشغيلي هي جميعها جزء من المعادلة.

الانتقال من الكشف إلى الوقاية

تقلل موثوقية الذكاء الاصطناعي من الوقت بين التعرف على مشكلة ومعالجتها. إنها تنتقل من الحديث عن “ما пошئ خطأ؟” إلى “كيف سيتحسن الذكاء الاصطناعي بسرعة؟” استخدام التقنيات التالية ينتقل من المراقبة السلبية إلى الوقاية النشطة:

- ترميز الإشارات عبر النماذج والبيانات والبنية التحتية لتحديد المشكلات

- اكتشاف المشكلات بشكل استباقي قبل حدوثها

- التحقق من جميع المدخلات والمخرجات في أنظمة الذكاء الاصطناعي الاحتمالية لاكتشاف التغييرات السلوكية الدقيقة

- إنشاء حلقة تغذية راجعة بين اكتشاف الإخراج غير المرغوب فيه في الإنتاج واستخدامه ل生成 بيانات تحسين لتحسين دقة النماذج الأساسية

- تتبع سير عمل متعدد الوكلاء لضمان khảية ربط النقاط حول تطور البيانات لتحديد الإجراءات المعقدة

- سير عمل وكلاء بشريون في الحلقة للاستجابة الآمنة والتصحيح الآلي

إغلاق الفجوة بين السيطرة والمراقبة

تستفيد الشركات من الإطارات التي تدمج الرؤية والسيطرة وتتطلب أكثر من مجرد طبقة مراقبة على رأس الذكاء الاصطناعي التوليدي. في الأنظمة المحددة وغير المحددة، يمكن لمنصة موثوقية تحديد وتنبؤ وتوضيح ومساعدة في السيطرة على المشكلات.

يجب أن يتضمن إطار قابل للاستخدام لعمليات الذكاء الاصطناعي الموثوقة ما يلي:

- تелеметري متكاملة لأنظمة تكنولوجيا المعلومات وأنظمة الذكاء الاصطناعي

- تتبع سير عمل وكلاء متكامل واعتماديات النظام

- تتبع سلوك وكلاء محددة للذكاء الاصطناعي وجودة (دفعات وتقييمات)

- اكتشاف شذوذ متقدم، بغض النظر عن المصدر

- استدلال سببي وتحليل أسباب جذرية

- تنبيهات تكيّف تلقائيًا مع بيئتك ولا تتطلب عتبات يدوية

- تنفيذ سياسات وحواجز

- تقييم إنساني للعمل الحساس أو الهام

- تأتمت عمليات وتنسيق تصحيح

- استخدام التحليل التنبؤي لمنع حدوث مشكلات

- حلقة تغذية راجعة تربط اكتشاف الشذوذ بتحسين جودة نموذج الذكاء الاصطناعي

تسهيل وظائف الذكاء الاصطناعي

تعتمد أنظمة الذكاء الاصطناعي على البنية التحتية والخدمات وأنابيب البيانات والعمليات التشغيلية؛ لا تفشل وحدها. يحصل الفريق على الصورة الكاملة عندما يتم دمج موثوقية الذكاء الاصطناعي وتكنولوجيا المعلومات.

لا ينبغي أن يكون غلاف LLM رقيق أساسًا لمنصة موثوقة. لتحديد ومعالجة المشكلات التي يغفلها أدوات الذكاء الاصطناعي التوليدي فقط، يجب النظر في مجموعة من تقنيات الذكاء الاصطناعي، بما في ذلك الذكاء الاصطناعي غير الموجه والتنبؤي والسببي والتوليدي. يُعرف هذا المزيج من التقنيات باسم “الذكاء الاصطناعي المركب”.

الذكاء الاصطناعي التوليدي جيد في تلخيص اللغة الطبيعية. وهو مناسب بشكل أفضل للمواقف التي تتطلب التفكير من خلال بيانات غير منظمات أو عند التفاعل مع البشر. ولكن هذا لا يتناسب مع شكل معظم مشاكل الموثوقية في الإنتاج.

يركز الذكاء الاصطناعي التنبؤي على تحديد الإشارات المبكرة قبل أن تصبح انقطاعات أو تجارب عملاء سيئة أو فشلات باهظة التكلفة باستخدام خوارزميات اكتشاف الشذوذ.

يساعد الذكاء الاصطناعي السببي في تحديد الأسباب الجذرية الحقيقية ليكشف ما إذا كانت جودة الاسترجاع أو سلوك النموذج أو بطء البنية التحتية أو انحراف البيانات الجانبية أو فشل النظام الجانبي هو السبب في انخفاض الأداء.

يكتشف الذكاء الاصطناعي غير الموجه تلقائيًا الأنماط المخفية أو الهياكل أو الشذوذ في البيانات دون توجيه بشري. يتفوق على الذكاء الاصطناعي التوليدي في الموثوقية لأنه يركز على العثور على هياكل مخفية داخل البيانات المعقدة غير المصنفة لتجميع عناصر مشابهة أو العثور على علاقات.

عندما تكون المخاطر أو الغموض أو التأثيرات التجارية كبيرة، يجب أن يكون وكلاء الذكاء الاصطناعي التشغيلي قادرون على توفير ردود فعل آلي مع الحفاظ على المشاركة البشرية لعمليات موثوقة.

يمكن تحسين فهم نموذج الذكاء الاصطناعي للسياق التجاري المحدد في كل لقاء باستخدام التعلم التعزيزي من بيانات المستخدم الفعلية في الإنتاج.

حتى الأنظمة الأكثر تطورًا تتجاوز التنبيه؛ تتعلم الإصلاح المفتوح من كل حادث مع مرور الوقت، وتأتمت ردود الفعل المعترف بها، وتبدأ إجراءات آمنة.

الاستعداد لأنظمة الذكاء الاصطناعي المستقلة

يمكن للشركات الاستعداد لأنظمة الذكاء الاصطناعي المستقلة بطرق مختلفة. أولاً، يجب اعتبار الوكلاء أنظمة تشغيلية وليس أدوات للإنتاجية. بمجرد أن يصبح للوكيل القدرة على العمل، يصبح جزءًا لا يتجزأ من عمليات الأعمال ويجب أن يتم تنظيمه بشكل مناسب.

يمكن للفرق تسجيل إشارات من النماذج والدفعات والأدوات والعمليات والبنية التحتية ونتائج المستخدم على الفور من خلالstrumenting الوكلاء. لا ينبغي تأجيل هذا الرقابة الأساسية حتى يصبح الوكلاء ضروريين للأعمال.

من المهم أيضًا إنشاء معايير موثوقية قبل نشر الوكلاء على نطاق واسع. يجب دمج عتبات مقبولة للسلامة والطول الزمني ومعدلات الخطأ ومخاطر الوهم وامتثال السياسات والتأثير التجاري في تصميمهم.

يربط ربط سلوك الذكاء الاصطناعي بالأنظمة والإجراءات التي تدعمه الشركات بدمج عمليات الذكاء الاصطناعي وتكنولوجيا المعلومات. استخدام أدوات مختلفة للبنية التحتية ومراقبة النموذج يخلق نقاط عمياء.

يجب على هندسة المنصات، وSRE، والأمان، وفريق البيانات، وفرق الذكاء الاصطناعي، ومالكي الأعمال العمل معًا لتقديم عمليات ذكاء اصطناعي موثوقة، وتنقل الأنظمة المستقلة إلى ما وراء السيلوس التقليدية.

كل حادث وشذوذ وقرب من الصدفة سيعزز النظام من خلال دمج حلقة تغذية راجعة في العمليات، مما يسمح للشركات بالاستمرار في التعلم من سلوك الإنتاج.

أخيرًا، من المهم اختيار منصات تهدف إلى السيطرة وليس فقط المراقبة. ستستفيد الشركات من الأنظمة التي تدمج المراقبة والتنبؤ والتوضيح والعمل مع نمو وكلاء الذكاء الاصطناعي بشكل متزايد. ستفوز المنظمات التي تنتقل بنجاح من تحديد المشكلات إلى السيطرة الآمنة على النتائج.

النقطة الأساسية

الذكاء الاصطناعي في الأعمال هو الآن نظام تشغيلي في بيئات المؤسسات وليس أداة. في سياقات الإنتاج الحقيقي، يضمن إضافة الموثوقية لأنظمة الذكاء الاصطناعي عمليات آمنة وثابتة ومتوقعة وكفية.