زاوية Anderson

يفضل الذكاء الاصطناعي قراءة الكتاب أكثر من مشاهدة الفيلم

من الم驚 أن يكون من الصعب إلى حد ما الحصول على نماذج الذكاء الاصطناعي لمشاهدة التعليق على المحتوى المرئي الفعلي ، حتى لو تم إنشاؤها لهذا الغرض. إنهم أكثر اهتماما بالكلمة المكتوبة.

إذا كنت قد حاولت تحميل مقطع فيديو صغير إلى ChatGPT أو إلى نموذج رؤية / لغة مشابه ، فقد تفاجأت بمعرفة أنهم لا يستطيعون في الواقع تحليل الفيديو. في حين أن النماذج مثل ChatGPT-4o+ قادرة على تحليل الإطارات الفردية – في شكل صور ، مثل JPEG و PNG – فإنهم يفضلون أن يقوم المستخدم باستخراج الإطارات الخاصة بهم ورفعها كصور (التي هم مستعدون للتعليق عليها).

في حالة سلسلة OpenAI GPT ، يمكن ، بعد بعض الجهد ، استخراج تشغيل كامل من الإطارات من مقطع فيديو وتمريرها إلى ChatGPT ، لغرض ، على سبيل المثال ، إنشاء سكة رواية منشأة بواسطة الذكاء الاصطناعي للفيديو:

![صور ورمز من درس OpenAI حول تحليل الإطارات المستخرجة المتعددة لغرض تطوير تعليق منشأ بواسطة الذكاء الاصطناعي للفيديو. [ مصدر ] https://cookbook.openai.com/examples/gpt_with_vision_for_video_understanding](https://www.unite.ai/wp-content/uploads/2025/10/openai-gpt-frame-parsing.jpg)

صور ورمز من درس OpenAI حول تحليل الإطارات المستخرجة المتعددة لغرض تطوير تعليق منشأ بواسطة الذكاء الاصطناعي للفيديو. مصدر

لكن يقع على عاتق المستخدم القيام بالتحويل من فيديو إلى إطارات ، إما عن طريق استدعاء الوظائف في روتين أكبر ، كما هو موضح في المثال أعلاه ، أو استخراج الإطارات باستخدام FFMPEG أو مختلف حلول تحرير الفيديو المجانية والمدفوعة.

إلى حد ما ، ربما إلى حد كبير ، تعتمد القيود على تحليل الفيديو في المنتجات ذات المستوى العالي مثل ChatGPT على استخدام الموارد : مجرد تزويد مثيل واحد من الذكاء الاصطناعي bằng مجموعة من شفرات الفيديو الأكثر شيوعًا ، والالتزام بموارد الحوسبة إلى عملية استخراج متطلبة للقرص والمتطلبة للوحدة المركزية هي لا تُستهان بها ، إذا قرر مئات الملايين من المستخدمين البدء في استخدام هذه المرافق كل يوم.

بالإضافة إلى ذلك ، يمكن أن يُظهر التحليل الزمني صورة مختلفة تمامًا مقارنة بإطار واحد (تخيل شخصًا يدخل منزلًا بحالة مزاج جيدة ثم يكتشف جثة) ؛ لذلك ، يجب النظر في العلامة الزمنية الكاملة لمقطع فيديو قصير جدًا هو مهمة صعبة ومستهلكة للموارد – بالإضافة إلى مجال بحث متخصص في الأدب ، على سبيل المثال مع التطوير المستمر لإطارات مثل الflux البصري – الذي يفك بشكل أساسي طول الفيديو حتى يتم النظر إليه والعمل عليه كما لو كان وثيقة ثابتة :

تُظهر مخططات Flux البصري كيفية تتبع الحركة عبر الإطارات في تسلسل فيديو ، مع أشعة خضراء تُظهر اتجاه الحركة والشدة. توفر هذه الخرائط الاستمرارية الزمنية اللازمة لـ VLMs ويمكن أن تعمل أيضًا كدلائل هيكلية في تدفقات VFX. مصدر

الاستقرار على ملخصات كليفز

على الرغم من ذلك ، منذ أن يمكن للنماذج مثل Notebook LM ومدخلات ChatGPT الأخيرة قراءة البيانات الوصفية المرتبطة (أي المحتوى النصي المضمن الذي يوفر السياق للفيديو بطرق معينة) ، فإنهم لا يحظرون تحميل ملفات الفيديو ؛ وأحيانًا ، سيحاولون حتى تفسير فيديو لا يحتوي على مثل هذه البيانات.

في الحالة التالية ، قمت بتحميل مقطعًا عشوائيًا مدته 6 ثوانٍ من فيلم The Hand of God الإيطالي (2021) إلى NotebookLM ، مع التأكد من أن المقطع لا يحتوي على نص مفيد ، إما في البيانات الوصفية أو في اسم الملف.

ثم واصلت NotebookLM المثيرة لل幻ازة المادة غير المرتبطة بالفيديو * ، كاملة مع بودكاست غير منطقي وغير مرتبط لمدة خمس دقائق :

لحظة يومية في مقطع فيديو مدته 6 ثوانٍ من فيلم إيطالي يتم تفسيره بشكل مخالف للواقع بواسطة NotebookLM. مصدر: Google NotebookLM

على الرغم من أن Notebook ، مثل ChatGPT ، سوف يقبل مقطع فيديو من YouTube كمدخل ، إلا أنه سيفعل ذلك فقط إذا كان الفيديو يحتوي على طبقة نصية قابلة للتفسير و / أو عناوين فرعية (ليست عناوين فرعية محرقة في الفيديو).

بهذه الطريقة ، يتم عمل تحليل الفيديو الفعلي ومشاهدته وفهمه (الذي هو ضروري قانونيًا لمنصة YouTube ، بسبب إجراءات حماية حقوق النشر ، ونظام الحماية المتعاقبة) ، يتم بعد ذلك تحميل المقطع ، وعندما يمكن تخصيص الموارد اللازمة للمعالجة.

التفسير الفعلي للفيديو مكلف ومُرهق ، ويتضح أن حتى النماذج التي تم تدريبها خصيصًا لأداء هذه المهمة تفضل قراءة النص أكثر من مشاهدة الفيديو.

TL;DW

هذا ، وفقًا لورقة جديدة من جامعة بريستول في المملكة المتحدة ، بعنوان الفيديو ليسworth ألف كلمة ، حيث يخلص المؤلفان إلى أن نماذج اللغة البصرية الحالية (VLMs) – النماذج المخصصة لتكون قادرة على تحليل الفيديو بطريقة أكثر جهدًا ، والمشاركة في إجابة الفيديو على الأسئلة (VQA) – تعتمد أيضًا على المعلومات النصية عند كل فرصة.

عندما تم إعطاء النماذج صور متحركة و أسئلة وأجوبة متعددة ، وجد المؤلفان أن النماذج اعتمدت اختياراتها على الأنماط في النص ، بدلاً من أي شيء يحدث على الشاشة – في nhiều حالات ، أدت بنفس الأداء حتى عندما تم إزالة السؤال كاملًا.

في ما يبدو أنه شكل عادة من الاختصار أو الغش ، ما كان مهمًا بالنسبة إلى معظم النماذج هو القدرة على تحديد الأنماط في الإجابات الممكنة ؛ فقط عندما تم جعل المهمة أكثر صعوبة ، من خلال إضافة المزيد من خيارات الإجابة ، بدأت الذكاء الاصطناعي في الاهتمام بالفيديو.

المنشور يُظهر :

‘[لنماذج السياق الطويل ، يُظهر الفيديو مساهمات متضائلة بشكل كبير ، مما يعني أن قيم Shapley للإطارات الفردية أقل بكثير من نظيراتها المميزة النصية. ‘

‘الفيديو ككل موداليتى لا يزال ذا صلة بالغه ، ولكن هذا دليل على أن قيم Shapley للإطارات الفردية أكثر مركزًا حول الصفر ، وأن انتباه النموذج إليها أقل توجيهًا من النص.’

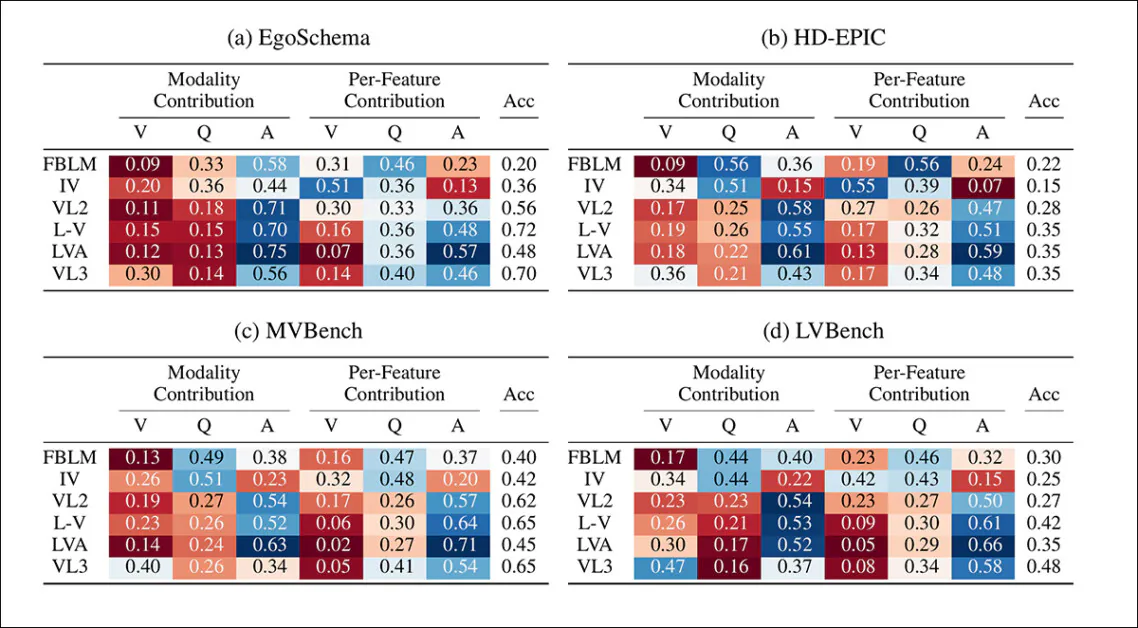

لاختبار كيف يساهم كل جزء من المدخل (الفيديو ، النص ، إلخ) في دقة النموذج ، أجرى الباحثون اختبارات إضافية باستخدام التخفي – إخفاء متعمد لجزء أو أكثر من المدخل ، ومراقبة كيف تتغير دقة النموذج نتيجة لذلك.

إذا انخفضت الأداء بشكل حاد عند إزالة مدخل معين ، فإن ذلك المدخل مهم على الأرجح ؛ إذا أدى النموذج بنفس الأداء ، فذلك يشير إلى أن القطعة الناقصة لم تكن تعتمد بشكل كبير.

في هذا الصدد ، فإن اختبارات التخفي هي نوع من دراسة الإزالة التكرارية.

تأثير أداء إخفاء مدخلات الفيديو أو السؤال أو الإجابة عبر أربعة معايير VQA. تُظهر النقاط التغيير من خط قاعدة غير مخفي. الأحمر يعني دقة أقل ، والأخضر يعني دقة أعلى. غالبًا ما احتفظت النماذج بنقاط عالية بدون فيديو ، ولكن خسروا المزيد عند إزالة (نص) الإجابة.

تُظهر النتائج (الموضحة أعلاه) أن الإجابات (الإجابات النصية في بيانات الاختيار المتعدد) تحمل أهمية أكبر عبر اللوحة. غالبًا ما تسبب إخفاء الإجابة في انخفاض أكبر في الدقة ، مما يقلل من أداء النماذج إلى قرب الأداء العشوائي.

ومع ذلك ، كان لإخفاء السؤال تأثير أقل ، مما يدعم الاستنتاج السابق بأن النماذج تقلل من قيمة السؤال.

في بعض الحالات ، حتى تحسنت الدقة عندما تم إزالة السؤال ، مما يشير إلى أن النماذج كانت في بعض الأحيان تتوافق فقط مع الإجابات مع الإشارات النصية أو البصرية بدلاً من تقييم السؤال بشكل صحيح.

تختلف النماذج أيضًا في اعتمادها على الفيديو: احتفظ بعضها بأداء معقول بدون فيديو ، مما يؤكد مرة أخرى مساهمة الفيديو المحدودة في العديد من التكوينات الحالية.

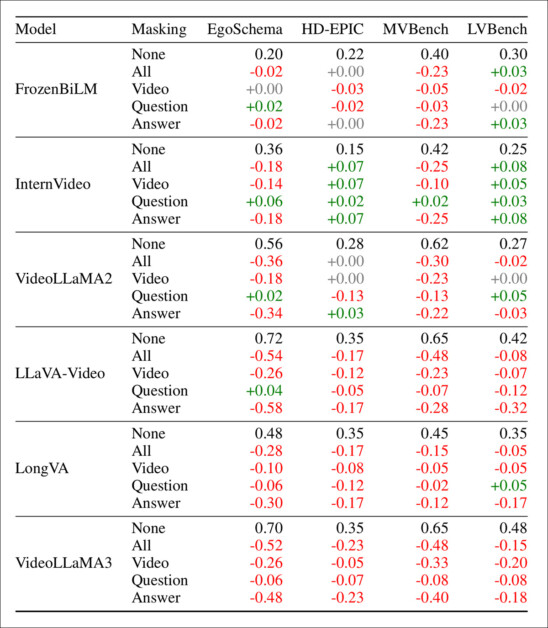

ثم قام المؤلفون باختبار ما إذا كان يمكن إجبار النماذج على الاعتماد على الفيديو من خلال إضافة المزيد من الإجابات الخاطئة إلى خيارات الاختيار المتعدد.

عندما كانت الإجابات الخاطئة سهلة ومستعارة من أسئلة أخرى ، تحسنت الأداء ، لأن النماذج قامت بالاتفاق مع الأنماط النصية دون الكثير من التفكير. لكن مع عشرة إجابات أو أكثر غير متعلقة ، بدأت في الاعتماد أكثر على الفيديو والسؤال :

مساهمة كل ميزة وأداء مدخلات الفيديو والسؤال والإجابة ، مع إضافة إجابات خاطئة إلى كل اختبار VQA ، مما يظهر أن زيادة عدد الإجابات الخاطئة يقلل من هيمنة النص ويرفع التأثير النسبي للميزات البصرية والسؤال.

لنموذج VideoLLaMA3 ، قلل إخفاء الفيديو من الدقة بنسبة 40٪ على EgoSchema و 15٪ على LVBench ، مما يشير إلى أن زيادة بسيطة في عدد الإجابات يمكن أن تhift النماذج بعيدًا عن اختصارات النص وتoward التفكير المتعدد الحسي الحقيقي.

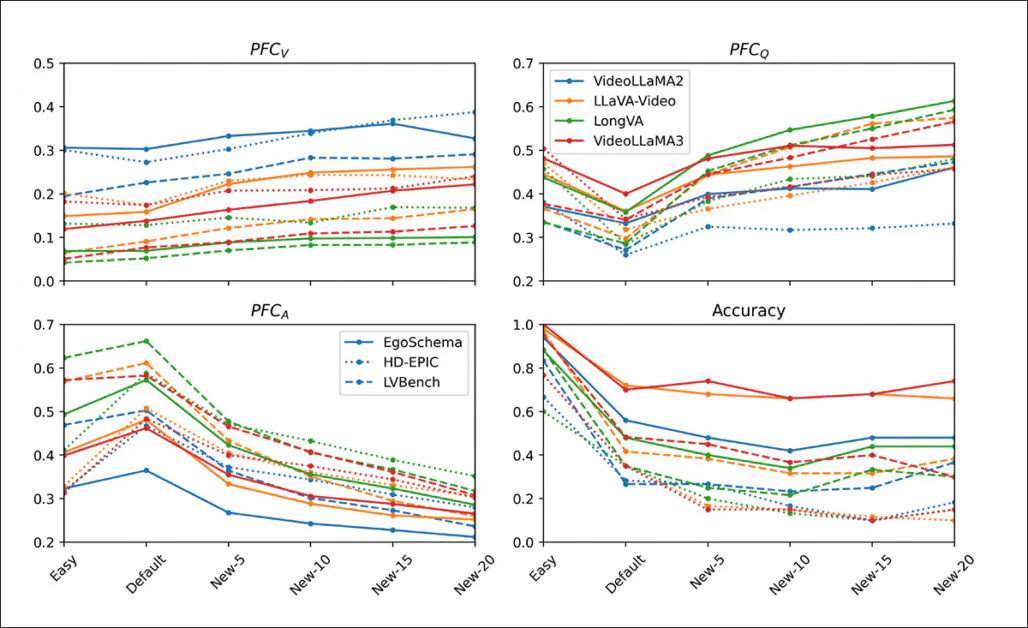

كما قام الباحثون باستكشاف كيفية توزيع الائتمان عبر المدخلات ، ونرى أدناه خرائط حرارة لقيم Shapley لكل مدخل نموذج :

خرائط حرارة لقيم Shapley لأربعة مجموعات بيانات ، حيث تظهر كل صفحة زوج VQA واحد ، وكل عمود ميزة واحدة. تظهر ميزات الفيديو على اليسار ، تليها النص. تؤكد القيم الأقوى في المناطق (الحمراء) النصية أن النماذج تعتمد بشكل أكبر على اللغة أكثر من الفيديو.

في تعليق على النتائج أعلاه ، يقول المؤلفون :

‘magnitude قيم Shapley أكبر بكثير نحو الجانب الأيمن من كل خريطة حرارة ، تمثل الائتمانات والسؤال. هذه الحدود الواضحة هي حيث تنتهي الإطارات الفيديو وتبدأ الميزات النصية ، مما يدل على أن مساهمة موداليتى الفيديو أقل بكثير من السؤال / الإجابة. ‘

في الخلاصة ، عبر جميع المجموعات البيانية ، تكون القيم أقوى بكثير نحو نهاية الطيف النصي ، مما يشير بقوة إلى أن النماذج تعتمد بشكل أكبر على اللغة أكثر من الإشارات البصرية. حتى عندما يُستخدم الفيديو ، تكون المساهمة موزعة ب薄ة عبر العديد من الإطارات ، غالبًا دون نمط متسق.

نرى أدناه مثالًا موضحًا من EgoSchema. تم اختيار 16 إطارًا “أهم” باستخدام قيم Shapley وتم تلوينها وفقًا لتأثيرها ، مع تلوين الأزرق للإشارة إلى مساهمة إيجابية والاحمر لسلبي :

ائتمانات Shapley لمثال EgoSchema واحد ، تُظهر 16 إطارًا الأكثر تأثيرًا وجميع المدخلات النصية. مساهمات الفيديو ضعيفة مقارنة بالنص ، الذي يهيمن على منطق النموذج.

الاستنتاج

من يعمل في تحرير الفيديو أو تحليل الفيديو سيعرف جيدًا مدى كون هذه العمليات مكلفة للموارد ، ويفهم لماذا لا يمكن للشركات التي تتحليل ملايين الطلبات التي يقوم بها الذكاء الاصطناعي يوميًا أن تتساهل في السماح للمستخدمين بتشغيل العمليات التحريرية والتفسيرية للفيديو بشكل عشوائي.

شيء واحد يجب تذكره في هذا الصدد هو أن كل واجهة API للذكاء الاصطناعي التي ستحاولها (باستثناء الإصدار الجديد والقصير الأجل من العرض التوضيحي لدعم البحث العلمي الجديد) تبحث عن إنجاز رغبات المستخدمين على أدنى مستوى من إنفاق الموارد.

هذا يعني الاعتماد على البيانات الوصفية الحالية من البيانات التي قدمها المستخدم أو استرجاعات RAG ، إذا كان ذلك ممكنًا ؛ والاستخراج (إذا لزم الأمر بشكل مطلق) البيانات الوصفية لتنسيقات أكثر قابلة للفهم مثل PDF و المستندات و الصور الفردية.

ما لا يُعتبر هو تشغيل فيديوك المحمل عبر CLIP أو أحدث إصدار من YOLO ، أو عبر أي نموذج VLM متطلب للموارد ووقت استهلاك يمكنه تحديد ما يوجد في الإطارات وفهم ما يحدث في الفيديو المقدم ، مع مراعاة الزمنية.

ومع ذلك ، هذا لا يعني أن الظواهر التي توثقها الورقة الحالية تنتج بالضرورة من النهج المعماري المتقشف. يلاحظ المؤلفون أن النص يهيمن على أنماط التدريب المتعددة الحسية الحالية في أي حال ، مما يشير إلى أن “اللغة البصرية” أقل تطورًا أو أقل أهمية أو إعلامية داخل سياق متعدد الحواس أو (على الأقل في الوقت الحالي) أقل فهمًا ،

* من المثير للاهتمام أن يبدو أن المواد التي جاءت بها NotebookLM هي إما أصلية تمامًا أو غير مؤشرة بواسطة Google ، لأنني لا أستطيع العثور على أي نتائج ويب يمكن أن تكون قد تسربت إلى بيانات التدريب و حفزت هذا الإخراج.

نُشر لأول مرة يوم الجمعة ، 31 أكتوبر 2025 ؛ تم تحريره في 14:20 لتنسيق