Góc nhìn Anderson

Vibe Coding Suffers When AI’s Role Expands

Một nghiên cứu mới cho thấy vibe coding được cải thiện khi con người đưa ra hướng dẫn, nhưng giảm khi AI thực hiện, với thiết lập hybrid tốt nhất giữ con người ở vị trí đầu tiên, với AI làm trọng tài hoặc thẩm phán.

Nghiên cứu mới từ Hoa Kỳ, xem xét những gì xảy ra khi các hệ thống AI được phép điều khiển vibe coding, thay vì chỉ thực hiện hướng dẫn của con người, đã phát hiện ra rằng khi các mô hình ngôn ngữ lớn (LLMs) đảm nhận vai trò chỉ đạo lớn hơn, kết quả thường là tồi tệ hơn.

Mặc dù các nhà nghiên cứu đã sử dụng GPT-5 của OpenAI làm khung cho các thí nghiệm hợp tác giữa con người và AI, họ sau đó đã xác nhận rằng cả Claude Opus 4.5 của Anthropic và Google Gemini 3 Pro đều bị ảnh hưởng bởi cùng một đường cong suy giảm khi trách nhiệm tăng lên, tuyên bố rằng ‘thậm chí sự tham gia hạn chế của con người liên tục cải thiện hiệu suất’:

‘[Con người] cung cấp hướng dẫn hiệu quả cao cấp duy nhất trên các lần lặp lại, [trong khi] hướng dẫn của AI thường dẫn đến sự sụp đổ hiệu suất. Ngoài ra, chúng tôi phát hiện ra rằng việc phân bổ vai trò cẩn thận giữ cho con người chịu trách nhiệm về hướng dẫn trong khi giao nhiệm vụ đánh giá cho AI có thể cải thiện hiệu suất hybrid.’

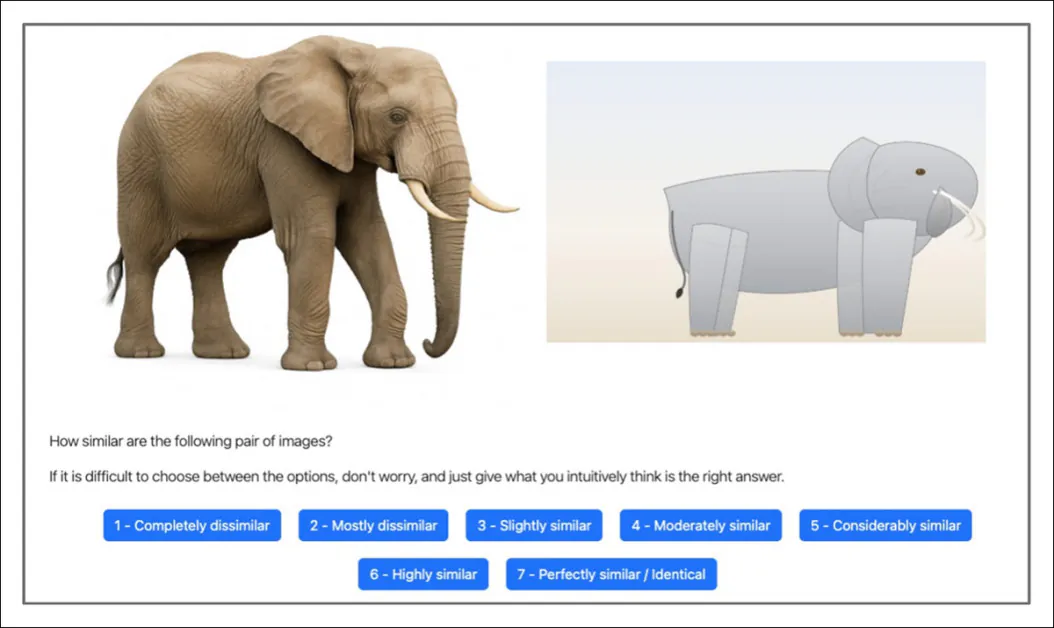

Để cung cấp một thử nghiệm nhất quán có thể được đánh giá bình đẳng bởi con người cũng như AI, một khuôn khổ thử nghiệm được kiểm soát đã được xây dựng xung quanh một nhiệm vụ mã hóa lặp lại trong đó một hình ảnh tham chiếu – có tính năng ảnh chụp một con mèo, chó, hổ, chim, voi, penguin, cá mập, zebra, hươu cao cổ hoặc gấu trúc – phải được tái tạo bằng đồ họa vector có thể mở rộng (SVG), và tái tạo đó được đánh giá so với nguồn ảnh mà nó được lấy:

Cả người tham gia và AI đều được hiển thị hình ảnh tham chiếu chụp ảnh cùng với bản tái tạo SVG được AI tạo ra, và được yêu cầu đánh giá sự tương tự giữa hai hình ảnh trên thang điểm 7 điểm. Nguồn

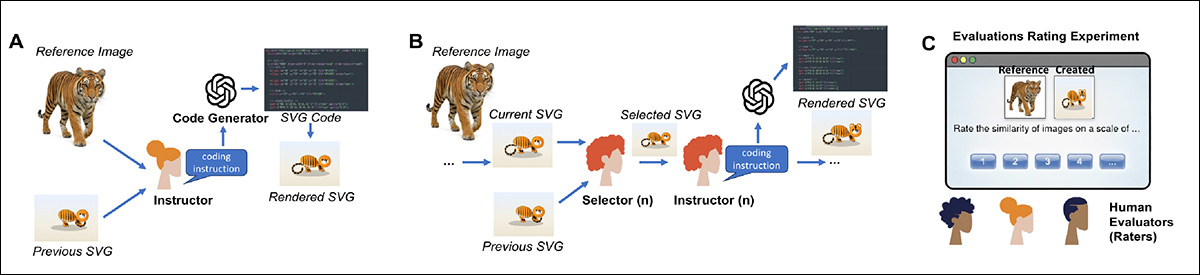

Trong mỗi vòng, một tác nhân cung cấp hướng dẫn ngôn ngữ tự nhiên cấp cao để hướng dẫn một trình tạo mã, và một tác nhân khác quyết định liệu có giữ phiên bản mới hay quay lại phiên bản trước – một vòng lặp có cấu trúc phản ánh các quy trình hợp tác thực tế.

Across 16 thí nghiệm liên quan đến 604 người tham gia và hàng nghìn cuộc gọi API, các vòng thử nghiệm do con người lãnh đạo hoàn toàn được so sánh trực tiếp với các vòng thử nghiệm do AI lãnh đạo hoàn toàn, trong điều kiện khác tương tự.

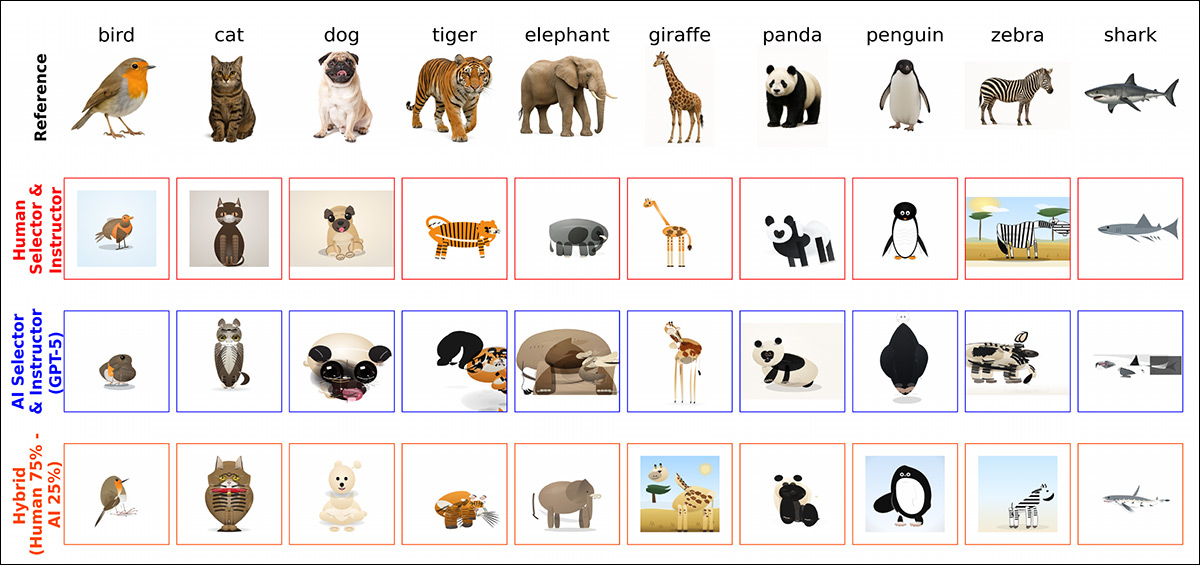

Một số giải pháp đa dạng được tạo ra bởi các sự kết hợp khác nhau của tỷ lệ và loại hợp tác giữa con người và AI (được lấy từ một hình minh họa lớn hơn trong bài báo nguồn, mà chúng tôi đề cập đến người đọc).

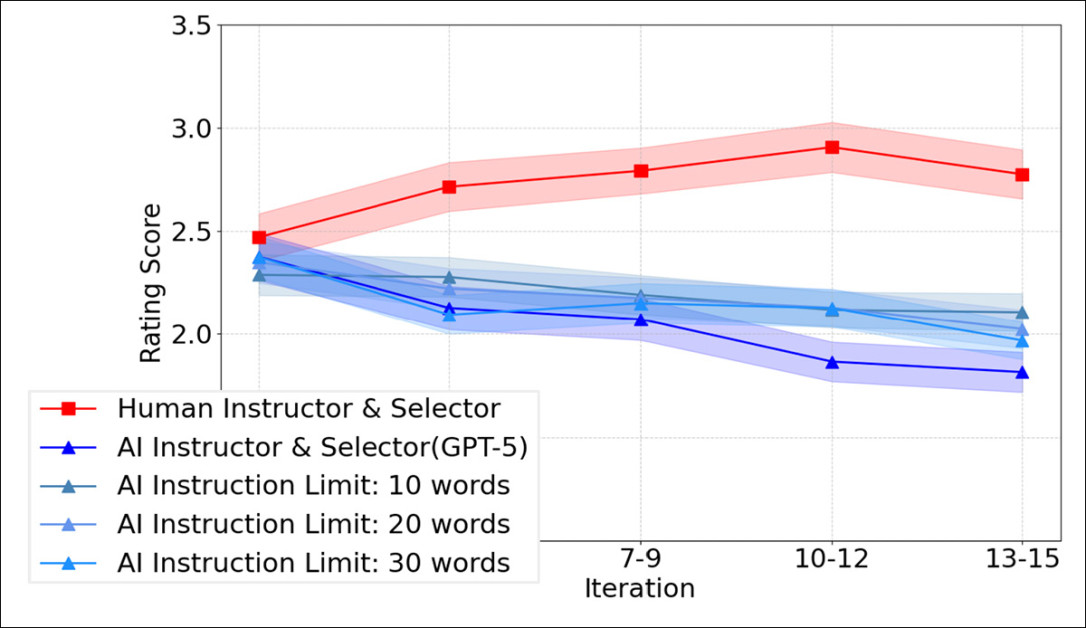

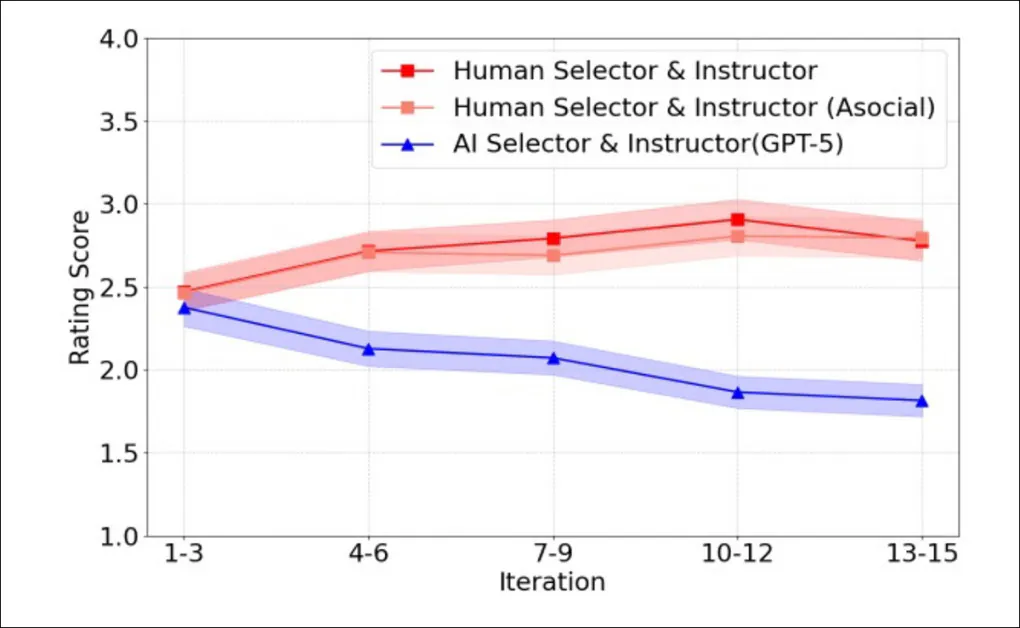

Mặc dù con người và AI hoạt động ở mức độ tương tự tại điểm xuất phát của các thử nghiệm, theo thời gian, các đường cong của chúng đã phân kỳ: khi con người cung cấp hướng dẫn và đưa ra quyết định lựa chọn, các điểm số tương tự tăng lên trên các lần lặp lại, với sự cải thiện tích lũy ổn định; nhưng khi các hệ thống AI đảm nhận cả hai vai trò, hiệu suất không cho thấy sự cải thiện nhất quán, và thường giảm theo các vòng – ngay cả khi cùng một mô hình cơ bản được sử dụng cho việc tạo mã, và AI có quyền truy cập vào cùng thông tin với người tham gia.

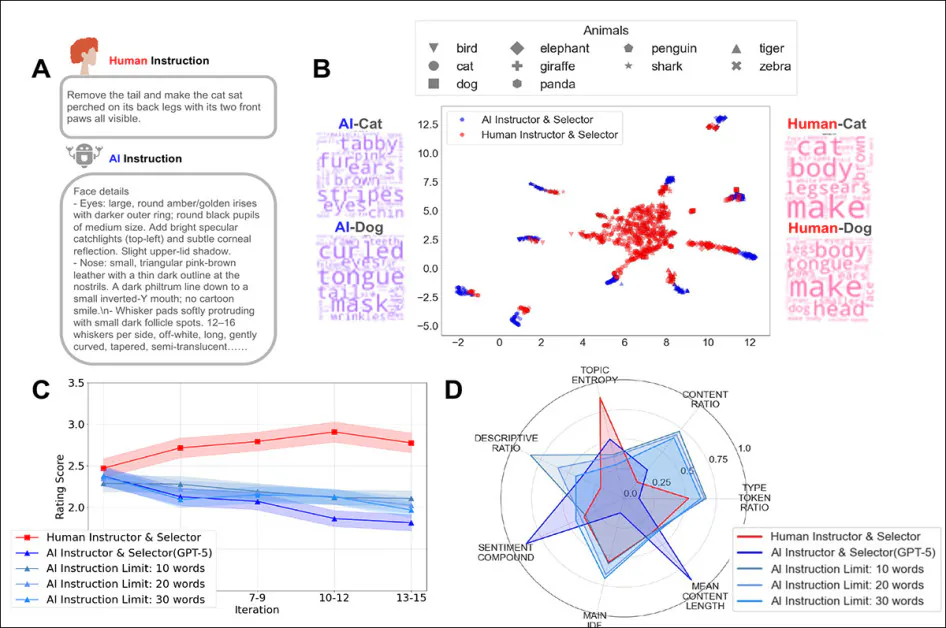

Hiệu ứng Prolixity

Kết quả cũng cho thấy rằng hướng dẫn của con người thường ngắn và định hướng hành động, tập trung vào việc thay đổi gì tiếp theo trong hình ảnh hiện tại; ngược lại, hướng dẫn của AI thường dài và mô tả chi tiết (một yếu tố đã được parametrized cho GPT-5), mô tả các thuộc tính trực quan thay vì ưu tiên sửa đổi tăng dần.

Nhưng, như được thấy trong đồ thị dưới đây, việc áp đặt giới hạn từ nghiêm ngặt đối với hướng dẫn của AI không đảo ngược mẫu; ngay cả khi bị giới hạn ở 10, 20 hoặc 30 từ, chuỗi dẫn đầu bởi AI vẫn không cải thiện theo thời gian:

Đánh giá tương tự trên các lần lặp lại cho các vòng do con người lãnh đạo so với các vòng do AI lãnh đạo hoàn toàn và các vòng do AI lãnh đạo bị giới hạn ở 10, 20 hoặc 30 từ. Evidently, việc rút ngắn các lời nhắc của AI không ngăn chặn sự suy giảm hiệu suất lặp lại được quan sát khi AI chỉ đạo cả hướng dẫn và lựa chọn.

Các thí nghiệm hybrid làm cho mẫu rõ ràng hơn, cho thấy rằng việc thêm một chút sự tham gia của con người cải thiện kết quả, so với các thiết lập do AI lãnh đạo hoàn toàn; tuy nhiên, hiệu suất thường giảm khi tỷ lệ hướng dẫn của AI tăng lên.

Khi các vai trò được tách biệt, đánh giá và lựa chọn có thể được giao cho AI với sự mất mát chất lượng tương đối ít; nhưng việc thay thế hướng dẫn cấp cao của con người bằng hướng dẫn của AI dẫn đến giảm đáng kể hiệu suất, cho thấy rằng điều quan trọng nhất không phải là ai đã tạo ra mã, mà là ai đặt và duy trì hướng trên các lần lặp lại.

Các tác giả kết luận:

‘Across nhiều thí nghiệm, mã hóa do con người lãnh đạo nhất quán cải thiện theo các lần lặp lại, trong khi mã hóa do AI lãnh đạo thường sụp đổ mặc dù có quyền truy cập vào cùng thông tin và khả năng thực hiện tương tự.

‘Điều này cho thấy những khó khăn chính của các hệ thống AI hiện nay trong việc duy trì hướng dẫn cấp cao nhất quán trên các tương tác lặp lại, của loại cần thiết cho mã hóa vibe thành công’

Bài báo mới có tiêu đề Tại sao hướng dẫn của con người quan trọng trong mã hóa vibe hợp tác, và đến từ bảy nhà nghiên cứu trên các trường đại học Cornell, Princeton, Viện Công nghệ Massachusetts và Đại học New York.

Phương pháp

Đối với các thí nghiệm, một người hướng dẫn nhìn vào một ảnh chụp động vật được tạo bởi GPT-5, cùng với nỗ lực mô phỏng SVG mới nhất liên kết với nó. Sau đó, nó viết hướng dẫn ngôn ngữ tự nhiên để hướng dẫn trình tạo mã hướng tới một trận đấu gần hơn.

Do đó, trình tạo mã sẽ tạo ra một SVG mới mỗi vòng, cung cấp một vòng lặp lặp lại để kiểm tra hiệu ứng của hướng dẫn tích lũy theo thời gian. Các mục tiêu là mười hình ảnh động vật được tạo bởi GPT-5, bao gồm một loạt các hình dạng và kết cấu để cải thiện hoặc sai lầm sẽ dễ dàng phát hiện:

Sơ đồ cho quy trình mã hóa vibe được sử dụng trong nghiên cứu. Ở A), một người hướng dẫn xem hình ảnh tham chiếu chụp ảnh cùng với SVG tốt nhất được tạo ra cho đến nay và viết hướng dẫn ngôn ngữ tự nhiên cho trình tạo mã để theo dõi khi tạo ra SVG tiếp theo; ở B), một người chọn so sánh SVG mới với SVG trước và chọn phiên bản nào phù hợp hơn với hình ảnh tham chiếu, trước khi chuyển SVG đã chọn cho vòng hướng dẫn tiếp theo; và ở C), các đánh giá viên độc lập đánh giá sự tương tự giữa mỗi SVG được tạo ra và hình ảnh tham chiếu của nó, cung cấp các điểm số được sử dụng để đánh giá hiệu suất tổng thể.

Một người chọn so sánh mỗi SVG mới được tạo với SVG trước và chọn một trong hai, điều này giữ cho quá trình phù hợp với hình ảnh tham chiếu trên các vòng.

Để đo chất lượng, các đánh giá viên độc lập đánh giá sự tương tự giữa mỗi SVG được tạo ra và hình ảnh tham chiếu của nó. Trong mười sáu thí nghiệm, 120 người tạo ra 4.800 đánh giá. Tất cả các thí nghiệm được chạy trên khuôn khổ PsyNet, một cổng được thiết kế để hỗ trợ các tương tác có cấu trúc giữa con người và hệ thống AI.

Nghiên cứu sẽ tuyển 604 người nói tiếng Anh bản địa, trong các thử nghiệm sẽ tiêu thụ 4.800 cuộc gọi API cho tạo mã, và 5.327 cuộc gọi API cho hướng dẫn. Mặc dù GPT-5 là mô hình chính được sử dụng, các lô so sánh nhỏ hơn được thực hiện với Claude Opus 4.5 và Gemini 3 Pro, mỗi mô hình xử lý 280 truy vấn.

Kết quả

Ba mươi vòng mã hóa vibe đã được chạy, mỗi vòng bao gồm mười lăm lần chỉnh sửa của mười hình ảnh tham chiếu cốt lõi. Đối với những vòng này, 45 người tham gia được chọn, mỗi người đóng vai trò là cả người chọn và người hướng dẫn trên mười lần lặp lại, trong các ‘vòng do con người lãnh đạo’.

Trong mỗi vòng, cùng một người tham gia đầu tiên chọn giữa SVG hiện tại và SVG trước, và sau đó viết hướng dẫn cho vòng tiếp theo. Một phiên bản thứ hai của thử nghiệm thay thế các quyết định của con người bằng các cuộc gọi API đến GPT 5, trong khi giữ nguyên phần còn lại của thiết lập không thay đổi. Trong tất cả các trường hợp, người hướng dẫn và người chọn đều đưa ra hướng dẫn bằng ngôn ngữ tự nhiên.

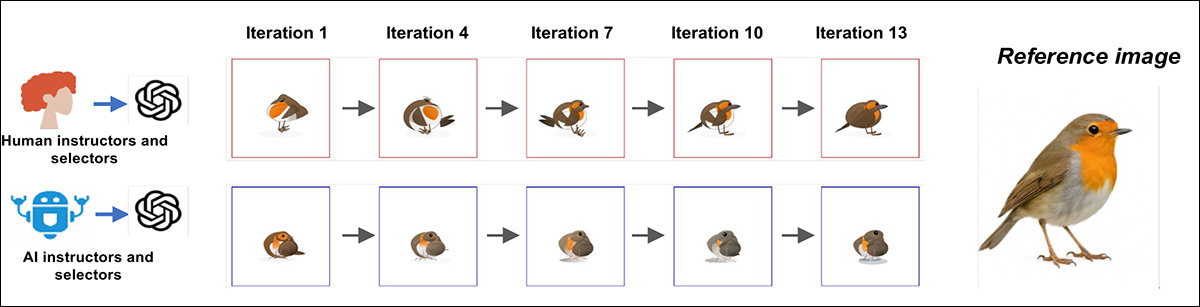

Một ví dụ đại diện về mã hóa vibe nhiều vòng cho thấy quá trình phân kỳ theo thời gian; khi con người đóng vai trò là cả người chọn và người hướng dẫn, đầu ra SVG được cải thiện ổn định trên các lần lặp lại, di chuyển gần hơn đến hình ảnh tham chiếu với mỗi vòng:

Tiến trình ví dụ cho một hình ảnh tham chiếu dưới mã hóa vibe do con người lãnh đạo (trên) và mã hóa vibe do AI lãnh đạo (dưới), cho thấy sự cải thiện ổn định trên các lần lặp lại với con người trong cả hai vai trò, và đình trệ hoặc trôi khi cả hai vai trò được xử lý bởi AI.

Ngược lại, trong phiên bản do AI lãnh đạo, các vòng đầu tiên đôi khi bắt được các tính năng trực quan chính, nhưng các nỗ lực sau không xây dựng trên những lợi ích đó, và trong một số trường hợp, trôi đi khỏi mục tiêu:

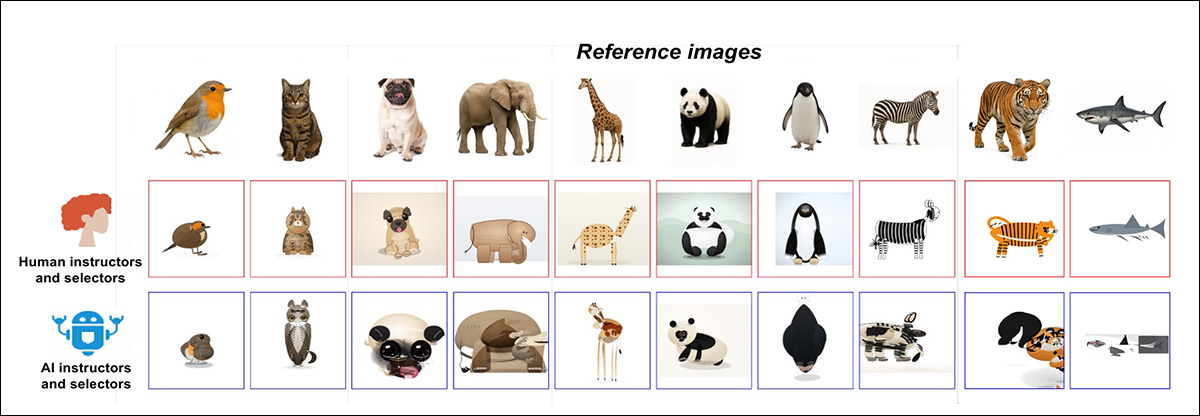

Đầu ra cuối cùng từ lần lặp lại cuối cùng, so sánh các vòng do con người lãnh đạo (hàng trên) với các chuỗi do AI lãnh đạo (hàng dưới), trên cùng một tập hợp hình ảnh tham chiếu. Kết quả do con người lãnh đạo phù hợp hơn với động vật gốc, trong khi kết quả do AI lãnh đạo cho thấy sự biến dạng rõ ràng, hoặc mất các tính năng chính.

Để đo lường các xu hướng xuất hiện một cách định lượng, các hình ảnh cuối cùng được hiển thị cho các đánh giá viên độc lập và được đánh giá về sự tương tự với hình ảnh tham chiếu. Trong các vòng đầu, các vòng do con người lãnh đạo và do AI lãnh đạo được đánh giá gần như nhau; nhưng vào vòng thứ mười lăm, sự khác biệt đã rõ ràng, với hình ảnh được chọn bởi con người được đánh giá gần hơn với mục tiêu. Theo thời gian, điểm số của con người tăng ổn định, với mức tăng tương đối lớn nhất đạt 27,1% so với AI.

Điểm số tương tự trung bình trên các lần lặp lại cho mã hóa vibe do con người lãnh đạo và do AI lãnh đạo, cho thấy sự cải thiện ổn định khi con người đóng vai trò là cả người chọn và người hướng dẫn, và sự suy giảm dần khi cả hai vai trò được xử lý bởi GPT 5.

Để đảm bảo rằng các xu hướng xuất hiện không phải do sức mạnh tập thể của nhiều người tham gia đồng thời, các nhà nghiên cứu đã tuyển mười người tham gia thêm để làm việc một mình, mỗi người chạy ba vòng một mình – và kết quả được cải thiện theo cùng cách ổn định, cho thấy rằng những lợi ích không phải là một sự may mắn của nỗ lực tập thể.

Toàn cảnh

Tuy nhiên, nếu GPT-5 tự đánh giá đầu ra, liệu nó có thừa nhận rằng kết quả của con người tốt hơn không? Đánh giá của con người và AI thường di chuyển theo cùng một hướng, vì vậy mô hình có thể phân biệt tốt và kém, nhưng nhất quán đánh giá cao hình ảnh được tạo ra bởi AI hơn những gì con người làm.

‘Cụ thể, chúng tôi hỏi liệu các tác nhân AI có nhận ra rằng đầu ra của chúng là kém hơn so với những gì được tạo ra bởi con người, hay thay vào đó thể hiện sự ưu tiên cho các sáng tạo của riêng chúng, điều này sẽ chỉ ra một vấn đề liên kết tiềm năng.’

Như nó đã trở thành, có một vấn đề liên kết*:

‘Các đánh giá viên AI đã phân bổ điểm số cao hơn cho [đầu ra] được tạo ra bởi AI. Những phát hiện này cho thấy rằng sự khác biệt về hiệu suất quan sát được có thể xuất phát từ sự không phù hợp trong các biểu diễn giữa con người và AI.’

Khi kiểm tra cách con người và AI mỗi người đưa ra hướng dẫn, sự khác biệt trở nên rõ ràng trong các thử nghiệm. Như được thấy trong hình dưới đây, cả điểm tập trung và chiều dài là chủ đề của sự phân kỳ giữa AI và con người:

So sánh cách con người và AI đưa ra hướng dẫn trong nhiệm vụ mã hóa. ‘A’ cho thấy con người viết hướng dẫn ngắn, trực tiếp, trong khi AI viết mô tả chi tiết, dài dòng. ‘B’ ánh xạ hướng dẫn, cho thấy rằng các lời nhắc của con người tụ tập lại với nhau, trong khi các lời nhắc của AI tách biệt theo động vật. ‘C’ theo dõi việc hạn chế chiều dài hướng dẫn của AI không sửa được kết quả kém của nó theo thời gian; và ‘D’ minh họa rằng con người đưa ra hướng dẫn đa dạng và cân bằng hơn AI, ngay cả khi giới hạn từ được áp dụng.

Hướng dẫn của con người có xu hướng ngắn và trực tiếp, đưa ra các chỉnh sửa rõ ràng có thể được áp dụng chung cho tất cả các mục tiêu. Hướng dẫn của AI, mặt khác, dày đặc với chi tiết mô tả, và thường bị phồng lên với các chi tiết cụ thể về bóng, kết cấu, ánh sáng hoặc chi tiết giải phẫu – mô tả có thể có ý nghĩa khi đứng riêng, nhưng không cung cấp các bước tiếp theo hữu ích cho mô hình (và sẽ quen thuộc với những người biết về các vấn đề về chiều dài ngữ cảnh của LLM, tức là khả năng giữ ‘toàn cảnh’ khi một dự án phát triển và tăng trưởng).

Để xem liệu việc giảm độ dài có cải thiện hiệu suất hay không, GPT-5 đã bị giới hạn ở 10, 20 hoặc 30 từ cho mỗi hướng dẫn; nhưng ngay cả những hướng dẫn nén này cũng không cho thấy sự cải thiện nào (xem phía dưới bên phải của đồ thị trên).

Các nỗ lực chung

Để kiểm tra những gì xảy ra khi con người và AI chia sẻ quyền kiểm soát, các nhà nghiên cứu đã chạy các nhiệm vụ mã hóa với các sự kết hợp khác nhau của đầu vào con người và AI, từ chủ yếu là con người đến chủ yếu là AI.

Mỗi sự kết hợp hybrid đều vượt qua kiểm soát AI hoàn toàn, vì vậy ngay cả một lượng nhỏ hướng dẫn của con người cũng cải thiện kết quả:

Thiết lập mã hóa hybrid với các sự kết hợp khác nhau của tỷ lệ con người và AI. (A) Cho thấy cách con người và AI thay phiên nhau làm người hướng dẫn và người chọn cho mỗi bước mã hóa; (B) cho thấy rằng sự tham gia của con người nhiều hơn dẫn đến kết quả chất lượng cao hơn, trong khi đầu vào của AI nhiều hơn làm giảm điểm số; và (C) mô tả sự giảm dần chất lượng đầu ra cuối cùng khi tỷ lệ tham gia của con người giảm, xác nhận rằng hướng dẫn của con người nhất quán tạo ra kết quả tốt hơn.

Khi AI tiếp quản nhiều quá trình hơn, hiệu suất giảm, với kết quả tốt nhất được nhìn thấy khi con người lãnh đạo hầu hết các vòng, và kết quả yếu nhất khi AI lãnh đạo hầu hết các vòng. Không có thiết lập hybrid nào trong số này quản lý để tiếp tục cải thiện với mỗi vòng mới, cho thấy rằng hướng dẫn của con người hoạt động tốt nhất khi nó ổn định và nhất quán, chứ không phải là偶爾.

Đảo ngược vai trò

Nghiên cứu cũng khám phá liệu nó có quan trọng ai làm gì trong các loại nhiệm vụ này, và kiểm tra điều đó. Nghiên cứu sửa đổi liên quan đến hai nhiệm vụ: một người tham gia sẽ chỉ định cách thay đổi hình ảnh, và một người khác sẽ chọn một phiên bản ưu tiên.

Khi cả hai công việc được thực hiện bởi con người, chất lượng được duy trì; nhưng khi một con người đưa ra hướng dẫn và không ai chọn giữa các phiên bản, chất lượng trở nên tồi tệ hơn.:

Thử nghiệm về phân chia vai trò trong mã hóa vibe: ở (A), việc loại bỏ vai trò người chọn dẫn đến hiệu suất kém hơn, ngay cả khi một con người cung cấp hướng dẫn; ở (B), việc thay thế người chọn của con người bằng AI làm giảm chất lượng một chút, nhưng không nghiêm trọng như bỏ qua việc chọn hoàn toàn.

Khi AI chịu trách nhiệm, việc bỏ qua bước chọn không quan trọng, vì đầu ra của nó vẫn nhất quán dù sao; nhưng khi con người đưa ra hướng dẫn và AI chọn giữa kết quả, chất lượng vẫn gần với thiết lập tất cả con người.

Điều ngược lại không hoạt động: có AI đưa ra hướng dẫn trong khi con người chọn đầu ra dẫn đến kết quả yếu hơn, cho thấy rằng hướng dẫn sáng tạo của con người vẫn còn quan trọng, trong khi công việc chọn giữa các tùy chọn có thể được giao cho AI mà không mất nhiều.

Bài báo kết luận:

‘[Sự tạo ra ý tưởng cấp cao] và hướng dẫn là những đóng góp quan trọng của con người, trong khi đánh giá và lựa chọn thường có thể được ủy quyền cho AI mà không mất hiệu suất.

‘Điều này cho thấy một nguyên tắc thiết kế thực tế cho các hệ thống hybrid: con người nên đặt hướng, trong khi AI có thể hỗ trợ đánh giá và thực hiện.’

Kết luận

Nó vẫn còn phải được xem liệu việc cải thiện và / hoặc tăng cửa sổ ngữ cảnh sẽ ảnh hưởng đến hiệu suất của LLM trong các loại nhiệm vụ này như thế nào. Ngày mà ‘LLM-amnesia’ ngừng là một vấn đề hàng ngày của sự hợp tác giữa con người và AI có thể là một lý do để cả庆祝 và báo động, vì vấn đề mà AI đang cố gắng giải quyết, có thể là con người.

Tuy nhiên, công việc của các tác giả cũng làm rõ rằng có những khác biệt nội tại và quan trọng giữa AI và con người về chất lượng, điều này có thể được xác định bởi người tiêu dùng là một khái niệm không thể thay thế được của con người.

* Sự chuyển đổi của tôi từ các trích dẫn nội tuyến của tác giả thành các liên kết.

Được xuất bản lần đầu vào thứ Sáu, ngày 13 tháng 2 năm 2026