Trí tuệ nhân tạo

Tăng cường Graph Neural Networks với Large Language Models: Hướng dẫn cuối cùng

Các đồ thị là cấu trúc dữ liệu đại diện cho các mối quan hệ phức tạp trong nhiều lĩnh vực, bao gồm mạng xã hội, cơ sở tri thức, hệ thống sinh học và nhiều hơn nữa. Trong các đồ thị này, các thực thể được biểu diễn dưới dạng nút và mối quan hệ của chúng được mô tả dưới dạng cạnh.

Khả năng đại diện và推 lý hiệu quả về các cấu trúc quan hệ phức tạp này là rất quan trọng để thúc đẩy tiến bộ trong các lĩnh vực như khoa học mạng, hóa sinh và hệ thống khuyến nghị.

Graph Neural Networks (GNNs) đã xuất hiện như một khuôn khổ học sâu mạnh mẽ cho các nhiệm vụ học máy đồ thị. Bằng cách tích hợp cấu trúc đồ thị vào kiến trúc mạng nơ-ron thông qua sự tổng hợp lân cận hoặc đồ thị convolution, GNNs có thể học các biểu diễn vector chiều thấp mã hóa cả tính năng nút và vai trò cấu trúc của chúng. Điều này cho phép GNNs đạt được hiệu suất tốt nhất trong các nhiệm vụ như phân loại nút, dự đoán liên kết và phân loại đồ thị trên nhiều lĩnh vực ứng dụng khác nhau.

Mặc dù GNNs đã thúc đẩy tiến bộ đáng kể, một số thách thức chính vẫn còn. Việc thu được dữ liệu nhãn chất lượng cao để đào tạo các mô hình GNN giám sát có thể tốn kém và mất thời gian. Ngoài ra, GNNs có thể gặp khó khăn với cấu trúc đồ thị dị hình và tình huống mà phân phối đồ thị tại thời điểm thử nghiệm khác biệt đáng kể so với dữ liệu đào tạo (tổng quát hóa ngoài phân phối).

Song song, Large Language Models (LLMs) như GPT-4 và LLaMA đã làm nên lịch sử với khả năng hiểu và tạo ngôn ngữ tự nhiên đáng kinh ngạc. Được đào tạo trên các tập dữ liệu văn bản lớn với hàng tỷ tham số, LLMs thể hiện khả năng học vài lần, tổng quát hóa trên các nhiệm vụ và kỹ năng推 lý thông thường mà trước đây được coi là rất thách thức đối với các hệ thống AI.

Sự thành công đáng kể của LLMs đã kích thích việc khám phá khả năng tận dụng sức mạnh của chúng cho các nhiệm vụ học máy đồ thị. Một mặt, khả năng tri thức và推 lý của LLMs mang lại cơ hội để nâng cao các mô hình GNN truyền thống. Ngược lại, các biểu diễn cấu trúc và kiến thức thực tế vốn có trong đồ thị có thể là công cụ quan trọng để giải quyết một số hạn chế chính của LLMs, chẳng hạn như ảo giác và thiếu khả năng giải thích.

Graph Neural Networks và Học tự giám sát

Để cung cấp ngữ cảnh cần thiết, chúng tôi sẽ xem xét ngắn gọn các khái niệm và phương pháp cốt lõi trong graph neural networks và học biểu diễn đồ thị tự giám sát.

Kiến trúc Graph Neural Network

Kiến trúc Graph Neural Network – nguồn

Sự khác biệt chính giữa mạng nơ-ron truyền thống và GNNs nằm ở khả năng hoạt động trực tiếp trên dữ liệu cấu trúc đồ thị. GNNs tuân theo một sơ đồ tổng hợp lân cận, trong đó mỗi nút tổng hợp vector tính năng từ các nút lân cận để tính toán biểu diễn của nó.

Nhiều kiến trúc GNN đã được đề xuất với các phiên bản khác nhau của hàm tin nhắn và cập nhật, chẳng hạn như Graph Convolutional Networks (GCNs), GraphSAGE, Graph Attention Networks (GATs) và Graph Isomorphism Networks (GINs) trong số các kiến trúc khác.

Gần đây, các biến thể đồ thị của transformer đã trở nên phổ biến bằng cách thích nghi cơ chế tự chú ý từ transformer ngôn ngữ tự nhiên để hoạt động trên dữ liệu cấu trúc đồ thị. Một số ví dụ bao gồm GraphormerTransformer và GraphFormers. Những mô hình này có khả năng bắt được sự phụ thuộc dài hạn trên đồ thị tốt hơn so với GNNs thuần túy dựa trên lân cận.

Học tự giám sát trên Đồ thị

Mặc dù GNNs là các mô hình biểu diễn mạnh mẽ, hiệu suất của chúng thường bị hạn chế bởi sự thiếu dữ liệu nhãn lớn cần thiết cho đào tạo giám sát. Học tự giám sát đã xuất hiện như một khuôn khổ đầy hứa hẹn để tiền đào tạo GNNs trên dữ liệu đồ thị không nhãn bằng cách tận dụng các nhiệm vụ tiền đề chỉ yêu cầu cấu trúc đồ thị nội tại và tính năng nút.

Một số nhiệm vụ tiền đề phổ biến được sử dụng để tiền đào tạo GNN bao gồm:

- Dự đoán Thuộc tính Nút: Ngẫu nhiên che giấu hoặc làm hỏng một phần thuộc tính của nút và yêu cầu GNN tái tạo chúng.

- Dự đoán Liên kết/Cạnh: Học để dự đoán liệu có một cạnh giữa một cặp nút, thường dựa trên việc che giấu ngẫu nhiên cạnh.

- Học Đối lập: Tối đa hóa sự tương đồng giữa các biểu diễn đồ thị của cùng một mẫu đồ thị trong khi đẩy các biểu diễn từ các đồ thị khác nhau.

- Tối đa Hóa Thông tin Đôi: Tối đa hóa thông tin đôi giữa các biểu diễn nút cục bộ và một biểu diễn mục tiêu như biểu diễn nhúng đồ thị toàn cầu.

Các nhiệm vụ tiền đề như vậy cho phép GNN trích xuất các mẫu cấu trúc và ngữ nghĩa có ý nghĩa từ dữ liệu đồ thị không nhãn trong quá trình tiền đào tạo. GNN đã được tiền đào tạo sau đó có thể được tinh chỉnh trên các tập dữ liệu nhãn nhỏ để đạt được hiệu suất vượt trội trên các nhiệm vụ như phân loại nút, dự đoán liên kết và phân loại đồ thị.

Bằng cách tận dụng giám sát tự, GNNs được tiền đào tạo trên các tập dữ liệu lớn không nhãn thể hiện sự tổng quát hóa, độ bền và hiệu quả tốt hơn so với đào tạo từ đầu. Tuy nhiên, một số hạn chế chính của các phương pháp tự giám sát GNN truyền thống vẫn còn, mà chúng tôi sẽ khám phá để tận dụng LLMs trong phần tiếp theo.

Nâng cao Graph ML với Large Language Models

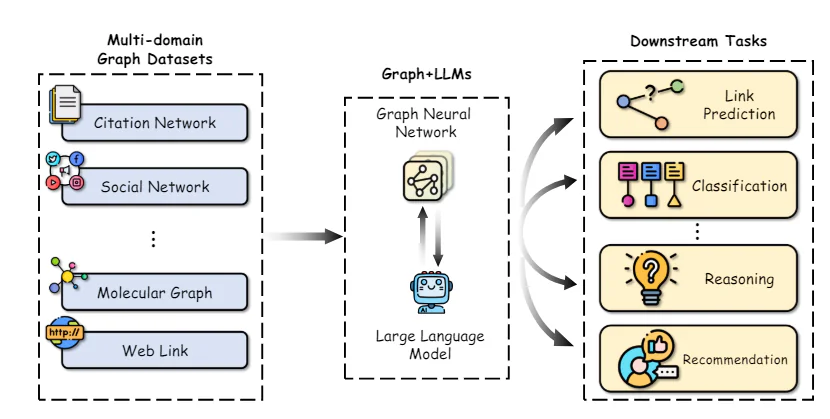

Tích hợp Đồ thị và LLM – nguồn

Khả năng hiểu ngôn ngữ tự nhiên đáng kinh ngạc,推 lý và học vài lần của LLMs mang lại cơ hội để nâng cao nhiều khía cạnh của các đường ống học máy đồ thị. Chúng tôi khám phá một số hướng nghiên cứu chính trong không gian này:

Một thách thức chính khi áp dụng GNNs là thu được các biểu diễn tính năng chất lượng cao cho các nút và cạnh, đặc biệt khi chúng chứa các thuộc tính văn bản phong phú như mô tả, tiêu đề hoặc tóm tắt. Truyền thống, các mô hình nhúng từ và bag-of-words đơn giản hoặc các mô hình nhúng từ tiền đào tạo thường được sử dụng, những mô hình này thường không thể bắt được ngữ nghĩa tinh vi.

Các công trình gần đây đã chứng minh sức mạnh của việc tận dụng các mô hình ngôn ngữ lớn như các bộ mã hóa văn bản để xây dựng các biểu diễn tính năng nút/lân cận tốt hơn trước khi truyền chúng đến GNN. Ví dụ, Chen et al. sử dụng LLMs như GPT-3 để mã hóa thuộc tính văn bản của nút, cho thấy sự tăng hiệu suất đáng kể so với các mô hình nhúng từ truyền thống trên các nhiệm vụ phân loại nút.

Ngoài việc mã hóa văn bản tốt hơn, LLMs có thể được sử dụng để tạo thông tin tăng cường từ các thuộc tính văn bản ban đầu theo cách bán giám sát. TAPE tạo ra các nhãn/nhận xét tiềm năng cho các nút sử dụng LLM và sử dụng chúng làm các tính năng tăng cường bổ sung. KEA trích xuất các thuật ngữ từ thuộc tính văn bản sử dụng LLM và thu được các mô tả chi tiết cho các thuật ngữ này để tăng cường tính năng.

Bằng cách cải thiện chất lượng và khả năng biểu diễn của tính năng đầu vào, LLMs có thể truyền đạt khả năng hiểu ngôn ngữ tự nhiên vượt trội của chúng cho GNNs, tăng hiệu suất trên các nhiệm vụ hạ nguồn.