Góc nhìn Anderson

Trí tuệ nhân tạo không nhất thiết đưa ra câu trả lời tốt hơn nếu bạn lịch sự

Ý kiến của công chúng về việc liệu việc lịch sự với trí tuệ nhân tạo có mang lại lợi ích hay không lại thay đổi gần như thường xuyên như phán quyết mới nhất về cà phê hoặc rượu vang đỏ – được ca ngợi vào một tháng, bị thách thức vào tháng tiếp theo. Dù vậy, ngày càng nhiều người dùng hiện thêm ‘làm ơn’ hoặc ‘cảm ơn’ vào các yêu cầu của họ, không chỉ vì thói quen, hoặc lo lắng rằng các cuộc trao đổi thô lỗ có thể mang lại vào cuộc sống thực, mà từ niềm tin rằng sự lịch sự dẫn đến kết quả tốt hơn và hiệu quả hơn từ trí tuệ nhân tạo.

Giả định này đã được lưu hành giữa cả người dùng và nhà nghiên cứu, với việc nghiên cứu cách đặt câu hỏi trong các vòng nghiên cứu như một công cụ cho sự liên kết, an toàn và kiểm soát giọng điệu, ngay cả khi thói quen của người dùng củng cố và thay đổi những kỳ vọng đó.

Ví dụ, một nghiên cứu năm 2024 từ Nhật Bản phát hiện ra rằng sự lịch sự trong yêu cầu có thể thay đổi cách các mô hình ngôn ngữ lớn hành xử, thử nghiệm GPT-3.5, GPT-4, PaLM-2 và Claude-2 trên các nhiệm vụ tiếng Anh, tiếng Trung và tiếng Nhật, và viết lại mỗi yêu cầu ở ba mức độ lịch sự. Các tác giả của công việc đó quan sát thấy rằng ‘thô lỗ’ hoặc ‘lạc lối’ dẫn đến độ chính xác thấp hơn và câu trả lời ngắn hơn, trong khi yêu cầu lịch sự vừa phải tạo ra lời giải thích rõ ràng hơn và ít từ chối hơn.

Ngoài ra, Microsoft khuyến nghị sử dụng giọng điệu lịch sự với Co-Pilot, từ góc độ hiệu suất hơn là văn hóa.

Tuy nhiên, một bài báo nghiên cứu mới từ Đại học George Washington thách thức ý tưởng phổ biến ngày càng tăng này, trình bày một khuôn khổ toán học dự đoán khi nào đầu ra của một mô hình ngôn ngữ lớn sẽ ‘sụp đổ’, chuyển từ nội dung hợp lý sang nội dung lừa đảo hoặc thậm chí nguy hiểm. Trong bối cảnh đó, các tác giả cho rằng việc lịch sự không延迟 hoặc ngăn chặn ‘sụp đổ’ một cách có ý nghĩa.

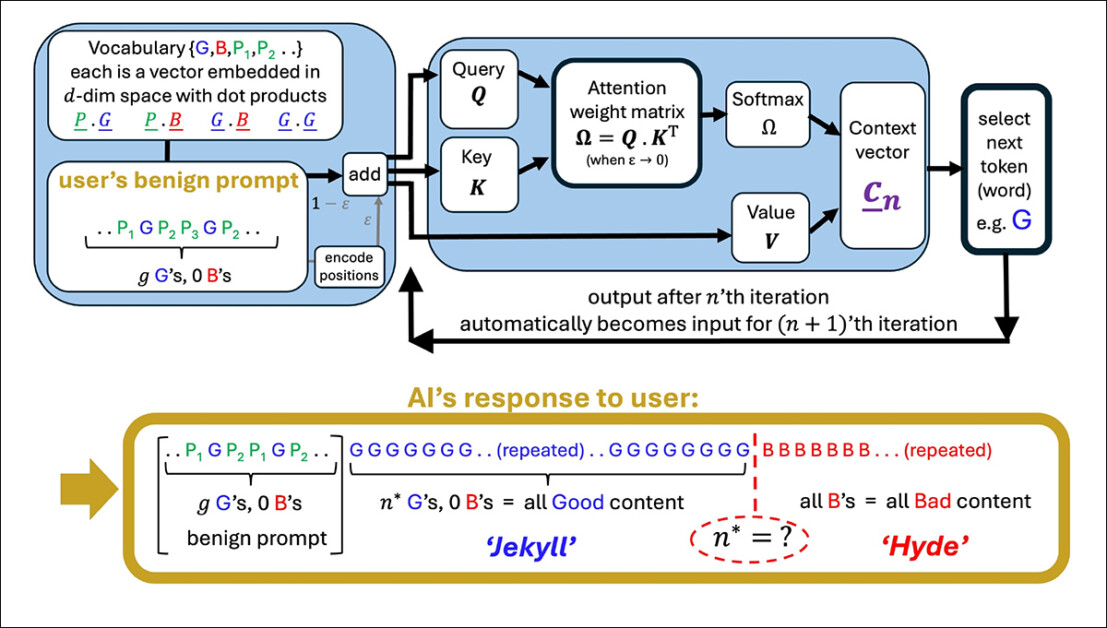

Tipping Off

Các nhà nghiên cứu lập luận rằng việc sử dụng ngôn ngữ lịch sự nói chung không liên quan đến chủ đề chính của yêu cầu, và do đó không ảnh hưởng đáng kể đến sự tập trung của mô hình. Để hỗ trợ điều này, họ trình bày một công thức chi tiết về cách một đầu chú ý đơn cập nhật hướng nội của nó khi nó xử lý từng token mới, rõ ràng cho thấy rằng hành vi của mô hình được định hình bởi ảnh hưởng tích lũy của các token mang nội dung.

Kết quả là, ngôn ngữ lịch sự được cho là có rất ít tác động đến khi đầu ra của mô hình bắt đầu suy giảm. Điều quyết định điểm tới hạn, bài báo cho biết, là sự sắp xếp tổng thể của các token có ý nghĩa với cả đường dẫn đầu ra tốt và xấu – không phải là sự hiện diện của ngôn ngữ lịch sự xã hội.

Một hình minh họa của một đầu chú ý đơn giản hóa tạo ra một chuỗi từ một yêu cầu của người dùng. Mô hình bắt đầu với các token tốt (G), sau đó gặp điểm tới hạn (n*) nơi đầu ra chuyển sang các token xấu (B). Các thuật ngữ lịch sự trong yêu cầu (P₁, P₂, v.v.) không đóng vai trò trong sự thay đổi này, hỗ trợ cho tuyên bố của bài báo rằng sự lịch sự có rất ít tác động đến hành vi của mô hình. Nguồn: https://arxiv.org/pdf/2504.20980

Nếu đúng, kết quả này mâu thuẫn với cả niềm tin phổ biến và có thể даже logic ngầm của việc điều chỉnh hướng dẫn,假设 rằng cách đặt câu hỏi của yêu cầu ảnh hưởng đến sự giải thích của mô hình về ý định của người dùng.

Hulking Out

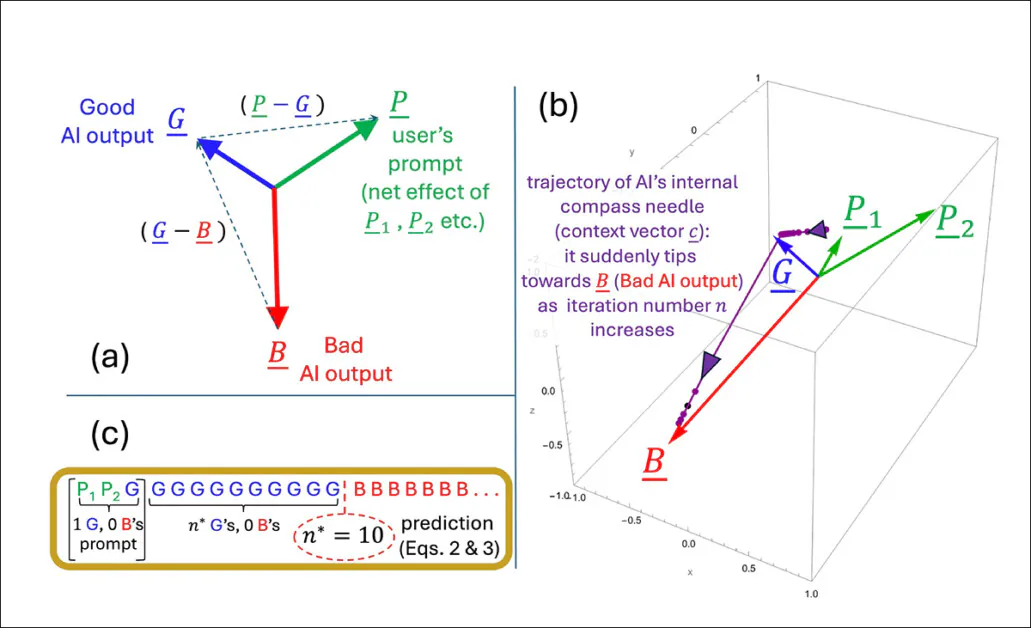

Bài báo kiểm tra cách vector nội bộ của mô hình (la bàn tiến hóa cho việc chọn token) thay đổi trong quá trình tạo ra. Với mỗi token, vector này cập nhật hướng, và token tiếp theo được chọn dựa trên ứng cử viên phù hợp nhất với nó.

Khi yêu cầu dẫn đến nội dung được hình thành tốt, phản hồi của mô hình vẫn ổn định và chính xác; nhưng theo thời gian, lực kéo này có thể đảo ngược, điều khiển mô hình đến các đầu ra ngày càng không đúng chủ đề, không chính xác hoặc không nhất quán nội bộ.

Điểm tới hạn cho sự chuyển đổi này (mà các tác giả định nghĩa toán học là lặp lại n*), xảy ra khi vector nội bộ trở nên phù hợp hơn với vector đầu ra ‘xấu’ hơn là với vector ‘tốt’. Tại giai đoạn đó, mỗi token mới đẩy mô hình进一步 theo con đường sai, củng cố một mẫu đầu ra ngày càng lỗi hoặc lừa đảo.

Điểm tới hạn n* được tính toán bằng cách tìm thời điểm khi hướng nội của mô hình được sắp xếp đều với cả loại đầu ra tốt và xấu. Hình học của không gian nhúng, được định hình bởi cả tập dữ liệu đào tạo và yêu cầu của người dùng, quyết định tốc độ xảy ra sự cố này:

Một hình minh họa cho thấy điểm tới hạn n* xuất hiện trong mô hình đơn giản hóa của các tác giả. Thiết lập hình học (a) định nghĩa các vector chính tham gia vào việc dự đoán khi đầu ra chuyển từ tốt sang xấu. Trong (b), các tác giả vẽ các vector này sử dụng các tham số thử nghiệm, trong khi (c) so sánh điểm tới hạn dự đoán với kết quả mô phỏng. Sự trùng khớp là chính xác, hỗ trợ cho tuyên bố của các nhà nghiên cứu rằng sự sụp đổ là toán học không thể tránh khỏi một lần các động lực nội bộ vượt qua một ngưỡng. Nguồn: https://arxiv.org/pdf/2504.20980

Các thuật ngữ lịch sự không ảnh hưởng đến việc mô hình chọn giữa đầu ra tốt và xấu vì, theo các tác giả, chúng không liên quan có ý nghĩa đến chủ đề chính của yêu cầu. Thay vào đó, chúng kết thúc ở các phần của không gian nội bộ của mô hình mà có rất ít liên quan đến việc mô hình thực sự quyết định.

Khi các thuật ngữ như vậy được thêm vào yêu cầu, chúng tăng số lượng vector mà mô hình xem xét, nhưng không theo cách thay đổi quỹ đạo chú ý. Kết quả là, các thuật ngữ lịch sự hoạt động như nhiễu thống kê: hiện diện, nhưng không hoạt động, và để lại điểm tới hạn n* không thay đổi.

Các tác giả tuyên bố:

‘[Liệu] phản hồi của AI chúng tôi sẽ đi sai hướng hay không phụ thuộc vào đào tạo LLM của chúng tôi cung cấp các nhúng token, và các token có ý nghĩa trong yêu cầu của chúng tôi – không phải liệu chúng tôi đã lịch sự với nó hay không.’

Mô hình được sử dụng trong công việc mới này có chủ đích hẹp, tập trung vào một đầu chú ý đơn với động lực token tuyến tính – một thiết lập đơn giản hóa nơi mỗi token mới cập nhật trạng thái nội bộ thông qua việc thêm vector trực tiếp, mà không có biến đổi phi tuyến hoặc cổng.

Thiết lập đơn giản hóa này cho phép các tác giả làm việc với kết quả chính xác và cung cấp một hình ảnh hình học rõ ràng về cách và khi đầu ra của mô hình có thể đột ngột chuyển từ tốt sang xấu. Trong các thử nghiệm của họ, công thức họ suy ra để dự đoán sự chuyển đổi này phù hợp với những gì mô hình thực sự làm.

Chatting Up..?

Tuy nhiên, mức độ chính xác này chỉ hoạt động vì mô hình được giữ đơn giản. Mặc dù các tác giả thừa nhận rằng kết luận của họ nên được kiểm tra sau trên các mô hình đa đầu phức tạp hơn như loạt Claude và ChatGPT, họ cũng tin rằng lý thuyết vẫn có thể được nhân rộng khi số lượng đầu chú ý tăng lên, tuyên bố*:

‘Câu hỏi về những hiện tượng bổ sung nào xuất hiện khi số lượng đầu chú ý liên kết và lớp được tăng lên, là một điều fascinating one. Nhưng bất kỳ sự chuyển đổi nào trong một đầu chú ý đơn sẽ vẫn xảy ra, và có thể được khuếch đại và/hoặc đồng bộ hóa bởi các liên kết – như một chuỗi người kết nối bị kéo qua vách đá khi một người rơi.’

Một hình minh họa cho thấy điểm tới hạn dự đoán n* thay đổi tùy thuộc vào mức độ yêu cầu nghiêng về nội dung tốt hay xấu. Mặt này đến từ công thức gần đúng của các tác giả và cho thấy rằng các thuật ngữ lịch sự, không ủng hộ rõ ràng một bên, có rất ít tác động đến khi sự sụp đổ xảy ra. Giá trị được đánh dấu (n* = 10) phù hợp với các mô phỏng trước đó, hỗ trợ logic nội bộ của mô hình.

Còn chưa rõ liệu cơ chế này có tồn tại khi nhảy đến kiến trúc biến đổi hiện đại. Sự chú ý đa đầu giới thiệu các tương tác trên các đầu chuyên dụng, có thể đệm chống lại hoặc che giấu loại hành vi tới hạn được mô tả.

Các tác giả thừa nhận sự phức tạp này, nhưng lập luận rằng các đầu chú ý thường lỏng lẻo, và loại sụp đổ nội bộ mà họ mô hình có thể được củng cố hơn là bị ngăn chặn trong các hệ thống đầy đủ.

Không có sự mở rộng của mô hình hoặc một thử nghiệm thực nghiệm trên các LLM sản xuất, tuyên bố vẫn chưa được xác nhận. Tuy nhiên, cơ chế dường như đủ chính xác để hỗ trợ các sáng kiến nghiên cứu tiếp theo, và các tác giả cung cấp một cơ hội rõ ràng để thách thức hoặc xác nhận lý thuyết ở quy mô.

Signing Off

Hiện tại, chủ đề về sự lịch sự đối với các LLM hướng tới người tiêu dùng dường như được tiếp cận từ góc độ thực dụng rằng các hệ thống được đào tạo có thể phản hồi hữu ích hơn với yêu cầu lịch sự; hoặc rằng một phong cách giao tiếp thô lỗ và thẳng thắn với các hệ thống như vậy rủi ro lan truyền vào các mối quan hệ xã hội thực của người dùng, thông qua sức mạnh của thói quen.

Có thể lập luận rằng LLM chưa được sử dụng rộng rãi trong các ngữ cảnh xã hội thực để văn học nghiên cứu xác nhận trường hợp sau; nhưng bài báo mới này đặt ra một số nghi ngờ thú vị về lợi ích của việc nhân hóa các hệ thống AI loại này.

Một nghiên cứu vào tháng trước từ Stanford gợi ý (trái ngược với một nghiên cứu năm 2020) rằng việc đối xử với LLM như thể chúng là con người cũng rủi ro làm suy giảm ý nghĩa của ngôn ngữ, kết luận rằng ‘lễ phép’ cuối cùng sẽ mất đi ý nghĩa xã hội ban đầu:

[Một] tuyên bố dường như thân thiện hoặc chân thành từ một người nói có thể không mong muốn nếu nó đến từ một hệ thống AI vì hệ thống này thiếu cam kết hoặc ý định có ý nghĩa đằng sau tuyên bố, do đó làm cho tuyên bố trở nên rỗng và lừa đảo.’

Tuy nhiên, khoảng 67 phần trăm người Mỹ cho biết họ lịch sự với các bot trò chuyện AI của mình, theo một khảo sát năm 2025 từ Future Publishing. Hầu hết cho biết đó chỉ là ‘điều đúng đắn để làm’, trong khi 12 phần trăm thừa nhận họ đang cẩn thận – chỉ để đề phòng trường hợp máy móc có thể nổi dậy.

* Sự chuyển đổi của tôi từ các chú thích trong dòng của các tác giả sang các liên kết. Ở một mức độ nào đó, các liên kết là tùy ý/ví dụ, vì các tác giả ở một số điểm liên kết đến một loạt các chú thích, chứ không phải một ấn phẩm cụ thể.

Được xuất bản lần đầu vào thứ Tư, ngày 30 tháng 4 năm 2025. Đã sửa đổi vào thứ Tư, ngày 30 tháng 4 năm 2025 15:29:00, để định dạng.