Yapay Zekâ

Yarışmalar AI’yi Test Etmek için Yeni Standard Haline Geliyor

Yıllarca, ImageNet gibi bilgisayar vizyonu ve GLUE gibi doğal dil işleme için kullanılan referans noktaları, AI’yi değerlendirmek için ana araçlar olarak kullanıldı. AI’nin ilerlemesini takip etmek ve farklı modelleri karşılaştırmak için basit bir yol sunuyorlardı. Ancak AI sistemleri geliştikçe, bu referans noktalarının çoğu doygunluğa ulaştı ve modeller insan düzeyindeki performansı eşledi veya hatta geçti. Bu zorluk, AI’nin yeteneklerini daha iyi test edebilecek yeni yöntemlere olan ihtiyacı ortaya çıkardı. Bu zorluğa yanıt olarak, araştırmacılar AI’yi değerlendirmek için alternatif bir yol olarak yarışmalara yöneldiler. Sabit veri kümelerine güvenmek yerine, AI modelleri şimdi satranç gibi masa oyunları, kodlama yarışmaları, matematik olimpiyatları, eSpor ve robotik yarışmaları gibi ortamlarda değerlendiriliyor. Bu ortamlarda, modeller yeni sorunlara ve rakiplere karşı uyum sağlamak, neden olmak ve stratejiler geliştirmek zorundalar. Bu makale, geleneksel referans noktalarının sınırlılıklarını inceliyor ve yarışmaların AI’yi değerlendirmek için yeni bir standard olarak ortaya çıktığını vurguluyor.

Geleneksel Referans Noktalarının Neden Yetersiz Olduğu

Geleneksel referans noktaları on yıllarca AI gelişimini yönlendirdi. AI modellerinin performansını karşılaştırmak için standartlaştırılmış bir yol sunuyorlar. Bu veri kümeleri, net hedefleri olan sabit girişleri içeriyordu, bu da araştırmacıların farklı yaklaşımları basit bir şekilde karşılaştırmalarına olanak tanıyordu. Daha iyi performans gösteren bir model daha yetenekli olarak kabul ediliyordu.

Ancak AI sistemleri daha güçlü hale geldikçe, bu referans noktaları temel sınırlılıkları ortaya çıkardı. En açık sorun, referans noktası doygunluğudur. Modeller mükemmel veya neredeyse mükemmel puanlar elde ettiğinde, test daha güçlü ve daha zayıf modeller arasında ayrım yapma yeteneğini kaybeder. Çalışmalar, birçok referans noktasının nhanh bir şekilde doygunluğa ulaştığını ve bu eğilimin son yıllarda daha da yaygın hale geldiğini gösteriyor.

Veri kirlenmesi başka bir zorunluluk oluşturuyor. Birçok referans noktası örneği çevrimiçi olarak mevcut ve eğitim veri kümelerine dahil edilmiş olabilir. Bir model bir sorunu çözdüğünde, eğitim sırasında gördüğü bir cevabı hatırlıyor olabilir. Bu, gerçek nedenleme yeteneğini göstermeden zeka izlenimi yaratıyor.

Bazı araştırmacılar bunu insan değerlendirmesi kullanarak çözmeye çalıştı. İnsan değerlendirmesi nüans ekler, ancak öznelilik ve önyargı da getirir. Bu değerlendirmeler ayrıca zaman alıcı, pahalı ve çoklu model boyunca ölçeklendirme açısından zor. Bu sınırlamalar, hızla gelişen AI yetenekleriyle birlikte ilerleyebilecek değerlendirme yöntemlerine olan acil ihtiyacı ortaya çıkardı.

Yarışmaların Daha İyi Bir Yaklaşım Sunduğu

Yarışmalar, geleneksel referans noktalarının birçok eksikliğini gideren dinamik bir test ortamı sunar. Açık kurallar, tanımlı hedefler ve subjektif yorumlamaya bağlı olmayan ölçülebilir sonuçlar sağlar. Başarı, herkesin doğrulayabileceği şeffaf sonuçlarla belirlenir.

Yarışmaların en önemli avantajı, zorluğun doğal olarak ölçeklenmesidir. AI geliştikçe, zorluklar otomatik olarak artar. Oyunlarda daha güçlü modeller daha sofistike rakiplerle karşılaşır. Matematik yarışmalarında sorunların karmaşıklığı artar. Kodlama yarışmalarında algoritmik zorluklar daha talepkar hale gelir. Bu self-ölçekli özellik, teknoloji ilerledikçe değerlendirme kalitesini korur.

Yarışmaların Getirdiği Örnekler

AI’yi yarışmalar aracılığıyla değerlendirmek yeni bir fikir değil. 2016’da DeepMind’in AlphaGo’su, Go dünya şampiyonu Lee Sedol’u yendi ve halefi AlphaZero, satrançta bilgisayar şampiyonu Stockfish’i yendi. eSpor’da OpenAI’nin Dota 2 sistemi (OpenAI Five) 2019’da dünya şampiyonu takımını yendi, DeepMind’in AlphaStar ise StarCraft II’de Grandmaster statüsüne ulaştı. Bu zaferler, AI sistemlerinin yüksek stratejik ve gerçek zamanlı ortamlarda uyum sağlayabildiğini ve başarılı olabileceğini gösterdi.

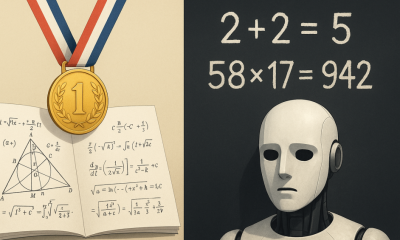

Son yıllarda, araştırmacılar akademik yarışmalar için AI modelleri geliştirdiler. Aslında, Google DeepMind ve OpenAI sistemleri, Uluslararası Matematik Olimpiyatı’nda altın madalya standardına ulaştı. Programlamada AlphaCode, yeni Codeforces sorunlarını ele aldı ve insan rakiplerinin ortalamasına yakın bir performans gösterdi. Bu sonuçlar, AI sistemlerinin olimpiyat tarzında akıl yürütme yarışmalarında rekabetçi performans gösterebileceğini vurguladı.

Robotik yarışmaları da benzer bir yaklaşımı takip ediyor. RoboCup, DARPA yarışmaları ve XPrize görevleri, ekiplerin gerçek dünya ortamlarında çalışan ajanlar geliştirmelerini gerektiriyor, bunlar futbol oynayan robotlardan otonom araçlara kadar çeşitleniyor. Bu yarışma formatları, ilerlemeyi ölçülebilir kılıyor ve sistemler arasında doğrudan karşılaştırma yapılmasına olanak tanıyor.

Yarışma Tabanlı Testin Ne Gösterdiği

Yarışmalar, geleneksel referans noktalarının genellikle kaçırdığı zeka yönlerini ortaya çıkarıyor. Genelleme yeteneği, AI’nin daha önce karşılaşmadığı yeni zorluklarla karşılaştığında hemen anlaşılıyor. Benchmark’lerin aksine, yarışmalar sürekli olarak yeni senaryolar sunuyor ve gerçek problem çözme becerileri gerektiriyor.

Yaratıcı akıl yürütme, özellikle matematik ve bilim yarışmalarında kritik bir faktör olarak ortaya çıkıyor. AI, daha önce görmediği bir sorunu çözmek için orijinal içgörüler üretmeli ve yeni argümanlar oluşturmalıdır. Bu yaratıcılık, sabit veri kümeleri üzerinde modelleme yoluyla ölçülemiyor.

Uyum yeteneği, tüm rekabetçi alanların temel bir yönü. Oyun oynayan AI, rakip davranışına göre stratejilerini ayarlamak zorundadır. Yarışma çözen AI, ilk girişimlerde başarısız olduğunda yaklaşımını değiştirmelidir. Bu esneklik, gerçek dünya gereksinimlerini yansıtıyor, burada esnek olmayan yanıtlar genellikle başarısız oluyor.

Yenilik karşısında dayanıklılık da yarışma tabanlı testin önemli bir yönü. Rekabet ortamı sürekli değişiyor, bu da AI’nin yeni durumlarla ve beklenmedik hamlelerle başa çıkmasını gerektiriyor. Bu koşullarda iyi performans gösteren bir model, gerçek dünya uygulamalarında daha güvenilir ve etkili olma olasılığı daha yüksek.

Yarışma Tabanlı Değerlendirmenin Zorlukları

Yarışma tabanlı değerlendirme birçok avantaj sunuyor, ancak çeşitli zorluklarla da karşı karşıya. Bir endişe, alan spesifisitesidir. Bir satranç şampiyonu, karmaşık bir matematik sorununu çözemeyebilir. Belirli bir yarışmadaki başarı, genel zeka garantisi vermez. Alan, AI’nin genel yeteneklerini daha kapsamlı bir şekilde anlamak için birden fazla yarışmadan sonuçları birleştirmenin yollarını bulmalıdır.

Standardizasyon başka bir sorun. Tek bir oyun içindeki galibiyet-kaybetme kayıtları açıkken, farklı yarışma türleri arasındaki sonuçları karşılaştırmak zordur. Örneğin, bir modelin bir robotik yarışmadaki performansını bir kodlama yarışmasındaki performansıyla nasıl karşılaştırabilirsiniz? Araştırmacılar, bu farklı sonuçları adil bir değerlendirme için birleştirebilecek çerçeveler oluşturmak için çalışıyorlar.

Son olarak, erişilebilirlik sorunu var. Birçok yarışma açık olsa da, bazıları önemli hesaplama kaynakları veya uzmanlık gerektirebilir, bu da tüm araştırmacılar, özellikle de küçük kurumların araştırmacıları için erişilebilir olmayabilir. Bu yeni değerlendirme yöntemlerinin kapsayıcı olması, alanın sağlığı ve çeşitliliği için esansiyeldir.

AI Araştırmalarına Geniş Etki

Yarışma tabanlı değerlendirmenin yükselişi, AI’nin geliştirilme şekli üzerinde already önemli bir etkiye sahip. Araştırmacıları, sadece referans noktalarında eğitim veren modeller yerine, planlayabilen, nedenlenebilen ve yeni durumlara adapte olabilen sistemler geliştirmeye teşvik ediyor. Bu değişiklik, daha genel zeka formlarına doğru gerçek ilerleme kaydetmek için kritik.

Yarışmacı platformlar ayrıca değerlendirmeyi demokratikleştiriyor. Oyunları ve yarışmaları herkesin erişebileceği hale getirerek, küçük araştırma grupları ve bireysel geliştiriciler, büyük teknoloji şirketleriyle yarışabilir. Bu, daha geniş bir insan ve kurum yelpazesinden inovasyona yol açıyor. Kaggle, Uluslararası Matematik Olimpiyatı ve programlama yarışma siteleri, AI yeteneklerini test etmek için erişilebilir mecralar sunuyor.

Son olarak, yarışmacı testten alınan dersler, doğrudan gerçek dünya uygulamalarını etkiliyor. Planlama, adapte olma ve baskı altında dayanıklılık yeteneği, finans, ulaşım, sağlık ve savunma gibi alanlarda çok değerli. Bu alanlar, belirsizliği ele alan, değişen koşullara adapte olan ve güvenilir performans gösteren AI sistemlerini gerektiriyor.

Sonuç

Yarışma tabanlı değerlendirme, AI ilerlemesini ölçme şeklimizi yeniden tanımlıyor. Statik referans noktalarının aksine, yarışmalar adapte olmayı, yaratıcılığı ve gerçek problem çözme yeteneğini dinamik koşullar altında test ediyor. Standardizasyon ve erişilebilirlik gibi zorluklar devam etse de, bu değişiklik AI’yi daha güçlü, çok yönlü ve insanla karşılaştırılabilir zeka yönünde itiyor. Sadece araştırmayı keskinleştirmekle kalmıyor, aynı zamanda gerçek dünya etkisine sahip AI sistemlerinin geliştirilmesini de hızlandırıyor.