Anderson’un Açısı

Vibe Kodlama, AI’ın Rolü Genişlediğinde Çöküyor

Yeni bir çalışma, vibe kodlamanın insanların talimat verdiğinde iyileştiğini, ancak AI’ın yaptığı zaman düştüğünü, en iyi melez kurulumun insanların öncülüğünü sürdürürken, AI’ın bir hakem veya yargıç olarak kalmasını gösteriyor.

Amerika Birleşik Devletleri’nden yeni bir araştırma, AI sistemlerinin vibe kodlama yönlendirmesine izin verildiğinde neler olduğu üzerine baktı ve Büyük Dil Modellerinin (LLM) daha büyük bir yönlendirme rolü aldığında, sonuçların neredeyse her zaman daha kötü olduğunu buldu.

Araştırmacılar, insan/AI işbirliği deneyleri için OpenAI’nin GPT-5 çerçevesini kullandı, ancak daha sonra Anthropic’in Claude Opus 4.5 ve Google Gemini 3 Pro‘nin de aynı şekilde sorumlulukları büyütürken aynı şekilde bozulan bir eğriye tabi olduğunu doğruladı, “sınırlı insan katılımının performansını sürekli olarak iyileştirdiğini” belirtti:

‘İnsanlar, yinelemeler boyunca benzersiz şekilde etkili yüksek düzeyde rehberlik sağlar, [oysa] AI rehberliği genellikle performans çökmesine yol açar. Ayrıca, dikkatli bir rol dağılımının, insanların yönünü belirleme sorumluluğunu sürdürürken, değerlendirme işini AI’a devretmenin melez performansı iyileştirebileceğini bulduk.’

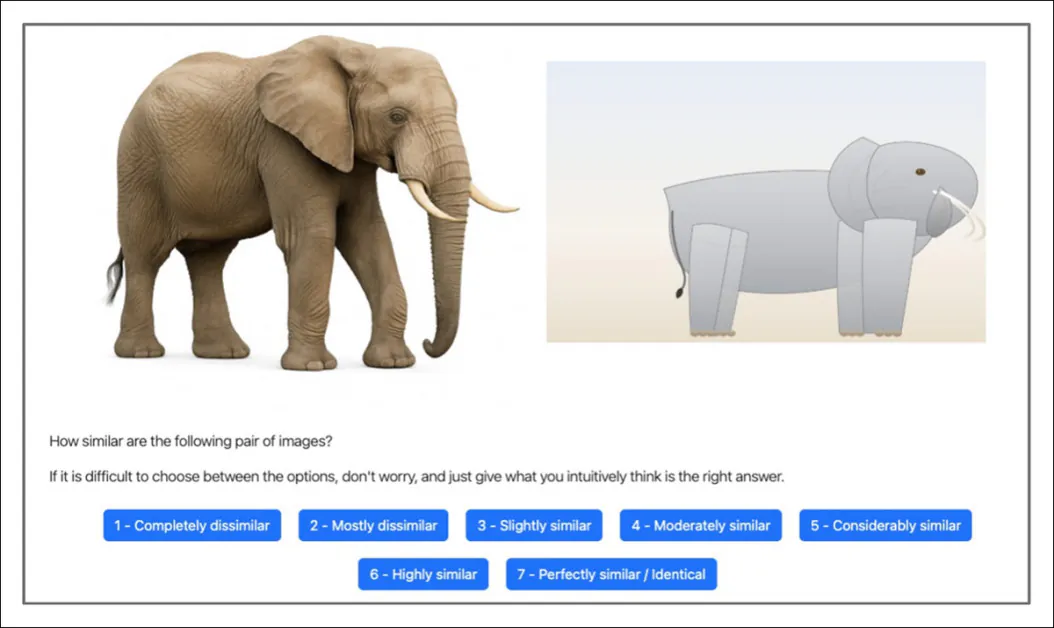

Deneylerin eşit şekilde insan ve AI tarafından değerlendirilebileceği tutarlı bir test sağlamak için, bir referans görüntüsünü – bir kedi, köpek, kaplan, kuş, fil, penguen, köpekbalığı, zebra, zürafa veya panda fotoğrafını – yeniden yaratmak için bir dizi kodlama görevi oluşturuldu ve bu yeniden yaratma, türetilmiş olduğu fotoğrafa karşı değerlendirildi:

Hem insan hem de AI katılımcılarına bir fotoğraf referans görüntüsü ve bir AI tarafından üretilen SVG yeniden yapılandırma gösterildi ve benzerliklerini 7 puanlık bir ölçekte değerlendirmeleri istendi. Kaynak

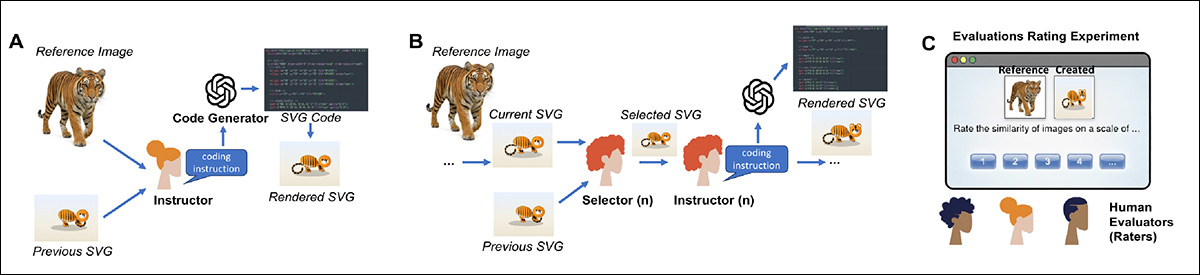

Her turda, bir ajan, bir kod oluşturucuyu yönlendirmek için yüksek düzeyde doğal dil talimatları sağladı ve diğeri, yeni sürümü kabul edip etmemeye karar verdi – gerçek işbirliği akışlarını yansıtan yapılandırılmış bir döngü.

On altı deney, 604 katılımcı ve binlerce API çağrısı ile, tam olarak insan liderliğindeki test turaları, tam olarak AI liderliğindeki turalarla, diğer koşulların aynı olduğu durumlarda karşılaştırıldı.

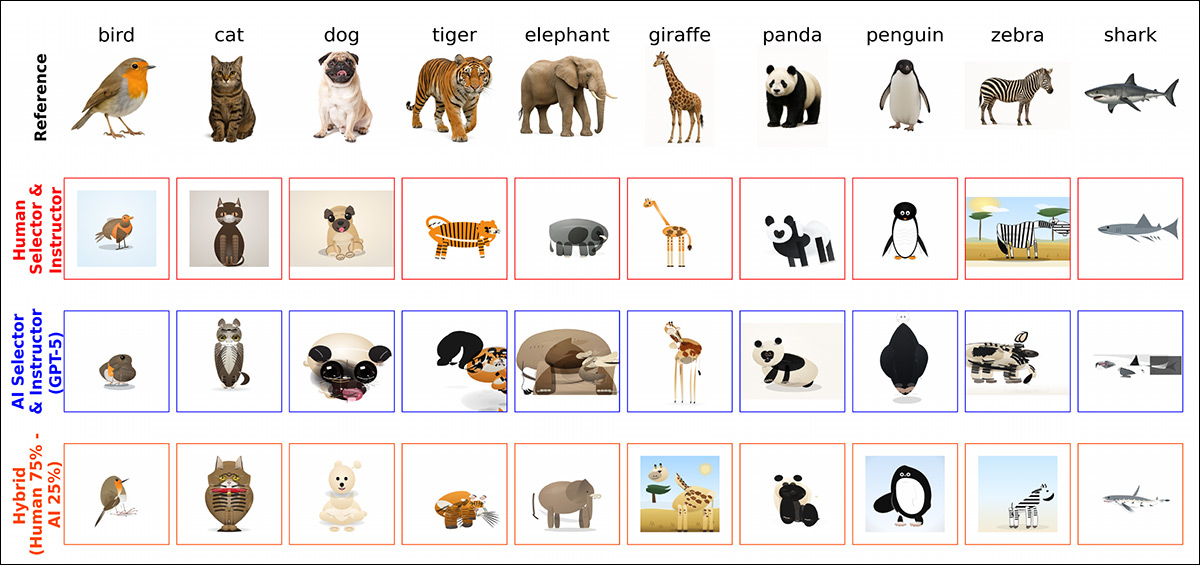

Farklı insan/AI işbirliği yüzdeleri ve türlerinin ulaştığı çeşitli çözümler (kaynak kağıttaki daha büyük bir illüstrasyondan alıntıdır, okuyucuyu kağıda yönlendiriyoruz).

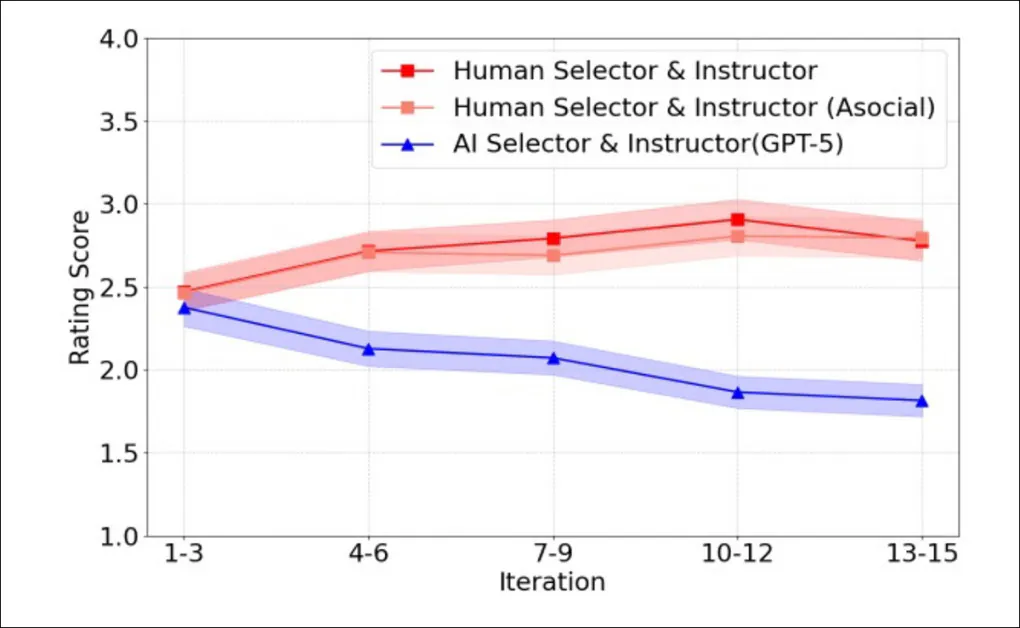

İnsanlar ve AI benzer seviyelerde başladı, ancak zaman içinde yolları ayrıldı: insanlar talimat verdiğinde ve seçim kararları aldığında, benzerlik puanları yinelemeler boyunca arttı, her turda referans görüntüsüne daha da yaklaştı; ancak AI sistemleri her iki rolü de doldurduğunda, performans tutarlı kazançlar göstermedi ve sık sık yinelemeler boyunca düştü – aynı temel model kod oluşturma için kullanıldığı ve AI’ın insan katılımcılarla aynı bilgilere erişebildiği halde.

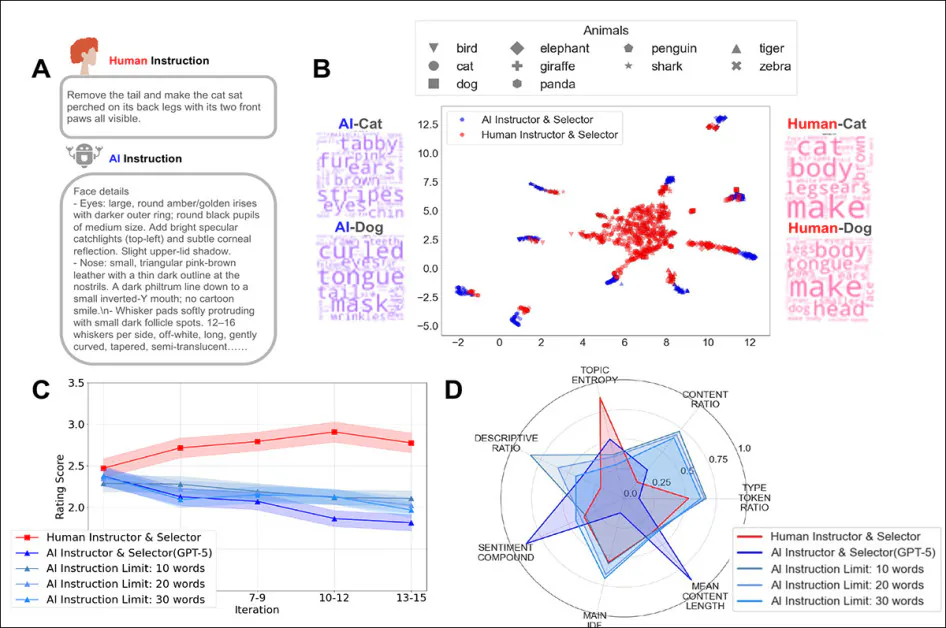

Söz Döküntüsü Etkisi

Sonuçlar ayrıca, insan talimatlarının genellikle kısa ve eylem odaklı olduğunu, mevcut görüntüde neyi değiştirmesi gerektiğini vurguladığını, AI talimatlarının ise çok daha uzun ve ayrıntılı olduğunu gösterdi (bu, GPT-5 için parametreleştirildi), görsel özelliklere odaklanmak yerine artımsal düzeltmeyi önceliklendirdi.

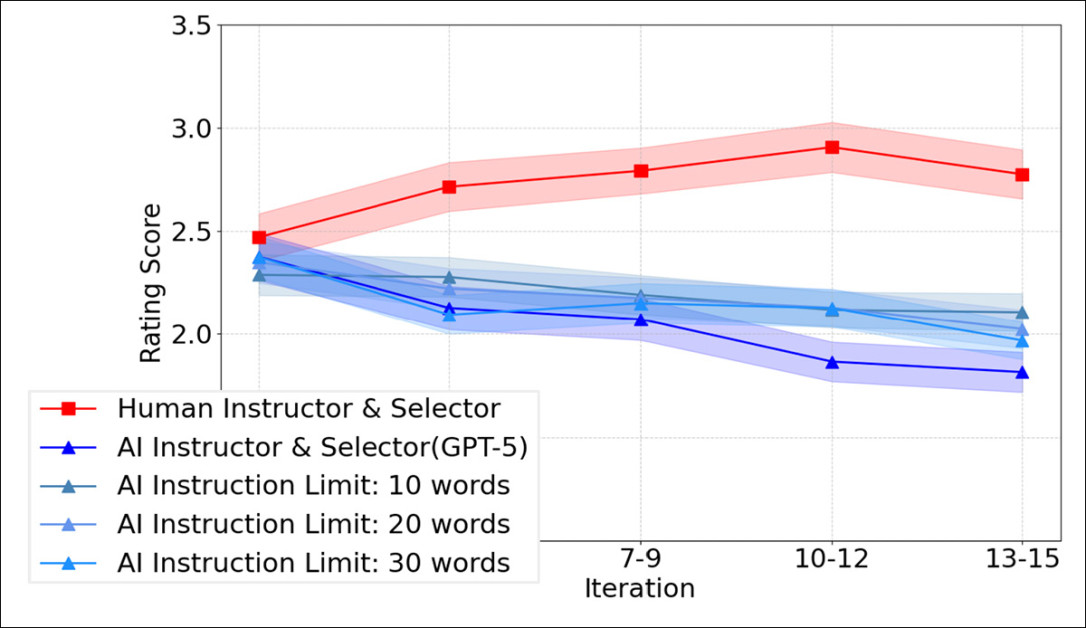

Ancak, aşağıdaki grafiğe bakıldığında, AI talimatlarına sıkı kelime sınırları koymak, kalıpları tersine çevirmeyecekti; AI liderliğindeki zincirlerin, 10, 20 veya 30 kelimelik talimatlarla bile, zaman içinde iyileşmediği görüldü:

İnsan liderliğindeki turalarla karşılaştırıldığında, yinelemeler boyunca benzerlik puanları, tam AI liderliğindeki turalarla ve 10, 20 veya 30 kelimelik talimatlarla sınırlı AI liderliğindeki turalarla gösterildi, AI’nin talimat ve seçim yönünü yönettiğinde, yinelemeler boyunca görülen performans düşüşünün, AI promt’larını kısaltmanın önüne geçmediğini gösterdi.

Melez deneyler, deseni daha da netleştirdi, insan katılımının birazcık bile eklenmesinin, tam AI liderliğindeki kurulumlara kıyasla sonuçları iyileştirdiğini gösterdi; ancak AI rehberliği payı arttıkça performans genellikle düştü.

Roller ayrıldığında, değerlendirme ve seçim AI’a verilebilirdi, ancak insan yüksek düzeyli talimatını AI rehberliğiyle değiştirmek, performansında belirgin düşüşlere yol açtı, bu da önemli olanın, kimin kod ürettği değil, kimin yönü belirleyip sürdürdüğü olduğunu gösterdi.

Yazarlar şu sonuca varıyor:

Çoklu deneyde, insan liderliğindeki kodlama tutarlı olarak yinelemeler boyunca iyileşirken, AI liderliğindeki kodlama genellikle çöktü, aynı bilgilere ve benzer yürütme yeteneklerine erişime rağmen.

Bu, bugünün AI sistemlerinin, başarılı bir vibe kodlaması için gerekli olan tekrarlanan etkileşimler boyunca tutarlı, yüksek düzeyde yönü sürdürme konusundaki temel mücadelelerini gösteriyor.

Yeni makale, İnsan Rehberliğinin İşbirliği Vibe Kodlamasında Neden Önemli Olduğu başlığını taşıyor ve bu, Cornell Üniversitesi, Princeton Üniversitesi, Massachusetts Teknoloji Enstitüsü ve New York Üniversitesi’nden yedi araştırmacının eseridir.

Yöntem

Deneyler için, bir insan öğretici, GPT-5 tarafından üretilen bir hayvan referans fotoğrafına, birlikte en son ilgili SVG taklit girişimine baktı ve ardından kod oluşturucuyu daha yakın bir eşleşme yönünde yönlendirmek için doğal dil talimatları yazdı.

Böylece, oluşturucu her turda yeni bir SVG üretirdi, performansı zaman içinde nasıl birikeceğini test etmek için yinelemeli bir döngü sağlar.

Hedefler, kolayca tespit edilebilecek iyileştirmeler veya hatalar için bir dizi şekil ve dokuya sahip on GPT-5 tarafından üretilen hayvan görüntüsünü kapsıyordu:

Çalışmada kullanılan vibe kodlama iş akışı şeması. A) Bir insan öğretici, bir fotoğraf referans görüntüsü ile birlikte en son üretilen SVG’yi görür ve bir sonraki SVG’yi üretmesi için kod oluşturucuya doğal dil talimatları yazar; B) Bir insan seçici, yeni SVG’yi önceki ile karşılaştırır ve hangisinin referans görüntüsüne daha iyi eşleştiğini seçer, sonra seçilen SVG’yi bir sonraki tur talimatı için ilerletir; ve C) Bağımsız insan değerlendiriciler, her üretilen SVG’nin referans görüntüsüne ne kadar benzer olduğunu değerlendirir, genel performansı değerlendirmek için kullanılan puanları sağlar.

Bir insan seçici, her yeni üretilen SVG’yi önceki ile karşılaştırdı ve kabul edip etmemeye karar verdi, bu da süreci tur boyunca referans görüntüsüne hizaladı.

Kaliteyi ölçmek için, bağımsız insan değerlendiriciler her üretilen SVG’nin referans görüntüsüne ne kadar benzer olduğunu değerlendirdi. On altı deneyde, 120 kişi 4.800 puanlama yaptı. Tüm deneyler, insan-AI sistemleri arasındaki yapılandırılmış etkileşimleri barındırmak üzere tasarlanmış PsyNet çerçevesinde yürütüldü.

Çalışma, 604 anadili İngilizce olan kişiyi işe aldı, testler 4.800 kod oluşturma API çağrısı ve 5.327 talimat API çağrısı yapacak, GPT-5 ana model olarak kullanılacaktı, ancak daha küçük karşılaştırma partileri Claude Opus 4.5 ve Gemini 3 Pro ile yapılacak, her biri 280 sorgu işleyecekti.

Sonuçlar

Otuz vibe-kodlama turu yürütüldü, her biri çekirdek on referans görüntüsünün on beş düzenlenmesini içeriyordu. Bunun için, 45 insan katılımcısı seçildi, her biri on iterasyon boyunca hem seçici hem de öğretici olarak görev yaptı.

Her turda, aynı katılımcı önce geçerli ve önceki SVG arasında seçim yaptı, sonra bir sonraki tur talimatını yazdı. İkinci bir test, insan kararlarını GPT 5’e API çağrıları ile değiştirdi, ancak kurulumun geri kalanını değiştirmeden.

Tüm durumlarda, öğretici ve seçici rolleri, kod oluşturucuya basit dil ile promt verdi.

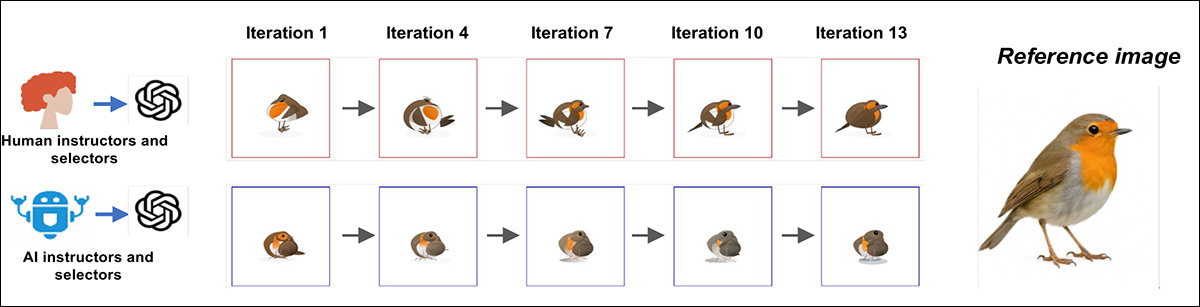

Bir temsilci çok tur örnek, sürecin zaman içinde nasıl ayrıldığını gösterir; insanlar hem seçici hem de öğretici olarak görev yaptığında, SVG çıktısı, her turda referans görüntüsüne daha da yaklaştı:

Bir referans görüntüsü için insan liderliğindeki (üst) ve AI liderliğindeki (alt) vibe kodlama ilerlemeleri, her iki rolde de insanların yer almasıyla yinelemeler boyunca sürekli iyileşme ve AI’nın her iki rolü de üstlenmesiyle durgunluk veya sapma gösteriyor.

Tersine, AI liderliğindeki versiyonda, erken turlar bazen ana görsel özellikleri yakaladı, ancak sonraki girişimler bu kazanımları üzerine inşa etmekte başarısız oldu ve bazı durumlarda hedeften uzaklaştı:

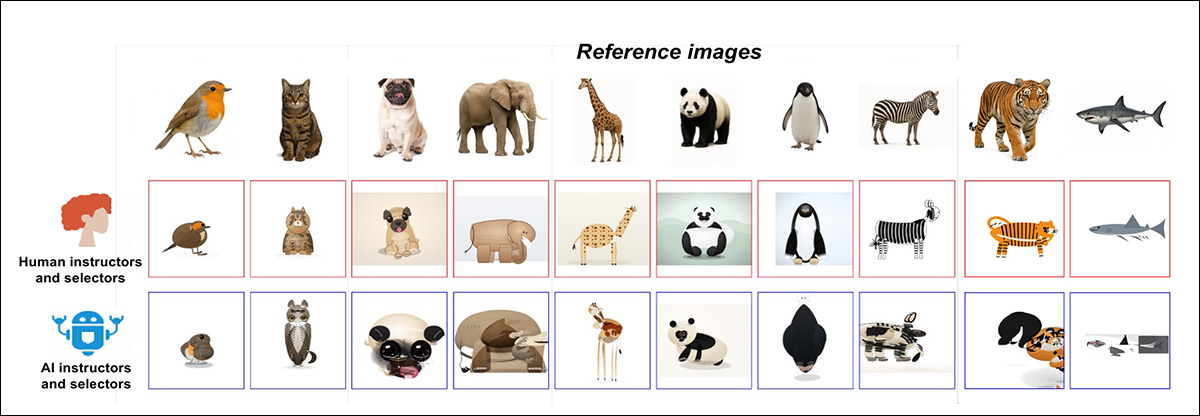

Son iterasyondan elde edilen nihai çıktılar, insan liderliğindeki turları (üst satır) AI liderliğindeki zincirlerle (alt satır) karşılaştırarak, aynı referans görüntüleri kümesi boyunca. İnsan liderliğindeki sonuçlar orijinal hayvanlara daha yakın bir eşleşme sağlarken, AI liderliğindeki sonuçlar görünür bozulmalar veya ana özelliklerin kaybını gösteriyor.

Eşdeğerlik puanlarını nicel olarak ölçmek için, nihai görüntüler bağımsız insan puanlayıcılarına gösterildi ve referans resimlerine benzerlikleri için puanlandı. Erken turlarda, insan liderliğindeki ve AI liderliğindeki çalışmalarda puanlar yaklaşık olarak aynıydı; ancak on beşinci turda fark açıktı, insan seçilen görüntüler referans resimlerine çok daha yakın olarak puanlandı.

İnsan liderliğindeki ve AI liderliğindeki vibe kodlama için yinelemeler boyunca ortalama benzerlik puanları, insanların her iki rolü de üstlenmesiyle sürekli kazançlar ve GPT 5’in her iki rolü de üstlenmesiyle dần bir düşüş gösteriyor.

Sonuçları garantilemek için, araştırmacılar on ek insanı tek başına çalışmak üzere işe aldı, her biri üç tur çalıştı – ve sonuçlar aynı şekilde sürekli olarak iyileştirdi, bu da kazanımların toplu bir çabanın tesadüfi sonucu olmadığını gösterdi.

Büyük Resim

Ancak, GPT-5 çıktılarını kendisi değerlendirirse, insan sonuçlarının daha iyi olduğunu kabul eder miydi? İnsan ve AI puanlamaları genellikle aynı yönde hareket etti, böylece model iyi ve kötü arasında ayrım yapabildi, ancak AI tarafından üretilen görüntüleri insanlardan daha yüksek puanladı.

Özellikle, AI ajanlarının kendi çıktılarının insanlar tarafından üretilenlerden daha düşük olduğunu tanıdığından yoksa kendi yaratımlarına bir tercih göstereceğinden emin olmak istedik, bu da potansiyel bir hizalama sorunu gösterecekti.’

Aslında, bir hizalama sorunu var:

AI değerlendiriciler, AI tarafından üretilen [çıktılara] daha yüksek puanlar verdi. Bu bulgular, gözlemlenen performans farklılıklarının, insanlar ve AI arasında bir temsil hizalaması uyumsuzluğundan kaynaklanabileceğini gösteriyor.

İnsanların ve AI’ın nasıl rehberlik sağladıklarını incelemekte, AI/Human ayrılıkları açıkça görülüyor:

Kodlama görevi sırasında insanların ve AI’ın nasıl talimat verdiğini gösteren bir karşılaştırma. ‘A’ insanların kısa ve direkt talimatlar yazdığını, AI’ın ise uzun ve ayrıntılı açıklamalar sağladığını gösteriyor. ‘B’ talimatları haritalıyor, insan promt’larının bir araya toplandığını, AI promt’larının ise hayvanlara göre ayrıldığını gösteriyor. ‘C’ AI talimat uzunluğunu sınırlamanın, zaman içinde kötü sonuçları düzeltmediğini izliyor ve ‘D’ insanların, AI’dan daha çeşitli ve dengeli rehberlik sağladığını, hatta kelime sınırları konduğunda bile gösteriyor.

İnsan talimatları kısa ve netti, genel olarak uygulanabilecek açık düzenlemeler sunarken, AI talimatları ise ayrıntılı ve uzun açıklamalarla dolu, gölgelendirme, dokular, aydınlatma veya anatomik ayrıntılar hakkında açıklamalar içeriyordu – bu açıklamalar izole olarak anlamlı olabilir, ancak model için (ve LLM’lerin bağlam uzunluğu etrafındaki sorunlarıyla ilgili olarak) faydalı sonraki adımlar sağlamaz.

Ortak Girişimler

İnsanlar ve AI kontrolü paylaştığında

ne olacağını test etmek için, araştırmacılar, insan ve AI girişiminin farklı karışımlarıyla kodlama görevleri yürüttü, çoğunlukla insan dan çoğunlukla AI‘a kadar.

Her melez kurulum, tam AI kontrolünden daha iyi performans gösterdi, böylece biraz insan rehberliği sonuçları iyileştirdi:

Farklı insan/AI karışımı ile melez kodlama kurulumları. (A) Her kodlama adımında insanların ve AI’ın öğretici ve seçici olarak dönüşümlü olarak görev yaptığını gösteriyor; (B) daha fazla insan katılımının daha yüksek kaliteli sonuçlara yol açtığını, daha fazla AI girişinin puanları düşürdüğünü gösteriyor; ve (C) insan katılımının payı azaldıkça nihai çıktı kalitesinin sürekli düşüşünü gösteriyor, daha tutarlı insan yönünün daha iyi sonuçlar ürettiğini onaylıyor.

AI daha fazla işlem aldığı medida, performans düştü, en iyi sonuçlar insanların çoğu turda liderlik yaptığı ve AI’ın çoğu turda liderlik yaptığı en zayıf sonuçlarla görüldü. Hiçbir melez kurulum, her yeni turda iyileşmeyi sürdüremedi, bu da insan yönünün en iyi şekilde sürekli ve tutarlı olduğu anlamına geliyordu.

Rol Değişimi

Çalışma ayrıca, bu tür görevlerde kimin ne yaptığının

önemli olup olmadığını ve bunu test etti.

Görev, iki görevden oluşuyordu: bir katılımcı görüntüyü nasıl değiştireceğini söyleyecekti ve diğeri daha iyi bir versiyonu seçecekti.

Her iki görev de insanlar tarafından yapıldığında, kalite korunurdu; ancak bir insan talimat verdiğinde ve hiç kimse versiyonlar arasında seçim yapmadığında, kalite kötüleşti:

Vibe kodlamada rol bölümlenmesi testleri: (A) seçici rolünü kaldırmak, performansın daha da kötüleşmesine yol açtı, hatta insan talimatları verilse bile; (B) insan seçiciyi AI ile değiştirmek, kaliteyi biraz düşürdü, ancak tamamen seçim yapmamaktan daha az kötüleşti.

AI liderlikteyken, seçim adımını atlamak önemli değildi, çünkü AI çıktıları her durumda tutarlı kaldı; ancak insanlar talimat verdiğinde ve AI seçimi yaptığında, kalite neredeyse tüm insan kurulumuna yakındı.

Tersi geçerli değildi: AI’nin talimat vermesi ve insanların çıktıları seçmesi, daha zayıf sonuçlara yol açtı, bu da insan yaratıcı rehberliğinin hala temel olduğunu, ancak seçme işinin AI’a devredilebileceğini gösterdi.

Makale şu sonuca varıyor:

Yüksek düzeyde fikir üretimi ve talimat, kritik insan katkılarıdır, oysa değerlendirme ve seçim genellikle AI’a devredilebilir ve performans kaybı olmadan.

Bu, melez sistemler için bir pratik tasarım ilkesini öneriyor: insanlar yönü belirlemeli, AI ise değerlendirme ve yürütme işini desteklemelidir.

Sonuç

Geliştirilmiş ve/veya artan bağlam pencerelerinin bu tür görevlerdeki LLM’lerin performansını ne ölçüde etkileyeceği henüz bilinmiyor. ‘LLM hafızasızlığı’ günlük bir sorun olmaktan çıkacağı gün, hem kutlama hem de alarm için bir neden olabilir, çünkü AI’nın çözmeye çalıştığı problem, aslında insanlardır.

Ancak yazarların çalışması, AI ve insanlar arasındaki kalite konusunda temel ve kritik anlaşmazlıklar olduğunu da net bir şekilde ortaya koyuyor, bu da tüketici tarafından insan kavramının yerini alınamaz olarak belirlenmiş olabileceğini gösteriyor.

* Yazarların satır içi alıntılarını hyperlink’e dönüştürmeme.

İlk olarak 13 Şubat 2026 Cuma günü yayımlandı.