Anderson’un Açısı

İyileşen AI Tabanlı Video Düzenleme Yolu

Video/görüntü sentez araştırma sektörü düzenli olarak video düzenleme mimarileri üretmekte ve son dokuz ayda bu tür çıkışlar daha da sık hale gelmiştir. Bununla birlikte, bunların çoğu, önemli olan temel zorluklar nedeniyle yalnızca mevcut durumun artımlı ilerlemelerini temsil etmektedir.

Ancak, bu hafta Çin ve Japonya arasındaki yeni bir işbirliği, yaklaşımın daha yakından incelenmesini hak eden bazı örnekler üretmiştir, bu bir kilometre taşı çalışması olmasa da.

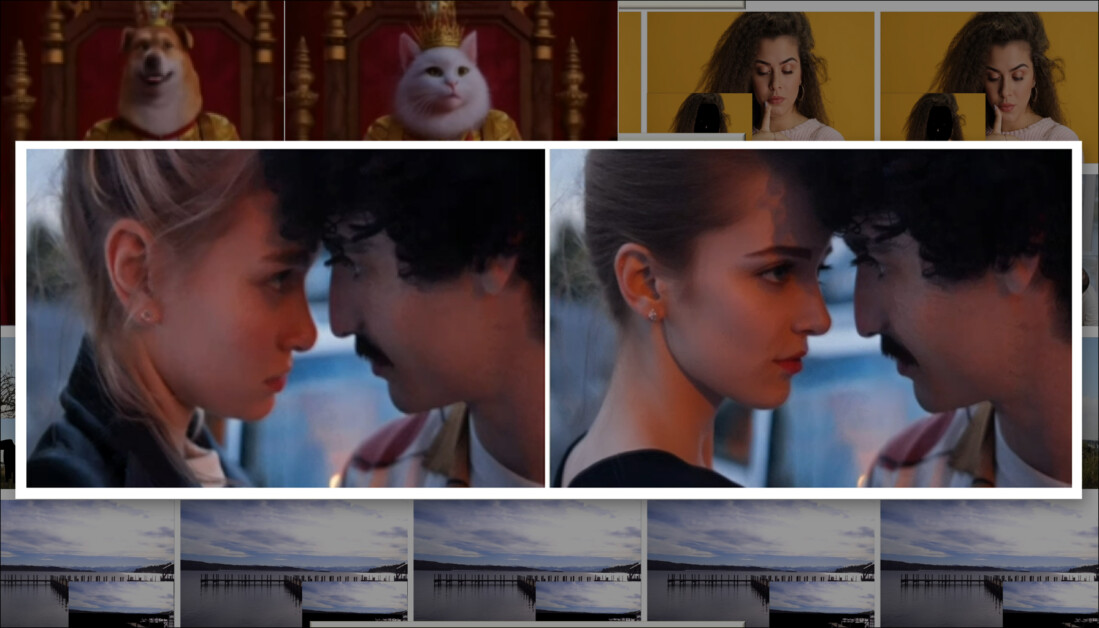

Aşağıdaki video klibinde (makalenin ilgili proje sitesinden, uyarı – tarayıcınızı zorlayabilir), sistemdeki deepfaking yeteneklerinin mevcut yapılandırmada mevcut olmadığı görülse de, sistem, alt soldeki video maskesine dayalı olarak resimdeki genç kadının kimliğini makul bir şekilde ve önemli ölçüde değiştirmekte iyi bir iş çıkarmaktadır:

Oynatmak için tıklayın. Alt soldeki semantic segmentasyon maskesi görselleştirildiğinde, orijinal (üst sol) kadın,.promptte belirtilen kimlik değişimini başarmasa da, önemli ölçüde farklı bir kimliğe dönüştürülmektedir. Kaynak: https://yxbian23.github.io/project/video-painter/ (yazma zamanında, bu otomatik oynatma ve video dolu site, tarayıcıma çökme eğilimindeydi). Daha iyi çözünürlük ve ayrıntı için lütfen kaynak videolara başvurun veya https://www.youtube.com/watch?v=HYzNfsD3A0s adresindeki projenin genel video örneklerine bakın

Bu tür maskeli düzenleme, statik latent difüzyon modellerinde iyi kurulmuştur, ControlNet gibi araçlar kullanılarak. Ancak, video中的 arka plan tutarlılığını korumak çok daha zorlu, hatta maskeli alanlar modeli yaratıcı esneklik sağlasa da:

Oynatmak için tıklayın. Yeni VideoPainter yöntemiyle tür değişikliği. Daha iyi çözünürlük ve ayrıntı için lütfen kaynak videolara başvurun veya https://www.youtube.com/watch?v=HYzNfsD3A0s adresindeki projenin genel video örneklerine bakın

Yazarlar, Tencent’in kendi BrushNet mimarisine (ki geçen yıl kapsamlı olarak ele aldık) ve ControlNet’e, her ikisi de ön plan ve arka plan oluşturmayı capable olan çift dal mimarisiyle ilgili olarak yöntemlerini dikkate almaktadırlar.

Ancak, bu yöntemi doğrudan Diffusion Transformers (DiT) yaklaşımına OpenAI’nin Sora tarafından önerilen şekilde uygulamak, yazarların not ettiği gibi özel zorluklar getirir:

‘[Doğrudan] uygulamak [BrushNet ve ControlNet’in mimarisi] video DiT’lerine several zorluklar sunar: [İlk olarak,] Video DiT’nin güçlü üretken temeli ve ağır model boyutu nedeniyle, tam/dev yarı dev Video DiT omurgasını bağlam kodlayıcısı olarak çoğaltmak gereksiz ve hesaplama açısından engeldir.

‘[İkincisi,] BrushNet’in saf konvansiyonel kontrol dalı gibi, DiT’nin maskeli bölgelerdeki tokenleri küresel dikkat nedeniyle arka plan bilgilerini içerir, bu da DiT omurgasındaki maskeli ve maskesiz bölgeler arasındaki ayrımı karmaşık hale getirir.

‘[Son olarak,] ControlNet, tüm katmanlar boyunca özellik enjeksiyonu eksikliği nedeniyle, boyama görevleri için yoğun arka plan kontrolünü engeller.’

Bu nedenle araştırmacılar, çift dal çerçevesi şeklinde bir tak ve çalıştır yaklaşımı geliştirmişlerdir: VideoPainter.

VideoPainter, önceden eğitilmiş DiT’leri, arka plan bağlamını ön plan oluşturmadan ayıran hafif bir bağlam kodlayıcısı ile güçlendiren bir çift dal video boyama çerçevesi sunar. Bu kodlayıcı, yalnızca omurganın parametrelerinin %6’sını oluşturur, yazarlar bunu geleneksel yöntemlere göre daha verimli olduğunu iddia etmektedir.

Model, üç ana yenilik sunar: verimli arka plan rehberliği için akıcı iki katmanlı bir bağlam kodlayıcısı; maskeli ve maskesiz tokenleri ayıran bir maskeli özellik entegrasyon sistemi; ve uzun video dizileri boyunca kimlik tutarlılığını korumak için bir boyama bölgesi ID yeniden örnekleme tekniği.

Hem önceden eğitilmiş DiT hem de bağlam kodlayıcısını dondurarak ve bir ID-Adapter tanıtarak, VideoPainter, boyama bölgesi tokenlerinin önceki kliplerden kalıcı olmasını sağlar, bu da video boyunca parlamayı ve tutarsızlıkları azaltır.

Çerçeve, ayrıca mevcut video oluşturma ve düzenleme iş akışlarına sorunsuz bir şekilde entegre edilebilmesi için tasarlanmıştır.

Çalışmayı desteklemek için, yazarlar CogVideo-5B-I2V olarak kullanılan üretken motoru kullanarak, bugüne kadarki en büyük video boyama verisetini oluşturmuşlardır. VPData adlı koleksiyon, toplam 886 saatten fazla video süresi için 390.000’den fazla klibi içermektedir. Ayrıca, VPBench adlı ilgili bir benchmarking çerçevesi geliştirdiler.

Oynatmak için tıklayın. Proje web sitesindeki örneklerden, VPData koleksiyonu ve VPBench test süiti tarafından sağlanan segmentasyon yeteneklerini görüyoruz. Daha iyi çözünürlük ve ayrıntı için lütfen kaynak videolara başvurun veya https://www.youtube.com/watch?v=HYzNfsD3A0s adresindeki projenin genel video örneklerine bakın

Yeni çalışma, VideoPainter: Her Uzunlukta Video Boyama ve Düzenleme ile Tak ve Çalıştır Bağlam Kontrolü olarak adlandırılmıştır ve Tencent ARC Lab, Çin Hong Kong Üniversitesi, Tokyo Üniversitesi ve Makao Üniversitesi’nden yedi yazar tarafından yapılmıştır.

Yazarlar, projeye ait daha erişilebilir bir YouTube özeti ve Hugging Face sayfası da yayınlamışlardır.

Yöntem

VPData için veri toplama.pipeline, toplama, açıklama, bölme, seçme ve altyazıdan oluşmaktadır:

Veri seti inşaat pipeline şeması. Kaynak: https://arxiv.org/pdf/2503.05639

Bu derlemenin kaynak koleksiyonları, Videvo ve Pexels olarak kullanılmıştır, yaklaşık 450.000 video ile başlangıç yapılmıştır.

Çoklu katılımcı kütüphaneler ve yöntemler ön işleme aşamasını oluşturdu: Her Şeyi Tanıma çerçevesi, açık set video etiketleme için kullanıldı, birincil nesneleri tanımlamakla görevlendirildi; Dino Yerleştirme tanımlanan nesnelerin etrafındaki sınırlayıcı kutuların tespiti için kullanıldı ve Her Şeyi Segmentle Model 2 (SAM 2) çerçevesi, bu kaba seçimlerin yüksek kaliteli maske segmentasyonlarına rafine edilmesini sağladı.

Sahneler arasındaki geçişleri yönetmek ve video boyamada tutarlılığı sağlamak için, VideoPainter PySceneDetect kullanır, bu, aynı nesneyi birden fazla açından takip etmekten kaynaklanan kesintileri önler. Klipler 10 saniyelik aralıklara bölünmüştür, 6 saniyeden kısa olan her şey atılmıştır.

Veri seçimi için üç filtreleme ölçütü uygulandı: estetik kalite, Laion-Aesthetic Skor Tahmincisi ile değerlendirildi; optik akış RAFT kullanılarak ölçüldü; ve Stable Diffusion’un Güvenlik Kontrolörü aracılığıyla doğrulanan içerik güvenliği.

Mevcut video segmentasyon veri setlerinde, üretken modelleri yönlendirmek için hayati önem taşıyan ayrıntılı metin açıklamalarının eksikliği gibi bir sınırlama vardır:

Araştırmacılar, karşılaştırılabilir koleksiyonlardaki video-altyazılarının eksikliğini vurgulamaktadır.

Bu nedenle, VideoPainter veri toplama süreci, anahtar kare tabanlı altyazılar ve maskeli bölgelerin ayrıntılı açıklamaları üretmek için önde gelen görme-dil modellerini, CogVLM2 ve Chat GPT-4o dahil olmak üzere bir dizi lider görme-dil modelini entegre eder.

VideoPainter, ön plan oluşturmadan arka plan bağlamını ayıran özel hafif bir bağlam kodlayıcısı ile önceden eğitilmiş DiT’leri güçlendirmektedir, bu, üst sağdaki şemada görüldüğü gibi:

VideoPainter için kavramsal şema. VideoPainter’in bağlam kodlayıcısı, VAE aracılığıyla gürültülü latents, aşağı örneklenmiş maskeler ve maskeli video latents’i işler ve yalnızca arka plan tokenlerini, belirsizliği önlemek için önceden eğitilmiş DiT’ye entegre eder. ID Resample Adapter, eğitim sırasında maskeli bölge tokenlerini birleştirmek ve çıkarım sırasında önceki kliplerden yeniden örnekleme yapmak suretiyle kimlik tutarlılığını sağlar.

Bu kodlayıcı, omurga tarafından gereksiz işleme yüklenmemesi için akıcı bir girdi kullanır: gürültülü bir latents, maskeli video latents (bir variational autoencoder veya VAE aracılığıyla çıkarılan) ve aşağı örneklenmiş maskelerin bir kombinasyonu.

Gürültülü latents, üretim bağlamı sağlar ve maskeli video latents, DiT’nin mevcut dağılımıyla uyumlu hale gelir, uyumluluğu artırmayı hedefler.

Yerine büyük model kısımlarını kopyalamak, yazarların önceki çalışmalarında olduğu gibi, VideoPainter yalnızca DiT’nin ilk iki katmanını entegre eder. Bu çıkarılan özellikler, dondurulmuş DiT’ye yapılandırılmış, gruplar halinde yeniden tanıtılmaktadır – erken katman özellikleri, modelin ilk yarısını bilgilendirirken, daha sonraki özellikler ikinci yarısını iyileştirir.

Ek olarak, bir token-seçici mekanizması, yalnızca arka plana ilgili özelliklerin yeniden entegre edildiğini sağlar, bu da maskeli ve maskesiz bölgeler arasındaki karışıklığı önler. Yazarlar, bu yaklaşımın VideoPainter’a arka plan korunmasında yüksek sadakat sağlamaya ve ön plan boyama verimliliğini iyileştirmeye olanak tanıdığını iddia etmektedirler.

Yazarlar, yöntemlerinin, Düşük Rütbe Uyum (LoRA) gibi en popüler stilendirme yöntemlerini de desteklediğini belirtmektedirler.

Veri ve Testler

VideoPainter, CogVideo-5B-I2V modeli ve metin-videoya eşdeğer modeli kullanılarak eğitilmiştir. VPData koleksiyonu, 480x720px’de ve 1×10-5 öğrenme hızında kullanılmıştır.

ID Resample Adapter, 2.000 adımda ve bağlam kodlayıcısı 80.000 adımda AdamW optimizer kullanılarak eğitilmiştir. Eğitim, güçlü 64 NVIDIA V100 GPU’lar (makale, bunların 16GB veya 32GB VRAM’ye sahip olup olmadığını belirtmemektedir) kullanılarak iki aşamada gerçekleştirilmiştir.

Benchmarkleme için, Davis rastgele maskeler için ve yazarların kendi VPBench için segmentasyon tabanlı maskeler için kullanılmıştır.

VPBench veri seti, nesneleri, hayvanları, insanları, manzaraları ve çeşitli görevleri içerir ve dört eylemi kapsar: ekle, kaldır, değiştir ve değiştir. Koleksiyon, 45 6 saniyelik video ve ortalama 30 saniyelik 9 video içerir.

Sekiz ölçüt kullanılmıştır. Maskeli Bölge Korunması için, yazarlar Peak Signal-to-Noise Ratio (PSNR); Öğrenilmiş Algısal Benzerlik Ölçütleri (LPIPS); Yapısal Benzerlik İndeksi (SSIM); ve Ortalama Mutlak Hata (MAE) kullanmıştır.

Metin hizalaması için, araştırmacılar CLIP Benzerliği kullanmışlardır, hem klibin altyazısı ve gerçek algılanan içeriği arasındaki semantik mesafeyi değerlendirmek hem de maskeli bölgelerin doğruluğunu değerlendirmek için.

Çıktı videolarının genel kalitesini değerlendirmek için Fréchet Video Mesafesi (FVD) kullanılmıştır.

Video boyama için nicel bir karşılaştırma turu için, yazarlar sistemi önceki yaklaşımlar ProPainter, COCOCO ve Cog-Inp (CogVideoX) ile karşılaştırdılar. Test, bir klibin ilk karesini görüntü boyama modelleri kullanarak boyamak ve ardından bir görüntü-videoya (I2V) omurga kullanarak sonuçları bir latent karıştırma işlemine yaymakla oluşuyordu, 2023 tarihli bir makale tarafından önerilen bir yöntem doğrultusunda.

Proje sitesinin tamamen işlevsel olmaması ve projenin ilgili YouTube videosunun, proje sitesindeki tüm örnekleri içermeyebileceği nedeniyle, bu çalışmada belirtilen sonuçlara çok özel video örneklerini bulmak oldukça zor. Bu nedenle, projenin web sitesindeki “sonuçlar” videolarından bizim tarafından birleştirilen örnekleri göstereceğiz.

Oynatmak için tıklayın. Proje sitesindeki “sonuçlar” videolarından bizim tarafından birleştirilen örnekler.

Bu video boyama için nitel turu hakkında, yazarlar şunları yorumlarlar:

‘VideoPainter, video tutarlılığı, kalitesi ve metin altyazısına uyumu açısından istisnai sonuçlar sürekli olarak gösterir. Özellikle, ProPainter, yalnızca arka plan piksel propagasyonuna bağlı olarak tamamen maskeli nesneleri üretmeyi başaramaz.

‘COCOCO temel işlevselliği gösterir, ancak boyalı bölgelerde tutarlı ID’yi (tutarsız gemi görünümü ve aniden değişen arazi değişiklikleri) korumakta başarısız olur, çünkü tek omurgalı mimarisi arka plan korunması ve ön plan oluşturmayı dengelemeye çalışmaktadır.

‘Cog-Inp, temel boyama sonuçları elde eder; ancak, karıştırma işleminin maske sınırlarını tespit edememesi önemli hatalara yol açar.

‘Dahası, VideoPainter, ID’yi tutarlı bir şekilde korurken bir dakikadan fazla süren koherent videolar üretebilir, bu da bizim ID yeniden örnekleme yeteneğimiz sayesinde gerçekleşir.’

Araştırmacılar ayrıca VideoPainter’ın altyazıları zenginleştirmek ve bu yöntemle iyileştirilmiş sonuçlar elde etmek yeteneğini, UniEdit, DiTCtrl ve ReVideo ile karşılaştırdılar.

Üç önceki yaklaşımla video düzenleme sonuçları.

Yazarlar şunları yorumlarlar:

‘Hem standart hem de uzun videolar için VPBench’te, VideoPainter süperior performans gösterir, hatta sondan sona ReVideo’yu da geçer. Bu başarı, arka plan korunması ve ön plan oluşturma yeteneklerini garantileyen çift dal mimarisine atfedilebilir, bu da düzenlenmeyen bölgelerde yüksek sadakat korurken, düzenlenmiş bölgelerin düzenleme talimatlarına yakın bir şekilde hizalanmasını sağlar ve boyama bölgesi ID yeniden örnekleme ile uzun video boyunca kimlik tutarlılığını korur.’

Makale, bu ölçüt için statik nitel örnekler sunsa da, bunlar aydınlatıcı değildir ve okuyucuyu projenin web sitesindeki ve YouTube videosundaki çeşitli örneklerine yönlendirmekteyiz.

Son olarak, 50 rastgele seçilmiş üretimi değerlendirmek için 30 kullanıcı ile bir insan çalışması yapılmıştır. Örnekler, arka plan korunması, talimata uyumu ve genel video kalitesini vurgulamıştır.

Kullanıcı çalışması sonuçları için VideoPainter.

Yazarlar şunları belirtirler:

‘VideoPainter, tüm değerlendirme kriterleri boyunca daha yüksek tercih oranlarına ulaşarak mevcut temel çizgileri önemli ölçüde geride bırakmaktadır.’

Ancak, VideoPainter’ın üretiminin kalitesinin temel modeline bağlı olduğunu ve kompleks hareket ve fizikle mücadele ettiğini kabul etmektedirler; ayrıca, düşük kaliteli maskeler veya hizasız altyazılarla da kötü performans gösterdiğini gözlemlemektedirler.

Sonuç

VideoPainter, literatüre değerli bir katkı gibi görünmektedir. Tipik olarak recent çözümler gibi, önemli hesaplama talepleri vardır. Ayrıca, projenin web sitesindeki birçok örnek, sunulan en iyi örneklerden çok uzakta kalıyor; bu nedenle, bu çerçeveyi gelecekteki girişlerle ve daha geniş bir dizi önceki yaklaşımla karşılaştırmak intéressan olacaktır.

* Video düzenleme teriminin, bu bağlamda geleneksel anlamı olan çeşitli klipleri bir diziye monte etmek anlamına gelmediğini, ancak mevcut video kliplerinin iç içeriğini doğrudan değiştirmek veya değiştirmek için makine öğrenimi tekniklerini kullandığını belirtmek önemlidir

İlk olarak 10 Mart 2025 Pazartesi günü yayımlanmıştır