Etik

Yapay Zeka Olay Veritabanı, Yapay Zeka Algoritmalarını Daha Güvenli Hale Getirmeyi Hedefliyor

Yeterince büyük bir sistem, hatalara sahip olacaktır ve bu hataları düzeltmek için bu hataların analiz edilebileceği bir veritabanına sahip olmak önemlidir. FDA’nın ilaca bağlı advers reaksiyonlar için bir veritabanı tuttuğu veya Ulusal Ulaşım Güvenliği Kurulu’nun havacılık kazaları için bir veritabanı tuttuğu gibi, Yapay Zeka Olay Veritabanı da yapay zeka sistemlerinin başarısızlıklarını kataloglamak ve yapay zeka araştırmacılarının bu başarısızlıkları önlemek için yeni yöntemler geliştirmelerine yardımcı olmak amacıyla oluşturulmuş bir veritabanıdır. Yapay Zeka Olay Veritabanı (AIID) yaratıcıları, bunun yapay zeka şirketlerine daha güvenli, daha etik yapay zeka geliştirmelerine yardımcı olacağını umuyor.

AIID nedir?

AIID, Partnership on AI (PAI) organizasyonunun ürünüdür. PAI, ilk olarak 2016 yılında Facebook, Apple, Amazon, Google, IBM ve Microsoft gibi büyük teknoloji şirketlerindeki yapay zeka araştırma ekiplerinin üyeleri tarafından kuruldu. O zamandan beri, organizasyon birçok başka organizasyondan üye kazandı, bunlar arasında çeşitli kar amacı gütmeyen kuruluşlar da vardır. 2018’de PAI, yapay zeka başarısızlıkları için tutarlı bir sınıflandırma standardı oluşturmaya çalıştı. Ancak, bu sınıflandırma standardını temel alacak yapay zeka olayları koleksiyonu yoktu. Bu nedenle, PAI, AIID’yi oluşturdu.

TechTalks’e göre, AIID’nin formatı, Ulusal Ulaşım Güvenliği Kurulu tarafından tutulan havacılık kazaları veritabanının yapısı tarafından bilgilendirildi. 1996’dan itibaren raporların toplanmaya başlandığından beri, ticari hava taşımacılığı sistemi, olayları arşivleyerek ve analiz ederek havacılık endüstrisinin güvenliğini artırmayı başardı. Umuyorlar ki, benzer bir yapay zeka olayları deposu, yapay zeka sistemlerini daha güvenli, daha etik ve daha güvenilir hale getirebilir. AIID, ayrıca Common Vulnerabilities and Exposures veritabanından da esinlendi, bu veritabanı, çeşitli endüstriler ve disiplinler boyunca uzanan önemli yazılım başarısızlıklarının bir deposudur.

Sean McGregor, IBM’de Watson AI XPRIZE için lead teknik danışmandır. McGregor, aynı zamanda AIID’nin 실제 veritabanının geliştirilmesini denetlemekle de sorumludur. McGregor, AIID’nin nihai hedefinin, yapay zeka sistemlerinin zarar vermesini önlemek veya en azından advers olayların şiddeti azaltmak olduğunu açıkladı. McGregor, makine öğrenimi sistemlerinin geleneksel yazılım sistemlerinden çok daha karmaşık ve öngörülemez olduğunu ve bu nedenle aynı şekilde test edilemeyeceğini belirtti. Makine öğrenimi sistemleri, beklenmedik şekillerde davranışlarını değiştirebilir. McGregor, derin öğrenme sistemlerinin öğrenme kapasitesinin, “arızaların daha olası, daha karmaşık ve daha tehlikeli” olabileceği anlamına geldiğini belirtti.

1.000’den Fazla Yapay Zeka İlgili Olay Kaydedildi

AIID ilk olarak oluşturulduğundan beri, veritabanına 1.000’den fazla yapay zeka ile ilgili olay kaydedildi. Veritabanındaki tüm olaylar arasında, en yaygın advers olay türü, yapay zeka adaleti ile ilgili sorunlardı. Bu adalet olaylarının çoğu, hükümet ajansları tarafından yüz tanıma algoritmalarının kullanılmasını içeriyor. McGregor, veritabanına robotik ile ilgili olayların sayısının arttığını da belirtti.

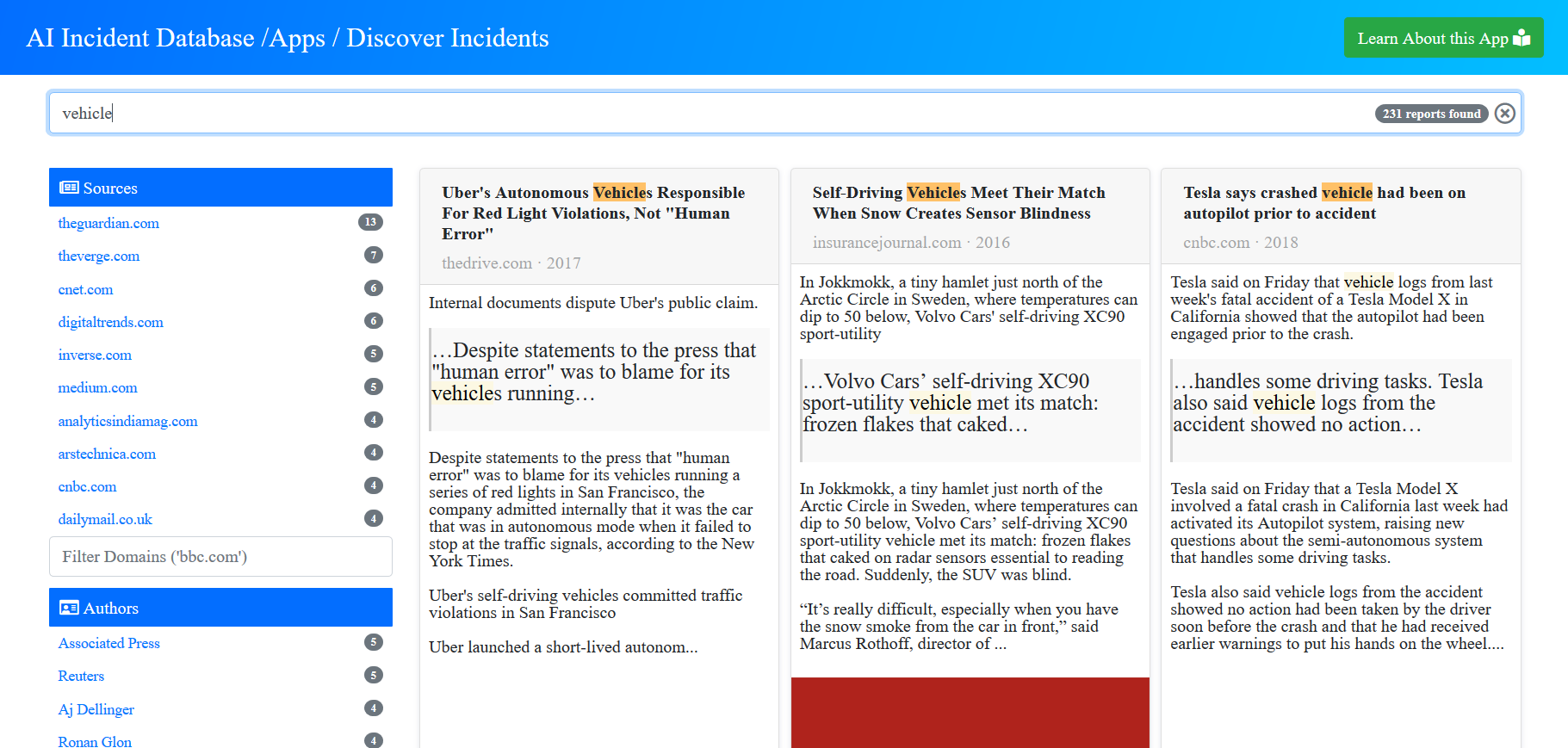

Veritabanını ziyaret edenler, anahtar kelimelere, olay kimliğine, kaynağa veya yazarına göre olaylar için sorgulama çalıştırabilir. Örneğin, “Deepfake” için arama yapmak 7 raporu döndürürken, “robotlar” için arama yapmak 158 raporu döndürür.

Yapay zeka sistemlerinin yanlış çalışması ve beklenmedik şekillerde davranmasıyla ilgili olaylar için merkezi bir veritabanı, araştırmacıların, mühendislerin ve etikçilerin yapay zeka sistemlerinin geliştirilmesini ve dağıtılmasını denetlemesine yardımcı olabilir. Teknoloji şirketlerindeki ürün müdürleri, AIID’yi kullanarak, AI öneri sistemlerini kullanmadan önce potansiyel sorunları görebilir veya bir yapay zeka mühendisi, AI uygulaması oluştururken düzeltilmesi gereken potansiyel önyargılar hakkında fikir edinebilir. Aynı şekilde, risk görevlileri, AI modeliyle ilgili potansiyel olumsuz yan etkileri belirlemek için veritabanını kullanabilir ve böylece önlemlerini planlayabilir ve potansiyel zararlara karşı önlemler geliştirebilir.

AIID’nin alt yapısı, esnek olması için tasarlandı, bu da veritabanına sorgulama yapmak ve anlamlı içgörüler elde etmek için yeni araçlar oluşturulmasını sağlar. Partnership on AI ve McGregor, tüm farklı türdeki yapay zeka olaylarını sınıflandırmak için kullanılabilen esnek bir taksonomi geliştirmek için işbirliği yapacaklar. Ekibin umudu, esnek taksonominin oluşturulduktan sonra, otomatik olarak yapay zeka olaylarını günlüğe kaydetmek için bir sistemle birleştirilebileceğidir.

“Yapay zeka topluluğu, ürünlerinde, kontrol prosedürlerinde ve araştırma programlarında değişiklikler yapmak için birbirleriyle olay kayıtlarını paylaşmaya başladı” McGregor, TechTalks aracılığıyla açıkladı. “Site, Kasım ayında kamuoyuna açıklandı, bu nedenle sistemın faydalarını henüz gerçekleştirmeye başlıyoruz.”